在iOS平臺上使用TensorFlow教程(上)

在利用深度學習網絡進行預測性分析之前,我們首先需要對其加以訓練。目前市面上存在著大量能夠用于神經網絡訓練的工具,但TensorFlow無疑是其中極為重要的首選方案之一。

大家可以利用TensorFlow訓練自己的機器學習模型,并利用這些模型完成預測性分析。訓練通常由一臺極為強大的設備或者云端資源完成,但您可能想象不到的是,TensorFlow亦可以在iOS之上順利起效——只是存在一定局限性。

在今天的博文中,我們將共同了解TensorFlow背后的設計思路、如何利用其訓練一套簡單的分類器,以及如何將上述成果引入您的iOS應用。

在本示例中,我們將使用“根據語音與對話分析判斷性別”數據集以了解如何根據音頻記錄判斷語音為男聲抑或女聲。數據集地址: https://www.kaggle.com/primaryobjects/voicegender

獲取相關代碼:大家可以通過GitHub上的對應項目獲取本示例的源代碼:https://github.com/hollance/TensorFlow-iOS-Example

TensorFlow是什么,我們為何需要加以使用?

TensorFlow是一套用于構建計算性圖形,從而實現機器學習的軟件資源庫。

其它一些工具往往作用于更高級別的抽象層級。以Caffe為例,大家需要將不同類型的“層”進行彼此互連,從而設計出一套神經網絡。而iOS平臺上的BNNS與MPSCNN亦可實現類似的功能。

在TensorFlow當中,大家亦可處理這些層,但具體處理深度將更為深入——甚至直達您算法中的各項計算流程。

大家可以將TensorFlow視為一套用于實現新型機器學習算法的工具集,而其它深度學習工具則用于幫助用戶使用這些算法。

當然,這并不是說用戶需要在TensorFlow當中從零開始構建一切。TensorFlow擁有一整套可復用的構建組件,同時囊括了Keras等負責為TensorFlow用戶提供大量便捷模塊的資源庫。

因此TensorFlow在使用當中并不強制要求大家精通相關數學專業知識,當然如果各位愿意自行構建,TensorFlow也能夠提供相應的工具。

利用邏輯回歸實現二元分類

在今天的博文當中,我們將利用邏輯回歸(logistic regression)算法創建一套分類器。沒錯,我們將從零開始進行構建,因此請大家做好準備——這可是項有點復雜的任務。所謂分類器,其基本工作原理是獲取輸入數據,而后告知用戶該數據所歸屬的類別——或者種類。在本項目當中,我們只設定兩個種類:男聲與女聲——也就是說,我們需要構建的是一套二元分類器(binary classifier)。

備注:二元分類器屬于最簡單的一種分類器,但其基本概念與設計思路同用于區分成百上千種不同類別的分類器完全一致。因此,盡管我們在本份教程中不會太過深入,但相信大家仍然能夠從中一窺分類器設計的門徑。

在輸入數據方面,我們將使用包含20個數字朗讀語音、囊括多種聲學特性的給定錄音。我將在后文中對此進行詳盡解釋,包括音頻頻率及其它相關信息。

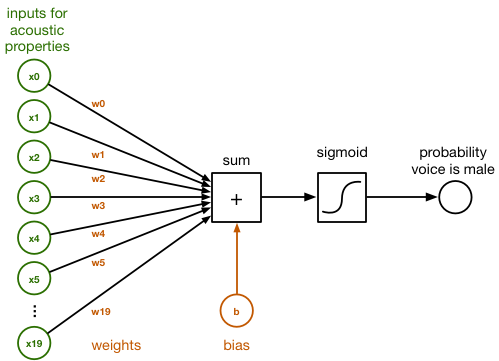

在以下示意圖當中,大家可以看到這20個數字全部接入一個名為sum的小框。這些連接擁有不同的weights(權重),對于分類器而言代表著這20個數字各自不同的重要程度。

以下框圖展示了這套邏輯分類器的起效原理:

在sum框當中,輸入數據區間為x0到x19,且其對應連接的權重w0到w19進行直接相加。以下為一項常見的點積:

- sum = x[0]*w[0] + x[1]*w[1] + x[2]*w[2] + ... + x[19]*w[19] + b

我們還在所謂bias(偏離)項的末尾加上了b。其僅僅代表另一個數字。

數組w中的權重與值b代表著此分類器所學習到的經驗。對該分類器進行訓練的過程,實際上是為了幫助其找到與w及b正確匹配的數字。最初,我們將首先將全部w與b設置為0。在數輪訓練之后,w與b則將包含一組數字,分類器將利用這些數字將輸入語音中的男聲與女聲區分開來。為了能夠將sum轉化為一條概率值——其取值在0與1之間——我們在這里使用logistic sigmoid函數:

- y_pred = 1 / (1 + exp(-sum))

這條方程式看起來很可怕,但做法卻非常簡單:如果sum是一個較大正數,則sigmoid函數返回1或者概率為100%; 如果sum是一個較大負數,則sigmoid函數返回0。因此對于較大的正或者負數,我們即可得出較為肯定的“是”或者“否”預測結論。

然而,如果sum趨近于0,則sigmoid函數會給出一個接近于50%的概率,因為其無法確定預測結果。當我們最初對分類器進行訓練時,其初始預期結果會因分類器本身訓練尚不充分而顯示為50%,即對判斷結果并無信心。但隨著訓練工作的深入,其給出的概率開始更趨近于1及0,即分類器對于結果更為肯定。

現在y_pred中包含的預測結果顯示,該語音為男聲的可能性更高。如果其概率高于0.5(或者50%),則我們認為語音為男聲; 相反則為女聲。

這即是我們這套利用邏輯回歸實現的二元分類器的基本設計原理。輸入至該分類器的數據為一段對20個數字進行朗讀的音頻記錄,我們會計算出一條權重sum并應用sigmoid函數,而我們獲得的輸出概率指示朗讀者應為男性。

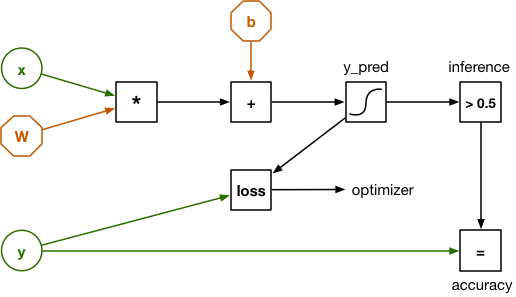

然而,我們仍然需要建立用于訓練該分類器的機制,而這時就需要請出今天的主角——TensorFlow了。在TensorFlow中實現此分類器要在TensorFlow當中使用此分類器,我們需要首先將其設計轉化為一套計算圖(computational graph)。一項計算圖由多個負責執行計算的節點組成,且輸入數據會在各節點之間往來流通。

我們這套邏輯回歸算法的計算圖如下所示:

看起來與之前給出的示意圖存在一定區別,但這主要是由于此處的輸入內容x不再是20個獨立的數字,而是一個包含有20個元素的向量。在這里,權重由矩陣W表示。因此,之前得出的點積也在這里被替換成了一項矩陣乘法。

另外,本示意圖中還包含一項輸入內容y。其用于對分類器進行訓練并驗證其運行效果。我們在這里使用的數據集為一套包含3168條example語音記錄的集合,其中每條示例記錄皆被明確標記為男聲或女聲。這些已知男聲或女聲結果亦被稱為該數據集的label(標簽),并作為我們交付至y的輸入內容。

為了訓練我們的分類器,這里需要將一條示例加載至x當中并允許該計算圖進行預測:即語音到底為男聲抑或是女聲?由于初始權重值全部為0,因此該分類器很可能給出錯誤的預測。我們需要一種方法以計算其錯誤的“具體程度”,而這一目標需要通過loss函數實現。Loss函數會將預測結果y_pred與正確輸出結果y進行比較。

在將loss函數提供給訓練示例后,我們利用一項被稱為backpropagation(反向傳播)的技術通過該計算圖進行回溯,旨在根據正確方向對W與b的權重進行小幅調整。如果預測結果為男聲但實際結果為女聲,則權重值即會稍微進行上調或者下調,從而在下一次面對同樣的輸入內容時增加將其判斷為“女聲”的概率。

這一訓練規程會利用該數據集中的全部示例進行不斷重復再重復,直到計算圖本身已經獲得了最優權重集合。而負責衡量預測結果錯誤程度的loss函數則因此隨時間推移而變低。

反向傳播在計算圖的訓練當中扮演著極為重要的角色,但我們還需要加入一點數學手段讓結果更為準確。而這也正是TensorFlow的專長所在:我們只要將全部“前進”操作表達為計算圖當中的節點,其即可自動意識到“后退”操作代表的是反向傳播——我們完全無需親自進行任何數學運算。太棒了!

Tensorflow到底是什么?

在以上計算圖當中,數據流向為從左至右,即代表由輸入到輸出。而這正是TensorFlow中“流(flow)”的由來。不過Tensor又是什么?

Tensor一詞本義為張量,而此計算圖中全部數據流皆以張量形式存在。所謂張量,其實際代表的就是一個n維數組。我曾經提到W是一項權重矩陣,但從TensorFlow的角度來看,其實際上屬于一項二階張量——換言之,一個二組數組。

- 一個標量代表一個零階張量。

- 一個向量代表一個一階張量。

- 一個矩陣代表一個二階張量。

- 一個三維數組代表一個三階張量。

之后以此類推……

這就是Tensor的全部含義。在卷積神經網絡等深度學習方案當中,大家會需要與四維張量打交道。但本示例中提到的邏輯分類器要更為簡單,因此我們在這里最多只涉及到二階張量——即矩陣。

我之前還提到過,x代表一個向量——或者說一個一階張量——但接下來我們同樣將其視為一個矩陣。y亦采用這樣的處理方式。如此一來,我們即可將數據庫組視為整體對其loss進行計算。

一條簡單的示例(example)語音內包含20個數據元素。如果大家將全部3168條示例加載至x當中,則x會成為一個3168 x 20的矩陣。再將x與W相乘,則得出的結果y_pred為一個3168 x 1的矩陣。具體來講,y_pred代表的是為數據集中的每條語音示例提供一項預測結論。

通過將我們的計算圖以矩陣/張量的形式進行表達,我們可以一次性對多個示例進行預測。

安裝TensorFlow

好的,以上是本次教程的理論基礎,接下來進入實際操作階段。

我們將通過Python使用TensorFlow。大家的Mac設備可能已經安裝有某一Python版本,但其版本可能較為陳舊。在本教程中,我使用的是Python 3.6,因此大家最好也能安裝同一版本。

安裝Python 3.6非常簡單,大家只需要使用Homebrew軟件包管理器即可。如果大家還沒有安裝homebrew,請點擊此處參閱相關指南。

接下來打開終端并輸入以下命令,以安裝Python的最新版本:

- brew install python3

Python也擁有自己的軟件包管理器,即pip,我們將利用它安裝我們所需要的其它軟件包。在終端中輸入以下命令:

- pip3 install numpy

- pip3 install scipy

- pip3 install scikit-learn

- pip3 install pandas

- pip3 install tensorflow

除了TensorFlow之外,我們還需要安裝NumPy、SciPy、pandas以及scikit-learn:

NumPy是一套用于同n級數組協作的庫。聽起來耳熟嗎?NumPy并非將其稱為張量,但之前提到了數組本身就是一種張量。TensorFlow Python API就建立在NumPy基礎之上。

SciPy是一套用于數值計算的庫。其它一些軟件包的起效需要以之為基礎。

pandas負責數據集的加載與清理工作。

scikit-learn在某種意義上可以算作TensorFlow的競爭對手,因為其同樣是一套用于機器學習的庫。我們之所以在本項目中加以使用,是因為它具備多項便利的功能。由于TensorFlow與scikit-learn皆使用NumPy數組,因為二者能夠順暢實現協作。

實際上,大家無需pandas與scikit-learn也能夠使用TensorFlow,但二者確實能夠提供便捷功能,而且每一位數據科學家也都樂于加以使用。

如大家所知,這些軟件包將被安裝在/usr/local/lib/python3.6/site-packages當中。如果大家需要查看部分未被公布在其官方網站當中的TensorFlow源代碼,則可以在這里找到。

備注:pip應會為您的系統自動安裝TensorFlow的最佳版本。如果大家希望安裝其它版本,則請點擊此處參閱官方安全指南。另外,大家也可以利用源代碼自行構建TensorFlow,這一點我們稍后會在面向iOS構建TensorFlow部分中進行說明。

下面我們進行一項快速測試,旨在確保一切要素都已經安裝就緒。利用以下內容創建一個新的tryit.py文件:

- import tensorflow as tf

- a = tf.constant([1, 2, 3])

- b = tf.constant([4, 5, 6])

- sess = tf.Session(config=tf.ConfigProto(log_device_placement=True))

- print(sess.run(a + b))

而后通過終端運行這套腳本:

- python3 tryit.py

其會顯示一些與TensorFlow運行所在設備相關的調試信息(大多為CPU信息,但如果您所使用的Mac設備配備有英偉達GPU,亦可能提供GPU信息)。最終結果顯示為:

- [5 7 9]

這里代表的是兩個向量a與b的加和。另外,大家可能還會看到以下信息:

- W tensorflow/core/platform/cpu_feature_guard.cc:45] The TensorFlow library wasn't compiled to use SSE4.1 instructions, but these are available on your machine and could speed up CPU computations.

如果出現上述內容,則代表您在系統當中安裝的TensorFlow并非當前CPU的最優適配版本。修復方法之一是利用源代碼自行構建TensorFlow,因為這允許大家對全部選項加以配置。但在本示例當中,由于其不會造成什么影響,因此直接忽略即可。深入觀察訓練數據集

要訓練分類器,我們自然需要數據。

在本項目當中,我們使用來自Kory Becker的“根據語音判斷性別”數據集。為了能夠讓這份教程能夠與TensorFlow指南上的MNIST數字化識別有所不同,這里我決定在Kaggle.com上尋找數據集,并最終選定了這一套。

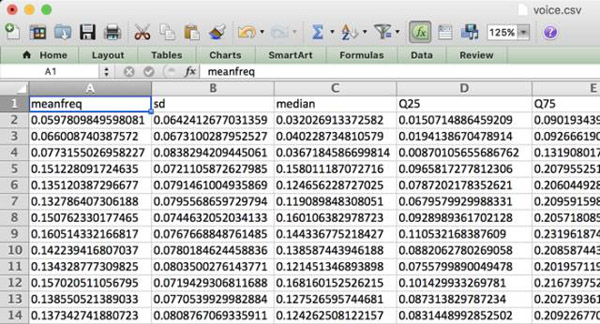

那么我們到底該如何立足音頻實現性別判斷?下載該數據集并打開voice.csv文件之后,大家會看到其中包含著一排排數字:

我們首先需要強調這一點,這里列出的并非實際音頻數據!相反,這些數字代表著語音記錄當中的不同聲學特征。這些屬性或者特征由一套腳本自音頻記錄中提取得出,并被轉化為這個CSV文件。具體提取方式并不屬于本篇文章希望討論的范疇,但如果大家感興趣,則可點擊此處查閱其原始R源代碼。

這套數據集中包含3168項示例(每項示例在以上表格中作為一行),且基本半數為男聲錄制、半數為女聲錄制。每一項示例中存在20項聲學特征,例如:

- 以kHz為單位的平均頻率

- 頻率的標準差

- 頻譜平坦度

- 頻譜熵

- 峰度

- 聲學信號中測得的最大基頻

- 調制指數

- 等等……

別擔心,雖然我們并不了解其中大多數條目的實際意義,但這不會影響到本次教程。我們真正需要 關心的是如何利用這些數據訓練自己的分類器,從而立足于上述特征確保其有能力區分男性與女性的語音。

如果大家希望在一款應用程序當中使用此分類器,從而通過錄音或者來自麥克風的音頻信息檢測語音性別,則首先需要從此類音頻數據中提取聲學特征。在擁有了這20個數字之后,大家即可對其分類器加以訓練,并利用其判斷語音內容為男聲還是女聲。

因此,我們的分類器并不會直接處理音頻記錄,而是處理從記錄中提取到的聲學特征。

備注:我們可以以此為起點了解深度學習與邏輯回歸等傳統算法之間的差異。我們所訓練的分類器無法學習非常復雜的內容,大家需要在預處理階段提取更多數據特征對其進行幫助。在本示例的特定數據集當中,我們只需要考慮提取音頻記錄中的音頻數據。

深度學習最酷的能力在于,大家完全可以訓練一套神經網絡來學習如何自行提取這些聲學特征。如此一來,大家不必進行任何預處理即可利用深度學習系統采取原始音頻作為輸入內容,并從中提取任何其認為重要的聲學特征,而后加以分類。

這當然也是一種有趣的深度學習探索方向,但并不屬于我們今天討論的范疇,因此也許日后我們將另開一篇文章單獨介紹。

建立一套訓練集與測試集

在前文當中,我提到過我們需要以如下步驟對分類器進行訓練:

- 向其交付來自數據集的全部示例。

- 衡量預測結果的錯誤程度。

- 根據loss調整權重。

事實證明,我們不應利用全部數據進行訓練。我們只需要其中的特定一部分數據——即測試集——從而評估分類器的實際工作效果。因此,我們將把整體數據集拆分為兩大部分:訓練集,用于對分類器進行訓練; 測試集,用于了解該分類器的預測準確度。

為了將數據拆分為訓練集與測試集,我創建了一套名為split_data.py的Python腳本,其內容如下所示:

- import numpy as np # 1

- import pandas as pd df = pd.read_csv("voice.csv", header=0) #2

- labels = (df["label"] == "male").values * 1 # 3

- labels = labels.reshape(-1, 1) # 4

- del df["label"] # 5

- data = df.values

- # 6

- from sklearn.model_selection import train_test_split X_train,

- X_test, y_train, y_test = train_test_split(data, labels, test_size=0.3, random_state=123456)

- np.save("X_train.npy", X_train) # 7

- np.save("X_test.npy", X_test)

- np.save("y_train.npy", y_train)

- np.save("y_test.npy", y_test)

下面我們將分步驟了解這套腳本的工作方式:

- 首先導入NumPy與pandas軟件包。Pandas能夠輕松實現CSV文件的加載,并對數據進行預處理。

- 利用pandas從voice.csv加載數據集并將其作為dataframe。此對象在很大程度上類似于電子表格或者SQL表。

- 這里的label列包含有該數據集的各項標簽:即該示例為男聲或者女聲。在這里,我們將這些標簽提取進一個新的NumPy數組當中。各原始標簽為文本形式,但我們將其轉化為數字形式,其中1=男聲,0=女聲。(這里的數字賦值方式可任意選擇,在二元分類器中,我們通常使用1表示‘正’類,或者說我們試圖檢測的類。)

- 這里創建的新labels數組是一套一維數組,但我們的TensorFlow腳本則需要一套二維張量,其中3168行中每一行皆對應一列。因此我們需要在這里對數組進行“重塑”,旨在將其轉化為二維形式。這不會對內存中的數據產生影響,而僅變化NumPy對數據的解釋方式。

- 在完成label列之后,我們將其從dataframe當中移除,這樣我們就只剩下20項用于描述輸入內容的特征。我們還將把該dataframe轉換為一套常規NumPy數組。

- 這里,我們利用來自scikit-learn的一項helper函數將data與labels數組拆分為兩個部分。這種對數據集內各示例進行隨機洗牌的操作基于random_state,即一類隨機生成器。無論具體內容為何,但只要青筋相同內容,我們即創造出了一項可重復進行的實驗。

- 最后,將四項新的數組保存為NumPy的二進制文件格式。現在我們已經擁有了一套訓練集與一套測試集!

大家也可以進行額外的一些預處理對腳本中的數據進行調整,例如對特征進行擴展,從而使其擁有0均值及相等的方差,但由于本次示例項目比較簡單,所以并無深入調整的必要。

利用以下命令在終端中運行這套腳本:

- python3 split_data.py

這將給我們帶來4個新文件,其中包含有訓練救命(X_train.npy)、這些示例的對應標簽(y_train.npy)、測試示例(X_test.npy)及其對應標簽(y_test.npy)。

備注:大家可能想了解為什么這些變量名稱為何有些是大寫,有些是小寫。在數學層面來看,矩陣通常以大寫表示而向量則以小寫表示。在我們的腳本中,X代表一個矩陣,y代表一個向量。這是一種慣例,大部分機器學習代碼中皆照此辦理。

建立計算圖

現在我們已經對數據進行了梳理,而后即可編寫一套腳本以利用TensorFlow對這套邏輯分類器進行訓練。這套腳本名為train.py。為了節省篇幅,這里就不再列出腳本的具體內容了,大家可以點擊此處在GitHub上進行查看。

與往常一樣,我們首先需要導入需要的軟件包。在此之后,我們將訓練數據加載至兩個NumPy數組當中,即X_train與y_train。(我們在本腳本中不會使用測試數據。)

- import numpy as np

- import tensorflow as tf

- X_train = np.load("X_train.npy")

- y_train = np.load("y_train.npy")

現在我們可以建立自己的計算圖。首先,我們為我們的輸入內容x與y定義所謂placeholders(占位符):

- num_inputs = 20

- num_classes = 1

- with tf.name_scope("inputs"):

- x = tf.placeholder(tf.float32, [None, num_inputs], name="x-input")

- y = tf.placeholder(tf.float32, [None, num_classes], name="y-input")

其中tf.name_scope("...")可用于對該計算圖中的不同部分按不同范圍進行分組,從而簡化對計算圖內容的理解。我們將x與y添加至“inputs”范圍之內。我們還將為其命名,分別為“x-input”與“y-input”,這樣即可在隨后輕松加以引用。

大家應該還記得,每條輸入示例都是一個包含20項元素的向量。每條示例亦擁有一個標簽(1代表男聲,0代表女聲)。我之前還提到過,我們可以將全部示例整合為一個矩陣,從而一次性對其進行全面計算。正因為如此,我們這里將x與y定義為二維張量:x擁有[None, 20]維度,而y擁有[None, 1]維度。

其中的None代表第一項維度為靈活可變且目前未知。在訓練集當中,我們將2217條示例導入x與y; 而在測試集中,我們引入951條示例。現在,TensorFlow已經了解了我們的輸入內容,接下來對分類器的parameters(參數)進行定義:

- with tf.name_scope("model"):

- W = tf.Variable(tf.zeros([num_inputs, num_classes]), name="W")

- b = tf.Variable(tf.zeros([num_classes]), name="b")

其中的張量W包含有分類器將要學習的權重(這是一個20 x 1矩陣,因為其中包含20條輸入特征與1條輸出結果),而b則包含偏離值。這二者被聲明為TensorFlow變量,意味著二者可在反向傳播過程當中實現更新。

在一切準備就緒之后,我們可以對作為邏輯回歸分類器核心的計算流程進行聲明了:

- y_pred = tf.sigmoid(tf.matmul(x, W) + b)

這里將x與W進行相乘,同時加上偏離值b,而后取其邏輯型成長曲線(logistic sigmoid)。如此一來,y_pred中的結果即根據x內音頻數據的描述特性而被判斷為男聲的概率。

備注:以上代碼目前實際還不會做出任何計算——截至目前,我們還只是構建起了必要的計算圖。這一行單純是將各節點添加至計算圖當中以作為矩陣乘法(tf.matmul)、加法(+)以及sigmoid函數(tf.sigmoid)。在完成整體計算圖的構建之后,我們方可創建TensorFlow會話并利用實際數據加以運行。

到這里任務還未完成。為了訓練這套模型,我們需要定義一項loss函數。對于一套二元邏輯回歸分類器,我們需要使用log loss,幸運的是TensorFlow本身內置有一項log_loss()函數可供直接使用:

- with tf.name_scope("loss-function"):

- loss = tf.losses.log_loss(labels=y, predictions=y_pred)

- loss += regularization * tf.nn.l2_loss(W)

其中的log_loss計算圖節點作為輸入內容y,我們會獲取與之相關的示例標簽并將其與我們的預測結果y_pred進行比較。以數字顯示的結果即為loss值。

在剛開始進行訓練時,所有示例的預測結果y_pred皆將為0.5(或者50%男聲),這是因為分類器本身尚不清楚如何獲得正確答案。其初始loss在經-1n(0.5)計算后得出為0.693146。而在訓練的推進當中,其loss值將變得越來越小。

第二行用于計算loss值與所謂L2 regularization(正則化)的加值。這是為了防止過度擬合阻礙分類器對訓練數據的準確記憶。這一過程比較簡單,因為我們的分類器“內存”只包含20項權重值與偏離值。不過正則化本身是一種常見的機器學習技術,因此在這里必須一提。

這里的regularization值為另一項占位符:

- with tf.name_scope("hyperparameters"):

- regularization = tf.placeholder(tf.float32, name="regularization")

- learning_rate = tf.placeholder(tf.float32, name="learning-rate")

我們還將利用占位符定義我們的輸入內容x與y,不過二者的作用是定義hyperparameters。

Hyperparameters允許大家對這套模型及其具體訓練方式進行配置。其之所以被稱為“超”參數,是因為與常見的W與b參數不同,其并非由模型自身所學習——大家需要自行將其設置為適當的值。

其中的learning_rate超參數負責告知優化器所應采取的調整幅度。該優化器(optimizer)負責執行反向傳播:其會提取loss值并將其傳遞回計算圖以確定需要對權重值與偏離值進行怎樣的調整。這里可以選擇的優化器方案多種多樣,而我們使用的為ADAM:

- with tf.name_scope("train"):

- optimizer = tf.train.AdamOptimizer(learning_rate)

- train_op = optimizer.minimize(loss)

其能夠在計算圖當中創建一個名為train_op的節點。我們稍后將運行此節點以訓練分類器。為了確定該分類器的運行效果,我們還需要在訓練當中偶爾捕捉快照并計算其已經能夠在訓練集當中正確預測多少項示例。訓練集的準確性并非分類器運行效果的最終檢驗標準,但對其進行追蹤能夠幫助我們在一定程度上把握訓練過程與預測準確性趨勢。具體來講,如果越是訓練結果越差,那么一定是出了什么問題!

下面我們為一個計算圖節點定義計算精度:

- with tf.name_scope("score"):

- correct_prediction = tf.equal(tf.to_float(y_pred > 0.5), y)

- accuracy = tf.reduce_mean(tf.to_float(correct_prediction), name="accuracy")

我們可以運行其中的accuracy節點以查看有多少個示例得到了正確預測。大家應該還記得,y_pred中包含一項介于0到1之間的概率。通過進行tf.to_float(y_pred > 0.5),若預測結果為女聲則返回值為0,若預測結果為男聲則返回值為1。我們可以將其與y進行比較,y當中包含有正確值。而精度值則代表著正確預測數量除以預測總數。

在此之后,我們將利用同樣的accuracy節點處理測試集,從而了解這套分類器的實際工作效果。

另外,我們還需要定義另外一個節點。此節點用于對我們尚無對應標簽的數據進行預測:

- with tf.name_scope("inference"):

- inference = tf.to_float(y_pred > 0.5, name="inference")

為了將這套分類器引入應用,我們還需要記錄幾個語音文本詞匯,對其進行分析以提取20項聲學特征,而后再將其交付至分類器。由于處理內容屬于全新數據,而非來自訓練或者測試集的數據,因此我們顯然不具備與之相關的標簽。大家只能將數據直接交付至分類器,并希望其能夠給出正確的預測結果。而inference節點的作用也正在于此。

好的,我們已經投入了大量精力來構建這套計算圖。現在我們希望利用訓練集對其進行實際訓練。

訓練分類器

訓練通常以無限循環的方式進行。不過對于這套簡單的邏輯分類器,這種作法顯然有點夸張——因為其不到一分鐘即可完成訓練。但對于深層神經網絡,我們往往需要數小時甚至數天時間進行腳本運行——直到其獲得令人滿意的精度或者您開始失去耐心。

以下為train.py當中訓練循環的第一部分:

- with tf.Session() as sess:

- tf.train.write_graph(sess.graph_def, checkpoint_dir, "graph.pb", False)

- sess.run(init)

- step = 0

- while True:

- # here comes the training code

我們首先創建一個新的TensorFlow session(會話)對象。要運行該計算圖,大家需要建立一套會話。調用sess.run(init)會將W與b全部重設為0。

我們還需要將該計算圖寫入一個文件。我們將之前創建的全部節點序列至/tmp/voice/graph.pb文件當中。我們之后需要利用此計算圖定義以立足測試集進行分類器運行,并嘗試將該訓練后的分類器引入iOS應用。

在while True:循環當中,我們使用以下內容:

- perm = np.arange(len(X_train))

- np.random.shuffle(perm)

- X_train = X_train[perm]

- y_train = y_train[perm]

首先,我們對訓練示例進行隨機洗牌。這一點非常重要,因為大家當然不希望分類器根據示例的具體順序進行判斷——而非根據其聲學特征進行判斷。

接下來是最重要的環節:我們要求該會話運行train_op節點。其將在計算圖之上運行一次訓練:

- feed = {x: X_train, y: y_train, learning_rate: 1e-2,

- regularization: 1e-5}

- sess.run(train_op, feed_dict=feed)

在運行sess.run()時,大家還需要提供一套饋送詞典。其將負責告知TensorFlow當前占位符節點的實際值。

由于這只是一套非常簡單的分類器,因此我們將始終一次性對全部訓練集進行訓練,所以這里我們將X_train數組引入占位符x并將y_train數組引入占位符y。(對于規模更大的數據集,大家可以先從小批數據內容著手,例如將示例數量設定為100到1000之間。)

到這里,我們的操作就階段性結束了。由于我們使用了無限循環,因此train_op節點會反復再反復加以執行。而在每一次迭代時,其中的反向傳播機制都會對權重值W與b作出小幅調整。隨著時間推移,這將令權重值逐步趨近于最優值。

我們當然有必要了解訓練進度,因此我們需要經常性地輸出進度報告(在本示例項目中,每進行1000次訓練即輸出一次結果):

- if step % print_every == 0:

- train_accuracy, loss_value = sess.run([accuracy, loss], feed_dict=feed)

- print("step: %4d, loss: %.4f, training accuracy: %.4f" % \

- (step, loss_value, train_accuracy))

這一次我們不再運行train_op節點,而是運行accuracy與loss兩個節點。我們使用同樣的饋送詞典,這樣accuracy與loss都會根據訓練集進行計算。正如之前所提到,訓練集中的較高預測精度并不代表分類器能夠在處理測試集時同樣擁有良好表現,但大家當然希望隨著訓練的進行其精度值不斷提升。與此同時,loss值則應不斷下降。

另外,我們還需要時不時保存一份checkpoint:

- if step % save_every == 0:

- checkpoint_file = os.path.join(checkpoint_dir, "model")

- saver.save(sess, checkpoint_file)

- print("*** SAVED MODEL ***")

其會獲取分類器當前已經學習到的W與b值,并將其保存為一個checkpoint文件。此checkpoint可供我們參閱,并判斷分類器是否已經可以轉而處理測試集。該checkpoinit文件同樣被保存在/tmp/voice/目錄當中。

使用以下命令在終端中運行該訓練腳本:

- python3 train.py

輸出結果應如下所示:

- Training set size: (2217, 20)

- Initial loss: 0.693146

- step: 0, loss: 0.7432, training accuracy: 0.4754

- step: 1000, loss: 0.4160, training accuracy: 0.8904

- step: 2000, loss: 0.3259, training accuracy: 0.9170

- step: 3000, loss: 0.2750, training accuracy: 0.9229

- step: 4000, loss: 0.2408, training accuracy: 0.9337

- step: 5000, loss: 0.2152, training accuracy: 0.9405

- step: 6000, loss: 0.1957, training accuracy: 0.9553

- step: 7000, loss: 0.1819, training accuracy: 0.9594

- step: 8000, loss: 0.1717, training accuracy: 0.9635

- step: 9000, loss: 0.1652, training accuracy: 0.9666

- *** SAVED MODEL ***

- step: 10000, loss: 0.1611, training accuracy: 0.9702

- step: 11000, loss: 0.1589, training accuracy: 0.9707

- . . .

當發現loss值不再下降時,就稍等一下直到看到下一條*** SAVED MODEL ***信息,這時按下Ctrl+C以停止訓練。

在超參數設置當中,我選擇了正規化與學習速率,大家應該會看到其訓練集的準確率已經達到約97%,而loss值則約為0.157。(如果大家在饋送詞典中將regularization設置為0,則loss甚至還能夠進一步降低。)

上半部分到此結束,下半部分我們將察看訓練的實際效果,以及如何在iOS上使用TensorFlow,最后討論一下iOS上使用TensorFlow的優劣。