微信基于時間序的海量存儲擴展性與多機容災能力提升

背景介紹

業務場景

作為以手機為主要平臺的移動社交應用,微信內大部分業務生成的數據是有共性可言的:數據鍵值帶有時間戳信息,并且單用戶數據隨著時間在不斷的生成,我們將這類數據稱為基于時間序的數據。例如朋友圈的發表,支付賬單流水,公眾號文章閱讀記錄等。這類基于時間序的數據通常不會刪除,而是會隨著時間流逝不斷積累,相應需要的存儲空間也與日俱增:key 量在萬億級別,數據量達到 PB 級別,每天新增 key 十億級別。同時在十億用戶的加持下,每天的訪問量也高達萬億級別。

訪問模型

經過數據分析,我們發現基于時間序的存儲一般有如下三個特點:

- 讀多寫少,這類基于時間序的存儲,如果需要訪問一段時間內的數據就需要對對應時間段內的所有鍵值對都進行一次訪問。與全部寫入到一個鍵值對的場景相比可以視為讀擴散的場景。部分業務場景下的讀寫比甚至高達 100:1。

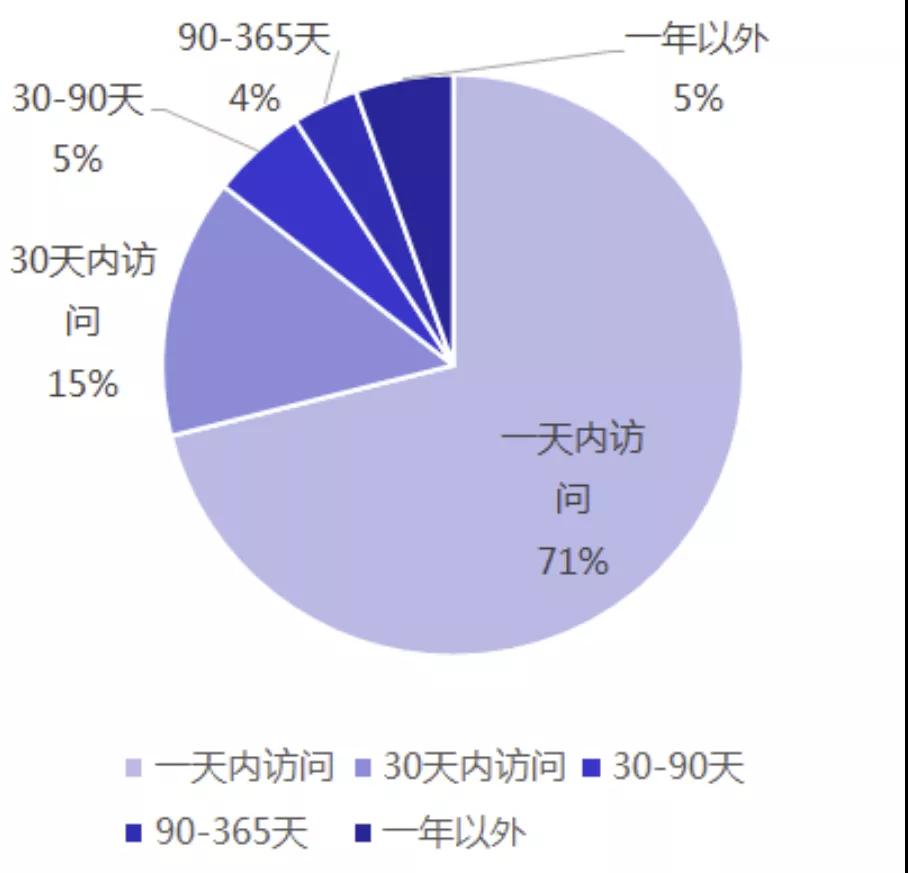

- 冷熱分明,這類基于時間序的存儲,數據的時效性往往也決定了訪問頻率。比如對用戶進行公眾號文章的推薦,用戶近期的閱讀記錄會更加具有參考意義。這就導致數據的訪問不是均勻的,而會更集中在最近一段時間所產生的數據。以某業務場景為例,70%以上的訪問來自最近一天內的新增數據,90%來自 3 個月內的新增數據。一年外的數據訪問占比只有 5%。

- 數據安全性要求高,這類數據通常是由用戶主動產生,一旦丟失,非常容易被用戶感知,導致投訴。

現有架構

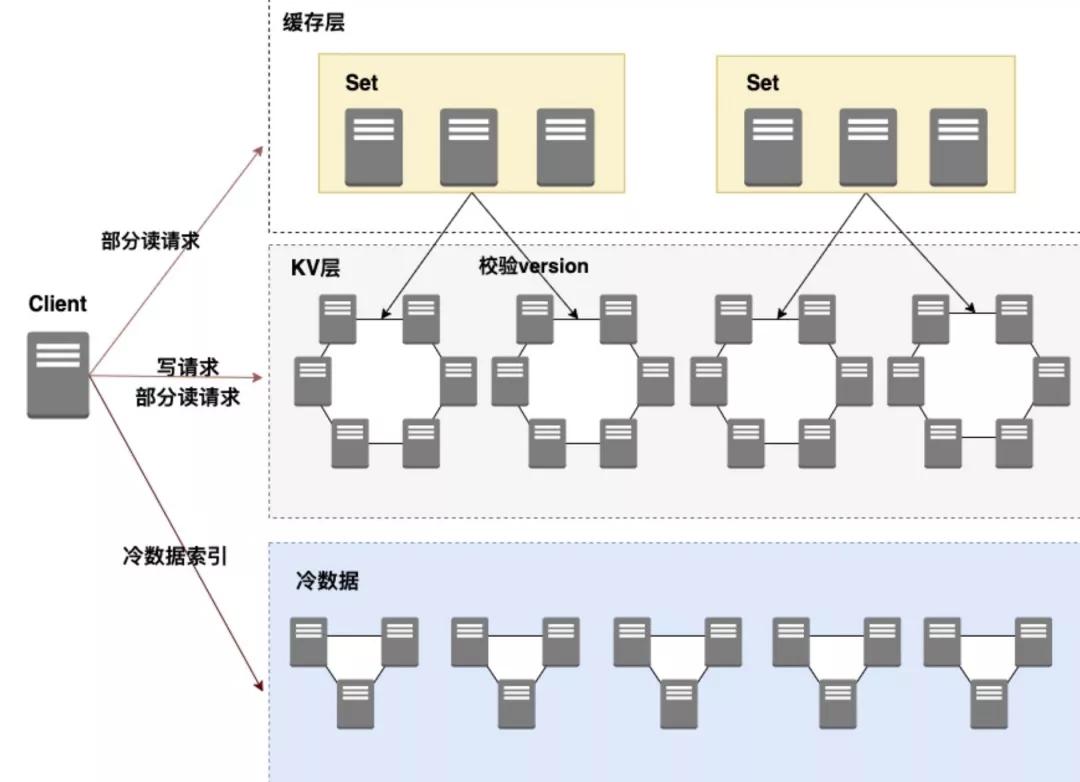

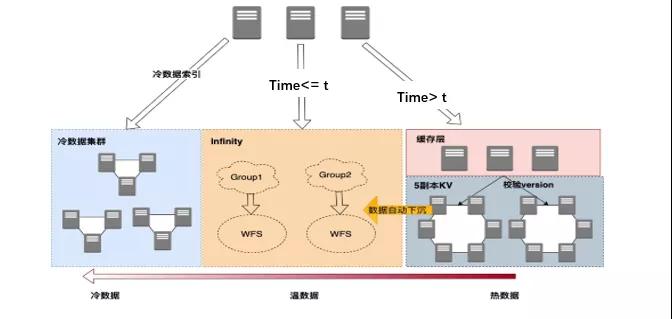

此前,我們使用一致性緩存層+SSD 熱數據層+機械盤冷數據層的分層架構方案來解決此類基于時間序的存儲。細節可以參考《微信后臺基于時間序的海量數據冷熱分級架構設計實踐》。

對于冷數據集群,我們使用微信自研的 WFS(Wechat File System 微信分布式文件系統)對其進行了一次升級,極大的簡化了運維成本。不過這部分不是本文重點,在此不再詳述。

面臨挑戰

舊架構在過去幾年微信后臺的發展過程中始終表現平穩,但是也依然面臨著一些挑戰。

首先是擴展能力方面的挑戰。舊架構中,考慮到讀多寫少的訪問模型,為了加快宕機后的數據 catchup 速度,我們使用了細粒度的 paxos group,即每個 key 有一個獨立的 paxos group。這樣在進程重啟等宕機場景下,只有少量寫入的 key 需要進行 catchup。理想很豐滿,現實很骨感。在 PaxosStore 架構中,數據的擴縮容是以 paxos group 為粒度的。也就是說,對于使用細粒度 paxos group 的存儲,進行擴縮容是逐 key 的,耗時可以看成與 key 量成正比;單機百億級別的 key 量放大了這一問題,即使我們采取一系列的工程優化縮短耗時,整體的遷移周期依然比較長,需要幾周時間。

另外一個方面則是來自容災能力的挑戰。PaxosStore 使用 KV64+三園區的部署方式。同一個 key 的三個副本分屬三個園區,同一個園區的兩臺機器服務分片沒有重疊,因此可以容忍園區級別的故障。然而對于同組兩臺不同園區機器故障的情況,則有占比 1/6 的數據只剩余單個副本,無法提供讀寫服務。

可能有同學會認為,同組兩臺不同園區機器故障,概率無異于中彩票。然而根據墨菲定律,"凡是可能出錯的事情,最終一定會出錯"。在過去幾年也曾出現過同 Set 兩臺不同園區機器先后發生故障的情況。

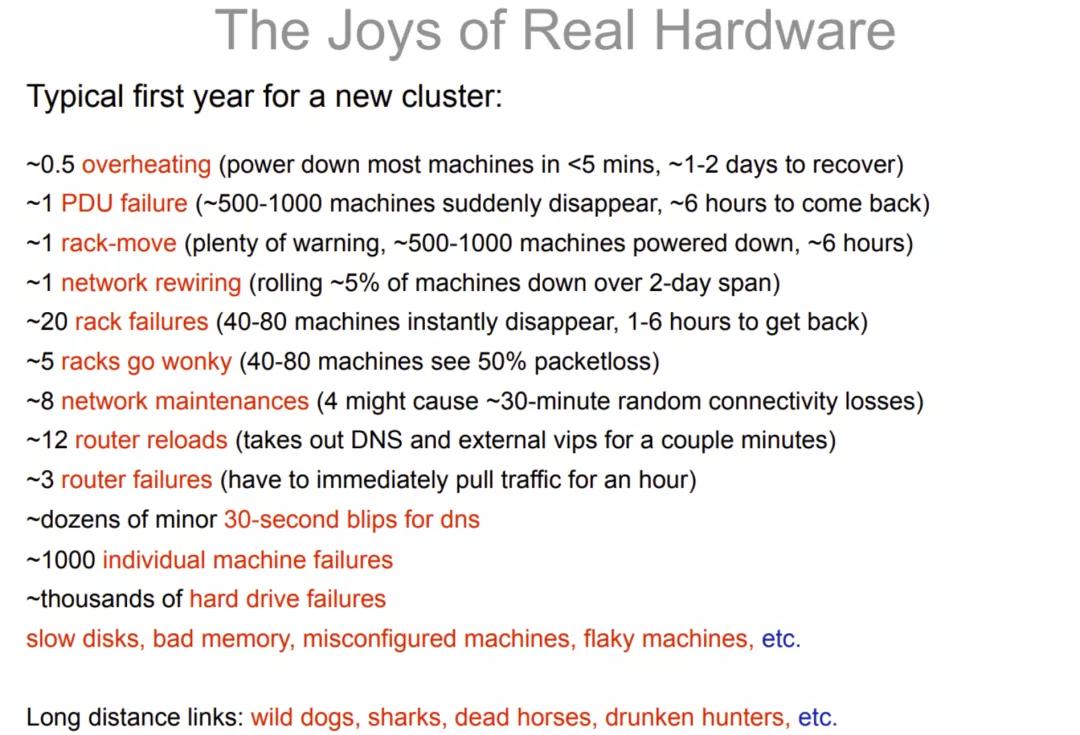

我們都知道,分布式系統的一個核心觀點就是基于海量的,不可靠的硬件,構造可靠的系統。那么硬件究竟有多不可靠呢?Jeff Dean 在 2009 年的一次 Talk 中曾經提到過:

PaxosStore 使用 no raid 的磁盤陣列,磁盤故障導致單盤數據丟失時有發生。在機器故障檢修以及數據恢復的過程中,有大量數據(占單組 50%,逐漸收斂為 0)是以 2 副本形式存在,這就進一步削弱了系統的容災能力。

總結一下,我們面臨如下幾個挑戰:

- 單機百億級別 key 量,10TB 級別數據,如何快速擴容?

- 如何低成本的提升系統的容災能力,使之容忍任意雙機故障?

- 磁盤故障,數據清空后如何快速恢復。

- 作為一款十億月活的國民 APP,對其進行改造無異于給一架正在飛行的飛機更換發動機,改造過程稍有不慎都可能招致用戶投訴,甚至上個熱搜。

接下來我會針對這幾個難點逐一展開,介紹我們的解決思路與方案。

百億級別 key 如何實現快速擴容

對于細粒度的的 paxos group,遷移過程中,掃 key,遷移,校驗等步驟都是逐 key 粒度的。這會產生大量的磁盤 IO 與 CPU 消耗,導致遷移速度上不去,需要幾周才可以完成遷移。

那么我們能否可以采取粗粒度 paxos group 以加快遷移呢?答案是肯定的。對比細粒度的 paxos group,單個粗粒度的 paxos group 可以同時保證多個 key 的內容強一致。因此遷移校驗等過程中,可以減少大量的 paxos 交互。然而粗粒度 paxos group 的存儲,與細粒度 paxos group 的存儲相比,在遷移過程中對目標集群的寫入不會減少,總體依然涉及了大量數據的騰挪。而由于 LSMTree 存儲引擎存在的寫放大問題,數據大量寫入目標機這一過程會成為瓶頸。總體來看,擴容時間可以縮短為原來的 1/2 甚至 1/3,達到天級別的水平。

看起來相比細粒度 paxos group 的遷移已經有很大改進,我們能否更進一步?首先我們分析一下在什么場景下需要擴容,一般來說是以下兩個場景:

1.由于數據增加,磁盤容量達到瓶頸

2.由于請求增加,CPU 處理能力達到瓶頸

對于情況 1,如果我們使用分布式文件系統替代本地文件系統,當容量達到瓶頸時只需要增加分布式文件系統的機器就可以實現容量的快速擴容,對上層應用而言相當于獲得了一塊容量可以無限增長的磁盤。對于情況 2,采用計算存儲分離結構后。計算節點無狀態,不涉及數據騰挪,自然可以實現快速擴容;如果是存儲層節點 CPU 瓶頸,也可以通過文件塊級別的騰挪來實現快速擴容以及熱點打散。

應用計算存儲分離的思路,我們基于 WFS(微信分布式文件系統)以及微信 Chubby(分布式鎖),實現了一套計算存儲分離的存儲架構,代號 Infinity,寓意無限的擴展能力。

"All problems in computer science can be solved by another level of indirection"

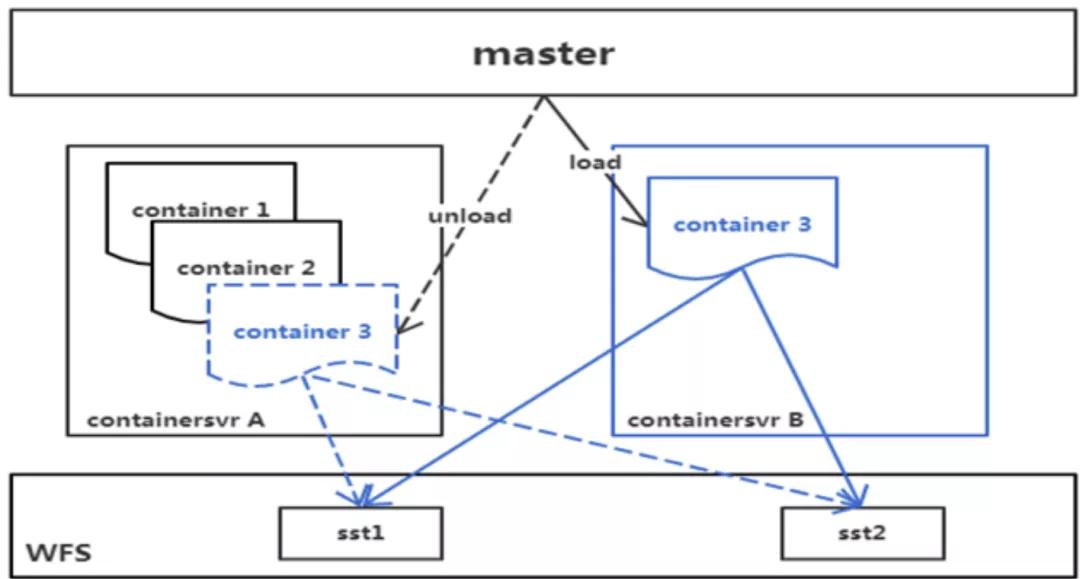

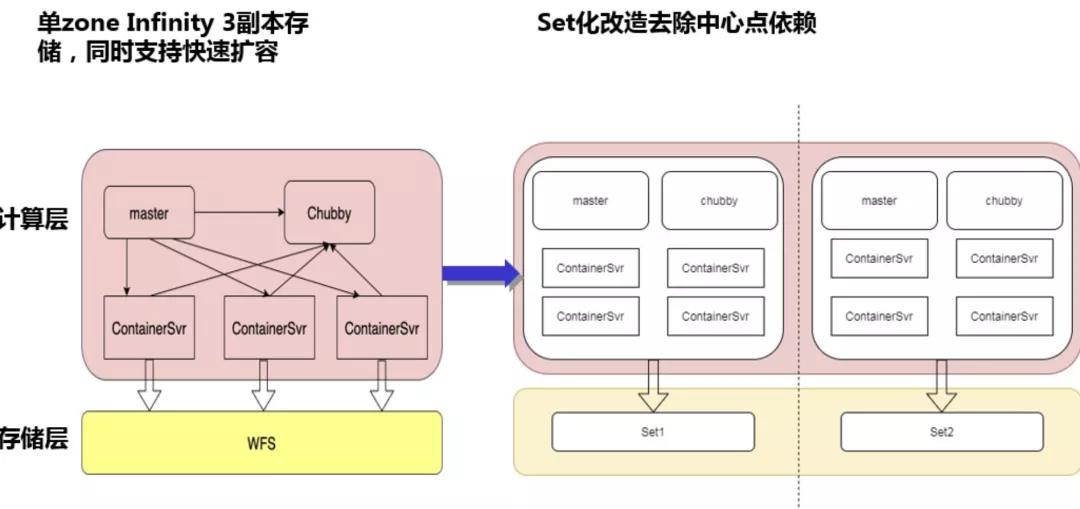

在 Infinity 中,我們引入了一個被稱為 Container 的中間層。Container 可以近似理解為一個數據分片。每臺機器可以裝載一個或多個 Container,我們稱之為 ContainerServer。ContainerServer 會處理其上 Container 對應數據的讀寫請求,Master 負責 Container 在 ContainerServer 間的調度,Chubby 則提供了分布式鎖服務以及 Container 位置信息在內的元信息存儲。

當 master 發現有新加入的機器時,會主動觸發負載均衡,將其他 ContainerServer 上的 Container 調度到新機。整個調度過程中,不涉及數據的騰挪。在我們實際的測試中,Container 騰挪的平均耗時在百毫秒級別。

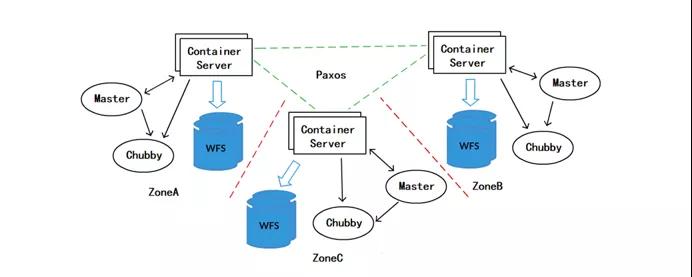

這是一個多園區部署的 Infinity 示意圖。每個園區內都有獨立的 WFS 與 Chubby 存儲,每個園區都對應全量的數據。對于同一個數據分片,分別位于 3 個園區的 3 個 container 組成一個 paxos group。

對于這樣一個方案,我們是可以對每個園區實現彈性伸縮的,系統整體的可用率由最上層的 paxos 提供保證。我們來計算下這一方案的存儲成本,園區內 3 副本的 WFS 存儲 X 園區間的 3 副本 Replica,整體就是 9 副本。對于 PB 體量的存儲,這一方案所增加的存儲成本是我們難以承擔的。既然多 zone 部署的 Infinity 存在成本問題。我們自然想到,能否使用單 zone 部署的 Infinity 來負責存儲。

首先分析成本,單 zone 部署 Infinity 的存儲成本為 3 副本 WFS,與現有架構的成本一致。其次分析擴展能力,單 zone 部署的 Infinity 一樣具有出色的擴展能力,優于現有架構。對于 Chubby 這一中心點依賴,我們可以實行 Set 化改造來盡量消除風險。

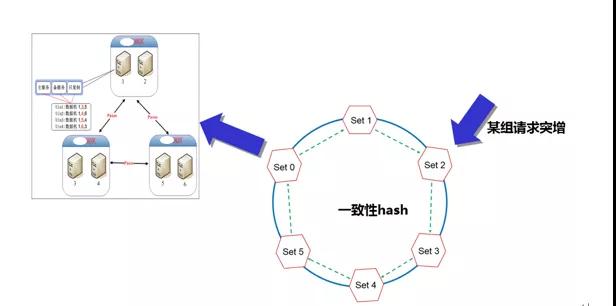

分 Set 改造后,我們不由得又想起那些年舊架構經常遇到的一種情況:單組請求突增。此處有必要簡單介紹一下 PaxosStore 的路由方案,組間一致性 Hash,單組內是 KV64 結構。一致性 Hash 消除訪問熱點,一切看起來很美好。然而假設由于某些原因,大量請求集中訪問某組 KV 時,如何應急?

此時我們既無法快速增加該組內的機器處理請求(KV64 限制),也無法快速分散請求到其他組(如果這組 KV 需要 3 倍容量,那就要把整個服務整體擴容 3 倍才可以)。這就引發了一個尷尬的局面:一組 KV 水深火熱,其他組 KV 愛莫能助;只能反復調整前端請求的訪問比例,直到業務低峰期。

那么在 Infinity 中,我們如何解決這一問題呢?

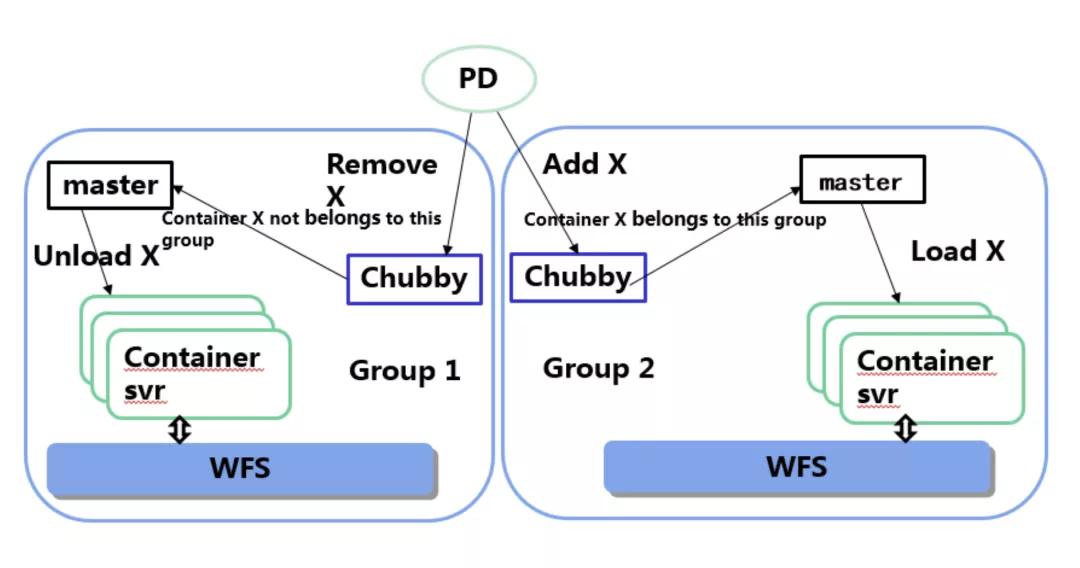

首先,我們的 Set 化本質上是對 Container 進行分組,其中 Container 到組的映射關系是存儲于 Chubby 中的。如果我們想分散一組請求到其他組,只需要依次修改每一組 Chubby 中存儲的映射關系即可。在實際實現中還有一些工程細節需要考慮,比如對于要移入其他組的 Container,必須在原組進行 Unload 并停止調度等。這里就不一一展開了。

我們在線上也進行了一次大規模騰挪 Container 到其他組的實驗:結果顯示,單個 container 騰挪到其他組,平均耗時不足 1 秒。

單 zone Infinity 架構的一些問題

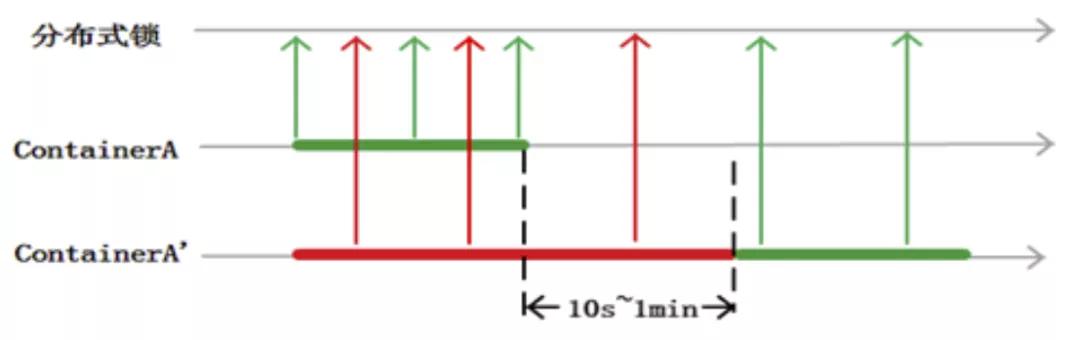

單 zone Infinity 架構解決了多 zone Infinity 成本問題的同時,也必然做出了取舍。對于某個 container,任一時刻必須只在最多一個 containersvr 上服務。否則就有導致數據錯亂的風險。類比多線程中的 data race。我們通過引入分布式鎖服務來避免 double assign。同時為了減少分布式鎖開銷,我們將鎖的粒度由 Container 級別收斂到 ContainerSvr 級別。每臺 ContainerSvr 開始提供服務后會定期前往 chubby 續租。如果一臺 ContainerSvr 崩潰,master 也需要等到鎖租約過期后才可以認為這臺 ContainerSvr 掛掉,并將其上的 container 分配出去。

這就會導致存在一部分 container 在租約切換期間(秒級別)不能服務。

我們引入兩個可靠性工程的常見指標來進行說明。MTTR——全稱是 Mean Time To Repair,即平均修復時間。是指可修復系統的平均修復時間,就是從出現故障到修復中間的這段時間。MTTR 越短表示易恢復性越好。MTBF——全稱是 Mean Time Between Failure,是指可修復系統中相鄰兩次故障間的平均間隔。MTBF 越高說明越不容易出現故障。

可以說,單 zone Infinity 架構縮短了 MTTR,但是也縮短了 MTBF,導致整體的可用性依然不高。

不可能三角?

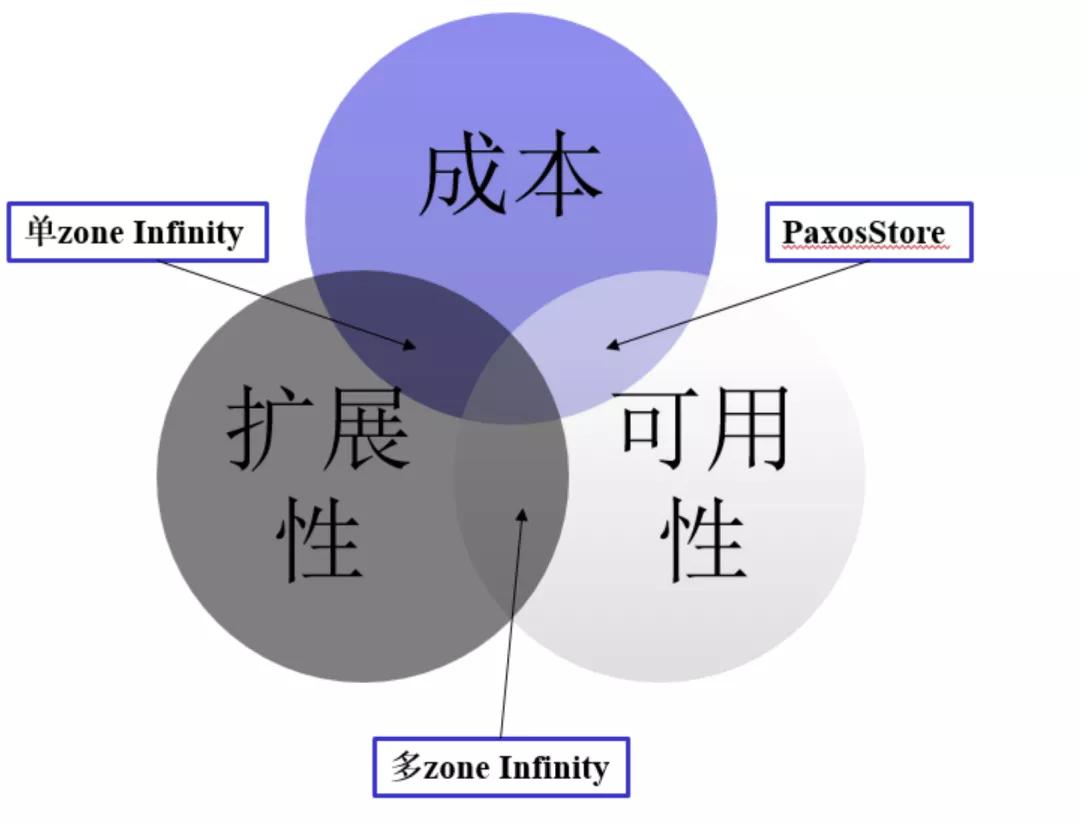

在很多領域中,都有類似“不可能三角”的理論。比如分布式理論中經典的 CAP 定理,經濟學理論中的蒙代爾不可能三角等。在我們上面的討論中,其實也蘊含了這樣的一個“不可能三角”:成本,擴展性,可用性。

PaxosStore 兼顧了成本與可用性,但擴展能力稍遜;多 zone Infinity 可用性與擴展性都為上乘,但成本是個問題;單 zone Infinity 犧牲了一點可用性,換來了成本和擴展性的優勢;三者不可得兼,我們該如何取舍?

首先是成本,是我們必須考慮的因素,這關系到我們架構實際落地還是成為巴貝奇的分析機;其次是可用性,這關系到用戶的使用體驗。在我們的新架構中,可用性不僅不能下降,甚至還應該有所提升。比如:容忍任意雙機故障。結合上面的討論,一個核心的目標逐漸浮出水面:低成本雙機容災改造。

低成本雙機容災改造

我們首先來分析一下如何實現雙機容災改造。一個簡單的思路是提升我們的副本數,由 3 副本提升為 5 副本。5 副本自然可以容忍小于多數派(<=2)的機器故障,實現雙機容災。然而考慮到成本問題,3 副本改造為 5 副本,成本增加 66%,這是我們無法接受的。此時我們想到了函數式編程中的常見思想:Immutable! 對于靜態不可變的數據而言,只要有 3 個副本,那么我們也可以在丟失 2 個副本的情況下,信任唯一的副本。然而對于一個存儲系統而言,我們沒辦法控制用戶不修改 Key 對應的 Value 值,那么我們該如何實現靜態化 3 副本呢?

LSMTree Revisited

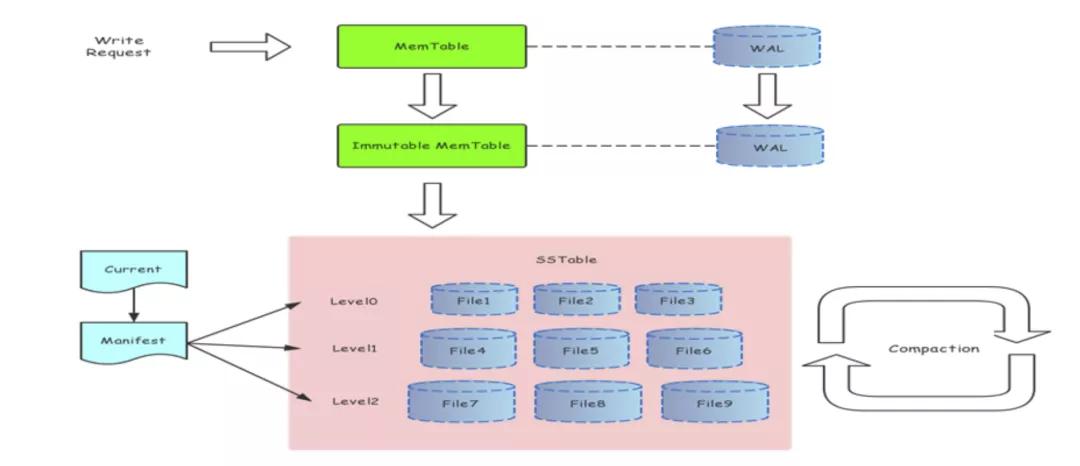

關于 LSMTree 這一存儲引擎的介紹,資料有很多。這里就不再詳述了。這里引用一張 LSMTree 的架構圖:

https://www.jianshu.com/p/6e49aa5182f0

我們分析一下圖中每個類型的文件:對于 SSTable 文件,寫入完成后即不可變,而且是 LSMTree 中主要的數據存儲(占比超過 99%),對于這一部分文件我們只需要存儲 3 副本即可;對于其他的文件如 WAL log,以及 Manifest,我們使用 5 副本存儲,總體的存儲成本增長可以忽略不計。這樣,我們就可以使用單 zone Infinity,在保持存儲成本不變的情況下,獲得雙機容災的能力。

分而治之

單 zone Infinity 可以以 3 副本的存儲成本實現雙機容災,然而存在租約切換期間的不可用問題;5 副本 KV 實現了無租約的雙機容災,然后存儲成本相比原來增加了 2/3。兩種架構各有不足,看似我們陷入了死局。然而回顧基于時間序數據的訪問模型,我們發現對于熱數據與溫數據,他們表現出了截然不同甚至相反的一些有趣性質。

| 訪問模型 | 訪問量 | 數據量(單副本) |

|---|---|---|

| 熱數據 | 千億級別 | 數十 TB |

| 溫數據 | 百億級別 | PB 級別 |

我們可以采取計算機科學中的重要思想——分治來解決。對于熱數據,訪問量較大,我們希望他有最高的可用性,同時它的數據占比又不大,適于采用 5 副本 KV 的方案進行雙機容災改造。

對于溫數據,數據量較大,不能采取 5 副本方案改造,而使用單 zone Infinity 的方案,則可以完美解決成本問題。雖然會有偶爾短暫的不可用時長,但是由于整體的訪問占比不多,系統整體的可用率依然可以保持在很高的水準。

對新架構的成本分析:

| 方案 | 成本 | 雙機容災 |

|---|---|---|

| 熱數據 5 副本 KV | 數據占比約 5% 5 倍成本 | 支持 |

| 溫數據 Infinity | 數據占比約 95% 3 倍成本 | 支持 |

| 整體 | 3.1 倍 | 支持 |

這樣我們就在不顯著增加存儲成本,不犧牲可用性的前提下,實現了雙機容災的目標。

為了提升熱數據部分的擴展性,我們可以使用粗粒度 paxos group 的交互方案。對于熱數據,在數據量減少+粗粒度 paxos group 雙重改進下,擴容時間可以提升到小時級別。同時,我們實現了熱數據由 5 副本 KV 到單 zone Infinity 的自動下沉。一方面可以保持總體的存儲成本不膨脹,另一方面也減少了熱數據的總量,熱數據集群的擴容需求也就沒有那么強烈。

磁盤清空后的數據快速恢復

對于 Infinity 部分的數據,可以依靠 WFS 自動檢測,補全副本數。在機器檢修期間就可以完成大部分數據的補全。對于熱數據部分的數據,雖然數據減少,但是恢復過程中還是會受限于 lsmtree 的寫入過程中 Compact 產生的寫放大問題。經過一些業界的調研,對于 lsmtree 批量導入的場景,一種常見的做法是 BulkLoad,也即先將所有 key 進行排序,生成有序的 SSTable 文件,直接提交到 lsmtree 的最后一層,這樣可以完全繞過寫放大實現數據的導入。

我們經過分析,發現這種做法還不是最優的。首先,我們對于 SSTable 中的數據會進行 block 級別的壓縮,在遍歷數據的過程中需要進行解壓;而在生成 SSTable 的過程中,為了減少存儲成本,又需要進行壓縮。經過研究,發現我們這種場景下有更優的恢復方案:基于目錄級別的快速恢復。

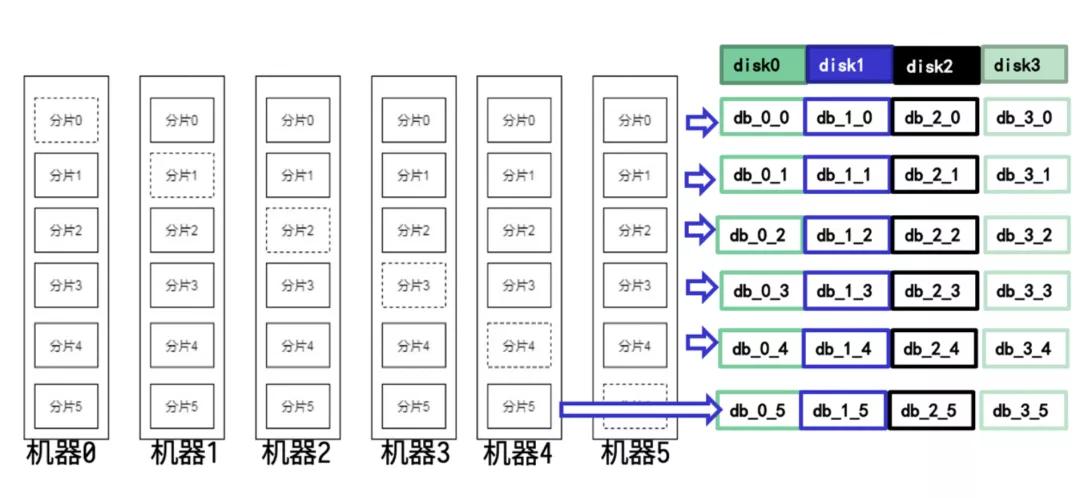

目錄級別的快速恢復

要想實現目錄級別的快速恢復,首要條件就是:需要數據的路由規則與目錄分布是完全對齊的。這樣才可以保證恢復目錄后,不會獲得不屬于本機的數據,也不會遺漏數據。在此前的 kv 中都忽略了這一設計,導致無法通過拷貝文件實現快速恢復。結合 5 副本的路由方案,我們獲得了一個可以實現對齊的目錄分布方案。推導后的方案非常簡潔,用一張圖片即可說明。

我們進行的測試也印證了這一改造的效果,基于目錄拷貝的恢復方案相比原來逐 paxos group 恢復方案取得了近 50 倍的速度提升,從小時級進入到分鐘級。

新架構

對幾個架構方案的對比:

平穩升級

至此我們的改造方案有了,然而改造過程同樣值得注意。我們必須在保證系統穩定的前提下,平穩的完成數據與訪問的切換。

首先是灰度能力,我們做了兩個粒度的灰度控制:一是訪問時間級別,按照 key 上面的時間,分批將數據從原架構中騰挪出來;二是命令字級別,數據騰挪完成后,我們會先保持雙寫狀態觀察,先逐步切換讀請求到新架構中,觀察正常后才會去掉雙寫,完成切換。其次是改造的正確性,我們采取了全量的數據校驗方案,保證改造過程中不會丟失數據。最后是在騰挪過程中,我們開發了一套基于機器資源以及監控上報的自動反饋機制,當業務高峰期或者出現失敗時自動降速,低峰期自動加速,減少了人為介入。

目前,我們已經完成部分核心存儲集群的架構改造,實現了全程無故障切換。

總結

2019 年,微信后臺通過如上持續不斷的改造,在不增加成本的前提下,極大提升了基于時間序存儲的擴展能力,從周級別的擴容速度升級到整體小時級的擴容速度,并且溫數據部分的計算節點做到了分鐘級的擴容速度。同時,利用數據的特性進行集群劃分,將 5 副本 PaxosStore 存儲與計算存儲分離架構進行有機結合,在極大提升了擴展能力的同時,將可用性提升到容忍雙機故障的水平。