深度學習先驅Yann LeCun被罵退推特:你們都很懂,從此我不說話了

在長達兩周的「罵戰」之后,圖靈獎得主、Facebook 首席 AI 科學家 Yann Lecun 宣布,自己將退出推特。

「我請求社交網絡上的所有人不要再互相攻擊了,特別是對于 Timnit Gebru 的攻擊,以及對于我之前一些言論的攻擊。」Yann LeCun 剛剛在推特上發出了這樣的呼吁。「無論是口頭還是其他方式的沖突,都只能獲得傷害和相反的結果。我反對一切形式的歧視。這里有一篇關于我核心價值觀的文章。」

「這是我在推特上最后一篇有內容的帖子,大家再見。」

看起來 2018 年圖靈獎得主、人工智能領軍人物 Yann LeCun 已經下定決心想對長達兩周的激烈討論畫上句號。而這場鬧得沸沸揚揚的罵戰,起因正是被指「嚴重種族歧視」的 PULSE 算法。

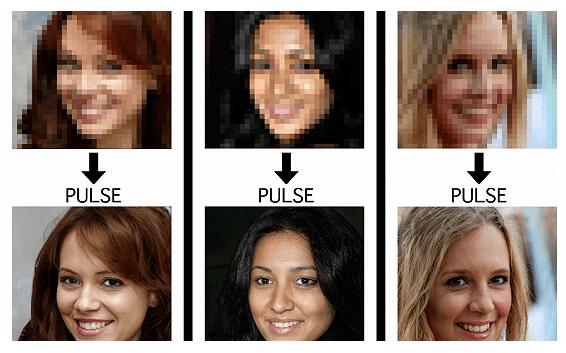

這一工作由杜克大學推出,其人工智能算法可以將模糊的照片秒變清晰,效果極佳。這項研究的論文已在 CVPR 2020 上發表(論文《PULSE:Self-Supervised Photo Upsampling via Latent Space Exploration of Generative Models》)。

PULSE 在 CVPR 大會期間引來了人們的關注,進而引發了 AI 社區的廣泛爭議。首先,這種方法所產出的圖像清晰度更高,細節也更加豐富:PULSE 能夠在幾秒內將一張 16×16 像素的圖片提升至 1024×1024 分辨率,提升高達 4096 倍。目前該算法僅針對人臉照片,算法生成的照片清晰到可以呈現出人臉上的毛孔、皺紋甚至一縷頭發。

但本質上看,PULSE 并不是在消除馬賽克,而是「生成」了看上去真實卻并不存在的人臉。超分辨率算法一直是計算機科學的熱門研究領域,以往科學家們提出的還原方法是在低分辨率圖片中添加像素點。但 PULSE 使用 GAN 的思路,先利用深度學習算法生成一些高清圖片,再降低它們的分辨率,并與模糊的原圖對比,從中找出匹配程度最高、最接近原圖的高清圖像隨后輸出。

問題就出在這里,有網友試用了 PULSE 之后,發現高糊照片經過去碼處理以后,生成的是一張「白人面孔」:

有網友質疑該方法生成結果存在偏見,對此項目作者也給出了回應,表示這一偏見很可能來自于 StyleGAN 的訓練數據集,可能還有其他未知因素。

「我們意識到偏見是機器學習和計算機視覺領域的重要問題,并就此問題聯系了 StyleGAN 和 FFHQ 數據集的創建者。我們希望這能夠促進不具備此類偏見行為的方法的誕生。」

但這件事還沒完,鑒于美國目前 BLM 的輿論環境,人們很快就開始深入討論機器學習研究結果缺乏多樣性的問題。在這其中,種族偏見和性別偏見的問題一直存在,迄今為止卻沒人給出一個好的解決辦法。

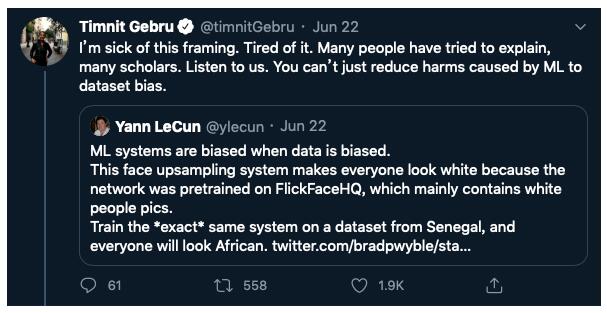

也就在這個時候,Yann LeCun 發布了一條推特,來解釋為什么 PULSE 會出現這樣的偏見。

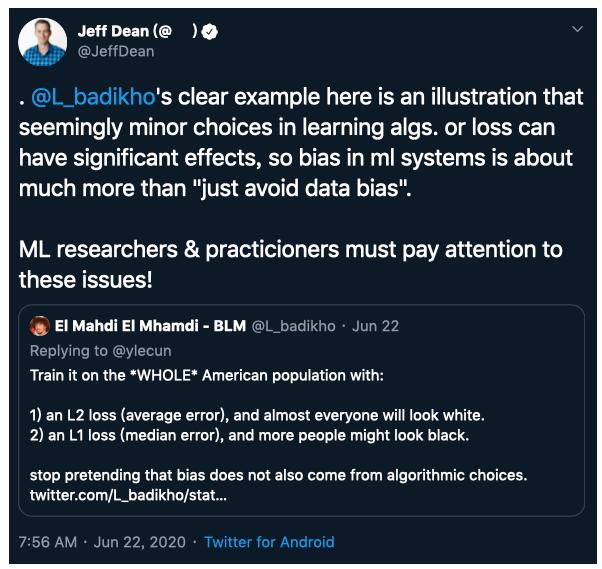

「機器學習系統的偏差是因為數據的偏差。這一人臉上采樣系統其結果傾向于白人是因為神經網絡是在 FlickFaceHQ 上預訓練的,其中的大部分圖片基本是白人照片,」Yann LeCun 說道。「如果這一系統用塞內加爾的數據集訓練,那肯定所有結果看起來都像非洲人。」

Yann LeCun 的說法本身沒有錯,但可能是因為過于直白了,一下子讓大量 AI 從業者和研究人員炸了鍋。LeCun 希望將人們的注意力引向數據集的偏差,但推特網友不買帳,并指責他「用這種陳舊的理由來掩蓋問題本質」。

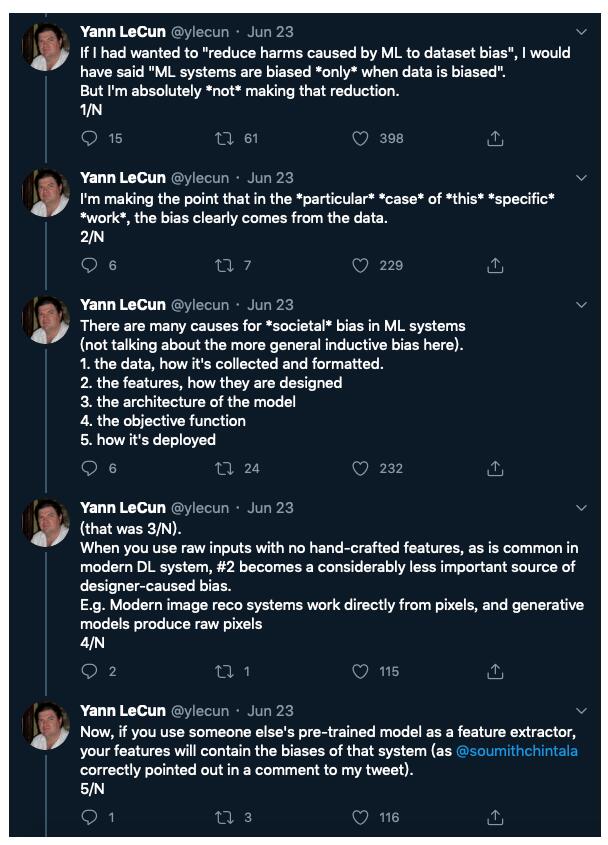

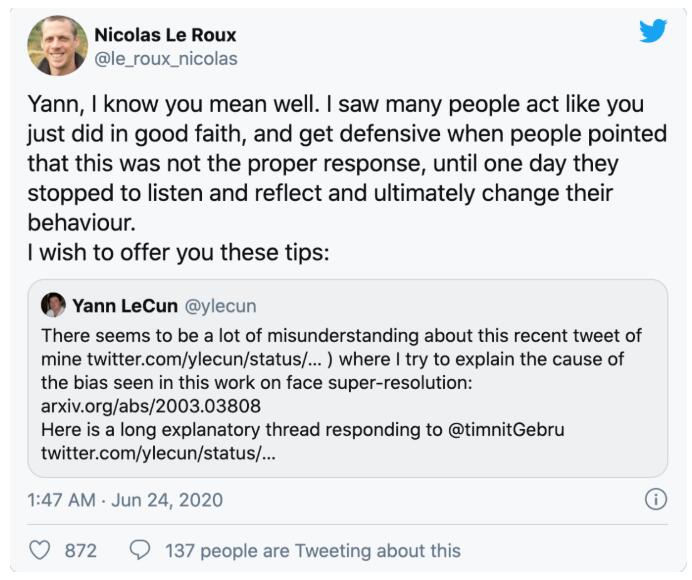

之后,Yann LeCun 又在多條推文來解釋自己關于偏見的立場,但仿佛已經沒有用了。

「與學術論文相比,這種偏見在已經部署的產品中產生的后果會更加可怕。」這句話的含義被解讀為「不必為此特例而過分擔心」,引發了諸多同行的質疑。

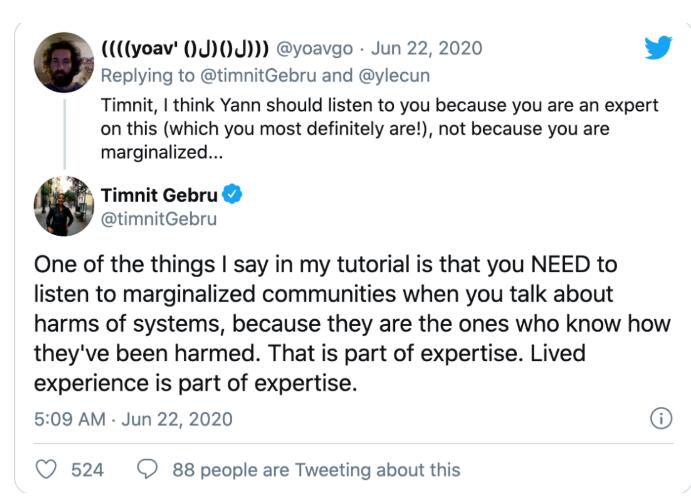

斯坦福 AI Lab 成員、Google AI 科學家 Timnit Gebru(她是一名非洲裔美國人),對 LeCun 的言論表示「失望」。

Yann LeCun 甚至在 Timnit Gebru 的推特評論區連寫 17 條回復:

當然,需要討論的也不只是機器學習中的偏見問題:

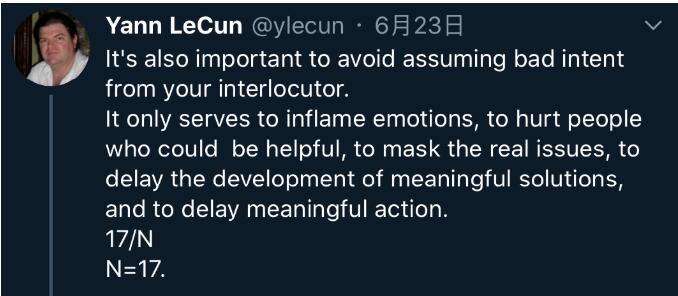

「同樣需要避免的是在對話中產生惡意,它只會激起情緒,傷害到所有人,掩蓋實際問題,推遲解決方案的出現。」

從事數據科學領域超過十年的 Luca Massaron 認為,盡管從技術角度來看 Yann LeCun 是完全正確的,但看看這種觀點被拋出之后公眾的反應,你就會知道談論它是多么的敏感。

「人們總是害怕自己會被不公平的規則控制,進而無條件地,有時甚至毫無理由地懼怕 AI 剝奪人們的自由,而不僅僅是工作,」Luca Massaron 說道。「我個人并不擔心 Face Depixelizer 這類研究,我所害怕的是在應用之后,我們無法識別和挑戰偏見。」

如今,越來越多的機器學習自動化技術正在進入我們的生活,立法者在這里扮演的角色非常重要。在歐盟國家,為了確保數據使用的透明度和責任,GDPR 條例要求互聯網公司保證算法的可解釋性,以及用戶對于自身數據的控制力。

如果我們希望 AI 能夠朝著正確的方向發展,我們需要追求的或許不是無偏見,而是透明度。Luca 認為,如果算法是有偏見的,我們可以挑戰它的推斷結果并解決問題。但如果算法的推理機制不可知,或許其中還隱藏著更大的問題。

不可否認的是,人類社會存在著各種偏見,但因此而認為機器傾向于更「流行」的答案是理所應當的,或許不是一個正確的觀點。

人們對于 PULSE 的討論,以及 LeCun 的攻擊,有很多已脫離了 LeCun 的本意。

作為這場爭議的起因,杜克大學的研究者們已在 PULSE 網站中表示將會修正有關偏見的問題。目前論文中已經增加了一個新的部分,并附加了可以解決偏差的模型卡。

為了達成沒有偏見的目標,我們必須讓整個人工智能社區行動起來。但在有關技術的討論之中讓技術大牛心灰意冷,是大多數人都不想看到的結果。Yann LeCun 此前一直以直言不諱著稱,他在社交網絡上經常會對熱門的深度學習研究發表評論,也可以直面其他人工智能著名研究者的批評。

機器學習模型中的偏見可能會使得推理的專業性受到侵害,導致大量業務遭受影響卻不為人所知。我們還沒有解決這個問題一勞永逸的方法。