人工智能:技術本無罪,善惡在人心

科技向來是一把雙刃劍,它在推進人類文明進步的同時,有時也會給人類帶來災難。人工智能亦是如此,人工智能技術被好人掌控時能澤被蒼生,如果被壞人控制則有可能禍患無窮。先來看兩個例子:

1、 人工智能用于作惡的案例:Deepfake合成音頻應用于詐騙

最近,據美國的科技媒體報道說,網絡詐騙犯正在利用Deepfake技術仿制公司高管的語音合成語音郵件發到公司員工,針對大型公司進行經濟詐騙,敲詐者將一份模仿公司CEO語音的Deepfake音頻以郵件方式前不久就發送給了一家公司的員工,要求員工立即提供幫助,以完成緊急商業交易。但值得慶幸的是這次詐騙并沒有成功。員工在收到語音郵件之后認為其可疑,并且將其登記到了公司的法律部門,但在此之前已經有很多利用Deepfake進行詐騙的案例了。

比如:2019年的9月,犯罪分子使用語音克隆軟件對英國一家能源公司的高管的聲音進行模仿。這家公司的執行董事在接聽詐騙電話之后,毫不猶豫的就把24萬美元匯入了一個海外賬戶。而前不久網絡安全公司賽門鐵克報告了三起Deepfake音頻詐騙案例,犯罪分子通過電話會議、社交媒體TED的演講,獲得了公司高管的音頻,然后用機器學習技術復制了高管的聲音,致電財務部門要求緊急匯款。

不過Deepfake音頻創作者為了創建更逼真的音頻通常需要克服如下幾個因素,比如捕獲幾乎沒有背景噪音的高質量音頻,比如大領導的演講,在不需要回電的情況下,對音頻進行傳送,因為對話起來容易露餡,平時都是以留言的形式避免與音頻接收者實時交流,也許不過腦子的人聽到領導的聲音一緊張,就會像上面那幾個案例一樣,乖乖打錢了。而更可怕的是未來如果Deepfake音頻加視頻合成更加成熟,騙子的成功率就可能大大提高,我們可要提高警惕了。如何才能提高警惕呢?說到底可能還是要借助科技的力量。

2、人工智能向善的案例:Fawkes給照片“隱身衣”,讓人臉識別系統失靈

眾所周知,社交媒體平臺有可能泄露我們的個人隱私,有時候一張自拍照所包含的信息就有可能把自己給“出賣”了,因為面部識別技術可以抓取到很多信息。也就是說只要能獲取照片數據,面部識別技術就可以輕松的獲取個人的敏感信息。此前,美國的面部識別公司就創建了一個大概有30億張圖像的超大容量人臉數據庫,而這些數據都是從Facebook 、YouTube甚至國內的微博上抓取過來的,而這些無處不在的面部識別技術對我們的隱私構成了不小的威脅。

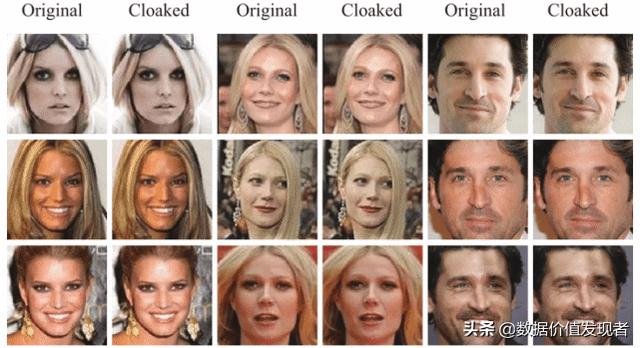

在芝加哥大學有個團隊就提出了一種新的解決思路,可以為我們的照片添加一層隱身衣,這就是他們推出的軟件——Fawkes。這款軟件已經讓曠視、微軟、亞馬遜等公司的面部識別算法失靈了,而這款軟件的研發者是一位來自北京的年僅23歲的小伙子。一張普通電子照片在用Fawkes給原圖稍加處理之后,就可以屏蔽任何人臉識別算法。但是我們人眼幾乎無法察覺到任何的細節,也就是說Fawkes軟件對人臉圖像進行了像素級的細微修改,讓肉眼無法察覺,但是AI圖像識別的算法就能看得清清楚楚,但是其識別結果會高度失真,把圖片看成完全不一樣的人。以后經過Fawkes快速處理的圖片,可以在不改變原貌的基礎上,隨意的分享在各大社交媒體平臺,也不擔心被其他的算法公司抓取用作非法途徑。這是個人工智能技術用于保護個人隱私方面的成功嘗試。

該研究團隊表示,他們希望Fawkes能夠被廣泛的部署和使用,以降低個人隱私泄露的風險。目前,用戶可在該項目官網免費使用Fawkes。技術論文已經在網上開放(論文地址:https://www.shawnshan.com/files/publication/fawkes.pdf)。同時,研究團隊已開發Windows和Mac版本的軟件,并希望社交媒體公司在其平臺直接部署該軟件。不過略有可惜的是,我們之前已經泄露在網上的照片,怕是沒機會再修改了。

3、 關于人工智能應用的幾點感想

①人類一方面在利用人工智能技術為自身的工作與生活帶來便利和效率,另一方面又在不停的與人工智能技術帶來的負面影響進行抗爭;

②人工智能技術的進步已經在挑戰人類感官的靈敏度了,眼見不一定為實,聲音不一定可靠,甚至你看到的人臉照片都可能是被AI換臉技術處理過的。長此以往,人們對人工智能產生的將會有怨恨和恐懼;

③在享受人工智能技術發展帶來的各種福祉的同時,人工智能所產生的倫理問題也日益突出,正成為全社會關注的焦點。人性是不完美的,一旦這些人工智能技術被不法分子利用,那么對社會而言將會是一場災難。如何規避人工智能帶來的倫理問題,已經成為人工智能發展無法回避的重要問題。

人工智能本沒有善與惡之分別,關鍵在于掌控它的人如何應用它。請銘記:人工智能技術是沒有罪的,但是,請正確對使用人工智能技術。技術無罪,善惡之道,存乎一心。