谷歌大腦最新操作玩“復古”:不用卷積注意力,圖像分類接近SOTA

本文經AI新媒體量子位(公眾號ID:QbitAI)授權轉載,轉載請聯系出處。

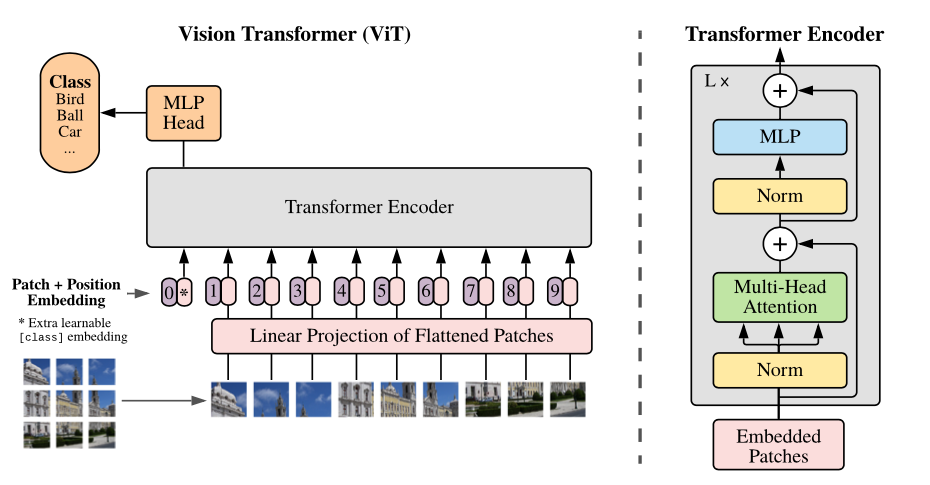

谷歌大腦的視覺Transformer團隊(ViT),搞了個復古操作。

他們不用卷積神經網絡(CNN)、也不用Transformer,僅憑最早的AI視覺任務采用的多層感知機(MLP)結構,就實現了接近SOTA的性能,更是在ImageNet圖像分類任務上取得了87.94%的準確率。

這個架構名為MLP-Mixer,采用兩種不同類型的MLP層,可以看做是一個特殊的CNN,使用 1×1卷積進行通道混合(按位操作),同時全感受野和參數共享的的單通道深度卷積進行字符混合(跨位操作)。

在JFT-300M數據集上預訓練、微調到224分辨率的Mixer-H/14版本取得了86.32%的準確率,比SOTA模型ViT-H/14僅低0.3%,但運行速度是其2.2倍。

論文地址:

https://arxiv.org/abs/2105.01601

項目地址:

https://github.com/google-research/vision_transformer/tree/linen