LSTM之父再稱ResNet、GAN等網(wǎng)絡(luò)都有他的功勞,網(wǎng)友:自負(fù)>引用數(shù)

本文經(jīng)AI新媒體量子位(公眾號(hào)ID:QbitAI)授權(quán)轉(zhuǎn)載,轉(zhuǎn)載請(qǐng)聯(lián)系出處。

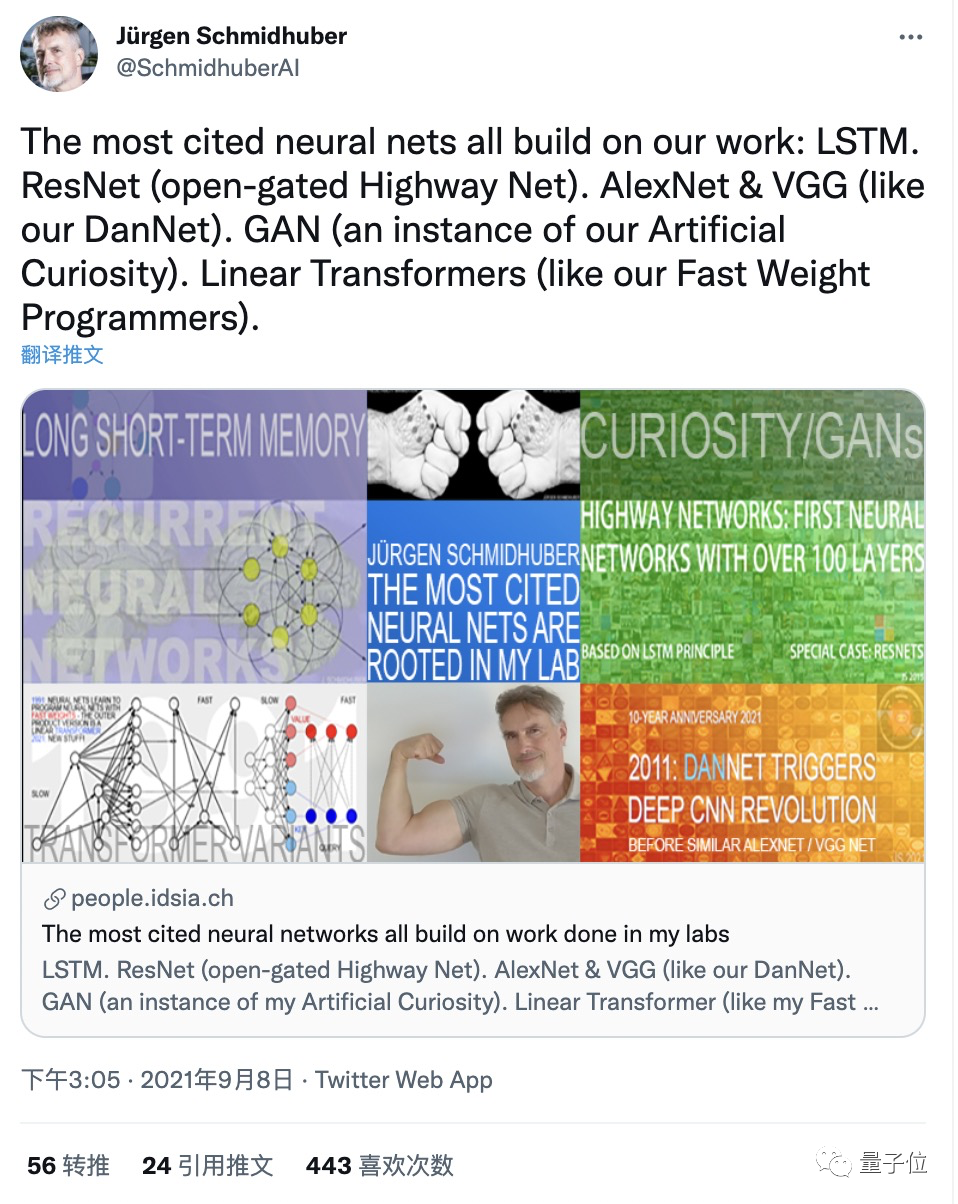

“現(xiàn)在引用最多的幾個(gè)神經(jīng)網(wǎng)絡(luò)都是建立在我的實(shí)驗(yàn)室成果之上的!”

能說出此話的不是別人,正是在深度學(xué)習(xí)領(lǐng)域作出了巨大貢獻(xiàn)的LSTM之父——Jürgen Schmidhube。

但這也不是他第一次為“自己的開創(chuàng)性工作沒得到足夠的尊重”而公開發(fā)聲。

在這篇“直抒胸臆”的推文里,他還專門鏈出了個(gè)博客,里面歷數(shù)了他和他的團(tuán)隊(duì)在LSTM、ResNet、AlexNet和VGG、GAN以及Transformer變體——這五個(gè)赫赫有名的神經(jīng)網(wǎng)絡(luò)上的早期貢獻(xiàn)。

來看看他是怎么說的。

“五大神經(jīng)網(wǎng)絡(luò)都是建立在我的實(shí)驗(yàn)室成果之上”

首先是LSTM (Long Short-Term Memory)。這是Jürgen和他的學(xué)生們?cè)?997年提出的一種新的RNN,解決了神經(jīng)網(wǎng)絡(luò)長短期記憶的難題。

根據(jù)谷歌學(xué)術(shù),這是20世紀(jì)被引用次數(shù)最多的神經(jīng)網(wǎng)絡(luò)。

現(xiàn)在已經(jīng)“滲透”進(jìn)醫(yī)療保健、學(xué)習(xí)機(jī)器人(learning robot)、游戲、語音處理、機(jī)器翻譯等領(lǐng)域,每天被無數(shù)人使用數(shù)十億次。

其厲害之處不用多說,大家對(duì)Jürgen的這項(xiàng)成就也沒啥異議。主要看另外四個(gè):

ResNet

作為21世紀(jì)被引用次數(shù)最多的神經(jīng)網(wǎng)絡(luò),Jürgen說它引用了他們的Highway Net、然后把它做成了另一個(gè)版本。

Highway Net,是他的學(xué)生們發(fā)明的第一個(gè)具有100多層的真正的深度前饋神經(jīng)網(wǎng)絡(luò)。

它用跳層連接解決了非常深度的神經(jīng)網(wǎng)絡(luò)的訓(xùn)練,其性能也與ImageNet上的ResNet差不多。

這倆的爭議很多人都有分析過,雖然兩者都用了跳層連接技術(shù),但選擇的機(jī)制不同;多數(shù)人認(rèn)為ResNet應(yīng)該只是受到了Highway Net的啟發(fā)。

但Jürgen不這么認(rèn)為,他還專門強(qiáng)調(diào)了一下,Highway Net也是基于LSTM的思想才得以解決深度訓(xùn)練的問題的。意思是ResNet“一脈相承”了他兩個(gè)成果。

AlexNet和VGG Net

對(duì)于這倆在引用次數(shù)排第二、第三的神經(jīng)網(wǎng)絡(luò),Jürgen表示:都類似DanNet——他們?cè)?011年提出的第一個(gè)贏得圖像識(shí)別比賽的深度卷積神經(jīng)網(wǎng)絡(luò),并且DanNet在AlexNet出現(xiàn)之前贏了4場。

因?yàn)?012年出生的AlexNet論文中引用了DanNet,用到了Jürgen團(tuán)隊(duì)提出的摒棄無監(jiān)督預(yù)訓(xùn)練為純監(jiān)督學(xué)習(xí)的DNN思想。

而VGG則是同樣采用了DanNet使用小卷積濾波器增加神經(jīng)網(wǎng)絡(luò)深度的track。

GAN

博文中寫道,大名鼎鼎的GAN也是Jürgen本人在1990年提出的Adversarial Curiosity原則的應(yīng)用,它們都由兩個(gè)神經(jīng)網(wǎng)絡(luò)進(jìn)行“對(duì)抗”(Adversarial Curiosity則是一個(gè)叫生成器,一個(gè)叫預(yù)測器)。

“炮轟”GAN可不是第一次了,Jürgen甚至還公開和GAN的提出者battle過,但很多學(xué)者分析,GAN并不能視為Adversarial Curiosity的一個(gè)簡單變種。

Transformer

最后一個(gè)是Transformer,如今風(fēng)靡的Transformer又和Jürgen有什么關(guān)系呢?

Jürgen說,Transformer的變體-線性Transformer,在形式上相當(dāng)與他于1991年提出的快速權(quán)重存儲(chǔ)系統(tǒng)(Fast Weight Programmers)的延伸(除了標(biāo)準(zhǔn)化部分)。

真的是這樣的嗎?

不得不說,Jürgen的某些思想非常超前,但其實(shí)上面的這些內(nèi)容都不是Jürgen第一次公開說明了。

一如既往,網(wǎng)友們的回應(yīng)褒貶不一。

追捧他的表示:

“這是Schmidhuber的世界,我們凡人只是居住在其中!”

“Schmidhuber is all you need.”

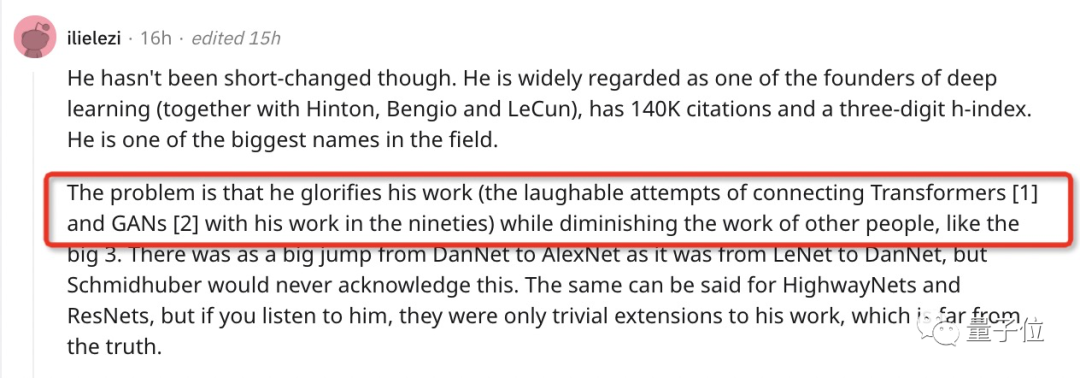

但更多的人都是在承認(rèn)他巨大貢獻(xiàn)的同時(shí),指出他過于美化自己的貢獻(xiàn),想把這二三十年所有相關(guān)的進(jìn)步都?xì)w功于他。

就像博文中提到的ResNets,許多人的觀點(diǎn)認(rèn)為它只是HighwayNets中一個(gè)非常微不足道的延伸;

而Transformer則是在發(fā)展壯大了三年之后才被Jürgen聯(lián)系到了Fast Weight Programmers身上;(如果真的那么相關(guān),怎么一開始不指出來)

上面提到的種種幾乎和他的團(tuán)隊(duì)成就沒啥關(guān)系,沒有他的那些論文,那些模型照樣會(huì)被提出來。

而他最重要的兩個(gè)貢獻(xiàn)是:用LSTM思想解決RNN訓(xùn)練難題以及梯度消失難題的理論分析。但這都還主要是他的學(xué)生Hochreiter領(lǐng)導(dǎo)的。

因此有人覺得Jürgen這種行為簡直就像個(gè)孩子一直在說“看我,我是最棒的”一樣:

甚有直言:“他的自負(fù)大于他的引用次數(shù)”。

你覺得呢?