公共場所人臉識別或全面被禁!剛剛,歐洲議會決議,AI監管再收緊

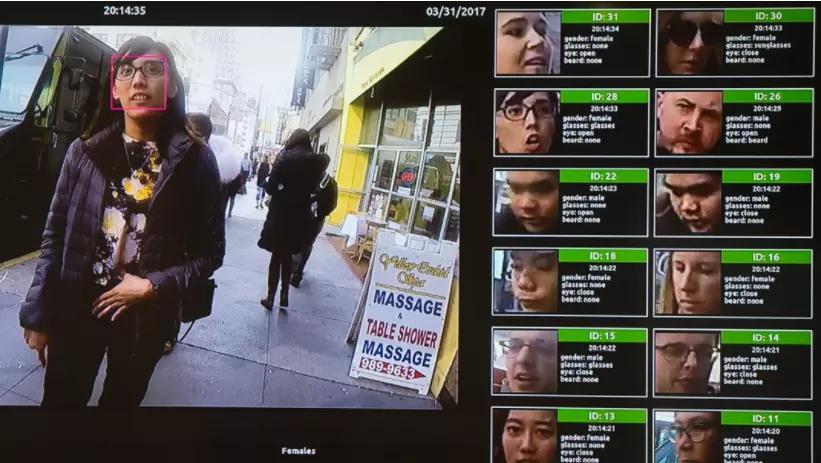

昨日,歐洲議會投票通過決議,呼吁全面禁止基于AI生物識別技術的大規模監控。

此次決議呼吁全面禁止在公共場所進行自動面部識別,并對警方使用AI進行預測性警務活動實施嚴格限制措施。歐洲議會以 377 票贊成、248 票反對、62 票棄權的結果通過了決議。

決議還呼吁禁止使用私人面部識別數據庫,并表示基于行為數據的預測性警務活動也應該被取締。

此外,決議還希望禁止試圖根據公民的行為或個性,對公民的信用進行評分的社會評分系統。

對于遠程生物特征監測的AI技術,委員會在報告中呼吁:

「……通過立法和非立法手段,必要時通過侵權訴訟,禁止出于執法目的生物識別數據處理,包括通過面部圖像識別,在公共場所進行大規模監視。」

歐洲議會成員Petar Vitanov在決議通過后的聲明中表示:

「人類的基本權利是無條件的。我們有史以來第一次呼吁暫停部署用于執法的面部識別系統,因為該技術已被證明是無效的,并且經常導致歧視性結果。這份報告對所有歐洲公民來說都是一個巨大的勝利。」

從分級到全面禁止,歐盟「緊箍咒」越來越緊

實際上,早在今年4 月,歐盟提出防范和監管AI技術高風險應用的草案,名為「人工智能行業監管草案」,其內容就包括「原則上禁止」在公共場合使用遠程生物識別監控技術。

這個草案實際上為人工智能引入一個全面的監管框架。其中一項措施是禁止在公共場所進行遠程生物識別(例如面部識別),除非它被用于處理重大犯罪,包括恐怖主義和綁架。

該案將人工智能應用場景分為「低、有限、高、不可接受」四個風險等級,等級越高的應用場景受到的限制越嚴格。

關于人工智能最受爭議的細分領域——人臉識別,以及所有遠距離生物識別系統都被認定為高風險,并禁止執法部門在公共場合使用這一技術,除非發生兒童失蹤、恐怖襲擊、甄別犯罪分子等情況,上述情況也需得到司法部門授權。

聊天機器人等應用屬于有限風險。這些應用需要讓用戶知曉自己在與機器互動,并有權決定是否繼續或退出該進程。

基于人工智能的電子游戲、垃圾郵件識別屬于低風險,低風險應用占目前歐盟人工智能應用的絕大部分。對上述應用不做約束。

早在2016年,歐盟的《通用數據保護條例》(GDPR)已對此有所限制,GDPR對生物數據的處理,遵循「原則禁止、特殊例外」的原則。數據控制者可援引「數據主體的同意」作為個人生物數據處理的例外,但該同意必須是「自由給予、明確、具體、不含混」的。

短短數年,歐盟對AI技術應用,尤其是大規模人臉識別技術,就經歷了從明確分級、到嚴格限制,再到全面禁止的過程。

近日通過的這個決議無疑表明,對AI技術,尤其是人臉識別技術的更嚴格的監管框架已經建立。

無論AI如何建議,最終必須由人來拍板

此次決議還針對AI算法強調了人類監督,以防止人工智能的歧視——尤其是在執法和過境檢查方面的應用。

歐洲議會同意,無論AI輔助系統的建議如何,最終的決定必須始終由人類做出,并表示由人工智能驅動的系統監控的對象必須能夠獲得補救。

歐洲議會議員指出,這類系統已被證明會錯誤識別少數族裔群體、LGBT人群、老年人和女性。算法應該透明、可追溯并有充分的記錄。公共部門盡可能使用開源軟件,以提高透明度。

歐洲議會議員還針對一項有爭議的歐盟資助的研究項目——基于面部表情分析結果的「智能測謊儀」項目iBorderCtrl 應該停止,該項目此前被用于自動化邊境管理系統。

決議還呼吁禁止人工智能協助司法決策,這可能會鞏固和擴大刑事司法系統中的系統性偏見。

怎么管好人臉識別?國內外都難辦

實際上,這并不是人臉識別技術首次被禁了。

2019年,美國有9個州都頒布了關于禁用人臉識別技術的法案,嚴禁警察、政府部門以及在公共場所使用人臉識別技術。舊金山成為美國第一個禁止警察和其他政府官員使用人臉識別的大城市。在接下來的幾個月內,奧克蘭和伯克利等地也通過了類似的法律。

許多技術公司,如IBM、亞馬遜、谷歌等,此前也曾暫停或放棄了人臉識別相關業務。

類似問題在國內也同樣存在。今年央視315晚會就曾曝光,科勒衛浴等廠商在旗下衛浴門店安裝人臉識別攝像頭,存在收集人臉數據的問題。嚴重侵犯個人隱私,給個人數據安全帶來重大威脅。

國家市場監管總局發布的《個人信息安全規范》明確規定,人臉信息屬于生物識別信息,也屬于個人敏感信息,收集個人信息時應獲得個人信息主體的授權同意。

今年1月1日正式實施的《民法典》中規定,處理個人信息,應征得該自然人或者其監護人同意。

4月23日,國家標準化管理委員會發布《信息安全技術人臉識別數據安全要求》征求意見稿,對人臉識別技術應用場景、安全要求、數據采集和處理等環節制定了標準化規范,彌補了相關法規和標準的缺失。

面對AI技術的日新月異,未來如何在充分利用人臉識別技術的同時,保障數據安全和個人隱私,依然有待探索。