拋棄熱圖回歸,滑鐵盧大學提出多人姿態估計新方法

關鍵點估計是一項計算機視覺任務,涉及定位圖像中的興趣點。作為計算機視覺工作中研究最多的主題之一,關鍵點估計在相關應用中發揮著重要作用,包括人體姿態估計、手部姿態估計 、動作識別、目標檢測、多人跟蹤、運動分析等。

估計關鍵點位置最常用的方法是生成 target 場的熱圖(heatmap)方法。但熱圖回歸作為檢測和定位關鍵點的標準方法,也存在以下缺點:

首先,這種方法存在量化誤差;關鍵點預測的精度本質上受到熱圖空間分辨率的限制。因此,較大的熱圖更優,但需要額外的上采樣操作和昂貴的更高分辨率處理;并且即使使用大型熱圖,也需要特殊的后處理步驟來優化關鍵點預測,這會降低推理速度;

其次,當兩個相同類型(即類別)的關鍵點彼此靠近時,重疊的熱圖信號可能會被誤認為是單個關鍵點。

基于此,已有一些工作開始研究可替代的、無熱圖的關鍵點檢測方法。

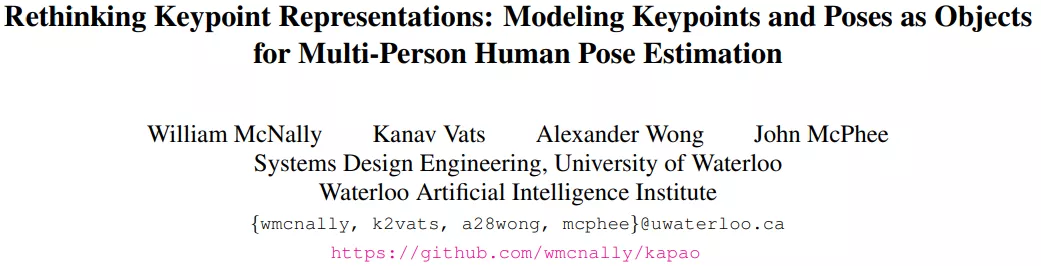

近日,來自加拿大滑鐵盧大學的研究者提出了一種全新的單階段多人關鍵點和姿態檢測方法 KAPAO。使用一塊 TITAN Xp GPU 實時運算,720p 視頻的推理速度可以達到每秒 35 幀,1080p 的視頻可達到每秒 20 幀。在不使用測試時增強 (TTA) 時,KAPAO 比此前的單階段方法(如 DEKR 和 HigherHRNet)更快、更準確。

在滑鐵盧大學的這項研究中,研究者提出了一種新的無熱圖關鍵點檢測方法 KAPAO(Keypoints And Poses As Objects),并將其應用于單階段多人人體姿態估計。其中單個關鍵點和空間相關的關鍵點(即姿態)集被建模為基于 anchor 的密集檢測框架中的目標。這種把關鍵點和姿態視為目標的 KAPAO 方法可以同時檢測關鍵點目標和姿態目標,并使用簡單的匹配算法融合結果。通過檢測姿態目標,該研究統一了人體檢測和關鍵點估計,從而形成了一種高效的單階段多人人體姿態估計方法。

- 論文地址:https://arxiv.org/abs/2111.08557

- GitHub 地址:https://github.com/wmcnally/kapao

- 試玩地址:https://huggingface.co/spaces/akhaliq/Kapao

KAPAO 方法

KAPAO 方法以 YOLO(You Only Look Once)密集檢測框架近期的一種實現為基礎,并包含一個高效的網絡設計。此外,由于 KAPAO 不會產生大型且昂貴的熱圖,因此在準確性和推理速度方面,優于此前的單階段方法,特別是在不使用 TTA 的情況下。

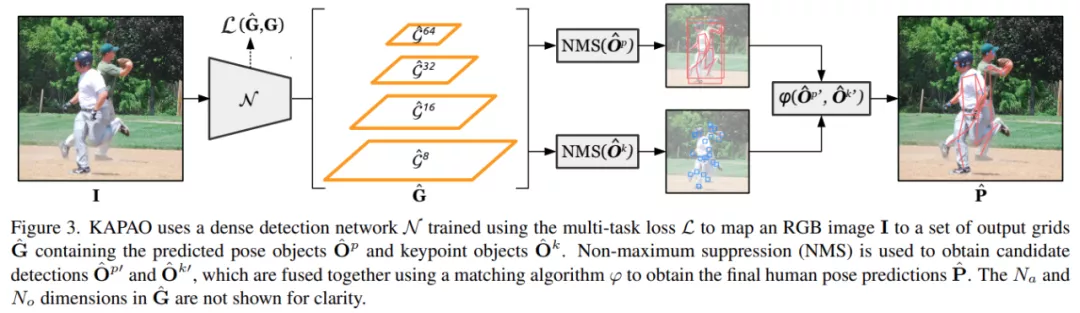

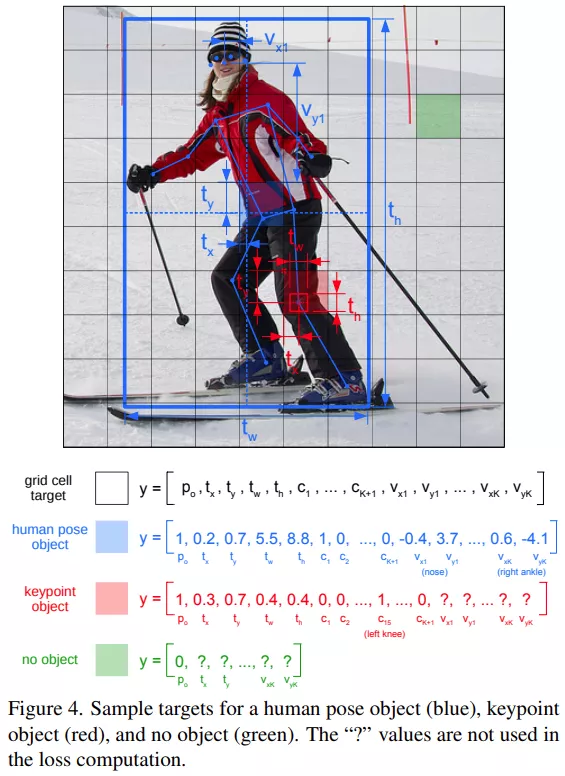

KAPAO 方法的基本原理如下圖所示:

KAPAO 借助使用多任務損失函數 L 訓練的密集檢測網絡 N ,將 RGB 圖像 I 映射為一個輸出網格

的集合,其中包含預測的姿態目標

和關鍵點目標

。

樣本 target:人體姿態目標(藍色)、關鍵點目標(紅色)、無目標(綠色),「?」值不用于損失計算。

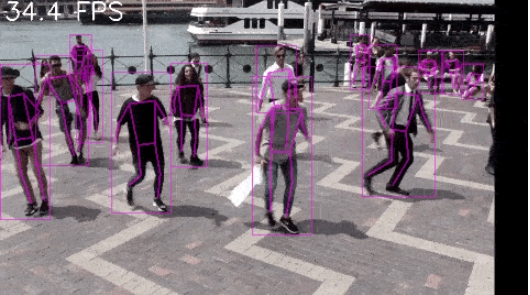

下圖展示了在 TITAN Xp GPU 上實時運行 KAPAO-S 進行視頻推理的效果:

KAPAO-S 在 TITAN Xp GPU 上可以實時運行,比本地每秒 25 幀的幀率還要快,不過圖中未顯示面部關鍵點。

實驗結果

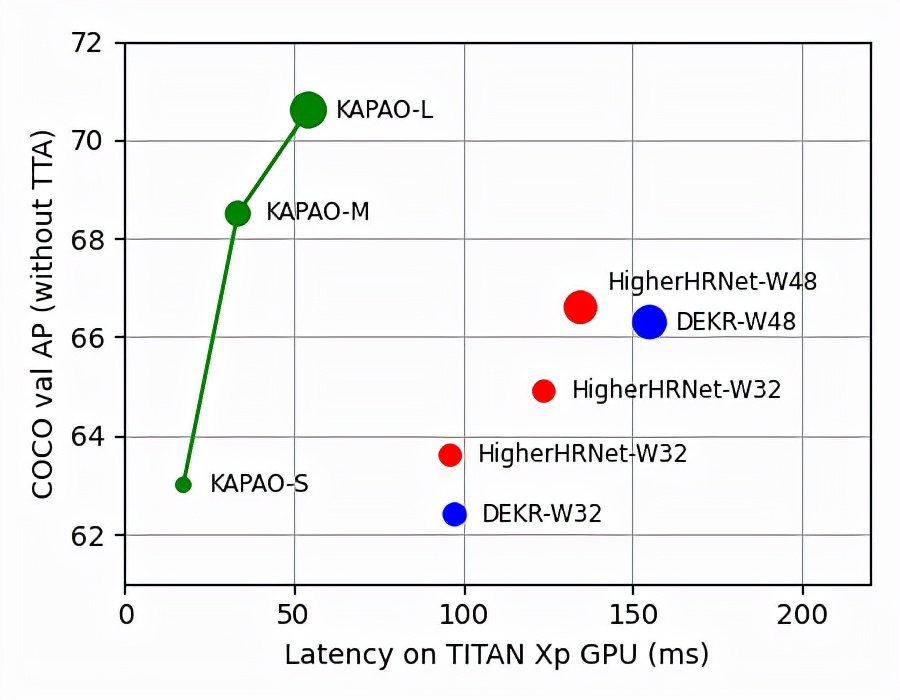

該研究用實驗表明了 KAPAO 比之前的方法明顯更快、更準確,熱圖后處理對之前的方法影響很大。此外,在不使用測試時增強(test-time augmentation,TTA)的實際設置中,KAPAO 在準確率 - 速度方面明顯更優秀。大型模型 KAPAO-L 在沒有 TTA 的情況下在 Microsoft COCO Keypoints 驗證集上實現了 70.6 AP,并且比準確率低 4.0 AP 的單階段模型還快了 2.5 倍。

圖 1:在沒有 TTA 的情況下,KAPAO 與單階段多人人體姿態估計 SOTA 方法 DEKR、 HigherHRNet 的準確率 - 速度比較結果。

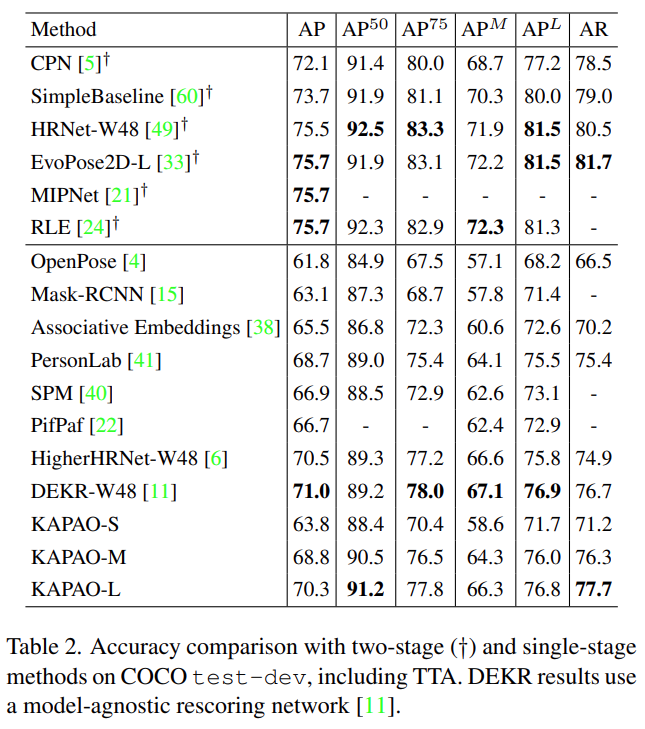

該研究在 COCO test-dev 上比較了 KAPAO 與單階段和兩階段方法的準確性,結果如下表所示。

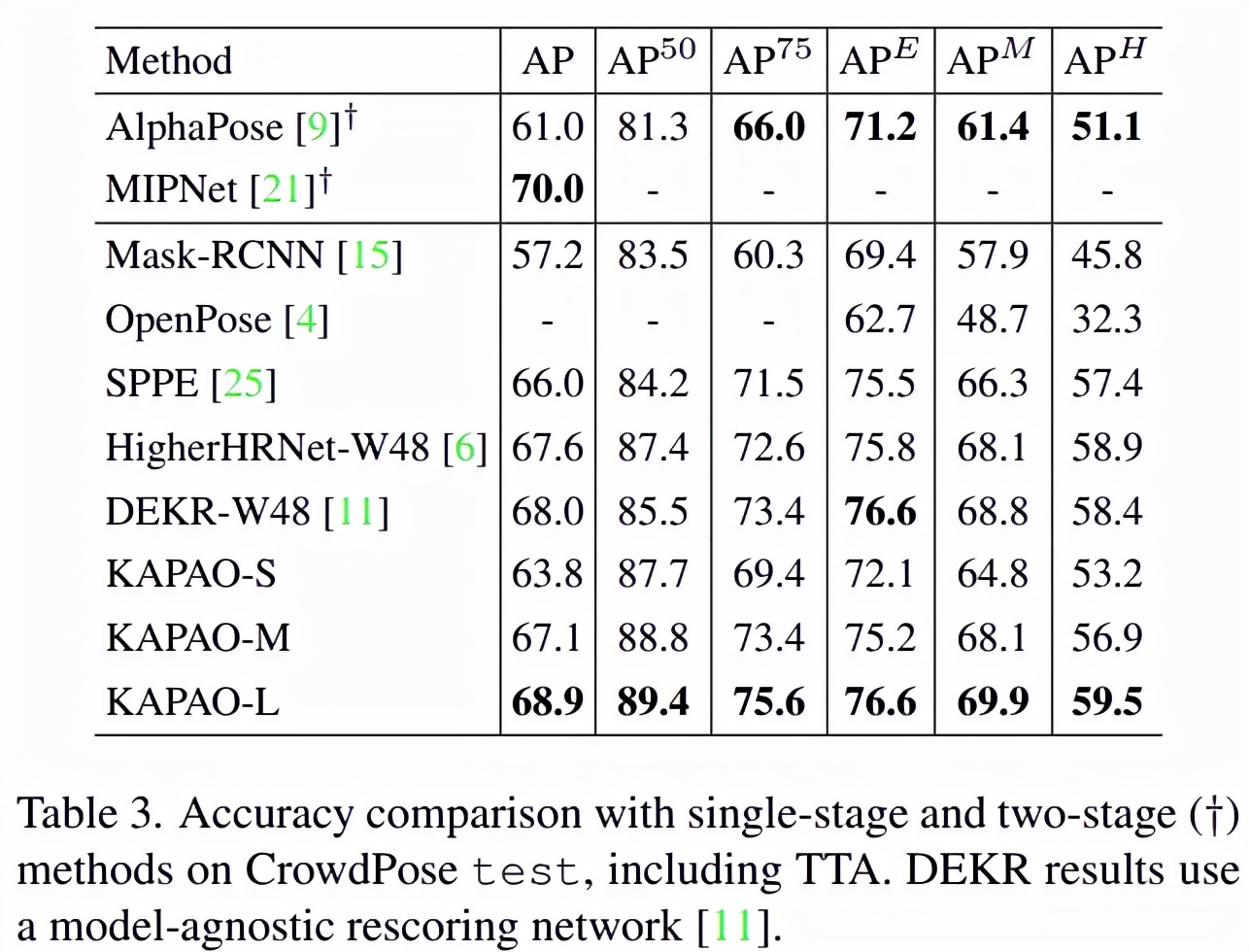

為了探究 KAPAO 在擁擠場景中的性能,該研究在 CrowdPose 測試集上對幾種模型進行了比較,結果表明 KAPAO 在存在遮擋的情況下同樣表現出色,在所有指標上超過了所有此前的單階段方法。在分析 APE、APM 和 APH 時,KAPAO 對擁擠場景的優勢是顯而易見的。

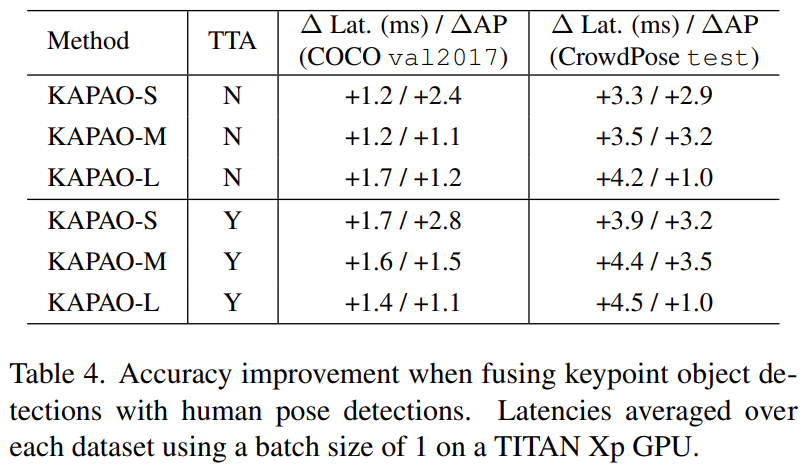

具體而言,KAPAO融合關鍵點目標和姿態目標所帶來的準確率改進如下表4所示:

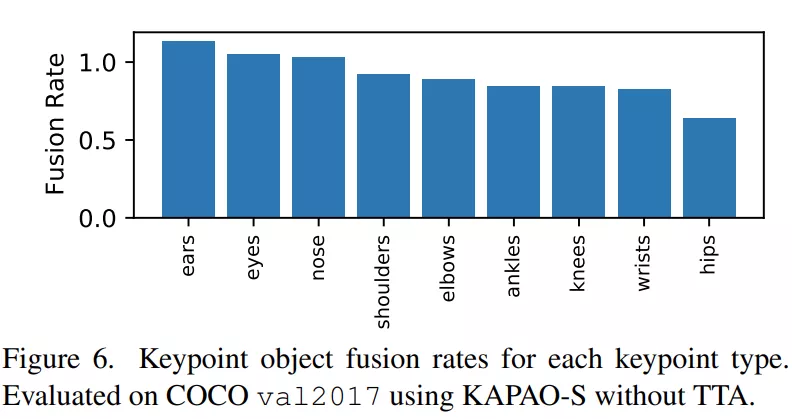

為了顯示在沒有 TTA 的情況下KAPAO的優勢,圖 6 繪制了在 COCO val2017 上,KAPAO-S 對每個關鍵點類型的融合率:

感興趣的讀者可以閱讀論文原文了解更多細節。