縮小規模,OpenAI文本生成圖像新模型GLIDE用35億參數媲美DALL-E

模型的參數規模并不需要那么大。

從年初 OpenAI 刷屏社區的 DALL-E 到英偉達生成逼真攝影的 GauGAN2,文本生成圖像可謂是今年大火的一個研究方向。現在 OpenAI 又有了新的進展——35 億參數的新模型 GLIDE。

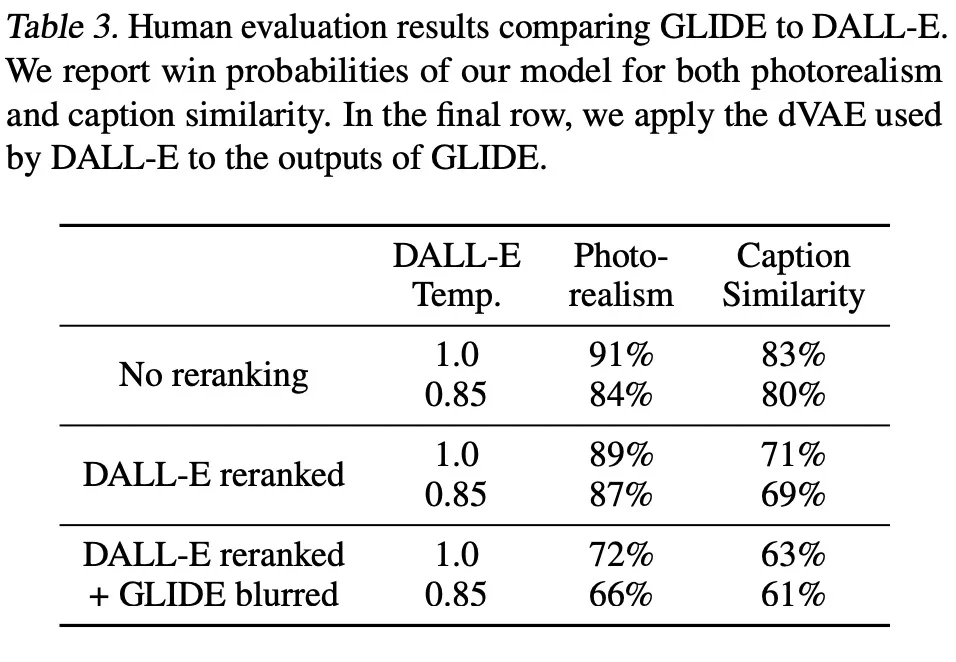

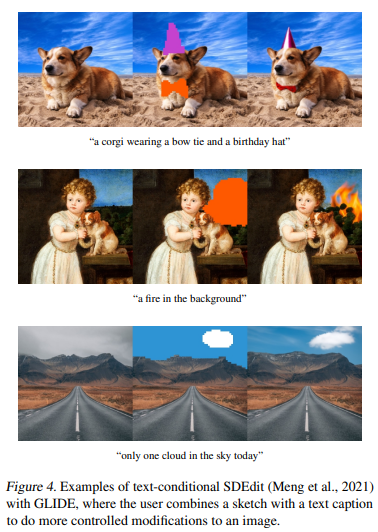

如下圖 1 所示,GLIDE 通常會生成逼真的陰影和反射,以及高質量的紋理。此外,該模型還能夠組合多個概念(例如柯基犬、領結和生日帽),同時將屬性(例如顏色)綁定到這些對象。

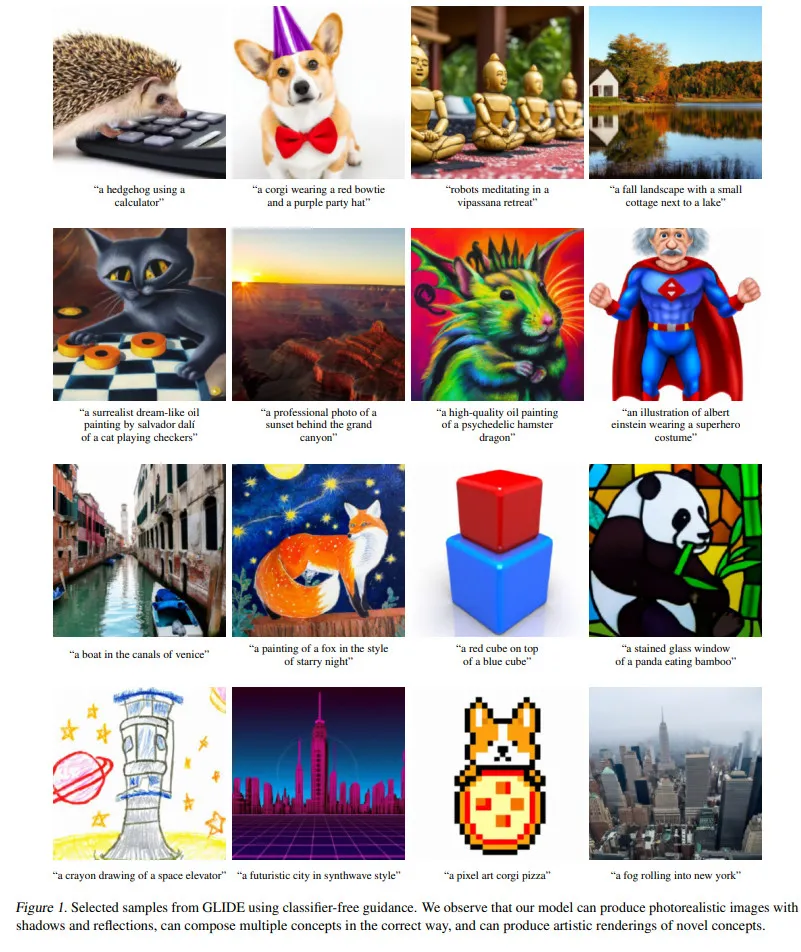

除了從文本生成圖像,GLIDE 還有圖像編輯功能——使用文本 prompt 修改現有圖像,在必要時插入新對象、陰影和反射,如下圖 2 所示。例如,在草坪上添加斑馬:

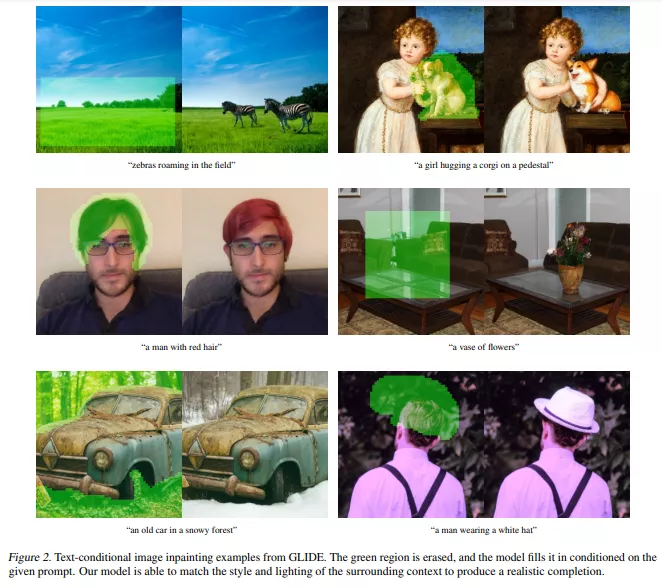

如下圖 3 所示,GLIDE 的零樣本生成和修復復雜場景的能力也很強。

GLIDE 還能夠將草圖轉換為逼真的圖像編輯。例如下圖中「一只戴著領結和生日帽的柯基犬」從涂鴉草圖轉換成了逼真的圖像。

上述功能是怎樣實現的呢?在新模型 GLIDE 中,OpenAI 將指導擴散(guided diffusion)應用于文本生成圖像的問題。首先該研究訓練了一個 35 億參數的擴散模型,使用文本編碼器以自然語言描述為條件,然后比較了兩種指導擴散模型至文本 prompt 的方法:CLIP 指導和無分類器指導。通過人工和自動評估,該研究發現無分類器指導能夠產生更高質量的圖像。

- 論文地址:https://arxiv.org/pdf/2112.10741.pdf

- 項目地址:https://github.com/openai/glide-text2im

該研究發現使用無分類器指導模型生成的樣本既逼真又反映了廣泛的現實知識。人類評估的結果表明,GLIDE 的生成結果優于 DALL-E。

此外,值得注意的是,DALL-E 的參數量是 120 億,而 GLIDE 僅有 35 億參數,卻實現了更優的性能。我們來具體看一下 GLIDE 的模型細節。

具有 35 億參數的文本條件擴散模型:GLIDE

OpenAI 以 64 × 64 的圖像分辨率訓練了一個具有 35 億參數的文本條件擴散模型(text-conditional diffusion model ),以及一個具有 15 億參數的文本條件上采樣擴散模型(text-conditional upsampling diffusion model),該模型將圖像分辨率提高到 256 × 256。對于 CLIP 指導(CLIP guidance),OpenAI 還訓練了一個噪聲感知 64 × 64 ViT-L CLIP 模型。

文本條件擴散模型

OpenAI 采用 Dhariwal & Nichol (2021) 提出的 ADM 模型架構,但使用文本條件信息對其進行了擴充。對于每個噪聲圖像 x_t 和相應的文本說明(text caption),模型對 p(xt−1|xt, caption) 進行預測。為了以文本為條件,OpenAI 首先將文本編碼為 K 個 token 序列,然后將這些 token 輸入到 Transformer 模型中(Vaswani 等,2017)。這個 transformer 的輸出有兩種用途:

- 首先,使用最終的 token 嵌入代替 ADM 模型中的類嵌入;

- 其次,最后一層的 token 嵌入(K 個特征向量序列)分別投影到 ADM 模型中每個注意力層,然后連接到每一層的注意力上下文。

OpenAI 采用與 DALL-E 完全相同的數據集訓練模型,并且使用與 Dhariwal & Nichol (2021) 提出的 ImageNet 64 × 64 模型相同的模型架構,模型通道為 512 ,從而為模型的視覺部分生成大約 23 億個參數。對于文本編碼 Transformer,OpenAI 使用 24 個殘差塊,產生大約 12 億個參數。

此外,OpenAI 還訓練了一個具有 15 億參數的上采樣擴散模型,圖像分辨率從 64 × 64 增加到 256 × 256 。該模型同樣以文本為條件,但使用寬度為 1024 較小的文本編碼器(而不是 2048 )。

無分類器指導的微調

模型初始訓練完成之后,可以微調基本模型以支持無條件圖像生成。訓練過程與預訓練完全相同,只是 20% 的文本 token 序列被替換為空序列。通過這種方式,模型保留了生成文本條件輸出的能力,同時也可以無條件地生成圖像。

圖像修復與編輯

以前的圖像修復工作存在一個缺點,即模型在采樣過程中無法看到整個上下文信息。為了獲得更好的生成效果,OpenAI 對模型進行了微調:微調時,隨機擦除訓練樣本一些區域,其余部分與掩碼通道一起作為附加條件信息輸入模型。OpenAI 對模型架構進行了修改,增加了四個額外的輸入通道:第二組 RGB 通道和一個掩碼通道。在微調之前,OpenAI 將這些新通道的相應輸入權重初始化為零。對于上采樣模型,OpenAI 提供了完整的低分辨率圖像,但對于未掩碼的區域提供高分辨率圖像。

CLIP 指導擴散

鑒于分類器指導和 CLIP 指導的相似性,應用 CLIP 來提高文本條件擴散模型的生成質量似乎很自然。為了更好地匹配 Dhariwal & Nichol (2021) 的分類器指導技術,OpenAI 使用圖像編碼器訓練噪聲感知 CLIP 模型,該圖像編碼器接收噪聲圖像,以 64 × 64 的分辨率訓練模型。

實驗結果

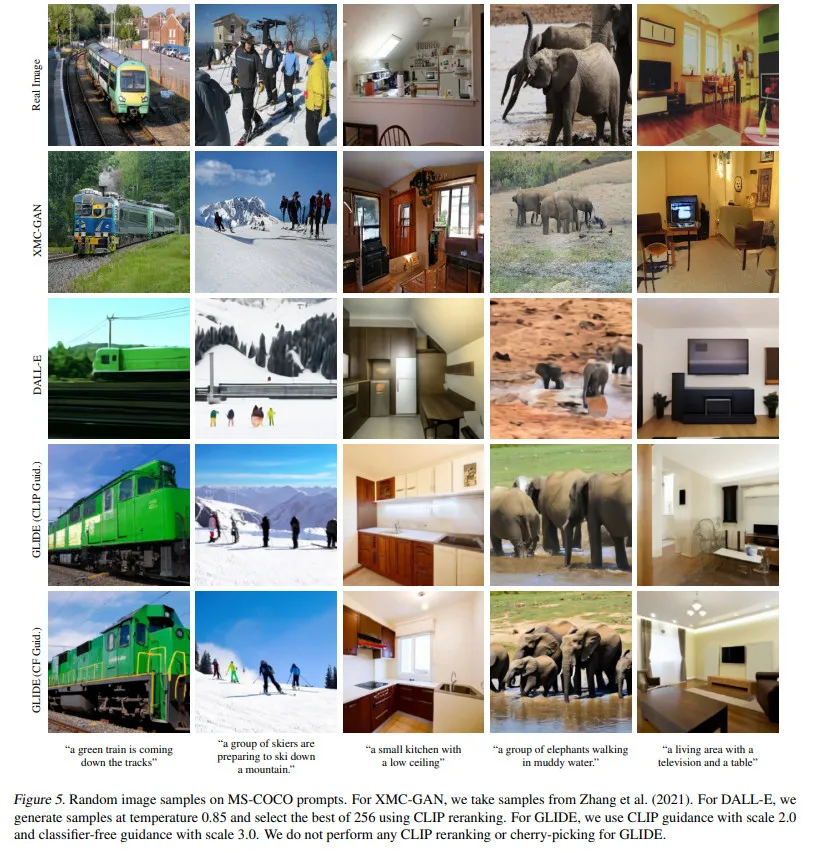

該研究將 GLIDE 與之前的 SOTA 模型進行了定性比較,結果如下圖 5 所示。GLIDE 生成了更逼真的圖像,并且無需 CLIP 重排序或挑選。

定量結果

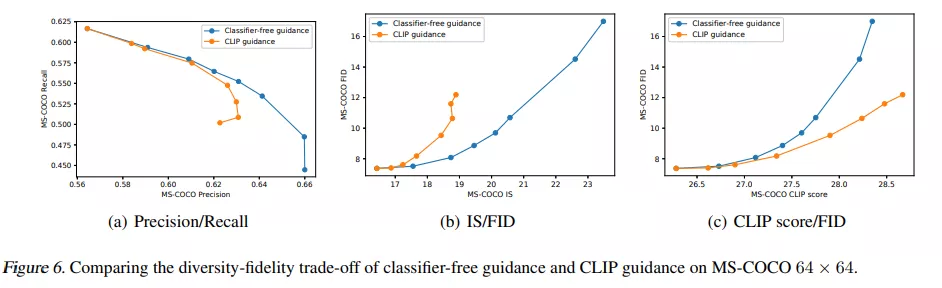

該研究首先通過查看圖像質量保真度權衡的帕累托前沿來評估無分類器指導和 CLIP 指導之間的差異。下圖 6 在 64 × 64 分辨率下評估了這兩種方法的零樣本 MS-COCO 生成。

該研究設置的人類評估實驗如下:

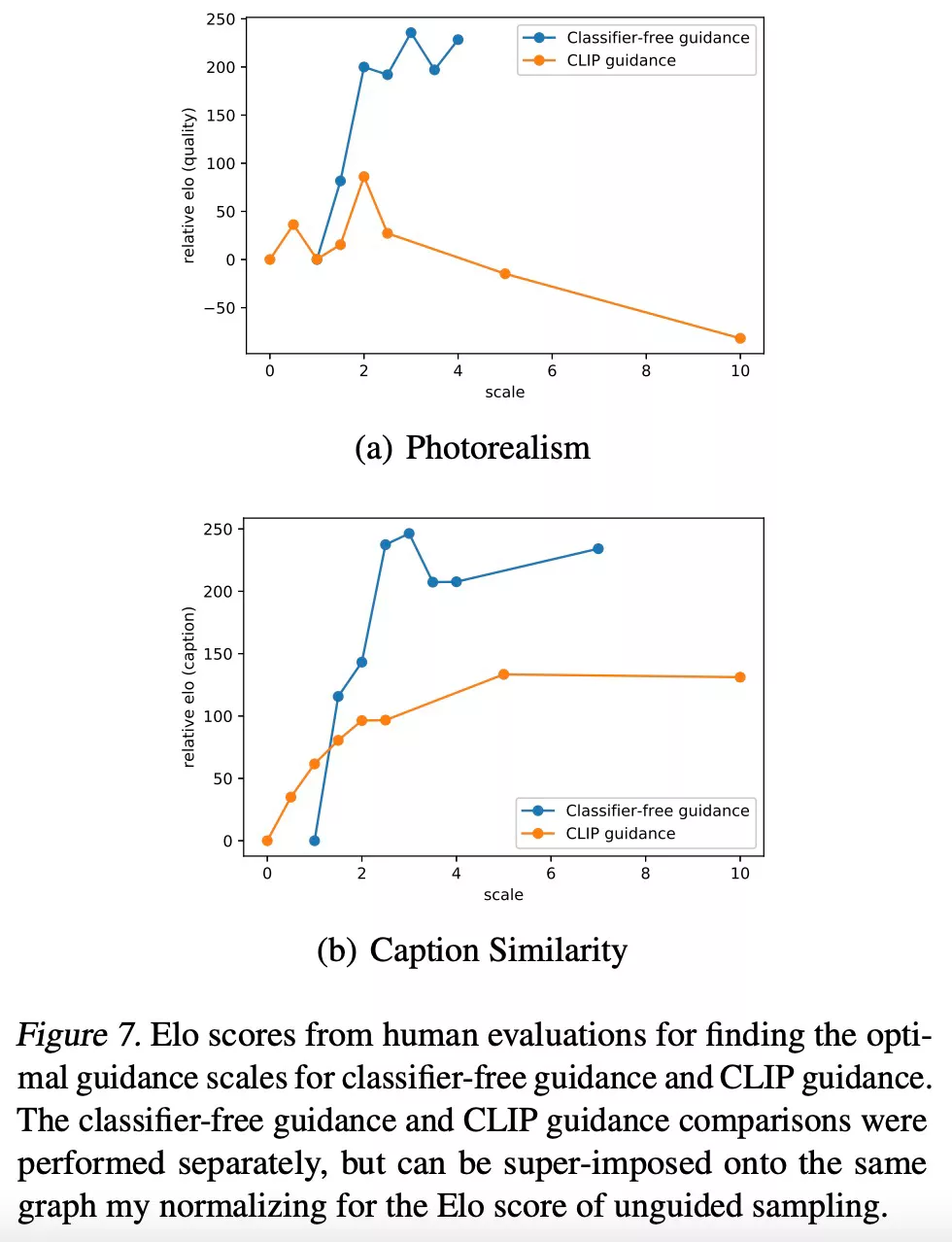

讓人們觀察兩個 256 × 256 的圖像,并按如下兩條標準選出一個更優的圖像:要么更好地匹配給定的標題,要么看起來更逼真。評估結果如下圖 7 所示。

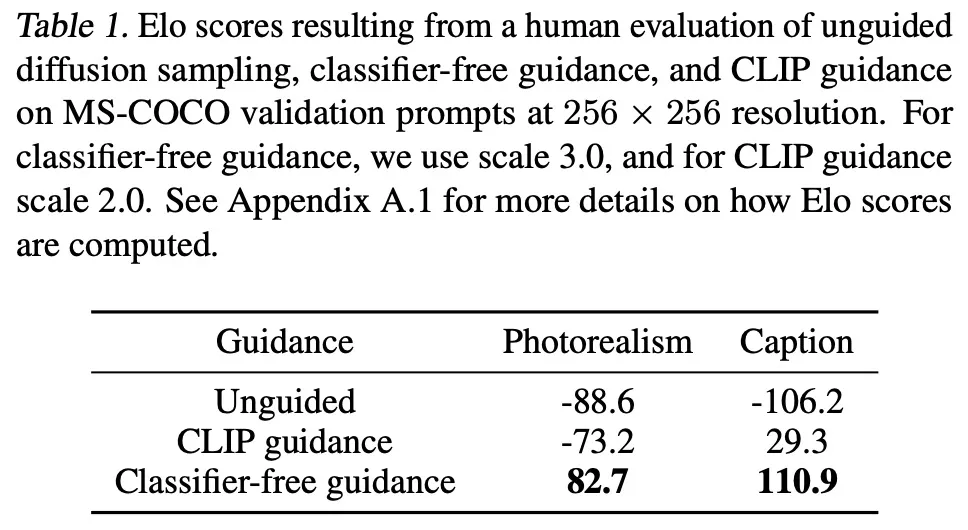

并將人類評估的結果和下表 1 的結果進行比較,然后該研究發現人類和 CLIP 指導給出的分數不一致,因此無分類器指導能夠產生與人類認知一致的更高質量生成結果。

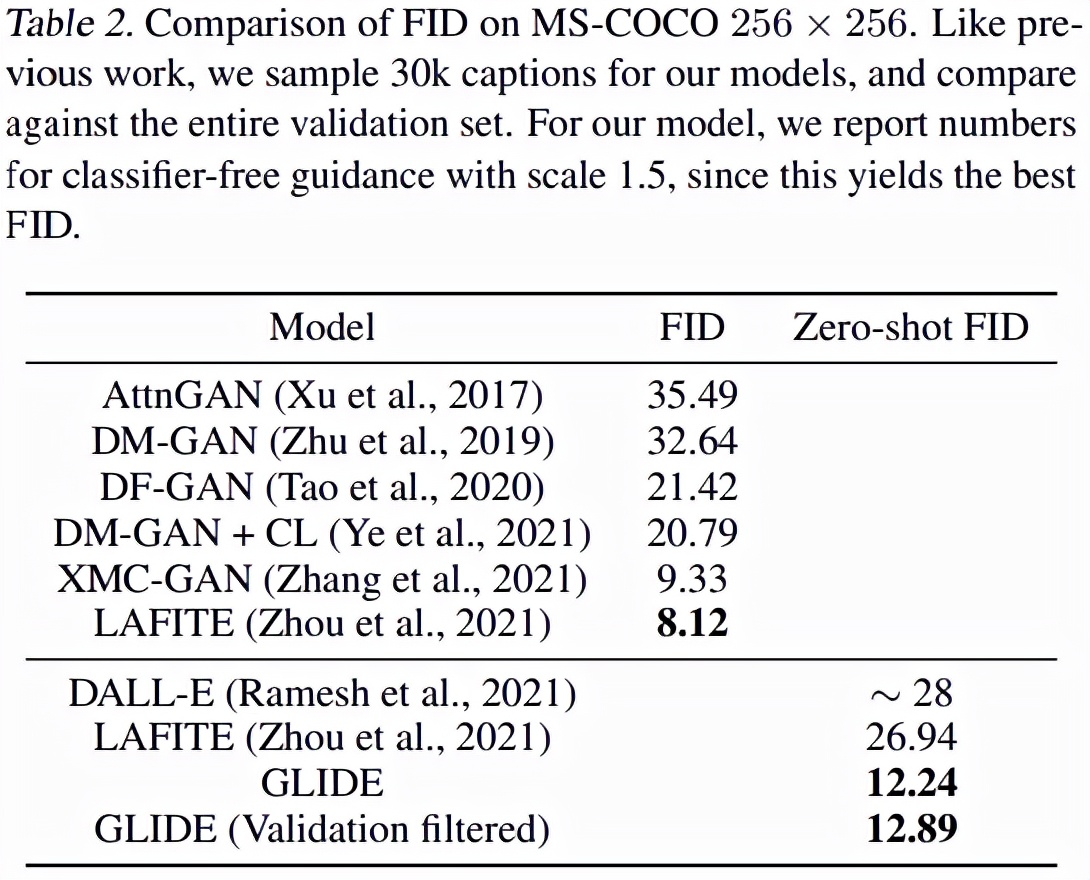

此外,研究者還將 GLIDE 與其他文本生成圖像模型進行了比較,結果如下表 2 所示。GLIDE 在 MS-COCO 上獲得有競爭力的 FID。

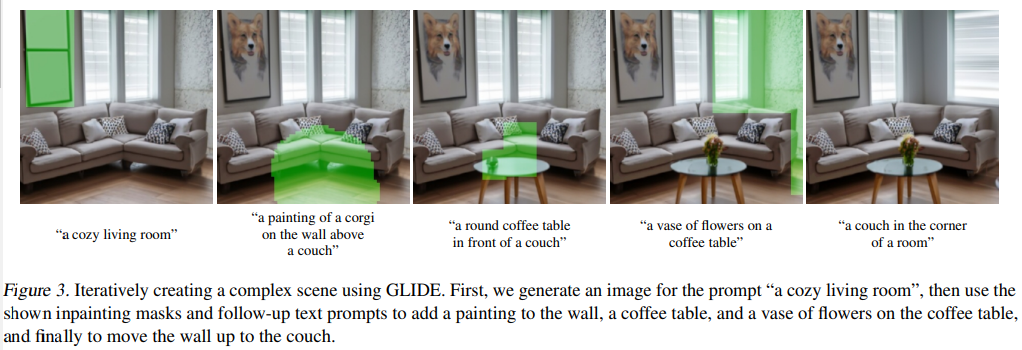

最后,該研究使用上述人類評估實驗設置比較了 GLIDE 和 DALL-E ,結果如下表 3 所示。注意到 GLIDE 的訓練使用與 DALL-E 大致相同的訓練計算,但模型要小得多(35 億參數 VS120 億參數),所需采樣延遲更少,并且不需要 CLIP 重排序。