Habitat Challenge 2022冠軍技術:字節(jié)AI Lab提出融合傳統和模仿學習的主動導航

物體目標導航 (Object Navigation) 是智能機器人的基本任務之一。在此任務中,智能機器人在一個未知的新環(huán)境中主動探索并找到人指定的某類物體。物體目標導航任務面向未來家庭服務機器人的應用需求,當人們需要機器人完成某些任務時,例如拿一杯水,機器人需要先尋找并移動到水杯的位置,進而幫人們取到水杯。

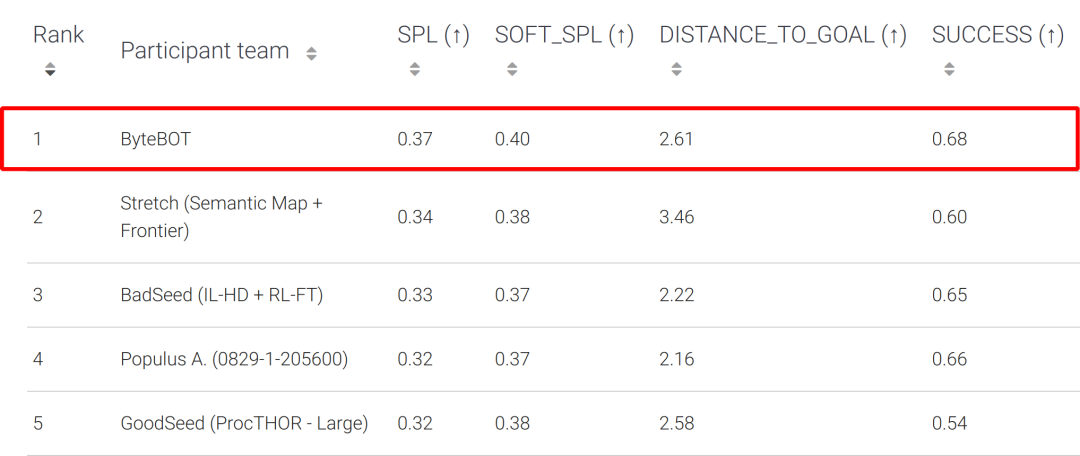

Habitat Challenge 挑戰(zhàn)賽由 Meta AI 等機構聯合舉辦,是物體目標導航領域的知名賽事之一,截至 2022 今年已連續(xù)舉辦 4 屆,本次比賽共有 54 支參賽隊參加。在比賽中,字節(jié)跳動 AI Lab-Research 團隊的研究者針對現有方法的不足,提出了一種全新的物體目標導航框架。該框架巧妙地將模仿學習與傳統方法結合,從一眾方法中脫穎而出獲得冠軍。在關鍵指標 SPL 中大幅度超過了第二名及其他參賽隊伍的結果。歷史上該賽事的冠軍隊伍一般是 CMU、UC Berkerly、Facebook 等知名研究機構。

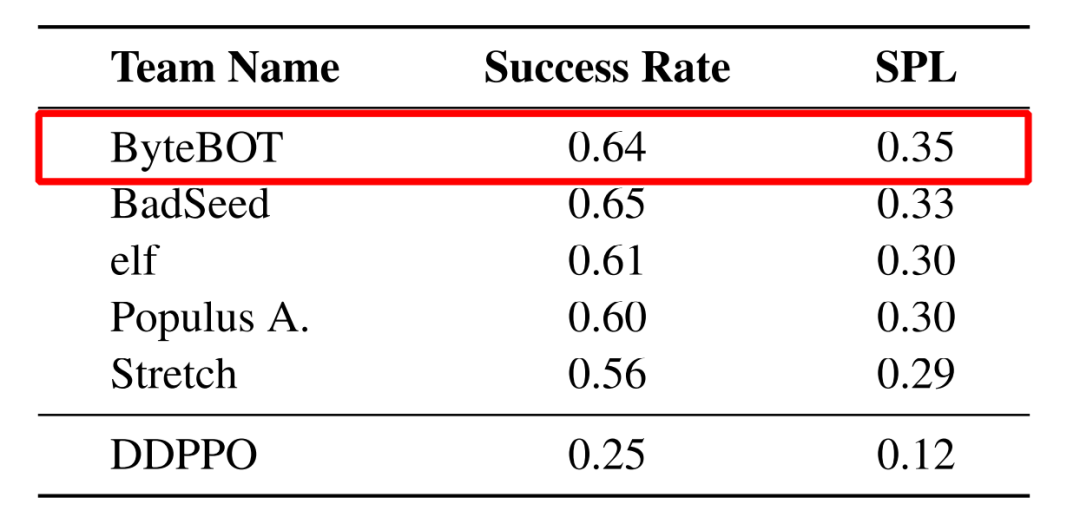

Test-Standard 榜單

Test-Challenge 榜單

Habitat Challenge 比賽官網:https://aihabitat.org/challenge/2022/

Habitat Challenge 比賽 LeaderBoard:https://eval.ai/web/challenges/challenge-page/1615/leaderboard

1. 研究動機

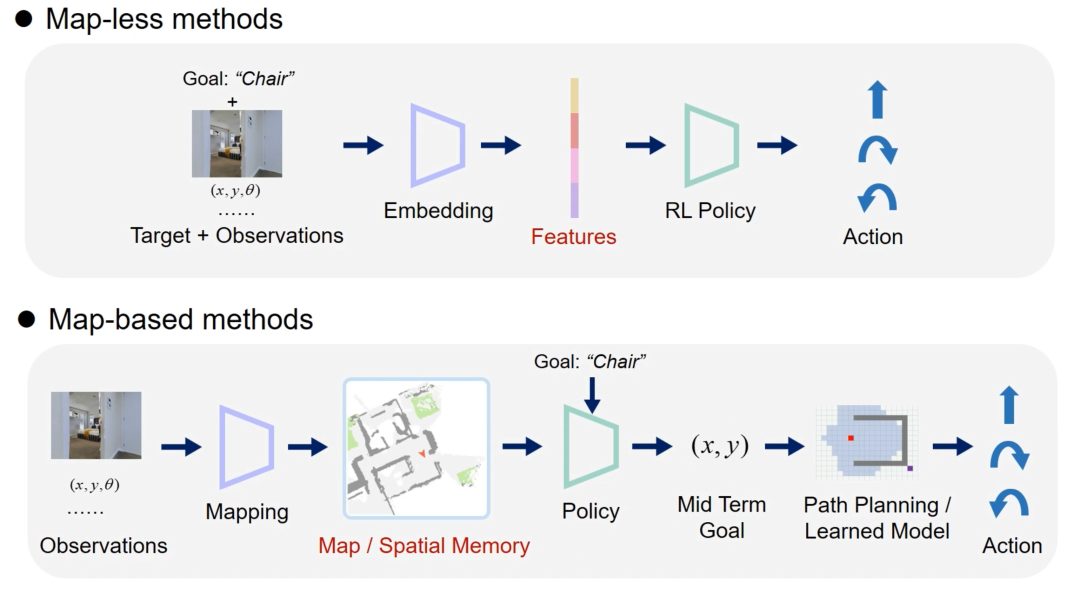

目前的物體目標導航方法可以大致分為端到端的方法和基于地圖的方法兩大類。端到端的方法提取輸入的傳感器數據的特征,再送入一個深度學習模型中得到 action,此類方法一般基于強化學習或模仿學習(如圖1Map-less methods);基于地圖的方法一般會構建顯式或隱式地圖,然后通過強化學習等方法在地圖上選取一個目標點,最后規(guī)劃路徑并得到 action(如圖1Map-based method)。

圖1 端到端的方法(上)和基于地圖的方法(下)流程示意圖

在經過大量實驗對比兩類方法后,研究者們發(fā)現這兩類方法各有優(yōu)劣:端到端的方法不需要構建環(huán)境的地圖,因此更加簡潔,且不同場景的泛化能力更強。但由于網絡需要學習編碼環(huán)境的空間信息,依賴大量的訓練數據,且難以同時學習一些簡單的行為,比如在目標物體附近停下。而基于地圖的方法使用柵格來存儲特征或語義,具有顯式空間信息,因此這類行為的學習門檻較低。但它非常依賴準確的定位結果,而且在一些如樓梯等環(huán)境中,需要人工設計感知和路徑規(guī)劃策略。

基于上述結論,字節(jié)跳動 AI Lab-Research 團隊的研究者們希望將兩類方法的優(yōu)勢結合起來。然而這兩類方法的算法流程差異很大,難以直接組合;此外也很難設計出一種策略直接融合兩種方法的輸出。因此研究者設計了一種簡單但有效的策略,使兩類方法根據機器人的狀態(tài)交替進行主動探索和物體搜索,從而將各自的優(yōu)勢最大程度地發(fā)揮出來。

2. 競賽方法

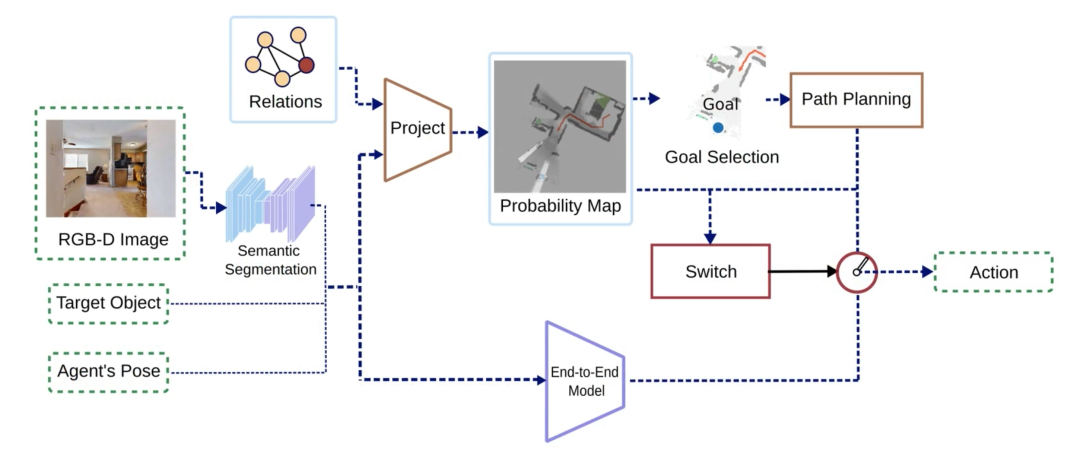

算法主要有兩個分支組成:基于概率地圖的分支和端到端的分支。算法的輸入是第一視角的 RGB-D 圖像和機器人位姿,以及需要尋找的目標物體類別,輸出是下一步動作 (action)。首先對 RGB 圖像進行實例分割,并將其與其他原始輸入數據一起傳給兩個分支。兩個分支分別輸出各自的 action,并由一個切換策略決定最終輸出的 action。

圖2 算法流程示意圖

基于概率地圖的分支

基于概率地圖的分支借鑒了 Semantic linking map[2] 的思想,對作者原來發(fā)表在 IROS 機器人頂會的論文[3]的方法進行了簡化。該分支根據輸入的實例分割結果、深度圖和機器人位姿,一方面構建 2D 語義地圖;另一方面基于預先學習的物體間關聯概率,對一張概率地圖進行更新。

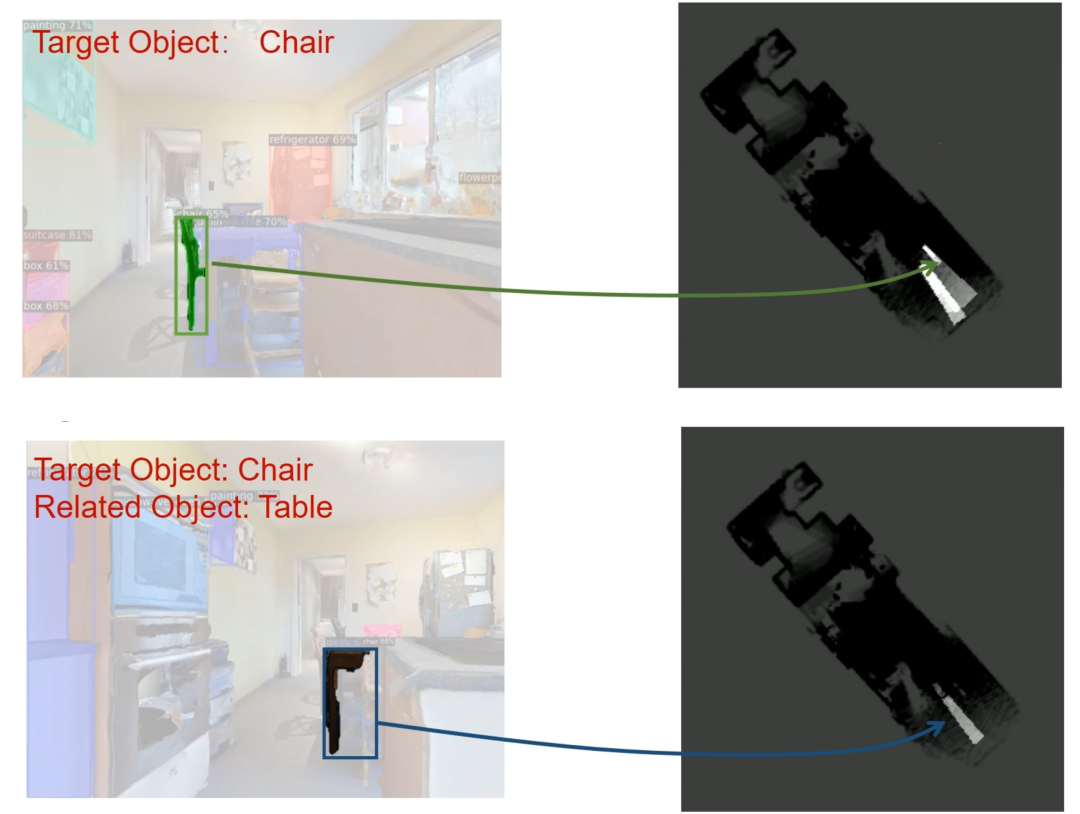

概率地圖的更新方式包括以下幾種:當檢測到目標物體但沒有足夠把握時(置信概率 confidence score 低于閾值),此時應該繼續(xù)靠近觀察,因此概率地圖上相應區(qū)域的概率值應該提高(如圖 3 上方所示);同理,如果檢測到和目標物體有關聯的物體(例如桌子和椅子放在一起的概率比較高),則相應區(qū)域的概率值也會提高(如圖 3 下方所示)。算法通過選擇概率最高的區(qū)域作為目標點,鼓勵機器人靠近潛在目標物體以及關聯物體進一步觀察,直到找到置信概率高于閾值的目標物體。

圖3 概率地圖更新方式示意圖

端到端的分支

端到端分支的輸入包括 RGB-D 圖像、實例分割結果、機器人位姿,以及目標物體類別,并直接輸出 action。端到端分支的主要作用是引導機器人像人類一樣尋找物體,因此采用了 Habitat-Web[4] 方法的模型和訓練流程。該方法基于模仿學習,通過在訓練集中收集人類尋找物體的示例樣本訓練網絡。

切換策略

切換策略主要根據概率地圖和路徑規(guī)劃的結果,在概率地圖分支和端到端分支輸出的兩個 action 中選擇一個作為最終輸出。當概率地圖中沒有概率大于閾值的柵格,機器人需要對環(huán)境進行探索;當地圖上無法規(guī)劃出可行路徑時,此時機器人可能處于一些特殊環(huán)境(如樓梯),這兩種情況下會采用端到端分支,使機器人具備足夠的環(huán)境適應能力。其他情況則選擇概率地圖分支,充分發(fā)揮其在尋找目標物體方面的優(yōu)勢。

該切換策略的效果如視頻所示,機器人一般情況下利用端到端分支高效地探索環(huán)境,一旦發(fā)現了可能的目標物體或關聯物體,則切換到概率地圖分支靠近觀察,如果目標物體的置信概率大于閾值,則在目標物體處停下;否則該區(qū)域的概率值會不斷降低,直到沒有概率大于閾值的柵格,機器人重新切換回端到端繼續(xù)探索。

從視頻中可以看出,這種方法兼具了端到端方法和基于地圖的方法的優(yōu)勢。兩個分支各司其職,端到端方法主要負責探索環(huán)境;概率地圖分支負責靠近感興趣區(qū)域進行觀察。因此該方法不僅能夠在復雜場景探索(如樓梯),還降低了端到端分支的訓練要求。

3. 總結

針對物體主動目標導航任務,字節(jié)跳動 AI Lab-Research 團隊提出了一種結合經典概率地圖與現代模仿學習的框架。該框架是對傳統方法與端到端方法相結合的一次成功的嘗試。在 Habitat 競賽中,字節(jié)跳動 AI Lab-Research 團隊提出的方法大幅度超出了第二名及其他參賽隊伍的結果,證明了算法的先進性。通過將傳統方法引入目前主流的 Embodied AI 端到端方法,來進一步彌補端到端方法的一些不足,從而使得智能機器人在幫助人、服務人的道路上更進一步。

近期,字節(jié)跳動 AI Lab-Research 團隊在機器人領域的研究還被 CoRL、IROS、ICRA 等機器人頂會收錄,其中包括物體位姿估計、物體抓取、目標導航、自動裝配、人機交互等機器人核心任務。

【CoRL 2022】Generative Category-Level Shape and Pose Estimation with Semantic Primitives

- 論文地址:https://arxiv.org/abs/2210.01112

【IROS 2022】3D Part Assembly Generation with Instance Encoded Transformer

- 論文地址:https://arxiv.org/abs/2207.01779

【IROS 2022】Navigating to Objects in Unseen Environments by Distance Prediction

- 論文地址:https://arxiv.org/abs/2202.03735

【EMNLP 2022】Towards Unifying Reference Expression Generation and Comprehension

- 論文地址:https://arxiv.org/pdf/2210.13076

【ICRA 2022】Learning Design and Construction with Varying-Sized Materials via Prioritized Memory Resets

- 論文地址:https://arxiv.org/abs/2204.05509

【IROS 2021】Simultaneous Semantic and Collision Learning for 6-DoF Grasp Pose Estimation

- 論文地址:https://arxiv.org/abs/2108.02425

【IROS 2021】Learning to Design and Construct Bridge without Blueprint

- 論文地址:https://arxiv.org/abs/2108.02439

4. 參考文獻

[1] Yadav, Karmesh, et al. "Habitat-Matterport 3D Semantics Dataset." arXiv preprint arXiv:2210.05633 (2022).

[2] Zeng, Zhen, Adrian R?fer, and Odest Chadwicke Jenkins. "Semantic linking maps for active visual object search." 2020 IEEE International Conference on Robotics and Automation (ICRA). IEEE, 2020.

[3] Minzhao Zhu, Binglei Zhao, and Tao Kong. "Navigating to Objects in Unseen Environments by Distance Prediction." arXiv preprint arXiv:2202.03735 (2022).

[4] Ramrakhya, Ram, et al. "Habitat-Web: Learning Embodied Object-Search Strategies from Human Demonstrations at Scale." Proceedings of the IEEE/CVF Conference on Computer Vision and Pattern Recognition. 2022.

5. 關于我們

字節(jié)跳動 AI Lab NLP&Research 專注于人工智能領域的前沿技術研究,涵蓋了自然語言處理、機器人等多個技術研究領域,同時致力于將研究成果落地,為公司現有的產品和業(yè)務提供核心技術支持和服務。團隊技術能力正通過火山引擎對外開放,賦能 AI 創(chuàng)新。

字節(jié)跳動 AI-Lab NLP&Research 聯系方式

- 招聘咨詢:fankaijing@bytedance.com

- 學術合作:luomanping@bytedance.com