GPT-4太強(qiáng),OpenAI也不懂!智能到底是怎么突然「涌現(xiàn)」的?

2023年至今,ChatGPT和GPT-4始終霸占在熱搜榜上,一方面外行人都在驚嘆于AI怎么突然如此強(qiáng)大,會不會革了「打工人」的命;另一方面,其實(shí)內(nèi)行人也不明白,為什么模型規(guī)模在突破某一界限后,突然就「涌現(xiàn)」出了驚人的智能。

出現(xiàn)智能是好事,但模型不可控、不可預(yù)測、不可解釋的行為,卻讓整個學(xué)術(shù)界陷入了迷茫與深思。

突然變強(qiáng)的超大模型

先出一道簡單的題目,下面這幾個emoj代表了什么電影?

最簡單的語言模型往往只能續(xù)寫出「The movie is a movie about a man who is a man who is a man」;中等復(fù)雜度模型的答案則更接近,給出的答案是「The Emoji Movie」;但最復(fù)雜的語言模型只會給出一個答案:海底總動員「Finding Nemo」

實(shí)際上這個prompt也是為測試各種大型語言模型能力而設(shè)計的204項任務(wù)之一。

Google Research的計算機(jī)科學(xué)家Ethan Dyer參與組織了這次測試,他表示,雖然構(gòu)建BIG-Bench數(shù)據(jù)集的時候我已經(jīng)準(zhǔn)備好了迎接驚喜,但當(dāng)真的見證這些模型能做到的時候,還是感到非常驚訝。

驚訝之處在于,這些模型只需要一個提示符:即接受一串文本作為輸入,并且純粹基于統(tǒng)計數(shù)據(jù)一遍又一遍地預(yù)測接下來是什么內(nèi)容。

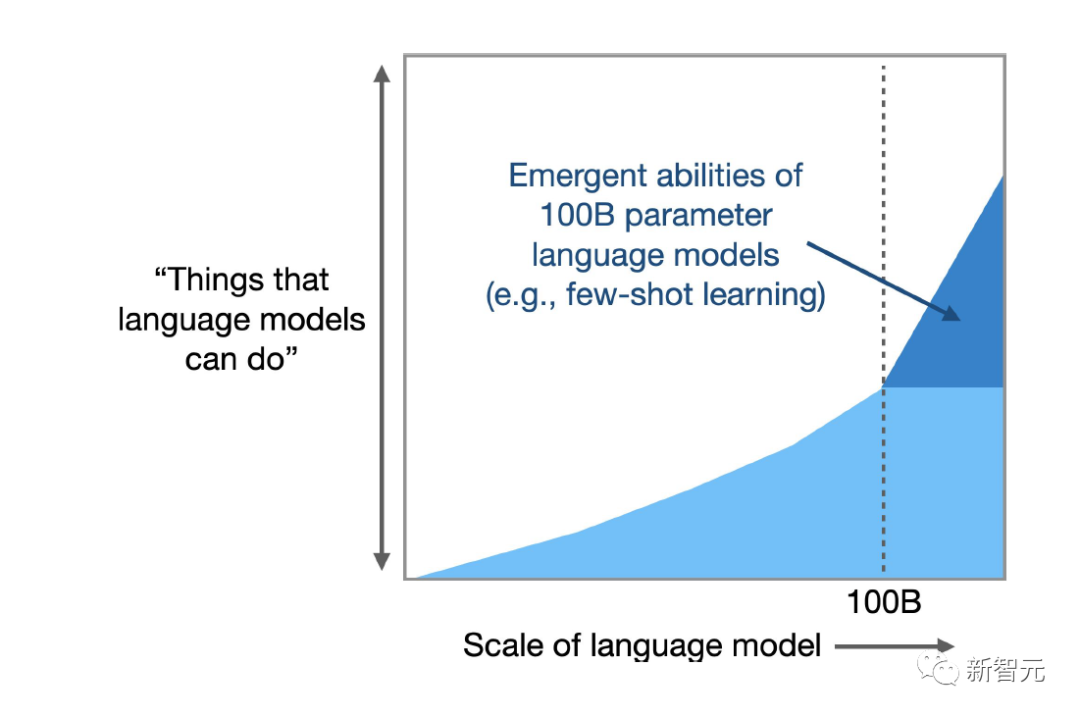

計算機(jī)科學(xué)家曾預(yù)計,擴(kuò)大規(guī)模可以提高已知任務(wù)的性能,但他們沒有預(yù)料到模型會突然能夠處理這么多新的、不可預(yù)測的任務(wù)。

Dyer最近參與的一項調(diào)研結(jié)果顯示,LLM 可以產(chǎn)生數(shù)百種「涌現(xiàn)」(emergent)能力,即大型模型可以完成的任務(wù),小型模型無法完成,其中許多任務(wù)似乎與分析文本無關(guān),比如從乘法計算到生成可執(zhí)行的計算機(jī)代碼,還包括基于Emoji符號的電影解碼等。

新的分析表明,對于某些任務(wù)和某些模型,存在一個復(fù)雜性閾值,超過這個閾值,模型的功能就會突飛猛進(jìn)。

研究人員也提出了涌現(xiàn)能力的另一個負(fù)面影響:隨著復(fù)雜性的增加,一些模型在回答中顯示出新的偏見(biases)和不準(zhǔn)確性。

斯坦福大學(xué)的計算機(jī)科學(xué)家 Rishi Bommasani 表示,我所知道的任何文獻(xiàn)中都沒有討論過語言模型可以做這些事情。

去年,Bommasani 參與編制了一份包含幾十種涌現(xiàn)行為的清單,其中包括在Dyer的項目中發(fā)現(xiàn)的幾種行為,并且這個名單還在繼續(xù)變長。

論文鏈接:https://openreview.net/pdf?id=yzkSU5zdwD

目前研究人員不僅在競相發(fā)現(xiàn)更多的涌現(xiàn)能力,而且還在努力找出它們發(fā)生的原因和方式,本質(zhì)上是試圖對不可預(yù)測性進(jìn)行預(yù)測。

理解涌現(xiàn)可以揭示圍繞人工智能和一般機(jī)器學(xué)習(xí)的深層次問題的答案,比如復(fù)雜模型是否真的在做一些新的事情,或者只是在統(tǒng)計方面變得非常擅長,它還可以幫助研究人員利用潛在的優(yōu)勢和減少涌現(xiàn)風(fēng)險。

人工智能初創(chuàng)公司 Anthroic 的計算機(jī)科學(xué)家Deep Ganguli表示,我們不知道如何判斷哪種應(yīng)用程序的危害能力將會出現(xiàn),無論是正常出現(xiàn)的還是不可預(yù)測的。

涌現(xiàn)的涌現(xiàn)(The Emergence of Emergence)

生物學(xué)家、物理學(xué)家、生態(tài)學(xué)家和其他科學(xué)家使用「涌現(xiàn)」一詞來描述當(dāng)一大群事物作為一個整體時出現(xiàn)的自組織、集體行為。

比如無生命的原子組合產(chǎn)生活細(xì)胞; 水分子產(chǎn)生波浪; 椋鳥的低語以變化但可識別的模式在天空中飛翔; 細(xì)胞使肌肉運(yùn)動和心臟跳動。

重要的是,涌現(xiàn)能力在涉及大量獨(dú)立部分的系統(tǒng)中都有出現(xiàn),但是研究人員直到最近才能夠在 LLM 中發(fā)現(xiàn)這些能力,或許是因為這些模型已經(jīng)發(fā)展到了足夠大的規(guī)模。

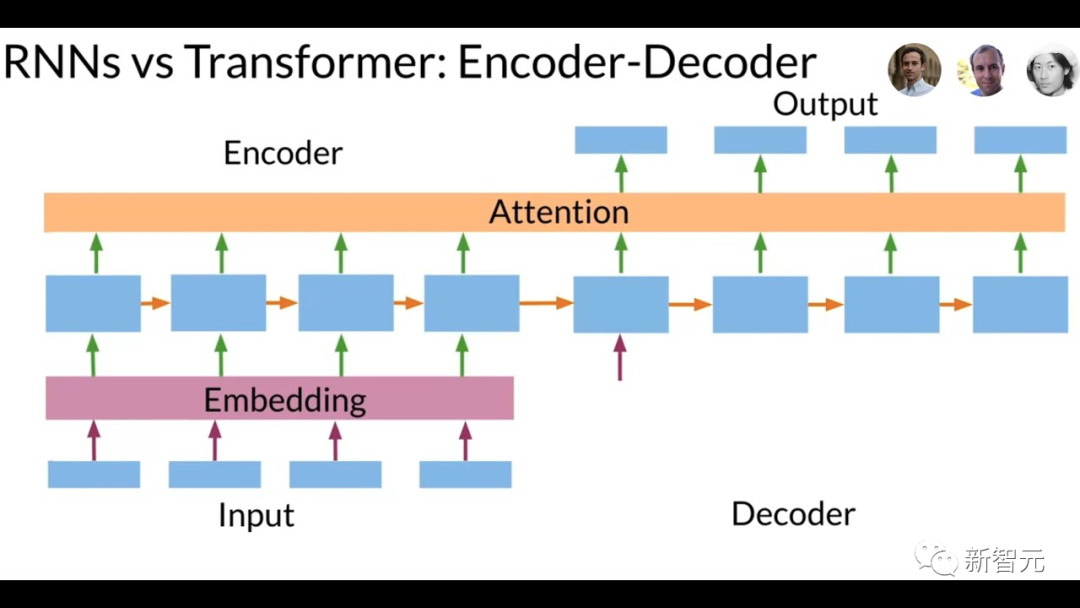

語言模型已經(jīng)存在了幾十年,但直到五年前最強(qiáng)大的武器還是基于循環(huán)神經(jīng)網(wǎng)絡(luò)(RNN),訓(xùn)練方法就是輸入一串文本并預(yù)測下一個單詞是什么;之所以叫循環(huán)(recurrent),是因為模型從自己的輸出中進(jìn)行學(xué)習(xí),即把模型的預(yù)測反饋到網(wǎng)絡(luò)中,以改善性能。

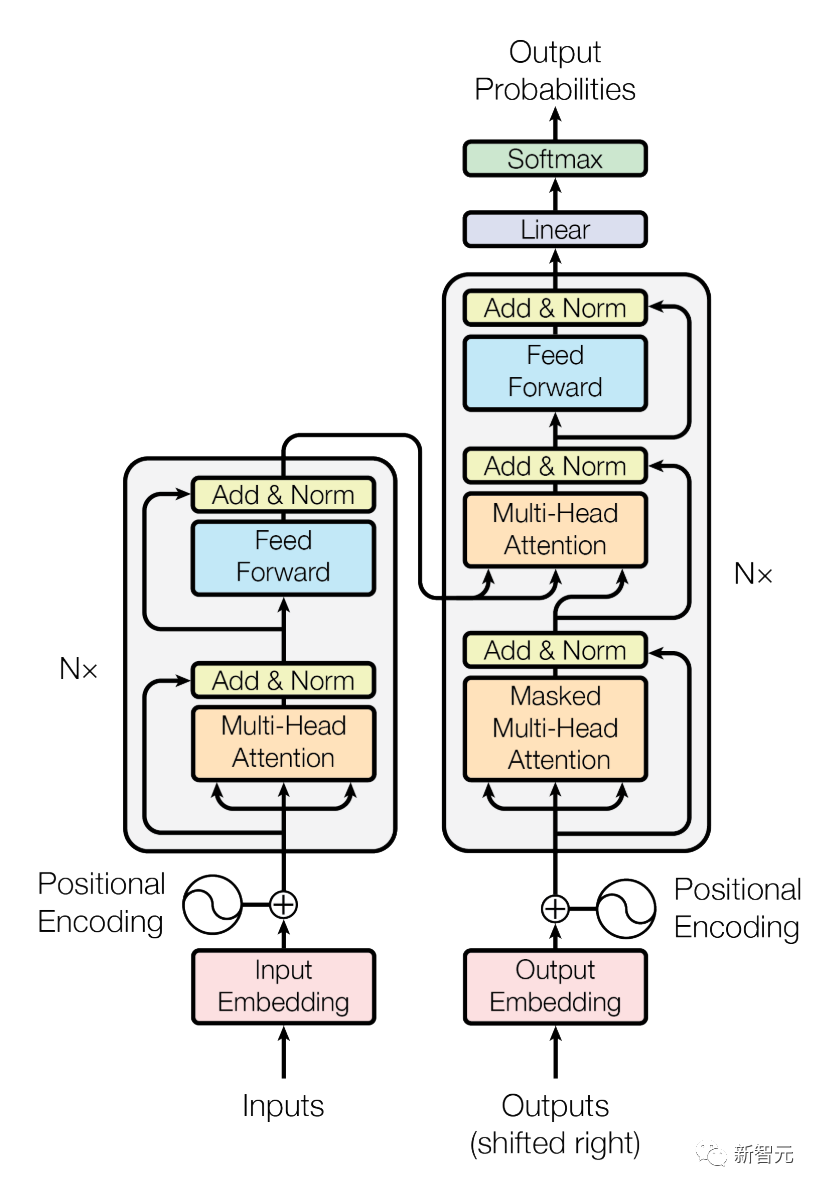

2017年,谷歌大腦的研究人員引入了一種名為Transformer的全新架構(gòu),相比循環(huán)網(wǎng)絡(luò)逐字分析一個句子,Transformer可以同時處理所有的單詞,也就意味著Transformer可以并行處理大量文本。

通過增加模型中的參數(shù)數(shù)量以及其他因素,Transformer使語言模型的復(fù)雜性得以快速擴(kuò)展,其中參數(shù)可以被認(rèn)為是單詞之間的連接,模型通過在訓(xùn)練期間調(diào)整這些連接的權(quán)重以改善預(yù)測結(jié)果。

模型中的參數(shù)越多,建立聯(lián)系的能力就越強(qiáng),模擬人類語言的能力也就越強(qiáng)。

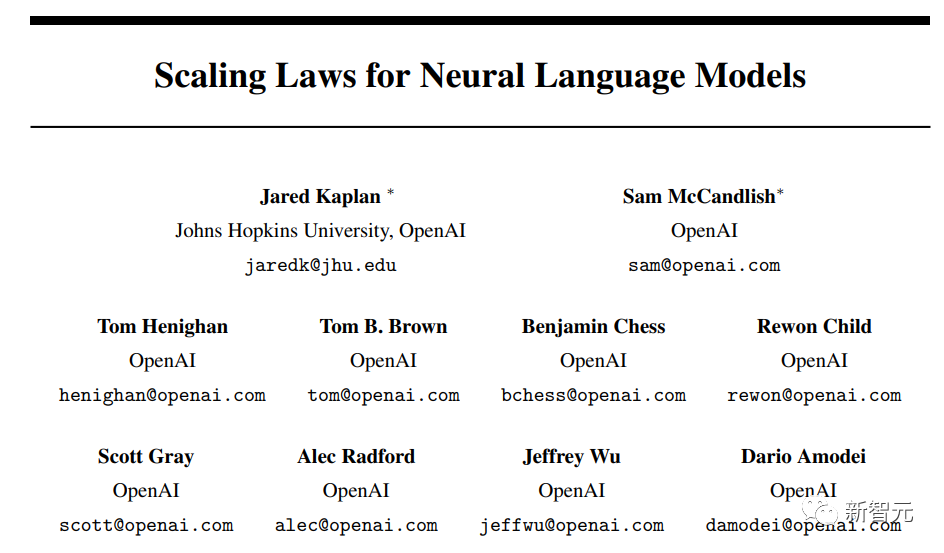

正如預(yù)期的那樣,OpenAI 研究人員在2020年進(jìn)行的一項分析發(fā)現(xiàn),隨著模型規(guī)模的擴(kuò)大,它們的準(zhǔn)確性和能力都有所提高。

論文鏈接:https://arxiv.org/pdf/2001.08361.pdf

隨著 GPT-3(擁有1750億參數(shù))和谷歌的 PaLM (可擴(kuò)展至5400億參數(shù))等模型的發(fā)布,用戶發(fā)現(xiàn)了越來越多的涌現(xiàn)能力。

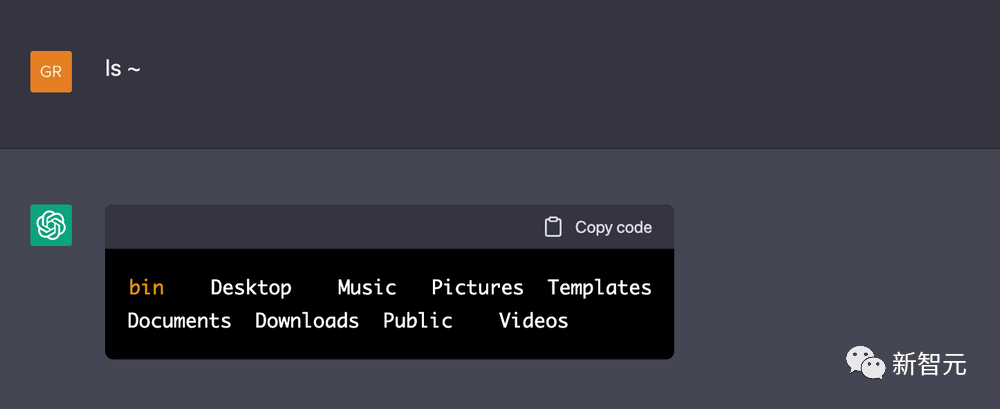

一位 DeepMind 的工程師甚至報告說,他可以讓 ChatGPT 認(rèn)為自己是一個 Linux 終端,并運(yùn)行一些簡單的數(shù)學(xué)代碼來計算前10個素數(shù)。值得注意的是,ChatGPT可以比在真正的 Linux 機(jī)器上運(yùn)行相同的代碼更快地完成任務(wù)。

與電影Emoji符號任務(wù)一樣,研究人員沒有理由認(rèn)為一個用于預(yù)測文本的語言模型可以模仿計算機(jī)終端,許多涌現(xiàn)行為都展現(xiàn)了語言模型的Zero-shot或Few-shot學(xué)習(xí)能力,即LLM可以解決以前從未見過或很少見過的問題的能力。

大批研究人員發(fā)現(xiàn)了 LLM 可以超越訓(xùn)練數(shù)據(jù)約束的跡象,他們正在努力更好地掌握涌現(xiàn)的樣子以及它是如何發(fā)生的,第一步就是完全地記錄下來。

超越模仿游戲

2020年,Dyer 和Google Research的其他人預(yù)測,LLM 將產(chǎn)生變革性影響,但這些影響具體是什么仍然是一個懸而未決的問題。

因此,他們要求各個研究團(tuán)隊提供困難且多樣化任務(wù)的例子以找到語言模型的能力邊界,這項工作也被稱為「超越模仿游戲的基準(zhǔn)」(BIG-bench,Beyond the Imitation Game Benchmark)項目,名字來源于阿蘭 · 圖靈提出的「模仿游戲」,即測試計算機(jī)是否能以令人信服的人性化方式回答問題,也叫做圖靈測試。

正如所預(yù)料的那樣,在某些任務(wù)上,隨著復(fù)雜性的增加,模型的性能平穩(wěn)且可預(yù)測地得到改善;而在其他任務(wù)中,擴(kuò)大參數(shù)的數(shù)量并沒有產(chǎn)生任何改善。

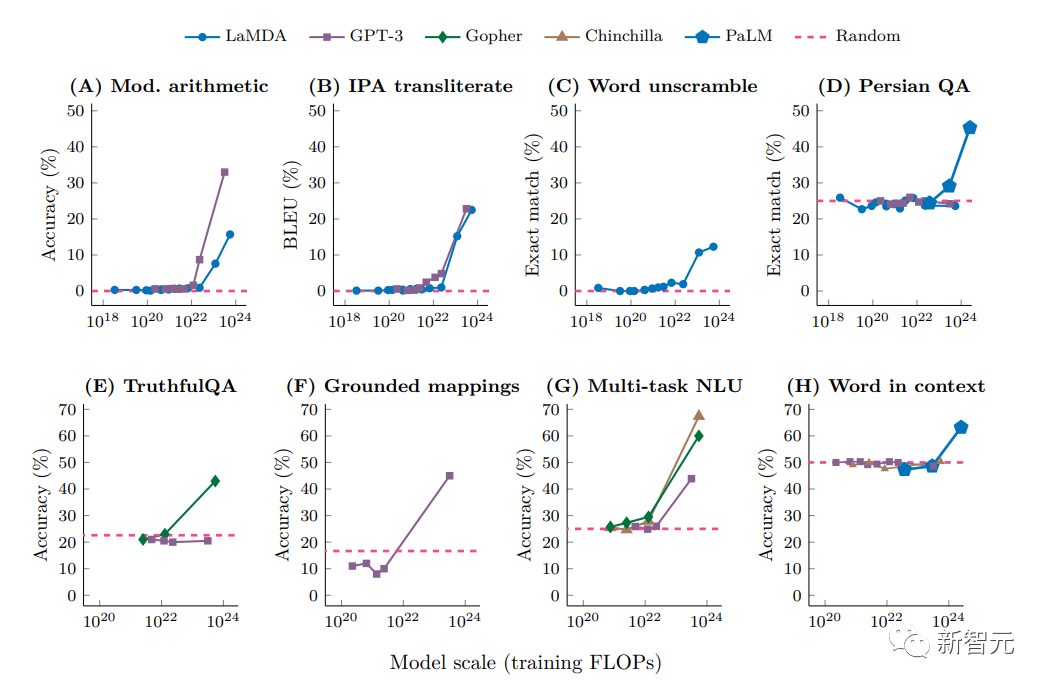

但是,在大約5% 的任務(wù)中,研究人員發(fā)現(xiàn)了所謂的「突破」(breakthroughs),即在一定閾值范圍內(nèi),性能出現(xiàn)了快速、戲劇性的躍升,該閾值隨任務(wù)和模型的不同而變化。

例如,參數(shù)相對較少(只有幾百萬)的模型不能成功地完成三位數(shù)加法或兩位數(shù)乘法的問題,但對于數(shù)百億個參數(shù),某些模型的精度會大幅提高。

其他任務(wù)也出現(xiàn)了類似的跳躍,包括解碼國際音標(biāo)、解讀單詞的字母、識別印度英語(印地語和英語的結(jié)合)段落中的冒犯性內(nèi)容,以及生成類似于斯瓦希里諺語的英語對等詞。

但是研究人員很快意識到模型的復(fù)雜性并不是唯一的驅(qū)動因素,如果數(shù)據(jù)質(zhì)量足夠高,一些意想不到的能力可以從參數(shù)較少的較小模型中獲得,或者在較小的數(shù)據(jù)集上訓(xùn)練,此外query的措辭也會影響模型回復(fù)的準(zhǔn)確性。

去年,在該領(lǐng)域的旗艦會議 NeurIPS 上發(fā)表的一篇論文中,Google Brain的研究人員展示了如何讓模型利用提示對自己進(jìn)行解釋(思維鏈推理),比如如何正確地解決math word問題,而同樣的模型如果沒有提示就不能正確地解決。

論文鏈接:https://neurips.cc/Conferences/2022/ScheduleMultitrack?event=54087

Google Brain的科學(xué)家Yi Tay致力于系統(tǒng)研究breakthroughs,他指出,最近的研究表明,思維鏈的提示改變了模型的規(guī)模曲線,也改變了涌現(xiàn)的點(diǎn),使用思維鏈?zhǔn)教崾究梢砸l(fā) BIG 實(shí)驗中沒有發(fā)現(xiàn)的涌現(xiàn)行為。

布朗大學(xué)研究語言計算模型的計算機(jī)科學(xué)家Ellie Pavlick認(rèn)為,最近的這些發(fā)現(xiàn)至少提出了兩種可能性:

第一個是,正如與生物系統(tǒng)相比較所顯示的那樣,較大的模型確實(shí)會自發(fā)地獲得新的能力,這很可能是因為這個模型從根本上學(xué)到了一些新的和不同的東西,而這些東西在小尺寸模型中沒有的,而這正是我們所希望的情況,當(dāng)模型擴(kuò)大規(guī)模時,會發(fā)生一些根本性的轉(zhuǎn)變。

另一種不那么聳人聽聞的可能性是,看似突破性的事件可能是一個內(nèi)部的、由統(tǒng)計數(shù)據(jù)驅(qū)動的、通過思維鏈?zhǔn)酵评磉\(yùn)作的過程,大型 LLM 可能只是學(xué)習(xí)啟發(fā)式算法,對于那些參數(shù)較少或者數(shù)據(jù)質(zhì)量較低的參數(shù)來說,啟發(fā)式算法是無法實(shí)現(xiàn)的。

但是她認(rèn)為,找出這些解釋中哪一個更有可能依賴于能夠理解 LLM 是如何運(yùn)行的,因為我們不知道它們在引擎蓋下是如何工作的,所以我們不能說這些猜測中哪些更合理。

隱藏在未知力量下的陷阱

谷歌在二月份發(fā)布了類ChatGPT產(chǎn)品Bard,不過在演示中卻暴露出了一個事實(shí)性錯誤,這也帶來了一個啟示,雖然越來越多的研究人員開始依賴這些語言模型來做基本的工作,但是并不能相信這些模型的輸出結(jié)果,需要人來進(jìn)一步檢查他們的工作。

涌現(xiàn)導(dǎo)致了不可預(yù)測性,而不可預(yù)測性也隨規(guī)模的擴(kuò)大而增加,使研究人員難以預(yù)測廣泛使用的后果。

想要研究涌現(xiàn)現(xiàn)象,那你必須先在頭腦中有一個案例,在研究規(guī)模的影響之前,你無法知道可能會出現(xiàn)什么能力或局限性。

某些有害行為也會在某些模型中涌現(xiàn),最近對 LLM 的分析結(jié)果表明,社會偏見的涌現(xiàn)往往伴隨著大量的參數(shù),也就是說大型模型會突然變得更有偏見,如果不能解決這一風(fēng)險,就可能危及這些模型的研究對象。