目標檢測標注的時代已經過去了?

在快速發展的機器學習領域,有一個方面一直保持不變:繁瑣和耗時的數據標注任務。無論是用于圖像分類、目標檢測還是語義分割,長期以來人工標記的數據集一直是監督學習的基礎。

然而,由于一個創新性的工具 AutoDistill,這種情況可能很快會發生改變。

Github代碼鏈接如下:https://github.com/autodistill/autodistill?source=post_page。

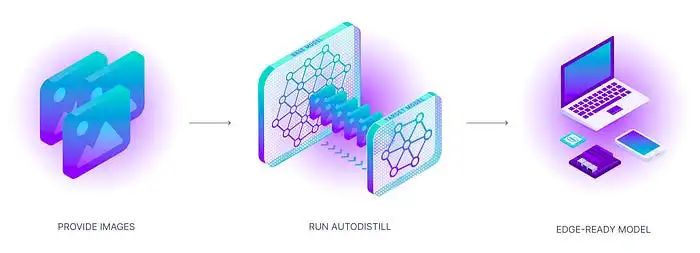

AutoDistill 是一個具有開創性的開源項目,旨在徹底改變監督學習的過程。該工具利用大型、較慢的基礎模型來訓練較小、更快的監督模型,使用戶能夠從未標記的圖像直接轉到在邊緣運行的自定義模型上進行推斷,無需人工干預。

AutoDistill 如何工作?

使用 AutoDistill 的過程就像它的功能一樣簡單而強大。首先將未標記的數據輸入基礎模型。然后,基礎模型使用本體來為數據集進行標注,以訓練目標模型。輸出結果是一個蒸餾模型,用于執行特定任務。

讓我們來解釋一下這些組件:

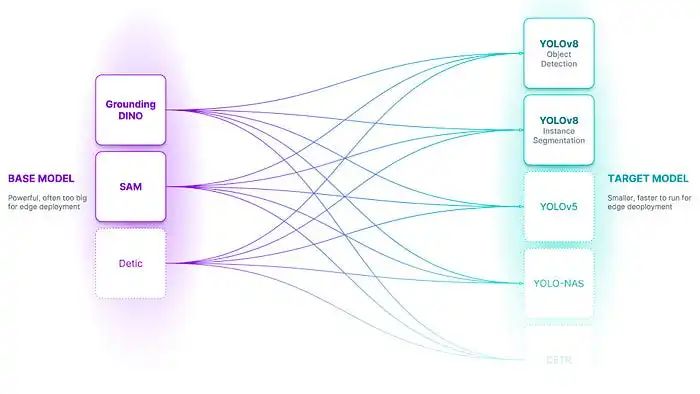

- 基礎模型:基礎模型是一個大型的基礎模型,比如 Grounding DINO。這些模型通常是多模式的,可以執行許多任務,盡管它們通常又大又慢,而且昂貴。

- 本體:本體定義了如何提示基礎模型、描述數據集的內容以及目標模型將預測什么。

- 數據集:這是一組可以用來訓練目標模型的自動標記數據。數據集是由基礎模型使用未標記的輸入數據和本體生成的。

- 目標模型:目標模型是一個監督模型,用于消耗數據集并輸出一個用于部署的蒸餾模型。目標模型的示例可能包括 YOLO、DETR 等。

- 蒸餾模型:這是 AutoDistill 過程的最終輸出。它是為您的任務進行了微調的一組權重,可以用于獲取預測。

AutoDistill 的易用性確實令人注目:將未標記的輸入數據傳遞給基礎模型,比如 Grounding DINO,然后使用本體來標記數據集以訓練目標模型,最終得到一個經過加速蒸餾并微調為特定任務的模型。

您可以觀看視頻,以了解這個過程的實際操作:https://youtu.be/gKTYMfwPo4M

AutoDistill 的影響

標注需要大量人工勞動一直是廣泛采用計算機視覺的主要障礙之一。AutoDistill 邁出了克服這一障礙的重要一步。該工具的基礎模型可以自主創建許多常見用例的數據集,通過創造性提示和少樣本學習,還有擴展其實用性的潛力。

然而,盡管這些進步令人印象深刻,但并不意味著不再需要標記的數據。隨著基礎模型的不斷改進,它們將越來越能夠在標注過程中替代或補充人類。但目前,在某種程度上,人工標注仍然是必要的。

目標檢測的未來

隨著研究人員不斷提高目標檢測算法的準確性和效率,我們預計將看到它們應用于更廣泛的實際應用領域。例如,實時目標檢測是一個關鍵的研究領域,對于自動駕駛、監控系統和體育分析等領域有著眾多應用。

另一個具有挑戰性的研究領域是視頻中的目標檢測,它涉及在多個幀之間跟蹤對象并處理動態模糊。在這些領域的發展將為目標檢測打開新的可能性,并進一步展示了 AutoDistill 等工具的潛力。

結論

AutoDistill 代表了機器學習領域的一項令人興奮的發展。通過使用基礎模型來訓練監督模型,該工具為未來鋪平了道路,數據標注這一繁瑣任務在開發和部署機器學習模型中將不再是一個瓶頸。