對比Elasticsearch,使用Doris進行高效日志分析

作為公司數據資產的重要組成部分,日志在系統的可觀察性、網絡安全和數據分析方面扮演著關鍵角色。日志記錄是故障排除的首選工具,也是提升系統安全性的重要參考。日志還是一個寶貴的數據源,通過對其進行分析,可以獲取指導業務增長的有價值信息。

日志是計算機系統中事件的順序記錄。一個理想的日志分析系統應該是:

- 具備無模式支持。 原始日志是非結構化的自由文本,基本無法直接進行聚合和計算,因此,在將日志用于數據庫或數據倉庫進行分析之前,需要將其轉化為結構化的表格形式(這個過程稱為“ETL”)。如果發生日志模式更改,需要在ETL流程和結構化表中進行一系列復雜的調整。為了應對此情況,可以使用半結構化日志,主要采用JSON格式進行記錄。在這種格式的日志中,可以相對容易地添加或刪除字段,而日志存儲系統會相應地調整其模式。

- 低成本。 日志數據龐大且持續不斷生成。一個相當大的公司每年會產生10~100 TB的日志數據。基于業務或合規要求,應該保留半年或更長時間的日志。這意味著需要存儲以PB為單位的日志大小,成本相當可觀。

- 具備實時處理能力。 日志應該實時寫入,否則工程師將無法及時捕捉故障排查和安全追蹤中的最新事件。此外,良好的日志系統應該提供全文搜索功能,并能快速響應交互式查詢。

1 基于Elasticsearch的日志分析解決方案

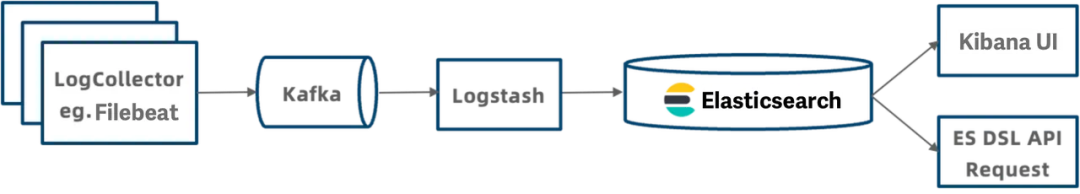

數據行業內常用的日志處理解決方案是ELK技術棧:Elasticsearch、Logstash和Kibana。該流程可分為五個模塊:

- 日志收集:Filebeat收集本地日志文件并將其寫入Kafka消息隊列。

- 日志傳輸:Kafka消息隊列收集和緩存日志。

- 日志轉換:Logstash過濾和轉換Kafka中的日志數據。

- 日志存儲:Logstash以JSON格式將日志寫入Elasticsearch進行存儲。

- 日志查詢:用戶通過Kibana可視化搜索日志或通過Elasticsearch DSL API發送查詢請求。

圖片

圖片

ELK堆棧具有優秀的實時處理能力,但也存在一些問題。

1.1 缺乏無模式支持

Elasticsearch中的索引映射定義了表的結構,包括字段名稱、數據類型以及是否啟用索引創建。

圖片

圖片

Elasticsearch還擁有自動根據輸入的JSON數據添加字段到映射的動態映射機制。這提供了某種程度的無模式支持,但這還不夠,因為:

- 動態映射在處理臟數據時經常會創建過多的字段,從而中斷整個系統的運行。

- 字段的數據類型是不可變的。為了確保兼容性,用戶通常將數據類型配置為"文本",但這會導致比二進制數據類型(如整數)慢得多的查詢性能。

- 字段的索引也是不可變的。用戶無法為特定字段添加或刪除索引,因此經常為所有字段創建索引,以便在查詢中方便地進行數據過濾。但是太多的索引需要額外的存儲空間,并減慢數據攝入速度。

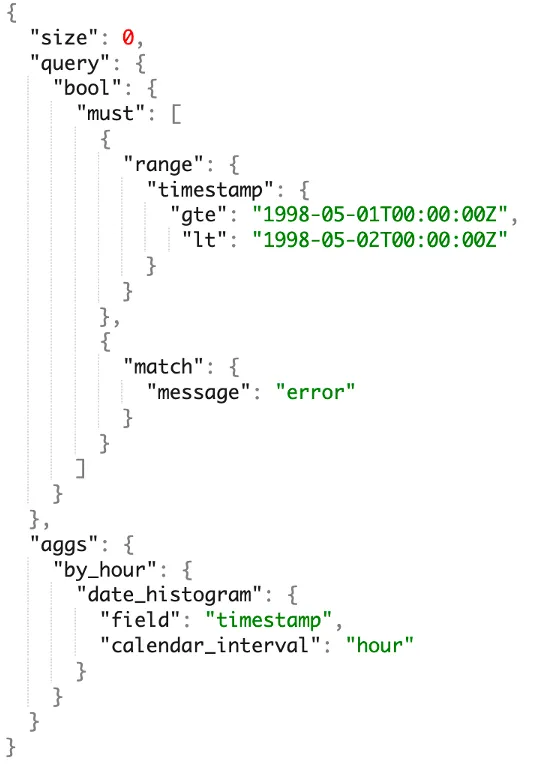

1.2 分析能力不足

Elasticsearch擁有獨特的領域特定語言(DSL),與大多數數據工程師和分析師熟悉的技術棧非常不同,所以存在陡峭的學習曲線。此外,Elasticsearch相對封閉的生態系統,在與BI工具集成方面會遇到一些阻力。最重要的是,Elasticsearch僅支持單表分析,滯后于現代OLAP對多表連接、子查詢和視圖的需求。

圖片

圖片

1.3 高成本和低穩定性

Elasticsearch用戶一直在抱怨計算和存儲成本。根本原因在于Elasticsearch的工作方式。

- 計算成本:在數據寫入過程中,Elasticsearch還執行計算密集型操作,包括倒排索引的創建、分詞和倒排索引的排序。在這些情況下,數據以每個核心約2MB/s的速度寫入Elasticsearch。當CPU資源緊張時,數據寫入需求往往會在高峰時段被拒絕,進一步導致更高的延遲。

- 存儲成本:為了加快檢索速度,Elasticsearch存儲原始數據的正排索引、倒排索引和文檔值,消耗了更多的存儲空間。單個數據副本的壓縮比僅為1.5:1,而大多數日志解決方案的壓縮比為5:1。

隨著數據量和集群規模的增長,保持穩定性會成為另一個問題:

- 在數據寫入高峰期:集群在數據寫入高峰期容易超載。

- 在查詢期間:由于所有查詢都在內存中處理,大型查詢很容易導致JVM OOM(內存溢出)。

- 恢復緩慢:對于集群故障,Elasticsearch需要重新加載索引,這對資源消耗很大,因此恢復過程可能需要幾分鐘。這對于服務可用性的保證是一個挑戰。

2 更具成本效益的方案

在反思基于Elasticsearch的解決方案的優點和局限性后,Apache Doris開發人員對Apache Doris進行了日志處理的優化。

- 增加寫入吞吐量: Elasticsearch的性能受到數據解析和倒排索引創建的限制,因此改進了Apache Doris在這些方面的性能:通過SIMD指令和CPU向量指令加快了數據解析和索引創建的速度;然后移除了在日志分析場景中不必要的數據結構,例如正排索引,以簡化索引創建過程。

- 減少存儲成本: 移除了正排索引,這部分數據占據了索引數據的30%。采用了列式存儲和ZSTD壓縮算法,從而實現了5:1到10:1的壓縮比。考慮到大部分歷史日志很少被訪問,引入了分層存儲來分離熱數據和冷數據。超過指定時間段的日志將被移動到存儲成本更低的對象存儲中。這可以將存儲成本降低約70%。

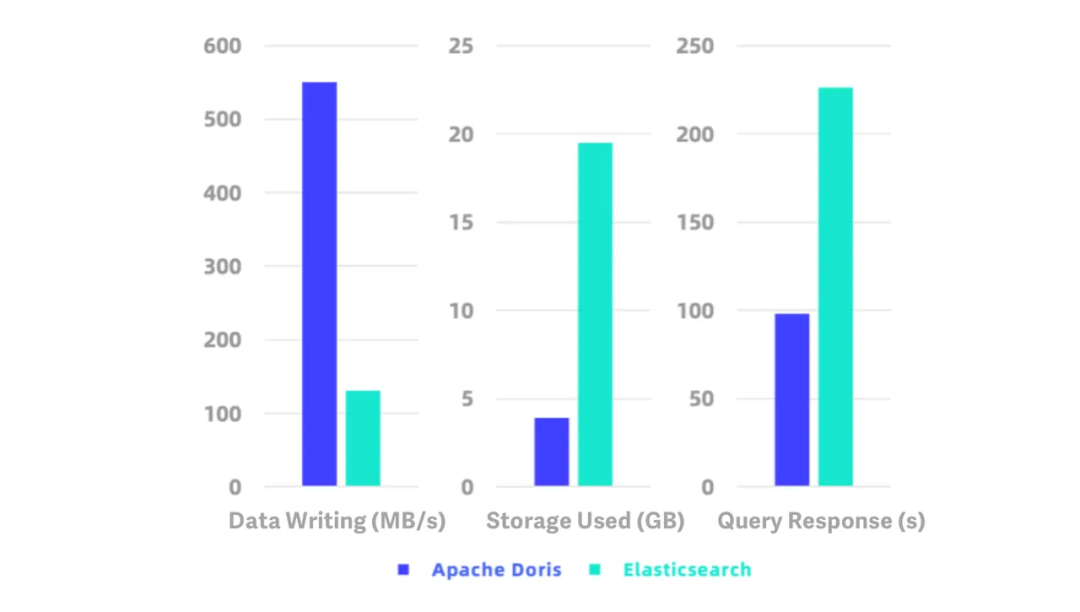

Elasticsearch的官方測試工具ES Rally進行的基準測試顯示,Apache Doris在數據寫入方面比Elasticsearch快約5倍,在查詢方面快約2.3倍,并且僅消耗Elasticsearch使用存儲空間的1/5。在HTTP日志的測試數據集上,它實現了550 MB/s的寫入速度和10:1的壓縮比。

圖片

圖片

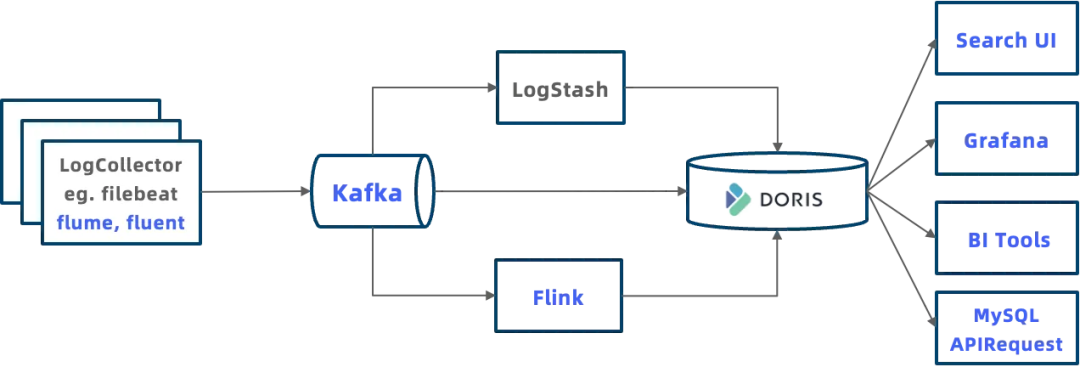

下圖顯示了一個典型的基于Doris的日志處理系統的樣貌。它更加全面,從數據攝取、分析到應用,都可以更靈活地使用:

- 數據導入:Apache Doris支持多種日志數據的攝入方式。可以通過使用Logstash的HTTP輸出將日志推送到Doris,可以在將日志寫入Doris之前使用Flink預處理日志,或者可以通過常規加載和S3加載從Flink或對象存儲中加載日志到Doris中。

- 數據分析:可以把日志數據放入Doris,并在數據倉庫中進行跨日志和其他數據的聯接查詢。

- 應用:Apache Doris兼容MySQL協議,因此可以把各種數據分析工具和客戶端集成到Doris中,例如Grafana和Tableau。還可以通過JDBC和ODBC API將應用程序連接到Doris。這里計劃構建一個類似于Kibana的系統來可視化日志。

圖片

圖片

此外,Apache Doris具有更好的無模式支持和更用戶友好的分析引擎。

2.1 原生支持半結構化數據

首先,在數據類型上進行優化。通過矢量化優化了字符串搜索和正則表達式匹配的文本性能,性能提升了2~10倍。對于JSON字符串,Apache Doris將其解析并存儲為更緊湊和高效的二進制格式,可以加快查詢速度4倍。還為復雜數據添加了一種新的數據類型:Array Map。它可以將連接的字符串進行結構化,以實現更高的壓縮率和更快的查詢速度。

其次,Apache Doris支持模式演化。這意味著可以根據業務變化調整模式。可以添加或刪除字段和索引,并更改字段的數據類型。

Apache Doris提供了輕量級的模式更改功能,因此開發人員可以在幾毫秒內添加或刪除字段:

-- 添加列。結果會在毫秒級返回。

ALTER TABLE lineitem ADD COLUMN l_new_column INT;還可以僅為目標字段添加索引,以避免不必要的索引創建帶來的開銷。在添加索引后,默認情況下,系統將為所有增量數據生成索引,并且可以指定需要索引的歷史數據分區。

-- 添加倒排索引。Doris會為以后的所有新數據生成倒排索引。

ALTER TABLE table_name ADD INDEX index_name(column_name) USING INVERTED;

-- 為指定的歷史數據分區構建索引。

BUILD INDEX index_name ON table_name PARTITIONS(partition_name1, partition_name2);2.2 基于SQL的分析引擎

基于SQL的分析引擎確保數據工程師和分析師能夠在短時間內輕松掌握Apache Doris,并將其在SQL方面的經驗應用到這個OLAP引擎中。借助SQL的豐富功能,用戶可以執行數據檢索、聚合、多表連接、子查詢、UDF、邏輯視圖和物化視圖,以滿足自身需求。

Apache Doris具備MySQL兼容性,可以與大數據生態系統中的大多數GUI和BI工具集成,使用戶能夠實現更復雜和多樣化的數據分析。

3 使用案例中的性能表現

一家游戲公司已經從ELK技術棧轉向了Apache Doris解決方案。他們基于Doris的日志系統所需的存儲空間只有之前的1/6。

一家網絡安全公司利用Apache Doris中的倒排索引構建了他們的日志分析系統,支持每秒寫入30萬行數據,僅使用以前所需的1/5服務器資源。

4 實踐指南

現在按照以下三個步驟來構建一個基于Apache Doris的日志分析系統。

在開始之前,從官方網站下載Apache Doris 2.0或更新版本,并部署集群。

4.1 步驟1:創建表格

這是一個表格創建的示例。

對配置的解釋:

- 將DATETIMEV2時間字段指定為鍵,以加快對最新N條日志記錄的查詢速度。

- 為頻繁訪問的字段創建索引,并使用解析器參數指定需要進行全文搜索的字段。

- "PARTITION BY RANGE"意味著根據時間字段將數據按范圍進行分區,啟用動態分區以進行自動管理。

- "DISTRIBUTED BY RANDOM BUCKETS AUTO"意味著將數據隨機分布到桶中,系統會根據集群大小和數據量自動決定桶的數量。

- "log_policy_1day"和"log_s3"意味著將超過1天的日志移動到S3存儲。

CREATE DATABASE log_db;

USE log_db;

CREATE RESOURCE "log_s3"

PROPERTIES

(

"type" = "s3",

"s3.endpoint" = "your_endpoint_url",

"s3.region" = "your_region",

"s3.bucket" = "your_bucket",

"s3.root.path" = "your_path",

"s3.access_key" = "your_ak",

"s3.secret_key" = "your_sk"

);

CREATE STORAGE POLICY log_policy_1day

PROPERTIES(

"storage_resource" = "log_s3",

"cooldown_ttl" = "86400"

);

CREATE TABLE log_table

(

``ts` DATETIMEV2,

``clientip` VARCHAR(20),

``request` TEXT,

``status` INT,

``size` INT,

INDEX idx_size (`size`) USING INVERTED,

INDEX idx_status (`status`) USING INVERTED,

INDEX idx_clientip (`clientip`) USING INVERTED,

INDEX idx_request (`request`) USING INVERTED PROPERTIES("parser" = "english")

)

ENGINE = OLAP

DUPLICATE KEY(`ts`)

PARTITION BY RANGE(`ts`) ()

DISTRIBUTED BY RANDOM BUCKETS AUTO

PROPERTIES (

"replication_num" = "1",

"storage_policy" = "log_policy_1day",

"deprecated_dynamic_schema" = "true",

"dynamic_partition.enable" = "true",

"dynamic_partition.time_unit" = "DAY",

"dynamic_partition.start" = "-3",

"dynamic_partition.end" = "7",

"dynamic_partition.prefix" = "p",

"dynamic_partition.buckets" = "AUTO",

"dynamic_partition.replication_num" = "1"

);4.2 步驟2:導入日志

Apache Doris支持多種數據導入方法。對于實時日志,推薦以下三種方法:

- 從Kafka消息隊列中拉取日志:Routine Load

- Logstash:通過HTTP API將日志寫入Doris

- 自定義編寫程序:通過HTTP API將日志寫入Doris

使用Kafka進行數據攝取

對于寫入Kafka消息隊列的JSON日志,創建常規加載(Routine Load),以便Doris從Kafka中拉取數據。以下是示例。property.* 配置為可選配置:

-- 準備Kafka集群和主題("log_topic")

-- 創建常規加載,從Kafka的 log_topic 加載數據到 "log_table"

CREATE ROUTINE LOAD load_log_kafka ON log_db.log_table

COLUMNS(ts, clientip, request, status, size)

PROPERTIES (

"max_batch_interval" = "10",

"max_batch_rows" = "1000000",

"max_batch_size" = "109715200",

"strict_mode" = "false",

"format" = "json"

)

FROM KAFKA (

"kafka_broker_list" = "host:port",

"kafka_topic" = "log_topic",

"property.group.id" = "your_group_id",

"property.security.protocol"="SASL_PLAINTEXT",

"property.sasl.mechanism"="GSSAPI",

"property.sasl.kerberos.service.name"="kafka",

"property.sasl.kerberos.keytab"="/path/to/xxx.keytab",

"property.sasl.kerberos.principal"="xxx@yyy.com"

);可以通過SHOW ROUTINE LOAD命令查看常規加載的運行情況。

通過Logstash進行數據導入

配置Logstash的HTTP輸出,然后通過HTTP Stream Load將數據發送到Doris。

1) 在logstash.yml中指定批量大小和批量延遲,以提高數據寫入性能。

pipeline.batch.size: 100000

pipeline.batch.delay: 100002) 在日志收集配置文件testlog.conf中添加HTTP輸出,URL為Doris中的Stream Load地址。

- 由于Logstash不支持HTTP重定向,應該使用后端地址而不是FE地址。

- 頭部中的授權是

http basic auth,使用echo -n 'username:password' | base64進行計算。 - 頭部中的

load_to_single_tablet可以減少數據攝取中的小文件數量。

output {

http {

follow_redirects => true

keepalive => false

http_method => "put"

url => "http://172.21.0.5:8640/api/logdb/logtable/_stream_load"

headers => [

"format", "json",

"strip_outer_array", "true",

"load_to_single_tablet", "true",

"Authorization", "Basic cm9vdDo=",

"Expect", "100-continue"

]

format => "json_batch"

}

}通過自定義程序進行數據攝取

以下是通過HTTP Stream Load將數據攝取到Doris的示例。

注意:

- 使用basic auth進行HTTP授權,使用 echo -n 'username:password' | base64 進行計算。

- http header "format:json":指定數據類型為JSON。

- http header "read_json_by_line:true":每行都是一個JSON記錄。

- http header "load_to_single_tablet:true":每次寫入一個分片(tablet)。

- 對于數據寫入客戶端,建議批量大小為100MB~1GB。未來的版本將在服務器端啟用Group Commit,并減小客戶端的批量大小。

curl \

--location-trusted \

-u username:password \

-H "format:json" \

-H "read_json_by_line:true" \

-H "load_to_single_tablet:true" \

-T logfile.json \

http://fe_host:fe_http_port/api/log_db/log_table/_stream_load4.3 步驟3:執行查詢

Apache Doris支持標準SQL,因此可以通過MySQL客戶端或JDBC連接到Doris,然后執行SQL查詢。

mysql -h fe_host -P fe_mysql_port -u root -Dlog_db一些常見的日志分析查詢:

- 檢查最新的10條記錄。

SELECT * FROM log_table ORDER BY ts DESC LIMIT 10;- 檢查Client IP為"8.8.8.8"的最新的10條記錄。

SELECT * FROM log_table WHERE clientip = '8.8.8.8' ORDER BY ts DESC LIMIT 10;- 檢索在"request"字段中包含"error"或"404"的最新的10條記錄。MATCH_ANY是Doris中的通過全文搜索來查找包含指定關鍵詞中任意一個的記錄。

SELECT * FROM log_table WHERE request MATCH_ANY 'error 404' ORDER BY ts DESC LIMIT 10;- 檢索在"request"字段中同時包含"image"和"faq"的最新的10條記錄。MATCH_ALL也是Doris中的全文搜索語法關鍵詞,表示查找同時包含所有指定關鍵詞的記錄。

SELECT * FROM log_table WHERE request MATCH_ALL 'image faq' ORDER BY ts DESC LIMIT 10;5 總結

如果需要一種高效的日志分析解決方案,Apache Doris是非常友好的選擇,尤其適合那些具備SQL知識的讀者。相比ELK堆棧,使用Apache Doris可以獲得更好的無模式支持,實現更快的數據寫入和查詢,并且減少存儲負擔。