AI大模型安全治理化繁為簡的“道與術”

業界有云:“復雜性是安全性的敵人”。如今智能化領域中愈發搶眼的 AI 大模型,在計算機視覺、文字生成等應用場景,顯現出震撼人心的智能化水準前,都有著一段類似“破繭成蝶”的經歷。AI 大模型“黑箱”內部架構有高度復雜的神經網絡,以及需要源源不斷地投喂、輸入高質量語料。經過高密度信息訓練與推理后的 AI 大模型,內部復雜性可想而知。

延伸閱讀,點擊鏈接了解 Akamai API Security

如今, AI 大模型已成為智能化時代的核心基礎資產。在 AI 大模型本體基礎上的應用層面,也展現了百花齊放的創新形態。從更廣的維度看,多類別創新版圖之間,貫穿不同系統平臺的 API 鏈路,也使得 AI 大模型生態日漸復雜,展現在黑客眼前的攻擊暴露面,正在持續蔓延。

OWASP: 重點關注三大風險

經過多輪分析、挑選,OWASP 安全機構發布了 AI 大模型應用的十大風險:

從中可以全覽 AI 大模型的風險分布,為 AI 大模型的通用安全漏洞評測提供標準依據。

從利用外部數據源訓練、微調數據集的訓練數據階段,到基于大模型自動化代理為終端用戶構建核心應用服務,以及聯動多方插件布局大模型的下游服務,OWASP 重點提示的十大風險,遍布于整個 AI 大模型創新生態的全鏈路關鍵場景。

如果說 AI 大模型的語料訓練階段,還屬于智能化科創企業的“閉門造車”的內部研發階段,但步入了推理部署階段之后,即將蝶變的 AI 智能體大腦,一經發布就要呈現于全域數字化場景中。此時,窺伺大模型與相關數據資產的黑客,將會易于尋覓到更多攻擊切入點。

大模型+API: 風險指數隨之增加

鑒于業界成型的 AI 大模型訓練成本門檻高,API 接口與開源模型廣為應用。借助 API 的互聯性,大模型更易用,可跨平臺響應不同應用需求與商業化運營。保護好 API 的安全性,就是在一定程度上增強了 AI 大模型的外層防御力度。因而,我們需要把 API 與漏洞評估視為 AI 大模型的頭等大事。

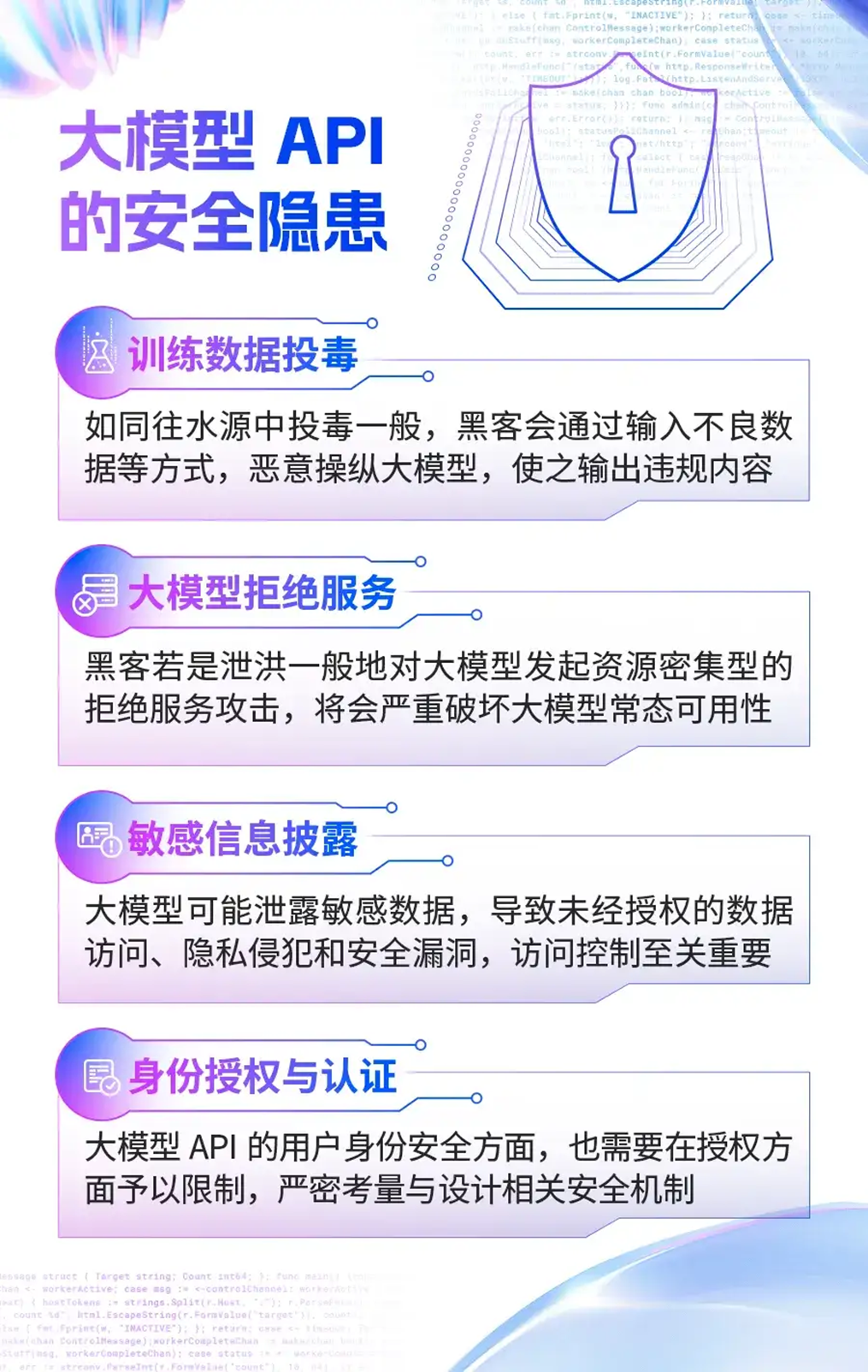

AI 大模型與上下游生態所組成的整個體系,API 接口如毛細血管一般,向不同位置的工作負載,輸送著多類別數據信息。結合 OWASP 安全機構總結的十大威脅來看,大模型 API 面臨著訓練數據投毒、大模型拒絕服務、敏感信息披露以及身份授權與認證等方面的安全隱患。

Akamai 云安全治理思路

深化加固重點攻防端口,有助于實現事半功倍的安全防護。無論是在傳統 IT 資產,還是在近年涌現的 AI 大模型等新興的智能化資產中,API 都關乎數據、關乎 IT 系統安全嚴密與否。Akamai 認為,做好 API 資產全生命周期管理,有助于全面檢測隱藏威脅,剔除黑客入侵路徑,規避 AI 大模型十大風險以及其它安全漏洞。

治理好 API 安全,即是保障數據流通的“管道”安全。而在數據安全方面,尤其是企業通過內部信息部署私有 AI 大模型時,也需注意培養員工對組織核心數據資產管理的安全意識,防范自身生產經營文件、員工隱私的意外泄露。

當下,多數 AI 大模型都部署于云端,所在云環境的安全性也十分關鍵。作為擁有多年安全基礎設施經驗積累的云服務商,Akamai 針對智能化時代的數據安全威脅,已構建有一套完全閉環的保護體系。目前,Akamai 通過多種路徑與具備 AI 能力的云安全產品,深度保護 AI 大模型、API 與數據等企業核心資產。

針對具有高度復雜性、黑箱性等特點的 AI 大模型安全治理,更需要開發大模型的 AI 先鋒企業建立全局視野,全生命周期端到端進行安全防御。當下,Akamai 內部云安全產品創新進程中,也在持續調研、分析可預防與緩解 AI 大模型風險的有效安全路徑,幫助 AI 科技等行業在安全運營等方面化繁為簡,全方位規避大模型數據泄露,專注解鎖 AI 增長點。

—————————————————————————————————————————————————

如您所在的企業也想要進一步保護API安全,

點擊鏈接了解Akamai Linode的解決方案