DeepSeek很火,我來潑點冷水

從2024年12月DeepSeek出圈以來,DeepSeek風潮越刮越勇,已有席卷全球之勢。各個大廠紛紛宣布自家接入DeepSeek,甚至有機頂盒企業也宣布自家產品接入了,市場情緒一度高漲。

在自媒體上,以DeepSeek為噱頭賣課的,教人如何使用DeepSeek提示詞的,或者利用DeepSeek+其他AI工具做自媒體賺快錢的,各種案例不勝枚舉。

各個技術群的聊天話題也集中于DeepSeek,好像不聊這個話題就要被開除技術籍。

DeepSeek很火爆,我也并非資深的人工智能領域從業人員,但我卻想潑一潑冷水。

首先思考一個問題:DeepSeek在功能和性能上,有遠超其他大模型產品的表現嗎?

答案很明顯,并沒有。DeepSeek官方于今年1月20日推出的DeepSeek R1版本,也只是在性能上對標Open AI o1正式版。

用DeepSeek官方的話來說:

“DeepSeek-R1 在后訓練階段大規模使用了強化學習技術,在僅有極少標注數據的情況下,極大提升了模型推理能力。在數學、代碼、自然語言推理等任務上,性能比肩 OpenAI o1 正式版。”

官方論文: https://github.com/deepseek-ai/DeepSeek-R1/blob/main/DeepSeek_R1.pdf

且這段時間大家應該都體驗過DeepSeek,使用體驗肯定很好,但其本身的工程能力(特指穩定性)卻無法匹配其功能和性能的表現。換句話說,DeepSeek更像一個在某方面極其突出的年輕少俠,而非全方位無死角的六邊形戰士。

OpenAI的o1是什么時候發布的呢?以下是從多個公開信息源找到的信息:

1、OpenAI于2024年9月12日首次發布了o1的預覽版(o1-preview)和輕量版(o1-mini)。這一版本主要面向ChatGPT Plus、Team用戶以及API開發者開放,特點是強化了推理能力,適用于科學、數學和編程等復雜任務。

2、完整版的o1(或稱“滿血版”)于2024年12月5日至6日在OpenAI的“12天12場直播”首日活動中正式推出。該版本進一步優化了性能,錯誤率降低34%,響應速度提升50%,并支持多模態輸入(文本+圖像)。

總結:DeepSeek R1的發布是后發先至,在數學、代碼、自然語言推理等任務上暫時取得了領先。

再來思考第二個問題:為什么DeepSeek會如此火爆,受到追捧?

按照業內的普遍共識,人工智能領域有三大底座(或者說三要素)是算力+模型+數據,也就是說只要你算力夠多,模型夠好,喂進去的數據量足夠大,就可以迭代出我們預期的AI產品。

在三大底座之上,喂數據是訓練過程,大規模應用是最終結果。在訓練和大規模應用之間,還存在這樣一個25年之前未被解決的問題,即:盈利模式。但DeepSeek的出現,帶來了新的契機。

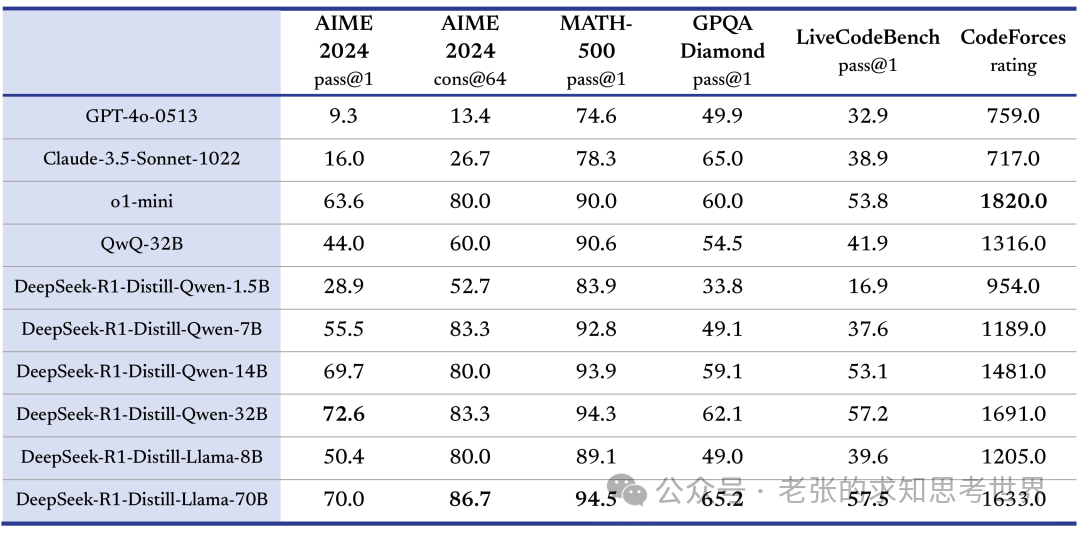

按照DeepSeek官方說法,他們在開源 DeepSeek-R1-Zero 和 DeepSeek-R1 兩個 660B 模型的同時,通過 DeepSeek-R1 的輸出,蒸餾了6個小模型開源給社區,其中 32B 和 70B 模型在多項能力上實現了對標 OpenAI o1-mini 的效果。

圖片

圖片

HuggingFace 鏈接: https://huggingface.co/deepseek-ai

這一消息目前已經被證實,且國內外各家科技企業巨頭的大模型都已開始接入DeepSeek,證明其成本相較于GPT-4確實有極大規模的下降。而成本的下降會帶來這兩點顯著的直接收益:降低訓練硬件需求,降低應用成本。

換句話說,降低訓練需求等于打破了高算力的壟斷門檻,降低應用成本意味著進入AI領域落地應用的門檻變低,會有更多的人有機會參與到探索應用落地的道路上。

從目前各種消息來看,模型降本已經指向了應用層的爆發,騰訊、阿里等大廠的走勢已經說明了一切。

可能以后生活中的每臺電子設備都會內置DeepSeek這種水平的大模型,而這也意味著AI+的爆款應用,大概率會在2025年橫空出世!

除此之外DeepSeek火出圈的另一個原因在于:前兩年各家公司的大模型逐漸同化,在數據層面沒有顯著差異的情況下,算力成為了唯一的決勝因素,而國產算力相比于英偉達,目前確實稍有不足。

DeepSeek的出現打破了過去兩年的唯算力論,也讓國內各大芯片廠商對追趕甚至超越“英偉達”重新燃起了希望。

這也是為什么前段時間,媒體報道說DeepSeek是“國運級”的產品。

回到本文的主題,即DeepSeek為什么會如此火爆?

一方面是人性使然導致的造神論,這點自古至今從未變過。另一方面,互聯網自媒體時代,媒體和社區會不斷助漲這種氛圍,甚至說難聽點,這是一種捧殺行為,嚴重點說實在扼殺整個中國的創新氛圍。

DeepSeek引起全球關注甚至詫異本身是件好事,但是這種整個產業界甚至全國性質的捧殺,我個人并不認同。

在大模型的方向、技術路線、資源投入各方面,每個公司都有差異。

比如有的公司堅持長期主義選擇dense模型,有的公司選擇擴展探索面在各種模態上都發展業務,至于像Deepseek押注moe,以及deepseek首先突破應用了預訓練fp8(之前有mla),也確實是一直走在一流團隊的前沿。

借用DeepSeek創始人梁文峰話來說:大部分中國公司習慣follow,而不是創新。中國AI和美國真實的gap是原創和模仿的差距。如果這個不改變,中國永遠只能是追隨者,所以有些探索是逃不掉的。英偉達的領先,不只是一個公司的努力,而是整個西方技術社區和產業共同努力的結果。創新首先是一個信念問題,OpenAI并不會一直領先。

同理,DeepSeek暫時領先也很難說會一直領先!

我很敬佩梁文峰先生的務實和專注風格,也很希望國內出現越來越多的像DeepSeek這樣的產品。很多的前沿創新都是基于務實和專注才會出現,希望大家能對當前對DeepSeek的造神保持警惕。

真正的科技創新型社會是百花齊放,百舸爭流。