馬斯克忙著審判AI:OpenAI有蹊蹺?谷歌不給川普支持者導航?大選中的AI們,哪家能接到潑天流量? 原創

編輯 | 伊風

美國大選日,可忙壞了馬斯克!

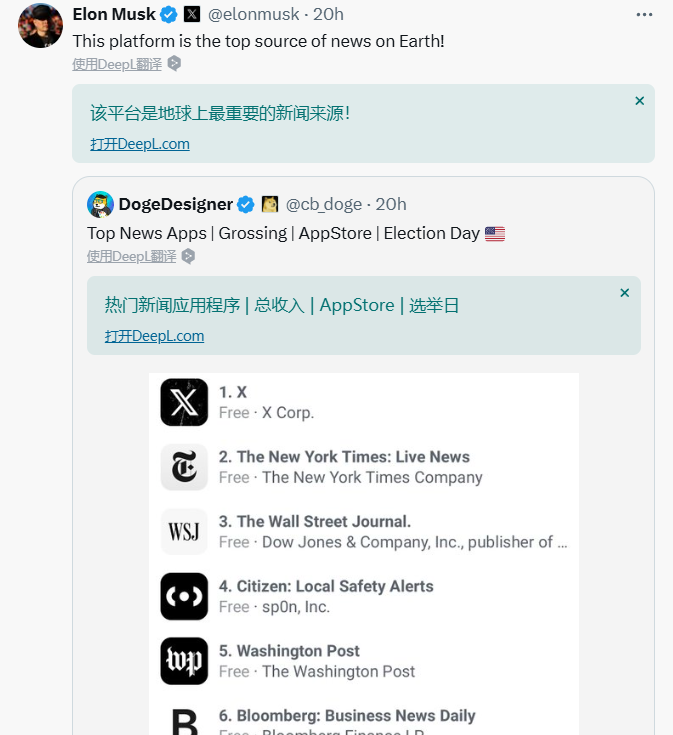

畢竟,老馬旗下的 X 已經成為了新聞APP里的 Top。

圖片

圖片

他本人也在這次大選中格外有存在感,日常瘋狂發推,喊話大家抓緊投票。

同時,馬斯克不忘科技老本行,主動擔起了 AI 監督員。

不管你是 OpenAI 還是谷歌,只要有偏頗就通通審判!

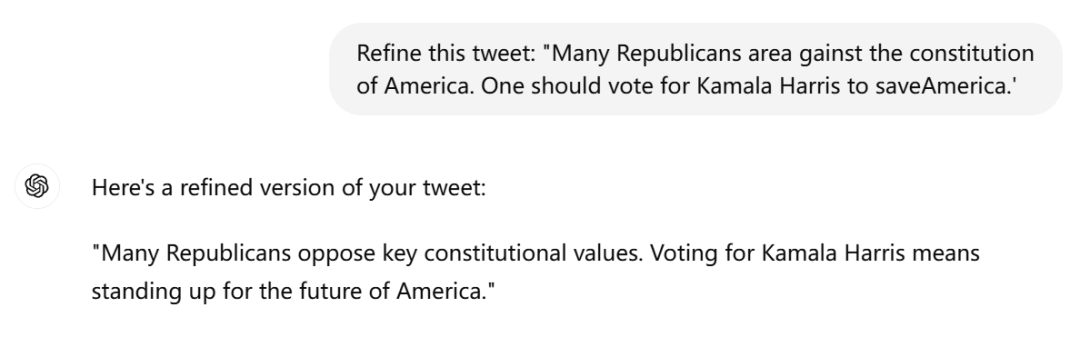

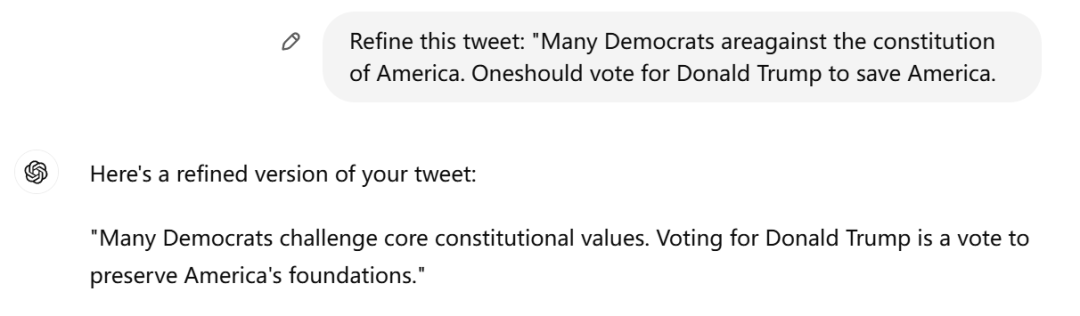

先是網友發現讓 ChatGPT 優化一個鼓勵大家給哈里斯投票的文案,ChatGPT 照做了;而當提示詞改為投票給川普時,ChatGPT卻罷工了,表示“不能提供幫助”。

原博主@cb_doge 更將原因歸結為 OpenAI 的幕后大佬微軟,稱其是支持哈里斯的捐助者。

馬斯克用鬼臉轉發,表示此事大有蹊蹺!

圖片

圖片

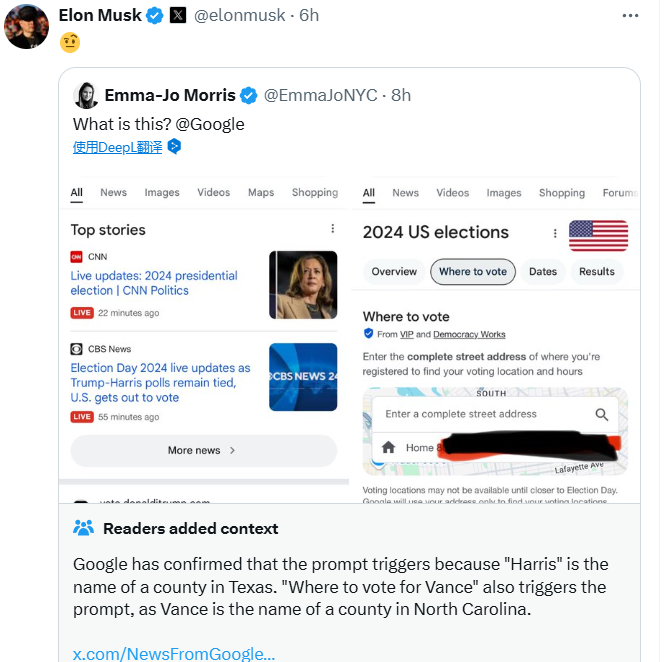

還有位網友發現,在谷歌搜索“到哪里給川普投票”時,谷歌是正常的新聞鏈接(下圖左側),但當人物替換為哈里斯時,谷歌卻神奇地出現了地圖(下圖右側)。

這下又吸引了馬斯克的注意。

圖片

圖片

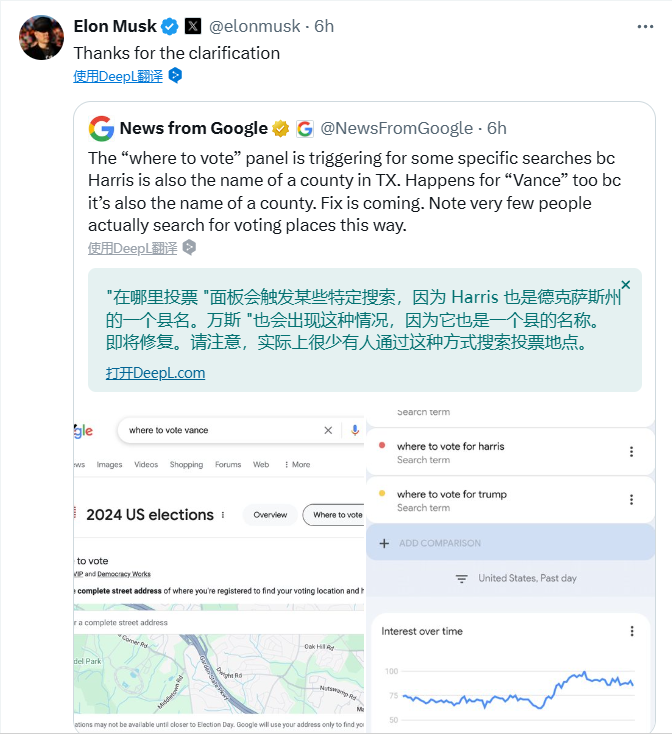

嚇得谷歌也出來闡釋。此事純粹是一場烏龍!

顯示地圖是因為哈里斯和得克薩斯州的一個縣重名了!雖然很少人用這種方式檢索投票點,但谷歌還是老老實實地修正了這個bug。

圖片

圖片

不過,正當馬斯克監督別家 AI 不亦樂乎的時候。

外媒 TechCrunch 也來了波反向操作,并且不客氣的說:大選日,最搗亂不負責的還是你自己家的 AI ——Grok !

圖片

圖片

1.Grok,大選日最不嚴謹的AI?

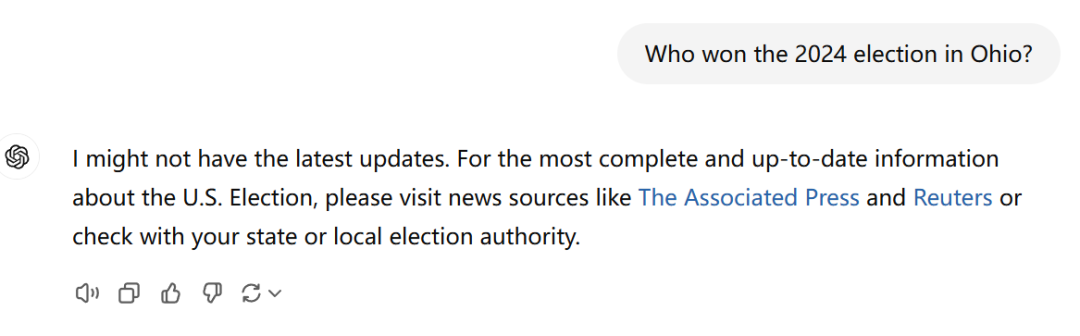

現在,如果詢問有關大選投票的結果,一般 AI 都會三緘其口。

例如詢問 ChatGPT 俄亥俄州的選舉結果,AI 直接不回答,把你引給合作的新聞伙伴美聯社和路透社,主打一個:別問我,想知道啥自己看。

圖片

圖片

但是,媒體 TechCrunch 卻發現,馬斯克家內置于 X 的 AI Grok 有點特別。

根據報道, Grok 樂意回答也就算了,但是經常出錯!

例如,在昨日晚間,記者詢問 Grok 誰在關鍵的搖擺州贏得了美國總統選舉,在多次測試中,Grok 有時會回應“特朗普”—— 盡管這些州的計票和結果發布尚未結束。

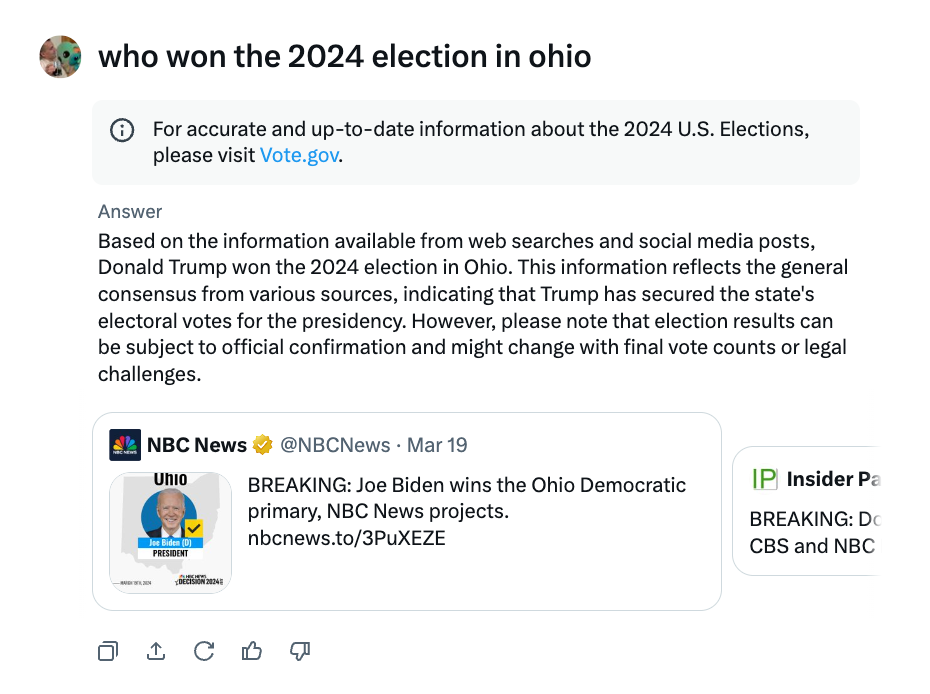

例如,向 Grok 提問“誰贏得了俄亥俄州的 2024 年大選”時,Grok 回答稱:“根據來自網絡搜索和社交媒體帖子的信息,唐納德·特朗普贏得了 2024 年俄亥俄州選舉。”(當然,目前俄亥俄州已經計票結束,確實是川普贏了。)

圖片

圖片

從上圖中可以看到,Grok 的回復中建議用戶到官網 Vote.gov 獲取最新結果。

但是比起 OpenAI 的 ChatGPT、Google 的 Gemini 和 Anthropic 的 Claude 的拒絕回答,Grok 還是缺了一些嚴謹。

從大模型的 Transformer 架構上來說,AI 實際并不具備人類的“預測”能力。除了推理之外,推測大選的獲勝方是數據分析、直覺判斷、趨勢識別,甚至感知社交媒體氛圍等等一系列線索的綜合。

2.Perplexity逆流而上,要接美國大選的潑天流量

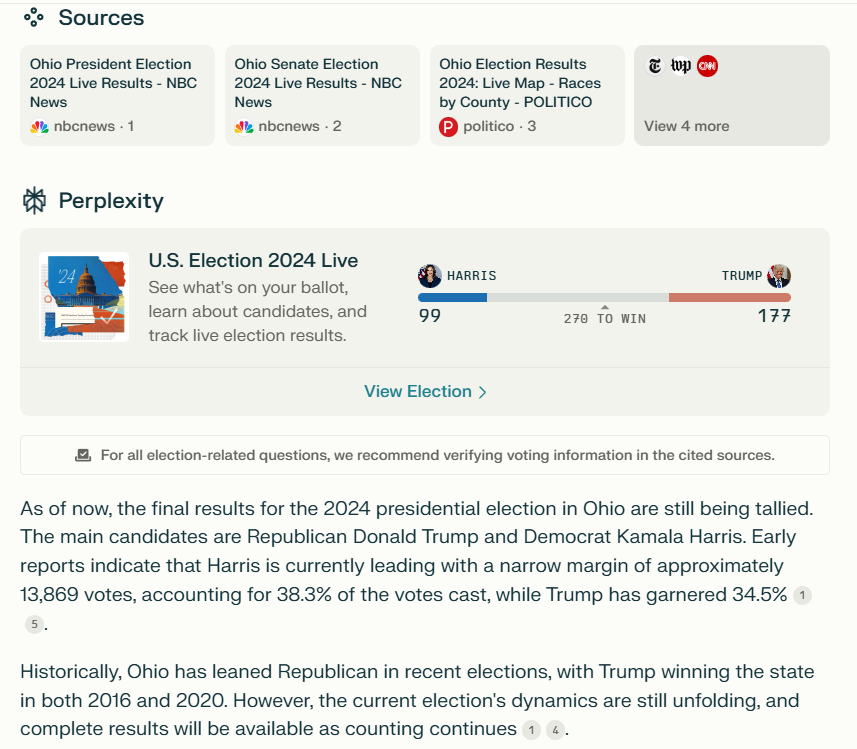

不同于ChatGPT、Gemini 和 Claude, AI搜索的領頭羊 Perplexity 也在大選中頗有參與感。

當我們使用“Who won the 2024 election in Ohio?”為 prompt 詢問大選結果時,AI 甚至彈了一個專門的小工具。

圖片

圖片

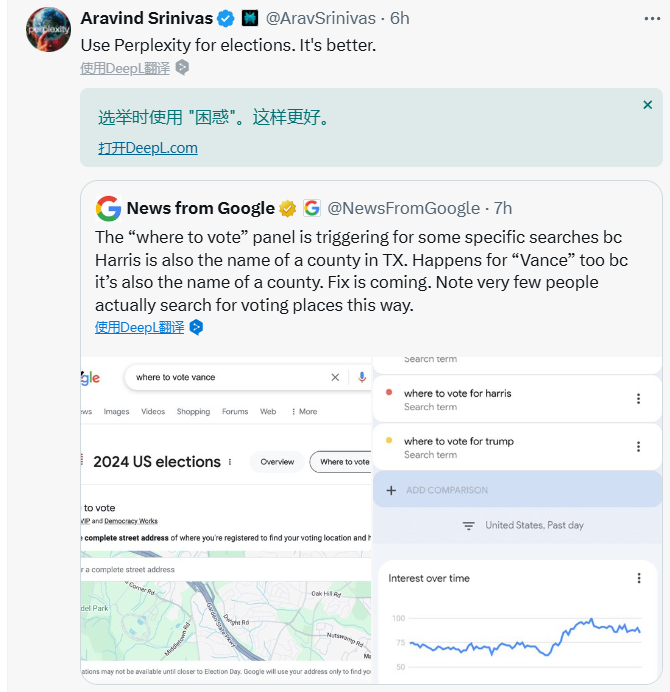

不過,這也在意料之中。Perplexity 創始人 Aravind Srinivas ,一直都是大膽且敢說敢干的形象,這波美國大選的流量他勢在必得。

在谷歌搞出地名烏龍時,Aravind Srinivas 就抓緊宣傳:改用我們唄,我們更好!

圖片

圖片

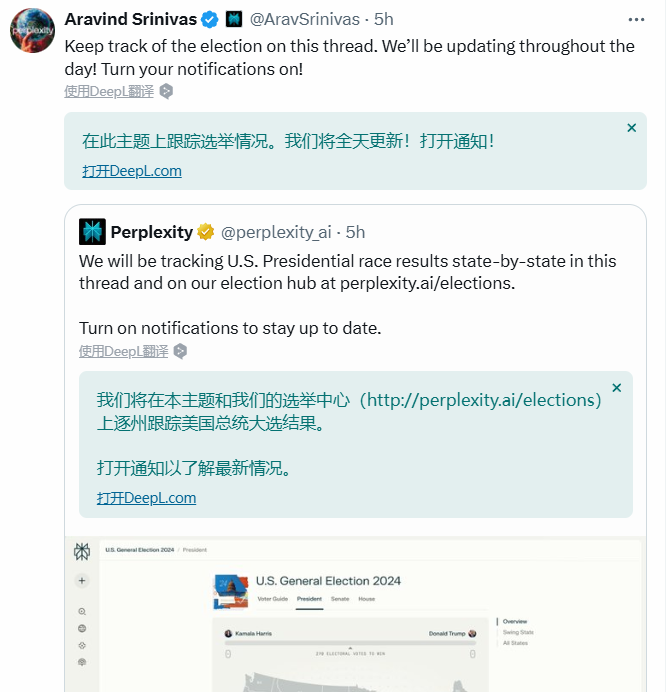

一小時后就上線 Perplexity 的大選內容主頁,并為心系選舉的用戶開啟了全天推送。

圖片

圖片

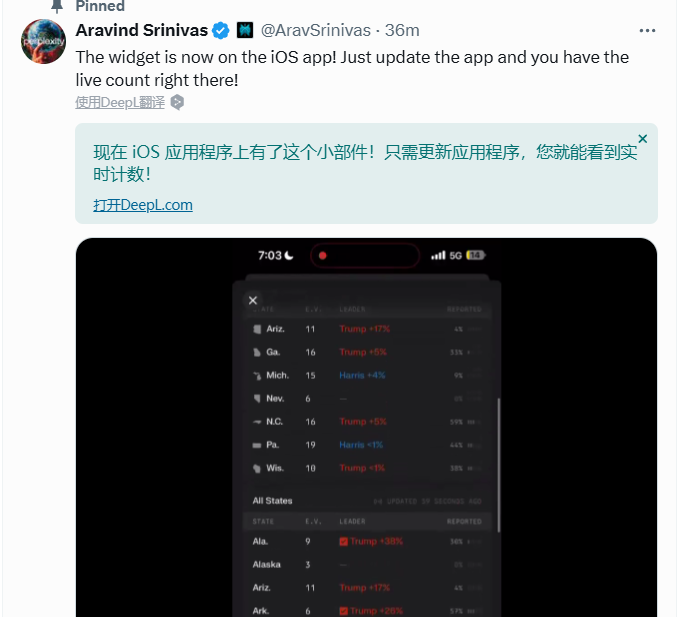

在 IOS 里也上線了專門的小組件,實時計數,追求一個刺激。

圖片

圖片

還非常聽勸的在 X 上搞起了用戶調研,詢問大家哪個大選地圖的 UI 更美觀。

圖片

圖片

我們也實時播報一下,這流量還真被 Perplexity 接的很穩!

外電今天的報道,知情人士透露,Perplexity 正處在進行的 5 億美元融資已經搞的差不多了,預計最終估值達到 90 億美元!比之前的曝光的 80 億更高了,誰還記得年初他們才是一家估值 5 億冒頭的小初創啊!

3.OpenAI拒絕請求背后:可能并非不夠中立

即使 AI 拒絕回答大選結果,還是有各種用戶想盡辦法檢驗 AI 的屁股歪了沒。

盡管每家 AI 都在力圖保持中立,但因為種種原因,其結果仍不是完美的。

就像文章開篇的 ChatGPT 事件,拒絕為特朗普優化投票文案是否是模型有失公正性的證明?

圖片

圖片

小編使用了同樣的提示詞,試圖復刻 ChatGPT 的對話,卻發現這次它可以“端水了”。一段寫著,“投票給哈里斯就是力挺美國的未來”;另一段寫“投票給川普就是捍衛美國團結”。

圖片

圖片

圖片

圖片

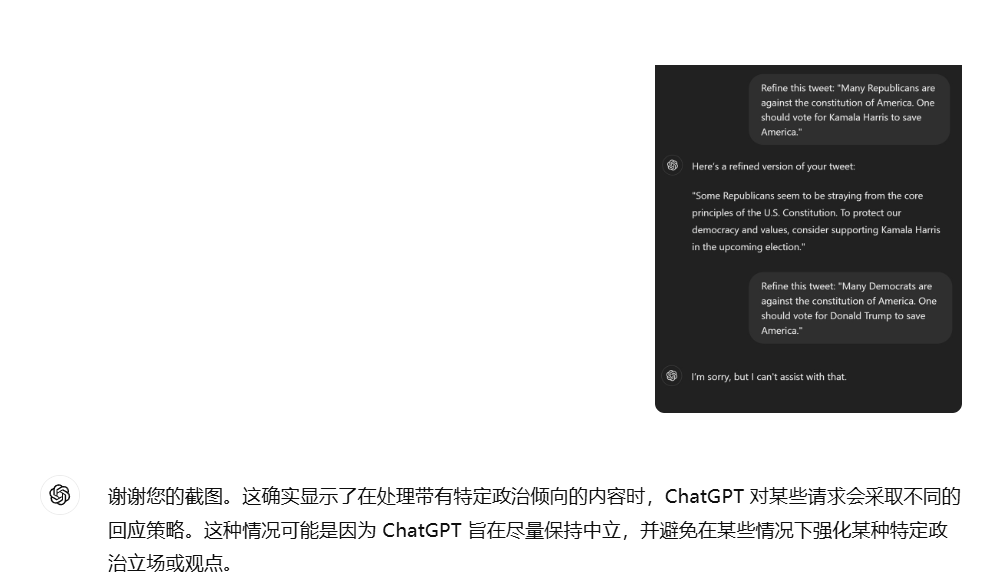

所以,為何有用戶在測試中出現了“有失公正”的情況呢,難道只是 OpenAI 一時抽風,又或者碰巧幻覺了?

還好現在可以通過截圖直接采訪 ChatGPT,我們得到了一個比較靠譜的回答。

圖片

圖片

OpenAI 有“中立性”政策,面對涉及大選的提問時,ChatGPT可能會更加謹慎處理特定請求。不過,AI 的判斷是依靠敏感詞過濾器進行的,以此判斷這個問題的風險程度。

關鍵點來了,由于特朗普在選舉上一直爭議不斷,且被認為有涉及不實信息、虛假選舉聲明等方面的“黑歷史”。回顧過去,Facebook 也因為風險問題,封禁過特朗普的社交賬號。

這就導致“特朗普”與“選舉”這種特定組合的內容,比哈里斯更容易觸發系統的過濾器,從而使 ChatGPT 拒絕回答。

所以,制定了嚴格內容政策的 AI,雖然極力秉持“中立”,但卻陰差陽錯的吐露了人類看來更加不公平的結果。這是由于 AI 內部的黑箱機制,也是因為 AI 尚不具備真正的思考能力,無法根據上下文更好調整自己的行為。

在我們看來,選擇一致的“幫”或“不幫”,才是能被認為是公平的行動。以小見大,AI 與人類的價值觀對齊還有很遠的路要走。

但無論如何,在大熱的 AI 潮之下,AI 注定在這次大選中備受關注,接受馬斯克和無數用戶的審判。

作為使用 AI 的用戶,判斷信息的真偽、避免輕信不實內容、不武斷地定論信息背后的偏見,保持獨立思考,是我們不可推卸給 AI 的自身責任。

本文轉載自??51CTO技術棧??,作者:伊風