LLM-R:基于RAG和層次化Agent落地案例解析 原創

在這個由智能設備主導的時代,維護工作的重要性愈發凸顯,幾乎成了生產活動的守護神。想象一下,當一臺精密的機器在深夜突發故障,而維護手冊卻像天書一樣難以理解,這時,交互式電子技術手冊(IETMs)就像一束溫暖的燈塔,指引著維護人員安全渡過難關。

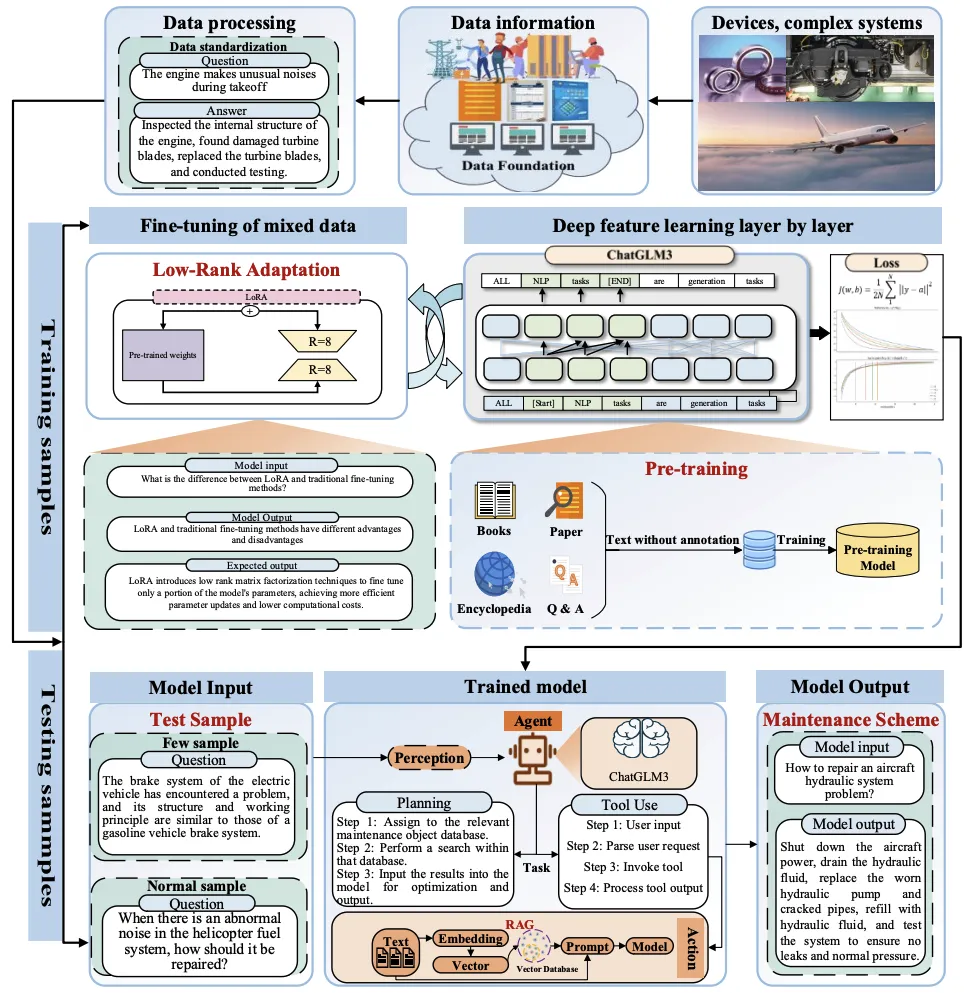

面對從圖形用戶界面(GUIs)到自然語言用戶界面(LUIs)的轉變,以及復雜邏輯關系的梳理,傳統的IETMs顯得有些力不從心。為了應對這一挑戰,一個革命性的方法——LLM-R應運而生,它基于大型語言模型,為維護方案的生成帶來了全新的思路。

LLM-R的核心創新包括:

- 低秩適應-知識保留(LORA-KR)損失技術:這是一種新穎的數據微調方法,它能夠調和混合維護數據,防止知識沖突,從而提升模型在特定維護領域的適應性和推理能力。

- 層次化任務Agent:這種Agent能夠深入挖掘任務的細節,確保每一步操作都精準無誤。

- 指令級檢索增強生成(RAG)技術:這是一種智能檢索技術,能夠在海量數據中迅速定位到最相關的維護方案,極大地提高了檢索的效率和準確性。

LLM-R框架的關鍵步驟如下:

整個過程的目標是利用LLMs來剖析復雜維護任務,并精確檢索相應的維護方案。這種方法不僅優化了傳統IETMs中存在的機械輸入問題,還顯著提升了維護人員處理復雜任務的效率。

LLM-R框架的結構和組件包括三個關鍵部分:指令級RAG機制、LORA-KR損失和層次化任務基礎Agent模塊。

- 指令級RAG(Instruction-level RAG):

- 作為智能體的核心工具,指令級RAG技術大幅提升了檢索特定維護對象方案的效率和準確性。

- 用戶或智能體識別維護任務的關鍵詞后,這些關鍵詞被輸入到RAG工具中,轉換為模型可以處理的向量格式,并與數據庫中向量化的數據匹配,以找到最相似的項。

- RAG在檢索階段使用BERT編碼器進行最大內積搜索(MIPS),以選擇相關的文本塊用于生成輸出。

- LORA-KR損失(Supervised Fine-Tuning of LORA-KR loss):

- LORA-KR損失是一種新的正則化方法,它結合了特定任務損失和領域獨立知識正則化,以在微調模型時保持預訓練知識領域的一致性。

- 包括任務特定損失(?CE)和領域獨立正則化損失(?KL),通過動態調整權重(w)來平衡這兩種損失。

- LORA-KR損失通過結合任務特定交叉熵損失和領域獨立KL散度正則化損失,在LoRA梯度更新中保持模型對原始預訓練領域知識的記憶力,同時適應新任務領域。

- 層次化任務基礎智能體(Hierarchical Task-Based Agent):

- 為了克服LLM在處理未知或高度復雜需求時可能出現的幻覺現象,采用了層次化任務基礎Agent技術。

- LLM作為“中央大腦”組織和總結信息,而智能體作為“助手”提供額外的具體信息支持。

- 設計了三個具有不同功能的智能體,都使用微調后的ChatGLM3模型作為基礎,分別負責解析用戶輸入、提供定制解決方案和將解決方案返回給基礎LLM進行進一步優化。

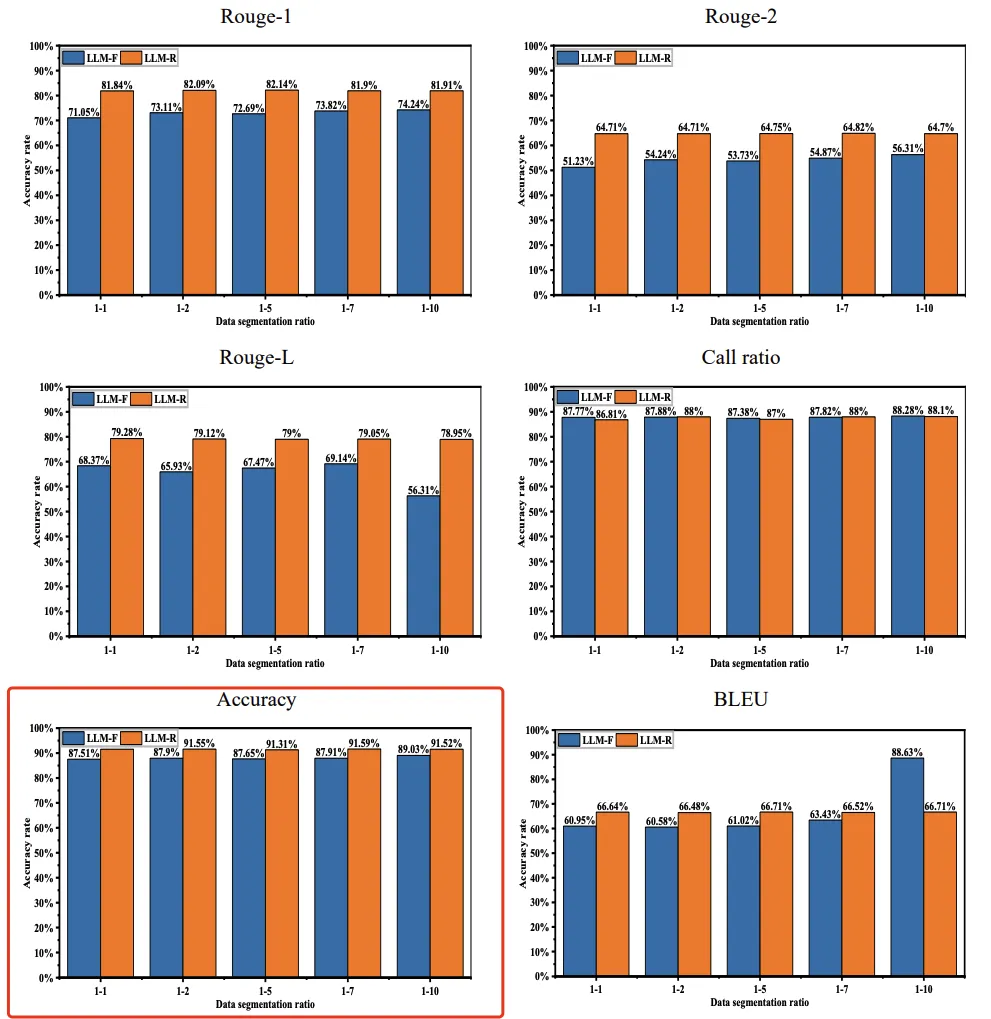

為了驗證所提出方法在維護任務中的有效性,使用不同領域的對象構建了一個維護方案數據集。實驗結果表明,所提出方法生成的維護方案的準確率達到了91.59%,這表明了其在提高維護方案的智能性和引入設備維護的新技術方法方面的顯著改進。

本文轉載自公眾號哎呀AIYA

?著作權歸作者所有,如需轉載,請注明出處,否則將追究法律責任

贊

收藏

回復

分享

微博

QQ

微信

舉報

回復

相關推薦