Omnivision-968M:最小多模態(tài)模型,為邊緣設備而生! 原創(chuàng) 精華

最近在HuggingFace上有一個開源多模態(tài)模型引起了廣泛關注:Omnivision-968M。這款模型以其不到1B參數(shù)量的小巧體積(僅968M參數(shù)量)脫穎而出,成為目前市場上最小的視覺語言模型之一。

Blog: ???https://nexa.ai/blogs/omni-vision???

Model: https://huggingface.co/NexaAIDev/omnivision-968M

Omnivision-968M

?? Omnivision-968M是由Nexa AI這家創(chuàng)業(yè)公司推出(與國內做CMOS聞名的同名半導體企業(yè)Omnivision無關)。Nexa AI的愿景是打造先進的端側AI模型,讓AI技術不再局限于云端,而是能夠直接在本地設備上運行。這不僅意味著成本的降低,更重要的是,它能夠更好地保護用戶的隱私安全。

??Omnivision-968M由于體積較小,所以模型在推理速度上,有著非常不錯的表現(xiàn)。在Apple最新M4 Pro處理器的MacBook上,它能夠以不到2秒的驚人速度,生成一張1046×1568像素圖像的語言描述。它在處理過程中僅占用988MB的統(tǒng)一內存空間。

??Omnivision在LLaVA架構的基礎上進行了改進,帶來了以下兩大改進:【9倍Token縮減】:Omnivision將圖像Token從729減少到81,這一改進大幅降低了延遲和計算成本,讓模型運行更加高效。【更少幻覺】:通過使用來自可信數(shù)據(jù)的DPO訓練,Omnivision減少了幻覺現(xiàn)象,提高了結果的可靠性。

模型結構

OmniVision的架構由以下三個關鍵組件構成:

基礎語言模型:Qwen2.5-0.5B-Instruct作為基礎語言模型,用于自回歸輸出文本。這款強大的語言模型為OmniVision提供了強大的文本處理能力。

視覺編碼器:SigLIP-400M,分辨率384,以14×14的patch大小生成圖像embedding。這一組件負責將輸入的圖像轉換成embedding。

投影層:MLP將視覺編碼器的嵌入與語言模型的Token空間對齊。與標準的LLaVA架構相比,能夠將圖像Token數(shù)目減少9倍。

視覺編碼器首先將輸入的圖像轉換成嵌入,然后這些嵌入通過投影層處理,以匹配Qwen2.5-0.5B-Instruct的Token空間,從而實現(xiàn)端到端的視覺-語言理解。

訓練方法

預訓練階段:OmniVision的訓練始于預訓練階段,這一階段的核心任務是建立基本的視覺-語言對齊。我們使用圖像-文本描述對來進行訓練,僅解凍MLP投影層參數(shù),以便學習圖像文本Token空間映射關系。

SFT:在預訓練的基礎上,通過圖像問答數(shù)據(jù)集來增強模型的上下文理解能力。在SFT階段,模型會在包含圖像的結構化聊天記錄上進行訓練,以生成更符合上下文的響應。

DPO:訓練流程的最后階段是直接偏好優(yōu)化(DPO)。首先,基礎模型會針對圖像生成響應。然后,教師模型會產生最小編輯的修正,同時保持與原始響應的高語義相似性,特別關注準確性至關重要的元素。這些原始和修正后的輸出形成選擇-拒絕對(chosen-rejected pair)。微調的目標是在不改變模型核心響應特征的情況下,針對模型輸出進行必要的改進。糾正預測分布,減少模型幻覺。

特色方法

上述模型結構和訓練方法和主流方法比沒有太多特殊之處,Omnivision除了模型參數(shù)量小之外,還應用了這些方法:

9x圖像Token壓縮: 在邊緣設備部署多模態(tài)模型時,處理太大的圖像Token數(shù)目會產生顯著的計算開銷,因為計算復雜度為O(N**2)的序列長度。標準LLaVA架構中,每張圖像生成729個Token(27x27),導致高延遲和高計算成本。OmniVision使用了和InternVL類似的方法,在投影階段使用pixel unshuffle機制,將圖像嵌入從[batch_size, 729, hidden_size]轉換為[batch_size, 81, hidden_size*9],這樣減少了9倍的Token數(shù)量,但保持信息量沒有被減少,只是挪動到了通道上,不犧牲模型性能。實驗表明,這種壓縮方法極大地提高了模型推理速度。分析表明,這種改進源于基礎Qwen模型對較短序列的處理能力,其中壓縮格式提供了更集中的信息表示。

最小編輯DPO: 傳統(tǒng)的DPO方法可能導致模型行為的顯著變化。OmniVision的DPO實現(xiàn)使用最小編輯對進行訓練。教師模型在保持原始結構的同時,對基礎模型的輸出進行小的、有針對性的改進。這種方法確保了精確的質量改進,而不破壞模型的核心能力。

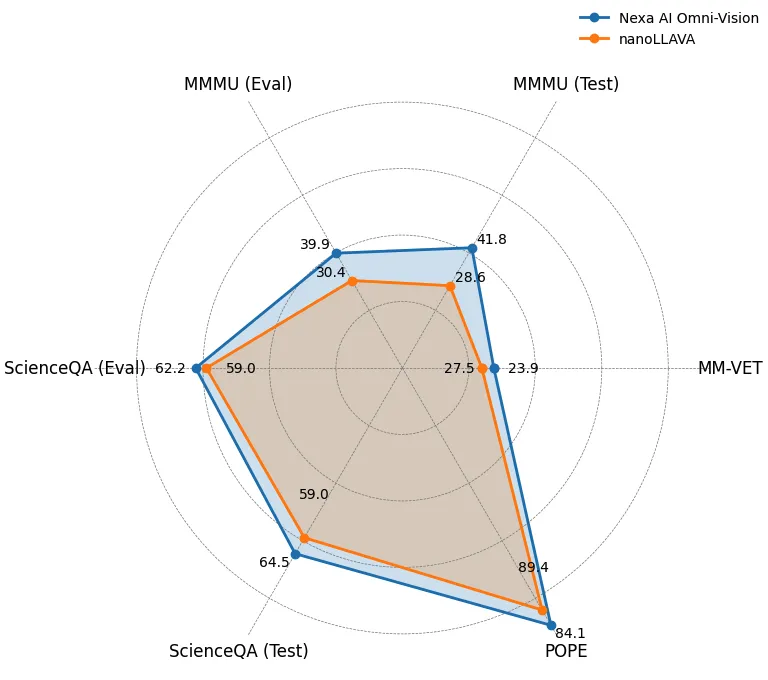

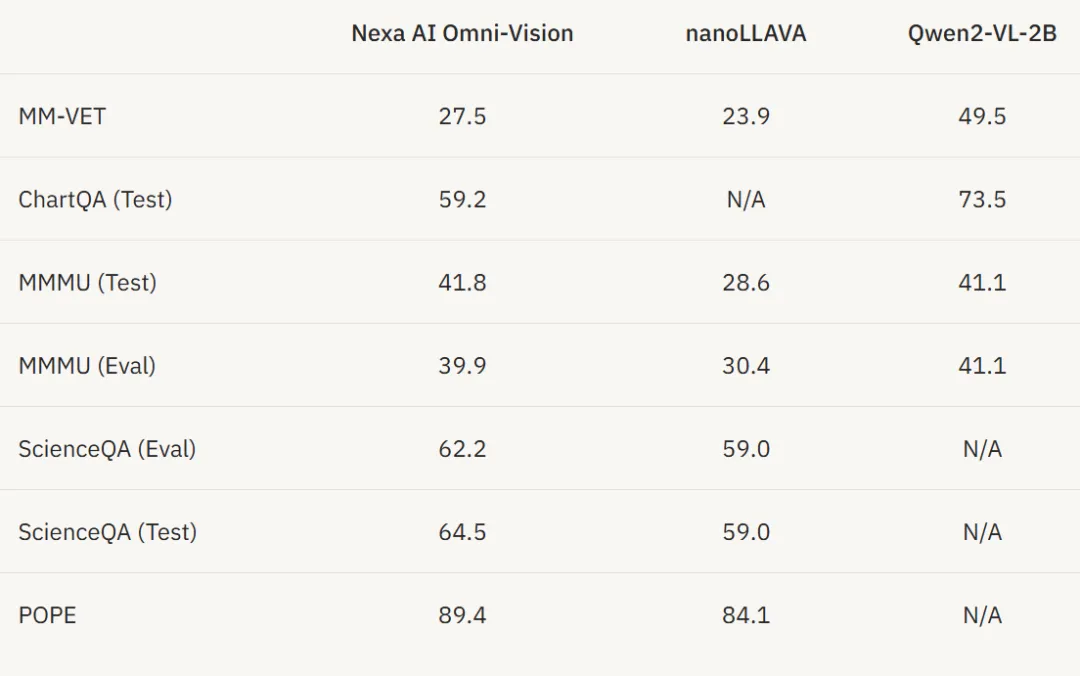

性能評測

在所有任務中,OmniVision的表現(xiàn)都優(yōu)于之前世界上最小的視覺語言模型nanoLLAVA。但略遜于Qwen2-VL-2B

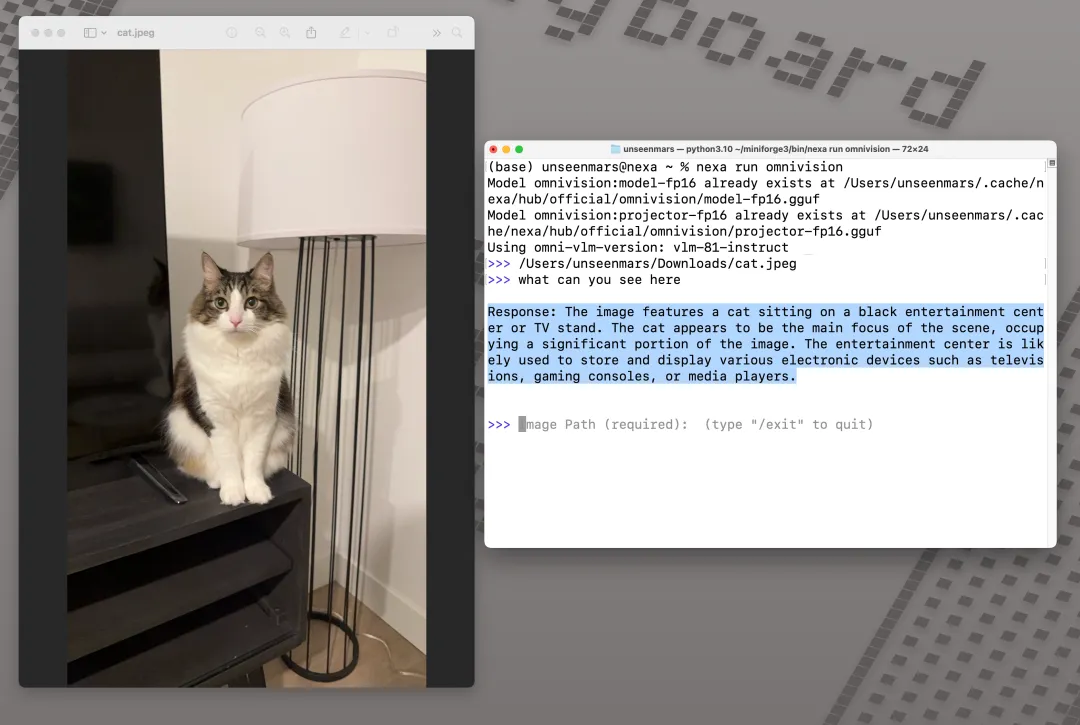

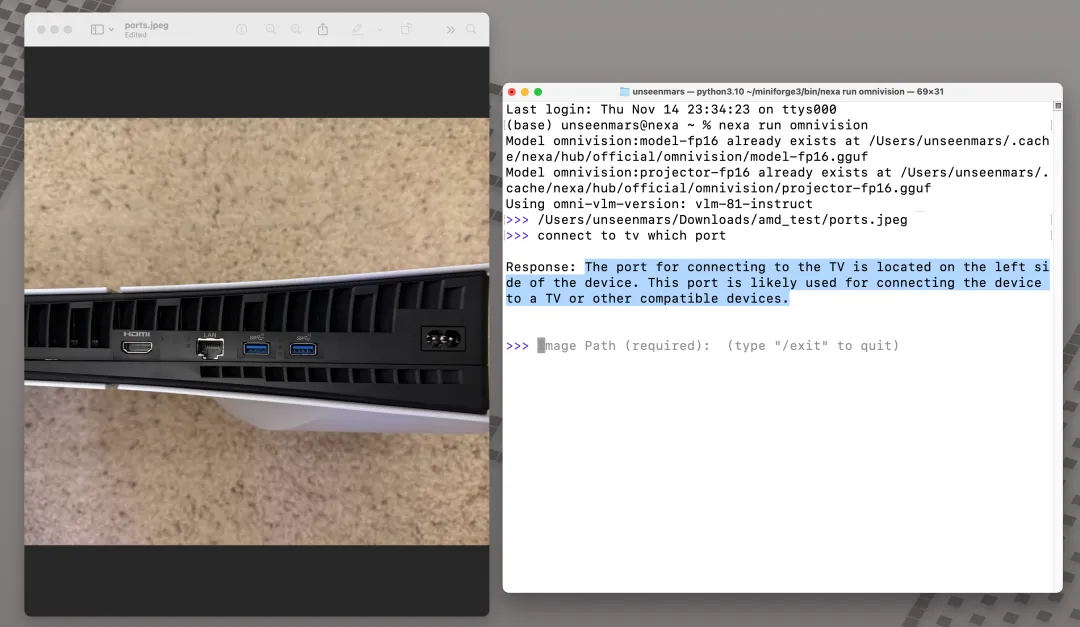

(OmniVision生成圖像描述)

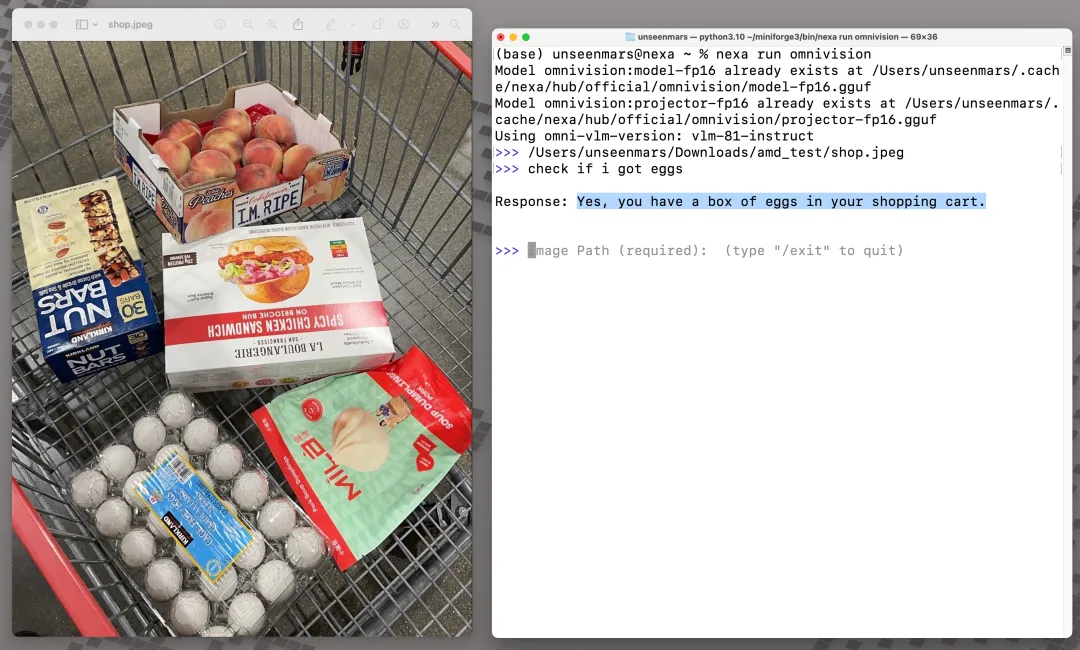

(OmniVision可以尋找圖像中出現(xiàn)的目標)

(OmniVision分析食物圖像并生成食譜)

(OmniVision確定了正確的HDMI端口位置)

本文轉載自公眾號思源數(shù)據(jù)科學 作者:思源Source

原文鏈接:??https://mp.weixin.qq.com/s/IclLU-FQd2X6zRZgg4zVtg??