再看多模態RAG進行文檔問答的方案

先說結論:這篇文章的方法和前面介紹的兩個多模態RAG的工作非常相似,可以看看往期介紹:

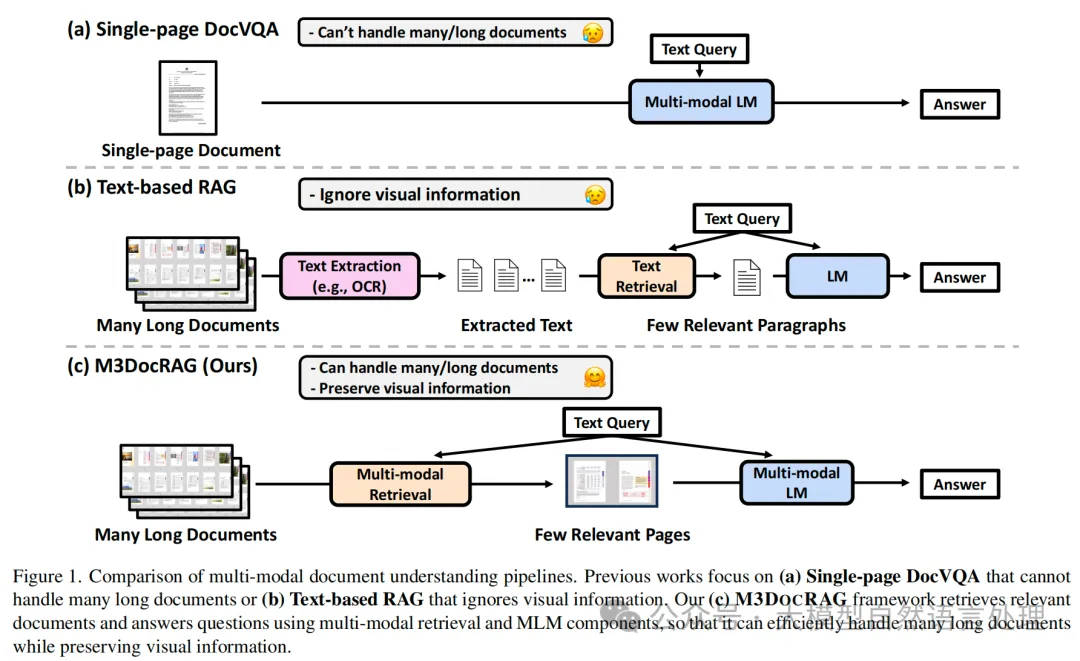

M3DOCRAG同樣也指出,現有的方法要么專注于單頁文檔的多模態語言模型,要么依賴于基于文本的RAG方法,這些方法使用OCR等文本提取工具。然而,這些方法在實際應用中存在困難,例如問題通常需要跨不同頁面或文檔的信息,而MLMs無法處理長文檔;并且,文檔中重要的視覺元素(如圖、表等)往往被文本提取工具忽略。

M3DoCRAG和以往方法對比

注:文章代碼和數據集暫未開源,但都是使用ColPali和qwen2-vl實現,筆者在前面文檔也恰好實踐了一個簡單的RAG-ColPali,供參考:

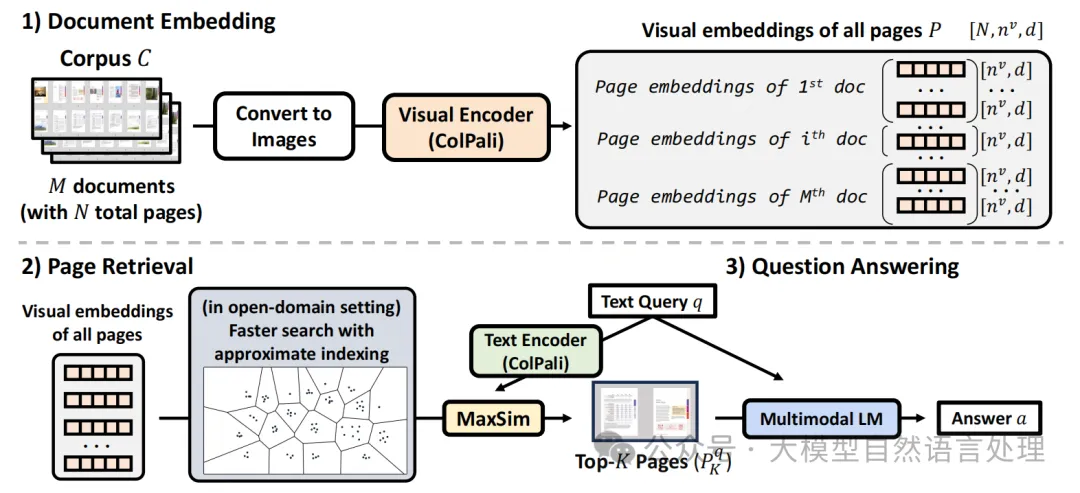

方法

- 文檔嵌入:和RAG-ColPali很相似,文檔嵌入使用ColPali將所有文檔頁面轉換為RGB圖像,并從頁面圖像中提取視覺嵌入。(ColPali是一種基于后期交互機制的多模態檢索模型,它將文本和圖像輸入編碼為統一的向量表示,并檢索最相關的圖像。其原理可以看看往期對ColPali的介紹《??ColPali??》)

M3DOCRAG流程

- 頁面檢索:也和RAG-ColPali使用的方法相似,也是使用MaxSim分數計算查詢與頁面之間的相關性,并檢索與文本查詢top-K個頁面。

- 答案生成:使用多模態語言模型(MLM)對檢索到的頁面圖像進行視覺問答,以獲得最終答案。該方法使用的是qwen2-vl-7b

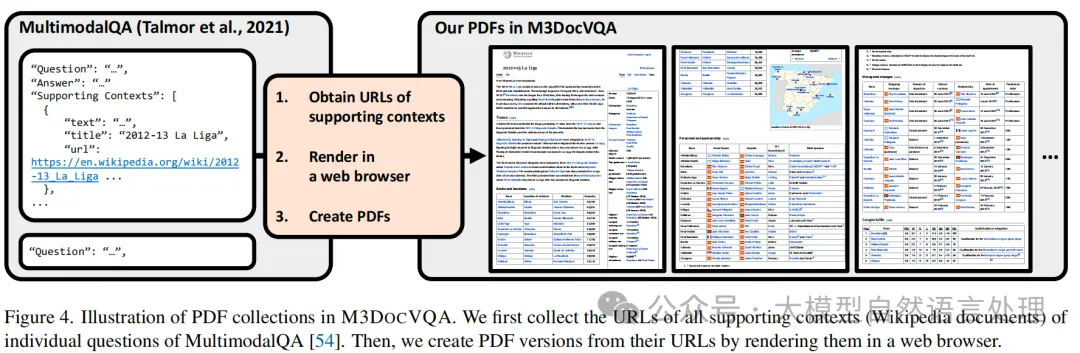

數據集

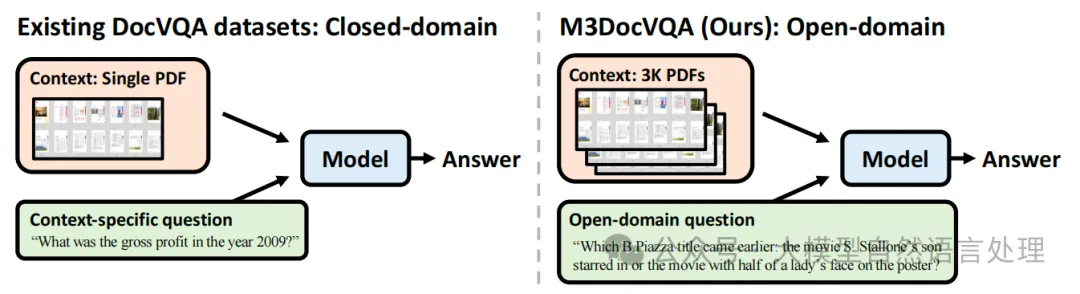

M3DocVQA包含3,368個PDF文檔,總計41,005頁,涵蓋開放域和封閉域的DocVQA任務。

M3DocVQA與現有DocVQA數據集對比

M3DocVQA中PDF集合的示意圖

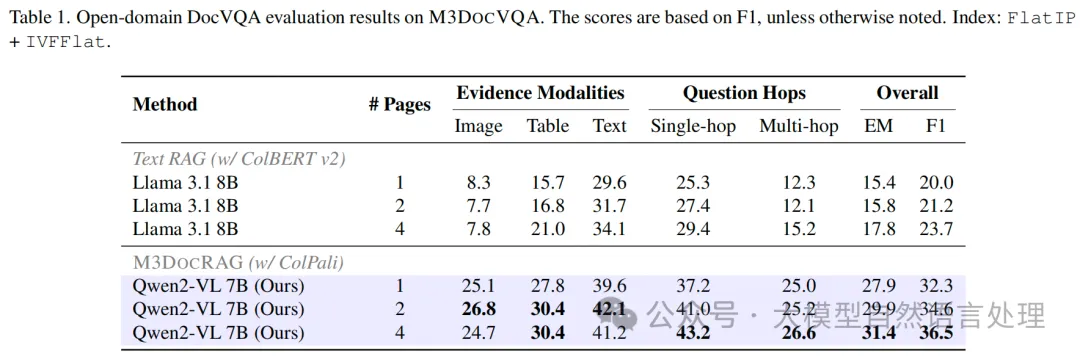

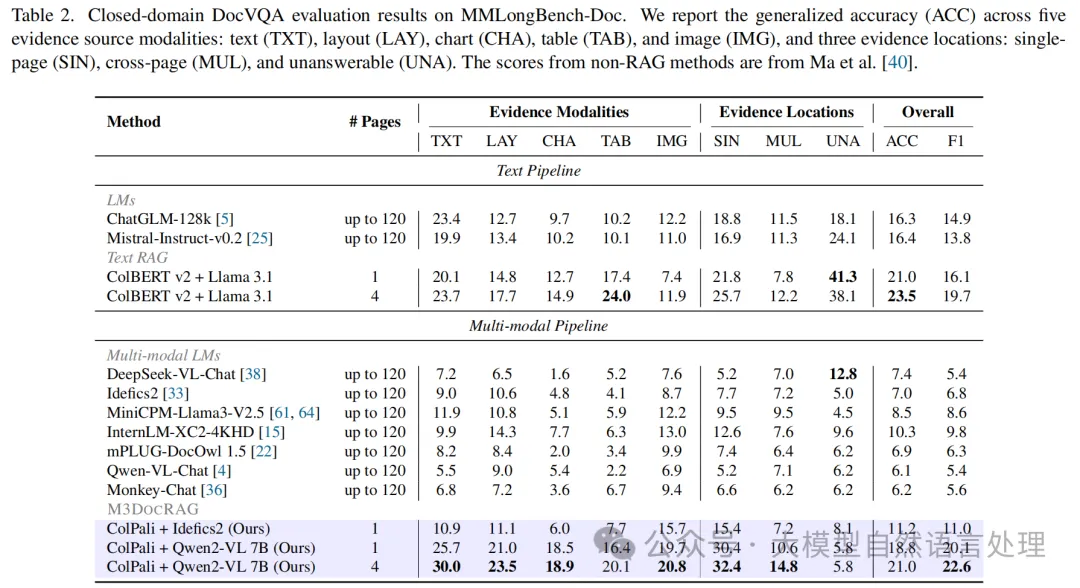

實驗結果

參考文獻

??https://arxiv.org/pdf/2411.04952v1??

本文轉載自公眾號大模型自然語言處理 作者:余俊暉

已于2024-11-28 18:52:01修改

贊

收藏

回復

分享

微博

QQ

微信

舉報

回復

相關推薦