多模態生成式人工智能(Generative AI):現狀、應用與未來! 原創 精華

引言:人工智能的新風向

在當今快速發展的人工智能領域,多模態生成式人工智能正以其獨特的魅力和巨大的潛力,引領著人工智能的變革潮流。生成式人工智能的創新,尤其是在跨多種模態進行操作的能力,正深刻地改變著我們生產文本、圖像、視頻和音頻內容的方式。

以往的人工智能系統往往只能執行特定任務,并且局限于單一模態,也就是所謂的單模態人工智能。比如,基于文本的模型只能生成書面內容,圖像模型則僅能創建視覺元素。而多模態生成式人工智能的出現,是人工智能發展的一個重大飛躍,它使得人工智能系統能夠處理來自多種數據模態的信息。

本文將深入探討多模態生成式人工智能,剖析其基本原理,展示其在現實世界中的廣泛應用。我們還會對當前流行的多模態人工智能模型,如OpenAI的GPT-4、谷歌DeepMind的Gemini以及Meta的ImageBind進行比較,并探討該行業所面臨的重大挑戰。

了解多模態生成式人工智能的基礎

想要深入理解多模態生成式人工智能,我們需要先掌握一些基礎知識。

首先是機器學習(ML)和深度學習機制。了解這些機制,能幫助我們明白生成式人工智能模型是如何處理各種數據類型的。比如,文本數據在預處理時需要進行標記化,圖像數據則要借助卷積神經網絡來提取視覺特征,而音頻數據在輸入人工智能模型前,可能需要先轉換為頻譜圖。

其次,對文本到圖像、文本到文本以及文本到音頻的生成式模型,如GPT、DALL·E和Stable Diffusion等有深入的理解,是內容生成的堅實基礎。這些模型的工作原理和應用場景,為我們打開了多模態生成式人工智能的大門。

最后,對單模態人工智能和多模態人工智能的充分理解,能讓我們深入洞察生成式人工智能系統中數據融合和跨模態學習技術的運作方式。這是因為多模態人工智能的核心就在于整合多種數據類型,而數據融合和跨模態學習則是實現這一目標的關鍵技術。

多模態生成式人工智能究竟是什么?

多模態生成式人工智能,指的是能夠處理和創建來自多種數據模態內容的人工智能系統。在人工智能領域,“模態”描述了各種數據形式,包括文本、圖像和視頻等視覺內容、音頻文件,以及來自智能設備的數據。

多模態人工智能通過跨模態學習,利用多種輸入類型生成更豐富的結果。舉個例子,一個多模態生成式人工智能系統可以讀取場景描述,并分析相應的圖像,從而生成新的內容,比如音頻旁白和詳細的圖像。這是通過合并來自兩種模態的數據來實現的。信息的融合讓人工智能能夠深入理解,從而生成能夠準確反映現實世界復雜性的回復。

多模態人工智能與生成式人工智能的區別

盡管多模態人工智能和生成式人工智能在實踐中經常重疊,但研究人員必須清楚它們之間的區別:

- 生成式人工智能:生成式人工智能旨在開發能夠生成新內容的人工智能系統,比如通過DALL·E、Stable Diffusion等工具生成視覺輸出。它還可以生成文本、音頻和視頻等媒體格式。

- 多模態人工智能:多模態人工智能則是將各種數據類型結合起來并進行處理。雖然并非所有的多模態人工智能系統都作為生成式模型運行,但生成式人工智能的許多最新進展都源于多模態方法。生成式人工智能多模態模型通過結合不同的數據源,將這兩個概念融合在一起,以產生富有創意和復雜的結果。

實際上,多模態人工智能和生成式人工智能并不是相互對立的,而是相互協作,共同創建一個統一的系統。通過從各種模態中組合多個數據輸入,多模態人工智能為生成式模型提供了多樣化和豐富的數據源,從而提高了生成式模型的創造力和真實性。

多模態人工智能是如何工作的?

多模態人工智能的工作原理,從根本上來說,依賴于它通過統一的計算框架處理和集成各種數據類型的能力。這個過程主要包括數據處理、跨模型對齊、數據融合和解碼。

- 數據處理:數據處理是多模態人工智能的核心。這涉及到專門的預處理方法,用于轉換來自多種模態的原始數據。例如,文本數據在預處理時需要進行標記化,圖像數據則利用卷積神經網絡提取視覺特征,音頻數據在轉換為頻譜圖后才能作為人工智能模型的輸入。

- 跨模態對齊:模型必須準確地對齊其提取的特征。通過跨模態學習方法,模型可以學習在不同數據類型之間建立有意義的關聯。比如,基于文本的描述可以幫助圖像識別系統更準確地識別對象,而圖像則可以提供上下文,改進文本生成,比如指定對象的顏色。這種相互作用需要模型執行跨注意力機制,這種機制允許模型架構的不同部分關注每個模態的相關方面。例如,描述圖像中“紅色球”的文本標記可能與圖像中表示紅色球形物體的相應視覺特征對齊。

- 數據融合:數據融合過程涉及將同步的特征組合成一個統一的表示。融合層起著關鍵作用,因為它能識別來自每個模態的對特定任務最重要的細節。數據融合有幾種技術,包括早期融合(在初始階段集成原始特征,幫助模型直接從組合數據中學習)、晚期融合(在組合輸出之前分別處理每個模態)和混合融合(通過多個網絡階段組合每個模態的部分表示,結合了早期和晚期融合的元素)。

- 解碼/生成:解碼器階段使用變換器或循環神經網絡,將統一的表示轉換為生成任務的目標輸出。根據模型的結構,生成的輸出可以是文本、圖像或其他各種格式。系統利用其集成的多模態知識來生成新的內容。

多模態在生成式人工智能中的應用實例

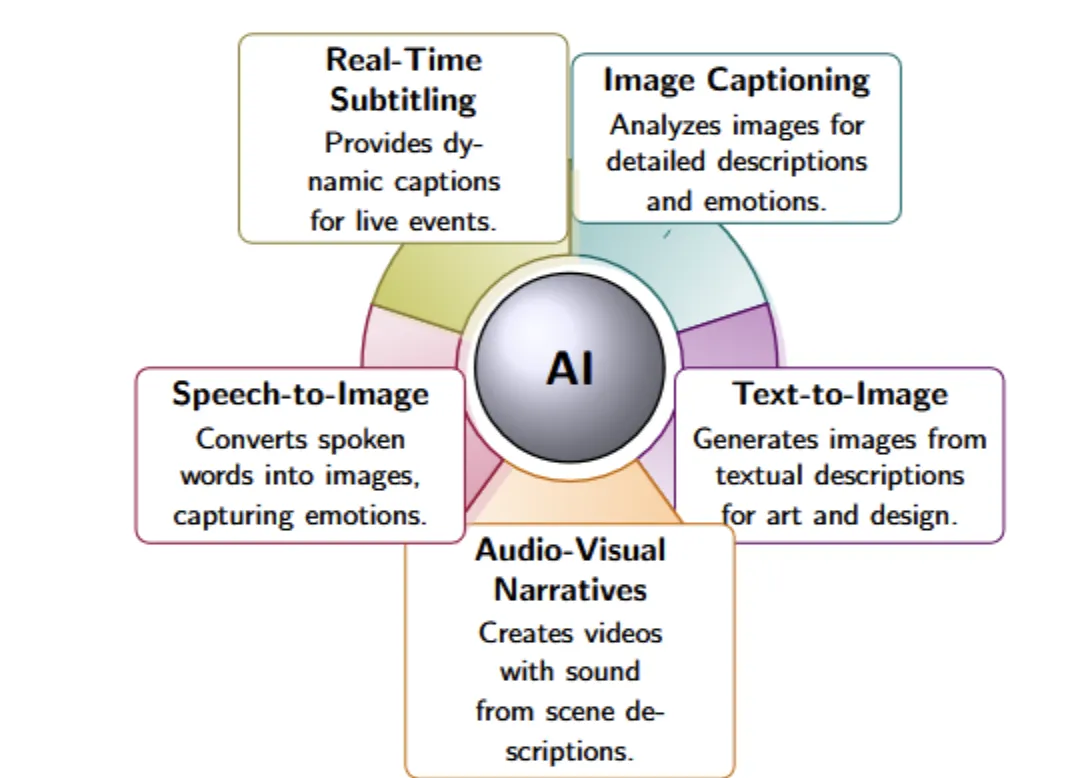

下面我們來看一些多模態生成式人工智能的實際應用例子,這些例子展示了文本、圖像、音頻和其他元素是如何有效整合的:

- 使用擴散模型的文本到圖像生成:當用戶提交一個描述性的文本提示,比如“一片沐浴在月光下的寧靜湖泊”,模型會生成相應的圖像,因為它學會了如何將文本描述與視覺特征聯系起來。這種應用廣泛用于數字藝術創作、營銷活動和概念設計工作。

- 視聽敘事生成:當用戶通過文本輸入描述一個場景時,人工智能系統會生成帶有適當音頻效果的動畫視頻。典型的流程包括文本編碼器(將場景描述轉換為嵌入)、視頻生成器(使用GAN或擴散模型生成幀)和音頻合成(生成相應的音頻)。這種系統在電影預告片制作、游戲序列生成和自動化社交媒體內容創作中都有應用。

- 語音到圖像模型:這些模型接收可能包含情感線索的語音輸入,并生成相應的圖像。技術方法是系統首先將音頻轉錄或轉換為語義嵌入,然后用于生成相應的圖像。不過,這需要強大的語音識別能力和先進的跨模態對齊技術。

- 具有上下文建議的實時字幕:在直播活動中,人工智能系統會聽取現場演講,創建顯示在屏幕上的文本字幕,同時通過攝像頭監控觀眾的反應,以調整字幕的細節和風格。這種方法通過動態和上下文敏感的字幕,提高了用戶的可訪問性和參與度。

- 圖像字幕和情感分析:將視覺表示與描述事件的描述性文本或音頻配對,生成的描述會提供對對象和個人及其情感狀態的詳細識別。這種應用在社交媒體、照片共享應用程序或執法部門分析隨身攝像頭的鏡頭時非常有價值。

這些例子凸顯了多模態在生成式人工智能中的應用,顯著拓寬了內容開發和用戶參與的潛力。通過使用集成多個數據流的人工智能解決方案,組織和個人可以生成更具創新性和上下文相關性的輸出。

多模態人工智能架構

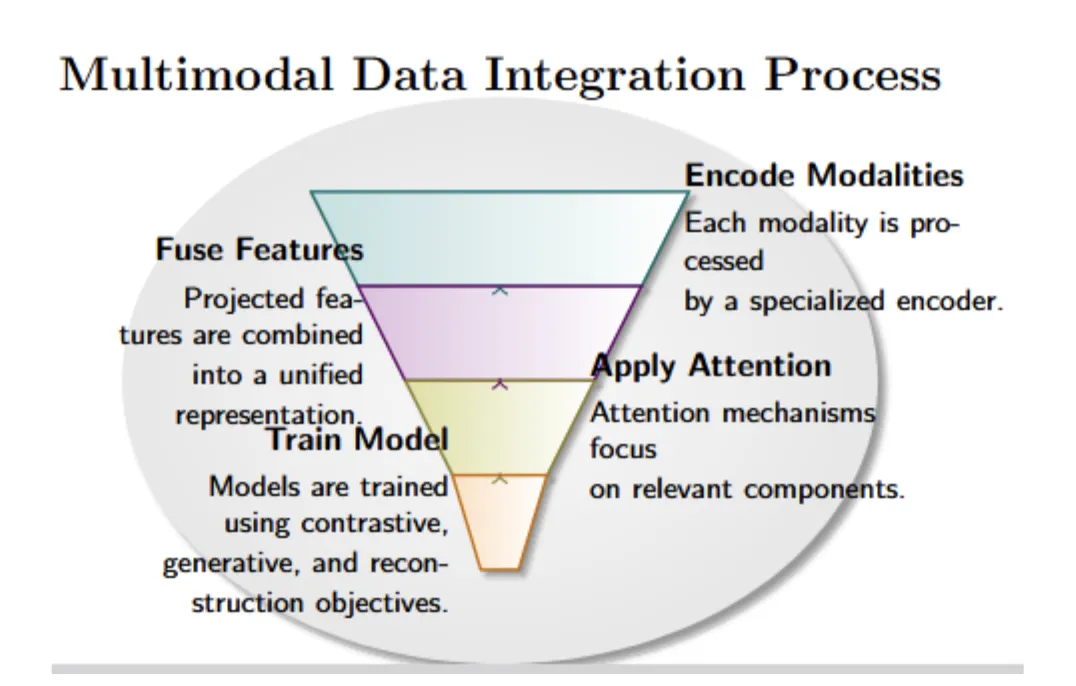

強大的多模態人工智能系統的開發,離不開編碼器-解碼器框架、注意力機制和訓練目標的支持。

- 編碼器-解碼器框架:多模態深度學習經常使用基于變換器的編碼器-解碼器框架作為主要方法。在這樣的系統中,每個模態(文本、圖像、音頻等)由專門的編碼器進行處理,這些專門編碼器的輸出投影到共享嵌入空間,允許跨注意力層學習模態對齊,解碼器則將融合的多模態表示轉換為最終輸出,可能是文本、圖像或其他格式。

- 注意力機制:有效的多模態系統需要注意力機制,使模型能夠關注各種模態中最相關的組件。例如,當模型生成圖像的文本描述時,它可以關注圖像中與特定單詞匹配的特定區域。

- 訓練目標:多模態模型的常見訓練目標包括對比學習(使來自同一實例的不同模態的表示趨向于相似)、生成損失(生成文本、圖像或其他內容時需要最小化損失函數,如交叉熵)和重建損失(類似于自動編碼器的系統通過重建學習過程訓練模型恢復缺失的模態)。

我們來看一個使用PyTorch的代碼示例,這個模型通過自注意力機制結合文本、圖像和音頻數據,實現多模態融合:

import torch

import torch.nn as nn

import torch.nn.functional as F

class Mult_Mod_Att_Fus(nn.Module):

def __init__(self, txt_dim, img_dim, aud_dim, fus_dim, num_heads=4):

super(Mult_Mod_Att_Fus, self).__init__()

# We performed the linear projections to a share fusion dimension

self.txt_fc = nn.Linear(txt_dim, fus_dim)

self.img_fc = nn.Linear(img_dim, fus_dim)

self.aud_fc = nn.Linear(aud_dim, fus_dim)

# Multi-head Self-Attention for Fusion

self.attn = nn.MultiheadAttention(embed_dim=fus_dim, num_heads=num_heads, batch_first=True)

# This is our final MLP for learned fusion

self.fusion_fc = nn.Linear(fus_dim, fus_dim)

def forward(self, txt_feat, img_feat, aud_feat):

# Fusion dimension through projection of each modalitity

proj_txt = self.txt_fc(txt_feat) # (batch, seq_len, fus_dim)

proj_img = self.img_fc(img_feat)

proj_aud = self.aud_fc(aud_feat)

# We Stack modalities into sequence

fus_inp = torch.stack([proj_txt, proj_img, proj_aud], dim=1)

# Here we can apply Multi-Head Attention for feature alignment

attn_out, _ = self.attn(fus_inp, fus_inp, fus_inp)

# Pass through fusion MLP for final feature aggregation

fused_rep = self.fusion_fc(attn_out.mean(dim=1))

return fused_rep

# Example Usage:

txt_feat = torch.randn(3, 255)

img_feat = torch.randn(3, 33)

aud_feat = torch.randn(3, 17)

encoder = Mult_Mod_Att_Fus(txt_dim=255, img_dim=33, aud_dim=17, fus_dim=128, num_heads=4)

fused_rep = encoder(txt_feat, img_feat, aud_feat)

print("Fused representation shape:", fused_rep.shape) # Expected: (3, 128)在這個例子中,模型使用不同的線性層將每個模態投影到共享融合空間,轉換后的特征堆疊在一起,形成一個統一的輸入張量。通過多頭自注意力機制,模型使各種模態能夠動態交互并相互影響。全連接層將對齊的特征輸出轉換為具有維度(batch_size, fusion_dim)的融合表示。在示例用法中,模型接收文本(255維)、圖像(33維)和音頻(17維)的隨機輸入張量,然后為每個批次樣本生成128維的融合表示。

多模態人工智能的應用領域

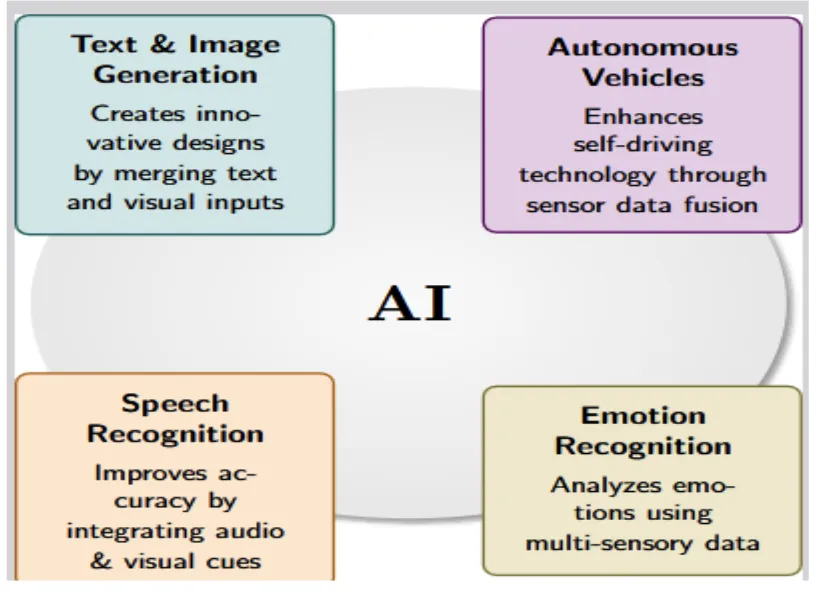

通過結合不同的模態,多模態人工智能系統能夠以類似人類的上下文感知能力執行任務。這使得它們在現實世界的許多應用中非常有效,比如自動駕駛汽車、語音識別、情感分析以及用于文本和圖像合成的生成式人工智能應用。

- 自動駕駛汽車:自動駕駛汽車的應用展示了多模態人工智能在實際應用中的有效性。自動駕駛汽車的運行依賴于來自眾多傳感器的數據輸入,包括攝像頭圖像、LiDAR點云、雷達信號和GPS信息。來自不同傳感器流的數據融合使車輛能夠準確感知周圍環境。生成式人工智能可以通過預測未來事件,如行人從人行道上走下來,來改進自動駕駛汽車技術。

- 語音識別:傳統的語音識別模型將語音音頻信號轉換為書面文本。多模態人工智能可以在傳統語音識別的基礎上增加上下文,比如唇讀或文本元數據。在嘈雜環境中,如果結合唇讀和音頻數據,可以取得更好的效果。此外,多模態生成式人工智能模型可以在轉錄語音的同時生成相關的摘要文本和要點,并整合圖表或圖表等視覺表示。

- 情感識別:要理解人類情感,我們需要觀察面部表情(視覺)、語音語調(音頻)和文本內容(如果存在)中的微妙信號。強大的情感識別來自于結合多種信號的多模態人工智能系統。例如,視頻會議應用程序可以識別用戶是否表現出困惑或不參與的跡象,從而促使演示者澄清特定主題。

- 用于文本和圖像生成的人工智能模型:文本到圖像生成包括集成文本和視覺提示的模型。比如,你有一個設計的部分草圖,并附有描述你想要的外觀的書面說明。通過合并來自不同模態的輸入,多模態人工智能系統可以生成一系列高質量的設計替代方案。這將有助于填補時尚、室內設計和廣告等領域的創意空白。將整個知識圖譜或大型文本語料庫與視覺數據集成,可以創建上下文豐富且有根據的輸出。例如,一個人工智能系統可以閱讀完整的建筑書籍,同時分析數千張建筑圖像,以生成創新的設計。

領先的多模態生成式人工智能模型比較

GPT-4、Gemini和ImageBind是領先的多模態生成式人工智能模型,每個模型都有其獨特的能力和優勢:

- GPT-4(OpenAI):GPT-4是OpenAI推出的大型語言模型,可以處理文本和圖像數據(GPT-4 Turbo)。它的主要特點包括多模態處理(支持文本和圖像輸入,但缺乏音頻和視頻處理的原生能力,且圖像理解能力相比文本能力有限)、卓越的性能(在文本生成、數學問題解決和復雜推理方面表現出色)以及巨大的上下文窗口(GPT-4 Turbo模型提供128K令牌的上下文窗口,在基于文本的人工智能系統中名列前茅)。

- Gemini 2.0(Google DeepMind):Gemini 2.0是谷歌DeepMind創建的多模態人工智能模型,因其能夠處理多種數據類型而脫穎而出。它的特點包括多功能的多模態能力(支持文本、音頻、視頻、圖像和代碼)、與谷歌服務的集成(直接與谷歌搜索、文檔、YouTube和其他平臺集成,以實現高效的知識訪問)以及在人工智能基準測試中表現出色(屬于頂級人工智能模型,在多模態理解、深度學習和研究驅動的應用中表現出色)。

- ImageBind(Meta AI):ImageBind是由Meta AI開發的模型,旨在理解和連接不同類型的數據。該模型處理六種數據模態:圖像、文本信息、音頻信號、深度讀數、熱圖像和IMU數據。ImageBind為多種數據形式建立共享表示,實現不同模態之間的順暢交互。它對從事各種人工智能應用的開發人員和研究人員很有用,其特點包括跨模態檢索(用戶可以使用文本描述查找圖像,并從視覺內容中提取文本)和嵌入算術(可以集成來自多個來源的數據,以創建更復雜概念的表示)。

以下是一個總結比較表:

特征 | GPT-4 (OpenAI) | Gemini 2.0 (Google DeepMind) | ImageBind (Meta AI) |

主要優勢 | 先進的文本生成、推理、編碼和有限的圖像處理能力 | 全功能多模態人工智能,原生支持文本、圖像、音頻、視頻和代碼 | 跨六種數據類型的跨模態學習和傳感器融合 |

多模態能力 | 文本和圖像(GPT-4 Turbo具有基本的圖像理解能力,但沒有原生的視頻或音頻支持) | 文本、圖像、音頻、視頻和代碼(真正的多模態處理) | 圖像、文本、音頻、深度、熱和IMU(運動傳感器) |

特殊功能 | 強大的語言推理、編碼任務和問題解決能力 | 先進的多模態理解和跨模態推理 | 基于嵌入的學習和跨模態檢索 |

最佳用例 | 聊天機器人、業務自動化、編碼助手、基于文本的研究 | 多模態人工智能應用、研究、多媒體處理和交互式人工智能任務 | 機器人技術、AR/VR、自主系統和傳感器驅動的人工智能 |

獨特優勢 | 在文本密集型推理、寫作和編碼任務中表現出色 | 在文本、圖像、音頻和視頻方面實現無縫多模態人工智能 | 卓越的傳感器融合和多模態數據綁定 |

適用對象 | 開發人員、企業以及NLP和編碼領域的研究人員 | 人工智能研究人員、交互式多模態應用程序和實時人工智能 | 自主系統、機器人技術、自動駕駛汽車和AR/VR應用程序 |

用戶可以通過查看這個表格,識別出最適合自己需求的人工智能系統,該表格概述了每個模型的基本優勢、能力和理想用例。

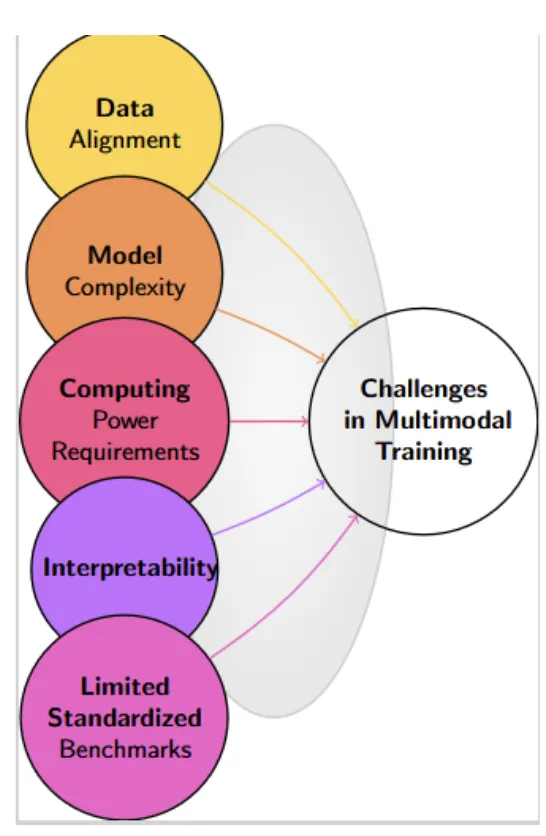

多模態訓練面臨的挑戰

盡管多模態生成式人工智能前景廣闊,但仍有一些挑戰阻礙其廣泛應用:

- 數據對齊:多模態數據集需要精心策劃和對齊,以確保文本與其相應的圖像或音頻剪輯相對應。數據對齊不當會導致訓練不一致和不可靠的性能結果。

- 模型復雜性:多模態人工智能架構比單模態模型需要更多的參數,這增加了GPU資源需求并延長了訓練時間。

- 計算能力要求:大規模訓練多模態模型的成本使得這項技術僅適用于擁有大量資金的組織和研究實驗室。

- 可解釋性:深入了解多模態系統的決策過程比分析單模態模型更復雜。由于需要跟蹤每個模態的輸入,因此更難解釋模型的操作。

- 有限的標準化基準:雖然文本和視覺任務有可用的基準,但全面的多模態人工智能應用仍相對較新。這給持續比較模型帶來了挑戰。

不過,行業正在積極應對這些挑戰。一方面,開發更強大的數據整理管道。通過優化數據采集、清洗、標注等環節,確保多模態數據的準確性與一致性,為模型訓練提供可靠的基礎。例如,一些公司利用眾包平臺,集合眾多標注者對圖像、文本、音頻等多種數據進行聯合標注,提高數據對齊的質量。

另一方面,研發高效的模型架構,像稀疏變換器和專家混合模型等。稀疏變換器通過減少不必要的計算連接,在保證模型性能的同時降低計算復雜度;專家混合模型則將不同的子模型(專家)組合起來,每個專家專注于處理特定類型的數據或任務,使得模型在處理多模態數據時更加高效。這些新架構在一定程度上緩解了模型復雜性和計算資源需求的問題。

同時,改進對齊策略也成為研究重點。通過設計更智能的跨模態學習算法,讓模型能更精準地捕捉不同模態數據間的關聯,提升模型的可解釋性。例如,一些研究團隊嘗試在模型訓練過程中引入可視化技術,實時展示不同模態數據在模型內部的交互過程,幫助研究人員理解模型的決策邏輯。

只有成功攻克這些難題,多模態深度學習才能取得進一步的重大進展。

多模態人工智能的未來展望

多模態人工智能的未來充滿希望,有多個發展方向將推動其持續進步:

- 實時應用:硬件加速器性能的提升,將使多模態人工智能系統能夠在實時環境中得到部署,如增強現實(AR)/虛擬現實(VR)體驗以及視頻會議翻譯。想象一下,在未來的AR購物場景中,消費者只需說出對商品的描述,系統就能實時生成該商品的3D模型并展示在眼前;在跨國視頻會議中,多模態AI能即時將發言者的語音轉化為文字并同步翻譯成多種語言字幕,讓交流毫無障礙。

- 個性化與情境感知AI:從個性化數據源(如短信、社交媒體動態和語音指令)中汲取學習洞察的AI模型,將為用戶帶來高度定制化的體驗。但這也需要嚴格的隱私和安全措施。例如,智能家居系統可以根據家庭成員日常的語音指令和行為習慣,自動調整家居設備的運行模式,營造最舒適的居住環境,同時確保用戶數據不被泄露。

- 道德與偏差緩解:隨著模型納入更多的數據類型,產生偏差或不當輸出的可能性也在增加。未來的研究將重點關注偏差檢測和可解釋性。比如在招聘場景中,多模態AI在篩選簡歷和面試評估時,要避免因性別、種族等因素產生偏見,保證公平公正。

- 與機器人技術的融合:機器人具備處理視覺信息和口語的能力,將使其能夠更好地適應環境。這將徹底改變醫療保健、物流和農業等行業。在醫療保健領域,機器人助手可以通過識別患者的表情、語音中的情緒以及醫療數據,提供更貼心的護理服務;在物流行業,機器人能根據視覺識別和語音指令快速準確地分揀貨物;在農業中,機器人可以通過感知農作物的外觀、生長環境的聲音等信息,進行精準的灌溉、施肥和病蟲害防治。

- 持續與終身學習:多模態生成式AI模型面臨的一個新挑戰是,在不斷更新知識庫的同時保留先前的信息,并能即時適應新類型的數據。未來的模型需要具備像人類一樣不斷學習成長的能力,在面對新的知識和場景時,能夠快速整合到已有的知識體系中,持續提升自身性能。

在未來幾年,我們將見證多模態人工智能深度融入各種產品和服務,極大地改善人機交互體驗,拓展機器的能力邊界,為我們的生活和工作帶來前所未有的變革。

常見問題解答

- 什么是生成式AI中的多模態學習?生成式AI的多模態學習是指訓練模型利用多種數據類型來理解并生成新內容。多模態系統并非僅依賴單一模態(如純文本),而是通過融合多種來源的信息來創造更豐富的輸出。

- 多模態AI如何改進生成式模型?多模態AI將各種數據類型相結合,為生成式模型提供了更多的上下文信息,有助于減少歧義,提升整體質量。比如額外的文本元數據或音頻線索,能讓文本到圖像模型生成更精準的圖像。

- 多模態生成式AI有哪些例子?多模態生成式AI涵蓋圖像字幕系統(從視覺數據生成文本)、文本到圖像模型(如DALL·E、Midjourney),以及能同時響應語音指令和文本查詢的虛擬助手。現在一些先進模型還能處理視頻內容,以及結合3D圖形和觸覺反饋數據。

- 多模態AI如何處理圖像和文本?多模態模型利用CNN或基于變換器的視覺網絡提取圖像特征,同時使用語言模型生成文本嵌入。模型通過注意力機制整合視覺和文本特征,以此理解視覺元素與文本標記之間的關聯。

- 多模態AI能用于實時應用嗎?硬件和算法的不斷改進,使得實時多模態AI應用越來越可行。例如,實時視頻會議工具能將文本、圖像與音頻數據相結合,即時給出結果。

總結

人工智能正以迅猛之勢發展,多模態生成式人工智能在這個變革性領域中處于領先地位。先進的多模態AI架構,結合數據融合和跨模態學習技術,使這些模型能夠處理和生成跨越多種模態的復雜數據。其應用范圍極為廣泛,從自動駕駛汽車到面部情感檢測,從語音識別到能夠生成文本和圖像的復雜AI系統,無處不在。

盡管存在諸多挑戰,但持續的研究和實際應用不斷推動著多模態人工智能向前發展。通過在訓練方法、架構優化以及解決倫理問題等方面的持續進步,我們將在現實世界中見證更多富有創意的應用涌現。多模態人工智能無疑將成為未來科技發展的重要驅動力,深刻改變我們生活和工作的方方面面,值得我們持續關注與期待。

本文轉載自公眾號Halo咯咯 作者:基咯咯