經(jīng)驗之談:如何為你的機器學習問題選擇合適的算法?

隨著機器學習越來越流行,也出現(xiàn)了越來越多能很好地處理任務的算法。但是,你不可能預先知道哪個算法對你的問題是***的。如果你有足夠的時間,你可以嘗試所有的算法來找出***的算法。本文介紹了如何依靠已有的方法(模型選擇和超參數(shù)調(diào)節(jié))去指導你更好地去選擇算法。本文作者為華盛頓大學 eScience Institute 和 Institute for Neuroengineering 的數(shù)據(jù)科學博士后 Michael Beyeler。

步驟一:了解基本知識

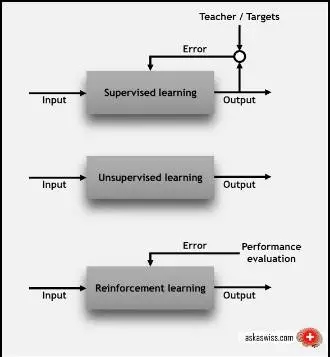

在我們深入學習之前,我們先重溫基礎知識。具體來說,我們應該知道機器學習里面三個主要類別:監(jiān)督學習,無監(jiān)督學習和強化學習。

1. 在監(jiān)督學習(supervised learning)中,每個數(shù)據(jù)點都會獲得標注,如類別標簽或與數(shù)值相關的標簽。一個類別標簽的例子:將圖片分類為「貓」或「狗」;數(shù)值標簽的例子如:預測一輛二手車的售價。監(jiān)督學習的目的是通過學習許多有標簽的樣本,然后對新的數(shù)據(jù)做出預測。例如,準確識別新照片上的動物(分類)或者預測二手車的售價(回歸)。

2. 在無監(jiān)督性學習(unsupervised learning)中,數(shù)據(jù)點沒有相關的標簽。相反,無監(jiān)督學習算法的目標是以某種方式組織數(shù)據(jù),然后找出數(shù)據(jù)中存在的內(nèi)在結(jié)構(gòu)。這包括將數(shù)據(jù)進行聚類,或者找到更簡單的方式處理復雜數(shù)據(jù),使復雜數(shù)據(jù)看起來更簡單。

3. 在強化學習(reinforcement learning)中,算法會針對每個數(shù)據(jù)點來做出決策(下一步該做什么)。這種技術在機器人學中很常用。傳感器一次從外界讀取一個數(shù)據(jù)點,算法必須決定機器人下一步該做什么。強化學習也適合用于物聯(lián)網(wǎng)應用。在這里,學習算法將收到獎勵信號,表明所做決定的好壞,為了獲得***的獎勵,算法必須修改相應的策略。

步驟二:對問題進行分類

接下來,我們要對問題進行分類,這包含兩個過程:

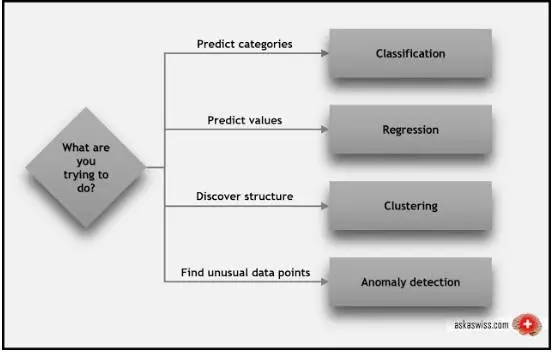

1. 根據(jù)輸入數(shù)據(jù)分類:如果我們的數(shù)據(jù)有標簽,這就是一個監(jiān)督學習問題;如果數(shù)據(jù)沒有標簽而且我們想找出數(shù)據(jù)的內(nèi)在結(jié)構(gòu),那這就是無監(jiān)督學習;如果我們想通過與環(huán)境交互來優(yōu)化目標函數(shù),這是強化學習。

2. 根據(jù)輸出結(jié)果分類:如果模型輸出結(jié)果是一個數(shù)值,這是回歸問題;如果輸出結(jié)果是一個類別,這是分類問題;如果輸出結(jié)果是一組輸入數(shù)據(jù),那這是聚類問題。

就是這么簡單!

更一般地說,我們可以詢問我們自己:我們的算法要實現(xiàn)什么目標,然后以此來找到正確的算法類別。

上面的描述包括了幾個我們還沒有提到的專業(yè)術語:

- 分類(classification):當使用數(shù)據(jù)來預測類別時,監(jiān)督學習也被叫做分類。比如將含有「貓」或「狗」的圖片識別出來,分類為「貓」或「狗」,這就是二分類問題(two-class or binomial classification)。當存在更多類別時(例如預測下一屆諾貝爾物理學家的獲得者是誰),這就是所謂的多分類問題(multi-class classification)。

- 回歸(regression):當要預測數(shù)值時(比如預測股價),監(jiān)督學習也被稱為回歸。

- 聚類(clustering):聚類或聚類分析(cluster analysis)是無監(jiān)督學習中最常見的方法之一。聚類是將一組對象以某種方式分組,使得同一組中的數(shù)據(jù)比不同組的數(shù)據(jù)有更多的相似性。

- 異常檢測(Anomaly detection):有時我們需要找出數(shù)據(jù)點中的異常點。例如,在欺詐檢測中,任何極不尋常的信用卡消費都是可疑的;欺詐具有大量不同的形式,而訓練樣本又非常少,使得我們不可能完全了解欺詐活動應該是什么樣。異常檢測所采取的方法就是了解正常情況下的表現(xiàn)行為(使用非欺詐交易的歷史數(shù)據(jù)),并識別出顯著不同的表現(xiàn)行為。

步驟三:尋找可用的算法

現(xiàn)在我們已經(jīng)將問題進行了分類,我們就可以使用我們所掌握的工具來識別出適當且實用的算法。

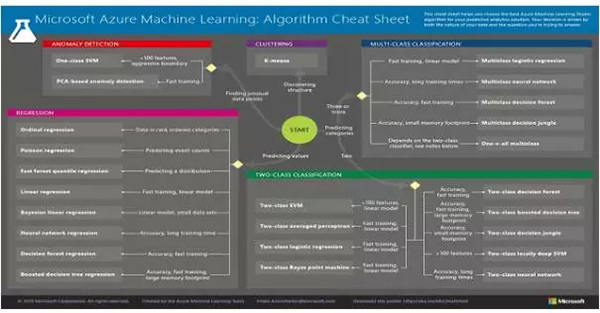

Microsoft Azure 創(chuàng)建了一個方便的算法列表,其展示了哪些算法可用于哪種類別的問題。雖然該表單是針對 Azure 軟件定制的,但它具有普遍的適用性(該表單的 PDF 版本可查閱 http://suo.im/3Ss2zW ):

一些值得注意的算法如下:

1. 分類:

- 支持向量機(SVM)可用于找到盡可能寬的分類的邊界。當兩個分類不能被清楚地分開時,該算法會找到其所能找到的***邊界。其真正的亮點在于處理特征密集的數(shù)據(jù),比如文本或者基因組(特征數(shù)量> 100)。在這些情況下,除了僅需要適量的記憶外,支持向量機(SVM)能夠比其它大多數(shù)算法更快且更少過擬合地進行分類。

- 人工神經(jīng)網(wǎng)絡是涵蓋二分類、多分類和回歸問題的腦啟發(fā)式學習算法。它們有***的種類,包括感知器和深度學習。它們需要很長時間來訓練,但已知其在多種應用領域都實現(xiàn)了當前***的表現(xiàn)。

- logistic 回歸:即便名字中有著「回歸」,但 logistic 回歸實際上是一種可用于二分類和多分類問題的強大工具。它快速且簡單。事實上,它使用「S」形曲線而非直線,所以它自然適合用于數(shù)據(jù)分組。logistic 回歸可以給出線性分類邊界,所以如果你要使用它,你一定要確保你能接受線性的近似。

- 決策樹和隨機森林:決策森林(decision forests)(回歸、二分類、多分類),決策叢林(decision jungles)(二分類和多分類)和提升決策樹(boosted decision trees)(回歸和二分類)都基于決策樹。這是一個基本的機器學習概念。決策樹有許多不同的變體,但它們都在做同樣的事情—將特征空間(feature space)細分為具有大致相同標簽的區(qū)域。這些區(qū)域可以是一致的類別或者恒定值,具體取決于你進行的是分類還是回歸。

2. 回歸:

- 線性回歸是將一條線(或平面、或超平面)擬合到一個數(shù)據(jù)集上。這是一種主要的工具,簡單且快速,但對于一些問題而言,它可能過于簡單。

- 貝葉斯線性回歸有著非常理想的特性:它可以避免過擬合。貝葉斯方法通過事先對答案的可能分布做出一些假設來做到這一點。這種方法的另一個副產(chǎn)品是它們具有非常少的參數(shù)。

- 提升決策樹回歸(Boosted decision tree regression):如上所述,提升決策樹(回歸和二分類)均基于決策樹,并通過將特征空間細分為具有大致相同標簽的區(qū)域發(fā)揮效用。提升決策樹通過限制其可以細分的次數(shù)以及每個區(qū)域中所允許的最少數(shù)據(jù)點來避免過擬合。該算法會構(gòu)造一個樹的序列,其中每棵樹都會學習彌補之前的樹留下來的誤差。這能得到一個會使用大量的內(nèi)存的非常精確的學習器。

3. 聚類:

- 層次聚類(Hierarchical Clustering)的目標是構(gòu)建聚類的層次結(jié)構(gòu),它有兩種形式。聚集聚類(agglomerative clustering)是一種「自下而上」的方法,其中每個觀察(observation)在其自己的聚類中開始,隨著其在層次中向上移動,成對的聚類會進行融合。分裂聚類(divisive clustering)則是一種「自上而下」的方法,其中所有的觀察都從一個聚類開始,并且會隨觀察向下的層次移動而遞歸式地分裂。整體而言,這里的融合和分裂是以一種激進的方式確定的。層次聚類的結(jié)果通常表示成樹狀圖(dendrogram)的形式。

- k-均值聚類(k-means clustering)的目標是將 n 組觀測值分為 k 個聚類,其中每個觀測值都屬于其接近的那個均值的聚類——這些均值被用作這些聚類的原型。這會將數(shù)據(jù)空間分割成 Voronoi 單元。

4. 異常檢測:

- k 最近鄰(k-nearest neighbors / k-NN)是用于分類和回歸的非參數(shù)方法。在這兩種情況下,輸入都是由特征空間中與 k 最接近的訓練樣本組成的。在 k-NN 分類中,輸出是一個類成員。對象通過其 k 最近鄰的多數(shù)投票來分類,其中對象被分配給 k 最近鄰中最常見的類(k 為一正整數(shù),通常較小)。在 k-NN 回歸中,輸出為對象的屬性值。該值為其 k 最近鄰值的平均值。

- 單類支持向量機(One-class SVM):使用了非線性支持向量機的一個巧妙的擴展,單類支持向量機可以描繪一個嚴格概述整個數(shù)據(jù)集的邊界。遠在邊界之外的任何新數(shù)據(jù)點都是非正常的,值得注意。

步驟四:實現(xiàn)所有適用的算法

對于任何給定的問題,通常有多種候選算法可以完成這項工作。那么我們?nèi)绾沃肋x擇哪一個呢?通常,這個問題的答案并不簡單,所以我們必須反復試驗。

原型開發(fā)***分兩步完成。在***步中,我們希望通過最小量的特征工程快速且粗糙地實現(xiàn)一些算法。在這個階段,我們主要的目標是大概了解哪個算法表現(xiàn)得更好。這個步驟有點像招聘:我們會盡可能地尋找可以縮短我們候選算法列表的理由。

一旦我們將列表減少至幾個候選算法,真正的原型開發(fā)開始了。理想情況下,我們會建立一個機器學習流程,使用一組經(jīng)過仔細選擇的評估標準來比較每個算法在數(shù)據(jù)集上的表現(xiàn)。在這個階段,我們只處理一小部分的算法,所以我們可以把注意力轉(zhuǎn)到真正神奇的地方:特征工程。

步驟五:特征工程

或許比選擇算法更重要的是正確選擇表示數(shù)據(jù)的特征。從上面的列表中選擇合適的算法是相對簡單直接的,然而特征工程卻更像是一門藝術。

主要問題在于我們試圖分類的數(shù)據(jù)在特征空間的描述極少。利如,用像素的灰度值來預測圖片通常是不佳的選擇;相反,我們需要找到能提高信噪比的數(shù)據(jù)變換。如果沒有這些數(shù)據(jù)轉(zhuǎn)換,我們的任務可能無法解決。利如,在方向梯度直方圖(HOG)出現(xiàn)之前,復雜的視覺任務(像行人檢測或面部檢測)都是很難做到的。

雖然大多數(shù)特征的有效性需要靠實驗來評估,但是了解常見的選取數(shù)據(jù)特征的方法是很有幫助的。這里有幾個較好的方法:

- 主成分分析(PCA):一種線性降維方法,可以找出包含信息量較高的特征主成分,可以解釋數(shù)據(jù)中的大多數(shù)方差。

- 尺度不變特征變換(SIFT):計算機視覺領域中的一種有專利的算法,用以檢測和描述圖片的局部特征。它有一個開源的替代方法 ORB(Oriented FAST and rotated BRIEF)。

- 加速穩(wěn)健特征(SURF):SIFT 的更穩(wěn)健版本,有專利。

- 方向梯度直方圖(HOG):一種特征描述方法,在計算機視覺中用于計數(shù)一張圖像中局部部分的梯度方向的 occurrence。

更多算法請參考:https://en.wikipedia.org/wiki/Visual_descriptor

當然,你也可以想出你自己的特征描述方法。如果你有幾個候選方法,你可以使用封裝好的方法進行智能的特征選擇。

1. 前向搜索:

- 最開始不選取任何特征。

- 然后選擇最相關的特征,將這個特征加入到已有特征;計算模型的交叉驗證誤差,重復選取其它所有候選特征;***,選取能使你交叉驗證誤差最小特征,并放入已選擇的特征之中。

- 重復,直到達到期望數(shù)量的特征為止!

2. 反向搜索:

- 從所有特征開始。

- 先移除最不相關的特征,然后計算模型的交叉驗證誤差;對其它所有候選特征,重復這一過程;***,移除使交叉驗證誤差***的候選特征。

- 重復,直到達到期望數(shù)量的特征為止!

- 使用交叉驗證的準則來移除和增加特征!

步驟六:超參數(shù)優(yōu)化

***,你可能想優(yōu)化算法的超參數(shù)。例如,主成分分析中的主成分個數(shù),k 近鄰算法的參數(shù) k,或者是神經(jīng)網(wǎng)絡中的層數(shù)和學習速率。***的方法是使用交叉驗證來選擇。

一旦你運用了上述所有方法,你將有很好的機會創(chuàng)造出強大的機器學習系統(tǒng)。但是,你可能也猜到了,成敗在于細節(jié),你可能不得不反復實驗,***才能走向成功。

原文:http://www.askaswiss.com/2017/02/how-to-choose-right-algorithm-for-your-machine-learning-problem.html

【本文是51CTO專欄機構(gòu)機器之心的原創(chuàng)譯文,微信公眾號“機器之心( id: almosthuman2014)”】