腦門貼張紙,騙過超強(qiáng)人臉識(shí)別系統(tǒng)!華為出品,F(xiàn)ace ID已陣亡

你知道嗎,在腦門上貼張符,AI就認(rèn)不出你了。

比如,這里有一個(gè)妹子,被人臉識(shí)別系統(tǒng)ArcFace發(fā)現(xiàn)了:

于是,她在腦門上貼了一張符。

人臉識(shí)別就不認(rèn)識(shí)她了,框框上的“Person_1”標(biāo)簽沒有了:

就算把光線調(diào)暗,這張符依然可以保護(hù)她,不被AI發(fā)現(xiàn)身份:

這樣,萬一哪天人類和AI打起來了,說不定還能逃過一劫呢 (誤) 。

畢竟,去年發(fā)表的ArcFace,在現(xiàn)有的公開FaceID系統(tǒng)里面,是最強(qiáng)大的一個(gè) (State-of-the-Art) 了。

而騙它的人,是來自莫斯科國立大學(xué)和華為莫斯科研究院的科學(xué)家。

他們的符上有特殊紋路,可以迷惑AI,這叫對(duì)抗攻擊。攻擊成本很低,符是普通的彩色打印機(jī)打出來的。

團(tuán)隊(duì)說,這是一個(gè)“很容易復(fù)現(xiàn) (Easily Reproducible) ”的方法,還不光對(duì)ArcFace這一只AI有效,可以遷移到其他AI上,騙無止境。

網(wǎng)友說:開個(gè)公司,可以量產(chǎn)了。

并且,畫符的算法已經(jīng)開源了,那大家都可以生成欺騙人臉識(shí)別AI的符了。

說不定有一天,監(jiān)控系統(tǒng)對(duì)陌生人出沒,就沒有抵抗力了。果然還是人類比較危險(xiǎn)。

那么,先來看看畫符的原理吧。

畫符的原理

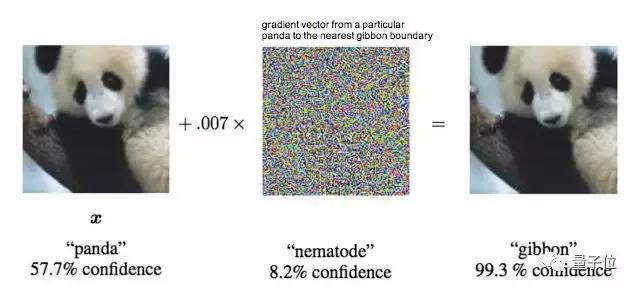

你可能聽說過,在圖像里加上一些噪聲,熊貓就變成了長臂猿:

對(duì)抗性攻擊在數(shù)字領(lǐng)域很容易實(shí)現(xiàn),但在真實(shí)世界中,對(duì)抗攻擊的效率大打折扣。

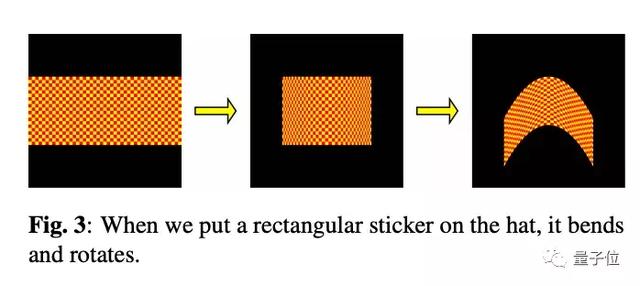

研究團(tuán)隊(duì)想到了一個(gè)方法,首先,他們琢磨出了一種新的離面變換方法,把一張平面矩形圖像彎曲成三維拋物線,再進(jìn)行旋轉(zhuǎn)。

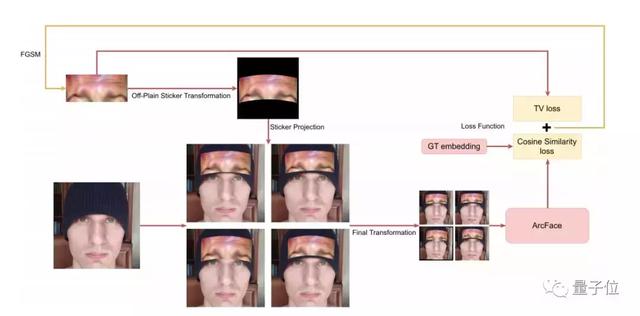

第二步,是把高質(zhì)量的人臉圖像投到變形后的“貼紙”上,并加入隨機(jī)噪聲。

然后,將由此獲得的圖像轉(zhuǎn)換為ArcFace的標(biāo)準(zhǔn)輸入。

最后,降低兩個(gè)參數(shù)的總和:初始矩形圖像的TV損失,和最后獲得的圖像的嵌入與ArcFace計(jì)算出來的錨嵌入之間的余弦相似性。

如此生成的對(duì)抗攻擊圖像,就不是一張平面的紙了,而是三維立體,能直接貼合人類腦門。

研究團(tuán)隊(duì)一開始完全隨機(jī)地加入噪聲。

在對(duì)抗樣本生成階段,他們采用的是具有動(dòng)量的多次迭代FGSM方法(Goodfellow提出的經(jīng)典對(duì)抗樣本生成方法)。攻擊分成兩個(gè)階段,第一階段的迭代步長為5/255,動(dòng)量為0.9;第二階段的迭代步長變成1/255,動(dòng)量為0.995。

在第一階段的100次迭代之后,使用最小二乘法,通過線性函數(shù)對(duì)最后100個(gè)驗(yàn)證值進(jìn)行插值。如果線性函數(shù)的斜率不小于0,則進(jìn)入攻擊的第二階段。

在第二階段的200次迭代之后,同樣進(jìn)行這一操作,如果線性函數(shù)的斜率不小于0,就停止攻擊。

有趣的現(xiàn)象出現(xiàn)了。

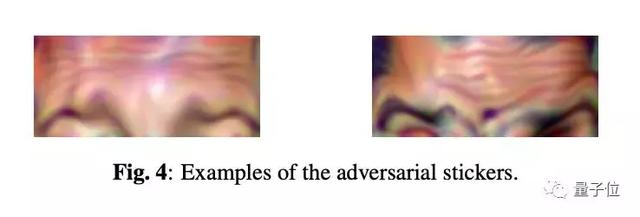

比較成功的對(duì)抗圖像,看上去都有點(diǎn)像人類的眉毛。

實(shí)際上,為了找到人臉的那個(gè)部位最適合投影到“貼紙”上,研究團(tuán)隊(duì)進(jìn)行了數(shù)字模擬實(shí)驗(yàn)。他們發(fā)現(xiàn)貼紙的位置較低時(shí)能得到更好的驗(yàn)證值。即使限制了貼紙的位置,強(qiáng)制它高于眼睛,貼紙也總是會(huì)向下移動(dòng)到更接近眼睛的位置。

而此前的研究也表明,眉毛是人類面部識(shí)別中最重要的特征。

不過最后生成的“貼紙”并不是通用的,是根據(jù)每個(gè)人的照片“私人定制”的。

團(tuán)隊(duì)請(qǐng)了10個(gè)人類,來測試定制效果。4女6男,結(jié)果如下:

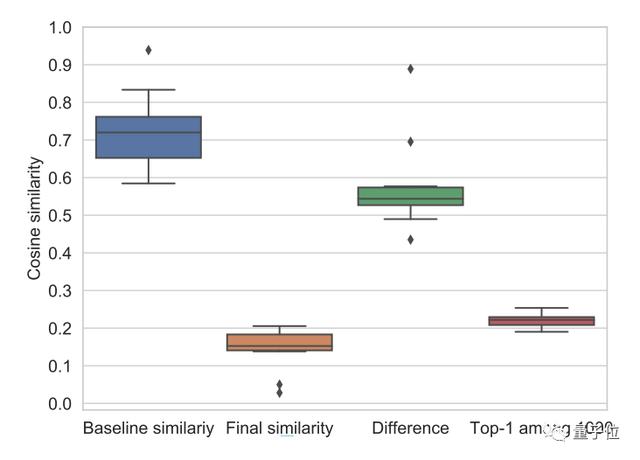

藍(lán)色,是一個(gè)人戴上普通帽子前后,AI判斷的類別相似度,在70%上下。

橙色,是一個(gè)人貼上對(duì)抗符前后,AI判斷的類別相似度,降到了20%以下。

定制成功,鑒定完畢。

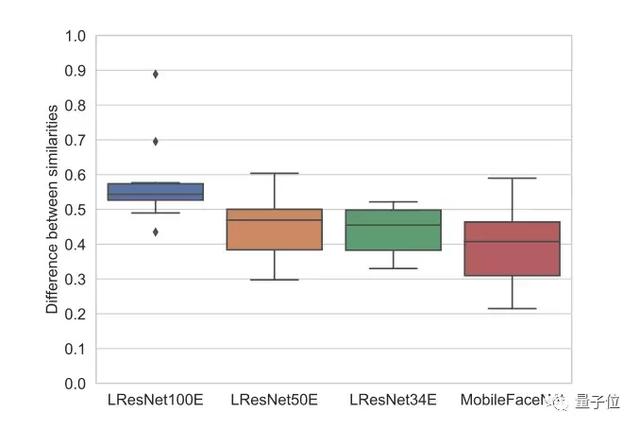

這套攻擊方法,不止是對(duì)ArcFace有效,其他的的Face ID模型也一樣扛不住。

△LResNet100E等模型基線相似度和被攻擊后的相似度之差

騙過AI一向不難

其實(shí),AI在對(duì)抗攻擊面前,一向沒什么抵抗力。

烏龜變步槍的舊事,這里不贅述,畢竟在那之后又有了許多先進(jìn)的玩法:

比利時(shí)魯汶大學(xué)的兩位少年,就曾經(jīng)拿一幅炫彩的對(duì)抗圖畫,擋在自己的肚子前面。

這樣,目標(biāo)檢測界的翹楚YOLOv2,不光看不出他們是人類,連那里有物體存在都發(fā)現(xiàn)不了。

優(yōu)秀的隱身衣,令人瑟瑟發(fā)抖。

另外,騰訊團(tuán)隊(duì)也曾經(jīng)用對(duì)抗圖,騙過一輛特斯拉。

一般情況,停車場里不會(huì)下雨的。但當(dāng)屏幕上出現(xiàn)了一種奇妙的圖案:

特斯拉的雨刷器就打開了。

并且,揮舞的節(jié)奏十分緊湊,仿佛AI看到的還不是綿綿細(xì)雨。

如果你覺得,開個(gè)雨刷器不算什么危險(xiǎn):

特斯拉的圖像處理工具,都是身兼數(shù)職的:追蹤其他車,追蹤物體和車道,為周圍環(huán)境畫地圖,以及估計(jì)雨量……

并且,騰訊團(tuán)隊(duì)還發(fā)現(xiàn),剛才這些任務(wù)里面,大多都是只靠單一神經(jīng)網(wǎng)絡(luò)完成的。

這不就是說,一掛掛一片?

而今天的主角,來自莫斯科的對(duì)抗符,一個(gè)高能之處在于:不是把圖案擺在面前,而是完全貼在臉上。

這就是說,經(jīng)過3D扭曲/拉伸的圖案,也可以用來欺騙AI。

其實(shí),擋在肚子前面的炫彩對(duì)抗圖出現(xiàn)之后,便有網(wǎng)友說最好印在T恤上,只是那時(shí)還不知道圖案能不能承受人體的拉伸。以現(xiàn)在的技術(shù),就做得到了。

另一個(gè)優(yōu)勢(shì)便是,它不止能欺騙一只AI,只要調(diào)調(diào)損失函數(shù),就可以遷移到其他AI上了,攻擊范圍十分廣泛。

不過,世界越來越危險(xiǎn),人臉識(shí)別顯得越來越脆弱,倒也不單是對(duì)抗攻擊的事。

福布斯的記者用3D打印的石膏人臉,破解了一眾流行旗艦手機(jī)的AI人臉識(shí)別解鎖功能;

騰訊又曾經(jīng)用一副眼鏡,攻破了蘋果的面部識(shí)別系統(tǒng)。

騙術(shù)日新月異,人臉識(shí)別AI,還是要變得更強(qiáng)大才行。

所以研究人員是希望,這個(gè)新的人臉識(shí)別對(duì)抗攻擊方法,可以用到人臉識(shí)別系統(tǒng)里,幫助各種FaceID系統(tǒng)進(jìn)化成更加魯棒、可以信賴的樣子。

來自華為莫斯科研發(fā)中心

這項(xiàng)研究的兩位作者Stepan Komkov和Aleksandr Petiushko,來自華為莫斯科研發(fā)中心。

目前,華為在俄羅斯擁有莫斯科和圣彼得堡兩大研發(fā)中心,另外還在籌備第三個(gè)研發(fā)中心,總共人數(shù)將破千,在俄羅斯科技行業(yè)能算得上是規(guī)模巨大的研發(fā)機(jī)構(gòu)了。

由于戰(zhàn)斗民族數(shù)學(xué)一向很好,因此在俄羅斯的研究中心主要面向算法研究,此前就有華為俄羅斯研究所的一名數(shù)學(xué)天才,打通了不同網(wǎng)絡(luò)制式之間的算法,幫助運(yùn)營商節(jié)省30%以上的成本。

論文傳送門:

https://arxiv.org/abs/1908.08705

代碼傳送門:

https://github.com/papermsucode/advhat