明確解釋:機(jī)器學(xué)習(xí)與統(tǒng)計(jì)建模有何不同

它們彼此之間非常不同,所有數(shù)據(jù)科學(xué)家都必須了解原因和方式!

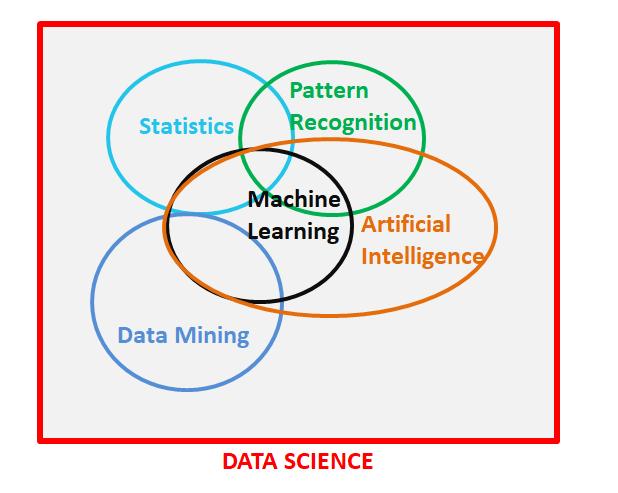

> Source: Inspired by a diagram from SAS Institute

這篇文章提出了一個(gè)非常重要的區(qū)別,我們應(yīng)該將其理解為數(shù)據(jù)科學(xué)領(lǐng)域的活躍部分。 上面的維恩圖最初是由SAS Institute發(fā)布的,但是它們的圖顯示統(tǒng)計(jì)和機(jī)器學(xué)習(xí)之間沒(méi)有重疊,據(jù)我所知,這是一個(gè)疏忽。 我已盡我所能和理解,重新創(chuàng)建了該圖。 該維恩圖非常恰當(dāng)?shù)靥岢隽藬?shù)據(jù)科學(xué)所有分支的區(qū)別和重疊。

我想相信數(shù)據(jù)科學(xué)現(xiàn)在是總稱,其他所有術(shù)語(yǔ)都可以描述為數(shù)據(jù)科學(xué)的分支,每個(gè)分支都是不同的,但與其他分支卻是如此相似!

機(jī)器學(xué)習(xí)與統(tǒng)計(jì)建模:這是一個(gè)古老的問(wèn)題,每個(gè)數(shù)據(jù)科學(xué)家/機(jī)器學(xué)習(xí)工程師或任何在這些領(lǐng)域開(kāi)始工作的人都會(huì)遇到。 在研究這些領(lǐng)域時(shí),有時(shí)機(jī)器學(xué)習(xí)感覺(jué)與統(tǒng)計(jì)建模息息相關(guān),這使我們想知道如何區(qū)分兩者,或者哪種標(biāo)簽最適合哪種模型。 當(dāng)然,如今機(jī)器學(xué)習(xí)已成為流行語(yǔ),但這并不意味著我們開(kāi)始將統(tǒng)計(jì)模型標(biāo)記為機(jī)器學(xué)習(xí)模型,因?yàn)榕c流行的看法相反,它們是不同的! 讓我們?cè)敿?xì)了解差異。

這篇文章的流程將是:

- 機(jī)器學(xué)習(xí)和統(tǒng)計(jì)建模的定義

- 機(jī)器學(xué)習(xí)與統(tǒng)計(jì)建模之間的差異

- 什么時(shí)候使用?

定義

機(jī)器學(xué)習(xí)

在不依賴于基于規(guī)則的編程的情況下,對(duì)將數(shù)據(jù)轉(zhuǎn)換為智能動(dòng)作的計(jì)算機(jī)算法開(kāi)發(fā)感興趣的研究領(lǐng)域稱為機(jī)器學(xué)習(xí)。

統(tǒng)計(jì)建模

通常將統(tǒng)計(jì)模型指定為一個(gè)或多個(gè)隨機(jī)變量與其他非隨機(jī)變量之間的數(shù)學(xué)關(guān)系。 因此,統(tǒng)計(jì)模型是"理論的形式表示"。

現(xiàn)在,無(wú)聊的冗長(zhǎng)的定義已不復(fù)存在,讓我們更深入地了解這兩個(gè)域之間的區(qū)別。

機(jī)器學(xué)習(xí)與統(tǒng)計(jì)建模之間的差異

1.歷史和學(xué)術(shù)相關(guān)性

在1950年代左右,機(jī)器學(xué)習(xí)開(kāi)始出現(xiàn)之前,統(tǒng)計(jì)建模就已經(jīng)出現(xiàn)了。1950年代,第一個(gè)機(jī)器學(xué)習(xí)程序—塞繆爾(Samuel)的檢查程序引入了。

世界各地的所有大學(xué)現(xiàn)在都在啟動(dòng)其機(jī)器學(xué)習(xí)和AI計(jì)劃,但并沒(méi)有關(guān)閉其統(tǒng)計(jì)部門。

機(jī)器學(xué)習(xí)與計(jì)算機(jī)科學(xué)系和獨(dú)立的AI系協(xié)同教學(xué),它們處理構(gòu)建預(yù)測(cè)算法,這些算法能夠通過(guò)學(xué)習(xí)從數(shù)據(jù)中"學(xué)習(xí)"而無(wú)需任何預(yù)先指定的規(guī)則,從而能夠自行"智能化"。 上面ML的定義。

鑒于

統(tǒng)計(jì)建模與數(shù)學(xué)系共同教授,其重點(diǎn)是建立模型,該模型可以首先找到不同變量之間的關(guān)系,然后可以預(yù)測(cè)可以描述為其他自變量的函數(shù)的事件。

2.不確定度容限

這是兩個(gè)域之間重要的區(qū)別點(diǎn)。

在統(tǒng)計(jì)建模中,我們要注意許多不確定性估計(jì)(例如置信區(qū)間,假設(shè)檢驗(yàn)),并且必須考慮到所有假設(shè)都必須滿足,才能信任特定算法的結(jié)果。 因此,它們具有較低的不確定性容限。

例如:如果我們建立了線性回歸模型,則在使用該模型的結(jié)果之前,必須檢查是否滿足以下假設(shè):

- 因變量和自變量之間的線性關(guān)系

- 錯(cuò)誤項(xiàng)的獨(dú)立性

- 錯(cuò)誤項(xiàng)(殘差)需要正態(tài)分布

- 平均獨(dú)立

- 無(wú)多重共線性

- 需要方差

相反,如果我們建立了邏輯模型,則必須考慮以下假設(shè):

- 二元邏輯回歸要求因變量為二進(jìn)制,而序數(shù)邏輯回歸要求因變量為序。

- 觀察結(jié)果必須彼此獨(dú)立。

- 無(wú)多重共線性

- 自變量和對(duì)數(shù)奇數(shù)的線性

鑒于

在機(jī)器學(xué)習(xí)算法中,幾乎沒(méi)有或不需要假設(shè)。 ML算法對(duì)統(tǒng)計(jì)線性,殘差的正態(tài)分布等沒(méi)有嚴(yán)格要求,因此比統(tǒng)計(jì)模型靈活得多。因此,它們具有較高的不確定性容限。

3.數(shù)據(jù)需求與方法

統(tǒng)計(jì)模型無(wú)法在非常大的數(shù)據(jù)集上進(jìn)行操作,它們需要屬性較少且觀測(cè)值數(shù)量可觀的可管理數(shù)據(jù)集。 在統(tǒng)計(jì)模型中,屬性的數(shù)量絕不會(huì)超過(guò)10–12,因?yàn)樗鼈儤O易過(guò)擬合(在訓(xùn)練數(shù)據(jù)集上表現(xiàn)出色,但在看不見(jiàn)的數(shù)據(jù)上表現(xiàn)差強(qiáng)人意,因?yàn)樗_實(shí)非常接近訓(xùn)練數(shù)據(jù)集,這是不希望出現(xiàn)的情況)

此外,大多數(shù)統(tǒng)計(jì)模型都遵循參數(shù)化方法(例如:線性回歸,邏輯回歸)

鑒于

機(jī)器學(xué)習(xí)算法是學(xué)習(xí)者算法,要學(xué)習(xí)它們需要大量數(shù)據(jù)。 因此,他們需要具有大量屬性和觀察結(jié)果的數(shù)據(jù)。 越大越好! ML算法在某種程度上需要大數(shù)據(jù)。

此外,大多數(shù)機(jī)器學(xué)習(xí)模型都遵循非參數(shù)方法(K最近鄰,決策樹(shù),隨機(jī)森林,梯度提升方法,SVM等)。

什么時(shí)候使用?

這主要取決于以下說(shuō)明的因素。 我們將講解理論上的要點(diǎn),并舉例說(shuō)明。

在以下情況下,統(tǒng)計(jì)模型應(yīng)該是您的首選:

- 不確定性很低,因?yàn)楫?dāng)您開(kāi)始構(gòu)建模型時(shí),大多數(shù)假設(shè)都已滿足

- 數(shù)據(jù)大小不是很大

- 如果要隔離少量變量的影響

- 總體預(yù)測(cè)中的不確定性/邊際誤差是可以的

- 各種自變量之間的相互作用相對(duì)較少,可以預(yù)先指定

- 需要高解釋性

機(jī)器學(xué)習(xí)可能是更好的選擇

- 當(dāng)要預(yù)測(cè)的結(jié)果沒(méi)有很強(qiáng)的隨機(jī)性時(shí); 例如,在視覺(jué)模式識(shí)別中,對(duì)象必須是E或不是E

- 可以對(duì)無(wú)限數(shù)量的精確重復(fù)進(jìn)行訓(xùn)練(例如,每個(gè)字母重復(fù)1000次或?qū)⒛硞€(gè)單詞翻譯成德語(yǔ))來(lái)訓(xùn)練學(xué)習(xí)算法

- 當(dāng)以整體預(yù)測(cè)為目標(biāo)時(shí),無(wú)法描述任何一個(gè)自變量的影響或變量之間的關(guān)系

- 人們對(duì)估計(jì)預(yù)測(cè)中的不確定性或所選預(yù)測(cè)器的影響不是很感興趣

- 數(shù)據(jù)量巨大

- 一個(gè)不需要隔離任何特殊變量的影響

- 低可解釋性,模型成為"黑匣子"是可以的

例如:如果您與一家信用卡公司合作,并且他們想建立一個(gè)跟蹤客戶流失的模型,那么他們很可能更喜歡一個(gè)統(tǒng)計(jì)模型,該模型將具有10–12個(gè)預(yù)測(cè)變量,他們可以根據(jù)自己的業(yè)務(wù)領(lǐng)域知識(shí)進(jìn)行解釋和否決 ,在這種情況下,他們將不會(huì)喜歡黑盒算法,因?yàn)閷?duì)可解釋性的需求比預(yù)測(cè)的準(zhǔn)確性更高。

另一方面,如果您正在為想要構(gòu)建強(qiáng)大的推薦引擎的Netflix和Amazon之類的客戶工作,那么在這種情況下,結(jié)果準(zhǔn)確性的要求高于模型的可解釋性,因此,機(jī)器學(xué)習(xí)模型將 在這里就足夠了。

有了這個(gè),我們到這篇文章的結(jié)尾。

您可以在以下文章中了解有關(guān)數(shù)據(jù)挖掘和機(jī)器學(xué)習(xí)之間的區(qū)別以及前4個(gè)機(jī)器學(xué)習(xí)算法的完整詳細(xì)信息:

- 明確解釋:機(jī)器學(xué)習(xí)與數(shù)據(jù)挖掘有何不同

- 定義,混淆,區(qū)別-全部說(shuō)明

- 明確解釋:4種機(jī)器學(xué)習(xí)算法

- 定義,目的,流行算法和用例-全部說(shuō)明

觀看此空間,以獲取有關(guān)機(jī)器學(xué)習(xí),數(shù)據(jù)科學(xué)和統(tǒng)計(jì)學(xué)的更多信息!

學(xué)習(xí)愉快:)