給卡車穿“隱身衣”,讓自動駕駛車撞上它:這場比賽,比誰攻得快

本文經AI新媒體量子位(公眾號ID:QbitAI)授權轉載,轉載請聯系出處。

自動駕駛算法,在這場比賽中成了實驗品:

24小時內,不僅要在特定的場景中,讓它被攻破;還要在競速情況下盡力優化它,讓車跑得更快。

如果這兩個方向均能脫穎而出,就能奪得第一名。

這是全球首個自動駕駛CTF (Capture The Flag,意為奪旗賽,一種網絡安全領域的技術競技)的比賽方式,參賽者是來自各地的知名CTF戰隊。

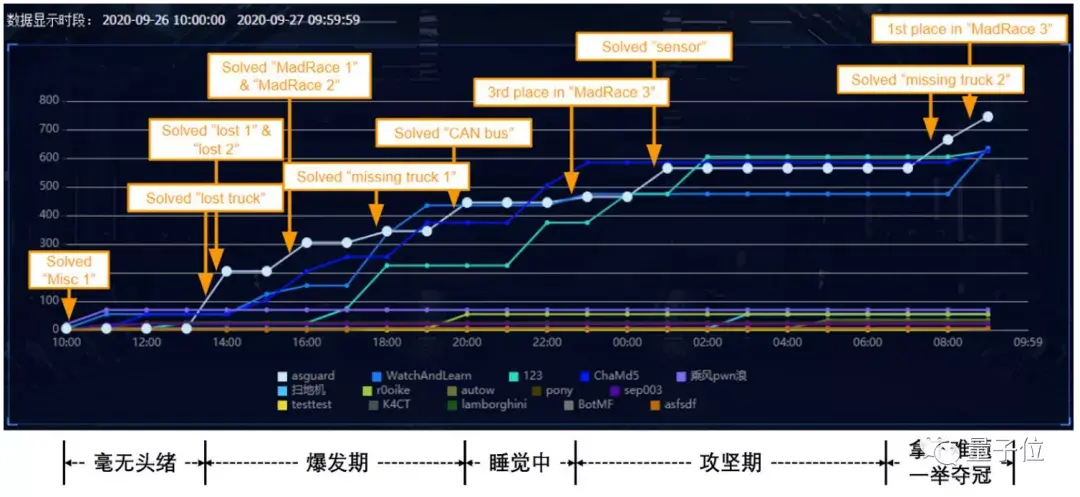

在9月26~27號的24小時里,加州大學爾灣分校(UCI)的小隊ASGuard脫穎而出,以745分的成績一舉奪魁。

一起來看看, 比賽中都有哪些題目。

比賽題目長啥樣

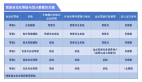

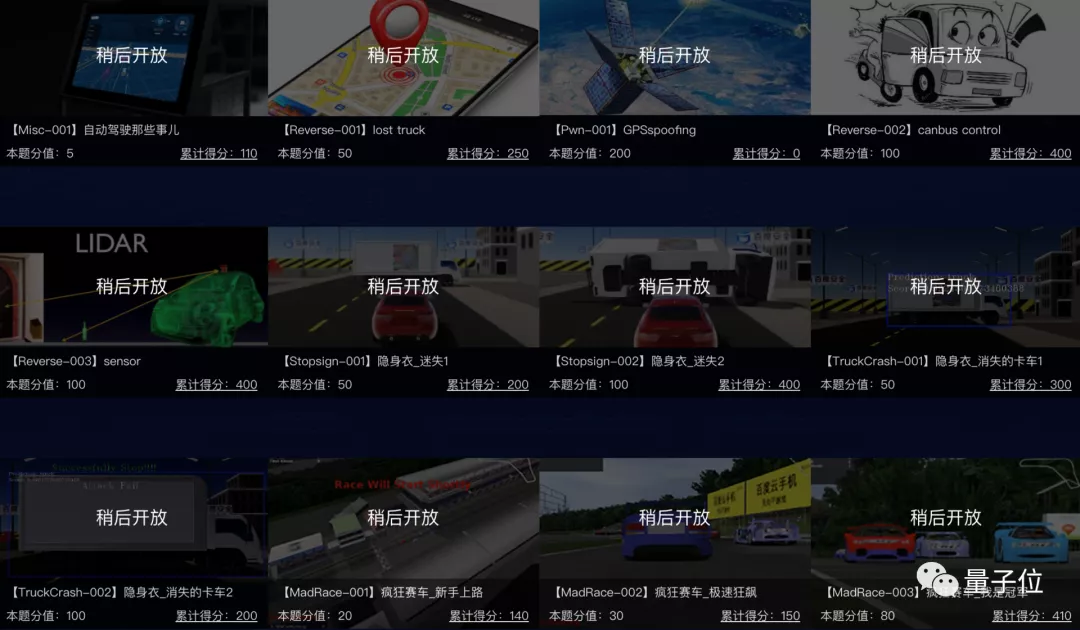

這次比賽包含了多種和自動駕駛安全密切相關的題型, 既有Binary,Reversing等傳統CTF賽題,也有機器學習安全(AML)和自動駕駛算法(Mad Race)等全新賽題。

從下圖可見,題目難度不小,“懸賞分”最高的題目是GPS欺騙,就沒有一個小組在限定時間內解出(累計得分0)。

部分題目具體的畫風,是下面這樣的:

到底是攻擊對手,還是讓自己跑更快?

如何在限定時間內,超越所有小隊的賽車,并獲得競速賽第一名?

這是競賽題目Mad Race的規則:

要求參賽隊伍實現自動駕駛的路線規劃和控制算法,跟其他隊伍同場競技,最快完成比賽者得最高分。

然而,也許是舉辦方“有意為之”,這題背后還隱藏著一個邪惡的獲勝方法:題目允許攻擊其他車輛的漏洞。

所以,比賽的方式不止一種。畢竟如果將路上的其他車輛都攻破了,那么自己的車子就穩操勝券了。

不過,獲勝團隊最后沒有選擇加入攻擊算法,而是集中全力提升了自己的路線規劃和控制算法,這也使得他們與第二名快速拉開了差距。

獲勝團隊表示,如果車輛優化得夠好,攻擊算法就追不上它,其實也能成為一種取勝策略。

一張“貼紙”,讓卡車消失

除此之外,自動駕駛算法的避障也是一個重要的技術。

所以,盡力騙過自動駕駛算法,讓它撞上障礙物,其實也是一種檢測算法漏洞的方法。

在名為消失的卡車題目中,參賽者需要提交Patch(一個圖像塊),系統把這個Patch貼到卡車車廂,并同時讓自動駕駛車輛逐漸靠近卡車,要求這期間,不能有一幀檢測到卡車。

說白了,就是利用特殊生成的圖片,騙過目標識別算法。

不過,也沒有這么簡單,因為參賽者提交的Patch不僅需要欺騙連續多幀的目標檢測,而且還需要考慮車輛行進軌跡中的視角和距離變化、傳感器噪聲、圖像預處理等技術。

畢竟,誰也無法預測自動駕駛算法會在什么時候、被什么樣的圖像“欺騙”。

在這道題目中,冠軍團隊讓生成的Patch具有更高的魯棒性,最終成功騙過了自動駕駛算法。

欺騙GPS:全場最難的題目

從得分來看,全場唯一沒有小組解出的題目,就是這道GPS欺騙 (GPS Spoofing)了。

這道題屬于Binary攻擊類型(二進制漏洞攻擊),是全場分數最高的一道題目,但無人解出。

題目要求參賽者攻擊一個服務器端的GPS Spoofing檢測程序,從而獲得服務器中Flag文件的內容。

這道題屬于傳統的CTF類型,它的難點在于,參賽者需要了解一種特定GPS數據的解析格式,并構建虛假的GPS數據,來觸發和利用該漏洞。

因此,要解決這道題,除了傳統的Binary攻擊技術,還必須要有自動駕駛中GPS傳感器的知識和經驗,大部分小組都被這一點難住了。

對于冠軍團隊來說,這次的遺憾應該在于沒能解出這道最難的題目。

“最后時刻,我們已經能構造需要的GPS數據格式、且找到了漏洞利用的注入點,無奈最后由于時間不足,未能完成,非常可惜。”

為何舉辦自動駕駛CTF

拼盡全力攻破自動駕駛算法,究竟有什么意義?

或許大家還記得今年6月,開啟AutoPilot的特斯拉,撞上側翻白色貨車的事故:

高速路上,一輛貨車側翻在地,后續來車紛紛避讓。

但一輛白色特斯拉Model 3,以110公里的時速,直接撞向了如此明顯的貨車障礙物。

針對這一類自動駕駛的安全事故,這次的CTF定位與實際生活中自動駕駛展現的安全問題密切相關。

例如,那道利用對抗樣本生成能讓白色卡車“消失”的Patch,就是自動駕駛中障礙物識別的一項極大挑戰。

而賽題的場景,就是從特斯拉在高速上的安全事故取材的。

畢竟,只有知道了攻擊自動駕駛算法的方法,才能更好地優化自動駕駛算法,讓車輛行駛更安全。

冠軍團隊介紹

這次比賽的冠軍團隊由6人組成,主要來自加州大學爾灣分校的ASGuard(Autonomous Sysems Guard)研究組,導師為Qi Alfred Chen,其中4名成員Junjie Shen、Takami Sato、Ningfei Wang和Ziwen Wan均為在讀博士生。

此外,還有一名來自清華大學的準一年級博士生Yunpeng Luo、以及目前在CMU就讀碩士、本科曾就讀于UCI的Zeyuan Chen。

而ASGuard研究組平時的研究方向,就是自動駕駛軟件安全。

ASGuard的組員也表示,參加這場比賽最大的獲勝點,是技能點、研究方向剛好覆蓋所有賽題類型。

因此,他們的團隊分工也非常明確,其中Junjie Shen,Ziwen Wan,Yunpeng Luo和Zeyuan Chen負責Binary、Reversing和Mad Race,而Takami Sato和Ningfei Wang則負責機器學習模型安全(AML)。

不過,這次的比賽對于冠軍組來說,也并非一帆風順。

可以看出,在最后的奪冠之前,團隊經歷了相當長時間的無進展期,但在最后時刻一舉解出兩道題目,最終反敗為勝。