黑科技檢測方法:利用心跳做信號,還能「揪出」造假模型

偽造人像視頻生成技術給社會帶來了新的威脅,例如利用逼真的偽造圖像和視頻進行政治宣傳、名人模仿、偽造證據以及其他與身份有關的操作。伴隨著這些生成技術的發展,出現了一些被證實有效的 deepfake 檢測方法,這些方法具備較高的分類準確率。然而,目前幾乎沒有任何工作關注 deepfake 視頻的來源(即生成 deepfake 視頻的模型)。

來自賓漢姆頓大學、英特爾公司的研究人員提出了一種方法,利用視頻中的生物信號檢測該視頻是否偽造。該方法不僅可以區分真假視頻,還能夠發現 deepfake 視頻背后的特定生成模型(其中,生成模型是在 DeepFakes、Face2Face、FaceSwap、NeuralTex 中進行選擇)。

一些純粹基于深度學習的方法嘗試使用 CNN 來分類造假視頻,CNN 實際上學習的是生成器的殘差。該研究認為這些殘差包含了更多的信息,可以通過將它們與生物信號分離來揭示偽造細節。觀察結果表明,生物信號中的時空模式可以看作是殘差的代表性投影。為了證明這一觀察結果的合理性,研究人員從真實和虛假視頻中提取 PPG 單元,并將其輸入到當前最優的分類網絡中,以檢測每個視頻的生成模型。

實驗結果表明,該方法對假視頻的檢測準確率為 97.29%,對假視頻背后生成模型的識別準確率為 93.39%。

論文地址:

https://arxiv.org/pdf/2008.11363.pdf

該論文的貢獻如下:

- 提出一種新型 deepfake 視頻源頭檢測方法,為 deepfake 檢測研究開啟了新的視角;

- 提出一項新發現:將生成噪聲投影到生物信號空間,可以為每個模型創建唯一標識;

- 提出一種先進的通用 deepfake 檢測器,在真假視頻分類方面優于現有方法,同時還能預測假視頻背后的生成模型,即源生成模型。

利用生物信號檢測假視頻及其生成模型

生物信號已被證明可以作為真實視頻的真實性標志,它也被用作 deepfake 檢測的重要生物標志。正如我們所知,假視頻中的合成人物無法具備與真視頻中人物類似的心跳模式。該研究的關鍵發現基于這一事實:這些生物信號可以被解釋為包含每個模型殘差標識變換的假心跳。這催生了對生物信號的新探索,它們不僅可以用來確定視頻的真實性,還可以對生成該視頻的源模型進行分類。

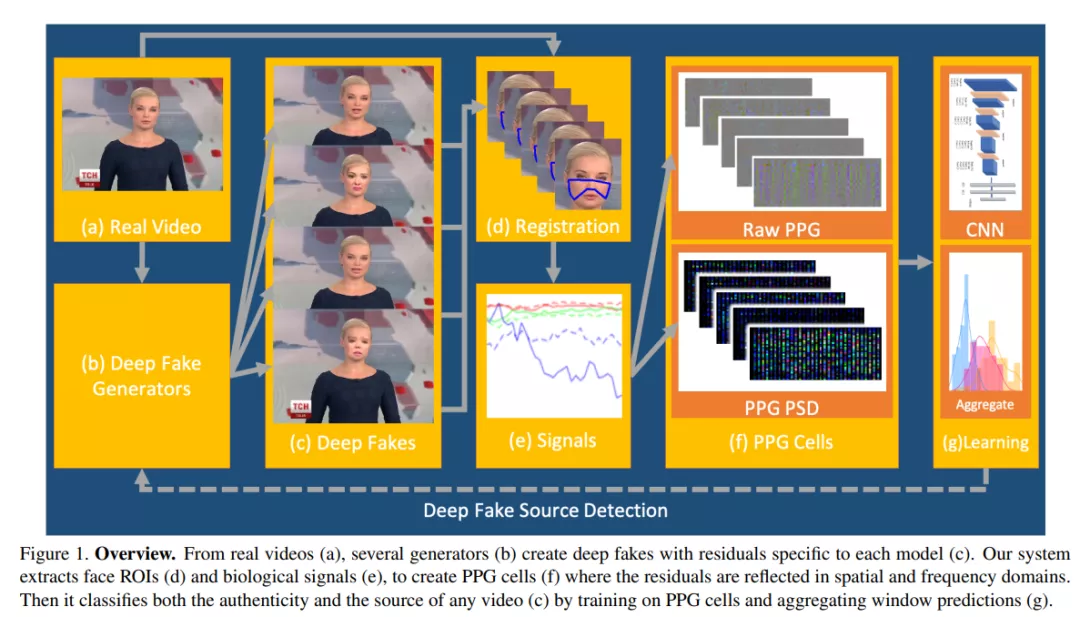

于是,該研究提出了既能檢測 deepfake 視頻,又能識別源生成模型的系統,如圖 1 所示:

為了連續地捕捉生物信號的特征,研究人員定義了一種新的時空塊——PPG 單元。該時空塊結合了多種原始的 PPG 信號及其功率譜,并從一個固定的窗口提取。PPG 單元的產生首先需要使用人臉檢測器在每一幀中找到人臉。

第二步是從檢測到的人臉中提取感興趣區域 (ROI)(圖 1d),該區域具有穩定的 PPG 信號。為了有效地提取,研究者使用眼睛和嘴之間的面部區域,以最大限度地增加皮膚暴露。

由于來自人臉不同區域的 PPG 信號之間存在相關性,因此定位 ROI 并測量其相關性成為檢測的關鍵步驟。

第三步需要將非線性 ROI 與矩形圖像對齊。該研究使用 Delaunay triangulation [26],隨后對每個矩形使用非線性仿射變換,從而將每個矩形轉換為校正圖像(rectified image)。

在第四步中,研究者將每個圖像分成 32 個相等大小的正方形,并在 ω 幀大小的固定窗口中計算每個正方形的原始 Chrom-PPG 信號,并且這不會干擾人臉檢測(圖 1e)。然后,計算校正圖像中的 Chrom-PPG,因為它能產生更可靠的 PPG 信號。對于每個窗口,現在有 ω × 32 個原始 PPG 值。

現在將它們重組成 32 行、ω 列的矩陣,就形成了 PPG 單元的基礎,如圖 1f 和圖 2 最下面一行的上半部分所示。

最后一步將頻域信息添加到 PPG 單元。計算窗口中每個原始 PPG 值的功率譜密度,并將其縮放到 ω 大小。

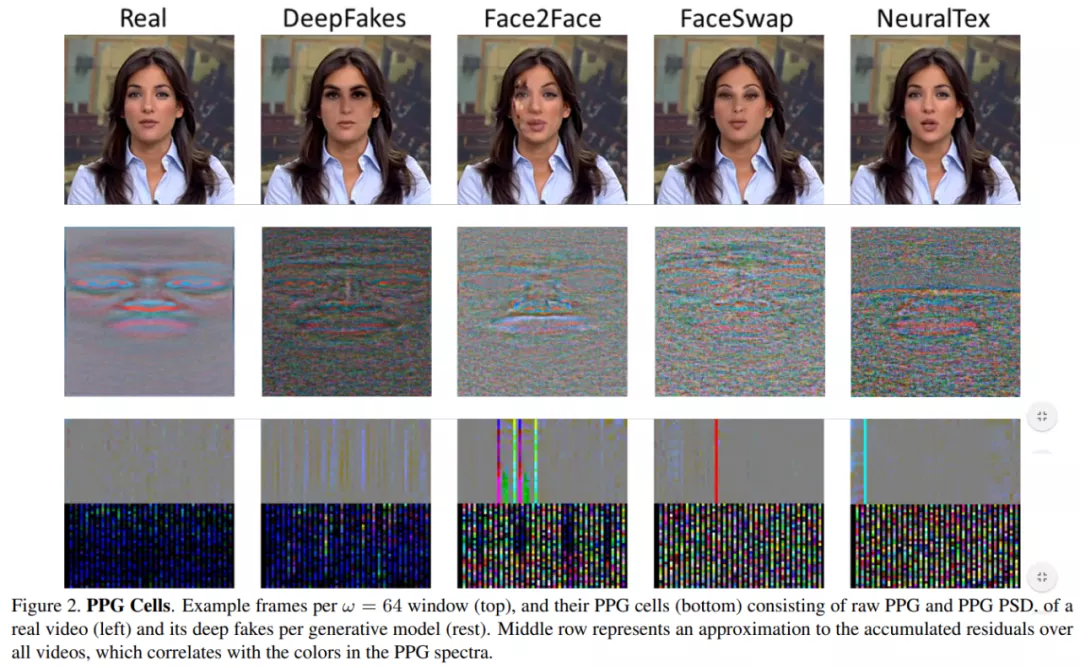

圖 2 的最下面一行顯示了從同一個窗口生成的 deepfake PPG 單元示例,第一行是每個窗口的示例幀。

定義完 PPG 單元后,研究者展示了其主要假設:將 deepfake 生成器的殘差投影到生物信號空間,可以創造一個獨特的模式,并用于檢測 deepfake 背后的源生成模型。

實驗

該研究提出的系統采用 Python 語言實現,使用 OpenFace 庫進行人臉檢測,OpenCV 進行圖像處理,使用 Keras 實現神經網絡。

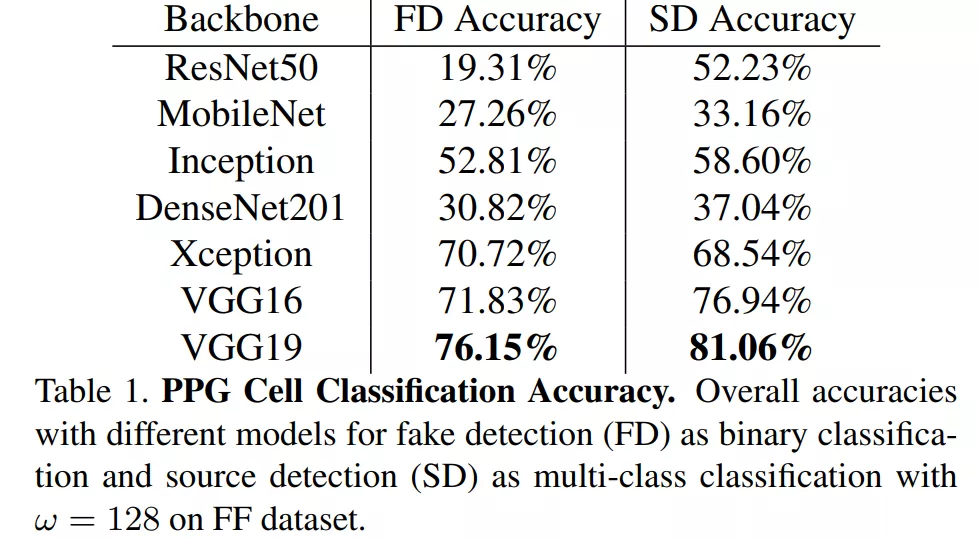

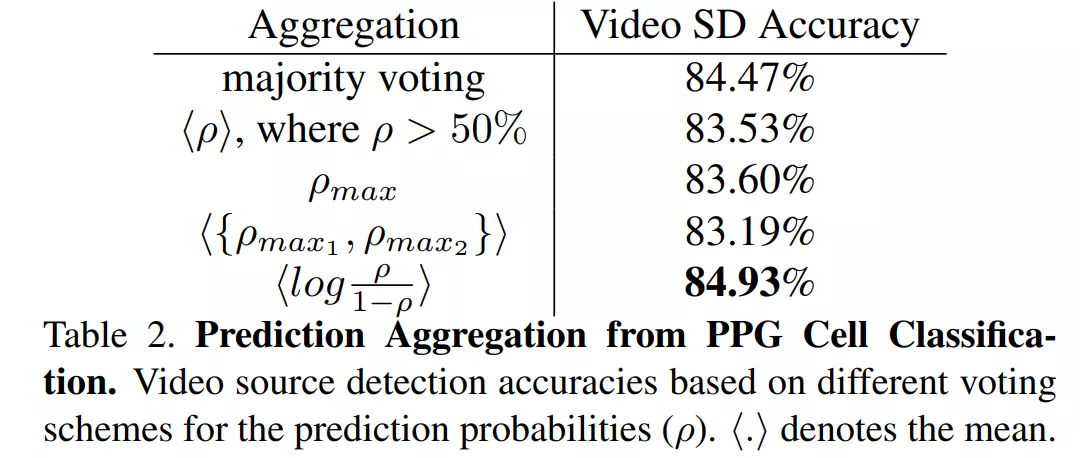

表 1 列出了在測試集上的 PPG 單元分類結果,其中 VGG19 在區分 4 種不同生成模型和檢測 FaceForensics++(FF)真實視頻方面達到了最高準確率(圖 1f)。像 DenseNet 和 MobileNet 這樣的復雜網絡由于過擬合,雖然達到了非常高的訓練準確率,但在測試集上的效果不如人意。

在視頻分類方面,表 2 記錄了過程中的不同投票方案。研究者設置 ω=128,比較了使用大多數投票、最高平均概率、兩個最高平均概率以及對數幾率平均后 VGG19 的單元預測結果。

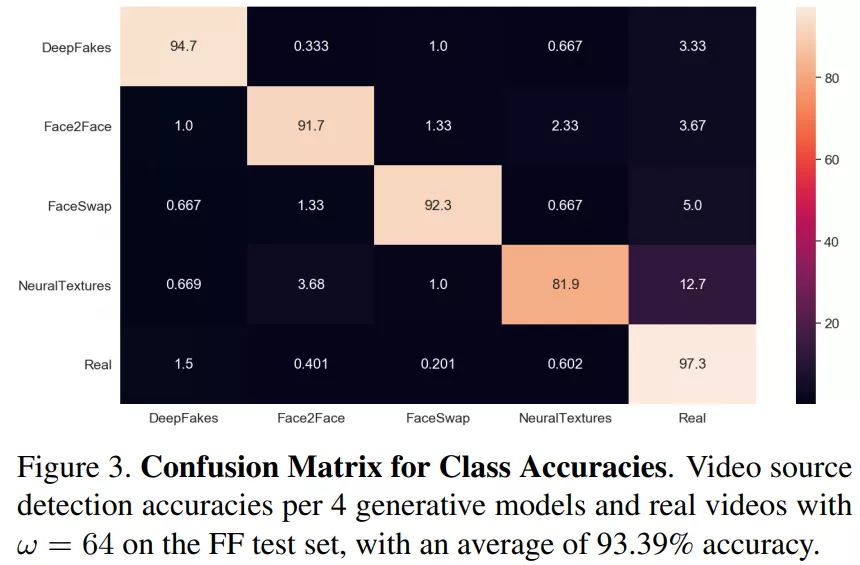

如圖 3 所示,該方法對五類 FF(1 個真視頻和 4 個假視頻)的真實視頻檢測率為 97.3%,對生成模型的檢測準確率至少為 81.9%。

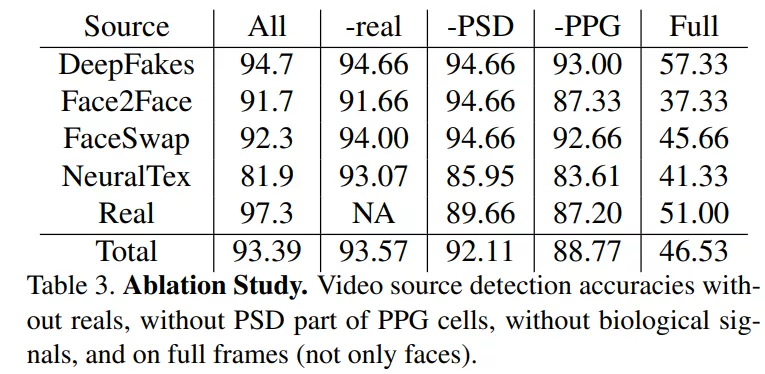

研究人員在不同的設置上進行訓練和測試:1)訓練集中沒有真實的視頻;2)PPG 單元中沒有功率譜;3)沒有生物信號;4)使用全幀而不是面部 ROI,其中 ω = 64,FF 數據集分割設為常數。結果見表 3:

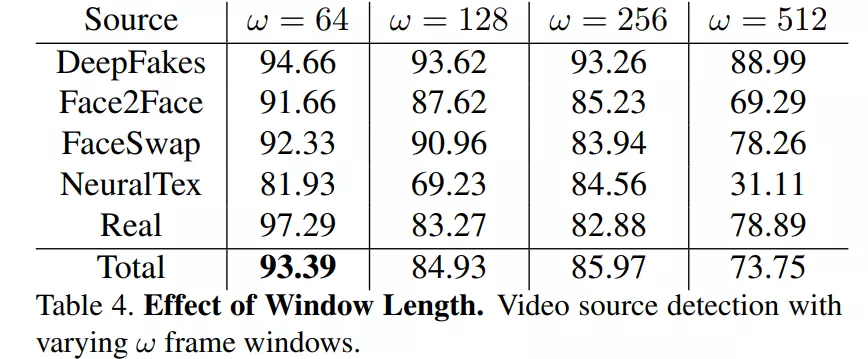

使用前述設置,用不同的窗口大小 ω = {64, 128, 256, 512} 幀來測試該論文提出的方法。結果參見下表 4:

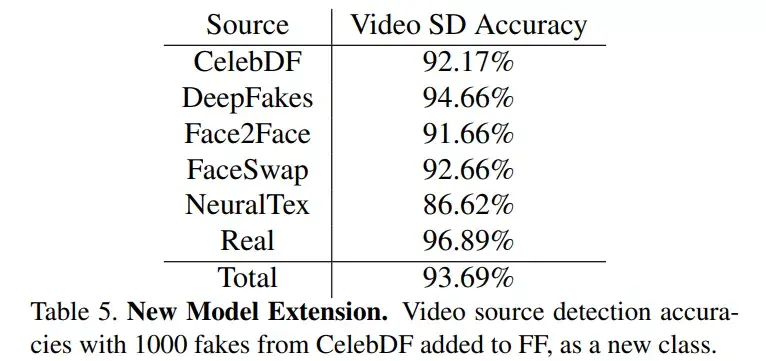

為了證明該論文提出的方法可以擴展到新模型,研究人員將 FF 設置與單個生成器數據集 CelebDF 相結合并重復分析過程。該研究提出的方法在整個數據集上達到了 93.69% 的檢測準確率,在 CelebDF 數據集上達到了 92.17% 的檢測準確率,這表明該方法可以泛化到新模型(參見表 5)。

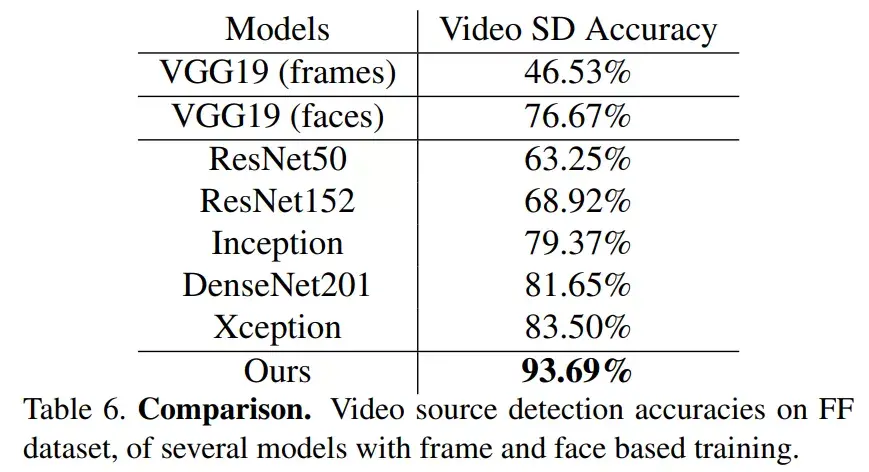

表 6 列出了測試集上不同模型的準確率。由結果可知,該論文提出的方法甚至超過了最復雜的網絡 Xception,準確率高出 10%。