微型機器學習:下一次AI革命

本文轉自雷鋒網,如需轉載請至雷鋒網官網申請授權。

由美國宇航局推動開始的電子產品小型化成為整個消費品行業(的趨勢)。現在我們把貝多芬的完整作品帶在領章上使用耳機聽。—天體物理學家、科學評論員尼爾-德格拉斯-泰森(Neil deGrasse Tyson)[......]超低功耗嵌入式設備的普及,再加上像TensorFlow Lite for Microcontrollers這樣的嵌入式機器學習框架的引入,將使人工智能驅動的物聯網設備大規模擴散。— 哈佛大學副教授 Vijay Janapa Reddi

嵌入式設備的微小機器學習(TinyML)概述

嵌入式設備的微小機器學習(TinyML)概述

這是關于微型機器學習系列文章的第一篇。本文的目的是向讀者介紹微型機器學習的理念及其未來的潛力。關于具體應用、實現和教程的深入討論將在該系列后續文章中進行。

簡介

在過去的十年里,由于處理器速度的提高和大數據的出現,我們見證了機器學習算法的規模成倍增長。最初,模型小到可以使用中央處理單元(CPU)內的一個或多個內核在本地機器上運行。

不久之后,使用圖形處理單元(GPU)進行計算成為處理較大數據集的必要條件,并且由于引入了基于云的服務,如SaaS平臺(如Google Colaboratory)和IaaS(如Amazon EC2 Instances),變得更加容易實現。此時,算法仍然可以在單機上運行。

最近,我們看到了專門的應用專用集成電路(ASIC)和張量處理單元(TPU)的發展,它們可以包裝出約8個GPU的功率。這些設備已經增強了在多個系統之間分布式學習的能力,以嘗試建立得到更多更大的模型。

最近,隨著GPT-3算法(2020年5月發布)的發布,這種情況達到了頂峰,它擁有一個包含1750億個神經元的驚人網絡架構—比人類大腦中存在的神經元數量(約850億)多出一倍。這比有史以來創建的下一個最大的神經網絡Turing-LG(2020年2月發布,包含約175億個參數)的神經元數量多10倍以上。有估計稱,該模型的訓練成本約為1000萬美元,耗電量約為3GWh(約為三座核電站一小時的發電量)。

雖然GPT-3和Turing-LG取得的成績值得稱贊,當然也自然導致了一些業內人士對人工智能行業日益增長的碳足跡提出了批評。不過,這也有助于激發人工智能學界對更加節能計算的興趣。這樣的想法,比如更高效的算法、數據表示和計算,幾年來一直是一個看似不相關領域的焦點:微型機器學習。

微型機器學習(tinyML)是機器學習和嵌入式物聯網(IoT)設備的交叉領域。該領域是一門新興的工程學科,有可能給許多行業帶來革命性的變化。

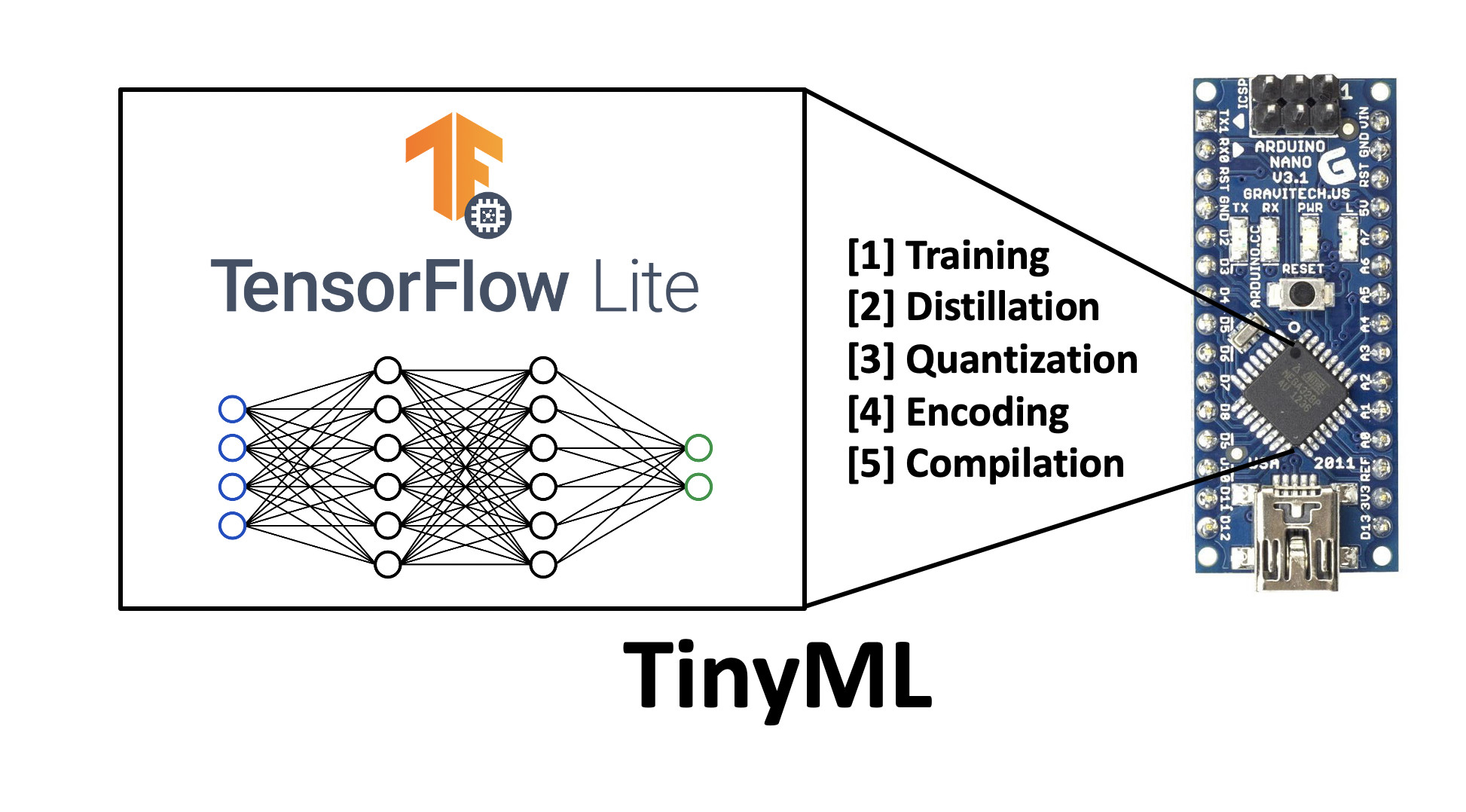

tinyML的主要行業受益者是在邊緣計算和節能計算領域。TinyML源于物聯網(IoT)的概念。傳統的物聯網概念是將數據從本地設備發送到云端進行處理。一些人對這個概念提出了一定的擔憂:包括隱私、延遲、存儲和能效等等。

能源效率。傳輸數據(通過電線或無線)是非常耗能的,比機載計算(具體來說是乘積單元)耗能約一個數量級。開發能夠自己進行數據處理的物聯網系統是最節能的方法。AI先驅們討論這種 "以數據為中心 "的計算理念(相對于云模式的 "以計算為中心")已經有一段時間了,現在我們開始看到它的發揮。

隱私。傳輸數據可能會被侵犯隱私。這些數據可能會被惡意行為者攔截,而且當數據被儲存在一個單一的位置(如云端)時,其本質上變得不那么安全。通過將數據主要保存在設備上并盡量減少通信,這可以提高安全性和隱私性。

存儲。對于很多物聯網設備來說,它們獲取的數據是沒有價值的。想象一下,一個監控攝像頭每天24小時記錄一棟大樓的入口。在一天中的很大一部分時間里,攝像頭的錄像是沒有用處的,因為沒有任何事情發生。通過擁有一個更智能的系統,只有在必要的時候才會激活,就需要更低的存儲容量,并減少傳輸到云端所需的數據量。

延時。對于標準的物聯網設備,比如亞馬遜Alexa,這些設備將數據傳輸到云端進行處理,然后根據算法的輸出返回響應。從這個意義上說,該設備只是通向云模型的便捷網關,就像自己和亞馬遜服務器之間的信鴿。這個設備很笨,完全依靠網速來產生結果。如果你的網絡速度很慢,亞馬遜的Alexa也會變得很慢。對于具有板載自動語音識別功能的智能物聯網設備來說,由于減少了(甚至沒有)對外部通信的依賴,所以延遲會降低

這些問題導致了邊緣計算的發展,即在邊緣設備(位于云的 "邊緣 "的設備)上執行處理活動的想法。這些設備在內存、計算和功率方面受到資源的高度限制,從而引發了更高效的算法、數據結構和計算方法的發展。

這樣的改進也適用于更大的模型,這可能會使機器學習模型的效率提高一個數量級,而對模型的準確性沒有影響。舉個例子,微軟開發的 Bonsai 算法可以小到 2 KB,但其性能甚至可以比典型的 40 MB kNN 算法,或者 4 MB 神經網絡更好。這個結果聽起來可能并不重要,但在大小只有1/10000的模型上,同樣的精度是相當驚人的。這么小的模型可以在Arduino Uno上運行,Arduino Uno的可用內存為2 KB,簡而言之,你現在可以在一個5美元的微控制器上建立這樣一個機器學習模型。

我們正處在一個有趣的十字路口,機器學習正在兩種計算范式之間分叉:以計算為中心的計算和以數據為中心的計算。在以計算為中心的范式中,數據是由數據中心的實例進行儲備和分析的,而在以數據為中心的范式中,處理是在數據的原始本地完成的。雖然我們似乎正在迅速走向以計算為中心范式的上限,但以數據為中心范式的工作才剛剛開始。

在現代世界中,物聯網設備和嵌入式機器學習模型正變得越來越無處不在(預計到2020年底,活躍設備將超過200億臺)。其中很多你可能根本沒有注意到。智能門鈴、智能恒溫器、當你說兩句話時就會 "喚醒 "的智能手機,甚至只是拿起手機。本文的剩余部分將更深入地關注 tinyML 的工作原理,以及當前和未來的應用。

云端的層次結構(資源:eBizSolutions)

云端的層次結構(資源:eBizSolutions)

TinyML的例子

之前,復雜的電路是設備執行各種動作的必要條件。現在,機器學習使得將這種硬件 "智能 "抽象成軟件的可能性越來越大,使得嵌入式設備越來越簡單、輕巧、靈活。

嵌入式設備中的機器學習應用所面臨的挑戰是相當大的,但在這一領域已經取得了很大的進展。在微控制器上部署神經網絡的關鍵挑戰是低內存占用、有限的功率和有限的計算。

也許TinyML最明顯的例子是在智能手機內。這些設備永遠主動聆聽 "喚醒詞",如Android智能手機的 "Hey Google",或iPhone上的 "Hey Siri"。通過智能手機的主要中央處理單元(CPU)來運行這些活動,現代iPhone的CPU主頻為1.85GHz,將在短短幾個小時內耗盡電池。對于大多數人每天最多使用幾次的東西來說,這種程度的消耗是不可接受的。

為了解決這個問題,開發者們創造了專門的低功耗硬件,能夠由小電池(如圓形CR2032 "硬幣 "電池)供電。這使得這些電路即使在CPU不運行時也能保持活躍,基本上只要屏幕不亮就可以。

這些電路的功耗可以低至1毫瓦,使用標準CR2032電池可以供電長達一年。

看上去似乎不像是,但這是個大問題。能源是許多電子設備的限制因素。任何需要市電的設備都被限制在有線路的地點,當十幾個設備出現在同一個地點時,很快就會變得不堪重負。市電是低效且昂貴的。將市電電壓(在美國的工作電壓約為120V)轉換為典型的電路電壓范圍(通常為約5V),會浪費大量的能源。任何有筆記本充電器的人在拔掉充電器時可能都會知道這一點。在電壓轉換過程中,充電器內部變壓器產生的熱量在電壓轉換過程中被浪費掉了能量。

即使是帶電池的設備也會受到電池壽命有限的影響,這就需要頻繁的對接。很多消費類設備的設計都是電池只能維持一個工作日。TinyML設備可以用硬幣大小的電池繼續工作一年,這意味著它們可以被放置在偏遠的環境中,只有在必要時才進行通信以節約能源。

喚醒詞并不是我們看到的唯一無縫嵌入智能手機的TinyML。加速計數據被用來判斷是否有人剛剛拿起手機,從而喚醒CPU并打開屏幕。

顯然,這些并不是TinyML唯一可能的應用。事實上,TinyML為企業和業余愛好者提供了許多令人興奮的機會,可以生產出更智能的物聯網設備。在一個數據變得越來越重要的世界里,將機器學習資源分配到遠程位置中受內存限制設備的能力可能會對數據密集型行業產生巨大的好處,如農業、天氣預測或地震學。

毫無疑問,賦予邊緣設備以執行數據驅動處理的能力,將為工業流程帶來模式轉變。舉個例子,如果設備能夠監測農作物,并在檢測到土壤濕度、特定氣體(例如,蘋果成熟時會釋放乙烷)或特定大氣條件(例如,大風、低溫或高濕度)等特征時發出 "幫助 "信息, 將極大地促進作物生長,從而提高作物產量。

作為另一個例子,智能門鈴可能會安裝一個攝像頭,可以使用面部識別來確定誰在現場。這可以用于安全目的,甚至可以用于當有人在場時將門鈴的攝像頭輸送到房屋中的電視,以便居民知道誰在門口。

tinyML目前主要關注的兩個方面是:

關鍵字發現。大多數人已經熟悉這個應用程序。"Hey Siri "和 "Hey Google "是關鍵詞的例子(通常與“ hotword”或“ wake word”同義使用)。這類設備連續聆聽來自麥克風的音頻輸入,并被訓練成只對特定的聲音序列做出反應,而這些聲音序列與學習到的關鍵詞相對應。這些設備比自動語音識別(ASR)應用更簡單,利用的資源也相應較少。某些設備(例如Google智能手機)利用級聯架構來提供揚聲器驗證以確保安全性。

視覺喚醒詞。有一種基于圖像的類似于喚醒詞的方法,稱為視覺喚醒詞。把這些詞看作是對圖像的二進制分類,以說明某些東西要么存在,要么不存在。例如,一個智能照明系統可能被設計成當它檢測到一個人的存在時啟動,當他們離開時關閉。同樣,野生動物攝影師可以利用這一點在特定的動物存在時拍照, 或者當他們發現有人時,可以使用安全攝像機拍攝照片。

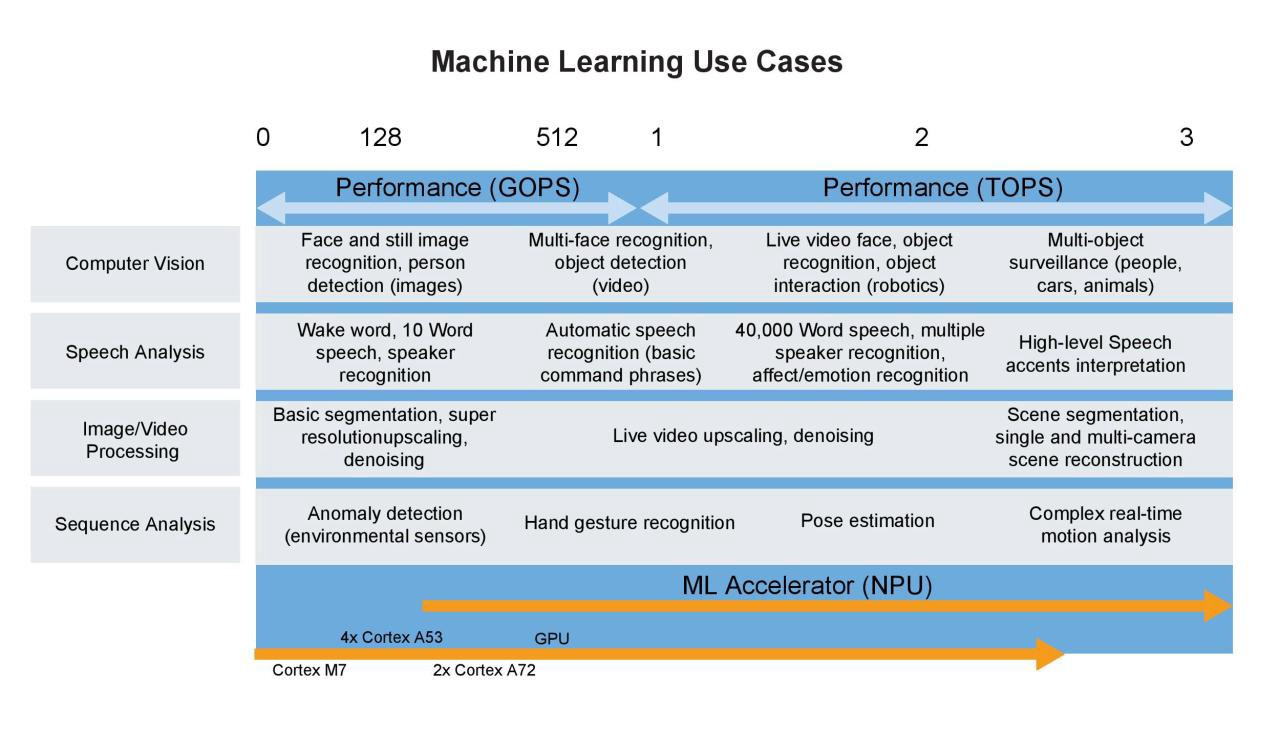

下面是TinyML當前機器學習使用案例的更廣泛概述。

TinyML的機器學習用例(來源圖片:NXP)。

TinyML的機器學習用例(來源圖片:NXP)。

TinyML如何工作?

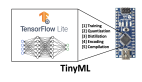

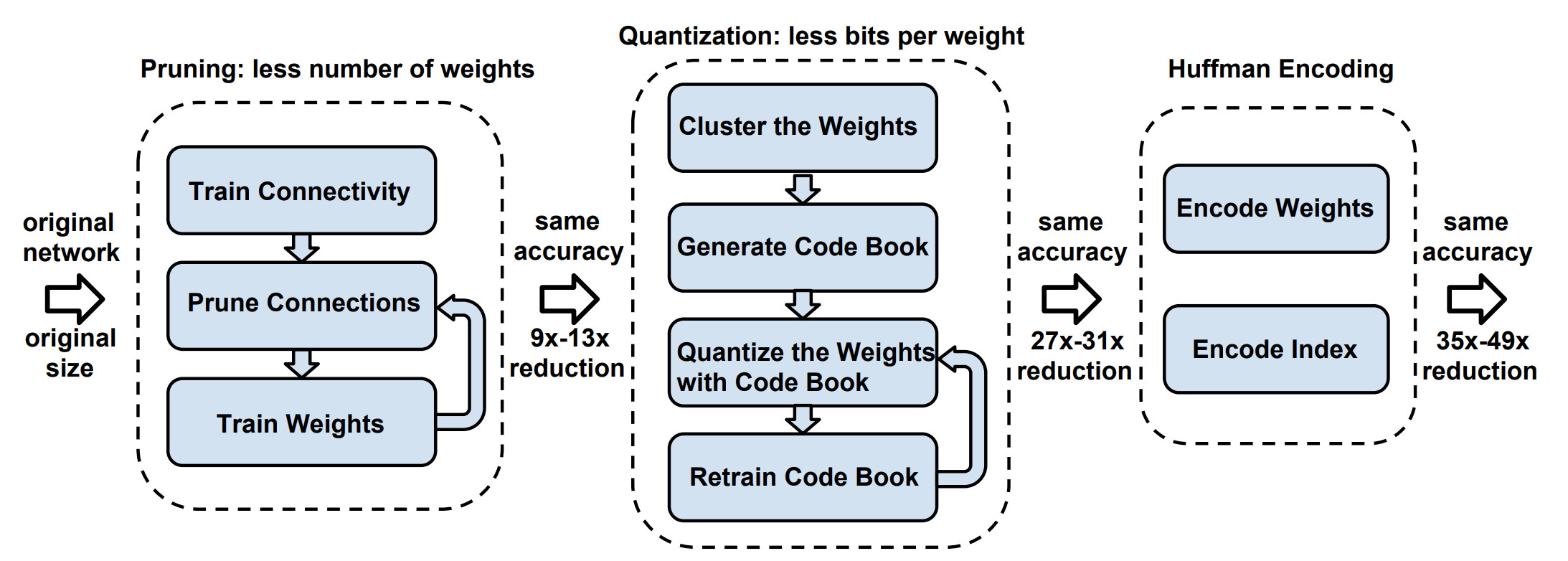

TinyML算法的工作方式與傳統的機器學習模型基本相同。通常情況下,模型是在用戶的計算機上或云端進行常規訓練。訓練后才是真正的tinyML工作開始的地方,這個過程通常被稱為深度壓縮。

深度壓縮過程示意圖。來源:ArXiv。

深度壓縮過程示意圖。來源:ArXiv。

模型蒸餾

訓練后,然后以創建具有更緊湊表示形式的模型的方式改變模型。剪枝和知識蒸餾是用于此目的的兩種此類技術。

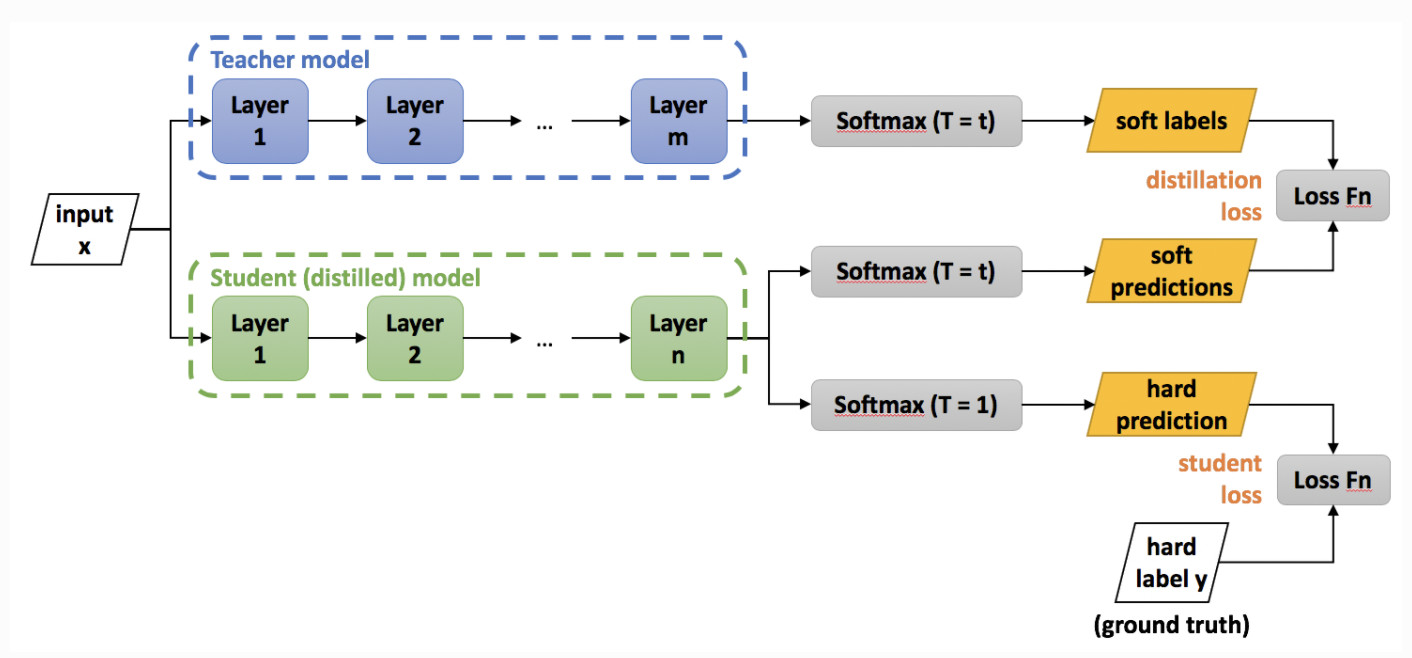

知識蒸餾的基本思想是,大型網絡內部具有一定的稀疏性或冗余性。雖然大型網絡具有較高的表征能力,但如果網絡容量沒有飽和,它可以在一個較小的網絡中以較低的表征能力(即較少的神經元)來表示。Hinton等(2015)將教師模型中的嵌入信息稱為 "暗知識",以轉移到學生模型中去。

下圖說明了知識蒸餾的過程。

深度壓縮過程的示意圖。在這個圖中,"老師 "是一個訓練有素的卷積神經網絡模型。教師的任務是將其 "知識 "轉移到一個參數較少的卷積網絡模型,即 "學生 "身上。這個過程被稱為知識蒸餾,用于將相同的知識封裝在一個較小的網絡中,提供了一種壓縮網絡的方法,使它們可以在更多內存限制的設備上使用。來源:ArXiv。

在這張圖中,"老師 "是一個經過訓練的神經網絡模型。老師的任務是將其 "知識 "轉移到一個參數較少的小網絡模型—"學生 "身上。這個過程用于將相同的知識封裝在一個較小的網絡中,提供了一種壓縮知識表示的方法,從而壓縮了神經網絡的大小,使它們可以在更多的內存限制的設備上使用。

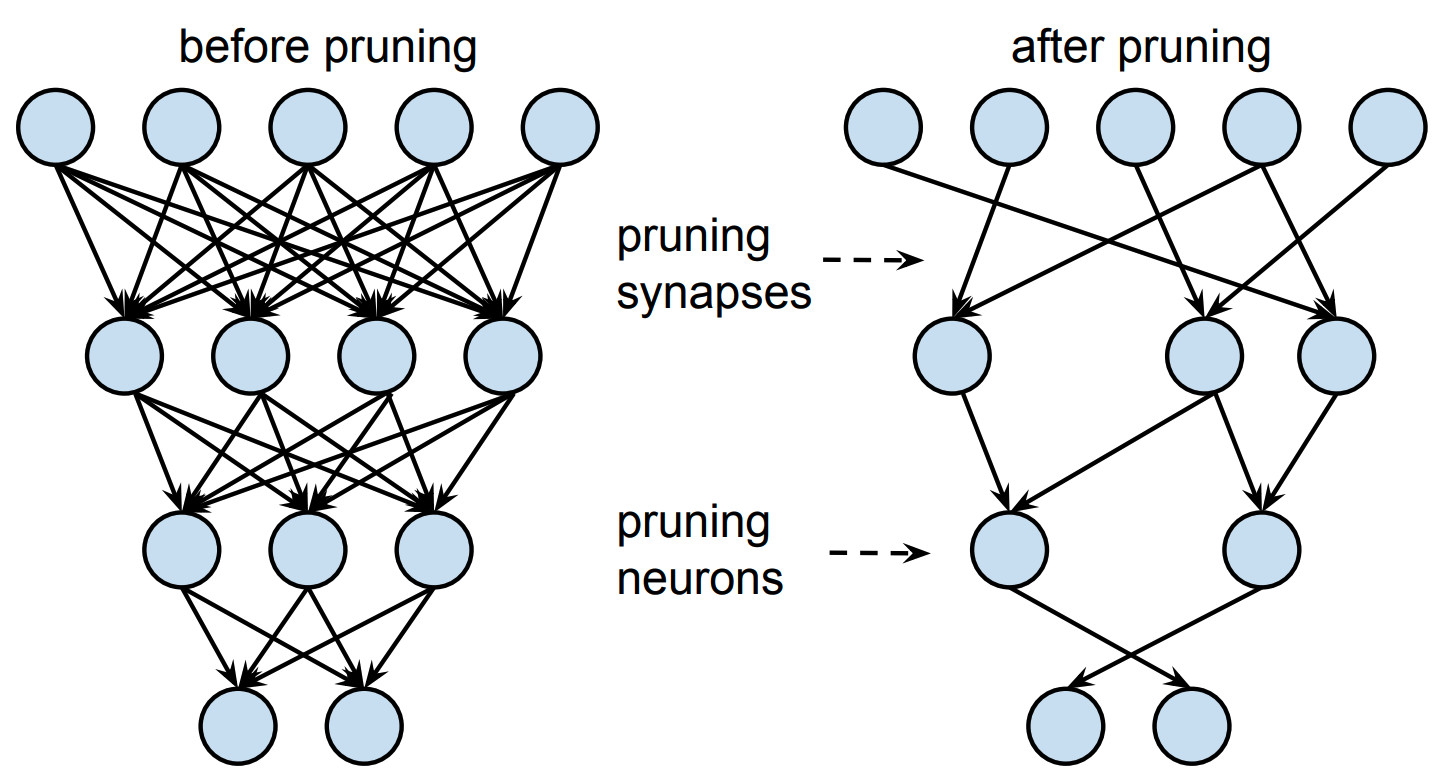

同樣,修剪也有助于使模型的表示更加緊湊。廣義上講,剪枝試圖去除那些對輸出預測提供很少效用的神經元。這通常與小的神經權重有關,而大的權重則由于其在推理過程中的重要性更大而被保留。然后在修剪后的架構上對網絡進行再訓練,以微調輸出。

為提煉模型的知識表征而進行修剪的示意圖

量化

經過蒸餾,模型在訓練后被量化為與嵌入式設備架構兼容的格式。

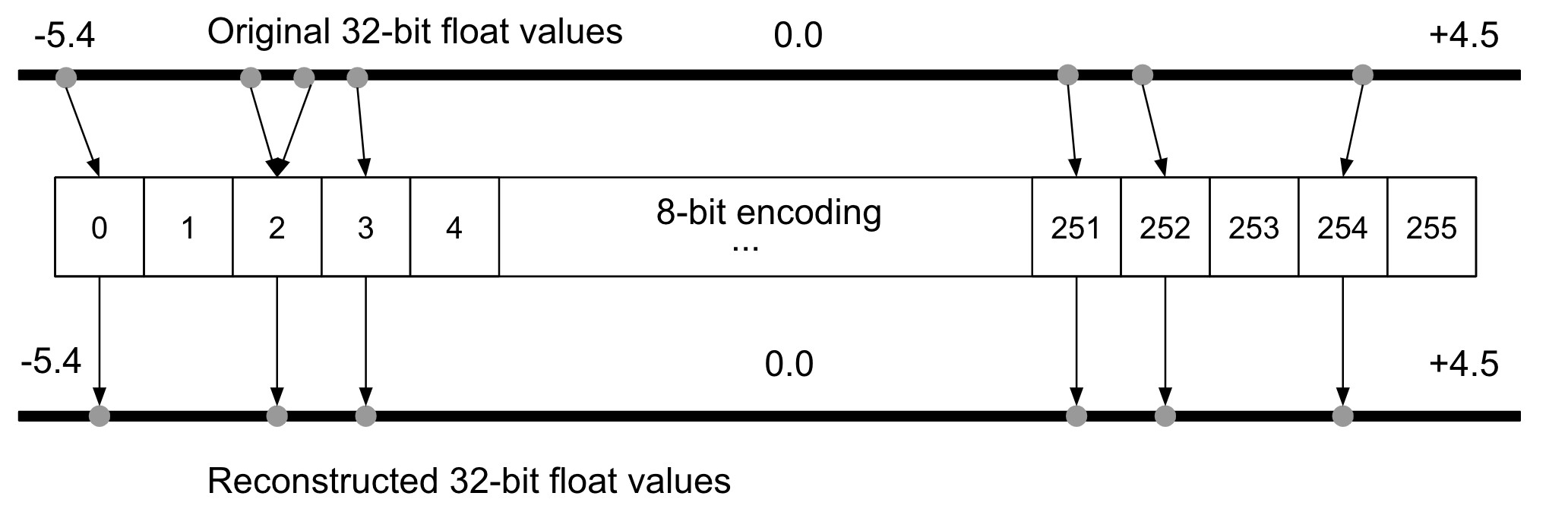

為什么要進行量化呢?想象一個使用ATmega328P微控制器的Arduino Uno,它使用8位算術。要在Uno上運行模型,理想情況下,模型權重必須存儲為8位整數值(而許多臺式電腦和筆記本電腦使用32位或64位浮點表示)。通過量化模型,權重的存儲量減少了4倍(從32位到8位值的量化),而精度的影響通常可以忽略不計(通常在1-3%左右)。

8位編碼過程中量化誤差的說明(然后用于重建32位浮點數)。(來源:TinyML書)

8位編碼過程中量化誤差的說明(然后用于重建32位浮點數)。(來源:TinyML書)

在量化過程中,一些信息可能會因為量化誤差而丟失(例如,在浮點表示法上為3.42的值在整數平臺上可能被截斷為3)。為了解決這個問題,量化感知(QA)訓練也被提出來作為一種替代方案。QA訓練主要是在訓練過程中約束網絡只使用量化設備上可用的值(見Tensorflow示例)。

赫夫曼編碼

編碼是一個可選的步驟,有時會通過最大效率的方式存儲數據來進一步減小模型的大小:通常是通過著名的Huffman編碼。

編譯

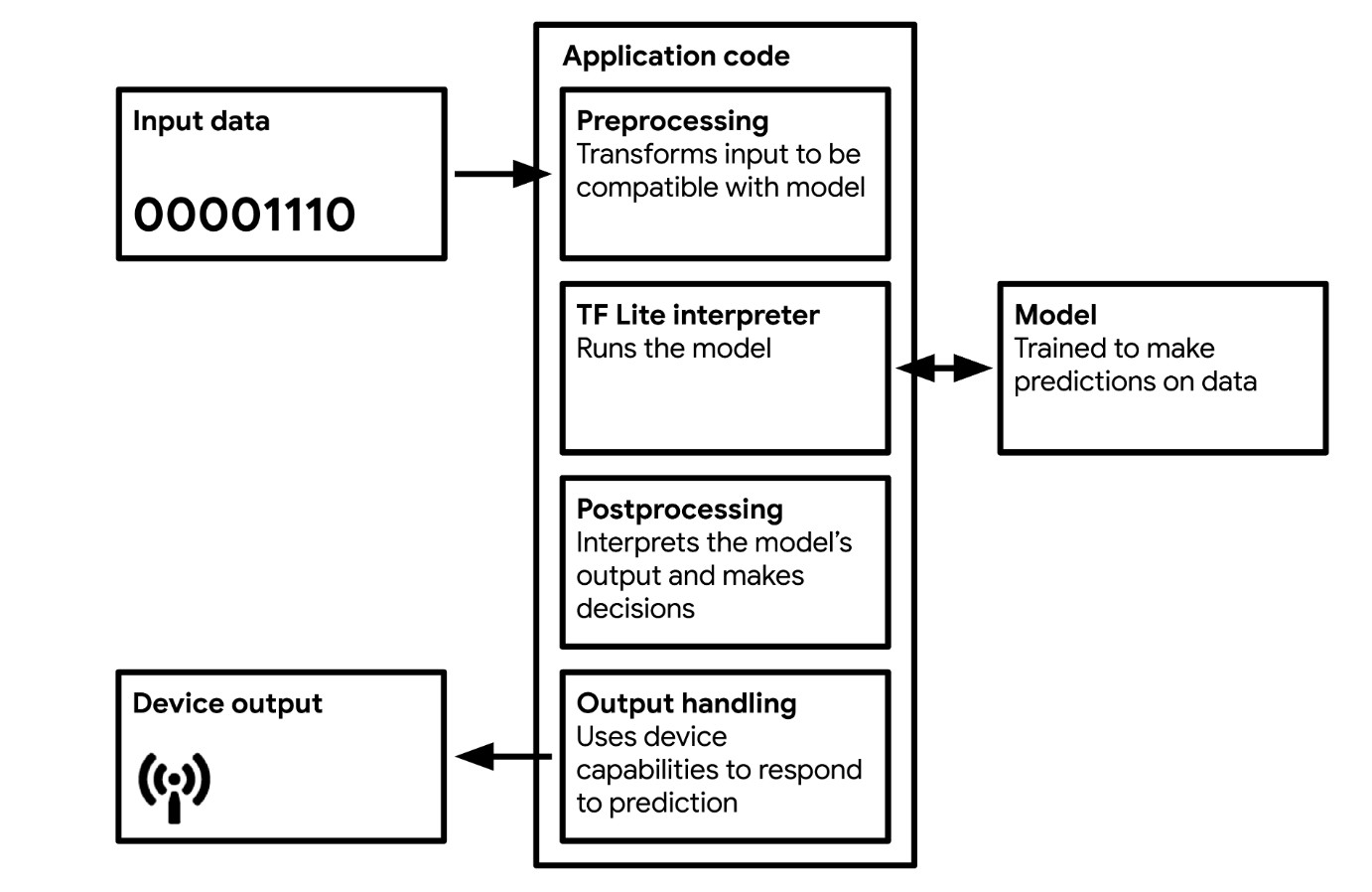

一旦模型被量化和編碼后,它就會被轉換為一種可以被某種形式的輕型神經網絡解釋器解釋的格式,其中最流行的可能是 TF Lite (大小約500 KB)和 TF Lite Micro(大小約20 KB)。然后,該模型被編譯成C或C++代碼(大多數微控制器工作的語言,以便有效地使用內存),并由解釋器在設備上運行。

TInyML應用程序的工作流程(來源:Pete Warden和Daniel Situnayake撰寫的 TinyML)

tinyML的大部分技巧都是在處理復雜的微控制器世界。TF Lite和TF Lite Micro之所以如此之小,是因為任何不必要的功能都已被刪除。不幸的是,這包括有用的能力,如調試和可視化。這意味著,如果在部署過程中出現錯誤,就很難分辨出發生了什么。

此外,雖然模型必須存儲在設備上,但模型還必須能夠進行推理。這意味著微控制器必須有足夠大的內存,以便能夠運行(1)其操作系統和庫,(2)神經網絡解釋器(如TF Lite),(3)存儲的神經權重和神經架構,以及(4)推理過程中的中間結果。因此,在tinyML的研究論文中,經常引用量化算法的峰值內存使用量,以及內存使用量、乘積單元(MAC)數量、精度等。

為什么不在設備上訓練?

在設備上進行訓練會帶來額外的復雜性。由于數值精度的降低,要保證充分訓練網絡所需的精度水平變得非常困難。標準臺式計算機上的自動微分方法大約精確到機器精度。計算導數的精度達到10^-16是令人難以置信的,但利用8位值的自動微分會導致較差的結果。在反向傳播過程中,這些導數會被復合并最終用于更新神經網絡參數。在數值精度如此之低的情況下,這種模型的精度可能會很差。

也就是說,神經網絡已經使用16位和8位浮點數進行訓練。

第一篇研究在深度學習中降低數值精度的論文是2015年Suyog Gupta及其同事的論文“Deep Learning with Limited Numerical Precision”。這篇論文的結果很有意思,它表明32位浮點表示法可以減少到16位定點表示法,而精度基本沒有下降。然而,只有在使用隨機舍入時才會出現這種情況,因為平均而言,它會產生的無偏結果。

2018年,王乃剛及其同事在“Training Deep Neural Networks with 8-bit Floating Point Numbers”一文中,使用8位浮點數訓練了一個神經網絡。由于在反向傳播過程中需要保持梯度計算的保真度(使用自動微分能夠達到機器精度),因此使用8位數字而不是推理來訓練神經網絡要實現的挑戰要困難得多。

計算效率如何?

也可以對模型進行定制,使其計算效率更高。廣泛部署在移動設備上的模型架構,如MobileNetV1和MobileNetV2就是很好的例子。這些本質上是卷積神經網絡,它們重塑了卷積運算以使其具有更高的計算效率。這種更高效的卷積形式被稱為深度可分離卷積。還可以使用基于硬件的性能分析和神經網絡結構搜索來優化體系結構的延遲,本文不涉及這些問題。

下一場AI革命

在資源有限的設備上運行機器學習模型的能力為許多新的可能性敞開了大門。發展更加節能的標準機器學習,這將有助于消除對數據科學對環境影響的擔憂。此外,tinyML允許嵌入式設備具有基于數據驅動算法的新型智能,這可以用于從預防性維護到在森林中探測鳥聲等任何事情。

雖然一些機器學習從業者無疑會繼續擴大模型的規模,但一種新的趨勢正在向更節省內存、計算和能源的機器學習算法發展。TinyML還處于萌芽階段,這方面的專家很少。我建議有興趣的讀者查閱參考文獻中的一些論文,這些論文都是tinyML領域的一些重要論文。這個領域發展迅速,在未來幾年內將成為人工智能在工業領域的一個新的重要應用。請關注這個領域。