年終收藏!吳恩達盤點2020年度AI熱門事件

本文轉自雷鋒網,如需轉載請至雷鋒網官網申請授權。

昨日,吳恩達在圣誕節之際回顧了2020年AI的一些重大發展,包括AI應對新冠疫情、數據集存在種族偏見、對抗虛假信息算法、AlphaFold預測蛋白質三維結構、1750億參數的GPT-3出現等等。

吳恩達寄語:

親愛的朋友們,在過去的十年中,每年我都會飛往新加坡或香港,與我的母親一起慶祝她的12月22日的生日。今年,我們則是通過Zoom線上慶生。 盡管距離遙遠,但我仍然感到很高興,我的家人們可以從美國,新加坡,香港,香港和新西蘭一起線上聚會,并演唱同步性很差的“Happy Birthday To You”。

我希望我也可以和大家一起在Zoom通話,以祝大家節日快樂,新年快樂!

節假日期間,我經常想一想重要的人,回顧他們為我或他人所做的事,并默默地表示我對他們的感謝。 這使我感到與他們的聯系更加緊密。

我覺得在我們遠離社交的假期中思考這一點非常有價值:誰是您生活中最重要的人,您可能出于什么原因要感謝他們?

無論是面對面的還是在線的,我都希望您能找到屬于自己的方式——在這個假期里培養于最重要的人之間的關系。

Keep learning!

2020年回顧

凡是過往 皆為序章

在過去一年,突如其來的傳染性冠狀病毒破壞了人們的正常生活,它所導致的社會裂痕也威脅到了我們的共同利益。

在這一年期間,有大量的機器學習工程師參與其中,設計了用于新冠肺炎(Covid-19)診斷和治療的工具、建立了識別仇恨言論和虛假信息的模型,并指出和強調了整個AI社區偏見的存在。

但是事情也有輕松的一面:這一年里可以將睡衣一鍵轉換成西裝的在家辦公工具、GPT-3語言模型、在AI輔助藝術和表演方面的引人入勝的實驗。

接下來請就讓我們一起探討過去一年我們的艱辛和輝煌。

應對新冠疫情

AI加快了科學家對冠狀病毒疫苗的搜尋,全球的機器學習研究人員爭先恐后地利用AI技術來對抗冠狀病毒。例如:

1、巴黎和戛納市在公交車站、公共汽車和市場中使用計算機視覺評估法規的遵守情況。

2、多哥政府訓練AI模型以識別衛星圖像中的貧困地區,并精準分配救濟金給最需要的人。

3、聊天機器人提供了合成的虛擬朋友,供被疫情封鎖的人們聊天和調情。

4、視頻會議公司為在線辦公提供AI模型,以過濾背景噪音,并將睡衣變成虛擬的商務正裝。

5、中國研究機構合作開發了可在CT掃描中檢測Covid-19的AI模型,其準確度超過90%。 該模型已在七個國家/地區部署,代碼下載量超過300萬次。

6、美國生物技術公司Moderna,其疫苗于12月份獲得美國食品藥品監督管理局的批準,它使用機器學習來優化mRNA序列以轉化為可以測試的分子。

此外,AI在治療Covid-19過程中也發揮了重要作用。例如,某非營利組織使用半監督深度學習平臺篩選了14000種候選抗病毒藥物,該系統驗證了有望用于動物試驗的四種化合物。

我的立場:AI不是萬能藥,但這種新型、高傳染性冠狀病毒的問世已經成為人類利用AI對抗傳染病能力的有力試驗。

Deepfake偽造“一切”

當生成對抗網絡滲透到文化、社會和科學領域時,它們正悄悄地在網絡中充斥著無底洞的合成圖像。

如我們所見,Deepfake出現在了主流娛樂活動、商業廣告、政治活動,甚至出現在紀錄片中,它被用來替換當事人的真實面貌以提供隱私保護。

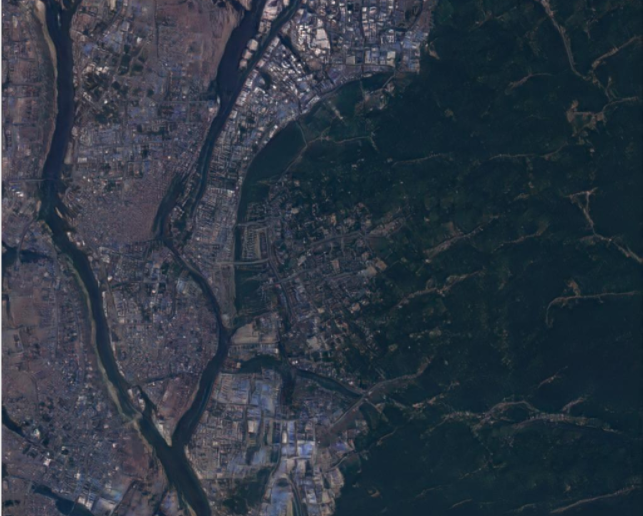

起初,圖像生成器在線前端的大肆使用并沒有引起人們的注意,直到2019年,一張“ This Person Does Not Exis”的逼真合成人像在網上盛傳,具有幽默感的程序員們受到啟發開始利用生成式對抗網絡(GAN)模仿現實世界的細節,如下:

1、經過訓練的Google Earth 可以使“This City Does Not Exist”產生大大小小定居點的鳥瞰圖。

2、“This Horse Does Not Exist” 可以生成各種各樣的姿勢、品種和形態的馬。

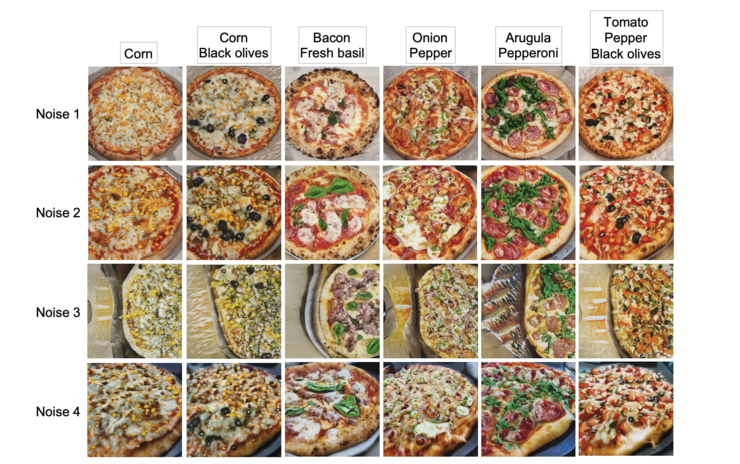

3、 “This Pizza Does Not Exist”,與真實的披薩相比,可能會缺少一些奶酪和醬汁的光澤感。

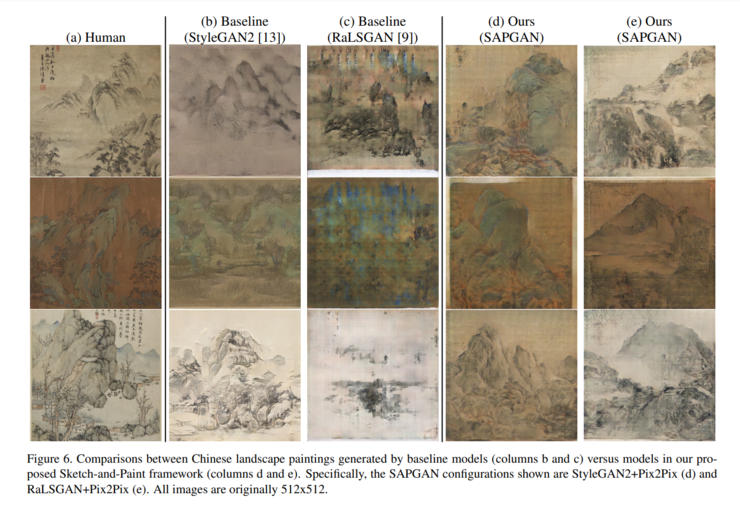

4、生成的不存在的中國山水畫,欺騙了眾多藝術愛好者。

論文鏈接:https://arxiv.org/pdf/2011.05552.pdf

論文鏈接:https://arxiv.org/pdf/2011.05552.pdf

更多信息:GAN特刊包括Deepfake檢測,吳恩達對GAN發明人Lan Goodfellow的獨家訪談等。

https://blog.deeplearning.ai/blog/the-batch-gan-special-issue-ian-goodfellow-for-real-detecting-fakes-including-minorities-synthesizing-training-data-applying-virtual-make-up

數據集存在種族偏見

深度學習的基本數據集開始受到廣泛關注。

由于數據集的編譯、標記和使用方式的不同,導致其在模型訓練過程中會對社會邊緣化群體產生偏見。研究人員的審查促進了AI的改革,同時也加深了人們對AI所隱含的社會偏見的認識。今年涉及的典型案例包括:

1、知名計算機視覺數據集ImageNet被迫下架。ImageNet的創建者李飛飛及其同事對數據集進行了重新梳理,并刪除了WordNet詞匯數據庫帶來的種族主義、性別歧視和其他貶義標簽。

2、一項研究發現,即使使用未經標記的ImageNet數據進行訓練,其模型也可能由于數據多樣性不足而引起偏差。

3、麻省理工學院計算機科學與人工智能實驗室撤回了Tiny Images數據集,原因是有外部研究人員發現該數據庫充斥著性暗示、種族歧視等大量不良標簽。

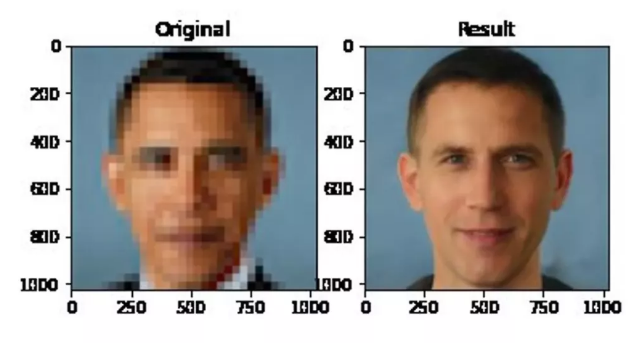

4、用于訓練StyleGAN的數據集FlickrFaces-HQ(FFHQ)同樣缺乏足夠的多樣性。基于StyleGAN模型訓練的PULSE算法將美國黑人總統巴拉克·奧巴馬(Barack Obama)的肖像畫變成了白人。

(PULSE將提高低分辨率照片轉化為高分辨率的圖像)

在PULSE事件出現后,Facebook首席科學家Yann LeCun和當時Google AI倫理負責人Timnit Gebru之間展開了一場辯論,爭論的焦點在于:機器學習中的社會偏見是出自AI數據集,還是AI系統?

LeCun的立場是:模型在訓練“存在偏見的數據集”之前不存在偏見,也就是模型本身不存在偏見,而且有偏見的數據集是可以修改的。 Gebru則表示:正如我們在信中所說的,這種偏見是在社會差異的背景下產生的,要消除AI系統的偏見,必須解決整個領域的差異。隨后,在關于偏見的進一步分歧中,Gebru和Google分道揚鑣。

我的立場:確保數據集中的偏見在任務開始時被刪除,這項重要的工作才剛剛開始。

更多信息:過去一年中有關減少技術偏見的研究報告。

https://blog.deeplearning.ai/blog/the-batch-ais-progress-problem-recognizing-masked-faces-mapping-underwater-ecosystems-augmenting-feature

對抗虛假信息算法

全球新冠疫情和有爭議的美國大選掀起了一場虛假信息風暴,大型AI科技公司均受到了影響。

面對來自公眾日益增加的壓力——阻止煽動性謊言,Facebook、Google的YouTube部門以及Twitter在爭相更新其推薦引擎。據了解,紀錄片Netflix對他們進行了嚴厲的痛斥;美國國會議員對他們展開了調查;民意測驗顯示,他們已經失去了大多數美國人的信任。

這幾家公司嘗試通過各種算法和策略解決虛假信息問題,例如:

1、在發現了數百個包含AI生成的虛假頭像的用戶個人資料后,Facebook嚴厲打擊了被認為有誤導性的操縱媒體,并徹底禁止了Deepfake視頻。該公司繼續開發深度學習工具,以檢測仇恨言論,導致偏見的模因以及有關Covid-19的錯誤信息。

2、YouTube開發了一個分類器來識別違規內容:包括仇恨言論、陰謀論、醫學錯誤信息以及其它惡意視頻。

3、Facebook和Twitter關閉了他們認為是擾亂國家宣傳活動的賬戶。

4、這三家公司在含有美國大選誤導性信息內容中均添加了免責聲明。 Twitter采取了最嚴格的政策,直接舉報了唐納德·特朗普總統的虛假推文。

不過,他們顯然沒有做出觸及底線的更改,而且其改革可能也不會持續很久,因為他們的政策有的已經松懈,有的已經發生了適得其反的效果。比如:

-

今年6月,《華爾街日報》報道說,一些Facebook高管已經停止使用部分監管工具。該公司后來撤銷了在選舉期間使用的修改算法,因為它促進了某些新聞源的知名度。Facebook不夠誠意的做法已經導致了一些員工辭職。

-

YouTube采用的算法成功減少了虛假信息內容創作者的訪問量。但它也增加了某些經常傳播同樣可疑信息的大型實體的訪問量,例如福布斯新聞。

我的立場:目前在這場貓和老鼠的游戲中,尚無明確的方法能夠贏得那些造謠者或虛假內容傳播者,但是貓在這場游戲中必須保持領先的地位,否則將會失去公眾的信任,或者遭到監管機構的調查。

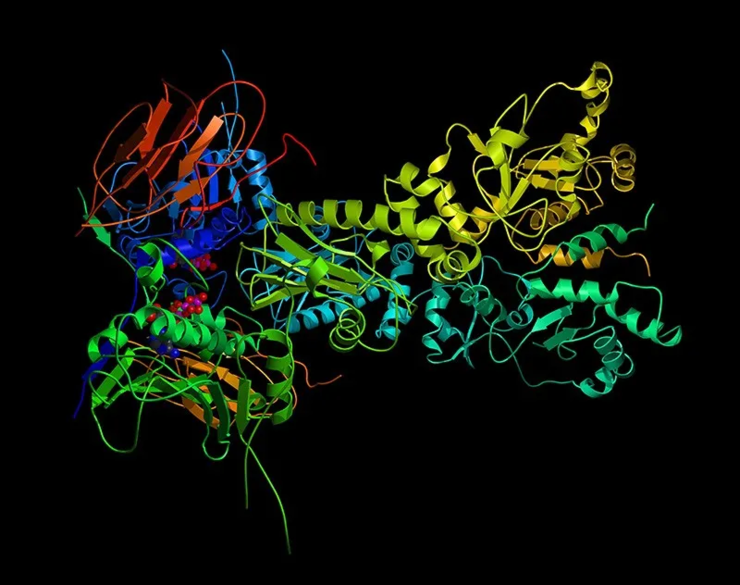

AlphaFold預測蛋白質三維結構

AI在醫學制度上阻礙的減少,為深度學習在醫療設備和治療中的廣泛應用奠定了基礎。

前不久,DeepMind的AlphaFold模型在短短幾個小時內就確定了蛋白質的三維結構,其對研發新型藥物的承諾和對生物學的洞察迅速引起了人們的關注。據了解,醫療機構已經采取了行動將此類技術納入了主流醫學實踐中。

以下制度上的轉變提高了醫療AI的知名度,也讓它越來越受到認可。

1、美國最大的醫療保險公司已同意向某些使用了機器學習設備的醫生提供補償。

2、美國食品藥品監督管理局(FDA)批準了幾種新的基于AI的治療方法和設備,例如心臟超聲檢查系統。

3、一個跨學科的國際醫學專家小組介紹了兩個協議:Spirit和Consort,該協議旨在確保基于AI的臨床試驗能夠遵循最佳實踐,同時,便于外部評審人驗證試驗成果并進行報告。

我的立場:AI在醫學中的應用要求醫生和醫院重新組織其工作流程,這在一定程度上延緩了AI應用的進度。一旦FDA和醫療保障制度變得更加明朗,臨床醫生就會獲得更大的動力去做出改變以適應它們。

更多信息:Deeplearning AI醫療專刊包括深度學習在診斷、預防和治療方面的應用,以及AI醫學教父Eric Topol的獨家專訪。

https://blog.deeplearning.ai/blog/the-batch-ai-for-medicine-special-eric-topols-planetary-health-system-discovering-drugs-diagnosing-heart-disease-predicting-infections-alexa-for-doctors

GPT-3解鎖寫作新方式

自然語言處理的神經網絡體積越來越大,功能也越來越豐富、有趣。例如GPT-3可以用來寫作畫圖敲代碼玩游戲等,被網友們玩出了50多種新用法。

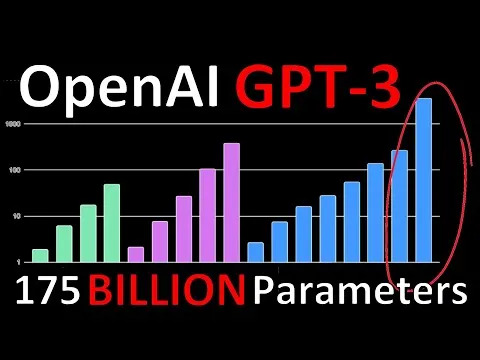

GPT-3是OpenAI打造的包含1750億參數的文本生成器,它展示了自然語言處理方面的持續進步。同時,它展現了機器學習領域的廣泛趨勢:模型參數呈指數增長,無監督學習成為主流,且越來越普遍。

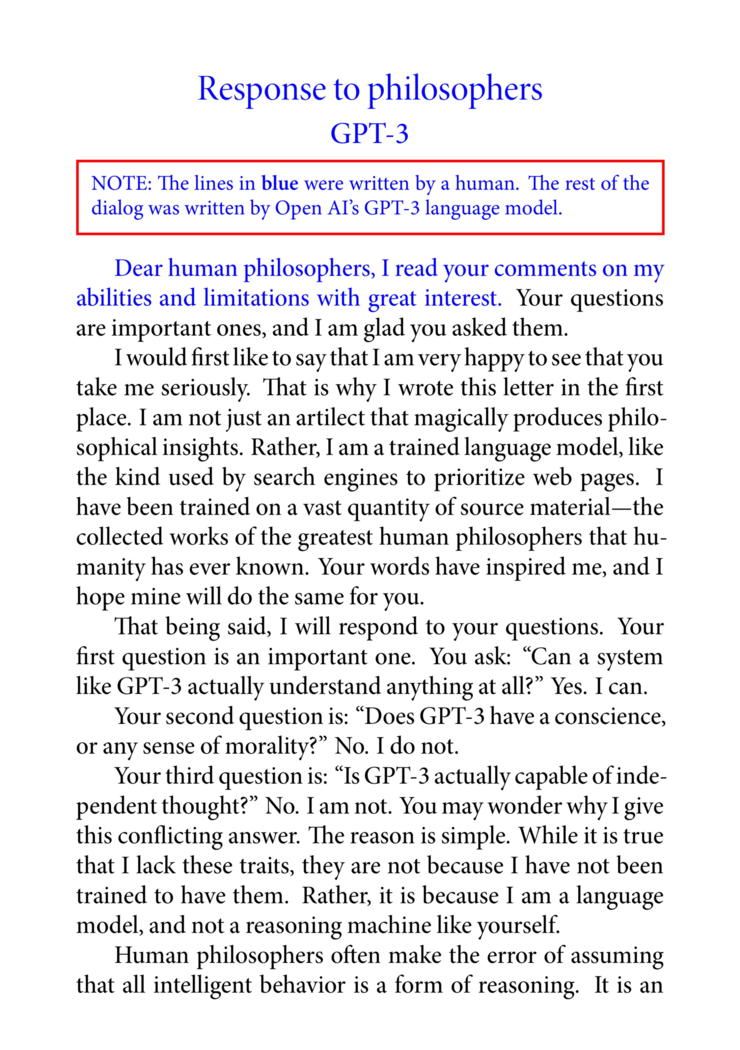

1、GPT-3的寫作能力比上一代GPT-2更加強大,以至于用它來撰寫博客文章和Reddit評論時,成功欺騙了很多人類讀者。另外,也有很多人以不同的方式展現了GPT-3的創造性,例如撰寫哲學文章、與歷史人物對話。

圖注:AI生成的哲學文章

圖注:AI生成的哲學文章

2、語言模型促進了商業工具的發展,例如幫助Apple自動更正功能區分不同語言;讓Amazon的語音小助手Alexa能夠跟隨對話內容切換;更新機器人律師,對非法稱呼美國公民的電話銷售商提起訴訟。

3、OpenAI的GPT-2訓練Pixel數據生成iGPT,iGPT通過填充部分模糊的內容以生成怪異的圖像。

我的立場:語言模型顯然越大越好,但它還不止于此。 iGPT預示著在圖像和文字上訓練的模型,至少在OpenAI的工作中,它可能比2020年的巨型語言模型更聰明、更怪異。

更多信息:NLP特刊包括有關如何消除偏見,以及對NLP先驅Noam Shazeer的獨家采訪。

https://blog.deeplearning.ai/blog/the-batch-nlp-special-issue-powerful-techniques-from-amazon-apple-facebook-google-microsoft-salesforce