新的深度學習模型如何將圖像分割引入邊緣設備?

譯文【51CTO.com快譯】圖像分割是確定圖像中對象的邊界和區域的過程。雖然人類對圖像不需要有意識地進行分割,但這對于機器學習系統來說仍然一個關鍵挑戰。這一技術對加強自動化機器人、自動駕駛汽車以及其他人工智能系統的功能至關重要,這些人工智能系統必須在現實世界中進行交互和導航。

直到現在,圖像分割還需要大型計算密集型神經網絡進行處理。這使得很多設備在沒有連接到云計算服務器的情況下很難運行這些深度學習模型。

DarwinAI公司和滑鐵盧大學公司的研究人員成功地創建了一個神經網絡,該網絡提供了近乎最佳的分割功能,并且其足夠小可以適用于資源受限的設備。研究人員在今年舉辦的一個計算機視覺和模式識別(CVPR)會議上在演講報告中詳細介紹了這種名為“AttendSeg”的神經網絡。

對象的分類、檢測和分割

人們對機器學習系統越來越感興趣的一個主要原因是可以解決計算機視覺中的一些問題。機器學習在計算機視覺中最常見的應用包括圖像分類、對象檢測和圖像分割。

圖像分類以確定圖像中是否存在某種類型的對象。對象檢測使圖像分類更進一步,并提供了檢測到的對象所在的邊界。

而分割有兩種形式:語義分割和實例分割。語義分割可以指定輸入圖像中每個像素的對象類別。實例分割可將每種類型的對象的各個實例進行區分。在實際應用中,分割網絡的輸出通常通過對像素著色來表示。而分割則是迄今為止最復雜的分類任務。

圖像分類vs對象檢測vs語義分割

卷積神經網絡(CNN)是計算機視覺任務中常用的一種深度學習架構,其復雜度通常以其參數的數量來衡量。神經網絡的參數越多,它需要的內存量和計算能力就越高。

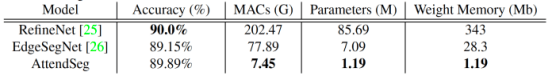

RefineNet是一種流行的語義分割神經網絡,其中包含8500多萬個參數,而每個參數為4字節,這意味著使用RefineNet的應用程序至少需要具體340M的內存才能運行神經網絡。考慮到神經網絡的性能在很大程度上取決于能夠執行快速矩陣乘法的硬件,這意味著模型必須加載到圖形卡或其他一些并行計算單元上,在這些單元中,其內存比計算中的內存少得多。

邊緣設備的機器學習

由于其硬件要求,大多數圖像分割應用程序都需要連接互聯網才能將圖像發送到可以運行大型深度學習模型的云計算服務器。連接云平臺可能會限制使用圖像分割的位置。例如,如果無人機或機器人將在沒有互聯網連接的環境中運行,那么執行圖像分割將成為一項艱巨的任務。在其他領域,人工智能代理將在敏感環境中工作,并且將圖像發送到云平臺將受到隱私和安全性約束。在需要來自機器學習模型的實時響應的應用程序中,由往返于云平臺造成的網絡延遲可能會令人望而卻步。值得注意的是,網絡硬件本身會消耗大量電能,而向云平臺發送恒定的圖像可能會增加電池供電的設備的負擔。

由于這些原因,邊緣人工智能和微型機器學習(TinyML)成為學術界和應用人工智能領域的關注和研究的熱點。TinyML的目標是創建可以在內存和功耗受限的設備上運行而無需連接到云平臺的機器學習模型。

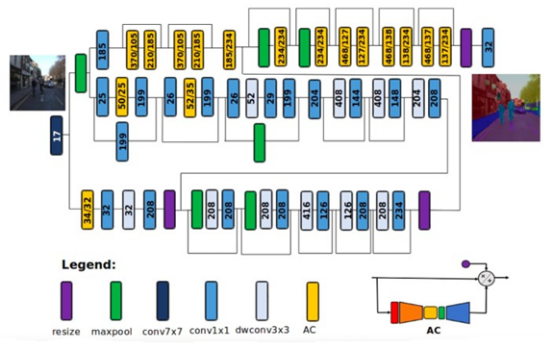

AttendSeg設備上語義分割神經網絡的架構

借助AttendSeg,DarwinAI公司和滑鐵盧大學的研究人員試圖解決邊緣計算設備上語義分割的挑戰。

DarwinAI公司聯合創始人兼滑鐵盧大學副教授Alexander Wong說,“AttendSeg的想法是由我們對推進微型機器學習(TinyML)領域發展的渴望。以及我們將其視為滿足DarwinAI公司的市場需求所驅動的。高效的邊緣分割方法在工業上有很多應用,我認為正是這種反饋和市場需求推動了我們的研究。”

Wong表示,AttendSeg是為微型機器學習(TinyML)應用量身定制的低精度、高度緊湊的深度語義分割神經網絡。

AttendSeg深度學習模型以幾乎與RefineNet相當的精度執行語義分割,同時將參數數量減少到119萬個。有趣的是,研究人員還發現,將參數的精度從32位(4字節)降低到8位(1字節)并不會導致顯著的性能損失,同時使AttendSeg的內存占用減少了四倍。該型號需要略高于1M字節的內存,這足夠小,適用于大多數邊緣設備。

Alexander Wong說,“根據我們的實驗,8位的參數對網絡的可推廣性沒有限制,這表明低精度的表示在這種情況下是非常有益的。”

實驗表明,AttendSeg深度學習模型提供了最佳的語義分割,同時減少了參數數量和內存占用量。

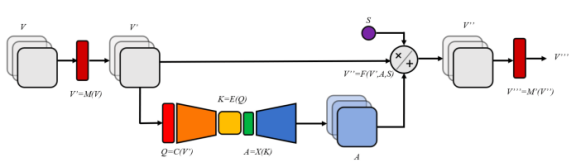

用于計算機視覺的自我關注機制

AttendSeg利用自我關注機制來減小模型尺寸,而不會影響運行性能。自我關注機制是通過關注重要信息來提高神經網絡效率的機制。自我關注機制已經成為自然語言處理領域的福音。它們一直是諸如Transformers之類的深度學習架構成功的決定性因素。雖然以前的架構(例如遞歸神經網絡)在較長的數據序列上具有有限的容量,但是Transformers使用自我關注機制來擴大其范圍。諸如GPT-3之類的深度學習模型利用“Transformers”和自我關注機制來產生長字符串,這些字符串(至少在表面上)在長跨度上保持連貫性。

人工智能研究人員還利用自我關注機制來提高卷積神經網絡的性能。去年,Wong和他的同事引入了一種非常節省資源的自我關注機制,并將其應用于圖像分類器機器學習模型中。

Wong說:“這種機制允許采用非常緊湊的深度神經網絡架構,該架構仍然可以實現高性能,使其非常適合邊緣計算和微型機器學習(TinyML)應用。”

自我關注機制以一種記憶有效的方式提高了卷積神經網絡的性能

機器驅動的神經網絡設計

設計TinyML神經網絡的關鍵挑戰之一是找到性能最佳的架構,同時還要注意不能超出目標設備的資源。

為了應對這一挑戰,研究人員使用了“生成合成”(Generative Synthesis)技術,這是一種可以根據特定的目標和約束創建神經網絡架構的機器學習技術。研究人員無需人工設置各種配置和架構,而是為機器學習模型提供一個問題空間,可讓它發現最佳組合。

Wong說,“這里使用的機器驅動設計過程(生成合成)要求人工提供初始設計原型和其指定的預期操作要求(例如尺寸、精度等),機器驅動設計過程將從中學習,并圍繞操作需求、任務和數據量身定制最佳架構設計。”

在他們的實驗中,研究人員使用機器驅動的設計來調整Nvidia Jetson的AttendSeg、機器人和邊緣人工智能應用的硬件包。但AttendSeg并不局限于應用在Jetson。

Wong說:“從本質上來說,與先前的文獻中提出的神經網絡相比,AttendSeg神經網絡將在大多數邊緣計算硬件上快速運行。但是,如果要生成針對特定硬件量身定制的AttendSeg,則可以使用機器驅動的設計方法,可以創建一個新的高度定制化的網絡。”

AttendSeg更適合在無人機、機器人和自動駕駛車輛中的應用,其中語義分割是實現導航的關鍵要求,但是設備上的分割可以有更多的應用程序。

Wong說,“這種高度緊湊、更加高效的分割神經網絡可以用于各行業領域的應用,其中包括制造應用(如零件檢查/質量評估、機器人控制)、醫療應用(如細胞分析、腫瘤分割)、衛星遙感應用(例如如土地覆蓋物的分割)和移動設備應用程序(例如增強現實中的人體分割)等。”

原文標題:New deep learning model brings image segmentation to edge devices,作者:Ben Dickson

【51CTO譯稿,合作站點轉載請注明原文譯者和出處為51CTO.com】