高通CVPR神研究:視頻處理計算量降78%,教卷積層自己“挑像素”

本文經(jīng)AI新媒體量子位(公眾號ID:QbitAI)授權轉載,轉載請聯(lián)系出處。

圖像領域,已經(jīng)限制不住AI算法大牛們的身手了。

現(xiàn)在,隨著視頻產(chǎn)業(yè)火熱發(fā)展,相關算法也正成為計算機視覺研究的新潮流。

畢竟日常生活中,無論是視頻通話、還是網(wǎng)課直播,都涉及大量的視頻處理算法。

但如果這些算法性能不高的話,視頻就會出現(xiàn)卡頓、降低分辨率的情況,體驗極差。

(想象視頻通話時,畫面卡成PPT的情況,已經(jīng)開始生氣了……)

因此,降低視頻算法計算量,一直是國內外AI視覺算法大牛們致力研究的問題。

最近有兩篇CVPR 2021的論文,就引起了視頻圈的不少關注。

它們教算法模型學會了自己“省算力”,將視頻處理算法的計算效率提升了幾倍不止,性能也并不下降!

教AI自己省算力,計算量-78%

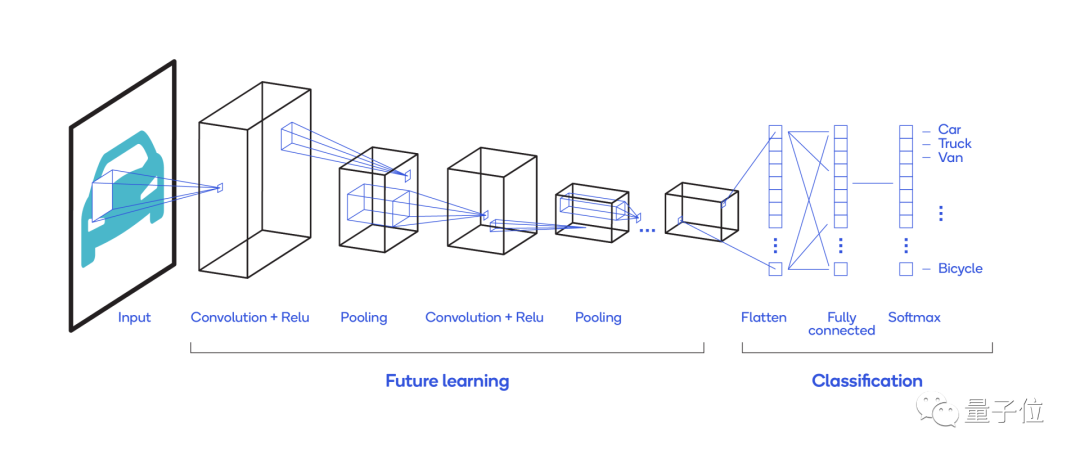

用卷積神經(jīng)網(wǎng)絡處理視頻,其實是一個計算量巨大的任務。

這里的“計算量”并非指視頻大小,而是卷積處理圖像的方式——將圖像完整地“掃”一遍。

但真正的視頻,往往存在大量變化不大的場景(甚至10幀內只有一只手在動):

這種情況下,如果還將每個像素都處理一遍……仿佛已經(jīng)感受到GPU在燃燒了。

那么,能否教AI學會高效“偷懶”,不浪費任何多余的算力呢?

當然可以,而且有2種方法。

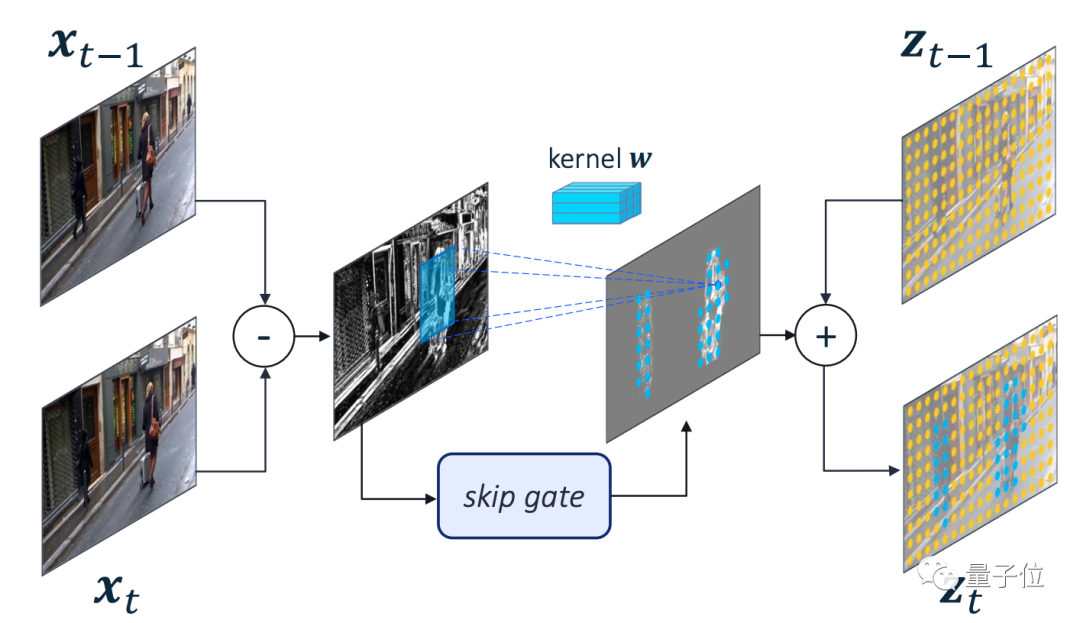

在第一篇論文中,提出了名為Skip-Convolutions(跳躍卷積)的新型卷積層,它能將前后兩幀圖像相減,并只對變化部分進行卷積。

沒錯,就像人的眼睛一樣,更容易注意到“動起來的部分”。

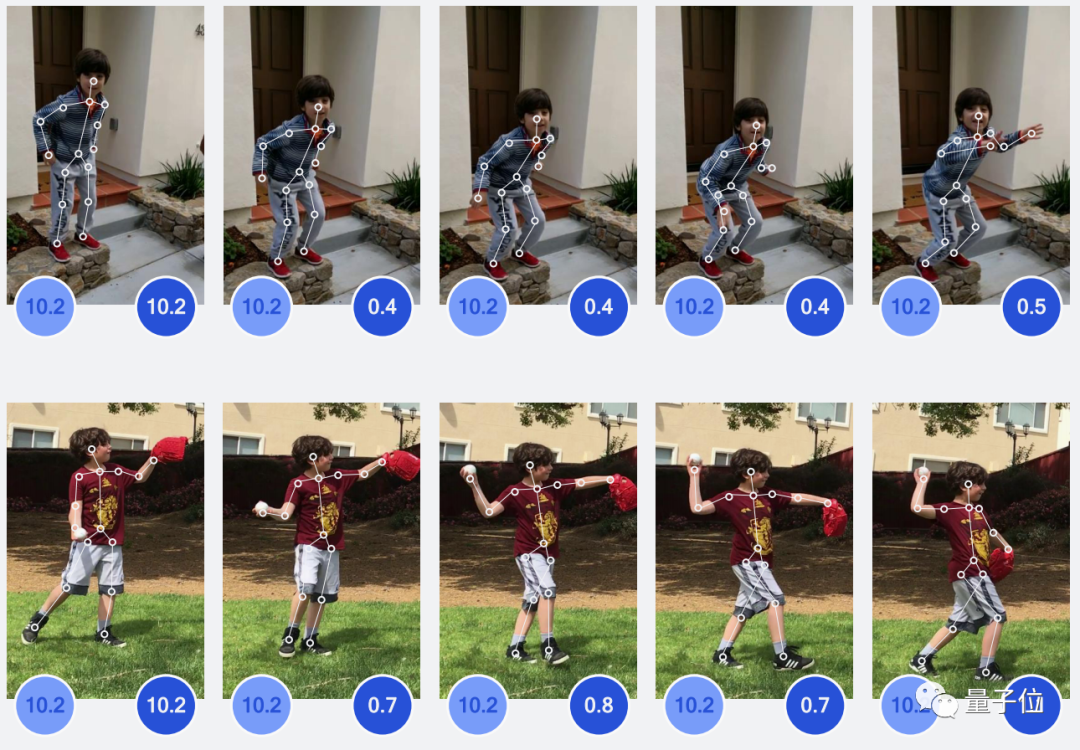

很快啊,計算量一下子從10.2GMACS(每秒10^9次定點乘累加計算)降到了0.4GMACS,不到原來的4%!

注意,不止是上面的姿態(tài)估計,這個卷積層適用于任何神經(jīng)網(wǎng)絡算法,包括光流、語義分割、分類任務等。

在最新的語義分割任務中,相比于經(jīng)典視頻AI算法HRNet,這個算法就將計算量減少了78%,延遲降低65%,性能還不下降。

而第二篇論文采用了一個新方法,讓AI模型“自行控制計算量”。

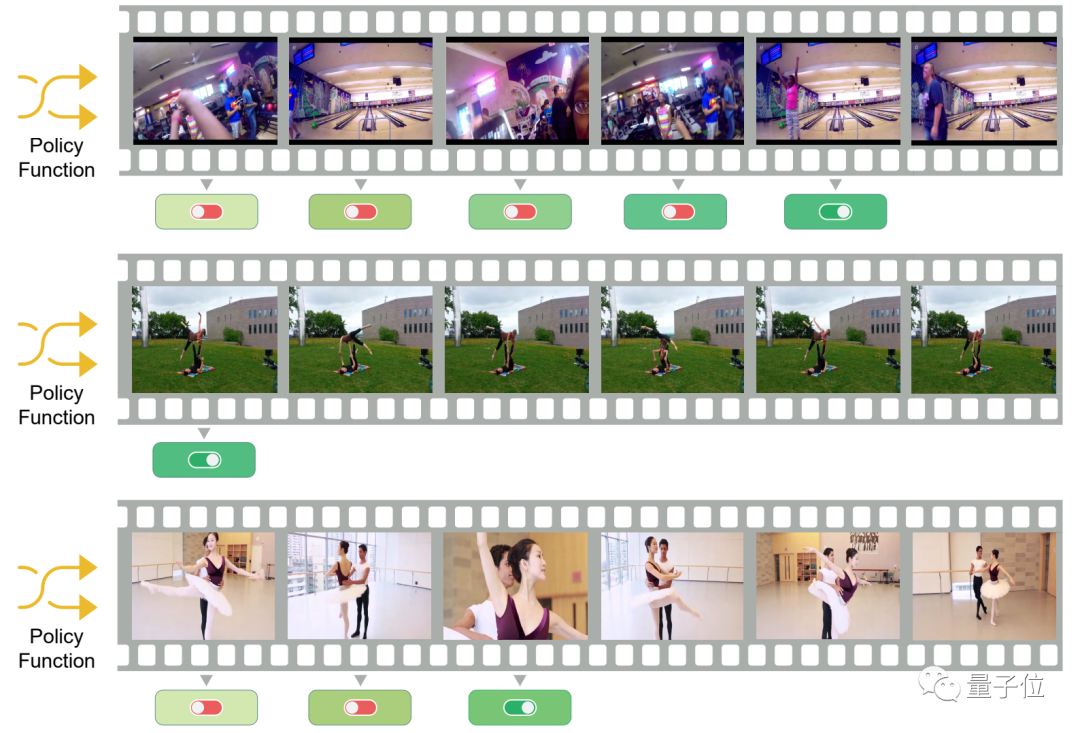

論文提出了一個名為FrameExit的網(wǎng)絡,由多個級聯(lián)分類器組成,可以隨著視頻幀的復雜度,來改變模型所用的神經(jīng)元數(shù)量。

在視頻前后幀差異大的時候,AI會用整個模型計算;前后幀差異小的時候,則只用模型的一部分計算。

也就是說,要是某一幀看起來不需要復雜計算的話,用更小的模型處理就夠了。

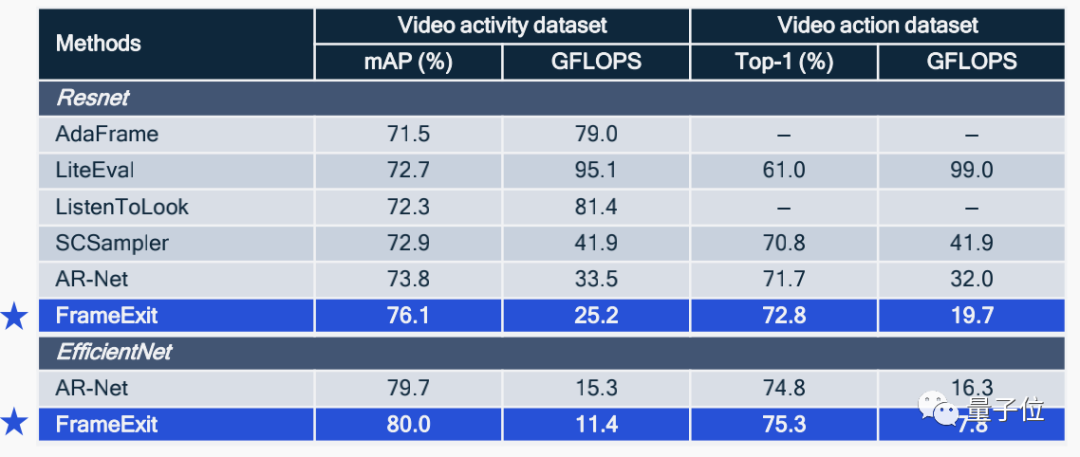

相比于其他模型,這種方法最高甚至能提升5倍的性能。

同時,神經(jīng)網(wǎng)絡檢測的精確度(mAP)不僅沒有下降,甚至還增加了!

目前,第二篇論文已經(jīng)入選CVPR 2021的Oral。

重要的是,這兩篇論文背后的單位,竟然都是高通,一個與所有手機用戶息息相關的公司。

看來我們又能用上更多性能更棒的手機視頻應用了。

手機視頻應用,性能超級加倍

這兩項AI視頻感知技術,高通已經(jīng)在研究落地了。

不得不說,即使是落地的方向,也都是我們平時手機視頻應用的剛需。

除了能優(yōu)化視頻處理算法以外,這類感知技術還能讓更多AI視頻模型被用到手機上。

首先是針對視頻處理算法的優(yōu)化。

例如,對于我們常見的線上視頻會議、網(wǎng)課等視頻通話場景來說,如果視頻處理算法模型不好,實時通話的質量就會非常差。

甚至可能因此出現(xiàn)卡頓的情況,然后直接掉幀,比語音通話的觀感還差。

但如果用上這類視頻感知技術,AI就能對視頻中的部分像素進行智能處理,極大地降低視頻通話所需的圖像計算量,讓通話過程變得更流暢。

又例如,我們的手機在對視頻文件進行智能剪輯處理時,往往會出現(xiàn)耗電量大、文件加載慢的問題。

但如果用這類算法對視頻剪輯應用進行處理,不僅能優(yōu)化算法本身,還能讓剪輯過程變得更加絲滑。

事實上,也正是由于這類視頻感知算法,讓更多AI模型能被應用到手機中。

以小米11為例,它的其中一項視頻編輯功能,是對視頻中的一部分畫面進行時間暫停,另一部分則保持播放,就像一個人對另一個人施加了“時間停止”魔法。

這類視頻算法模型,此前的計算量非常大,原本在論文中要用GPU才能實現(xiàn)。現(xiàn)在用手機就能實現(xiàn)“時間停止”,還是實時的:

不止是一段視頻,就連其中的特殊幀也能被暫停,并做成一段很有意思的視頻:

又例如,各大AI視覺論文中常見的圖像增強算法,以往主要是針對拍照實現(xiàn),無法被應用到視頻中。

但現(xiàn)在,由于視頻計算量的下降,它已經(jīng)能用在實時視頻拍攝中了,甚至包括視頻會議這樣的場景。

以OPPO Find X3 Pro的夜景攝影為例,正常拍攝下逆光、或是夜景的視頻效果,在AI的計算下也能將臉看得清清楚楚:

甚至就連我們常見的視頻智能穩(wěn)定、視頻插幀,之所以能應用到手機視頻上,也離不開視頻感知算法對智能幀間對比、超分辨率算法等技術的加持。

例如,這是vivo X60 Pro+的視頻智能穩(wěn)定效果:

事實上,上面這些已經(jīng)被應用到手機中的AI黑科技,背后都有著驍龍888的算力和處理性能支持。

也就是說,高通已經(jīng)將不少AI視頻處理算法,從“幾張紙”的論文變成了實際的手機視頻應用。

“隱形”AI黑科技,身邊其實就不少

不止是手機應用,在這些算法的加持下不斷“進階”。

在智慧醫(yī)療、智能工廠、XR等“未來”場景逐漸成為現(xiàn)實的背后,同樣有著無數(shù)的AI黑科技。

以我們常見的VR設備為例,由于有了AI算法的加成,攝像頭也能實現(xiàn)由內向外更精準的追蹤。

結合5G進行視頻傳輸后,有了AI加持的VR設備,不僅能給孩子們進行科普教育、還能讓醫(yī)生能夠給病患更細致地講解病情。

又例如,現(xiàn)在出門去醫(yī)院看病,只需要一個碼,就能將包括病案信息、診療進度、最新診療結果在內的相關病情信息匯集在碼中。

利用東大集成研發(fā)的“小碼哥”進行掃描后,醫(yī)生就能快速獲取全部信息,及時進行診斷。

同時,物聯(lián)網(wǎng)醫(yī)療設備和AI數(shù)據(jù)分析還能簡化健康監(jiān)控,建立一個真正“互聯(lián)”的醫(yī)院,讓患者也能在不同地區(qū)、時間及時查看病情結果。

又例如,利用AI+邊緣計算+5G,就能做出替代人眼進行質量檢測和瑕疵識別的智能化數(shù)字生產(chǎn)線,讓工廠節(jié)省大量人力成本。

不僅如此,工業(yè)搬運機器人也能通過5G+AI,對攝像頭所收集的視頻流數(shù)據(jù)在云端或邊緣側進行智能分析,從而實現(xiàn)遠程操控。

但用戶并不需要了解其中的每一個細節(jié)。

因為,高通這樣的前沿科技公司,正將這些技術難點一一攻克。

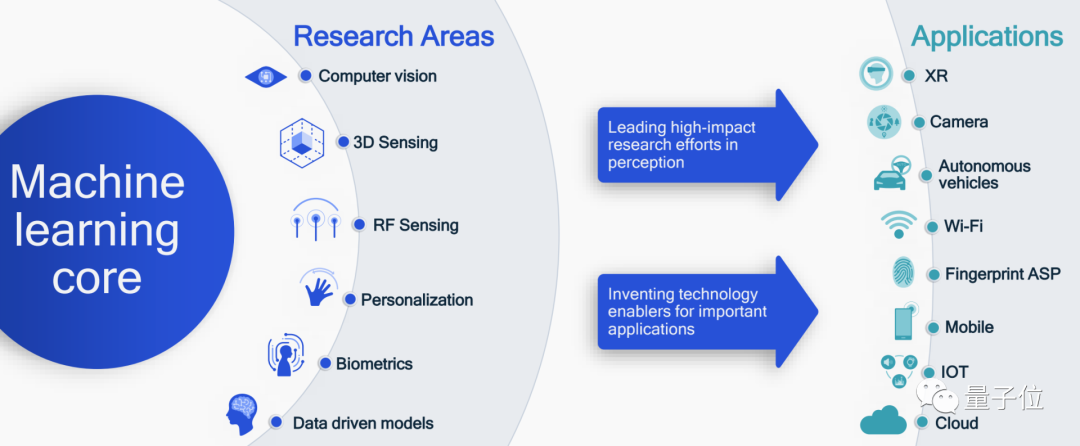

△高通在AI方向的應用布局

然后,再以產(chǎn)品的方式呈現(xiàn)出來,讓每一個用戶都能無差別地享受最新科技突破。

黑科技有多復雜?

那不是大多數(shù)用戶需要考慮的。

兩篇CVPR 2021論文地址:

[1]

https://arxiv.org/abs/2104.11487

[2]

https://arxiv.org/abs/2104.13400