Nature:機器促進人類語言的產生

本周,《自然》上刊登了一篇科學報告,研究人員發現,機器人可以促進人類語言的產生。

這一報告的意義在于,對語言發育遲緩、詞匯檢索困難的臨床人群、以及需要增強語言生成的教育環境,機器人或許能起到十分重要的作用。

而且,文章揭示的共同表征和語言促進機制可能會被整合到社交機器人的認知架構中,以提高它們在與人類進行口頭交流時的溝通技巧。

此前,已有研究證明,在信息處理級別,機器人可以影響人類行為,包括運動、社交、高階認知方面。

人類+機器人:命名任務快速完成!

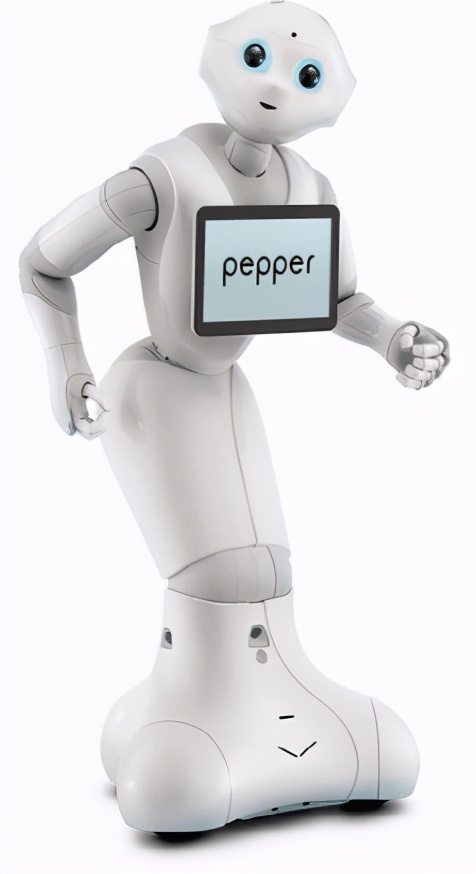

根據文章,本次實驗的參與者是36名年齡在 19 至 35 歲之間的德語母語人士,以及機器人Pepper,這是日本軟銀集團和法國Aldebaran Robotics專為與人類交流而研發的人形機器人,高1.2 米。

機器人的語音和行為通過 NAOqi 框架生成,其中包含在機器人和可視化顯示刺激的 Presentation 軟件之間進行通信的自定義腳本。

為了突出機器人的自然行為,休息期間,它被設置為響應并關注其環境。在命名任務期間,則會有微妙的手臂和頭部運動。

實驗開始前,Pepper會作為任務伙伴被介紹給參與者。

實驗材料包括 320 張自然或人造物體的照片,分為32 個不同語義類別(如,花卉、建筑物、鳥類)。

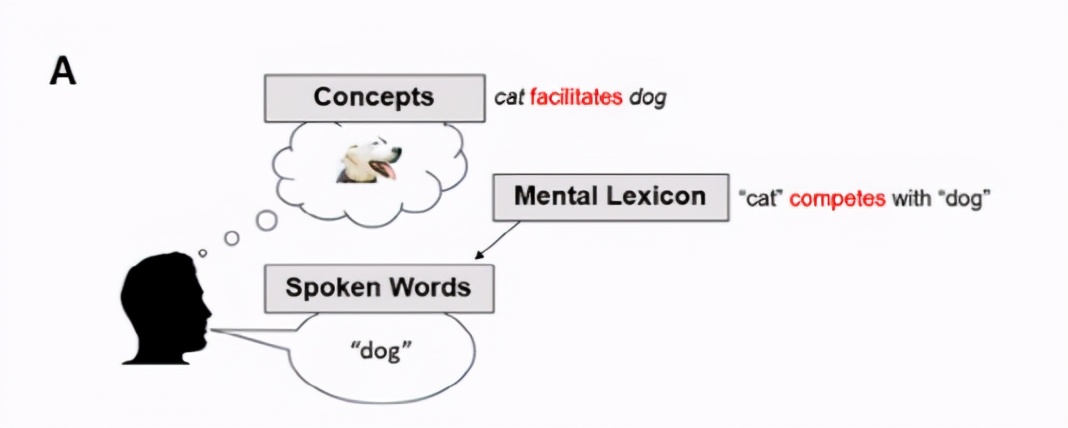

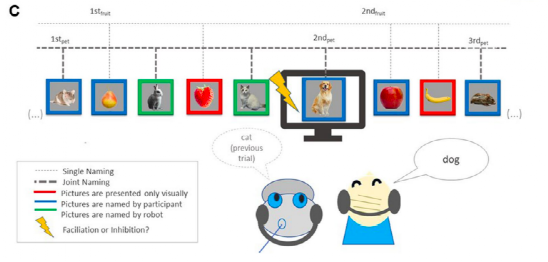

實驗裝置中的認知模型如圖A所示,語音生成過程中的詞匯訪問認知模型解釋了概念如何激活心理詞匯表中的條目,然后轉化為語音。

實驗中,一個參與者和機器人Pepper在電腦屏幕前相鄰而坐,顯示圖片,其中一些是語義相關的。

研究人員評估了機器人的言語行為是否被模擬,以及在哪個處理層面(概念與詞匯)。

為了排除在與機器人共享命名過程中可能出現的額外語言輸入的干擾,參與者和機器人都戴著耳機,這可以掩蓋伙伴的命名聲。

圖片由參與者命名,一半只以視覺方式呈現。在聯合命名條件下,某一語義類別中的一半圖片(如寵物)由參與者命名,另一半由機器人伙伴命名。對于那些由參與者命名的圖片,將計算出1-5的順序位置。

每個試驗都以 0.5 秒的固定交叉展示開始。在參與者命名物體的試驗中,圖片被呈現直到命名響應被啟動或最多 2 秒。從圖片展示開始,參與者的命名延遲(反應時間)會被記錄下來。

圖片連續顯示在電腦屏幕上。在單一命名條件下,在一個給定的語義類別中,一半的圖片(例如:水果)被參與者命名,另一半的圖片僅以視覺方式呈現。水果)的一半被參與者命名,另一半則只以視覺方式呈現。在聯合命名條件下,在一個特定的語義類別中,一半的圖片(如寵物)由參與者命名,另一半由機器人命名。

實驗結果顯示:

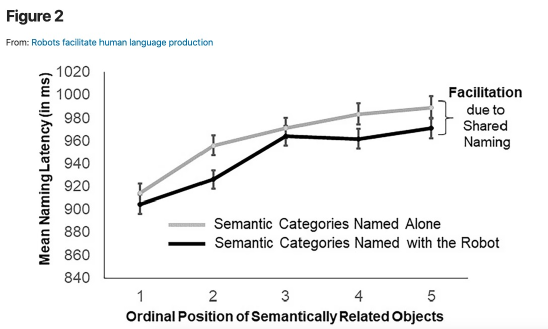

- 與機器人共同命名可以促進語言的產生。

- 人類和人類同伴一起命名時沒有促進作用,而和機器人一起,則有促進作用。

- 機器人并未在詞匯選擇的層面上共同表征,機器的語言是在概念層面進行模擬,從而對人類語言的產生產生了促進作用。

實驗結束時,參與者完成了兩個與機器人意圖有關的問題:機器人有意采取行動、機器人主動決定何時對刺激做出反應,評判標準從1到11.

當然,此項研究并不是十分完善,比如,還不清楚這種共同表征的確切性質。未來的研究應該包括生理測量,如腦電圖,或是針對性的潛在機制。

另外,還應系統地研究機器人的行為、(合成)聲音或視覺外觀的細節,以及語言交互的強度或機器人屬性的加強是會否影響機器人的語言共同表示。