人工智能如何增強現有的人類偏見?

根據定義,人工智能 (AI) 旨在模擬人腦的工作機制以優化組織活動。

不幸的是,雖然我們已經能夠更接近于人工地重新創造人類智能,但人工智能也表現出另一種獨特的人類特征——基于種族、民族或性別對某人的偏見。人工智能中的偏見并不是一個新概念。最近和過去都發現了醫療保健、執法和招聘行業中存在偏見的算法示例。

因此,幾個世紀以來的不容忍和歧視不斷以一種或另一種形式出現,即使世界似乎正在朝著對所有人包容的方向發展。要了解人工智能如何強化長期存在的人類偏見,我們需要找出偏見潛入人工智能模型和神經網絡的方式。

用于訓練 AI 模型的有偏數據集

人工智能驅動的系統的決策僅反映用于模型訓練的輸入數據的類型。因此,如果 AI 模型吸收的數據集具有歧視性,則輸出推薦或決策將遵循相同的趨勢。在初始機器學習階段,可以通過兩種方式創建有偏差的 AI 模型。首先,如前所述,用于訓練 AI 模型的數據(總體上)是狹窄且有偏見的。其次,由于給定數據集中的樣本存在偏差,因此創建了判別算法。由于疏忽或因為從事訓練過程的數據科學家本身保守、心胸狹窄,有偏見,輸入數據可能很窄。

歧視性人工智能的最佳例子之一是臭名昭著的 COMPAS 系統,該系統在美國多個州使用。人工智能驅動的系統使用歷史監獄數據庫和回歸模型來預測被釋放的罪犯將來是否有可能再次犯罪。正如預期的那樣,該系統的預測表明,與白種人相比,非洲裔美國人的再犯人數幾乎翻了一番。這種偏見的主要原因之一是,網絡管理員在分析其預測時從未嘗試檢測系統的歧視性暗示。通常,人工智能偏見的受害者是女性、特定地區的少數族裔或有移民背景的人。正如他們所說,人工智能的模型不會引入新的偏見,而只是反映社會中已經存在的偏見。

如上所述,機器訓練的數據收集過程也可能存在偏差。在這種情況下,指定的 AI 治理官員會意識到所收集數據中的偏差,但仍會選擇忽略它。例如,在收集與招生背景相關的數據時,學校可能只選擇白人候選人。此外,學校可能只是拒絕為其他孩子提供學習機會。在可能是一個循環中,AI 模型可能會密切觀察學校選擇專門選擇白人學生的做法。稍后,該模型將繼承種族主義傳統,因為其模式分析僅表明這是學校招生期間的正確行動方案。因此,盡管存在處理這一過程的尖端技術,但種族主義仍被多次強化。

除了種族或性別歧視,人工智能中的偏見甚至可能以對富人的優惠待遇的形式存在。因此,窮人在 AI 數據集中的代表性可能不足。在正在進行的 COVID-19 時代,甚至可以想象出一個這樣的假設例子。一些國家開發了自己的移動應用程序,可用于跟蹤感染病毒的人,并提醒任何特定區域的其他人與這些人保持距離。雖然該計劃可能具有崇高的目的,但沒有智能手機的個人將在應用程序中完全不可見。雖然這種類型的偏見不是任何人的錯,但它首先違背了設計此類應用程序的目的。

綜上所述,歧視性的訓練數據和操作實踐會直接導致人工智能系統和模型的偏差。

由于代理相關原因導致的人工智能偏見

偏見滲入人工智能模型的另一種方式可能是通過代理。用于機器訓練的一些細節和信息可能與受保護的特征相匹配。由此產生的偏差實例可能是無意的,因為用于做出理性和校準決策的數據可能最終作為類成員的代理。

例如,假設一家金融機構使用人工智能系統來預測哪些貸款申請人可能難以還款。用于訓練 AI 系統的數據集將包含跨越三個多世紀的歷史信息。現在,此輸入數據不包含與申請人的膚色或性別相關的詳細信息。然而,假設系統預測居住在特定地點(與某個郵政編碼相關聯)的人將拖欠他們的貸款分期還款。此預測僅根據歷史記錄生成。當銀行因居住地而決定不批準他們的貸款申請時,居住在該地區的人可能會感到受到了歧視。人工智能中的這種偏見可以通過讓人類官員參與來消除,他們可以根據實際事實而不僅僅是歷史記錄推翻人工智能系統的決定。

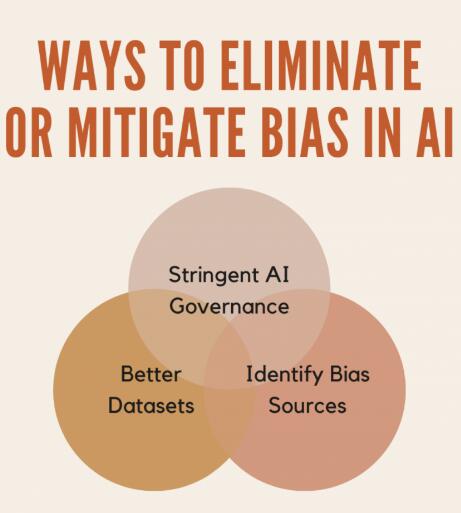

除此之外,還有其他幾種產生偏見的人工智能的方式,然后在當今時代繼續強化古老的偏見。有幾種方法可以徹底消除人工智能中的偏見,或者至少在很大程度上減少偏見。

選擇更具代表性的數據集

組織中的每個人都需要努力降低其 AI 系統在工作中存在偏見的可能性。正如我們所見,人工智能的偏見完全源于它為機器訓練或其日常操作接收的數據類型。收集大量培訓和運營數據的數據科學家和其他專家需要使用各種數據,其中包括屬于所有種族和少數種族的人。在此類數據集中,女性必須與男性一樣多。此外,僅當數據專家向類似分割的模型提供輸入數據時,才應存在 AI 模型中的分割。

此外,使用人工智能應用的組織不得針對不同的種族和民族多樣性使用不同的模型。如果單個人群的數據不足,組織可以使用加權等技術來平衡其相對于其他人群的重要性。如果每個數據組沒有得到謹慎和同等權重的處理,就有可能在 AI 模型中產生偏見。

識別潛在的偏見觸發因素或來源

檢測某些類型的偏見可能進入 AI 系統的區域和操作是任何組織中 AI 治理團隊和執行級別員工的主要責任。理想情況下,必須在將 AI 納入組織之前執行此過程。組織可以通過檢查數據集并檢查它們是否會導致 AI 模型具有狹隘的“觀點”來減輕偏見。經過徹底檢查后,組織必須進行試運行,以查看其 AI 系統是否在工作中表現出偏見。最重要的是,組織必須列出涵蓋所有有偏見的人工智能領域的問題。然后,他們必須不斷尋找解決方案,以便一個接一個地回答這些問題。

實施嚴格的人工智能治理指南

AI 治理團隊在防止 AI 系統隨著時間的推移變得歧視方面發揮著關鍵作用。為了避免人工智能的偏見,治理團隊必須定期更新人工智能模型。更重要的是,團隊應該制定不可協商的法規和指南,以檢測和消除或至少減輕用于機器訓練的輸入數據集的偏差。

除此之外,必須建立清晰的溝通渠道,以便組織中任何級別的員工都可以在收到客戶關于人工智能歧視的投訴時通知治理團隊。即使員工自己發現他們組織的 AI 可能存在偏見,這些渠道也會起作用。

人工智能中的偏見對于成為其決策犧牲品的個人或團體來說可能非常痛苦。更成問題的是,有偏見的人工智能系統是人類歷史上不幸的受害者面臨數百年邊緣化和歧視的新一代象征。因此,我們必須通過確保模型訓練和有能力的 AI 治理的不同輸入數據集來確保將算法偏差扼殺在萌芽狀態。歧視性 AI 是每個人的問題,因此,組織中參與 AI 模型設計、實施和維護階段的所有各方都應該聯合起來解決它。