AI語音克隆詐騙銀行高管,取2.2億如探囊取物

本文經AI新媒體量子位(公眾號ID:QbitAI)授權轉載,轉載請聯系出處。

一位銀行經理接到公司董事打來的電話:公司安排了一項收購,要從賬戶里轉出巨額資金,希望他批準這道流程,還附上了相關律師的電子郵件,以確認金額和轉入賬戶。

這次交易合法合規,流程也并無問題,況且還是老板親自打的電話,他就按要求將3500萬美元如數轉出。

晴天霹靂的背后是AI語音轉換

直到轉完賬之后,這位迪拜高管也萬萬沒有想到,電話那頭熟悉的老板的聲音,其實是用語音克隆技術合成的。

這樁詐騙案由福布斯報道,但受害者的名字和其他更多細節沒有透露。據估計,這項精密的計劃至少涉及17人,自去年年初,騙取的資金已經發往全球各地的銀行賬戶。

如果不是親耳聽到,應該是不會相信會有這么神奇的事。

(完整視頻見下方鏈接)

網友表示,這講話太流暢了,應該再加一些停頓……

不過不得不說,能做到這種程度已經能夠以假亂真了。如果有更長的時間和更多的素材去訓練,相似程度應該還能更上一層樓。

更可怕的是,如此逼真的轉換,操作起來也不難。

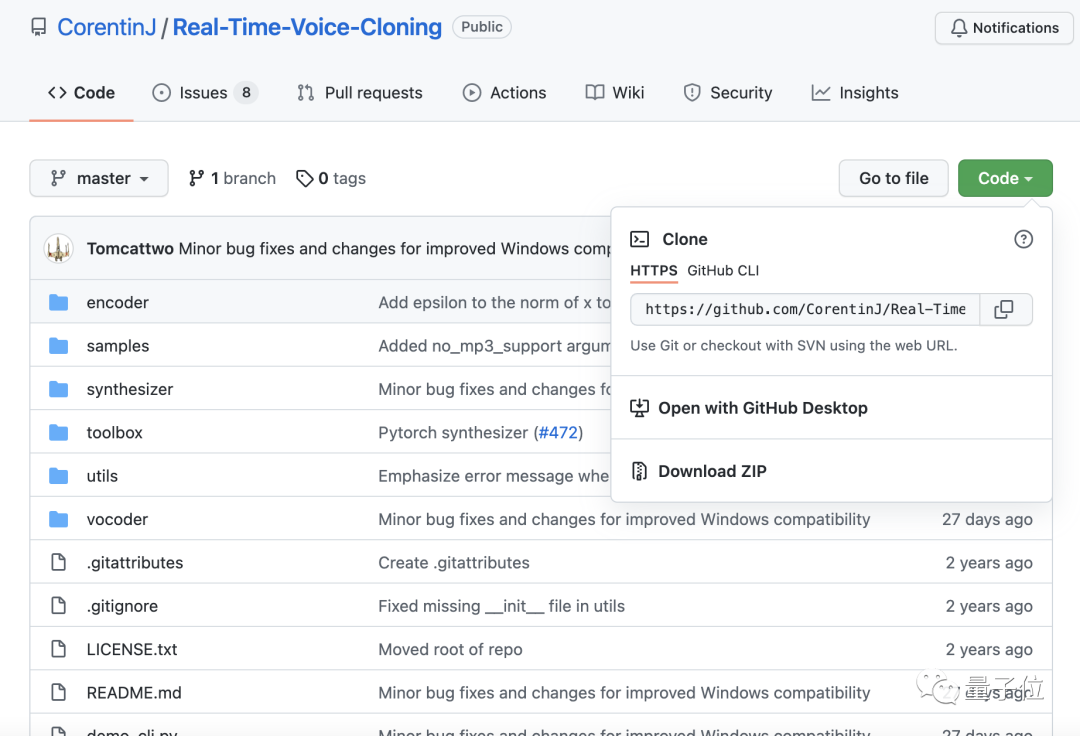

例如在Github上大火的AI擬聲項目Real-Time-Voice-Cloning,能夠在5s內克隆你的聲音并生成任意內容,還能直接下載或者自行訓練合成器。這個視頻就是基于該項目的訓練成果。

開源項目可以直接從GitHub上直接獲取:

然后再錄入一段你的聲音和目標聲音,打出想要讀出的文本內容,就可以克隆出一段輸出音頻了。

面對這樣以假亂真的效果,也就不難理解這位銀行高管為什么會被輕易詐騙了。但這僅是已知使用語音克隆實施巨額詐騙的第二例,已經遠比第一例英國某能源公司22萬歐元詐騙案更為成功,其破壞力可見一斑。

科技中立,善惡由人

了解完這樣的新型詐騙手段不禁讓人想問,發明出AI語音轉換難道是用來騙人的嗎?

完全不是,語音轉換本可以用來做很有意義的事。在前些時候,語音轉換技術就曾在央視節目《等著我》中出現,幫助退役多年的袁爺爺,找回了當時在戰場上一同作戰的老排長的“聲音”。

如今已有少數信息安全方面的創業公司關注到這一點。他們聲稱可以檢測出合成的語音以防止詐騙。

反詐原理是通過對比音頻里單詞的實際發音在細微程度上是否與真實人類的說話模式相匹配,畢竟人類發音不會像機器一樣標準、機械。

這也給我們提了一個醒,有必要及時關注科技新進展,不斷提高安全意識。

對于長輩來說,今后除了要下載反詐app,可能還要多驗證驗證電話另一端是不是真正的兒子(女兒)~

趕快轉發到家族群,讓家人不要受騙!(保護)