高級自動駕駛系統的新型三大感知能力要素分析

自動駕駛傳感器配置需求隨著汽車智能化和電動化的快速發展不斷增加。當前的傳感器趨向于從探測范圍、探測精度、探測能力上進行不斷優化以便適應更多的邊緣場景。使用更高級能力的傳感器到底能帶來哪些優勢,又能解決哪些問題,如何對車身周圍配置的傳感器進行最優化配置和選擇將是我們必須要面對的問題。

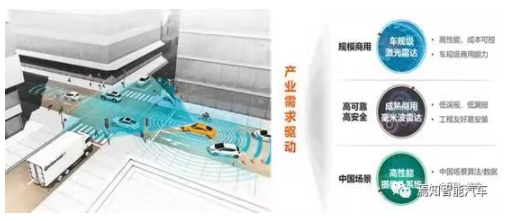

高階自動駕駛系統的傳感器仍然按照當前自動駕駛系統一樣,配置了包含毫米波雷達、攝像頭、激光雷達、超聲波雷達等傳感器配置。然而,在毫米波雷達、攝像頭、激光雷達的選擇上卻是增加了幾個臺階。首先,是毫米波雷達采用了4D高精度毫米波雷達,從分辨率角度得到質的飛躍。其次是,攝像頭采用了高清攝像頭,其分辨率的巨大提升使得其更加容易探測出更小的目標。最后,是激光雷達從原始的機械式激光雷達向MEMS甚至Flash激光雷達的轉變。

本文將針對如上三類傳感器的轉變詳細說明其對自動駕駛系統探測能力到底有哪些提升。

4D毫米波雷達優勢

從當前已經出過得自動駕駛事故(無論是特斯拉的大卡車相撞還是蔚來汽車主裝上高速作業車)中不難看出,高速自動駕駛最容易出現事故的地方就是在于傳感器對于靜止目標的識別上。當前,駕駛輔助系統架構常采用攝像頭融合毫米波雷達的方式進行檢測,而對于靜止目標的識別主要是依靠攝像頭的視覺檢測,由于視覺感知的目標都必須經過模塊或算法訓練,而數據模型中無法涵蓋所有類型目標數據,且識別過程中通常采用的圖像分割會把靜止目標當成背景區域而過濾到,因此,視覺檢測很難做到對目標的有效識別。

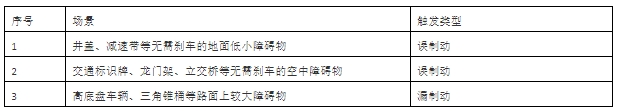

這時,很多情況下會依靠傳統毫米波雷達進行靜止目標檢測。而由于當前的毫米波雷達是不具備測高能力的,這就意味著其檢測過程中難以判斷前方靜止物體是在地面還是在空中,無法細化剎車場景,容易出現如下情況的誤檢測導致AEB誤制動或漏制動。

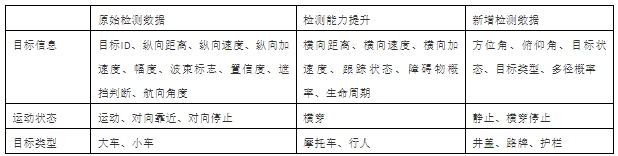

高階自動駕駛系統采用了4D毫米波雷達,其原理是指在原有距離、方位、速度的基礎上增加了對目標的高度維數據解析,能夠實現“3D+速度”四個維度的信息感知。主要的感知參數表示如下:

除開如上述的檢測能力外,4D毫米波雷達又稱為“成像雷達”,其中的成像概念是指其具備超高的分辨率,可以有效解析目標的輪廓、類別、行為。這意味著4D毫米波雷達系統可以適應更多復雜路況,包括識別較小的物體,被遮擋的部分物體以及靜止物體和橫向移動障礙物的檢測等。

具體來說,對于4D雷達來說是如何提升目標信息檢測能力從而提升自動駕駛系統控制能力的呢?

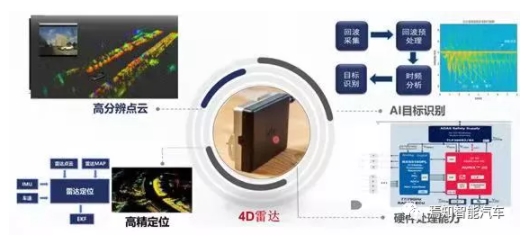

1、4D雷達高分辨率點云

首先,成像雷達可提供精度更高的道路邊緣信息,為高速行車與變道提供更精確的輔助定位信息;對靜止目標尤其是擁堵條件下目標探測精度更高,可以有效避免追尾等安全事故。

如何做到的呢?很多工程師以為是其分辨率提升促使其深度學習可以更好地利用在點云匹配學習算法中,但是筆者并不這么認為。因為再強的深度學習碰上毫米波雷達那樣稀疏的圖像也基本無能為力的,能檢測到靜止目標主要還是因為其能夠有效檢測高度信息。4D毫米波雷達增加了俯仰角天線通道,通常這種通道數的增加會使得其雷達芯片的運算量成倍的增加。

2、AI深度學習的目標識別

其次,自動駕駛中最難的場景之一是對于行人的識別能力,而當前的識別往往依賴于攝像頭,如果我們基于成像雷達的高分辨特征是否能夠對其行人的識別產生好的輔助效果呢?答案是肯定的。這個過程主要是結合行人擺臂、車輪轉動等微動特征,利用更高分辨率的時頻分析方法,提取目標的微多普勒信息,通過機器學習等目標分類方法,進行VRU目標的微多普勒識別。

3、基于毫米波雷達的高精定位

眾所周知,高精定位系統的檢測過程需要相應的傳感器建立密集的毫米波雷達點云信息,且依托于環境結構,且不受雨、雪、霧等環境因素的影響。而這些要素則是毫米波雷達本身所具備的能力。因此,利用毫米波雷達本身就可以進行簡單的定位建圖,這里我們稱之為RSLAM。而如果系統本身搭載了諸如激光雷達或高清攝像頭,則毫米波雷達的建圖能力可以很好的作為該兩者的輔助傳感器。

4、硬件處理能力

4D雷達成像主要的部件包括比3D雷達多更多的收發天線,同時最重要的是其雙板處理芯片:一塊用于RF收發器(主要是PCB板搭載的多跟收發天線)、SRAM數據采集和USB類型的數據流;另一個用于數據處理(包含基于點云的深度學習)和BT/Wi-Fi連接。因此,很多毫米波雷達供應商通常還采用芯片級聯或通過軟件新建虛擬發射天線的方式增加發射端對環境物體的點云信息搜集比率。一般的,高分辨成像雷達隨著級聯芯片的增多,點云密度與精度越來越高,通過人工智能(AI)中深度學習等在雷達的應用就帶來了更多優越的先驗條件(比如點云聚類),接近于視覺的分類效果。

高分辨率攝像頭是否能夠帶來質的飛躍

隨著整車E/E 架構的演化趨勢,傳感ECU 也開始由分布式向集中式進行演變,其中的算力也不再向以前一樣由各分ECU來承擔,而是由中央處理器進行集中式處理,這一過程中的計算機視覺及圖像處理則由中央域控制器進行軟件集成,而攝像頭將只用于“圖像采集”的純sensor。

隨著自動駕駛級別的提升,對攝像頭的要求也越來越高,其中主要體現在對攝像頭的分辨率上,從最開始30萬像素實現基本的全景泊車升級到100多萬像素實現半自動泊車,又發展到現在的200萬像素實現基本的行車對中控制。并且隨著自動駕駛級別對于感知能力的進一步提升需求以及市場需求的推動,未來的高級別自動駕駛車輛中都在規劃應用800萬級別的高清像素攝像頭,用于對更遠距離的目標進行識別和監測。

從基礎能力上看,升級為800萬攝像頭最大的挑戰在于其對感知算力的大幅提升。舉個例子,像地平線目前對800萬攝像頭的處理demo實驗,采用了J3對其進行算法處理,這無異于小馬拉大車,導致不得不將高分辨率圖像進行下裁剪。裁剪后的圖像其分辨率降低后,才可進行相應的包含語義分割、目標級匹配等處理。因此,類似高清車載攝像頭需要有與高分辨率攝像頭相匹配的算法和測試能力。

那么業界普遍關注的話題就是800萬像素攝像頭與算力、算法以及數據之間的關系。其中包括:

1、如果用高清攝像頭(如800萬像素)代替之前低分辨率攝像頭,需要多大算力的芯片的支持,對于整個域控制器的發熱量及功耗會有多大提升?

首先攝像頭對算力的需求不僅跟攝像頭自身的性能參數有關(位數、幀率、分辨率等),也和自動駕駛實際的應用場景和感知算法模型相關。

TOPS=Function(camera intrinsic parameters,usecase,perceptron algorithm)

比如,以前視為例,基于同樣分辨率的攝像頭,如果其應用場景僅限于識別車輛、行人、車道線、限速牌這幾類目標,由于其算法匹配庫中的模型是簡單的,因此其對算力的匹配需求來說是一個相對輕量級的。若其應用場景需要系統識別的更多目標(包含一些不常見或異類目標,如落石、不明障礙物、紅綠燈、路標)、探測的更遠距離(包含一些小動物、小障礙物等)、更高識別精度(如更加清晰的航向定位、更加準確的距離、速度),對于如上這類應用場景的算力需求肯定是更大量級的。

2、新的高清攝像頭是否需要將原來的算法結構進行大幅更新?

實際是使用高分辨率攝像頭后,在算法方面并不需要完全重寫,原有采集的數據可以作為深度學習模型的初始架構參數,而新采集的高分辨率圖像數據則可以作為深度學習模型中更新和優化其架構的參數的數據源。

對于如上的說法,需要充分考慮其低分辨率的攝像頭目標檢測算法是否已經應用到了AI神經網絡訓練算法,還是只是簡單的模式識別算法。因為,諸如像做L1或者L2這樣的簡單駕駛輔助功能,很多時候對于攝像頭的檢測能力只需要滿足簡單的車道線或者標準的車輛等一些簡單的檢測方案。這樣的檢測過程壓根可能不需要進行AI算法訓練和神經網絡加速,而是通過類似于構建ARM核進行邏輯運算便可以滿足要求(這樣就可以說SOC中的CPU資源就可以滿足)。因此,從算法復雜度,算法策略及算法構建的模型參數上考慮,高分辨率攝像頭都是沒辦法完全復用低分辨率攝像頭算法的。另外,從硬件資源上講,處理高分辨率攝像頭數據所需要的SOC往往是更高級的SOC,不僅其中的AI運算單元得到了極大的提升,而且其中的邏輯算力也是提升到了新的高度,這就導致對于原始低等級駕駛輔助系統所訓練的算法無法在新的SOC上做到很好的適配。因此,這也往往促使其改進相應的AI算法模型。另外,諸如像采用相同供應商的系列芯片這種方式,也有可能存在相類似的情況,比如當前采用地平線的J3進行算法訓練所產生的產品,到其升級到J5后,很有可能就會在當前算法的復雜度上實現較大的提升了。

3、當攝像頭傳感器得到升級后,低等級的自動駕駛系統架構采集的數據是否可以直接應用于高等級自動駕駛?

自動駕駛算法的構建和迭代都是以數據作為驅動的,尤其是感知和預測模塊,并且很多時候都是要在過程中做到很好的數據閉環。

自動駕駛的算法模塊,尤其是感知和預測模塊,基本都是數據驅動,可見數據對算法迭代的重要性。這里需要說明的是,很多智能駕駛算法公司都是前期通過數據采集進行算法訓練參數得到的,而低等級智能駕駛系統的數據采集往往采用了低等級的傳感器,不管是在分辨率、檢測距離、誤檢漏檢等方面均不及高等級自動駕駛。因此,對于高分辨率攝像頭檢測而言,除了需要通過之前采集的數據繼承低像素攝像頭的一些基礎性能外,也可以通過場景建模來實現部分場景重構。此外,對于一些極端場景,則需要利用高分辨率攝像頭進行數據采集和重新的算法訓練,進而無限的提升其檢測效果,實現數據閉環。

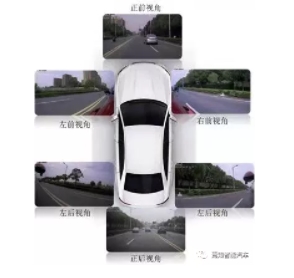

4、高分辨率攝像頭是只進行前裝(前視攝像頭)還是整個鋪開(側視、后視攝像頭)?

對于高階自動駕駛系統來說,前視需要解決的場景最多,目標識別任務最復雜,比如遠距離小目標識別,近距離目標切入識別,這兩者對于攝像頭的波束開角和分辨率都有較高的需求。對于側視和后視攝像頭來說,其感知場景的要求則相對簡單些,這兩者的主要需求都基本在對于自動變道場景的側后方目標探測上。因此,從成本和效率上講,側視/后視場景采用一般分辨率的攝像頭即可滿足要求。而對于環視攝像頭而言,通常是在中低速情況下通過大視角短距離檢測泊車入位的車道線和車輛目標。因此,采用中低分辨率攝像頭也能夠滿足目標探測要求。同理,對于智能座艙內的攝像頭,通常采用的是包含駕駛員在位識別、人臉識別、情緒識別等,基本上采用適中的攝像頭分辨率即可。

當然,對于如上攝像頭能力配置,可以在一定程度上通過模擬實際場景并通過算法迭代來找到最優值。比如,利用響應曲面法找到最優值。

5、相同探測要求下,攝像頭分辨率是不是越高越好?

其實不然,高分辨率攝像頭由于其探測范圍更遠、探測結果更清晰,且其具備更寬動態范圍(HDR)和更優質的LED頻閃消除功能(LFM)。但是其低光照強度下的感知效果相對會差一些。這是因為同等條件下,攝像頭分辨率越高,其單像素尺寸就會越小,這就導致其在低照度下的光電轉換效率就會低一些,從而影響在光照不足時攝像頭的表現。

此外,對于高清攝像頭在帶寬、數據量等方面的需求也是呈現指數級別的增長,這就導致其對于周邊關聯部件和網絡的需求也呈現較高的能力需求。因此,對于自動駕駛系統來說,在進行攝像頭方案選型時候需要在分辨率和探測效能上做一個權衡。

如何利用激光雷達優勢才能真正滿足自動駕駛需求

同樣是雷達,毫米波雷達的金屬反射電磁波性能遠比人體要高,因此針對像自行車或行人這樣的反射物在距離檢測車輛1.5米時,普通采用3發4收單片3D毫米波雷達對自行車也幾乎只能檢測到一個點,甚至檢測不到。即便是成像毫米波雷達,對于行人、錐桶這類物體也只是一個小點,普通雷達則完全檢測不到。從這一點上講,顯然成像毫米波雷達無法和激光雷達成像相提并論。激光雷達用于下一代自動駕駛系統可以極大程度地提升其系統探測能力,已經是一個不爭的事實。這方面的優勢主要體現在其優質的探測能力可以解決很多當前自動駕駛系統無法解決的一些邊緣場景,包括車輛Cut-in、檢測車后突出物、道路中的異形物等。

那么關于激光雷達,大家究竟關心什么?

其實,無論對于主機廠還是供應商,對激光雷達的要求無非就是性能(包含測距能力、精度、視場角、分辨率、刷新幀率、體積、功耗等參數)、可靠性(運行穩定性、一致性、是否符合車規級別)和成本(設計成本、物料成本、生產成本)。

1、探測距離與精度:

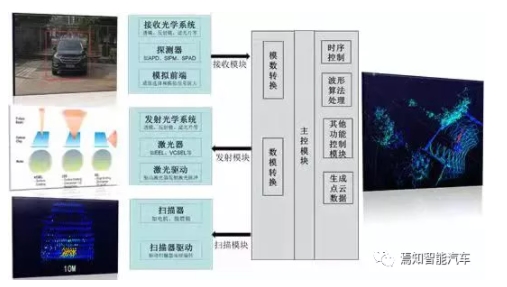

我們知道,激光雷達最重要的部分是收發模塊和掃描模塊。激光收發效率越高,信號處理能力越強,則測距能力越強。激光雷達實際使用中,測距能力也和被測物體的反射率相關,反射率越高,收到的反射光就越多,測距就越遠,測得的距離也越精確。因此,測距能力主要由收發模塊決定,包括激光器的發射功率、發射波段、探測器的探測靈敏度等。我們在額定探測距離及其精度的時候一定是附帶在某反射率下來談其探測目標的距離的。

2、探測范圍

探測范圍主要通過視場角、分辨率和刷新幀率來定義。視場角主要由激光雷達發射激光點的方向相關,而分辨率則是和發射點頻率相關。發射點頻率指的是激光雷達每秒完成探測并獲取的探測點的總數目,類似攝像頭的總像素的概念。因此,相同探測場景下,激光點頻越大,說明激光雷達對目標物的感知能力越好。

使用發射點頻率來描述可以很好的解決類似激光刷新率和視場角大小不均勻帶來的極端分辨率。

我們知道激光雷達的掃描都是采用二維掃描進行的。即包含水平掃描和垂直掃描,因此對于發射點頻來說,可以通過輸入的水平掃描和垂直掃描點綜合描述。

如上情況,要想提高激光點頻率,可以很大程度上提升刷新率,但是與之相反的是其分辨率也會很快下跌。因此,要想提高發射點頻率的唯一辦法就是提升激光雷達的發射本體性能,即發射內參來決定。這種廣義內參實際是激光雷達本體需要考慮激光器性能需求、總功耗、壽命以及激光芯片的信號的綜合處理能力。

3、功耗

激光雷達內部的電子模塊需要每秒在百萬次的量級上發設和接受光,并且每次收發都要經過復雜的模擬和數字電路處理把他轉化為3D點云信號。因此,該電子模塊需要大量的供電輸出。同時,由于激光雷達的探測能力很大程度上收到其探測表面是否干凈無雜質的影響,因此很多情況下要求激光雷達具備自清洗能力,而這一過程也是需要極高的電源供電能力的。

4、功能安全

激光雷達的可靠性主要取決于其收發模塊和掃描模塊,一般采用905nm的供應廠商,其收發模塊的電子元器件相對容易過車規,比如博世的激光雷達,可以達到整體ASILB的安全等級,而人眼激光保護的場合可以達到ASIL C。相比之下,基于1550nm收發模塊的器件都還處于相對早期,過車規挑戰大。

5、成本

最后,不得不回到激光雷達最關心的核心議題,那就是成本問題,這也是制約激光雷達搭載率的重要因素。由于激光雷達的掃描模塊很大程度上影響著其可靠性、穩定性。而收發模塊則很大程度上影響著其性能指標。因此,從維持其功能和性能的角度上講,激光雷達需要不斷優化其相應的收發模塊性能,從而在不增加成本的情況下增加其整體性能。

小結

從自動駕駛系統的傳感器先進性升級角度上看,將搭載高清攝像頭、優質的激光雷達、成像毫米波雷達來重點解決當前自動駕駛系統可能遇到的各種邊緣場景問題。其中,升級為4D毫米波雷達,算法便可更多考慮毫米波雷達的感知結果,從而以更高概率識別路面上的靜態障礙物,結合其高分辨率帶來的優勢,可以更有效地解析目標的輪廓、類別、行為,進而能知道在什么情況下必須剎車(避免漏剎)。視覺感知的挑戰在于,目標障礙物必須經過提前訓練,而模型庫又不可能窮舉所有類型,所以很多靜態障礙物成了“漏網之魚”,此外即使有模型庫,另一個挑戰在于神經網絡能否正確識別出前方障礙物。因此,便經常出現明明前方有障礙物、自動駕駛汽車卻依然撞上去的結果。高清攝像頭正好從一定程度上可以解決部分該問題,但是也要注意對攝像頭的選型需要遵循一定的原則。此外,從激光雷達的原理可以,激光雷達可以通過發射接收的點云自然的擬合出各種形狀的物體,但是,激光雷達的使用也是需要從成本、性能和功耗等各個角度統一考慮其搭載的可行性。