自動(dòng)駕駛中可解釋AI的綜述和未來(lái)研究方向

arXiv上2021年12月21日上傳的自動(dòng)駕駛可解釋AI的綜述:"Explainable Artificial Intelligence for Autonomous Driving: A Comprehensive Overview and Field Guide for Future Research Directions",作者來(lái)自加拿大Alberta大學(xué)和華為研發(fā)。

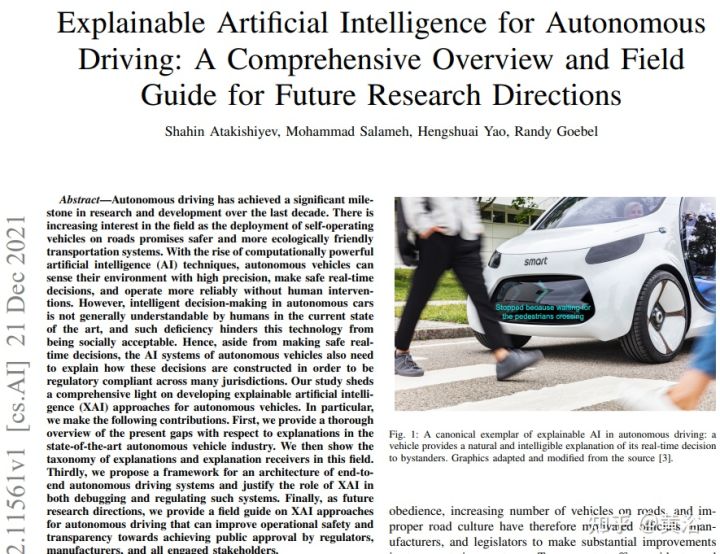

在過(guò)去十年中,自動(dòng)駕駛在研發(fā)方面取得了重大的里程碑。人們有興趣在道路上部署自行操作車(chē)輛,這預(yù)示著交通系統(tǒng)將更加安全和生態(tài)友好。隨著計(jì)算能力強(qiáng)大的人工智能(AI)技術(shù)的興起,自動(dòng)駕駛車(chē)輛可以高精度地感知環(huán)境,做出安全的實(shí)時(shí)決策,在沒(méi)有人為干預(yù)的情況下運(yùn)行更加可靠。

然而,在目前的技術(shù)水平下,自動(dòng)駕駛汽車(chē)中的智能決策通常不為人類(lèi)所理解,這種缺陷阻礙了這項(xiàng)技術(shù)被社會(huì)接受。因此,除了做出安全的實(shí)時(shí)決策外,自動(dòng)駕駛汽車(chē)的AI系統(tǒng)還需要解釋這些決策是如何構(gòu)建的,以便在多個(gè)政府管轄區(qū)內(nèi)符合監(jiān)管要求。

該研究為開(kāi)發(fā)自動(dòng)駕駛車(chē)輛的可解釋人工智能(XAI)方法提供了全面的信息。首先,全面概述了目前最先進(jìn)的自動(dòng)駕駛汽車(chē)行業(yè)在可解釋方面存在的差距。然后,展示該領(lǐng)域中可解釋和可解釋受眾的分類(lèi)。第三,提出了一個(gè)端到端自動(dòng)駕駛系統(tǒng)體系結(jié)構(gòu)的框架,并論證了XAI在調(diào)試和調(diào)控此類(lèi)系統(tǒng)中的作用。最后,作為未來(lái)的研究方向,提供自主駕駛XAI方法的實(shí)地指南,提高操作安全性和透明度,公開(kāi)獲得監(jiān)管機(jī)構(gòu)、制造商和所有密切參與者的批準(zhǔn)。

自動(dòng)駕駛可解釋的需求源自各種問(wèn)題和關(guān)注點(diǎn)。首先,自動(dòng)駕駛車(chē)輛參與發(fā)生的道路事故,是一個(gè)基本的實(shí)際問(wèn)題。由于粗心和危險(xiǎn)駕駛會(huì)直接影響乘客和旁觀者的安全,人們通常需要確認(rèn)安全運(yùn)輸系統(tǒng)。此外,對(duì)行為或決策來(lái)由的理解是人類(lèi)思維的自然要求。有專(zhuān)家說(shuō),“如果用戶(hù)不信任模型或預(yù)測(cè),他們將不會(huì)使用它。”在案例研究中,經(jīng)驗(yàn)證明提供可解釋和可察覺(jué)的系統(tǒng)可以顯著提高用戶(hù)對(duì)系統(tǒng)的信任。特別是,如果沒(méi)有向參與者提供可靠的解釋?zhuān)l繁發(fā)生的故障可能會(huì)嚴(yán)重?fù)p害個(gè)人和公眾對(duì)智能系統(tǒng)的信任。一旦對(duì)智能系統(tǒng)的信任被破壞,重新獲得信任可能會(huì)是一項(xiàng)艱巨的任務(wù)。因此,人類(lèi)自然希望了解特定場(chǎng)景中汽車(chē)的關(guān)鍵決策,以建立對(duì)汽車(chē)的信任。如果汽車(chē)智能決策的背后有信任,那么將進(jìn)一步支持另一個(gè)積極的組件,透明度。一旦提供了透明度,就達(dá)到了另一項(xiàng)要求,即可依賴(lài)(accountability ),這與該系統(tǒng)的決定和行動(dòng)是否符合管轄條例和標(biāo)準(zhǔn)有關(guān)。最后,這些積極因素促成公平性,對(duì)自主系統(tǒng)的決定性行動(dòng)進(jìn)行道德分析、支持和因果論證。這些組件及其相互關(guān)系可被視為實(shí)現(xiàn)自動(dòng)駕駛車(chē)輛獲得大眾認(rèn)可的基本因素。

根據(jù)自動(dòng)駕駛中用戶(hù)的身份和背景知識(shí),可解釋的細(xì)節(jié)、類(lèi)型和表達(dá)方式各不相同。例如,一個(gè)對(duì)自動(dòng)駕駛車(chē)輛如何運(yùn)行缺乏專(zhuān)業(yè)知識(shí)的用戶(hù),可能會(huì)對(duì)相關(guān)決策/結(jié)果的簡(jiǎn)單解釋感到滿(mǎn)意。然而,自主系統(tǒng)工程師需要更多信息的解釋?zhuān)私馄?chē)當(dāng)前的可操作性,并根據(jù)需要適當(dāng)?shù)?ldquo;調(diào)試”現(xiàn)有系統(tǒng)。因此,解釋受眾的領(lǐng)域知識(shí)和知識(shí)特點(diǎn)對(duì)于提供恰當(dāng)?shù)摹⒂谐浞中畔⒌暮涂衫斫獾慕忉屩陵P(guān)重要。

以下就是一些可解釋性的影響因素:

- cause filters

- content type

- model

- system type

- interactivity

- concrete scope

下面是自動(dòng)駕駛各個(gè)模塊的可解釋性方法:

1 感知

正如準(zhǔn)確感知環(huán)境是自主駕駛的基本要求一樣,提供自主行動(dòng)決策的基本解釋對(duì)于理解場(chǎng)景導(dǎo)航和駕駛行為也至關(guān)重要,特別是在關(guān)鍵場(chǎng)景中。因此,在自動(dòng)駕駛車(chē)輛的感知任務(wù)中需要提供可解釋性方法。

一些研究用視覺(jué)注意的反省(introspective )文本描述尋求因果(post-hoc)解釋?zhuān)恍┭芯堪呀忉屪鳛樯婕耙蚬评淼娜祟?lèi)行為描述,另一些研究將重點(diǎn)放在目標(biāo)誘導(dǎo)(object-induced)的行為決策。

另一種基于感知的解釋生成方法是理解卷積神經(jīng)網(wǎng)絡(luò)(CNN)的結(jié)果。這種方法背后的主要思想是測(cè)量和顯示從神經(jīng)網(wǎng)絡(luò)輸出層反向傳播(BP)到輸入層的梯度。基于梯度的解釋方法示例包括Class Activation Map(CAM),其增強(qiáng)變型,如 Guided Grad-CAM、Grad-CAM、Grad-CAM++、Smooth Grad CAM++,以及基于反向傳播的方法,如引導(dǎo)(guided)反向傳播、分層相關(guān)(layered relevance )傳播,VisualBackProp和DeepLift。此外,基于啟發(fā)式的Deep Visual Explanations(DVE)為深度CNN的預(yù)測(cè)提供了合理的理由。基于計(jì)算機(jī)視覺(jué)的可解釋自動(dòng)駕駛系統(tǒng)綜述,見(jiàn)valeo公司的文章“Explainability of vision-based autonomous driving systems: Review and challenges”。

2 定位

由于自動(dòng)車(chē)輛的實(shí)時(shí)決策需要準(zhǔn)確地感知道路位置,因此了解如何從不同導(dǎo)航系統(tǒng)和傳感器獲取車(chē)輛位置也至關(guān)重要。這就是定位還需要解釋性的原因。需要了解自動(dòng)駕駛車(chē)輛的誘發(fā)位置,特別是當(dāng)來(lái)自GPS或其他傳感器的信號(hào)不精確時(shí)候。這種不可靠的通信通道可能因此迫使自動(dòng)駕駛汽車(chē)做出錯(cuò)誤的高風(fēng)險(xiǎn)決策。因此,調(diào)試導(dǎo)航系統(tǒng)和相關(guān)傳感器,有助于阻止不準(zhǔn)確的信號(hào),并為自動(dòng)駕駛汽車(chē)的縱向-橫向正確定位提供可靠的通信渠道。

3 規(guī)劃

規(guī)劃決策的可解釋性綜述見(jiàn)論文”The emerging landscape of explainable automated planning & decision making“,來(lái)自IBM和Arizona州立大學(xué)。

之前的一個(gè)Explainable AI Planning (XAIP) 研討會(huì),其議程特別說(shuō)到”雖然XAI主要關(guān)注基于黑盒學(xué)習(xí)的方法,但基于模型的方法非常適合——可以說(shuō)更適合——作為可解釋性,XAIP可以幫助用戶(hù)在復(fù)雜決策過(guò)程與AI技術(shù)交互,發(fā)揮重要作用。“

摘自該綜述,其可解釋性方法如下分類(lèi):

- 基于算法 Algorithm-based explanations

- 基于模型 Model-Based Explanations

- 推理調(diào)和 Inference Reconciliation

- 模型調(diào)和 Model Reconciliation (user mental model)

- 基于規(guī)劃 Plan-based explanations

可解釋性的性質(zhì)包括:

- Social

- Contrastive

- Selective

- Local

- Global

- Abstraction

- User Study

4 控制

由于車(chē)輛控制最終反映了駕駛系統(tǒng)的高級(jí)決策,用戶(hù)可能需要及時(shí)解釋實(shí)時(shí)自動(dòng)行動(dòng)選擇的基本原理。這一需求將可解釋性的本質(zhì)引入到自動(dòng)化車(chē)輛的控制系統(tǒng)中。車(chē)內(nèi)界面、儀表板和其他用戶(hù)友好功能,可幫助用戶(hù)提出“為什么”問(wèn)題(例如,“為什么停在右側(cè)?”),或?qū)Ρ葐?wèn)題(例如,“為什么選擇這條路線(xiàn)而不是另一條路線(xiàn)?”),反事實(shí)(counterfactual )問(wèn)題(例如,“如果選擇了該路線(xiàn)而不是當(dāng)前路線(xiàn),怎么辦?”)和描述性問(wèn)題(例如,“十分鐘后會(huì)在哪里?”)。

另外,作者提出一個(gè)XAI框架,集成了自主控制、可解釋性和法規(guī)遵從性。如圖所示:包括可調(diào)節(jié)的自動(dòng)駕駛?cè)齻€(gè)組成部分,一個(gè)端到端自動(dòng)控制系統(tǒng)組件(eeC,把感知的環(huán)境映射到車(chē)輛的動(dòng)作),一個(gè)安全法規(guī)遵從性組件(srC,代表監(jiān)管機(jī)構(gòu)職能,主要職責(zé)之一是驗(yàn)證eeC與自動(dòng)車(chē)輛動(dòng)作任意組合的安全性。主要通過(guò)軟件模擬仿真和實(shí)際駕駛驗(yàn)證),和一個(gè)XAI組件(XAI指導(dǎo)的自主駕駛應(yīng)該在最高層反映出一種學(xué)習(xí)到的軟件體系結(jié)構(gòu)和監(jiān)管原則)。

自動(dòng)駕駛XAI,就是定義為AI驅(qū)動(dòng)方法的概要(compendium):1)確保車(chē)輛實(shí)時(shí)決策的可接受安全,2)提供關(guān)鍵交通場(chǎng)景中動(dòng)作決策的可解釋性和透明度,以及3)遵守監(jiān)管機(jī)構(gòu)制定的所有交通規(guī)則。

最后,作者提出一個(gè)現(xiàn)場(chǎng)指導(dǎo):引導(dǎo)XAI追隨自動(dòng)駕駛的目標(biāo),其包括以下四部分

- 可解釋的視覺(jué)(包括因果解釋和基于計(jì)算的并發(fā)解釋?zhuān)?/b>

描述自然語(yǔ)言的歷史以及所采取的每個(gè)相關(guān)行動(dòng),有助于給關(guān)鍵交通場(chǎng)景提供可靠的因果解釋。另外,基于生成可解釋模型的并發(fā)解釋可大大有助于事故預(yù)防。比如:假設(shè)自動(dòng)駕駛車(chē)輛有車(chē)內(nèi)人員(即后補(bǔ)駕駛員或乘客);車(chē)輛提供一個(gè)緊急使用的控制(即停止)按鈕;車(chē)內(nèi)界面顯示前方?jīng)]有人橫穿道路并繼續(xù)行駛;但是前面發(fā)現(xiàn)有一個(gè)人在路上(即視覺(jué)系統(tǒng)故障);然后,車(chē)內(nèi)人員及時(shí)發(fā)現(xiàn)這種異常情況,使用緊急按鈕減速和/或停車(chē),防止事故發(fā)生。這個(gè)簡(jiǎn)單的例子表明,并發(fā)解釋的概念在自動(dòng)駕駛中具有潛在的用途,并為車(chē)輛的安全導(dǎo)航提供了機(jī)會(huì)。

- 基于強(qiáng)化學(xué)習(xí)(RL)的可解釋狀態(tài)-動(dòng)作映射(自動(dòng)駕駛基于MDP的軌跡串行決策)

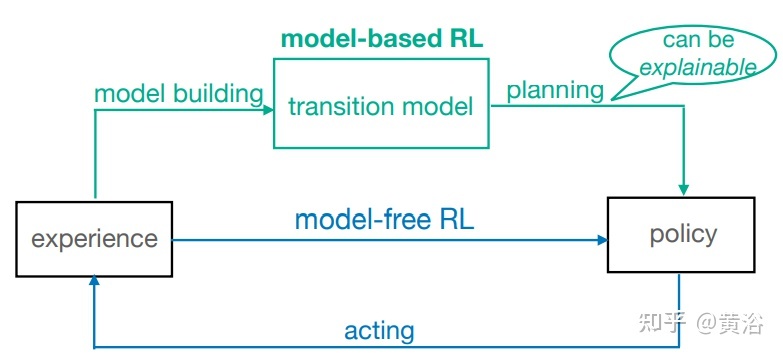

如圖是基于模型和無(wú)模型這兩種RL在可解釋性方面的比較:除了模仿學(xué)習(xí),這兩種RL的比較可以看到,基于模型RL的優(yōu)點(diǎn)是,智體首先學(xué)習(xí)環(huán)境的模型,并根據(jù)環(huán)境的動(dòng)態(tài)性調(diào)整其學(xué)習(xí)策略。這種有針對(duì)性的探索(exploration )通常被稱(chēng)為規(guī)劃,從本質(zhì)上說(shuō)可以解釋學(xué)習(xí)過(guò)程。

RL中的規(guī)劃思想對(duì)于正確決策至關(guān)重要,以Dyna體系結(jié)構(gòu)為例:Dyna及其變型,即線(xiàn)性Dyna體系結(jié)構(gòu),與世界交互學(xué)習(xí)最優(yōu)策略的同時(shí),也學(xué)習(xí)世界模型。Dyna的規(guī)劃過(guò)程從最初提供的假想(imaginary )狀態(tài)創(chuàng)建預(yù)測(cè)的未來(lái)軌跡。基于這種結(jié)構(gòu),模型投影生成最優(yōu)行為,同時(shí)生成預(yù)測(cè)狀態(tài)和預(yù)測(cè)獎(jiǎng)勵(lì)。最后兩個(gè)組件可以被可視化和分析,作為解釋的基礎(chǔ),幫助理解為什么智體喜歡在特定的時(shí)刻選擇特定的動(dòng)作。由于自動(dòng)駕駛的每個(gè)(關(guān)鍵)動(dòng)作可能需要直觀的解釋?zhuān)虼耍珼yna體系結(jié)構(gòu)和基于模型的RL,通常可以通過(guò)其可解釋性功能提供巨大的益處。

- 知識(shí)表征的預(yù)測(cè)知識(shí)(在RL框架下)

通用價(jià)值函數(shù)(GVF),是表示預(yù)測(cè)知識(shí)(predictive knowledge)的初步技術(shù)。根據(jù)定義,GVFs旨在獲取RL智體實(shí)際觀察結(jié)果的長(zhǎng)時(shí)預(yù)測(cè)總結(jié)。例如,自主駕駛中的RL智體可能會(huì)提出問(wèn)題,并用GVF表達(dá)相應(yīng)的答案。例子有“在下一個(gè)十字路口不遇到紅燈的可能性有多大?”或者“根據(jù)目前的駕駛策略,到達(dá)目的地預(yù)計(jì)時(shí)間是多少?”

- 在動(dòng)作中包含常識(shí)知識(shí)(包括時(shí)域問(wèn)題和問(wèn)題驅(qū)動(dòng)的軟件分層結(jié)構(gòu))

分層軟件架構(gòu)是一種支持可解釋自主駕駛決策系統(tǒng)的合適結(jié)構(gòu)。這樣的結(jié)構(gòu)直接反映了人類(lèi)司機(jī)開(kāi)車(chē)時(shí)的想法,例如,“交通燈會(huì)很快從綠色變?yōu)辄S色嗎?”或者“前面的行人打算過(guò)馬路嗎?”或者“前面的車(chē)會(huì)加速嗎?”諸如這樣一些代表性的問(wèn)題,反映了在運(yùn)動(dòng)過(guò)程中與駕駛相關(guān)的考量。根據(jù)這種直覺(jué),可以說(shuō),自動(dòng)駕駛汽車(chē)的分層軟件系統(tǒng)是問(wèn)題驅(qū)動(dòng)型。

可解釋性軟件系統(tǒng)應(yīng)反映所采取時(shí)域行為的時(shí)域問(wèn)題。與這種體系結(jié)構(gòu)相對(duì)應(yīng)而合適的RL方法是選項(xiàng)(options )的概念。options 是動(dòng)作的泛化,在這些動(dòng)作中,RL智體有一個(gè)執(zhí)行一個(gè)動(dòng)作帶終端狀態(tài)的策略。最近提出的選項(xiàng)-批評(píng)(option-critic)架構(gòu)是基于options 的概念。該體系結(jié)構(gòu)可以學(xué)習(xí)內(nèi)部策略和options 的終端狀態(tài),在Arcade learning Environment(ALE)中的options 端到端學(xué)習(xí),證明是有效的。選項(xiàng)-批評(píng)架構(gòu)的固有結(jié)構(gòu),使其適合于自主車(chē)輛學(xué)習(xí)系統(tǒng)的進(jìn)一步開(kāi)發(fā)。

駕駛相關(guān)問(wèn)題通常是暫時(shí)性的,幾秒鐘后就可以為后續(xù)行動(dòng)生成新問(wèn)題。駕駛決策的時(shí)間敏感性實(shí)時(shí)動(dòng)態(tài)變化,使車(chē)輛面臨不同程度的風(fēng)險(xiǎn)。當(dāng)然,風(fēng)險(xiǎn)較低的動(dòng)作是首選。然而,在時(shí)間和計(jì)算方面,我們需要有效地探索,評(píng)估和相應(yīng)動(dòng)作相關(guān)的風(fēng)險(xiǎn)水平:僅關(guān)注增加RL獎(jiǎng)勵(lì),長(zhǎng)時(shí)有可能不會(huì)帶來(lái)預(yù)期動(dòng)作。

在傳統(tǒng)的RL中,只考慮獎(jiǎng)勵(lì)而不考慮風(fēng)險(xiǎn)作為衡量標(biāo)準(zhǔn),并不總是自動(dòng)化系統(tǒng)的完美決策,并且RL智體可能無(wú)法通過(guò)這種探索找到最優(yōu)策略。相比之下,將不同級(jí)別的風(fēng)險(xiǎn)與相應(yīng)的動(dòng)作結(jié)合起來(lái),有助于通過(guò)不同的過(guò)渡(transition)和獎(jiǎng)勵(lì),在環(huán)境中動(dòng)態(tài)發(fā)現(xiàn)最優(yōu)策略。因此,構(gòu)建良好的問(wèn)題層次結(jié)構(gòu)和評(píng)估與適當(dāng)動(dòng)作相關(guān)的風(fēng)險(xiǎn)水平,在關(guān)鍵交通環(huán)境中有助于對(duì)智能車(chē)輛做出及時(shí)、直觀、豐富且可信賴(lài)的解釋。