人臉神經輻射場的掩碼編輯方法NeRFFaceEditing,不會三維建模也能編輯立體人臉

想要個性化設計高真實感的三維立體人臉,卻發現自己并不熟悉專業的設計軟件?三維人臉編輯方法 NeRFFaceEditing 提供了新的解決方案,即使不會三維建模,也能自由編輯高真實感的立體人臉,建模元宇宙中的個性化數字肖像!

NeRFFaceEditing 由中科院計算所和香港城市大學的研究人員合作完成,相關技術論文在計算機圖形學頂級會議 ACM SIGGRAPH Asia 2022 上發表。

項目主頁:http://geometrylearning.com/NeRFFaceEditing/

NeRFFaceEditing 將二維的語義掩碼作為三維幾何編輯的橋梁,用戶在一個視角下進行的語義編輯可以傳播到整個三維人臉的幾何,并保持材質不變。進一步,給定表示參考風格的圖像,用戶可以輕松的更改整個三維人臉的材質風格,并保持幾何不變。

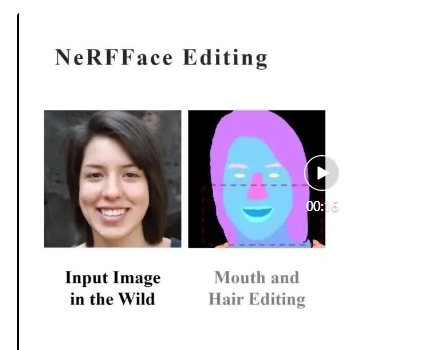

基于該方法的三維人臉編輯系統,即使用戶不熟悉專業的三維設計,也可以輕松進行個性化的人臉設計,自定義人臉形狀和外觀。先來看兩個使用 NeRFFaceEditing 的驚艷效果!

?圖 1 幾何編輯效果:二維語義掩碼上的編輯傳播到整個三維幾何空間

圖 2 風格遷移效果:將給定風格作用到整個人臉三維空間上而保持幾何不變

Part I 背景

近些年,隨著神經輻射場 [1] 與對抗式生成網絡 [2] 的結合,各種高質量、快速渲染的三維人臉生成網絡被提出,其中包括 EG3D [3]。

圖 3 EG3D 的不同視角的生成效果與幾何表示

該方法的三平面表示結合了傳統的二維生成對抗網絡和最新的三維隱式表征,因此繼承了 StyleGAN [4] 的強大生成能力和神經輻射場的表征能力。但是,這些生成模型并不能對人臉的幾何和材質進行解耦控制,而解耦控制幾何和材質是三維角色設計等應用不可或缺的功能。

已有工作,如 DeepFaceDrawing [5]、DeepFaceEditing [6] 可以實現基于線稿的幾何和材質的解耦控制及二維人臉圖像的生成與編輯。DeepFaceVideoEditing [7] 則將線稿編輯應用到人臉視頻,能在時序上生成豐富的編輯效果。

但是,圖像的解耦與編輯方法,很難直接應用至三維空間。而現有的三維人臉的幾何和材質解耦方法往往需要重新訓練網絡參數,而且使用的空間表示方法有較大的局限性,缺少三平面表示的良好性質。為了解決上述的問題,NeRFFaceEditing 在三平面表示的三維生成對抗網絡的預訓練模型參數的基礎上,利用任意視角的二維語義掩碼作為媒介,實現對三維人臉進行幾何編輯和對材質的解耦控制。

Part 2 NeRFFaceEditing 的算法原理

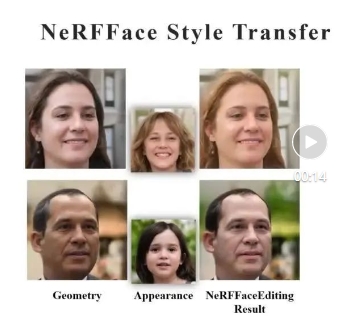

在三平面生成器生成出三平面之后,啟發自 AdaIN [8],即對于二維的特征圖(Feature Map),它的統計數據可以表示它的風格,NeRFFaceEditing 將三平面分解為表達空間上不變的高層次材質特征的均值和標準差 (a),以及表達空間上變化的幾何特征的標準化的三平面。結合標準化的三平面與分解出的材質特征 (a) 可以還原出原本的三平面。因此,如果給定不同的材質特征,即可賦予同一幾何不同的材質。

更進一步,為了實現對于幾何和材質的解耦控制,NeRFFaceEditing 將原始的單個解碼器分解為了幾何解碼器和材質解碼器。幾何解碼器輸入從標準化三平面采樣得到的特征,預測密度和語義標簽,用于表達三維人臉的幾何和語義掩碼體(Volume)。而幾何特征與材質特征 (a) 通過可控制的材質模塊(CAM)模塊組合后,再從中采樣特征輸入材質解碼器預測顏色。最后通過體渲染,得到某一視角下的人臉圖像與對應的語義掩碼。而在給定一個不同的材質特征 (b) 的情況下,幾何特征與材質特征 (b) 通過 CAM 模塊和體渲染可以得到另一張幾何不變而材質改變的人臉圖像。整體網絡結構如下圖所示:

圖 4 NeRFFaceEditing 的網絡架構

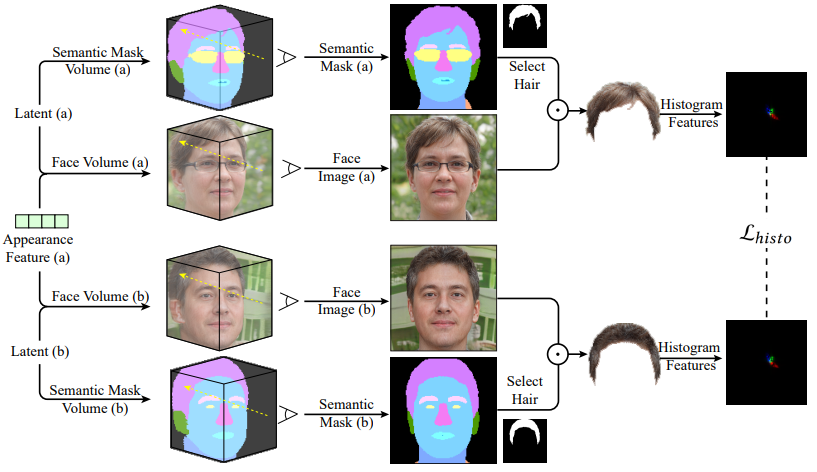

除此之外,為了約束擁有同一材質特征,但幾何不同的樣本渲染結果在材質上相似,NeRFFaceEditing 利用生成好的語義掩碼,使用直方圖特征來分別表示這些材質特征相同,幾何不同的樣本不同臉部組成部分,例如頭發、皮膚等,在顏色上的分布。然后優化這些樣本在各個組成部分上顏色分布的距離和。如下圖所示:

圖 5 材質相似約束訓練策略

Part 3 效果展示與實驗對比

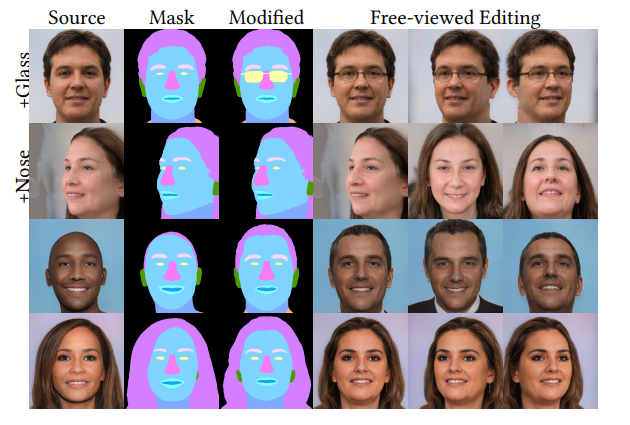

使用 NeRFFaceEditing,可以借助二維的語義掩碼對三維人臉空間進行幾何編輯:

圖 6 三維人臉幾何編輯

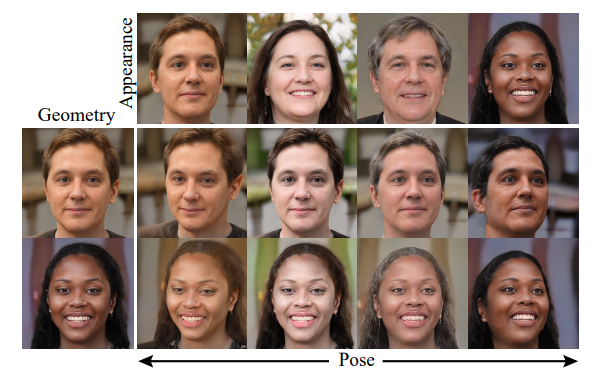

除此之外,還可以基于參考圖片,進行三維一致的三維空間內材質風格遷移:

圖 7 三維人臉風格遷移

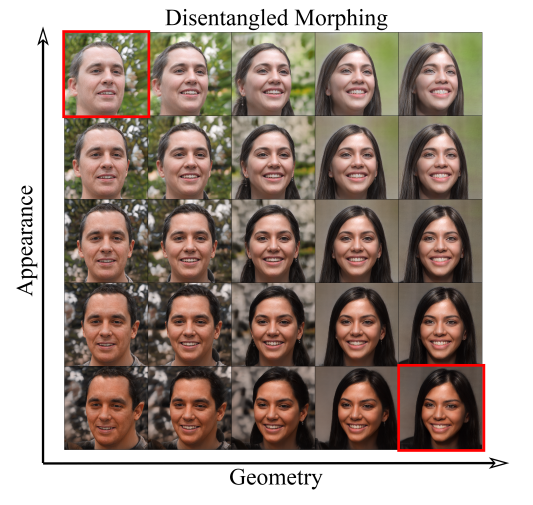

在此基礎上,可以實現解耦的人臉插值變形應用,如下圖以左上角和右下角作為起止點,對相機、幾何、材質進行線性插值:

圖 8 解耦人臉變形效果展示

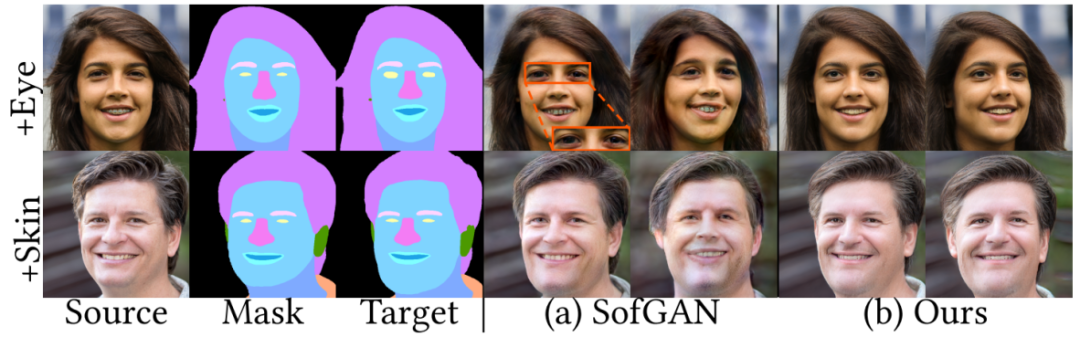

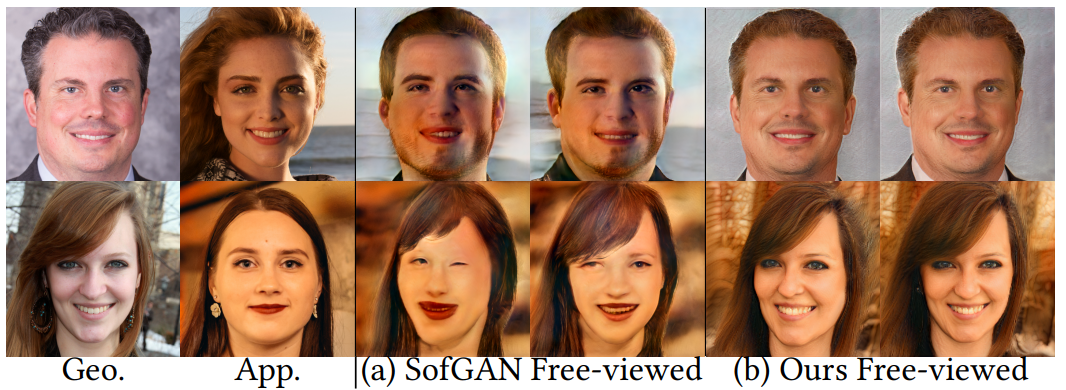

借助 PTI [9] 將真實圖像反投影到 NeRFFaceEditing 的隱空間,也可以實現對于真實圖像的編輯和風格遷移。借此,NeRFFaceEditing 也與其他可以控制視角的對人臉進行編輯的開源方法,即 SofGAN [10] 進行了比較,證明了方法的優越性。

圖 9 真實圖像三維幾何編輯的例子。可以看到 NeRFFaceEditing 的真實性優于 SofGAN,而且 SofGAN 在其他視角上對于身份有一定的改變。

圖 10 真實圖像風格遷移的例子。可以看到 SofGAN 有一定的瑕疵,而且在身份上有一定變化。

Part 4 結語與致謝

數字內容生成在工業制作和數字媒體領域有著廣泛的應用,尤其是虛擬數字人的生成與編輯,在近期受到了廣泛的關注,而三維人臉幾何與材質的解耦編輯就是在個性化塑造真實的虛擬形象上一種可能的解決手段。

NeRFFaceEditing 系統,通過對三維人臉生成網絡進行解耦設計,可以將用戶在二維視角上對于語義掩碼的修改,轉變為對于整個三維空間的幾何修改,并且保證材質不改變。除此之外,借助對于風格遷移效果強化的訓練策略,可以實現有效的三維空間內材質風格遷移。NeRFFaceEditing 的論文已經被計算機圖形學頂級會議 ACM SIGGRAPH ASIA 2022 錄用。

該項目研究團隊包括中科院計算所菁英班本科生同學蔣楷文(第一作者),高林副研究員(本文通訊作者)、陳姝宇博士和香港城市大學傅紅波教授等,有關論文的更多細節,請瀏覽項目主頁:

?http://geometrylearning.com/NeRFFaceEditing/?