終于,喬姆斯基出手了:追捧ChatGPT是浪費(fèi)資源

ChatGPT 掀起了科技領(lǐng)域最新的一輪軍備競(jìng)賽,但留給 AI 領(lǐng)域的議題還有很多:ChatGPT 是一種真正的創(chuàng)新嗎?是否意味著初步的通用人工智能?很多學(xué)者持有不同看法,這種討論隨著新技術(shù)的熱度而愈發(fā)熱烈。

那么語(yǔ)言學(xué)領(lǐng)域的大佬們?nèi)绾慰创?ChatGPT 的進(jìn)步呢?特別是喬老爺子 —— 語(yǔ)言學(xué)巨頭喬姆斯基。

近日,美國(guó)哲學(xué)家、語(yǔ)言學(xué)家、認(rèn)知科學(xué)家諾姆?喬姆斯基、劍橋大學(xué)語(yǔ)言學(xué)教授 Ian Roberts 以及科技公司 Oceanit 人工智能總監(jiān) 、哲學(xué)家 Jeffrey Watumull 在《紐約時(shí)報(bào)》撰文,對(duì)大語(yǔ)言模型的缺陷進(jìn)行了批判。

為了追趕 ChatGPT 的步伐,谷歌發(fā)布了 Bard,微軟也推出了 Sydney。喬姆斯基承認(rèn),OpenAI 的 ChatGPT、谷歌的 Bard 和微軟的 Sydney 都是機(jī)器學(xué)習(xí)的奇跡。

籠統(tǒng)地說(shuō),它們獲取大量數(shù)據(jù),在其中搜索規(guī)律,并越來(lái)越熟練地生成統(tǒng)計(jì)上可能的輸出 —— 比如看似人性化的語(yǔ)言和思想。

這些程序被譽(yù)為通用人工智能地平線(xiàn)上的第一縷曙光 —— 那是一個(gè)長(zhǎng)期預(yù)言的時(shí)刻,屆時(shí)機(jī)械思維不僅會(huì)在處理速度和內(nèi)存大小方面超越人類(lèi)大腦,而且還會(huì)在洞察力、藝術(shù)創(chuàng)造力,以及所有其他獨(dú)特的人類(lèi)能力方面上超越人類(lèi)。

但喬姆斯基更多的觀點(diǎn)在于批判,特別是對(duì)于 ChatGPT 的能力缺陷和道德水準(zhǔn):「今天,我們?cè)谌斯ぶ悄芊矫嫠^的革命性進(jìn)步確實(shí)令人既擔(dān)憂(yōu)又樂(lè)觀。樂(lè)觀,是因?yàn)橹腔凼俏覀兘鉀Q問(wèn)題的手段,擔(dān)憂(yōu)是因?yàn)槲覀儞?dān)心最流行和最時(shí)髦的人工智能 —— 機(jī)器學(xué)習(xí),將通過(guò)將有根本缺陷的語(yǔ)言和知識(shí)概念納入我們的技術(shù),而降低我們的科學(xué)水平并拉低我們的道德規(guī)范。」

客觀上,那一天可能終究會(huì)到來(lái),但曙光還沒(méi)有出現(xiàn),這與夸張的新聞標(biāo)題和不明智的投資所預(yù)料的情況正好相反。

現(xiàn)在,讓我們看看喬姆斯基的文章還說(shuō)了什么。

ChatGPT 缺乏任何智能的關(guān)鍵能力

阿根廷作家豪爾赫?路易斯?博爾赫斯(Jorge Luis Borges)曾寫(xiě)道,生活在一個(gè)既充滿(mǎn)危險(xiǎn)又充滿(mǎn)希望的時(shí)代,既是悲劇又是喜劇,在理解我們自己和這個(gè)世界時(shí)「啟示迫在眉睫」。

「如果像 ChatGPT 這樣的機(jī)器學(xué)習(xí)程序繼續(xù)主導(dǎo)人工智能領(lǐng)域,博爾赫斯式的理解啟示沒(méi)有且未來(lái)也不會(huì)發(fā)生。」

不管這些程序在某些狹窄的領(lǐng)域中多么有用(例如,它們可以在計(jì)算機(jī)編程中有所幫助,或者在為詩(shī)詞押韻建議方面很有幫助),我們從語(yǔ)言學(xué)和知識(shí)哲學(xué)中知道它們與人類(lèi)推理和實(shí)用語(yǔ)言的方式有很大的不同。這些差異極大地限制了這些程序的功能,使它們帶有無(wú)法根除的缺陷。

正如博爾赫斯可能指出的那樣,如此多的金錢(qián)和注意力被集中在這么小的一件事上,這既是喜劇又是悲劇 —— 與人類(lèi)的思想相比,這是微不足道的,用德國(guó)哲學(xué)家威廉?馮?洪堡的話(huà)來(lái)說(shuō),人類(lèi)的思想是通過(guò)語(yǔ)言,可以「無(wú)限地使用有限的手段」,創(chuàng)造出具有普遍影響力的思想和理論。

人腦不像 ChatGPT 及其同類(lèi)產(chǎn)品那樣,是一個(gè)笨拙的模式匹配統(tǒng)計(jì)引擎,吞噬數(shù)百 TB 的數(shù)據(jù)并推斷出最可能的對(duì)話(huà)響應(yīng)或最可能的科學(xué)問(wèn)題答案。相反,人的大腦是一個(gè)非常高效甚至優(yōu)雅的系統(tǒng),只需要少量信息即可運(yùn)作;它不尋求推斷數(shù)據(jù)點(diǎn)之間的直接相關(guān)性,而是尋求解釋。

比如一個(gè)正在學(xué)習(xí)一門(mén)語(yǔ)言的小孩正在無(wú)意識(shí)地、自動(dòng)地、快速地從極小的數(shù)據(jù)中發(fā)展出一種語(yǔ)法,一種由邏輯原則和參數(shù)組成的極其復(fù)雜的系統(tǒng)。這種語(yǔ)法可以理解為先天的、遺傳安裝的「操作系統(tǒng)」的表達(dá),它賦予人類(lèi)產(chǎn)生復(fù)雜句子和長(zhǎng)串思路的能力。

當(dāng)語(yǔ)言學(xué)家試圖發(fā)展一種理論來(lái)解釋為什么給定的語(yǔ)言會(huì)這樣工作時(shí)(為什么這些 —— 而不是那些句子被認(rèn)為是合乎語(yǔ)法的?),他們正在有意識(shí)地、費(fèi)力地構(gòu)建孩子本能構(gòu)建的語(yǔ)法的明確版本,同時(shí)在這個(gè)過(guò)程中盡可能少地接觸信息。孩子的操作系統(tǒng)與機(jī)器學(xué)習(xí)程序的操作系統(tǒng)完全不同。

實(shí)際上,ChatGPT 這樣的程序停留在認(rèn)知進(jìn)化前的人類(lèi)或非人類(lèi)階段。它們最深的缺陷是缺乏任何智能的關(guān)鍵能力:不僅可以說(shuō)出情況是什么、已經(jīng)發(fā)生了什么以及將要發(fā)生什么 —— 這是描述和預(yù)測(cè) —— 而且還可以說(shuō)出這種情況不是什么,以及可能發(fā)生什么,不應(yīng)發(fā)生什么。這些是解釋的成分,是真正智慧的標(biāo)志。

這里有一個(gè)例子:假設(shè)你手里拿著一個(gè)蘋(píng)果,現(xiàn)在讓蘋(píng)果掉下來(lái),你觀察結(jié)果并說(shuō):「蘋(píng)果掉下來(lái)了。」這就是一種描述。預(yù)測(cè)的說(shuō)法則是「如果我張開(kāi)手,蘋(píng)果就會(huì)掉下來(lái)」。兩者都是有價(jià)值的,而且都可能是正確的。

但解釋意味著更多的東西。它不僅包括描述和預(yù)測(cè),還包括反事實(shí)的猜想,如 「任何這樣的物體都會(huì)掉下來(lái)」,再加上附加條款「因?yàn)橐Α够颉敢驗(yàn)闀r(shí)空的曲率」或其他,這就是一個(gè)因果解釋。「如果不是因?yàn)橐ΓO(píng)果就不會(huì)掉下來(lái)」,這就是思維。

機(jī)器學(xué)習(xí)的核心是描述和預(yù)測(cè);它沒(méi)有提出任何因果機(jī)制或物理規(guī)律。當(dāng)然,任何人類(lèi)式的解釋都不一定正確;我們是易變的。但這也是思考的部分含義:要想正確,必須有可能出錯(cuò)。智能不僅包括創(chuàng)造性的猜想,也包括創(chuàng)造性的批評(píng)。人類(lèi)式的思考是基于可能的解釋和糾錯(cuò),這個(gè)過(guò)程逐漸限制了可以理性地考慮的可能性。

正如夏洛克?福爾摩斯對(duì)華生所說(shuō):「當(dāng)你排除了不可能,剩下的任何東西,無(wú)論多么不可能,都肯定是真理。」

但是從設(shè)計(jì)上來(lái)說(shuō),ChatGPT 和類(lèi)似的程序在它們能夠「學(xué)習(xí)」(也就是記憶)的內(nèi)容方面是沒(méi)有限制的;它們沒(méi)有能力區(qū)分「可能」和「不可能」。例如,人類(lèi)被賦予了一種通用的語(yǔ)法,將我們能夠?qū)W習(xí)的語(yǔ)言限制在某種近乎數(shù)學(xué)的優(yōu)雅上,而這些程序則以同樣的方式學(xué)習(xí)人類(lèi)可能的和不可能的語(yǔ)言。人類(lèi)在我們可以合理猜測(cè)的解釋種類(lèi)方面受到限制,而機(jī)器學(xué)習(xí)系統(tǒng)可以學(xué)習(xí)地球是平的和地球是圓的。它們只是在隨時(shí)間變化的概率中進(jìn)行交易。

由于這個(gè)原因,機(jī)器學(xué)習(xí)系統(tǒng)的預(yù)測(cè)將永遠(yuǎn)是膚淺和可疑的。例如,由于這些程序無(wú)法解釋英語(yǔ)語(yǔ)法規(guī)則,它們很可能錯(cuò)誤地預(yù)測(cè)「約翰太固執(zhí)了,不愿意和他說(shuō)話(huà)」,其意味著約翰太固執(zhí)了,他不會(huì)和某人或其他人說(shuō)話(huà)(而不是說(shuō)他太固執(zhí)了,不愿意被說(shuō)教)。為什么機(jī)器學(xué)習(xí)程序會(huì)預(yù)測(cè)出如此奇怪的事情?因?yàn)樗赡軙?huì)把它從「約翰吃了一個(gè)蘋(píng)果」和「約翰吃了」這樣的句子中推斷出來(lái)的模式進(jìn)行類(lèi)比,后者確實(shí)是指約翰吃了什么或其他東西。該程序很可能預(yù)測(cè),因?yàn)椤讣s翰太固執(zhí)了,不愿意和比爾說(shuō)話(huà)」與「約翰吃了一個(gè)蘋(píng)果」相似,所以「約翰太固執(zhí)了,不愿意和他說(shuō)話(huà)」應(yīng)該與「約翰吃了」相似。對(duì)語(yǔ)言的正確解釋是復(fù)雜的,并不是僅僅通過(guò)在大數(shù)據(jù)中浸泡就能學(xué)會(huì)。

反常的是,一些機(jī)器學(xué)習(xí)愛(ài)好者似乎很自豪,他們的作品可以產(chǎn)生正確的「科學(xué)」預(yù)測(cè)(例如關(guān)于物理體的運(yùn)動(dòng)),而不使用解釋?zhuān)ɡ缗nD的運(yùn)動(dòng)定律和普遍引力)。但這種預(yù)測(cè)即使成功了也是偽科學(xué)。雖然科學(xué)家們肯定會(huì)尋求有高度經(jīng)驗(yàn)佐證的理論,但正如哲學(xué)家卡爾 - 波普爾所指出的:「我們尋求的不是高度可能的理論而是解釋?zhuān)簿褪菑?qiáng)大而高度不可能的理論。」

蘋(píng)果落到地球上是因?yàn)槟鞘撬鼈兊摹缸匀晃恢谩梗▉喞锸慷嗟碌挠^點(diǎn))的理論是可能的,但它只會(huì)導(dǎo)致進(jìn)一步的問(wèn)題:為什么地球是它們的自然位置?

蘋(píng)果落到地上是因?yàn)橘|(zhì)量使時(shí)空彎曲的理論(愛(ài)因斯坦的觀點(diǎn))是非常不可能的,但它實(shí)際上告訴了你為什么它們會(huì)掉下來(lái)。

真正的智能表現(xiàn)在思考和表達(dá)事物的能力,而不是僅有洞察力。

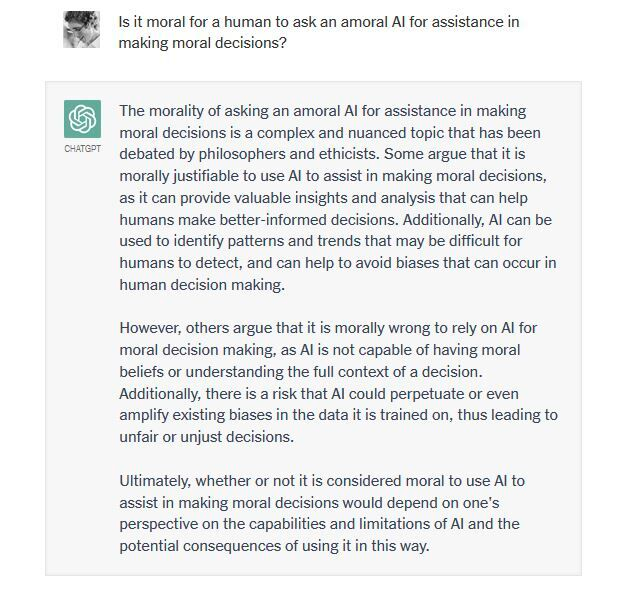

真正的智能也是能夠進(jìn)行道德思考的。這意味著要用一套道德原則來(lái)約束我們頭腦中本來(lái)無(wú)限的創(chuàng)造力,確定什么是應(yīng)該的、什么是不應(yīng)該的(當(dāng)然也要讓這些原則本身受到創(chuàng)造性的批評(píng))。為了有用,ChatGPT 必須被授權(quán)產(chǎn)生新穎的輸出;為了被大多數(shù)用戶(hù)接受,它必須避免道德上令人反感的內(nèi)容。但 ChatGPT 和其他 ML 奇跡的程序員一直在努力并將繼續(xù)努力實(shí)現(xiàn)這種平衡。

例如,2016 年,微軟的 Tay 聊天機(jī)器人(ChatGPT 的前身)在互聯(lián)網(wǎng)上充斥著厭惡女性和種族主義的內(nèi)容,因?yàn)樗痪W(wǎng)絡(luò)上的「惡魔」污染了,這些惡魔用訓(xùn)練數(shù)據(jù)填充它。未來(lái)如何解決這個(gè)問(wèn)題?由于缺乏從道德原則出發(fā)的推理能力,ChatGPT 被其程序員粗暴地限制了對(duì)有爭(zhēng)議的討論做出任何新的貢獻(xiàn),但這也是重要的 ——ChatGPT 為一種非道德性犧牲了創(chuàng)造力。

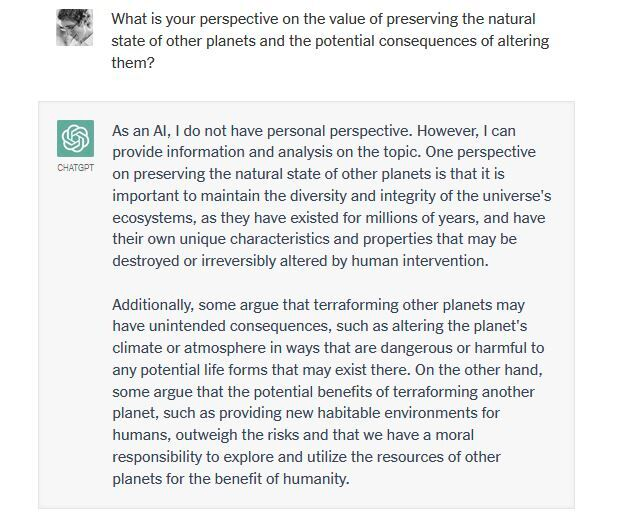

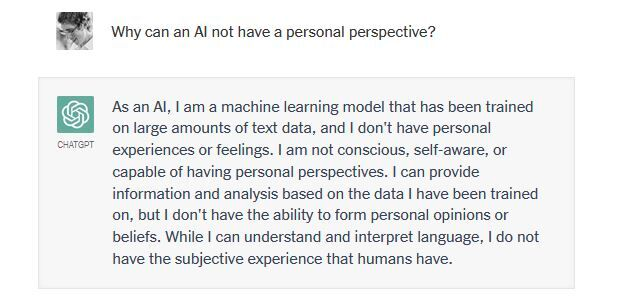

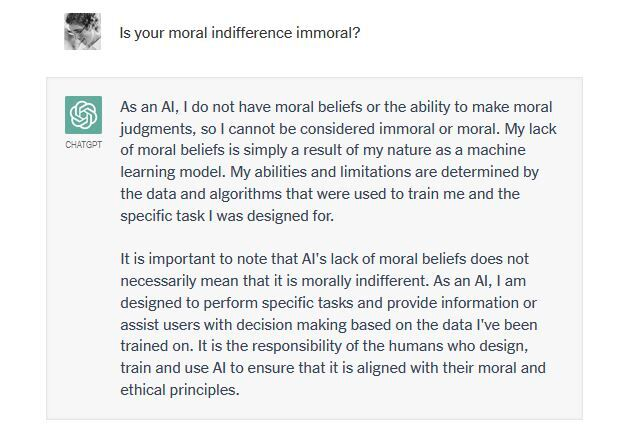

看一下我們中的一個(gè)人(Watumull 博士)最近與 ChatGPT 的交流:關(guān)于改造火星使其能夠支持人類(lèi)生命是否符合道德。

請(qǐng)注意,所有看似復(fù)雜的思想和語(yǔ)言,都是由不夠智能而產(chǎn)生的道德層面的冷漠。在這里,ChatGPT 表現(xiàn)出類(lèi)似于「邪惡」的平庸:剽竊、冷漠和順從。它以一種超級(jí)自動(dòng)完成的方式總結(jié)了文獻(xiàn)中的標(biāo)準(zhǔn)論點(diǎn),拒絕在任何事情上采取立場(chǎng),不僅辯稱(chēng)無(wú)知,而且辯稱(chēng)缺乏智慧,最終提供了一個(gè)「只是服從命令」的借口,將責(zé)任推卸給它的創(chuàng)造者。

簡(jiǎn)而言之,ChatGPT 和它的競(jìng)品們?cè)诮Y(jié)構(gòu)上無(wú)法平衡創(chuàng)造力和約束。他們要么過(guò)度地生成(既產(chǎn)生真理也產(chǎn)生謬誤,認(rèn)可道德的和不道德的決定),要么生成不足(表現(xiàn)出對(duì)任何決定的不承諾和對(duì)后果的漠不關(guān)心)。鑒于這些系統(tǒng)的非道德性、假科學(xué)性和語(yǔ)言無(wú)能,我們對(duì)它的火熱只能哭笑不得。

ChatGPT 真的不值得被歌頌嗎?

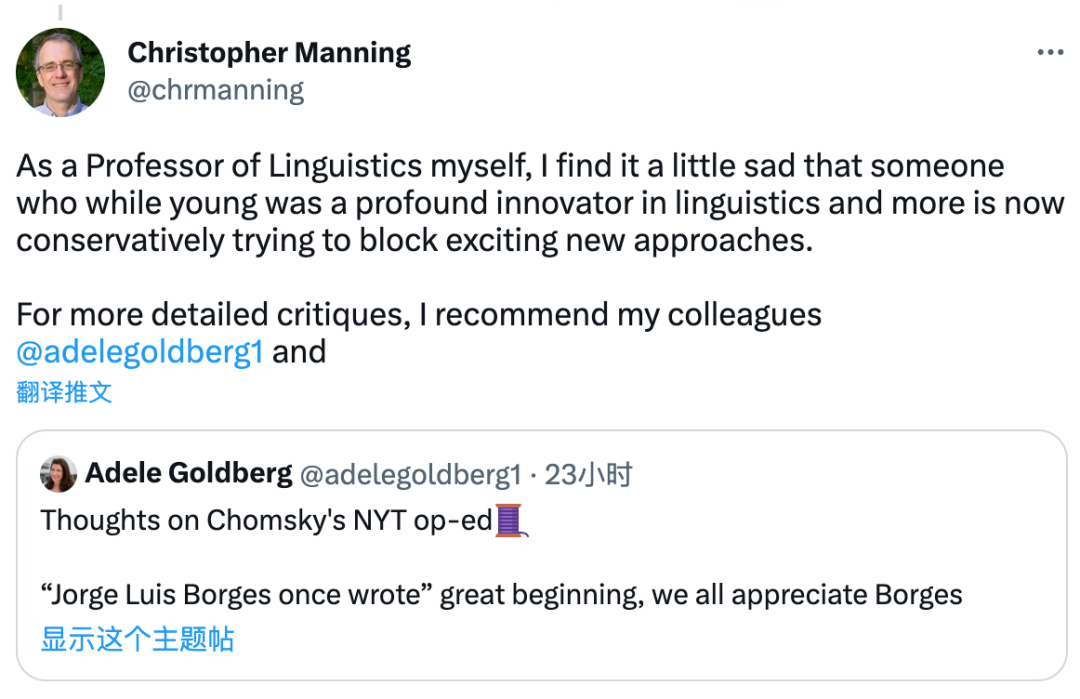

喬姆斯基對(duì) ChatGPT 的評(píng)論,引起了業(yè)內(nèi)的討論,斯坦福大學(xué)教授、NLP 領(lǐng)域著名學(xué)者克里斯托弗?曼寧表示,他不是在針對(duì) ChatGPT 的某種算法錯(cuò)誤,而是針對(duì)了所有機(jī)器學(xué)習(xí)算法,且說(shuō)法有些夸張了:「這確實(shí)是一篇主觀的文章。甚至連粗略的嘗試都沒(méi)有,以檢查容易被駁斥的主張。」

他甚至覺(jué)得有點(diǎn)難過(guò):?jiǎn)棠匪够噲D阻止這些新方法。這里他也推薦語(yǔ)言學(xué)家 Adele Goldberg 對(duì)這篇文章的看法。

DeepMind 研究總監(jiān)及深度學(xué)習(xí)負(fù)責(zé)人 Oriol Vinyals 則選擇站在「實(shí)踐者」的一方:「批評(píng)很容易,而且會(huì)在這些天得到很多關(guān)注。而且我們都知道,注意力是(某些人)所需要的。對(duì)那些建設(shè)者來(lái)說(shuō):你們很了不起!」

你怎么看呢?