通過使用因果機器學習做出有效的可操作決策以優化業務KPI

譯文?譯者 | 李睿

審校 | 孫淑娟 ?

在不同的場景中,常用的機器學習建模技術可能會誤解數據中的真實關系。因此在這里試圖改變這種范式,以基于估計因果關系和衡量目標關鍵績效指標(KPI)結果的治療效果,找到超越虛假相關性的可操作見解。?

因果機器學習的動機?

假設獲得了某家企業在過去一年某一產品的歷史數據或觀察數據,面這一產品有5%的顧客流失,那么這家企業的目標是通過開展有針對性的活動來降低流失率。通常會構建經典的客戶流失預測性傾向模型(傾向性評分——客戶行為的協變量流失概率),并通過選擇閾值規定折扣或向客戶追加銷售/交叉銷售。?

現在,企業管理人員想要預測客戶流失的有效性,例如該公司的客戶是由于促銷活動或營銷活動而保留下來的,還是與其相反?這需要傳統的AB測試標準實驗,實驗需要一些時間,而且在某些情況下也不可行并且成本高昂。?

因此需要思考傾向模型之外的問題。具有監督的流失預測是有用的,但不是每次都有用,因為它缺乏在假設情況下推薦下一個最佳行動的建議。針對那些能夠積極響應企業的營銷建議而不會在失敗案例上浪費資金的個性化客戶,從而采取下一個最佳行動/干預并改變未來結果(例如最大限度地提高保留率)的問題是因果推斷中的提升建模。?

在理解消費世界中的某些反事實問題時,例如如果提高或降低零售價格,消費者的行為會如何改變(價格對行為模式的影響是什么)?如果企業向顧客展示廣告,他們會不會購買產品(廣告對購買的影響)?這其中包括通過因果建模的數據驅動決策。 ?

在通常情況下,預測或預測問題關注的是在下個月有多少人會訂閱,而因果問題則是如果某些政策發生改變會發生什么情況(例如,如果開展一項活動會有多少人訂閱)。?

因果分析將更進一步。它旨在推斷數據生成過程的各個方面。借助這些方面,人們不僅可以推斷靜態條件下事件的可能性,還可以推斷變化條件下事件的動態。這種能力包括預測行動的效果(例如,治療或政策決定),確定所報告事件的原因,以及評估責任和歸因(例如,事件x對于事件y的發生是否必要或足夠)。 ?

當人們使用監督機器學習使用偽相關模式的預測模型時,隱含地假設事情將像過去一樣繼續。與此同時,由于基于預測結果做出的決定或采取的行動,正在以經常打破這些模式的一種方式積極地改變環境。?

從預測到決策?

對于決策,需要找到導致結果的特征,并估計如果特征發生變化,結果將如何改變。許多數據科學問題是因果問題,在決策場景中,估計反事實很常見。?

- A/B實驗:如果改變網站上按鈕的顏色,它是否會帶來更高的參與度??

- 政策決策:如果采用這種治療/政策,它將如何導致結果的改變?這會帶來更健康的病人/更多的收入嗎? ?

- 政策評估:企業在過去所做的改變或直到現在所知道的,以及結果變化的方式,制定的政策是幫助還是阻礙了試圖改變的產品? ?

- 信用歸因:人們購買商品是因為看到了廣告嗎?他們會購買嗎? ?

什么是因果關系和因果效應? ?

如果一個行動或治療(T)導致了一個結果(Y),當且僅當該行動(T)導致了結果(Y)的改變,保持其他一切不變。因果關系意味著通過改變一個因素,可以改變另一個因素。?

例如:如果阿司匹林能緩解頭痛,當且僅當阿司匹林能使頭痛的情況發生變化。?

如果市場營銷能夠帶來銷售額的增長,當且僅當營銷活動能夠帶來銷售額的改變,那么其它一切便能夠保持不變。?

因果效應是Y隨T的單位變化而變化的幅度,而不是相反:?

因果推斷需要領域知識、假設和專業知識。微軟ALICE研究團隊開發了DoWhy和EconML開源庫,讓人們的工作和生活更輕松。任何因果分析的第一步都是提出一個明確的問題:?

- 對什么治療/行動感興趣? ?

- 想考慮什么樣的結果? ?

- 哪些混雜因素可能與結果和治療相關? ?

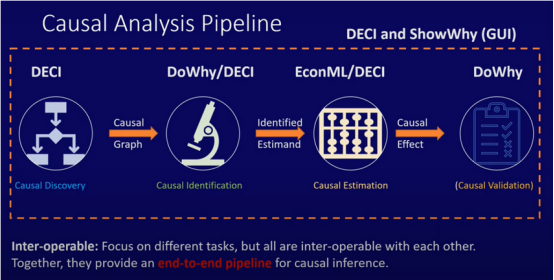

因果分析管道:基于深度學習的端到端因果推斷(DECI)(微軟專利)。 ?

因果發現-因果識別-因果估計-因果驗證。 ?

負責任的人工智能儀表板(Azure Machine Learning Studio) :原因分析?

該功能基于對模型注冊表中擬合模型的解釋,如果對相同變量有因果關系理解,則可以探究可能發生的情況。可以觀察不同特征的因果效應,并將其與異質效應進行比較,可以觀察到不同的群體,以及什么特征或政策對它們最有效。?

- DECI:提供了一個端到端因果推斷的框架,也可以單獨用于發現或估計。?

- EconML:提供多種因果關系估計方法。?

- DoWhy:提供多種識別和驗證方法。?

- ShowWhy:在用戶友好的圖形用戶界面(GUI)中為因果決策提供無代碼端到端因果分析。?

總結?

現代機器學習和深度學習算法可以在解釋黑盒算法的數據中找到復雜的模式,他們的解釋可能意味著機器學習算法從世界上學到了什么。?

當將這些學習過的機器學習算法應用到社會中,以制定諸如貸款批準和健康保險政策等政策決策時,它所了解的世界并不一定能很好地反映世界上正在發生的事情。?

然而,數據驅動的預測模型是透明的,但不能真正解釋。可解釋性需要一個因果模型(表二謬論證明了這一點)。因果模型可靠地代表了世界上的一些過程。可解釋的人工智能應該能夠進行推理,從而做出有效的決策,而不會產生偏見。?

原文標題:??Causal Analysis in Azure Machine Learning Studio to answer your Causal questions through an end-to-end automated framework??,作者:Hari Hara

?