聯合NeRF與特征網格,實現超大規模城市渲染,高效且逼真

純基于 MLP 的神經輻射場(NeRF)由于模型容量有限,在大規模場景模糊渲染中往往存在欠擬合現象。最近有研究者提出對場景進行地理劃分、并采用多個子 NeRF,分別對每個區域進行建模,然而,這樣做帶來的問題是隨著場景的逐漸擴展,訓練成本和子 NeRF 的數量呈線性擴大。

另一種解決方案是使用體素特征網格表示,該方法計算效率高,可以自然地擴展到具有增加網格分辨率的大場景。然而,特征網格由于約束較少往往只能達到次優解,在渲染中產生一些噪聲偽影,特別是在具有復雜幾何和紋理的區域。

本文中,來自香港中文大學、上海人工智能實驗室等機構的研究者提出了一個新的框架,用來實現高保真渲染的城市(Ubran)場景,同時兼顧計算效率,入選 CVPR 2023。該研究使用一個緊湊的多分辨率 ground 特征平面表示來粗略地捕獲場景,并通過一個 NeRF 分支網絡用位置編碼輸入來補充它,以聯合學習的方式進行渲染。這種方式集成了兩種方案的優點:在特征網格表示的指導下,輕加權 NeRF 足以呈現具有細節的逼真新視角;聯合優化的 ground 特征平面可以獲得進一步的細化,形成更精確、更緊湊的特征空間,輸出更自然的渲染結果。

- 論文地址:https://arxiv.org/pdf/2303.14001.pdf

- 項目主頁:https://city-super.github.io/gridnerf/

下圖為該研究方法對真實世界 Ubran 場景的示例結果,給人一種沉浸式城市漫游體驗:

方法介紹

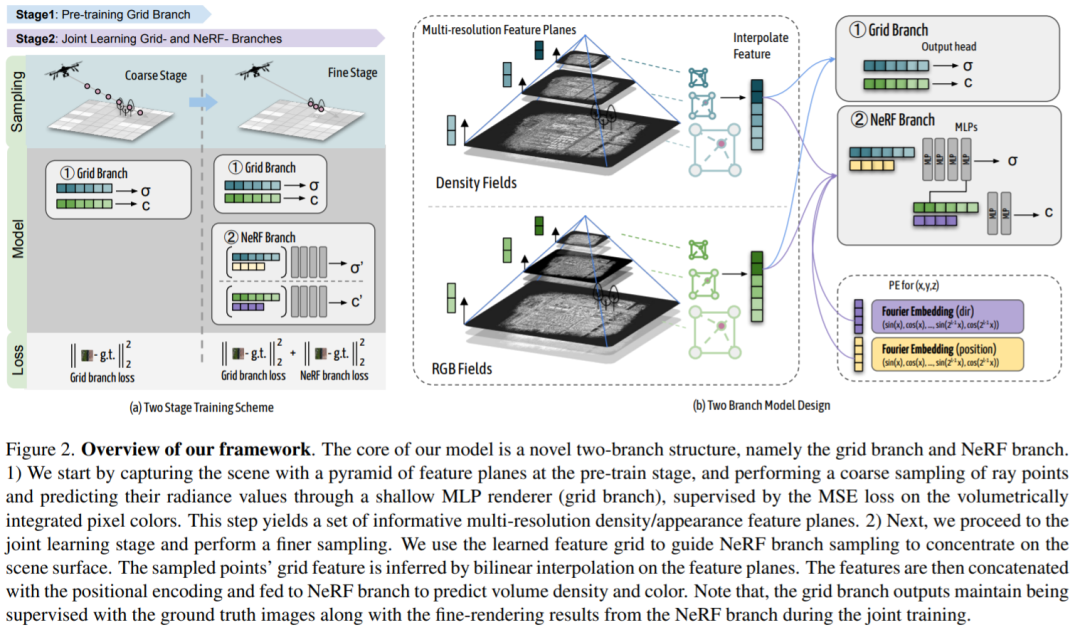

為了有效利用隱式神經表示重建大型城市場景,該研究提出了一個雙分支模型架構,它采用統一的場景表示,集成了基于顯式體素網格和基于隱式的 NeRF 方法,這兩種類型的表示可以互補。

首先在預訓練階段使用特征網格對目標場景進行建模,從而粗糙地捕捉場景的幾何形狀和外觀。然后使用粗特征網格,1) 引導 NeRF 點采樣,使其集中在場景表面周圍;2) 為 NeRF 的位置編碼提供關于場景幾何形狀和在采樣位置上的外觀額外特征。在這樣的指導下,NeRF 可以在一個大大壓縮的采樣空間中有效地獲取更精細的細節。此外,由于粗層級的幾何圖形和外觀信息被明確地提供給 NeRF,一個輕量級的 MLP 就足以學習從全局坐標到體積密度和顏色值的映射。在第二個聯合學習階段,通過來自 NeRF 分支的梯度對粗特征網格進行進一步優化,并對其進行規范化,從而在單獨應用時產生更準確和自然的渲染結果。

該研究的核心是一個新的雙分支結構,即網格分支和 NeRF 分支。1) 研究人員首先在預訓練階段捕捉特征平面的金字塔場景,并通過淺 MLP 渲染器(網格分支)對射線點進行粗略的采樣,并預測它們的輻射值,由體積積分像素顏色上的 MSE 損失監督。這一步生成一組信息豐富的多分辨率密度 / 外觀特征平面。2) 接下來,研究人員進入聯合學習階段,并進行更精細的抽樣。研究人員使用學習到的特征網格來指導 NeRF 分支采樣,以集中在場景表面。通過在特征平面上的雙線性插值法,推導出采樣點的網格特征。然后將這些特征與位置編碼連接,并輸入 NeRF 分支以預測體積密度和顏色。請注意,在聯合訓練過程中,網格分支的輸出仍然使用 ground 真實圖像以及來自 NeRF 分支的精細渲染結果進行監督。

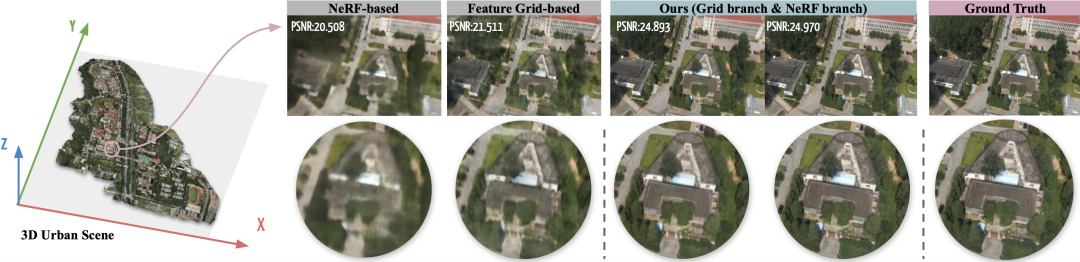

目標場景:在這項工作中,該研究使用新穎的網格引導神經輻射場執行大型城市場景渲染。下圖左側顯示了一個大型城市場景的示例,它跨越 2.7km^2 的地面區域,由超過 5k 的無人機圖像捕獲。研究表明,基于 NeRF 方法渲染結果模糊且過度平滑且模型容量有限,而基于特征網格的方法在適應具有高分辨率特征網格的大規模場景時往往會顯示嘈雜的偽影。該研究提出的雙分支模型結合了兩種方法的優點,并通過對現有方法的顯著改進實現了逼真的新穎視圖渲染。這兩個分支都比各自的基線獲得了顯著增強。

實驗

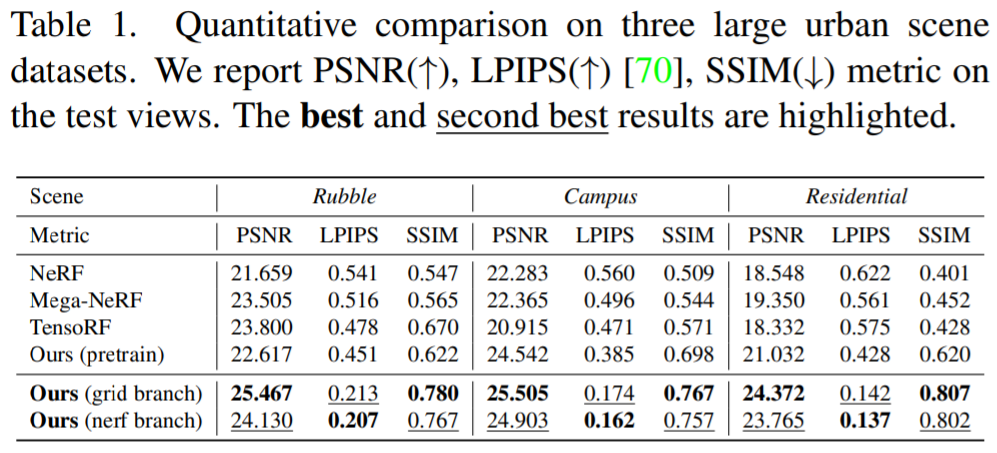

研究人員在下圖和表格中報告了 baseline 的性能和研究人員的方法作對比。無論從定性和定量上看。在視覺質量和所有指標方面都可以觀察到顯著的改善。與純粹的基于 MLP 的方法(NeRF 和 Mega-NeRF)相比,研究人員的方法揭示了更清晰的幾何形狀和更精細的細節。特別是由于 NeRF 的有限容量和光譜偏差,它總是不能模擬幾何形狀和顏色的快速變化,如操場上的植被和條紋。盡管像 Mega-NeRF 的 baseline 中顯示的那樣,在地理位置上將場景劃分為小區域稍有幫助,但呈現的結果仍然顯得過于平滑。相反,在學習特征網格的引導下,NeRF 的采樣空間被有效地、大大地壓縮到場景表面附近。從 ground 特征平面采樣的密度和外觀特征明確地表示了場景內容,如圖 3 所示。盡管不那么準確,但它已經提供了信息豐富的局部幾何圖形和紋理,并鼓勵 NeRF 的位置編碼來收集缺失的場景細節。

下表 1 為定量結果:

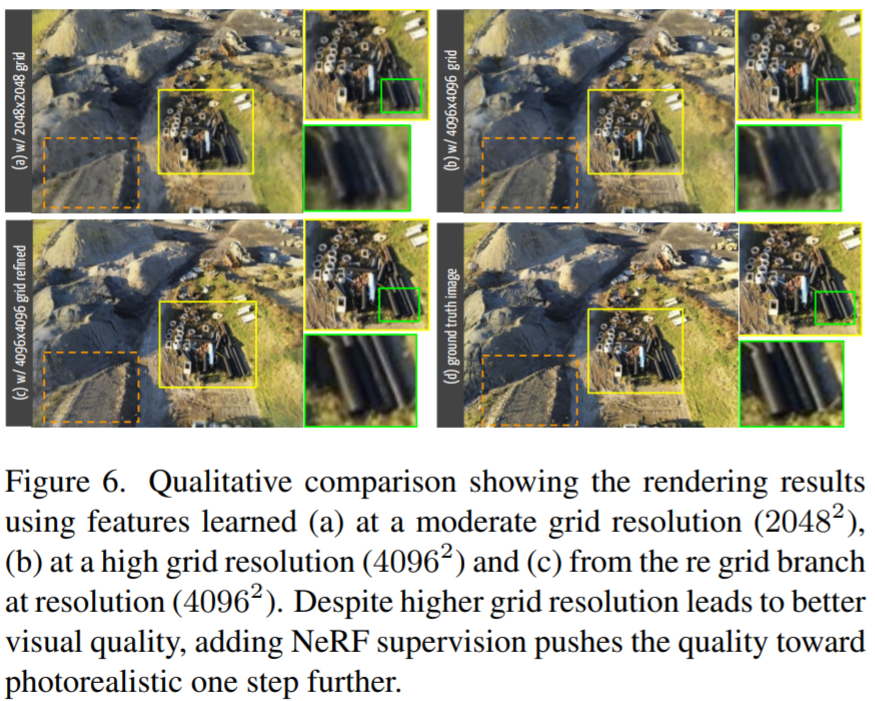

圖 6 可以觀察到渲染保真度的快速提高:

了解更多內容,請參考原論文。