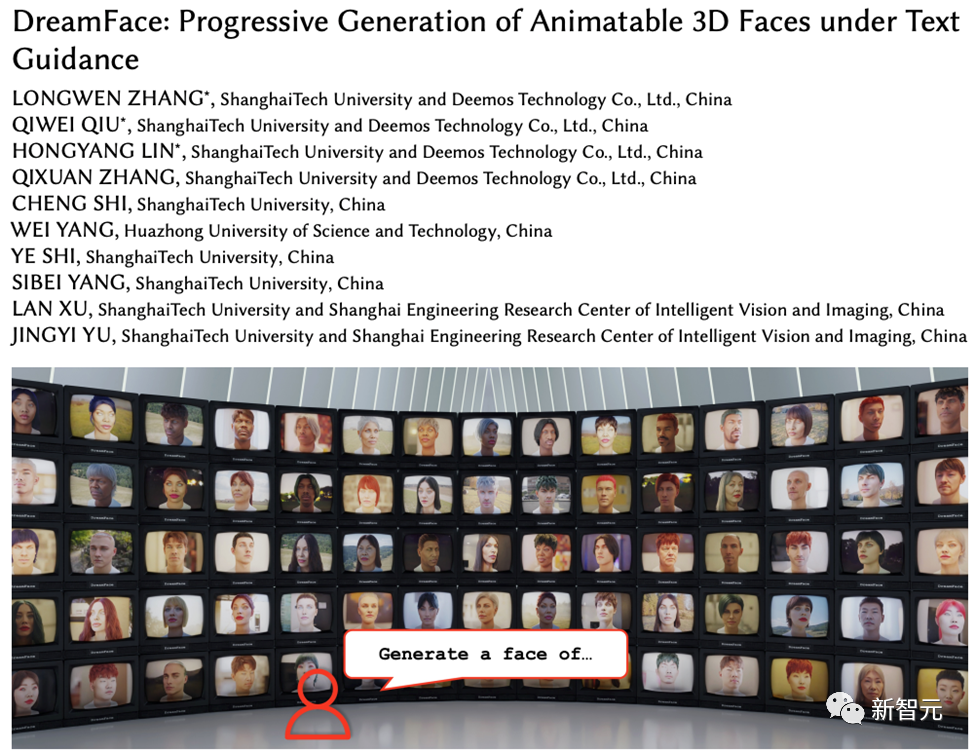

上科大等發布DreamFace:只需文本即可生成「超寫實3D數字人」

隨著大型語言模型(LLM)、擴散(Diffusion)等技術的發展,ChatGPT、Midjourney等產品的誕生掀起了新一波的AI熱潮,生成式AI也成為備受關注的話題。

與文本和圖像不同,3D生成仍處于技術探索階段。

2022年年底,Google、NVIDIA和微軟相繼推出了自己的3D生成工作,但大多基于先進的神經輻射場(NeRF)隱式表達,與工業界3D軟件如Unity、Unreal Engine和Maya等的渲染管線不兼容。

即使通過傳統方案將其轉換為Mesh表達的幾何和顏色貼圖,也會造成精度不足和視覺質量下降,不能直接應用于影視制作和游戲生產。

項目網站:https://sites.google.com/view/dreamface

論文地址:https://arxiv.org/abs/2304.03117

Web Demo:https://hyperhuman.top

HuggingFace Space:https://huggingface.co/spaces/DEEMOSTECH/ChatAvatar

為了解決這些問題,來自影眸科技與上海科技大學的研發團隊提出了一種文本指導的漸進式3D生成框架。

該框架引入符合CG制作標準的外部數據集(包含幾何和PBR材質),可以根據文本直接生成符合該標準的3D資產,是首個支持Production-Ready 3D資產生成的框架。

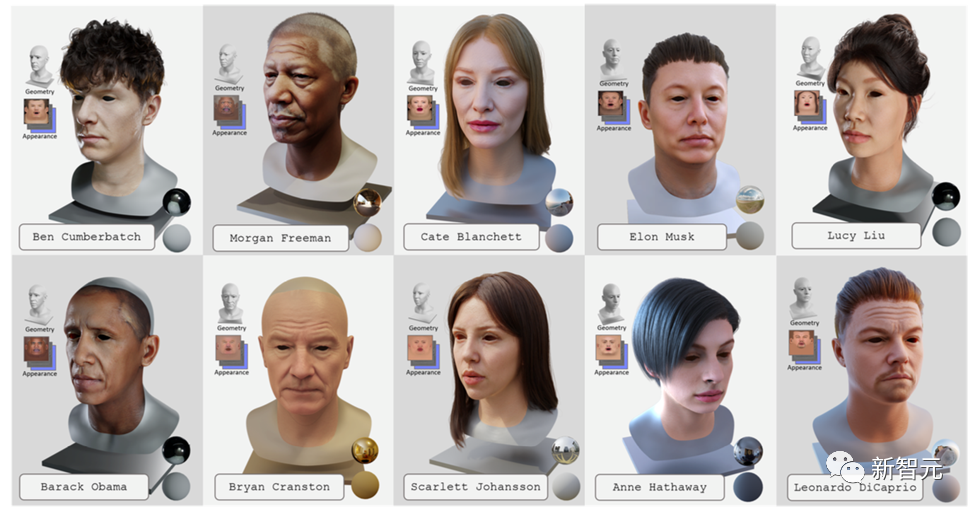

為了實現文本生成可驅動的3D超寫實數字人,該團隊將這個框架與產品級3D數字人數據集相結合。這項工作已經被計算機圖形領域國際頂級期刊Transactions on Graphics接收,并將在國際計算機圖形頂級會議SIGGRAPH 2023上展示。

DreamFace主要包括三個模塊,幾何體生成,基于物理的材質擴散和動畫能力生成。

相比先前的3D生成工作,這項工作的主要貢獻包括:

· 提出了DreamFace這一新穎的生成方案,將最近的視覺-語言模型與可動畫和物理材質的面部資產相結合,通過漸進式學習來分離幾何、外觀和動畫能力。

· 引入了雙通道外觀生成的設計,將一種新穎的材質擴散模型與預訓練模型相結合,同時在潛在空間和圖像空間進行兩階段優化。

· 使用BlendShapes或生成的Personalized BlendShapes的面部資產具備動畫能力,并進一步展示了DreamFace在自然人物設計方面的應用。

幾何生成

幾何體生成模塊可以根據文本提示生成與之一致的幾何模型。然而,在人臉生成方面,這可能難以監督和收斂。

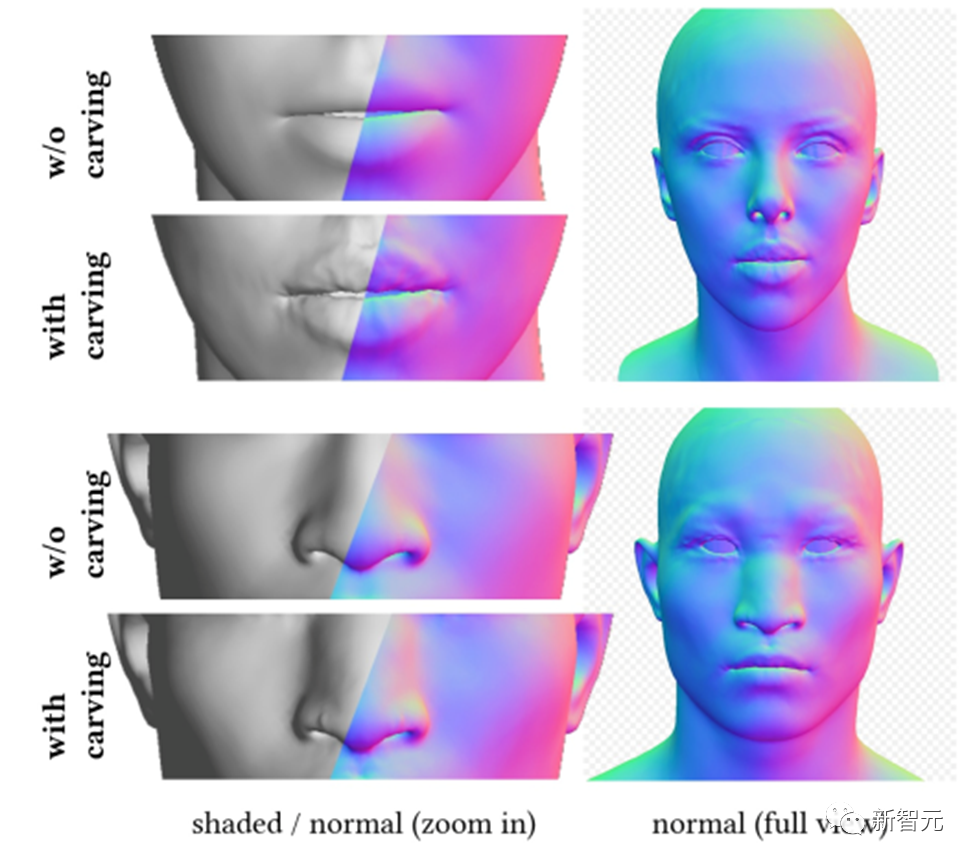

因此,DreamFace提出了一個基于CLIP(Contrastive Language-Image Pre-Training)的選擇框架,首先從對人臉幾何參數空間內隨機采樣的候選項中選擇最佳的粗略幾何模型,然后雕刻幾何細節,使頭部模型更符合文本提示。

根據輸入提示,DreamFace利用CLIP模型選擇匹配得分最高的粗略幾何候選項。接下來,DreamFace使用隱式擴散模型(LDM)在隨機視角和光照條件下對渲染圖像進行得分蒸餾采樣(SDS)處理。

這使得DreamFace可以通過頂點位移和詳細的法線貼圖向粗略幾何模型添加面部細節,從而得到高度精細的幾何體。

與頭部模型類似,DreamFace還基于該框架進行發型和顏色的選擇。

基于物理的材質擴散生成

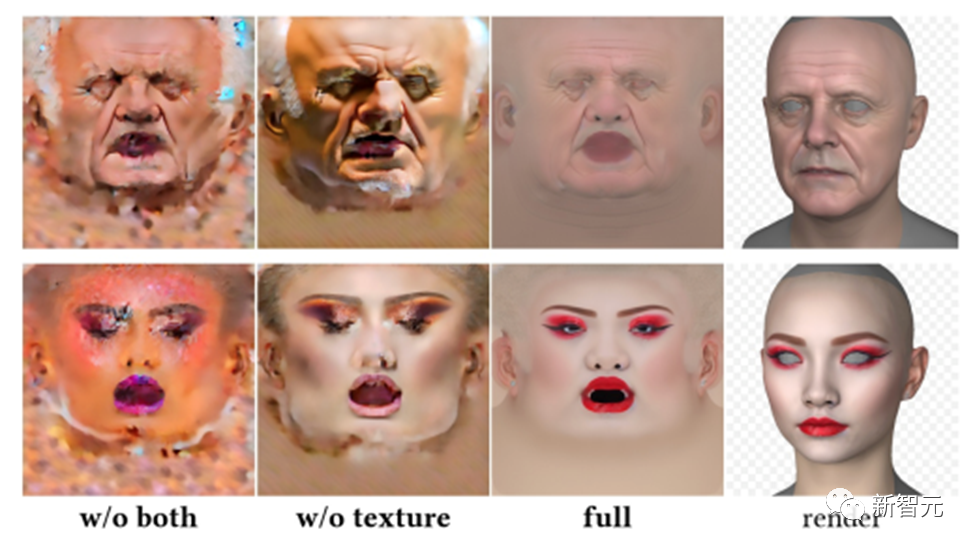

基于物理的材質擴散模塊旨在預測與預測幾何體和文本提示一致的面部紋理。

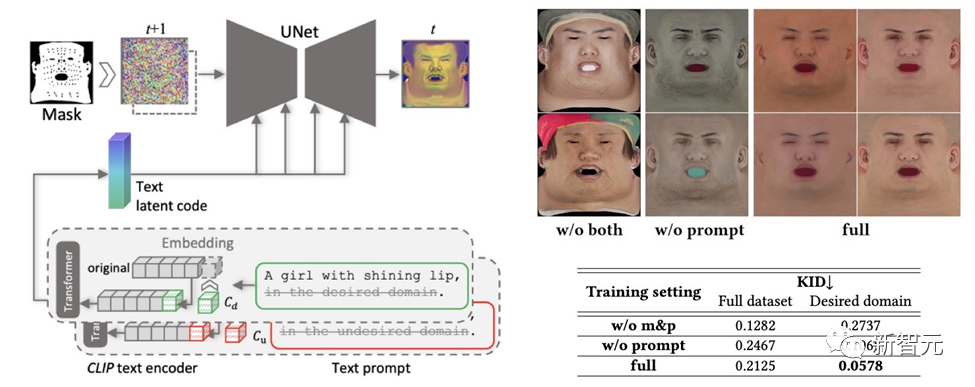

首先,DreamFace將預先訓練的LDM在收集的大規模UV材質數據集上微調,得到兩個LDM擴散模型。

DreamFace采用了一種聯合訓練方案,協調兩個擴散過程,一個用于直接去噪UV紋理貼圖,另一個用于監督渲染圖像,以確保面部UV貼圖和渲染圖像的正確形成與文本提示一致。

為了減少生成時間,DreamFace采用了一個粗糙紋理潛在擴散階段,為細節紋理生成提供先驗潛在。

為了確保所創建的紋理地圖不含有不良特征或照明情況,同時仍保持多樣性,設計了一種提示學習策略。

團隊利用兩種方法生成高質量的漫反射貼圖:

(1)Prompt Tuning。與手工制作的特定領域文本提示不同,DreamFace將兩個特定領域的連續文本提示 Cd 和 Cu 與相應的文本提示結合起來,這將在U-Net去噪器訓練期間進行優化,以避免不穩定和耗時的手工撰寫提示。

(2)非面部區域遮罩。LDM去噪過程將額外地受到非面部區域遮罩的限制,以確保生成的漫反射貼圖不含有任何不需要的元素。

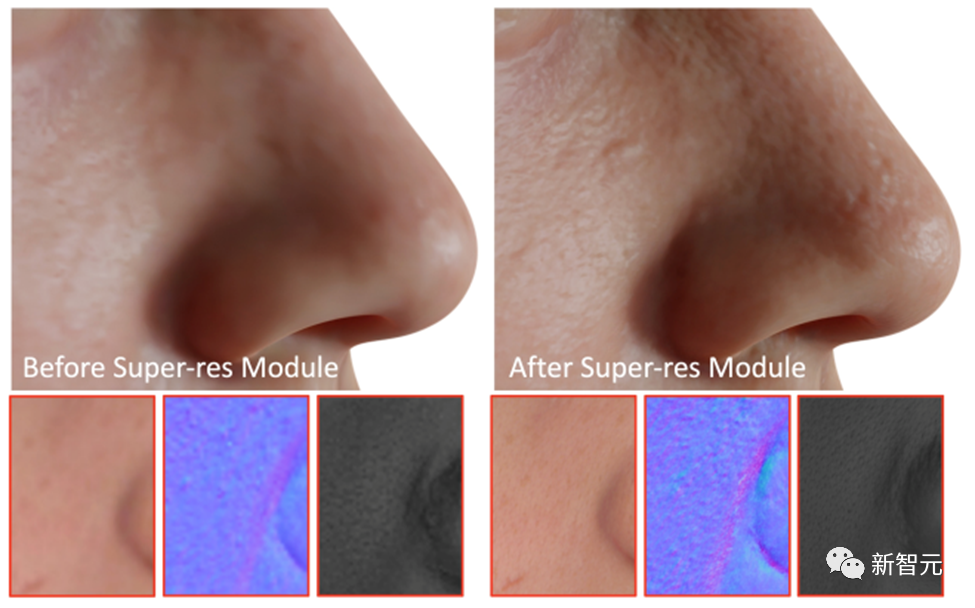

作為最后一步,DreamFace應用超分辨率模塊生成4K基于物理的紋理,以進行高質量渲染。

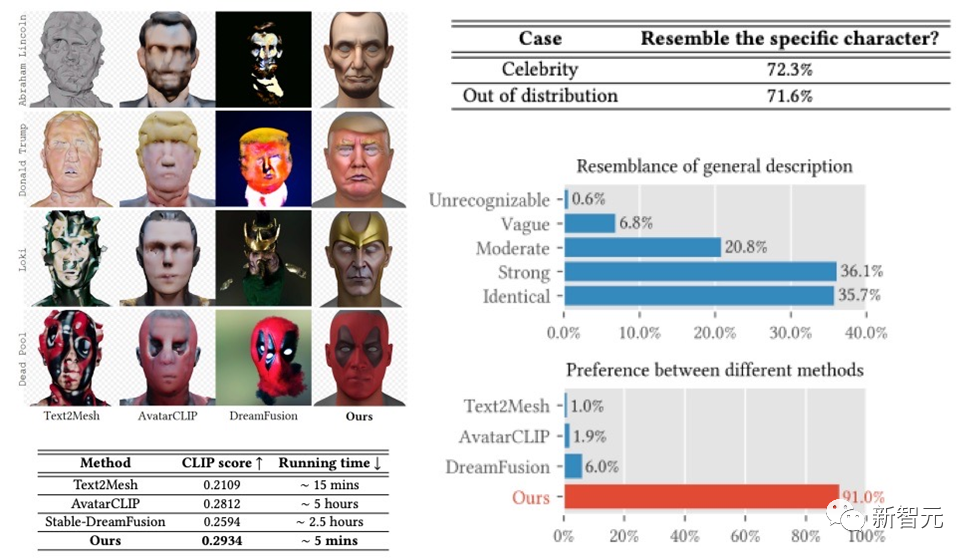

DreamFace框架在名人生成,根據描述生成角色上都取得了相當不錯的效果,在User Study中獲得了遠超先前工作的成績。相比先前的工作,在運行時間上也具備明顯的優勢。

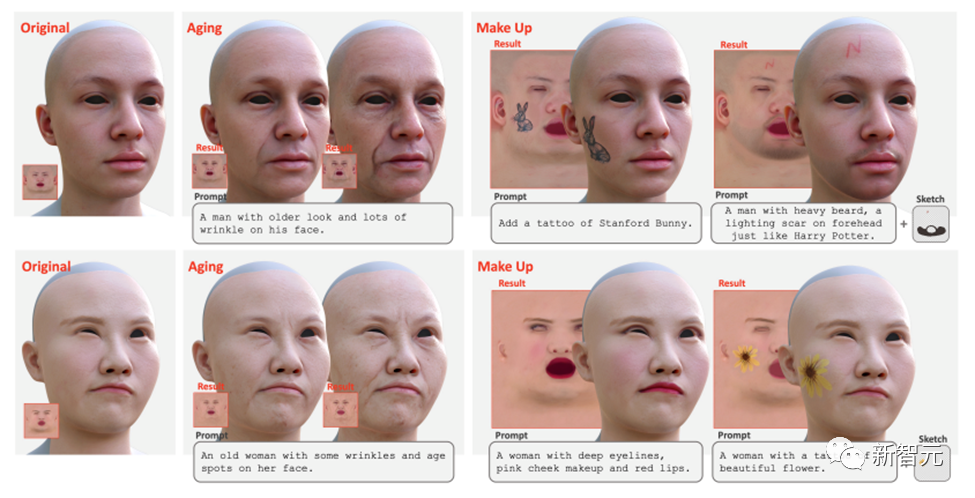

除此之外,DreamFace還支持使用提示和草圖進行紋理編輯。通過直接使用微調的紋理LDM和提示,可以實現全局的編輯效果,如老化和化妝。通過進一步結合掩模或草圖,可以創建各種效果,如紋身、胡須和胎記。

動畫能力生成

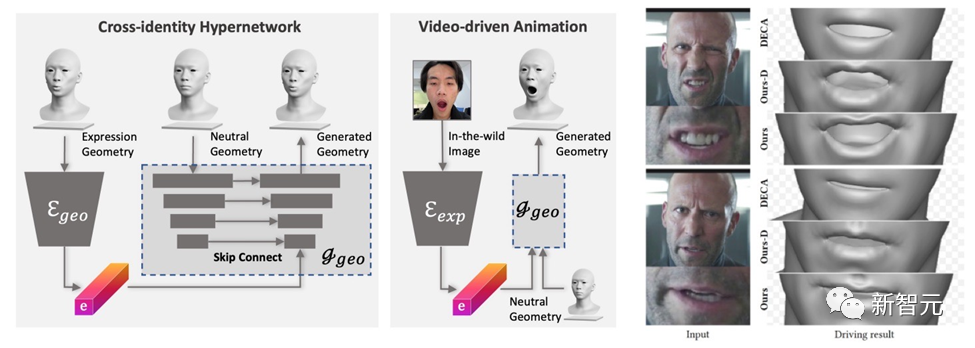

DreamFace生成的模型具備動畫能力。與基于BlendShapes的方法不同,DreamFace的神經面部動畫方法通過預測獨特的變形來為生成的靜息(Neutral)模型賦予動畫效果,從而產生個性化的動畫。

首先,訓練一個幾何生成器,學習表情的潛在空間,其中解碼器被擴展為以中性幾何形狀為條件。接著,進一步訓練表情編碼器,從RGB圖像中提取表情特征。因此,DreamFace能夠通過使用單目RGB圖像以中性幾何形狀為條件來生成個性化的動畫。

與使用通用BlendShapes進行表情控制的DECA相比,DreamFace的框架提供了細致的表情細節,并且能夠精細地捕捉表演。

結論

本文介紹了DreamFace,一種文本指導的漸進式3D生成框架,它結合了最新的視覺-語言模型、隱式擴散模型,以及基于物理的材質擴散技術。

DreamFace的主要創新包括幾何體生成、基于物理的材質擴散生成和動畫能力生成。與傳統的3D生成方法相比,DreamFace具有更高的準確性、更快的運行速度和較好的CG管線兼容性。

DreamFace的漸進式生成框架為解決復雜的3D生成任務提供了一種有效的解決方案,有望推動更多類似的研究和技術發展。

此外,基于物理的材質擴散生成和動畫能力生成將推動3D生成技術在影視制作、游戲開發和其他相關行業的應用。