3.6萬億token、3400億參數,谷歌大模型PaLM 2細節遭曝光

上周四,在 2023 谷歌 I/O 大會上,谷歌 CEO 皮查伊宣布推出對標 GPT-4 的大模型 PaLM 2,并正式發布預覽版本,改進了數學、代碼、推理、多語言翻譯和自然語言生成能力。

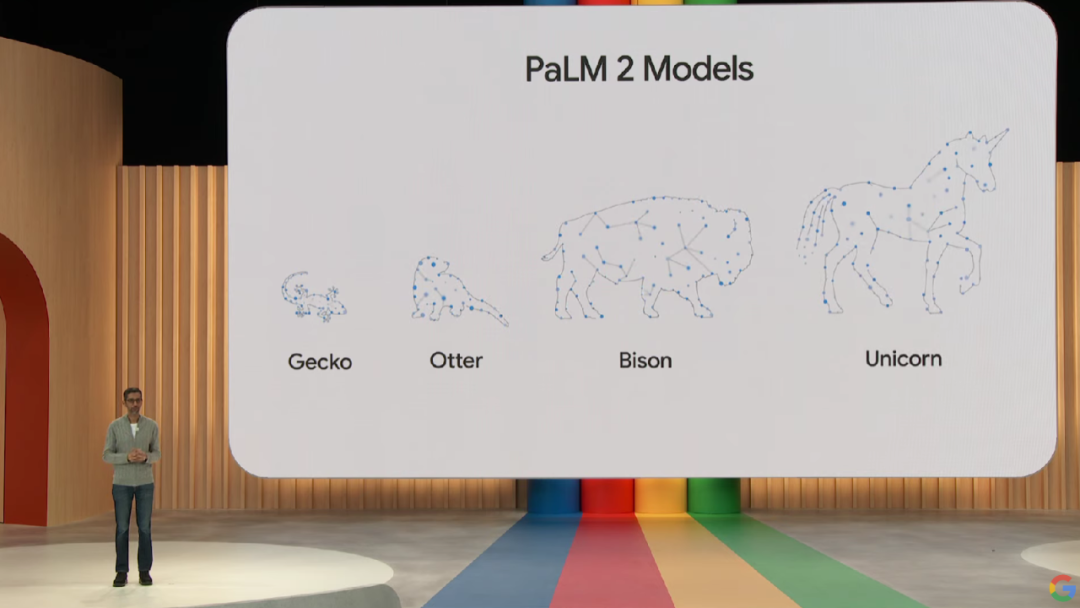

PaLM 2 模型提供了不同尺寸規模的四個版本,從小到大依次為 Gecko、Otter、Bison 和 Unicorn,更易于針對各種用例進行部署。其中輕量級的 Gecko 模型可以在移動設備上運行,速度非常快,不聯網也能在設備上運行出色的交互式應用程序。

不過會上,谷歌并沒有給出有關 PaLM 2 的具體技術細節,只說明了它是構建在谷歌最新 JAX 和 TPU v4 之上。

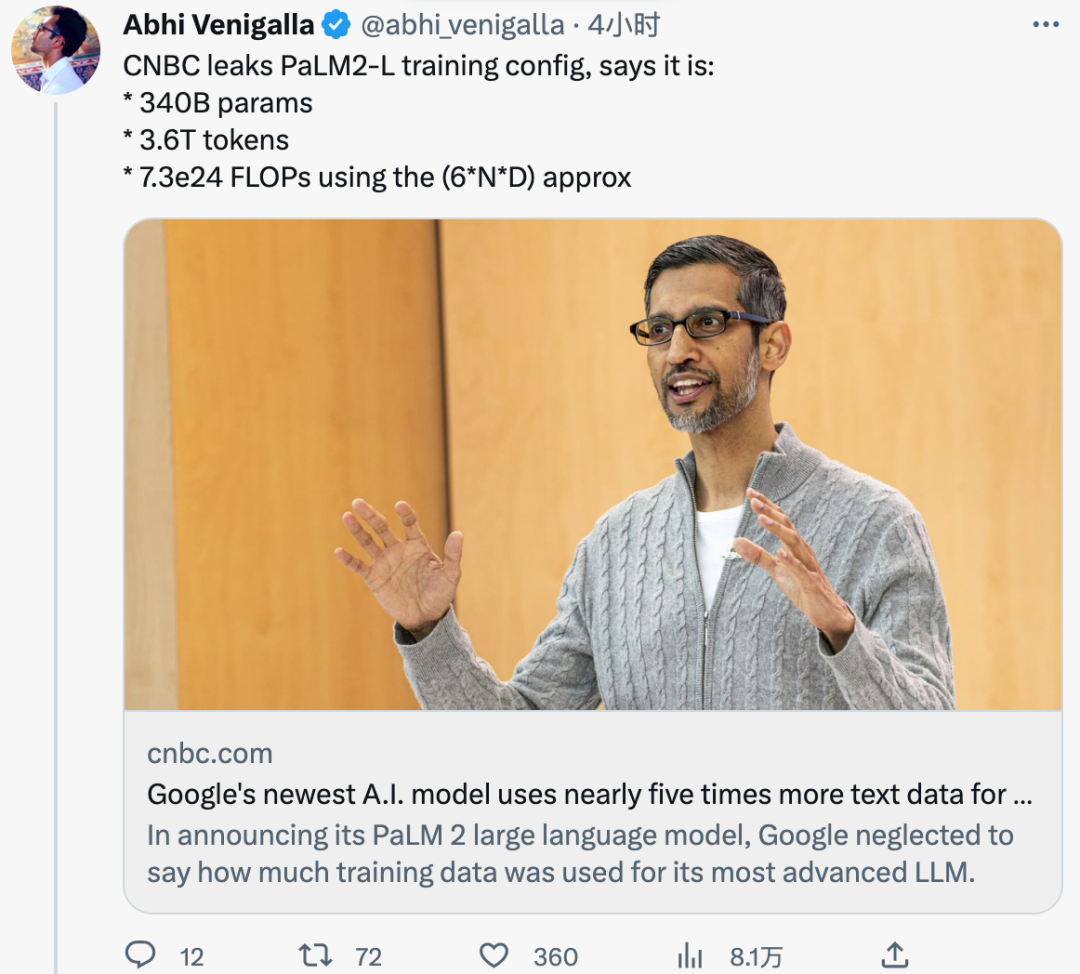

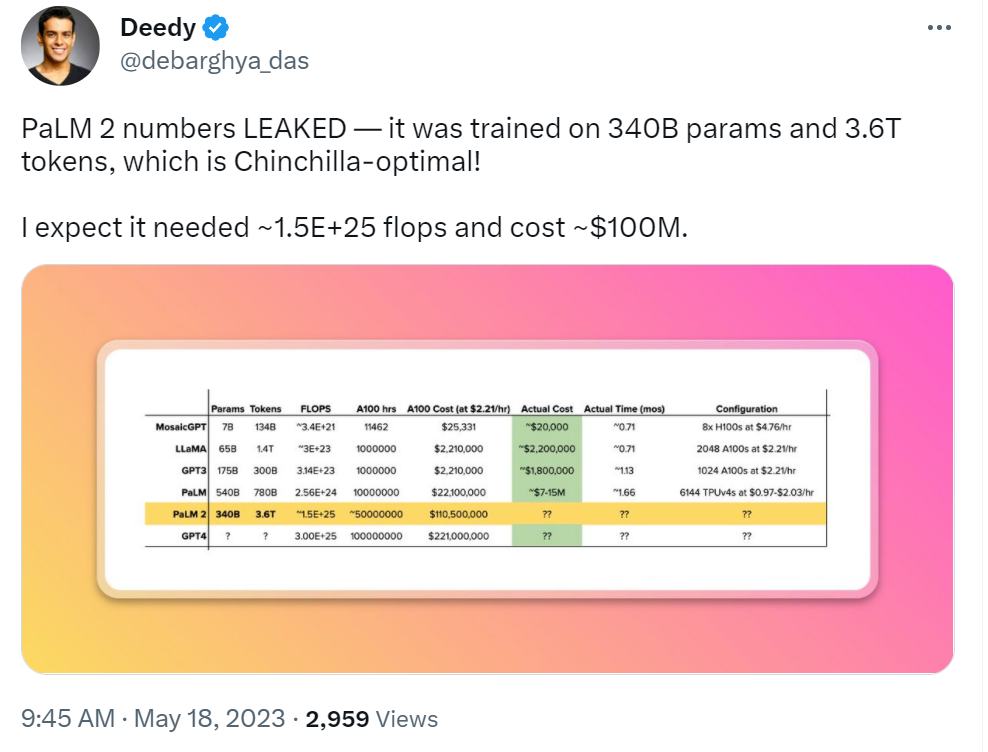

昨日,據外媒 CNBC 看到的內部文件稱,PaLM 2 是在 3.6 萬億個 token 上訓練。作為對比,上代 PaLM 接受了 7800 億 token 的訓練。

此外,谷歌之前表示 PaLM 2 比以前的 LLM 規模更小,這意味著在完成更復雜任務的同時變得更加高效。這一點也在內部文件中得到了驗證,PaLM 2 的訓練參數量為 3400 億,遠小于 PaLM 的 5400 億。

PaLM 2 的訓練 token 和參數量與其他家的 LLM 相比如何呢?作為對比,Meta 在 2 月發布的 LLaMA 接受了 1.4 萬億 token 的訓練。OpenAI 1750 億參數的 GPT-3 是在 3000 億 token 上訓練的。

雖然谷歌一直渴望展示其 AI 技術的強大能力以及如何嵌入到搜索、電子郵件、文件處理和電子表格中,但也不愿公布其訓練數據的大小或其他細節。其實這樣做的不只谷歌一家,OpenAI 也緘口不言其最新多模態大模型 GPT-4 的細節。他們都表示不披露細節是源于業務的競爭屬性。

不過,隨著 AI 軍備競賽的持續升溫,研究界越來越要求提高透明度。并且在前段時間泄露的一份谷歌內部文件中,谷歌內部研究人員表達了這樣一種觀點:雖然表面看起來 OpenAI 和谷歌在 AI 大模型上你追我趕,但真正的贏家未必會從這兩家中產生,因為第三方力量「開源」正在悄然崛起。

目前,這份內部文件的真實性尚未得到驗證,谷歌也并未對相關內容置評。

網友評論

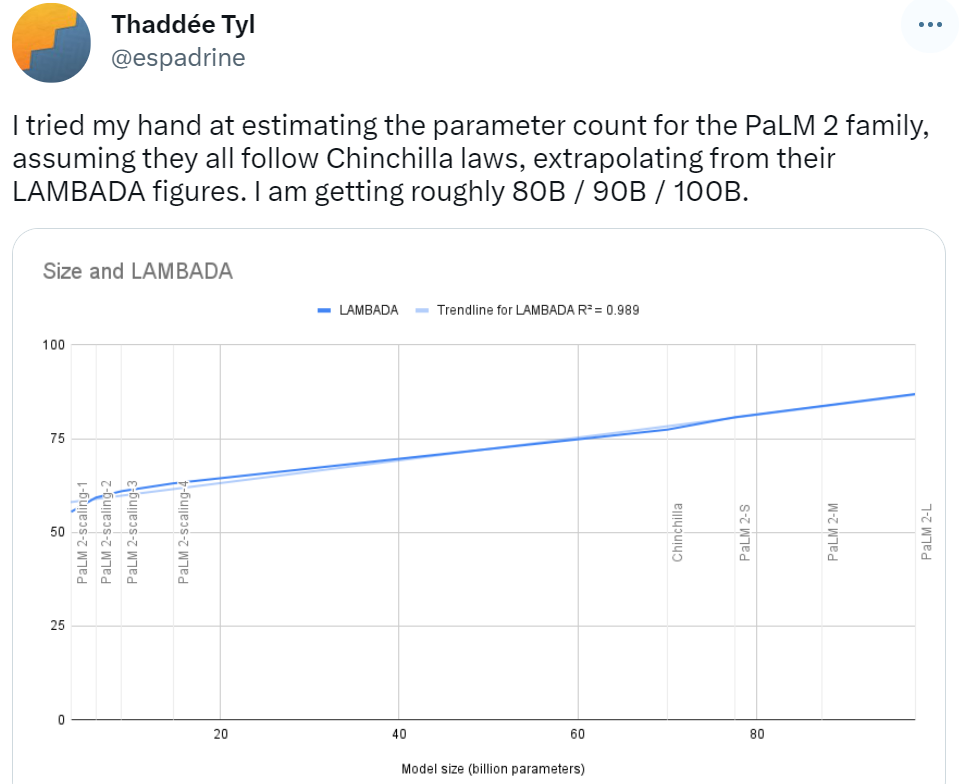

在官宣 PaLM 2 之初,就有網友根據 Chinchilla 定律預測其參數量,ta 預測 PaLM 2 模型家族的參數結果為 80B / 90B / 100B 不等,和這次爆料的 340B 還是差距很大的。

還有人對 PaLM 2 的訓練成本進行了一波預測,根據歷代大模型的發展來看,這位網友表示,打造 PaLM 2 需要耗資 1 億美元。

PaLM 2 參數都泄密了,可以試著推測 Bard 了,這位網友表示:

隨著 PaLM 2 token 數的泄露,網友不禁疑問,在 AGI 到來之前,多少 token 才能迎來一次大轉折?