比Transformer快4成!Meta發布全新Megabyte模型,解決算力損耗硬傷

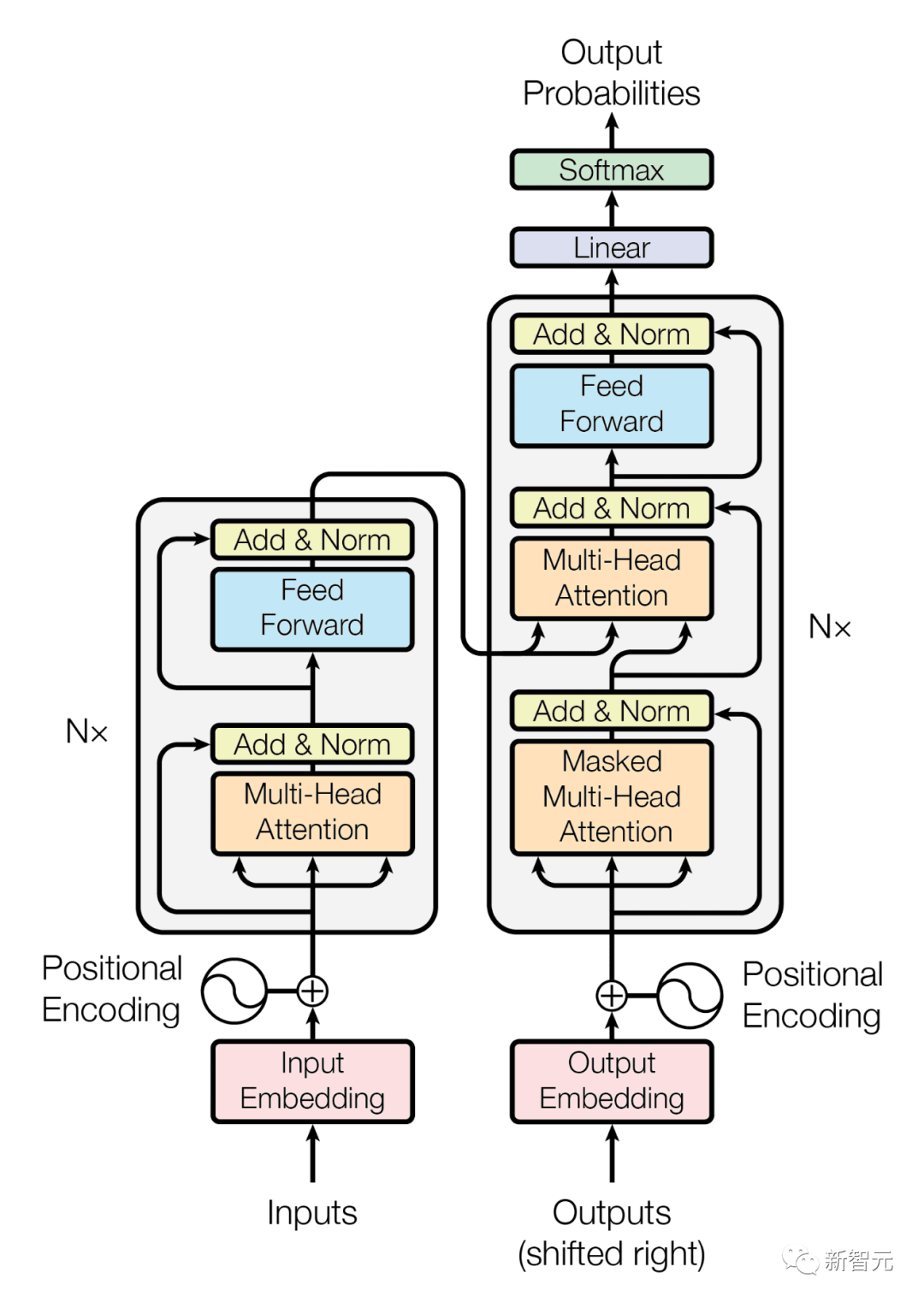

Transformer無疑是過去幾年內機器學習領域最流行的模型。

自2017年在論文「Attention is All You Need」中提出之后,這個新的網絡結構,刷爆了各大翻譯任務,同時創造了多項新的記錄。

但Transformer在處理長字節序列時有個硬傷,就是算力損耗嚴重,而Meta的研究人員的最新成果則可以很好地解決這一缺陷。

他們推出了一種全新的模型架構,能跨多種格式生成超過100萬個token,并超越GPT-4等模型背后的現有 Transformer架構的功能。

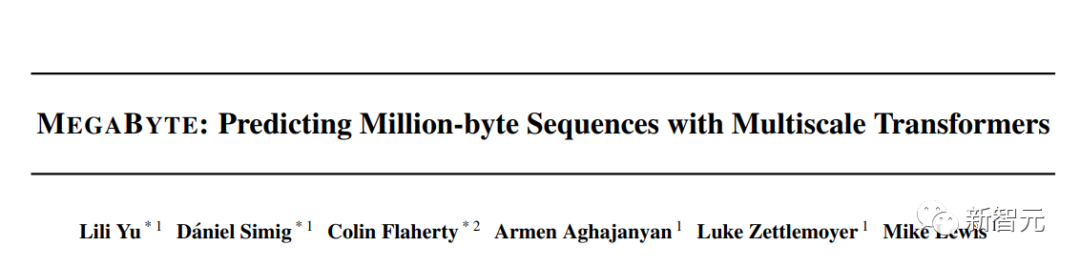

這個模型被稱為「兆字節」(Megabyte),是一種多尺度解碼器架構(Multi-scale Decoder Architecture),可以對超過一百萬字節的序列進行端到端可微分建模。

論文鏈接:https://arxiv.org/abs/2305.07185

Megabyte為什么比Transformer強,就得先看看Transformer的不足之處在哪。

Transformer的不足

迄今為止幾類高性能的生成式AI模型,如OpenAI的GPT-4、Google的Bard,都是基于Transformer架構的模型。

但Meta的研究團隊認為,流行的Transformer架構可能正達到其閾值,其中主要理由是Transformer設計中固有的兩個重要缺陷:

- 隨著輸入和輸出字節長度的增加,自注意力的成本也迅速增加,如輸入的音樂、圖像或視頻文件通常包含數兆字節,然而大型解碼器 (LLM)通常只使用幾千個上下文標記

- 前饋網絡通過一系列數學運算和轉換幫助語言模型理解和處理單詞,但在每個位置的基礎上難以實現可擴展性,這些網絡獨立地對字符組或位置進行操作,從而導致大量的計算開銷

Megabyte強在哪

相比Transformer,Megabyte模型展示了一種獨特的不同架構,將輸入和輸出序列劃分為patch而不是單個token。

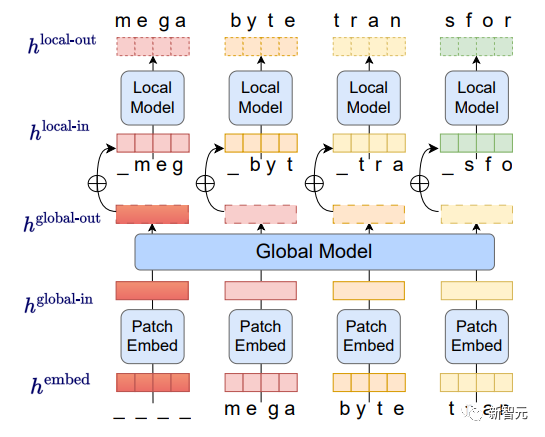

如下圖,在每個patch中,本地AI模型生成結果,而全局模型管理和協調所有patch的最終輸出。

首先,字節序列被分割成固定大小的patch,大致類似于token,這個模型由三部分組成:

(1) patch嵌入器:通過無損地連接每個字節的嵌入來簡單地編碼patch

(2) 一個全局模型:一個輸入和輸出patch表示的大型自回歸變換器

(3) 一個本地模型:一個預測patch中字節的小型自回歸模型

研究人員觀察到,對于多數任務而言字節預測都相對容易(如完成給定前幾個字符的單詞),這意味著每個字節的大型網絡是不必要的,并且可以使用更小的模型進行內部預測。

這種方法解決了當今AI模型中普遍存在的可擴展性挑戰,Megabyte 模型的patch系統允許單個前饋網絡在包含多個token的patch上運行,從而有效解決了自注意力縮放問題。

其中,Megabyte架構對長序列建模的Transformer進行了三項主要改進:

- 二次自注意力(Sub-quadratic self-attention)

大多數關于長序列模型的工作都集中在減輕自注意力的二次成本上,而Megabyte將長序列分解為兩個較短的序列,即使對于長序列也仍然易于處理。

- patch前饋層(Per-patch feedforward layers)

在GPT-3大小的模型中,超過98%的FLOPS用于計算位置前饋層,Megabyte每個patch使用大型前饋層,以相同的成本實現更大、性能更強的模型。在patch大小為P的情況下,基線轉換器將使用具有m個參數的相同前饋層P次,兆字節可以以相同的成本使用具有mP個參數的層一次。

- 解碼中的并行性(Parallelism in Decoding)

Transformers必須在生成期間串行執行所有計算,因為每個時間步的輸入是前一個時間步的輸出,通過并行生成patch的表示,Megabyte允許在生成過程中實現更大的并行性。

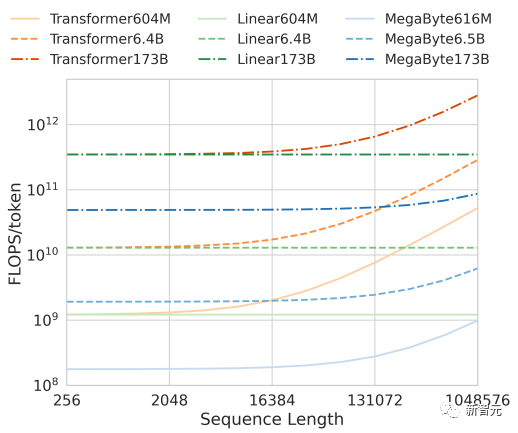

例如,具有1.5B參數的Megabyte模型生成序列的速度比標準的350MTransformer快40%,同時在使用相同的計算量進行訓練時還能改善困惑度。

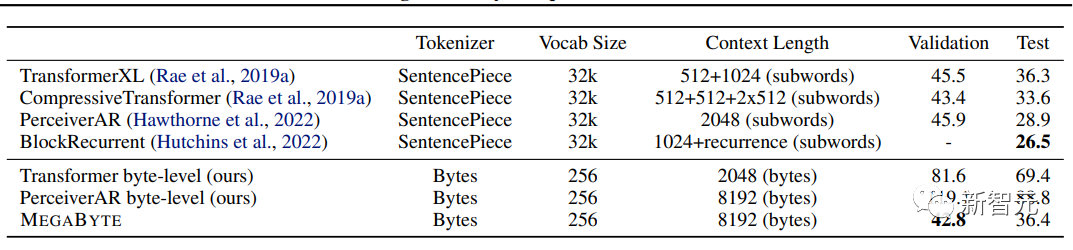

Megabyte遠遠優于其他模型,并提供與在子詞上訓練的 sota 模型競爭的結果

相比之下,OpenAI 的GPT-4有32,000個token的限制,而Anthropic的Claude有100,000個token的限制。

此外,在運算效率方面,在固定模型大小和序列長度范圍內,Megabyte比同等大小的Transformers和Linear Transformers使用更少的token,允許以相同的計算成本使用更大的模型。

總之,這些改進使我們能夠在相同的計算預算下訓練更大、性能更好的模型,擴展到非常長的序列,并提高部署期間的生成速度。

未來將會如何

隨著AI軍備競賽進行地如火如荼,模型性能越來越強,參數也越來越高。

雖然GPT-3.5在175B個參數上進行了訓練,但有人猜測功能更強大的GPT-4在1萬億個參數上進行了訓練。

OpenAI的CEO Sam Altman最近也建議轉變戰略,他表示公司正在考慮舍棄對龐大模型的訓練,而專注于其他性能的優化。

他將AI模型的未來等同于iPhone芯片,而大多數消費者對原始技術規格一無所知。

Meta的研究人員相信他們的創新架構來得正是時候,但也承認還有其他優化途徑。

例如采用修補技術的更高效的編碼器模型、將序列分解為更小塊的解碼模型以及將序列預處理為壓縮token等,并且可以擴展現有Transformer架構的能力以構建新一代模型。

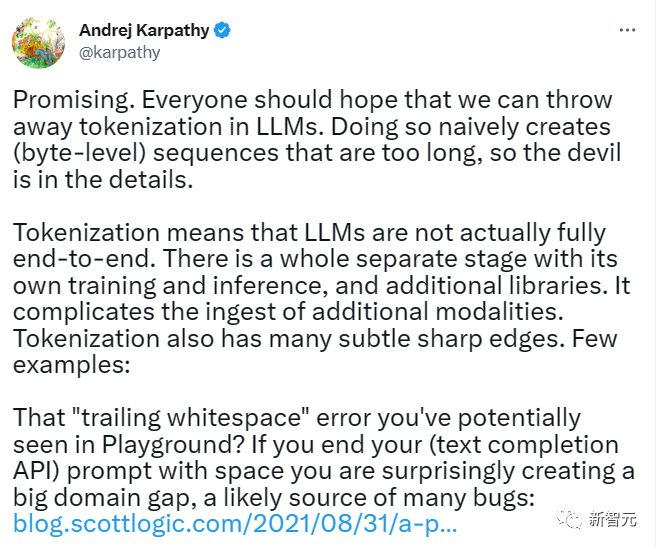

前特斯拉AI總監Andrej Karpathy也在這篇論文中發表了看法,他在推特上寫道:

這是非常有希望的,每個人都應該希望我們能在大模型中扔掉標記化,也不需要那些過長字節的序列。