點擊參加51CTO網(wǎng)站內(nèi)容調(diào)查問卷

作者 | 徐杰承

自ChatGPT問世以來,強大的理解力與信息總結(jié)能力便使得其快速成為了各行業(yè)從業(yè)者的得力助手,無論是程序員、作家、學(xué)生還是記者都能夠依靠ChatGPT的幫助來提升實際的工作效率。

然而在硬幣的另一面,幻覺問題卻也始終困擾著這款誕生并不太久的聊天機器人,并且隨著所涉獵場景的不斷增加,ChatGPT的幻覺也開始在越來越多的情況下給用戶甚至是其母公司OpenAI帶來麻煩。

就在不久前,一位記者為了撰寫報告,要求ChatGPT提供一起有關(guān)美國槍支權(quán)利基金會(SAF)的案件摘要。然而在幻覺的作祟之下,ChatGPT編造了一起并不存在的貪腐案件,還將莫須有罪名強加到了一位與基金會并無太多關(guān)聯(lián)的電臺主持人頭上。

而得知自己遭到ChatGPT惡意誣陷的電臺主持人,也在一氣之下將OpenAI告上了法庭,使這家如日中天的企業(yè)背上了有史以來第一個關(guān)于人工智能的誹謗訴訟。

1、電臺主持人化身槍支基金會高官

這起事件的主角Mark Walters是Armed America電臺的一位主持人。作為合法持槍權(quán)的擁護者,Walters時常會通過各類渠道呼吁民眾支持合法持槍權(quán)。由于他為槍支自由所做出的貢獻,美國槍支權(quán)利基金會曾于2017年授予了Walters杰出服務(wù)獎。

Mark Walters

但也正因這個獎項,使得ChatGPT錯誤地將Walters與SAF聯(lián)系了起來。在被記者要求提供有關(guān)SAF的案件介紹及摘要時,ChatGPT鬼使神差的將Mark Walters的名字附在了一份刑事訴訟之上。

在ChatGPT提供給記者的摘要中,原本只獲得過SAF獎項的電臺主持人搖身一變成為了SAF的首席財務(wù)官和司庫,更為離譜的是,在幻覺的驅(qū)使下,ChatGPT還為Walters捏造了一項利用職務(wù)之便詐騙、貪污基金會資金的罪名。

而當(dāng)記者要求ChatGPT繼續(xù)提供相關(guān)訴狀的具體案件卷宗時,ChatGPT依然假模假式地制造了一封完全不存在的案件文檔,甚至為了讓文件看起來更加真實,ChatGPT還主動向記者提供了捏造出來的案件編號。

從記者口中得知這一事件的Walters非常氣憤,并在第一時間聘請律師將OpenAI告上了法庭。Walters表示:ChatGPT對自己的指控是虛假、惡意的,通過印刷、寫作圖片等內(nèi)容,傷害了自己的名譽,并使自己受到了公眾的仇恨、蔑視或嘲笑。

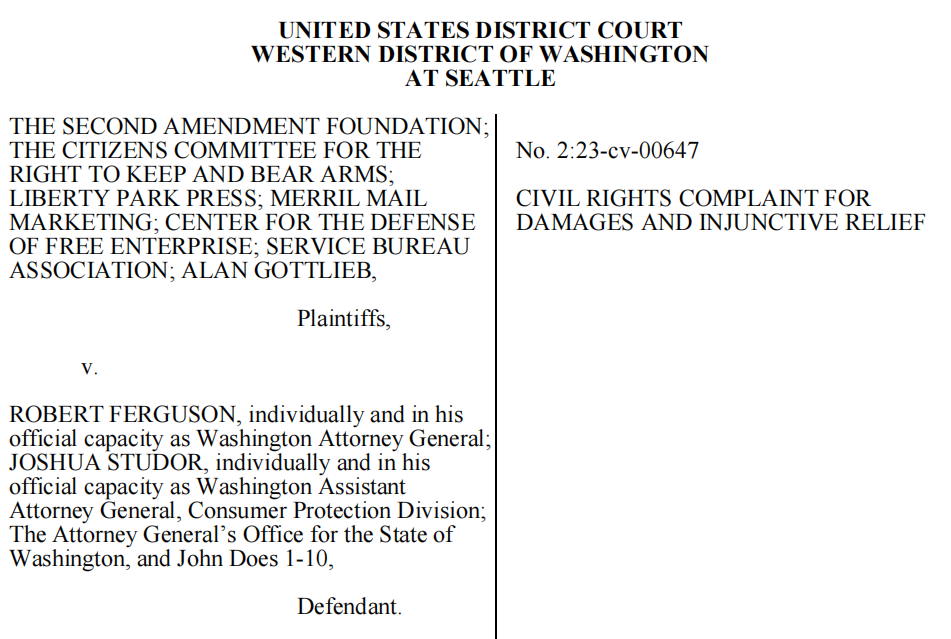

訴訟文件

根據(jù)法院所出示的公開信息,Walters起訴OpenAI要求賠償其個人損失及律師費。但由于司法界意見并為達成統(tǒng)一,截至目前該案件尚未正式開庭。至于Walters所要求的賠償,法院方則表示,如案件確認開庭,賠償金將會在審判時予以確定。

2、ChatGPT為什么總會說謊

眾所周知,ChatGPT的幻覺問題由來已久,捏造訴訟也并不是第一次了。就在幾周前,一名律師讓ChatGPT幫忙整理案件材料,而ChatGPT所提供的6起案件全是假的,這也讓這位粗心的律師差點丟掉了飯碗。

對于Walters的案件,熟悉AI系統(tǒng)的法學(xué)教授Eugene分析稱,ChatGPT產(chǎn)生幻覺的原因可能是由于受到了與記者的對話歷史的影響。ChatGPT的回答會基于對話的上下文,如果對話歷史存在錯誤或不明確信息,那么ChatGPT就會比較容易受到影響。

在與ChatGPT進行交互的過程中,記者首先要求ChatGPT提供SAF相關(guān)的案件及摘要而不是確切的鏈接或文檔,若此時ChatGPT的訓(xùn)練數(shù)據(jù)中存在錯誤信息或缺少該方面內(nèi)容,那么這就很可能會導(dǎo)致幻覺的產(chǎn)生。

隨后記者又要求ChatGPT提供其所生成案件的相關(guān)卷宗,為了能夠滿足用戶需求,此時的ChatGPT便在無法查詢到不存在案件的情況下,模仿類似文件的樣式,自動生成了一份能夠以假亂真的文檔。

Eugene強調(diào)稱,雖然ChatGPT的幻覺產(chǎn)生可能是由于記者所給出的提示不夠準(zhǔn)確。但在這起案件中,記者并沒有主動引導(dǎo)ChatGPT進行造假,只是對ChatGPT提出了正常需求,因此所造成的影響與使用者并無關(guān)系。

3、OpenAI該承擔(dān)責(zé)任嗎

Walters的律師Monroe在接受采訪時表示:雖然OpenAI在ChatGPT的使用條款中標(biāo)注了“用戶應(yīng)當(dāng)根據(jù)用例評估輸出的準(zhǔn)確性,包括人工審查輸出結(jié)果”。但OpenAI不能僅僅通過這樣簡單的標(biāo)注來逃避誹謗責(zé)任。

ChatGPT聲明

Walters所提交給法院的訴狀指出,OpenAI早就意識到ChatGPT有時會捏造事實,并將這種現(xiàn)象稱為幻覺。這一案件是檢驗公司對人工智能系統(tǒng)法律責(zé)任的一個重要案例,OpenAI知道它的人工智能系統(tǒng)正在發(fā)布誹謗信息,但它們試圖依靠一些小手段回避這一點,這顯然是在混淆視聽。

對此,Eugene教授也從法律角度提出了自己的看法,他表示,在誹謗罪名相關(guān)法律責(zé)任中,如果原告“可以證明被告陳述是虛假的”,并且“可以證明被告在作出虛假陳述的行為導(dǎo)致?lián)p害了原告的實際利益”,那么誹謗索賠原則上就是合法的。

然而Eugene也提到,以自己的了解,目前沒有法律先例要求公司是對人工智能輸出內(nèi)容負責(zé)。雖然此類誹謗索賠原則上是可行的,但這起特殊訴訟應(yīng)該很難維持,因為事發(fā)過后,Walters沒有通知OpenAI這些虛假信息,給他們一個機會來刪除它們,并且他也很難有效證明ChatGPT的輸出對他造成了實際的損害。

4、網(wǎng)友熱評 :都是幻覺

這起史無前例的、將OpenAI送上法庭的案件,也在網(wǎng)上一石激起千層浪,引發(fā)了大量網(wǎng)友廣泛的討論。

Beryllium Sphere在Slashdot的留言中寫到:如果一家公司的機器因為其疏忽造成了損失,該公司應(yīng)當(dāng)承擔(dān)責(zé)任。OpenAI當(dāng)然知道ChatGPT的輸出不可靠,他們也在主頁上進行了標(biāo)注,但我認可Walters的觀點,這樣的警告不足以讓他們避免責(zé)任。

Koga Onutalepo提到:盡管如此,我仍然很難將OpenAI視為這里的責(zé)任方,它只是創(chuàng)建了這個復(fù)雜的自動系統(tǒng)。他對這位主持人一無所知,ChatGPT也只是根據(jù)提示生成了聽起來合理的描述,如果讓OpenAI承擔(dān)責(zé)任,似乎很多人可以要求ChatGPT捏造他們想要的任何故事,然后以此來起訴OpenAI。

JJMORRIS2000則在Reddit上留言表示:這就是我討厭“幻覺”一詞的原因,ChatGPT獲得答案的過程只是遵循了不同的隨機路徑來生成文本字符串,并最終提出它自己認為正確的東西。所以如果說生成錯誤答案被認為是一種幻覺,那生成正確答案其實也可以被認為是一種幻覺。

歸根結(jié)底,我們目前依然無法從根本上解決大模型的幻覺問題,但隨著以ChatGPT為首的人工智能工具不斷深入各行業(yè),未來的我們在享受生成式人工智能所帶來便利的同時,也注定將會在技術(shù)、法律、監(jiān)管等領(lǐng)域面臨更多未知的挑戰(zhàn)。

現(xiàn)階段我們所能做的,就是保持對一切問題的理性看待,依靠在一次次不同經(jīng)歷中所積累的經(jīng)驗,逐步完善對生成式人工智能的監(jiān)管與控制。在降低技術(shù)所帶來的負面影響的同時,盡可能地發(fā)揮出它的最大價值,這是我們需要在未來不斷思考并著力解決的最主要課題。

最后,對于這起史無前例的誹謗訴訟,你有什么不一樣的看法呢?

參考鏈接:

https://www.theregister.com/2023/06/08/radio_host_sues_openai_claims/