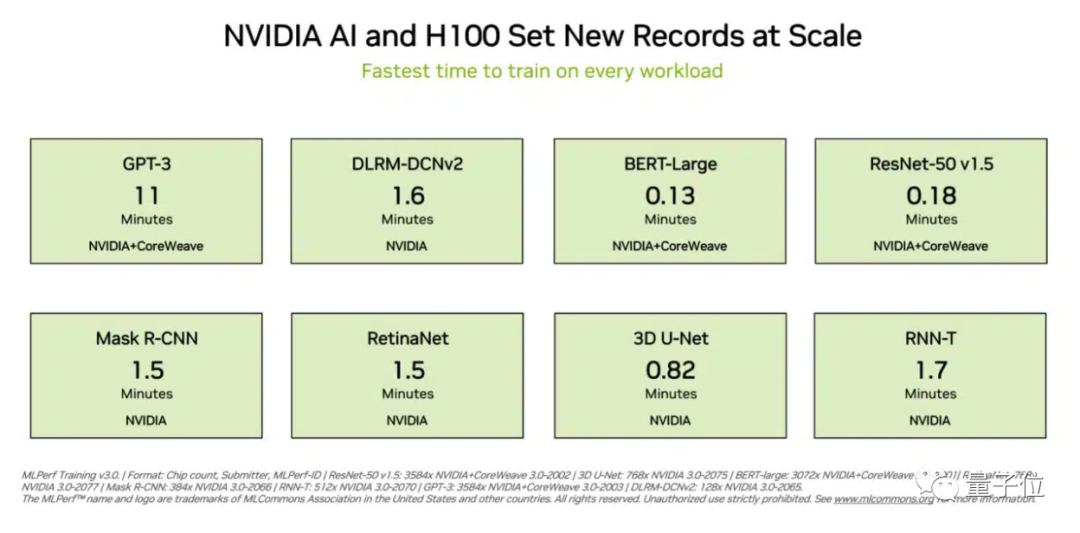

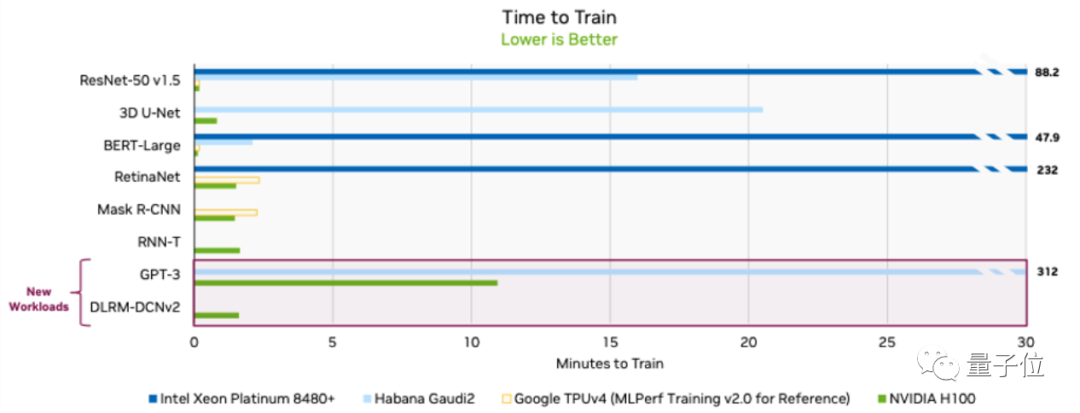

英偉達(dá)H100殺瘋了:11分鐘訓(xùn)完GPT-3,霸榜8項(xiàng)測(cè)試,集群性能逼近線性增長(zhǎng)

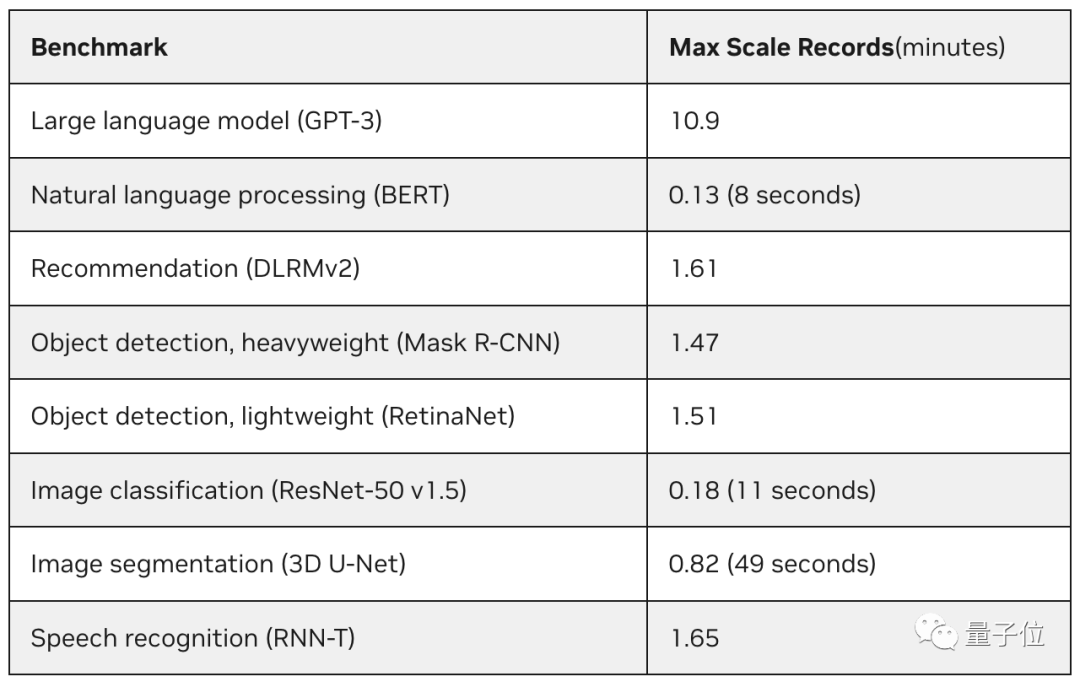

11分鐘內(nèi)訓(xùn)練一遍GPT-3,8秒訓(xùn)完BERT。

這就是英偉達(dá)給AI圈的一點(diǎn)“小小震撼”。

在最新MLPerf訓(xùn)練基準(zhǔn)測(cè)試中,英偉達(dá)H100集群,橫掃八項(xiàng)測(cè)試,全部創(chuàng)下新紀(jì)錄,并且在大語言模型任務(wù)中表現(xiàn)尤為突出!

圖片

圖片

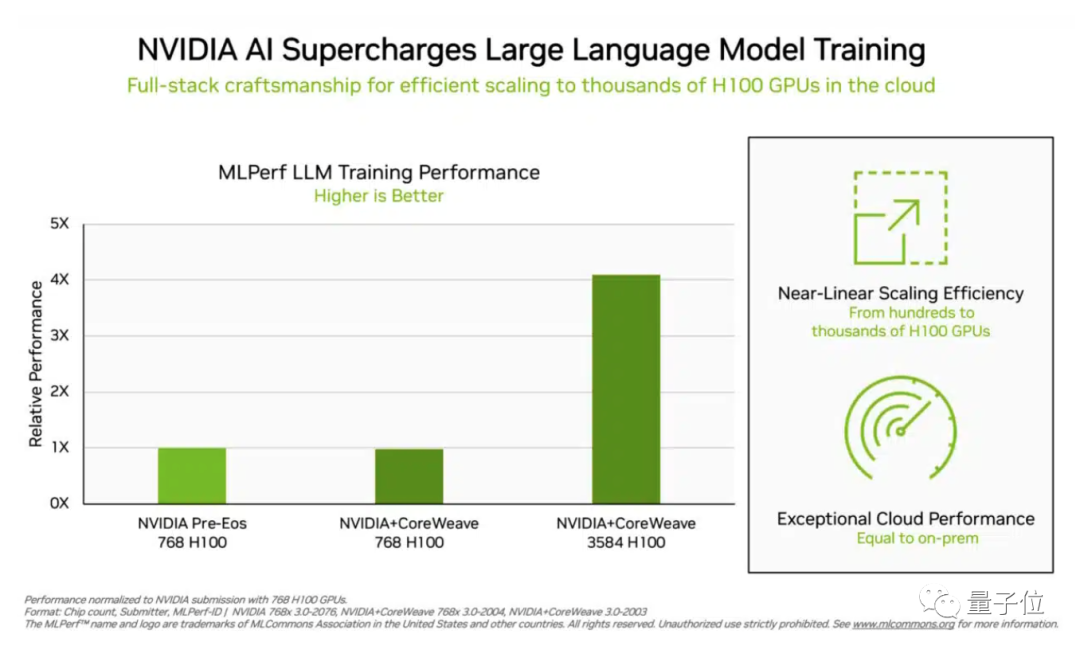

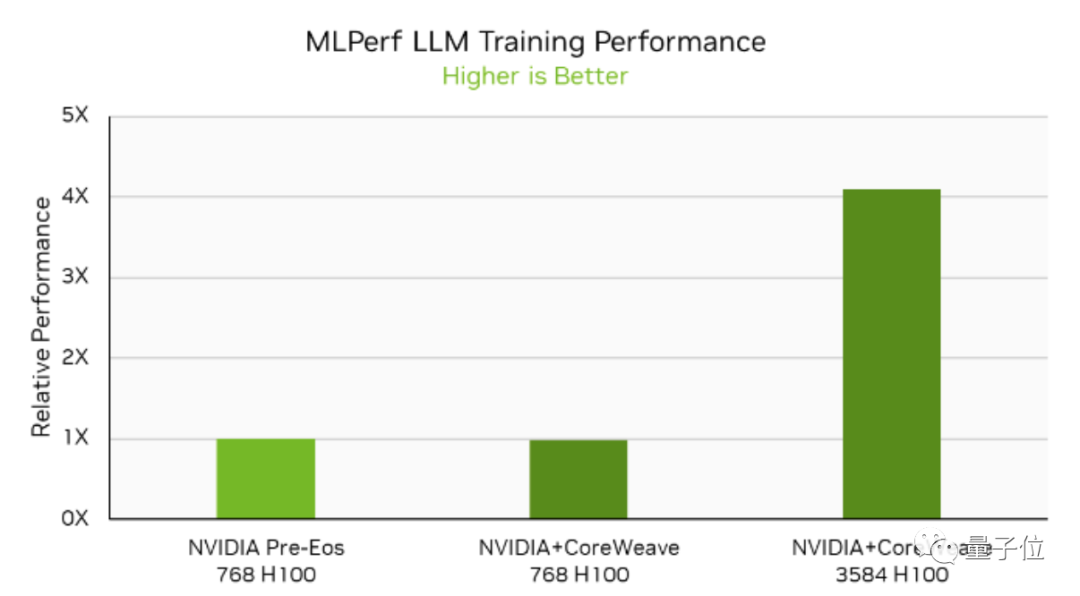

在大語言模型任務(wù)中,H100集群的加速性能逼近線性增長(zhǎng)。

即隨著集群處理器數(shù)量增加,加速效果也幾乎同比增加。

這意味著在集群內(nèi)GPU之間的通信效率非常高。

圖片

圖片

除此之外,H100還完成了推薦算法、CV、醫(yī)學(xué)圖像識(shí)別以及語音識(shí)別等任務(wù),是唯一一個(gè)參加8項(xiàng)測(cè)試的集群。

而在算力就是生產(chǎn)力的時(shí)代下,這波成績(jī)意味著什么,懂得都懂。

圖片

圖片

據(jù)悉,本次測(cè)試系統(tǒng)由英偉達(dá)和Inflection AI聯(lián)合開發(fā),在云廠商CoreWeave上托管。

單節(jié)點(diǎn)性能增長(zhǎng)明顯

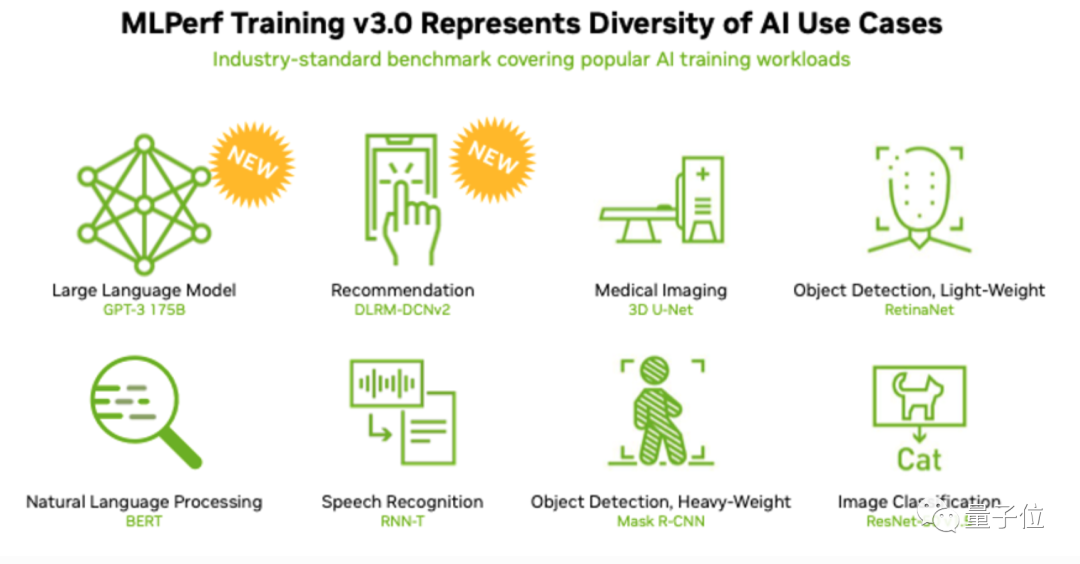

這次MLPerf Training v3.0中增加了兩項(xiàng)新任務(wù):

- 大語言模型(基于GPT-3)

- 推薦算法

這意味著測(cè)試任務(wù)包含了更大的數(shù)據(jù)集和更先進(jìn)的模型。

圖片

圖片

如上刷新各項(xiàng)記錄的,是由3584塊H100組成的超大集群。

它的具體成績(jī)?nèi)缦拢?/p>

圖片

圖片

這是本輪測(cè)試中,英偉達(dá)拿出的最大集群。

實(shí)際上他們還提交了一個(gè)包含768塊H100的集群進(jìn)行測(cè)試,并分別在云上和本地部署。

結(jié)果顯示二者性能幾乎完全相同。

更進(jìn)一步還論證了隨著集群中顯卡數(shù)量的增加,其性能提升可以接近線性增長(zhǎng)。

(NVIDIA Pre-Eos為本地部署,NVIDIA+CoreWeave為云上部署)

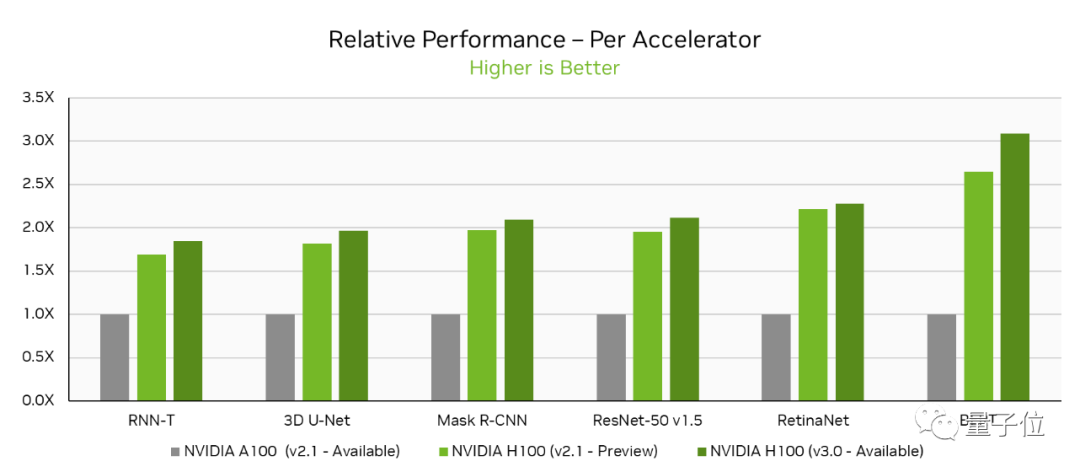

除此之外,這輪測(cè)試中英偉達(dá)還刷新了單節(jié)點(diǎn)加速記錄。

和6個(gè)月前MLPef Training v2.1的數(shù)據(jù)比較,單個(gè)DGX H100系統(tǒng)(8塊H100組成)在各項(xiàng)任務(wù)中平均提速17%。

和A100 Tensor Core GPU相比,最高能提速3.1倍(BERT任務(wù))。

這些加速效果的實(shí)現(xiàn),主要得益于兩個(gè)方面。

一方面是H100本身就足夠強(qiáng)悍。

H100基于最新Hopper架構(gòu),采用臺(tái)積電4nm工藝,集成800億個(gè)晶體管,較A100增加了260億個(gè)。

內(nèi)核數(shù)量達(dá)到前所未有的16896個(gè),是A100的2.5倍。

由于面向AI計(jì)算,H100中專門搭載了Transformer Engine,讓大模型訓(xùn)練速度可直接×6。

另一方面則是依賴集群內(nèi)的加速網(wǎng)絡(luò)。

這里使用的是英偉達(dá)Quantum-2 InfiniBand網(wǎng)絡(luò),是該網(wǎng)絡(luò)架構(gòu)的第七代。

官網(wǎng)介紹,加速網(wǎng)絡(luò)能夠提供軟件定義網(wǎng)絡(luò)、網(wǎng)絡(luò)內(nèi)計(jì)算、性能隔離、優(yōu)越加速引擎、RDMA和最快達(dá)400Gb/s的安全加速。

據(jù)悉,共有90個(gè)系統(tǒng)參與最新一輪測(cè)試,其中82個(gè)使用了英偉達(dá)的GPU,英特爾方面有7個(gè)系統(tǒng)參與。

英特爾的加速系統(tǒng)使用了64-96 Intel Xeon Platinum 8380處理器和256-389 Intel Habana Gaudi2加速器。

其高配系統(tǒng)完成LLM的訓(xùn)練時(shí)間為311分鐘。

基于這次報(bào)告的測(cè)試結(jié)果,有分析師表示他感受到的最大震撼不是H100本身的性能,而是在云上訓(xùn)練AI實(shí)現(xiàn)的卓越效果。

那么這次和英偉達(dá)合作的云廠商CoreWeave是誰?聯(lián)合開發(fā)系統(tǒng)Inflection AI又來者何人?

計(jì)算集群還會(huì)進(jìn)一步擴(kuò)大

首先來看CoreWeave。

它成立于2017年,是一家大型云廠商,號(hào)稱提供業(yè)內(nèi)最快、最靈活的大規(guī)模GPU計(jì)算資源,提供渲染、機(jī)器學(xué)習(xí)等云上方案,速度比大型公共云快35倍,成本低80%。

而這家云廠商很受科技巨頭青睞,英偉達(dá)在此之前沒少cue過它。

5月,CoreWeave拿下2億美元融資,主要來自對(duì)沖基金Magnetar Capital,B輪總?cè)谫Y額達(dá)到4.21億美元。

6月,有消息稱微軟與CoreWeave簽署AI算力協(xié)議,用于計(jì)算基礎(chǔ)設(shè)施,未來數(shù)年內(nèi)的投資金額可能數(shù)十億美元。

英偉達(dá)也向CoreWeave投資了1億美元,4月時(shí)它的估值為20億美元。

另一家AI初創(chuàng)公司Inflection AI由DeepMind創(chuàng)始成員穆斯塔法·蘇萊曼(Mustafa Suleyman)等人創(chuàng)立。

這家公司成立于22年3月,已拿下2.25億美元融資,估值超12億美元。

公司已經(jīng)開發(fā)出了一個(gè)大語言模型Pi,正是在H100集群上訓(xùn)練出來的。

據(jù)了解,Pi的定位是幫助人類更好和計(jì)算機(jī)交互,它能通過聊天內(nèi)容來逐漸了解用戶,然后提供更加個(gè)性化的回答,類似于個(gè)人智能管家的感覺。

Inflection AI的最新Blog里表示,基于目前的合作,他們計(jì)劃在未來幾個(gè)月內(nèi)進(jìn)一步擴(kuò)大底層計(jì)算基礎(chǔ)設(shè)施的規(guī)模。

參考鏈接:

[1]https://blogs.nvidia.com/blog/2023/06/27/generative-ai-debut-mlperf/?cnotallow=685ee2dc8db6455efed731baa85e2741

[2]https://developer.nvidia.com/blog/breaking-mlperf-training-records-with-nvidia-h100-gpus/

[3]https://www.forbes.com/sites/stevemcdowell/2023/06/27/nvidia-h100-dominates-new-mlperf-v30-benchmark-results/?sh=62b226c35e99