陳丹琦ACL學術報告來了!詳解大模型「外掛」數據庫7大方向3大挑戰,3小時干貨滿滿

本文經AI新媒體量子位(公眾號ID:QbitAI)授權轉載,轉載請聯系出處。

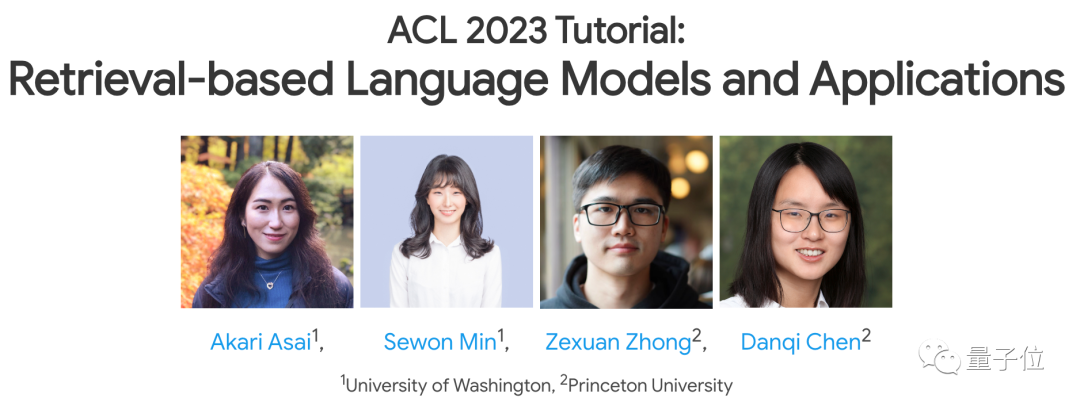

清華姚班校友陳丹琦,在ACL 2023上做了場最新演講!

話題還是近期非常熱門的研究方向——

像GPT-3、PaLM這樣的(大)語言模型,究竟是否需要依靠檢索來彌補自身缺陷,從而更好地應用落地。

在這場演講中,她和其他3位主講人一起,共同介紹了這個主題的幾大研究方向,包括訓練方法、應用和挑戰等。

圖片

圖片

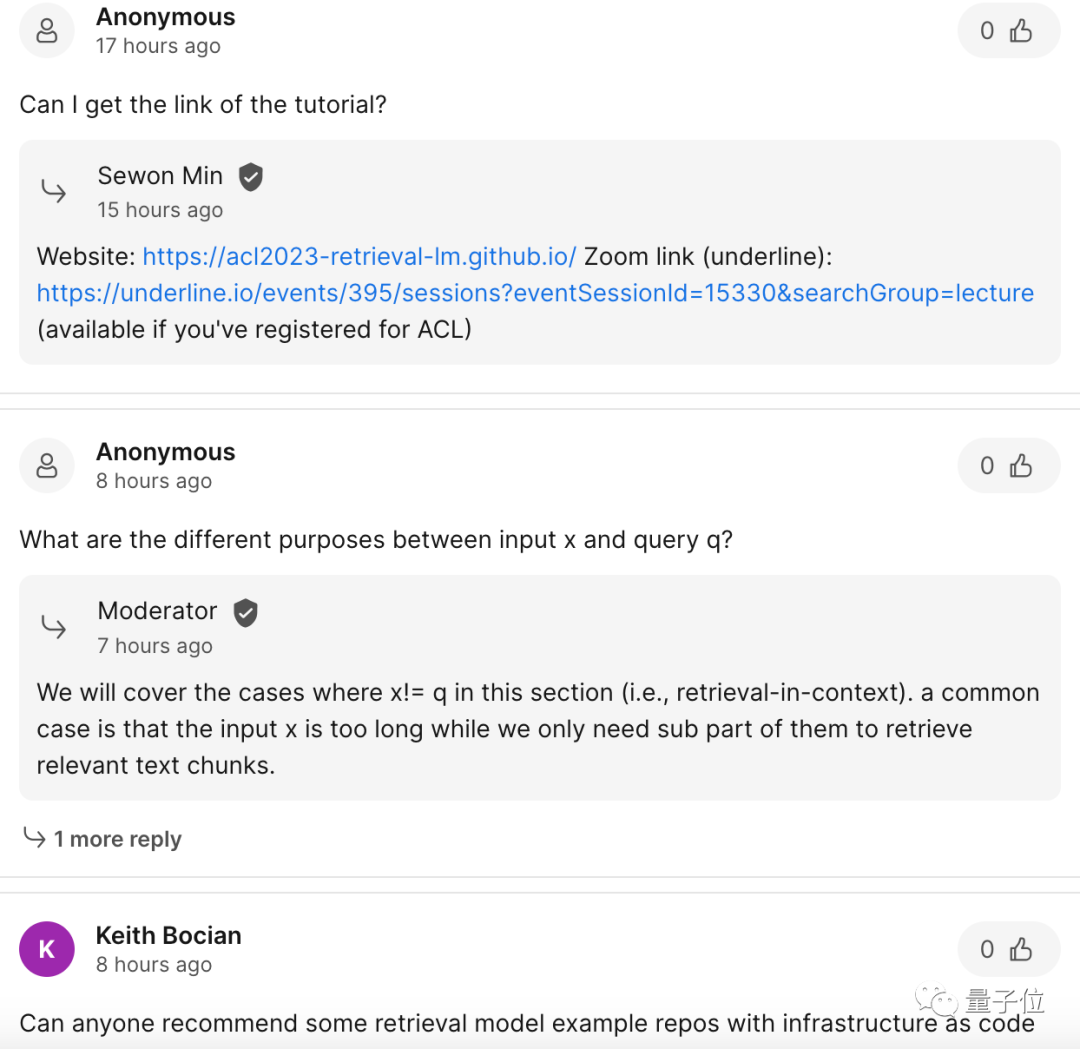

演講期間聽眾的反響也很熱烈,不少網友認真地提出了自己的問題,幾位演講者盡力答疑解惑。

圖片

圖片

至于這次演講具體效果如何?有網友直接一句“推薦”給到評論區。

圖片

圖片

所以,在這場長達3個小時的演講中,他們具體講了些什么?又有哪些值得一聽的地方?

大模型為何需要“外掛”數據庫?

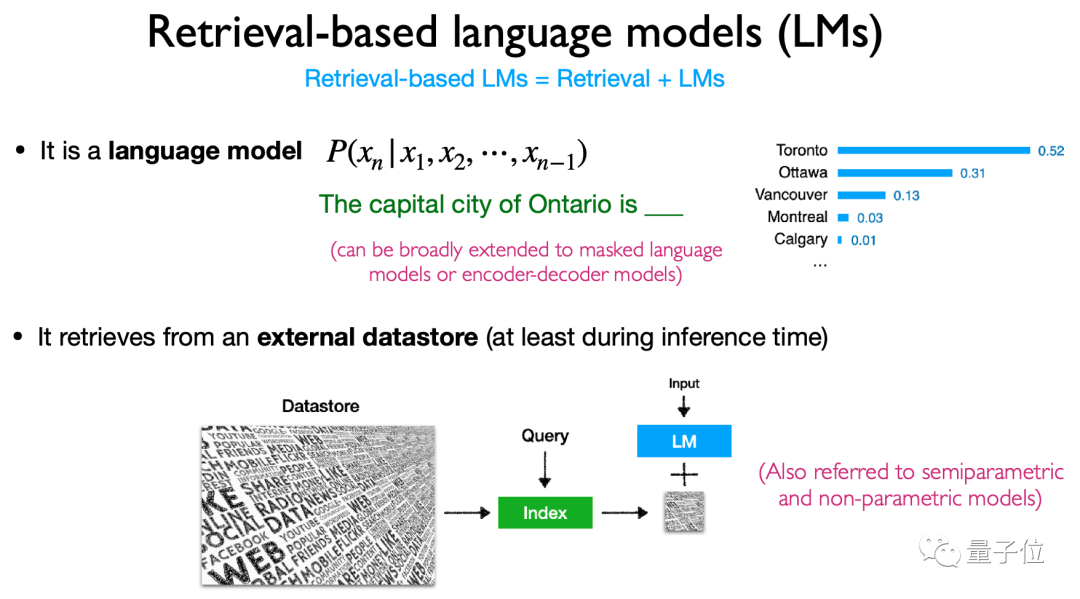

這場演講的核心主題是“基于檢索的語言模型”,包含檢索和語言模型兩個要素。

從定義上來看,它指的是給語言模型“外掛”一個數據檢索庫,并在進行推理(等操作)時對這個數據庫進行檢索,最后基于檢索結果進行輸出。

這類外掛數據存儲庫,也被稱之為半參數模型或非參數模型。

圖片

圖片

之所以要研究這個方向,是因為如GPT-3和PaLM這類(大)語言模型,在表現出不錯的效果同時,也出現了一些讓人頭疼的“bug”,主要有三個問題:

1、參數量過大,如果基于新數據重訓練,計算成本過高;

2、記憶力不行(面對長文本,記了下文忘了上文),時間一長會產生幻覺,且容易泄露數據;

3、目前的參數量,不可能記住所有知識。

在這種情況下,外部檢索語料庫被提出,即給大語言模型“外掛”一個數據庫,讓它隨時能通過查找資料來回答問題,而且由于這種數據庫隨時能更新,也不用擔心重訓的成本問題。

介紹完定義和背景之后,就是這個研究方向具體的架構、訓練、多模態、應用和挑戰了。

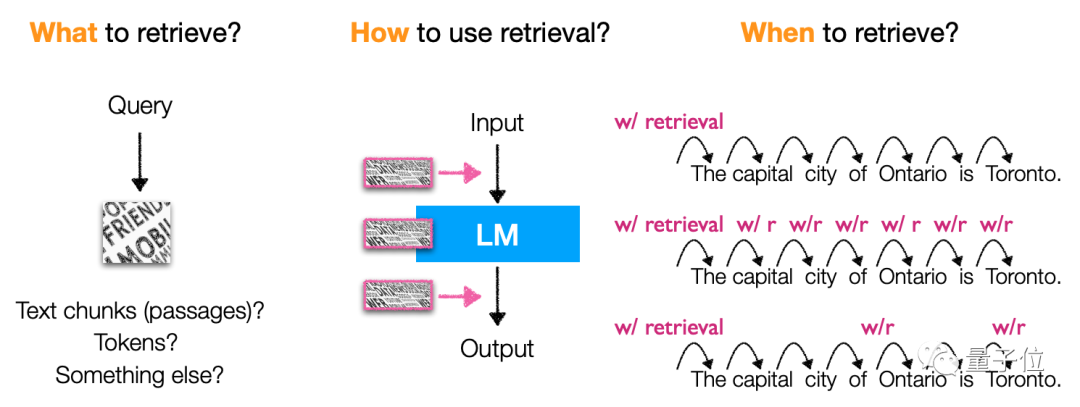

在架構上,主要介紹了基于檢索的語言模型檢索的內容、檢索的方式和檢索的“時機”。

具體而言,這類模型主要會檢索token、文本塊和實體詞語(entity mentions),使用檢索的方式和時機也很多樣性,是一類很靈活的模型架構。

圖片

圖片

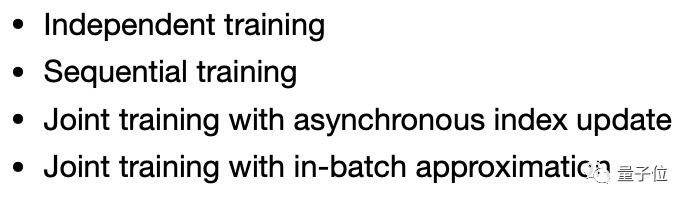

在訓練方式上,則著重介紹了獨立訓練(independent training,語言模型和檢索模型分開訓練)、連續學習(sequential training)、多任務學習(joint training)等方法。

圖片

圖片

至于應用方面,這類模型涉及的也就比較多了,不僅可以用在代碼生成、分類、知識密集型NLP等任務上,而且通過微調、強化學習、基于檢索的提示詞等方法就能使用。

應用場景也很靈活,包括長尾場景、需要知識更新的場景以及涉及隱私安全的場景等,都有這類模型的用武之地。

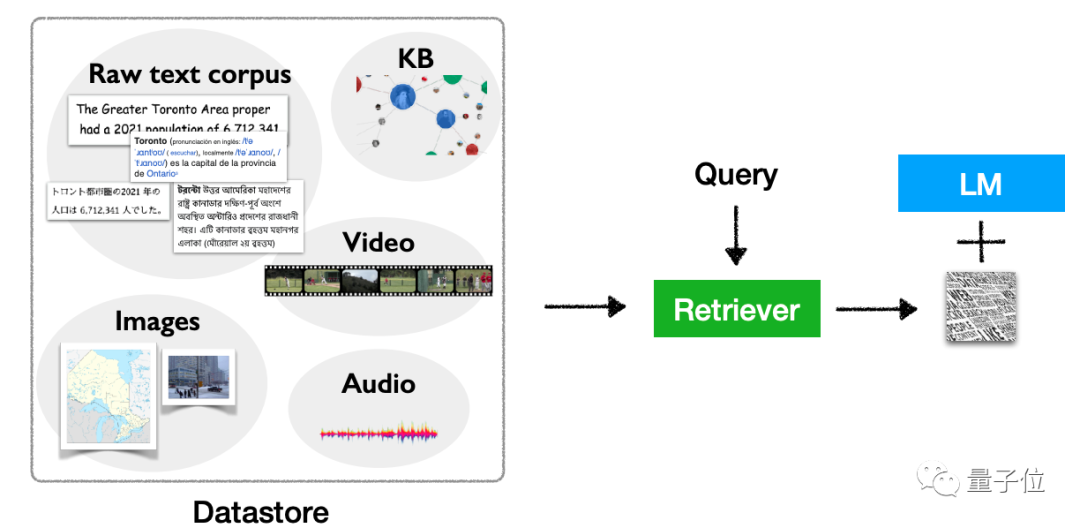

當然,不止是文本上。這類模型也存在多模態擴展的潛力,可以將它用于文本以外的任務上。

圖片

圖片

聽起來這類模型優點很多,不過基于檢索的語言模型,當下也存在一些挑戰。

陳丹琦在最后“收尾”的演講中,著重提到了幾點這個研究方向需要解決的幾大難題。

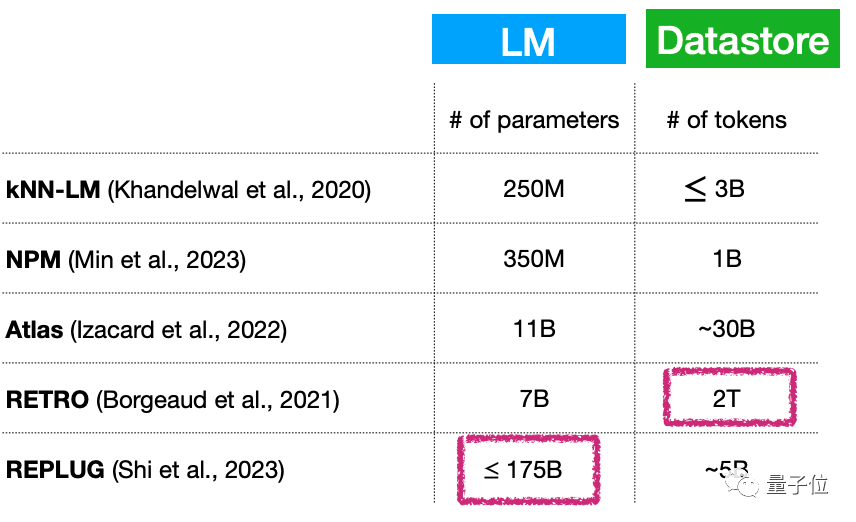

其一,小語言模型+(不斷擴張的)大數據庫,本質上是否意味著語言模型的參數量依舊很大?如何解決這一問題?

例如,雖然這類模型的參數量可以做到很小,只有70億參數量,但外掛的數據庫卻能達到2T……

圖片

圖片

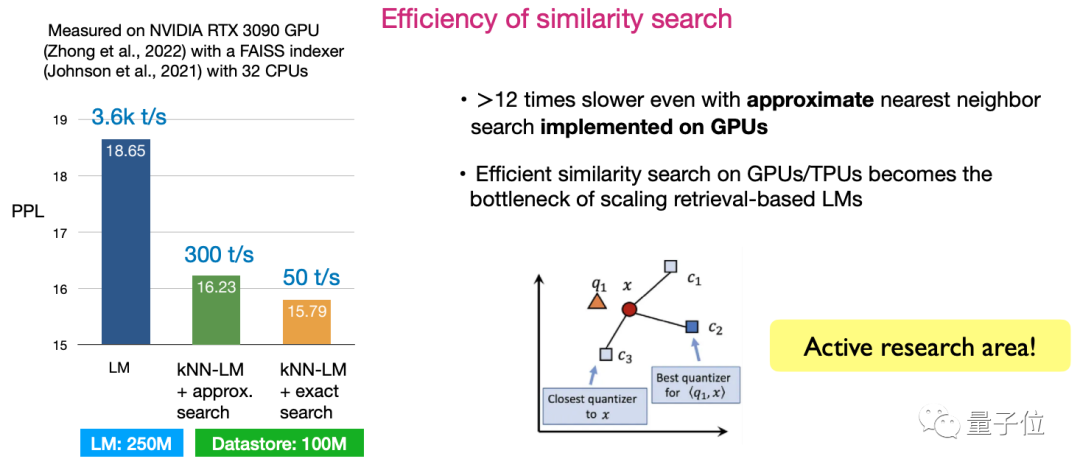

其二,相似性搜索的效率。如何設計算法使得搜索效率最大化,是目前非常活躍的一個研究方向。

圖片

圖片

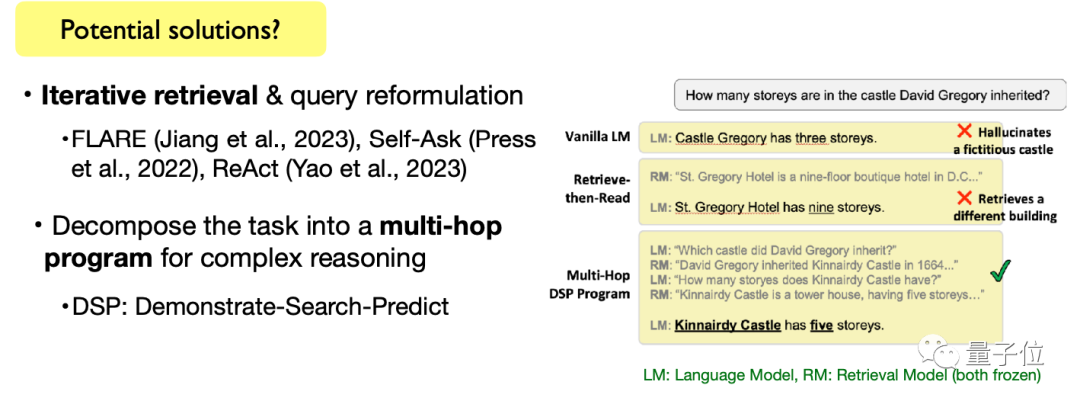

其三,完成復雜語言任務。包括開放式文本生成任務,以及復雜的文本推理任務在內,如何用基于檢索的語言模型完成這些任務,也是需要持續探索的方向。

圖片

圖片

當然,陳丹琦也提到,這些話題是挑戰的同時,也是研究機遇。還在尋找論文課題的小伙伴們,可以考慮是否把它們加進研究列表了~

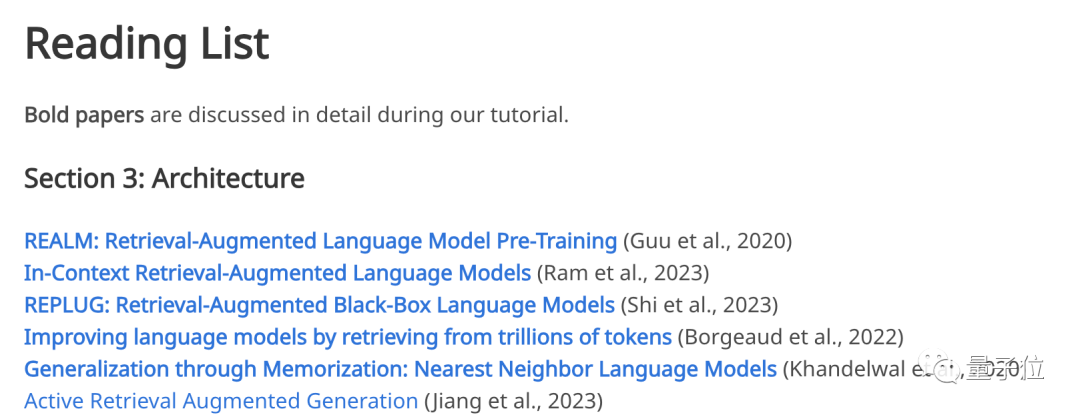

值得一提的是,這次演講也不是“憑空”找出的話題,4位演講者貼心地在官網放出了演講參考的論文鏈接。

從模型架構、訓練方法、應用、多模態到挑戰,如果對這些話題中的任何一部分感興趣,都可以去官網找找對應的經典論文來看:

圖片

圖片

現場解答聽眾困惑

這么干貨滿滿的演講,四位主講人也不是沒有來頭,在演講中他們還耐心地對聽眾提出的問題進行了解答。

我們先來康康主講人都是誰。

首先是主導這次演講的普林斯頓大學計算機科學助理教授陳丹琦。

圖片

圖片

她是計算機科學領域近來最受關注的華人青年學者之一,也是08級清華姚班校友。

在信息學競賽圈,她頗具傳奇色彩——CDQ分治算法就是以她的名字命名。2008年,她代表中國隊斬獲一枚IOI金牌。

而她的那篇長達 156 頁的博士畢業論文《Neural Reading Comprehension and Beyond》,更是一度火爆出圈,不光獲得當年斯坦福最佳博士論文獎,還成為了斯坦福大學近十年來最熱門畢業論文之一。

現在,陳丹琦除了是普林斯頓大學計算機科學助理教授,也是該校從頭搭建NLP小組的聯合負責人、AIML小組成員。

她的研究方向主要聚焦于自然語言處理和機器學習,并且對在實際問題中具有可行性、可擴展性和可泛化性的簡單而又可靠的方法饒有興趣。

同樣來自普林斯頓大學的,還有陳丹琦的徒弟鐘澤軒(Zexuan Zhong)。

圖片

圖片

鐘澤軒是普林斯頓大學的四年級博士生。碩士畢業于伊利諾伊大學香檳分校,導師是謝濤;本科畢業于北京大學計算機系,曾在微軟亞研院實習,導師是聶再清。

他的最新研究主要聚焦于從非結構化文本中提取結構化信息、從預訓練語言模型中提取事實性信息、分析稠密檢索模型的泛化能力,以及開發適用于基于檢索的語言模型的訓練技術。

此外,主講人還有來自華盛頓大學的Akari Asai、Sewon Min。

圖片

圖片

Akari Asai是華盛頓大學主攻自然語言處理的四年級博士生,本科畢業于日本東京大學。

她主要熱衷于開發可靠且適應性強的自然語言處理系統,提高信息獲取的能力。

最近,她的研究主要集中在通用知識檢索系統、高效自適應的NLP模型等領域。

圖片

圖片

Sewon Min是華盛頓大學自然語言處理小組的博士候選人,讀博士期間,曾在Meta AI兼職擔任研究員長達四年,本科畢業于首爾國立大學。

最近她主要關注語言建模、檢索以及二者的交叉領域。

在演講期間,聽眾也很熱情地提出了眾多問題,例如為啥要用perplexity(困惑度)來作為演講的主要指標。

圖片

圖片

主講人給出了細心解答:

在比較參數化的語言模型時,困惑度(PPL)經常被用到。但困惑度的改善能否轉化為下游應用仍然是一個研究問題。

現已有研究表明,困惑度與下游任務(尤其是生成任務)有很好的相關性,并且困惑度通常可提供非常穩定的結果,它可以在大規模評估數據上進行評估(相對于下游任務來說,評估數據是沒有標簽的,而下游任務可能會受到提示的敏感性和缺乏大規模標記數據的影響,從而導致結果不穩定)。

圖片

圖片

還有網友提出了這樣的疑問:

關于“語言模型的訓練成本高昂,而引入檢索可能會解決這個問題”的說法,你只是將時間復雜度替換為空間復雜度(數據存儲)了嗎?

主講人給出的解答是醬嬸的:

我們討論的重點是如何將語言模型縮減到更小,從而減少時間和空間的需求。然而,數據存儲實際上也增加了額外的開銷,這需要仔細權衡和研究,我們認為這是當前的挑戰。

與訓練一個擁有一百億以上參數的語言模型相比,我認為目前最重要的是降低訓練成本。

圖片

圖片

想找這次演講PPT,或是蹲具體回放的,可以去官網看看~

官方網址:https://acl2023-retrieval-lm.github.io/