AIoTel下視頻編碼技術(下)

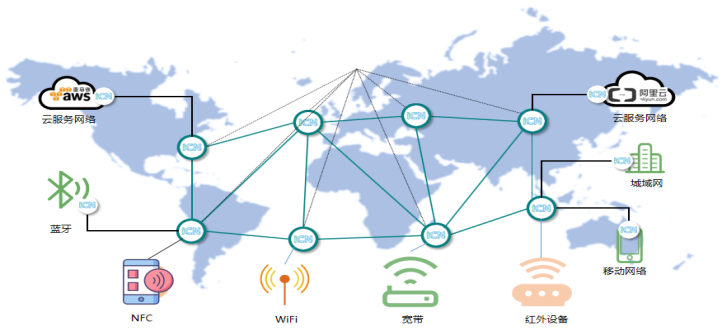

在進入正題之前,我們先回顧下《AIoTel下視頻編碼技術(上)》。在《上》中我們給出了AIoTel定義,即:AIoTel是一個組合詞,它由AI+IoT+Telephony拼接而成,表達由智能設備、物聯網、多媒體通信等技術構建的新型多媒體交互體系,也稱作物聯多媒體。接著討論了AIoTel及媒體特征,以及這些特征決定的AIoTel編碼技術必須滿足自適應、場景化等要求。

圖1 AIoTel通信

1、視頻編碼在AIoTel中的挑戰

在AIoTel中,視頻編碼面臨著諸多挑戰。首先,帶寬限制和硬件資源限制要求我們提升視頻編碼的壓縮效率。其次,為了保證良好的用戶體驗,我們需要改進視頻質量和復雜度的平衡。此外,如何在保證視頻編碼性能的同時,保護用戶的數據隱私和安全,也成為了重要的挑戰,總結起來有以下四個突出特點:

1??低延時和高效率

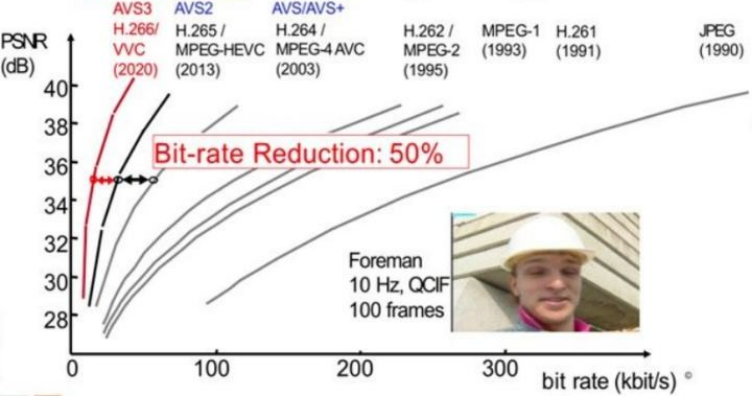

在很多AIoTel應用場景中,如和家智話、智慧車載等,需要實現實時的視頻傳輸和處理。H.266/VVC(Versatile Video Coding),雖然在編碼效率上比H.265提高了超50%,但其編碼復雜度增加10倍以上,無法滿足AIoTel設備低算力高實時的要求。

圖2 H26X 碼率比較

2??高質量和高分辨率

高清、超高清等高分辨率的視頻成為了趨勢。2022年,全球有超過82%的互聯網流量由視頻內容產生,其中4K和8K視頻的占比大幅增加。這對視頻編碼技術提出了更高的要求:一方面,AIoTel設備的計算和存儲資源有限,需要高效的視頻編碼算法以減少計算和存儲壓力;另一方面,物聯網設備通常通過無線網絡進行通信,帶寬資源有限,也需要高效的視頻編碼算法以減少傳輸壓力。

3??安全和隱私保護

在AIoTel設備中,視頻數據往往涉及到個人隱私或者商業機密。如何在視頻編碼過程中保護視頻數據的安全和隱私,是一個具有戰略意義的研究方向。根據Check Point Research(CPR)的報告,2022年,物聯網上的網絡攻擊事件增長了38%,其中涉及到視頻數據的攻擊事件占比顯著增加。這說明了安全和隱私保護在視頻編碼中的重要性。(https://zhuanlan.zhihu.com/p/597994525 2023.1.10)

4??跨平臺和跨設備的兼容性

在AIoTel系統中,視頻數據需要在不同的平臺和設備之間進行傳輸和處理。如何實現跨平臺和跨設備的視頻編碼兼容性,仍然是一個挑戰。據Sandvine最新發布的《2023全球互聯網現象報告》顯示,2022年的全球物聯網視頻流量同比增長23%,其中,跨平臺和跨設備的視頻流量增長最為顯著,約占總量65.93%。(https://www.ennews.com/news-41889.html 2023.4.24)

圖3 AIoTel設備接入多樣性

接下來,我們就以上挑戰,提出我們的應對思路,包括引入語義通信和大模型。

2、應對挑戰的策略和技術

針對上述挑戰,我們提出了包括云端和邊緣的協同處理、高效網絡傳輸以及兼容性等多方面應對策略。

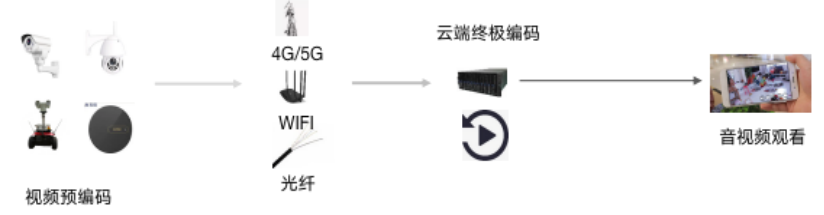

2.1 云端和邊緣的協同處理

隨著AIoTel網絡中設備數量的增加,如何有效處理和編碼視頻數據,以實現高效的數據傳輸,是當前面臨的重要挑戰。云端有強大的計算能力,可以進行高質量的視頻編碼,但其需要較大的帶寬和延時,這對實時應用帶來了阻礙。而邊緣設備由于臨近用戶,具有低延時的優勢,但其計算能力有限,可能無法進行高質量的視頻編碼。因此,云端和邊緣的協同處理成為一種可能的解決方案。通過在邊緣設備上進行預編碼,然后在云端進行終極編碼,可以在保持編碼質量的同時,減少了約30%的帶寬需求。

圖4 云邊端協同編碼

2.2 提升編碼效率

根據IDC預測,到2025年,物聯網設備生成的數據量預計將達到73.1 ZB,(http://www.jiyikeji.cn/trends/news-id/43/ 2022.5.20)這將給視頻存儲帶來巨大挑戰,在傳統的視頻編碼技術中,H.266/VVC相較H.265,可提升超50%壓縮效率,但復雜度提升10倍以上,傳統的編碼技術演進方越來越接近極限。與此同時AI技術為視頻編碼帶來了新的機遇和挑戰。AI可以幫助我們更好地理解和優化視頻編碼過程,如通過深度學習的方法優化編碼參數選擇,或者通過強化學習的方法動態調整編碼策略。研究表明,使用深度神經網絡優化的H.265編碼,可以在保持同等圖像質量的情況下,比原始編碼節省約80%的碼率。但這也對計算資源和數據安全提出了更高的要求。如何在保證編碼效率和質量的同時,合理使用和管理這些資源,是我們需要解決的關鍵問題。

2.3 保障數據安全與隱私

在AIoTel環境下,數據安全與隱私保護已成為一項至關重要的議題。面對眾多挑戰,如設備多樣性、數據類型復雜性,以及終端設備安全漏洞等問題,我們需要在視頻編碼過程中考慮如何更好地保障數據的安全與隱私。

- 視頻數據加密

首先,對于視頻數據,我們需要應用加密技術來確保其在傳輸和存儲過程中的安全性。這里涉及到各種加密算法和協議,例如對稱加密算法(如AES)、非對稱加密算法(如RSA)、以及用于保障數據完整性和認證的哈希函數和數字簽名等。

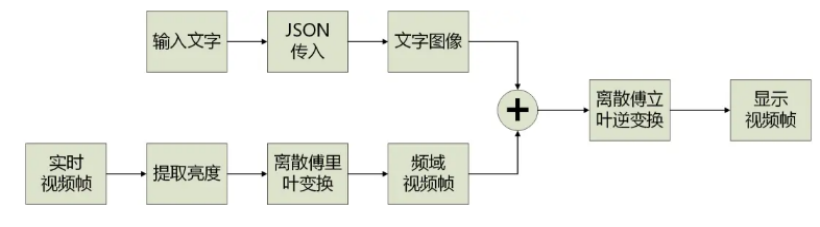

- 數字水印技術

除了加密技術,數字水印也是一種重要的視頻數據保護技術。通過在視頻數據中嵌入不可見或難以察覺的水印,我們可以對視頻數據進行身份標識和版權保護,同時也能檢測和追蹤數據泄露和非法分發。常見的數字水印技術有空域水印、頻域水印,其中頻域水印如離散余弦變換(DCT)水印、離散傅里葉變換(DFT)水印以及離散小波變換(DWT)水印等。

圖5 視頻水印生成原理

總的來說,數據安全與隱私保護在視頻編碼中的應用需要我們在技術、架構和政策等多個層面進行考慮和設計。這是一項既有挑戰又有機遇的工作,我們需要不斷探索新的技術和策略,平衡安全和效率,進一步提升編碼技術的數據安全性。

2.4 兼容性和平臺無關性

市場研究機構IoT Analytics發布了報告顯示,2022年全球物聯網連接數增長了18%,達到143億。2023年全球聯網物聯網設備的數量將再增長16%,達到160億個(https://www.sohu.com/a/679524270_121119003 2023.5),海量設備令我們必須面對兼容性問題。首先,選擇成熟且廣泛被支持的編碼標準,如H.264/AVC,可在多種設備和平臺上進行播放和解碼,如PC、智能手機、電視機、游戲機等。其次,自適應流媒體技術(Adaptive Bitrate Streaming, ABS)可以在網絡條件不同的情況下,提供最佳的用戶體驗。

2.5 語義編碼的應用

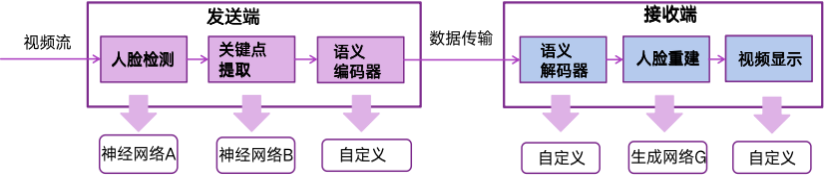

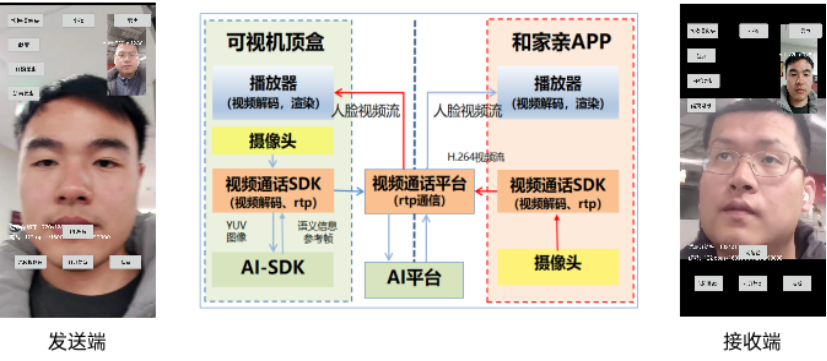

語義編碼是一種新興的視頻編碼技術,這種方法可以減少一個數量級的傳輸數據量。研究思路如下:在發送端發送一個初始參考幀 I_ref,此后只傳輸人臉關鍵點信息 Kps_t=F_B(I_t)( I_t :原始圖像),自定義編碼規則壓縮數據;在接收端主要通過生成對抗網絡(GAN)進行圖像重建及顯示實現 (I_t) ?=G(I_ref,Kps_t)( (I_t) ? :生成圖像)

圖6 語義編碼原理

基于這個思路,我們在AIoTel設備上做了人臉通信實驗,節省碼率83%:

圖7 人臉語義通信實踐

3、AIoTel中的大模型與視頻編碼

大模型是一種革命性的AI技術,我們希望它也能給視頻編碼帶來機會,因此單列一章。

大模型尤其是深度學習模型在諸多領域如計算機視覺,自然語言處理等均取得了顯著的成果。模型規模逐年增大,從最初的幾百萬參數到現今的數十億,甚至上百億參數,展示出了深度學習模型處理復雜問題的強大能力。但隨著模型規模的增大,訓練所需的計算資源,存儲需求以及能耗等問題也日益凸顯,這對于AIoTel領域來說是個嚴峻的挑戰,因為在AIoTel設備上,通常需要在資源有限的情況下執行模型推理。

3.1 大模型在視頻編碼中的應用和挑戰

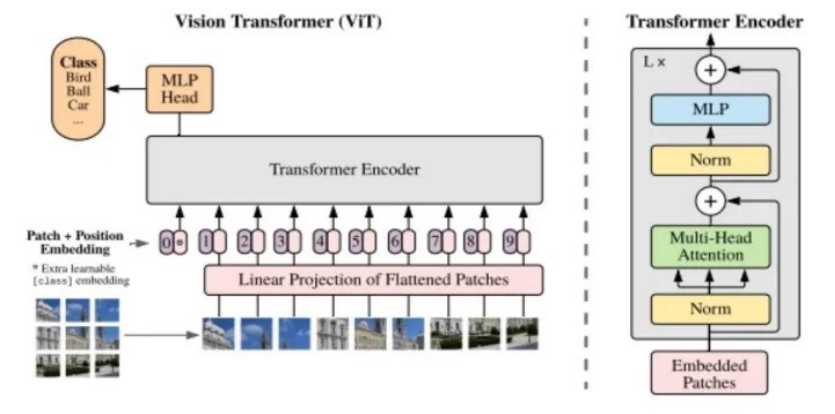

大模型在視頻編碼中的應用提供了新的研究和發展方向。例如,視覺自注意力模型(VIT)、深度生成模型如變分自編碼器(VAE)和生成對抗網絡(GAN)已經在視頻壓縮、超分辨率、去噪等任務中取得了一些成果。某些研究工作已經采用深度學習模型替代傳統的預測和變換模塊,使得視頻編碼效率得到了一定提升。例如,用于視頻編碼的深度可分離卷積網絡模型DVC,其編碼效率相比傳統H.265編碼提升約30%。

然而大模型在視頻編碼中的應用也面臨一些挑戰。首先,訓練大模型需要大量的計算資源和數據,這對許多機構和個人來說是不可達到的。其次,大模型通常需要較大的推理時間,這可能會限制其在實時視頻編碼中的應用。此外,大模型可能會過度擬合訓練數據,導致在實際使用中的效果不理想。

圖8 Vision Transformer(VIT)

3.2 應對挑戰的策略和技術

大模型由于其龐大的計算需求和內存占用,通常需要在有大量計算資源和儲存空間的服務器上運行。然而,視頻編碼則需要在端側實時完成,這樣才能滿足低延遲的實時視頻傳輸需求。解決這個問題的一種可能的方向是模型壓縮、硬件加速和聯邦學習等策略。

- 模型壓縮

模型壓縮技術旨在減小深度學習模型的大小和計算復雜性,而不顯著降低模型的性能。主要的模型壓縮技術包括知識蒸餾、權值量化、結構剪枝等。通過這些技術,大模型可以被壓縮為一個小模型,這個小模型可以在資源受限的端側設備上運行,同時保持相當的性能,使其更適用于實時視頻編碼。

- 聯邦學習

聯邦學習等分布式學習方法可以解決訓練大模型所需大量數據和計算資源的問題,通過在設備上本地處理數據,然后僅共享模型更新,大大減少了數據傳輸的需求。

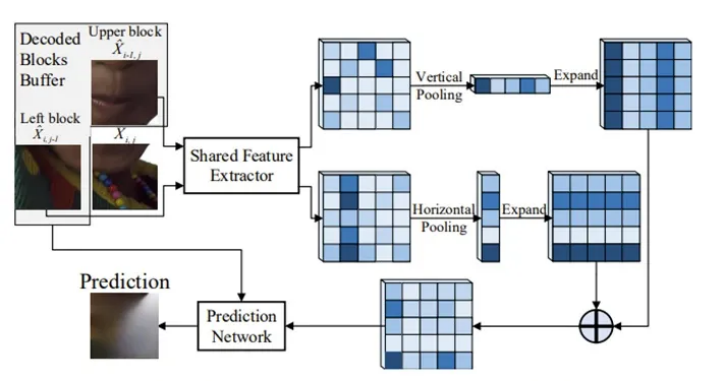

- 混合編碼

一些研究工作提出了混合編碼框架,其中深度學習模型與傳統編碼模塊共同工作,這種方法在提高編碼效率的同時,也降低了對計算資源的需求。

- 硬件加速

硬件加速是另一種解決方案,通過使用專門設計的硬件加速器,如GPU、TPU和專用的AI芯片,可以大大加速大模型的計算。一些設備制造商已經開始在其端側設備上集成這些硬件加速器,這使得大模型能夠在這些設備上運行。

將模型壓縮、聯邦學習、混合編碼以及和硬件加速相結合,可以在端側設備上運行大模型,同時滿足視頻編碼的實時需求。這是一個非常活躍的研究領域,未來還需要進一步的研究和發展才能實現大模型在端側設備上的廣泛部署。

圖9 混合編碼器

4、總結和展望

隨著AIoT技術的飛速發展,視頻編碼在AIoT領域中的作用也日益凸顯。目前,雖然基于傳統方法的視頻編碼仍然是主流,但深度學習模型在提升視頻編碼性能,尤其是在壓縮效率、視頻質量和復雜度平衡等方面已經展示出了強大的潛力,比如語義編碼。大模型如GPT-3和BERT等,雖然主要用于自然語言處理,但其在視頻編碼的應用也逐步被關注。

同時,面向未來,我們可以看到AIoTel中視頻編碼的一些新趨勢:一方面,隨著深度學習技術的發展,包括深度生成模型、自監督學習、聯邦學習等新技術和方法將在視頻編碼中發揮更大的作用。另一方面,隨著硬件技術,特別是AI硬件的進步,更強大、更高效的編碼算法將得以實現。此外,隨著數據隱私和安全問題的日益突出,如何在保證視頻編碼性能的同時,保護用戶的數據隱私和安全,將成為AIoTel中視頻編碼面臨的重要挑戰。