百度商業(yè)多模態(tài)理解及 AIGC 創(chuàng)新實(shí)踐

一、富媒體多模態(tài)理解

首先來(lái)介紹一下我們對(duì)多模態(tài)內(nèi)容的感知。

1、多模態(tài)理解

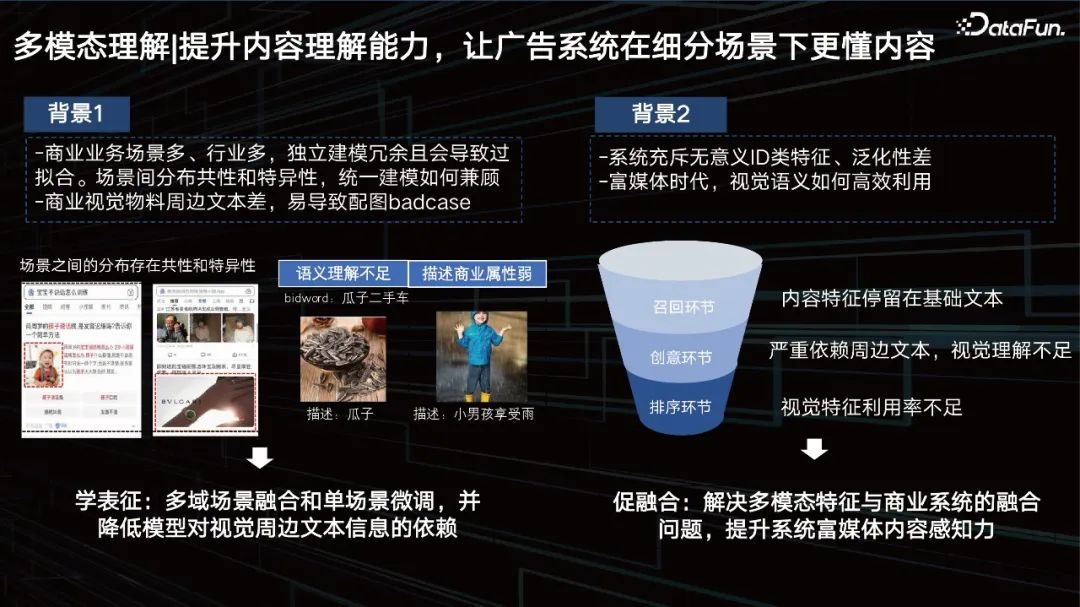

提升內(nèi)容理解能力,讓廣告系統(tǒng)在細(xì)分場(chǎng)景下更懂內(nèi)容。

在提升內(nèi)容理解能力時(shí),會(huì)遇到很多現(xiàn)實(shí)的問(wèn)題:

- 商業(yè)業(yè)務(wù)場(chǎng)景多、行業(yè)多,獨(dú)立建模冗余且會(huì)導(dǎo)致過(guò)擬合,場(chǎng)景間分布共性和特異性,統(tǒng)一建模如何兼顧。

- 商業(yè)視覺物料周邊文本差,易導(dǎo)致配圖badcase。

- 系統(tǒng)充斥無(wú)意義ID類特征、泛化性差。

- 富媒體時(shí)代,如何高效利用視覺語(yǔ)義,這些內(nèi)容特征、視頻特征和其他特征如何融合,是我們需要去解決的,用以提升系統(tǒng)內(nèi)對(duì)富媒體內(nèi)容的感知力度。

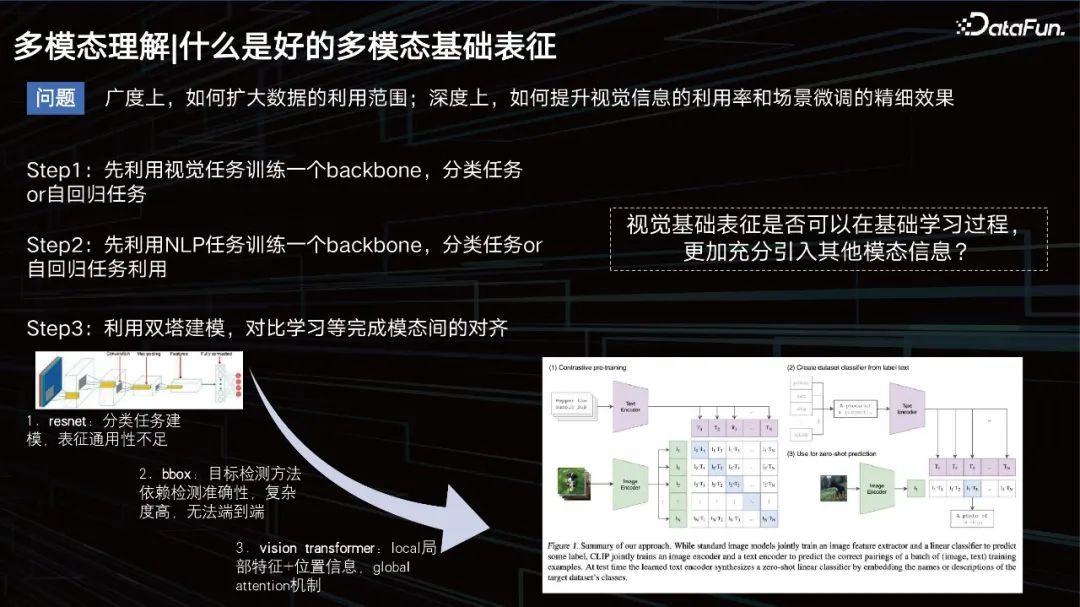

什么是好的多模態(tài)基礎(chǔ)表征。

什么是一個(gè)好的多模態(tài)表征?

從廣度上要擴(kuò)大數(shù)據(jù)應(yīng)用的范圍,從深度上要提升視覺效果,同時(shí)保證場(chǎng)景的數(shù)據(jù)微調(diào)。

之前,常規(guī)的思路是,訓(xùn)練一個(gè)模型去學(xué)習(xí)圖片的模態(tài),一個(gè)自回歸的任務(wù),然后做文本的任務(wù),再套用一些雙塔的模式,去拉近二者的模態(tài)關(guān)系。那時(shí)的文本建模比較簡(jiǎn)單,大家更多的是在研究視覺怎么建模。最開始是CNN,后面包括一些基于目標(biāo)檢測(cè)的方式去提升視覺的表征,比如bbox方式,但這種方式的檢測(cè)能力有限,并且太重了,并不利于大規(guī)模的數(shù)據(jù)訓(xùn)練。

到了2020年和2021年前后, VIT方式成為了主流。這里不得不提的一個(gè)比較有名的模型就是 OpenAI在20年發(fā)布的一個(gè)模型CLIP,基于雙塔的架構(gòu)分別去做文本和視覺的表征。再用cosine去拉進(jìn)二者的距離。該模型在檢索上面非常優(yōu)秀,但在VQA任務(wù)等一些需要邏輯推理的任務(wù)上,就稍顯能力不足了。

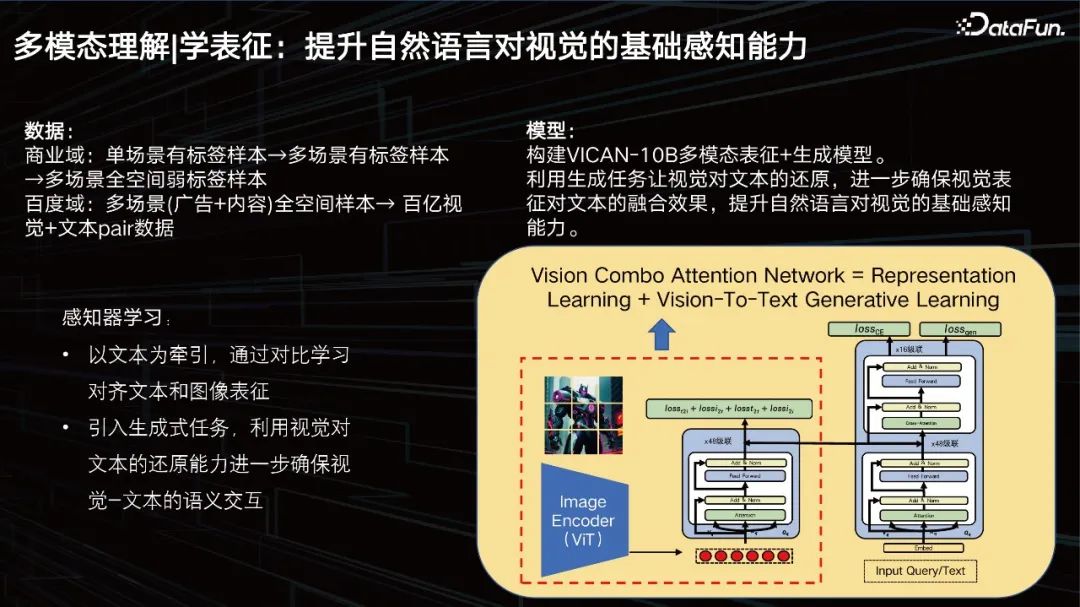

學(xué)表征:提升自然語(yǔ)言對(duì)視覺的基礎(chǔ)感知能力。

我們的目標(biāo)就是要提升自然語(yǔ)言對(duì)視覺的基礎(chǔ)感知能力。數(shù)據(jù)方面,我們的商業(yè)域有著億級(jí)的數(shù)據(jù),但仍然不夠,我們需要進(jìn)一步擴(kuò)展,引入商業(yè)域以往的數(shù)據(jù),并進(jìn)行清洗和梳理。構(gòu)建了百億級(jí)別的訓(xùn)練集。

我們構(gòu)建了VICAN-12B多模態(tài)表征+生成模型,利用生成任務(wù)讓視覺對(duì)文本的還原,進(jìn)一步確保視覺表征對(duì)文本的融合效果,提升自然語(yǔ)言對(duì)視覺的基礎(chǔ)感知能力。上圖中展示了模型的整體結(jié)構(gòu),可以看到它還是一個(gè)雙塔+單塔的復(fù)合結(jié)構(gòu)。因?yàn)槭紫纫鉀Q的是一個(gè)大規(guī)模圖片檢索的任務(wù)。左邊的框中的部分我們稱之為視覺的感知器,是一個(gè)20億參數(shù)規(guī)模的ViT結(jié)構(gòu)。右邊可以分兩層看,下面為了做檢索,是一個(gè)文本的transformer的堆疊,上面為了做生成。模型分為了三個(gè)任務(wù),一個(gè)是生成任務(wù),一個(gè)是分類任務(wù),一個(gè)是圖片對(duì)比任務(wù),基于這三個(gè)不同目標(biāo)去訓(xùn)練模型,所以達(dá)到了比較好的效果,但我們還會(huì)進(jìn)一步去優(yōu)化。

一套高效、統(tǒng)一、可遷移的多場(chǎng)景全域表征方案。

結(jié)合商業(yè)場(chǎng)景數(shù)據(jù),引入了LLM模型提升模型理解能力。CV模型是感知器,LLM模型是理解器。我們的做法就是需要把視覺特征進(jìn)行相應(yīng)的遷移,因?yàn)閯偛盘岬剑碚魇嵌嗄B(tài)的,大模型是基于文本的。我們只需要讓它去適配我們的文心LLM的大模型就可以了,所以我們需要利用Combo attention的方式,去做相應(yīng)的特征融合。我們需要保留大模型的邏輯推理能力,所以盡量不動(dòng)大模型,只是加入商業(yè)場(chǎng)景反饋數(shù)據(jù),去促進(jìn)視覺特征到大模型的融合。我們可以用few shot的方式去支撐下任務(wù)。主要任務(wù)包括:

- 圖片的描述,其實(shí)它不僅僅是個(gè)描述,而是一個(gè)Prompt逆向工程,優(yōu)質(zhì)的圖文數(shù)據(jù)可以作為我們后面文生圖的一個(gè)比較好的數(shù)據(jù)來(lái)源。

- 圖文相關(guān)性控制,因?yàn)樯虡I(yè)需要做配置,需要做對(duì)圖片信息的理解,我們廣告配圖的搜索詞和圖片語(yǔ)義其實(shí)是需要做控制的,當(dāng)然這是一個(gè)很通用的方式,就可以對(duì)圖片和Prompt進(jìn)行相關(guān)的判定。

- 圖片風(fēng)險(xiǎn)&體驗(yàn)控制,我們已經(jīng)能夠?qū)D片的內(nèi)容進(jìn)行比較好的描述了,那么我們只需要簡(jiǎn)單利用風(fēng)控的小樣本數(shù)據(jù)遷移就能夠清楚地知道它是否涉及一些風(fēng)險(xiǎn)問(wèn)題。

下面,重點(diǎn)分享下場(chǎng)景化精調(diào)。

2、場(chǎng)景化精調(diào)

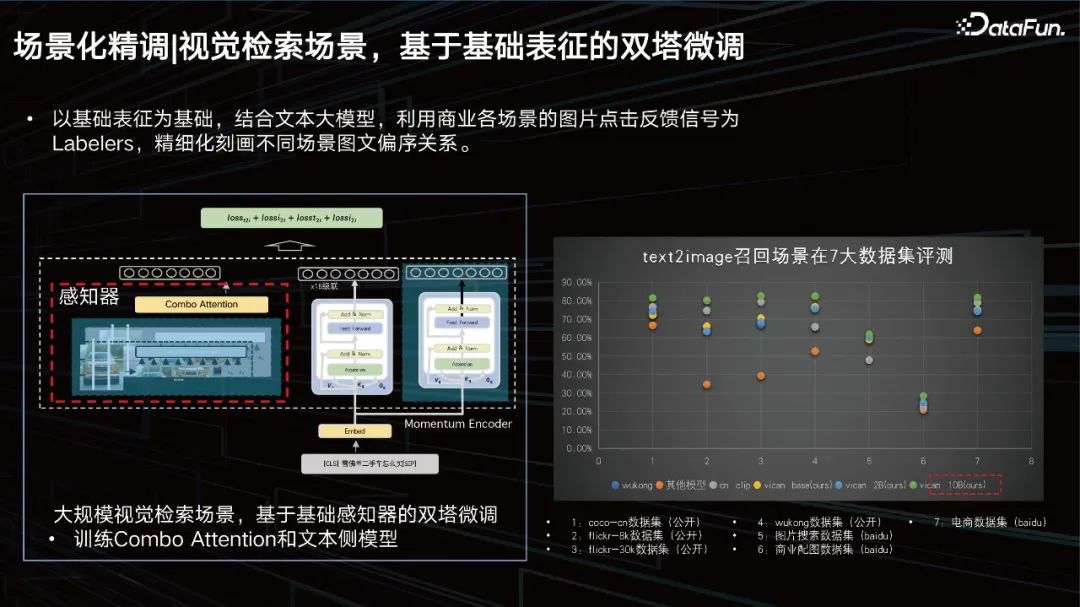

視覺檢索場(chǎng)景,基于基礎(chǔ)表征的雙塔微調(diào)。

以基礎(chǔ)表征為基礎(chǔ),結(jié)合文本大模型,利用商業(yè)各場(chǎng)景的圖片點(diǎn)擊反饋信號(hào)為L(zhǎng)abelers,精細(xì)化刻畫不同場(chǎng)景圖文偏序關(guān)系。我們?cè)?大數(shù)據(jù)集上進(jìn)行了評(píng)測(cè),均能達(dá)到SOTA的效果。

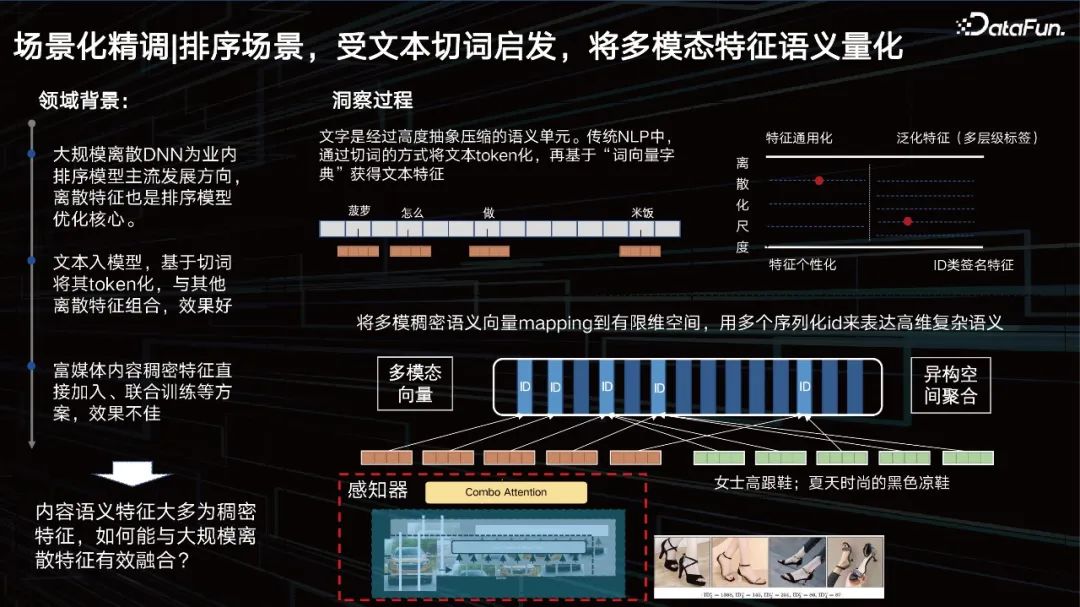

排序場(chǎng)景,受文本切詞啟發(fā),將多模態(tài)特征語(yǔ)義量化。

表征以外,另一個(gè)問(wèn)題是如何提升排序場(chǎng)景中視覺的效果。先來(lái)看一下領(lǐng)域背景,大規(guī)模離散DNN為業(yè)內(nèi)排序模型主流發(fā)展方向,離散特征也是排序模型優(yōu)化的核心。文本入模型,基于切詞將其token化,與其他離散特征組合,效果好。而對(duì)于視覺,我們希望也能將其進(jìn)行token化。

ID類特征其實(shí)是一個(gè)極具個(gè)性化的特征,但是泛化特征通用性好了,其刻畫精度可能就變差了。我們需要通過(guò)數(shù)據(jù)和任務(wù)去動(dòng)態(tài)調(diào)節(jié)這個(gè)平衡點(diǎn)在哪。也就是希望找到一個(gè)和數(shù)據(jù)最相關(guān)的尺度,去把特征進(jìn)行相應(yīng)的”切詞”變成一個(gè)ID,像文本一樣去切分多模態(tài)特征。所以我們提出了一個(gè)多尺度、多層級(jí)的內(nèi)容量化學(xué)習(xí)方法,去解決這一問(wèn)題。

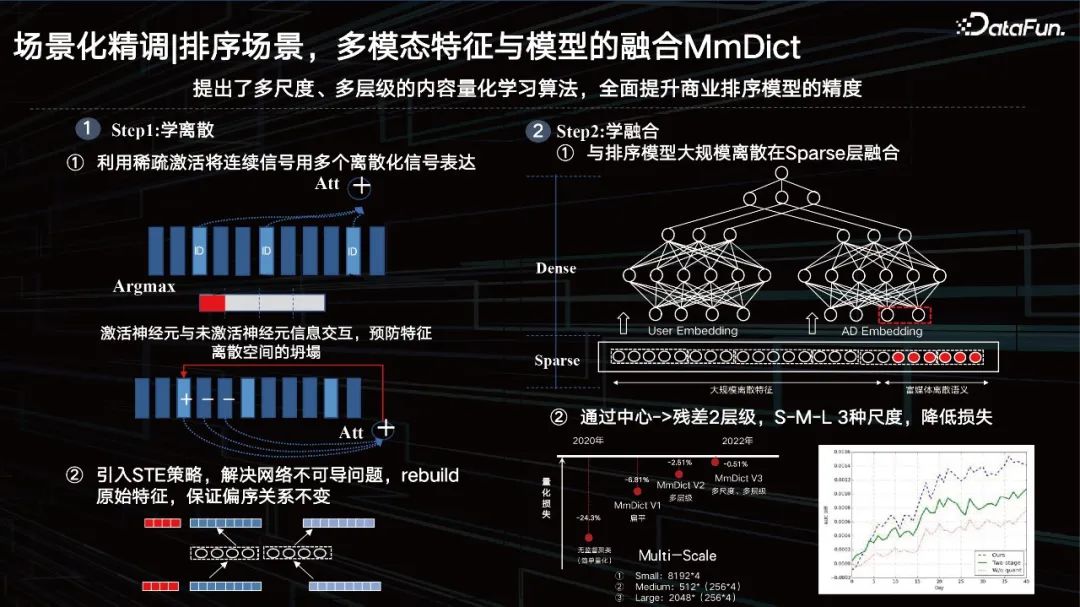

排序場(chǎng)景,多模態(tài)特征與模型的融合 MmDict。

主要分兩步,第一步是學(xué)離散,第二步是學(xué)融合。

Step1:學(xué)離散

① 利用稀疏激活將連續(xù)信號(hào)用多個(gè)離散化信號(hào)表達(dá);也就是通過(guò)稀疏激活的方式把稠密特征進(jìn)行切分,然后去激活對(duì)應(yīng)多模態(tài)codebook里面的ID,但這里面其實(shí)只有argmax操作,會(huì)引來(lái)不可導(dǎo)的問(wèn)題,同時(shí)為了去防止特征空間的坍塌,加入了激活神經(jīng)元與未激活神經(jīng)元信息交互。

② 引入 STE 策略,解決網(wǎng)絡(luò)不可導(dǎo)問(wèn)題, rebuild原始特征,保證偏序關(guān)系不變。

通過(guò)encoder-decoder的方式,把稠密特征進(jìn)行序列量化,再通過(guò)正確的方式把量化出來(lái)的特征進(jìn)行還原。還原前后要保證它的偏序關(guān)系不變,幾乎可以控制特征在具體任務(wù)上的量化損失小于1%,這樣的ID具備了當(dāng)下數(shù)據(jù)分布個(gè)性化的同時(shí),還具有泛化特性。

Step2:學(xué)融合

① 與排序模型大規(guī)模離散在 Sparse層融合。

那么剛才提到的隱層復(fù)用直接放在上面去,其實(shí)效果一般。如果把它ID化,量化之后,到sparse特征層和其他類的特征進(jìn)行融合,有著比較好的效果。

② 通過(guò)中心 -> 殘差2層級(jí), S-M-L 3種尺度,降低損失。

當(dāng)然我們也采用了一些殘差,以及多尺度的方式。從2020年開始,我們把量化的損失逐步壓低,去年達(dá)到了一個(gè)點(diǎn)以下,這樣就可以在大模型抽出來(lái)特征之后,我們用這種可學(xué)習(xí)量化的方式對(duì)視覺內(nèi)容進(jìn)行刻畫,具備語(yǔ)義關(guān)聯(lián)ID的特征其實(shí)非常適配我們現(xiàn)在的商業(yè)系統(tǒng),包括推薦系統(tǒng)的ID的這樣一個(gè)探索的研究方式。

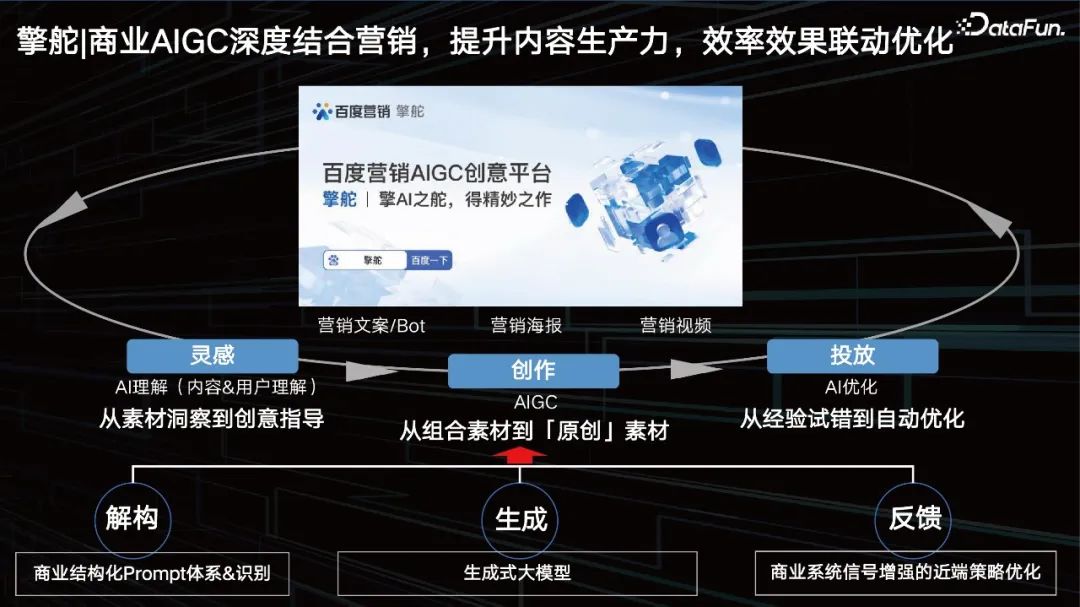

二、擎舵

1、商業(yè)AIGC 深度結(jié)合營(yíng)銷,提升內(nèi)容生產(chǎn)力,效率效果聯(lián)動(dòng)優(yōu)化

百度營(yíng)銷AIGC創(chuàng)意平臺(tái)從靈感到創(chuàng)作,再到投放形成了一個(gè)完美的閉環(huán)。從解構(gòu)、生成、反饋都在推進(jìn)優(yōu)化我們的AIGC。

- 靈感:AI理解(內(nèi)容&用戶理解)。AI能不能幫助我們?nèi)フ业绞裁礃拥腜rompt是好的。從素材洞察到創(chuàng)意指導(dǎo)。

- 創(chuàng)作:AIGC,如文本生成,圖片生成,還有數(shù)字人、視頻生成等等。

- 投放:AI優(yōu)化。從經(jīng)驗(yàn)試錯(cuò)到自動(dòng)優(yōu)化。

2、營(yíng)銷文案生成 = 商業(yè) Prompt 體系+ 文心大模型

一個(gè)好的商業(yè)Prompt,具備以下一些要素:

- 知識(shí)圖譜,比如說(shuō)賣車,車到底需要包含哪些商業(yè)元素,僅有品牌是不夠的,廣告主更希望有一個(gè)完整的知識(shí)體系;

- 風(fēng)格,例如現(xiàn)在『文藝范』的宣傳體,其實(shí)是需要把它抽象成一些標(biāo)簽,去幫助我們判斷主要是什么樣的營(yíng)銷標(biāo)題或營(yíng)銷的一些描述。

- 賣點(diǎn),賣點(diǎn)其實(shí)就是產(chǎn)品屬性的一個(gè)特征,即為最強(qiáng)有力的消費(fèi)理由。

- 用戶畫像,是根據(jù)目標(biāo)的行為觀點(diǎn)的差異區(qū)分為不同類型,迅速組織在一起,然后把新得出的類型提煉出來(lái),形成一個(gè)類型的用戶畫像。

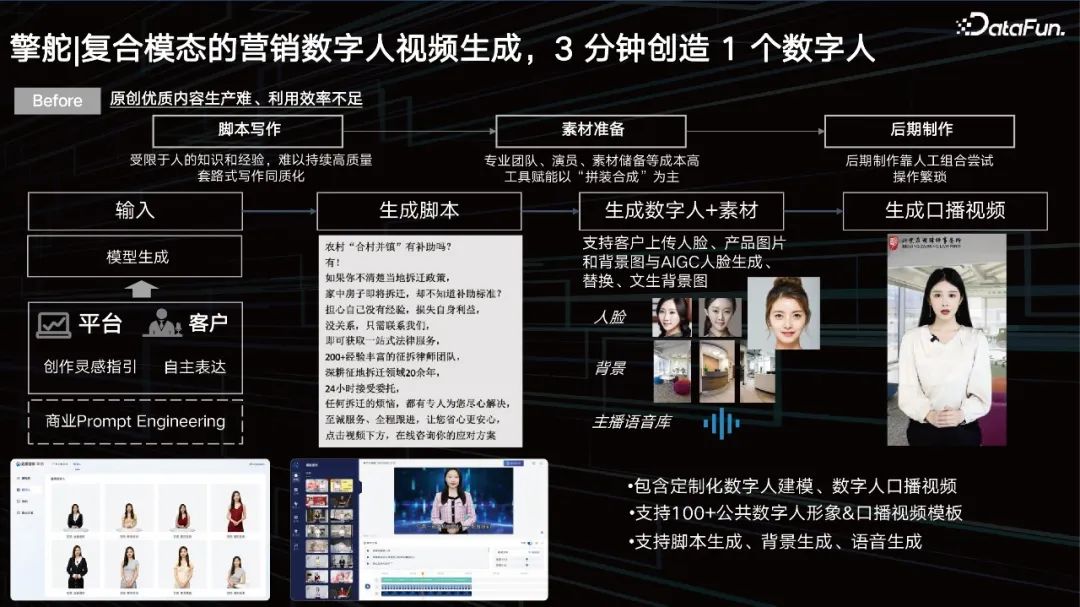

3、復(fù)合模態(tài)的營(yíng)銷數(shù)字人視頻生成, 3 分鐘創(chuàng)造 1 個(gè)數(shù)字人

視頻生成目前已經(jīng)比較成熟。但它其實(shí)依然存在著一些問(wèn)題:

- 腳本寫作:受限于人的知識(shí)和經(jīng)驗(yàn),難以持續(xù)高質(zhì)量寫作,同質(zhì)化嚴(yán)重。

- 素材準(zhǔn)備:專業(yè)團(tuán)隊(duì)、演員、素材儲(chǔ)備等成本高工具賦能,以“拼裝合成”為主。

- 后期制作:后期制作靠人工試錯(cuò),操作繁瑣。

前期通過(guò)prompt來(lái)輸入,想生成一個(gè)什么樣的視頻,希望選擇一個(gè)什么樣的人,讓他去說(shuō)什么,都通過(guò)prompt來(lái)輸入,然后我們根據(jù)其訴求,能夠準(zhǔn)確控制我們的大模型去生成相應(yīng)的腳本。

接下來(lái)我們可以通過(guò)我們的數(shù)字人庫(kù)去召回相應(yīng)的數(shù)字人,但是可能利用AI技術(shù)進(jìn)一步提升數(shù)字人的多樣性,比如人臉替換、背景替換、口音語(yǔ)音替換去適配我們的prompt,最后腳本、數(shù)字人唇形替換、背景替換、人臉替換,視頻壓制之后,就可以得到一個(gè)口播視頻。客戶得以利用數(shù)字人的方式去介紹產(chǎn)品對(duì)應(yīng)的一些營(yíng)銷賣點(diǎn)。這樣3分鐘即可做好一個(gè)數(shù)字人,極大地提升了廣告主做數(shù)字人的能力。

4、營(yíng)銷海報(bào)圖生成,結(jié)合多模態(tài)表征的營(yíng)銷圖片生成

大模型還可以幫助商業(yè)實(shí)現(xiàn)營(yíng)銷海報(bào)的生成和商品背景的替換。我們已有一個(gè)百億規(guī)模的多模態(tài)表征,中間這一層是我們學(xué)的一個(gè)擴(kuò)散,我們基于好的動(dòng)態(tài)表征去學(xué)unet。通過(guò)大數(shù)據(jù)的訓(xùn)練之后,客戶還希望有一些特別個(gè)性化的東西,所以我們還需要加入一些微調(diào)的方式。

我們提供了一個(gè)幫助客戶微調(diào)的方案,一個(gè)大模型動(dòng)態(tài)加載小參數(shù)的方案,這也是目前業(yè)界的一個(gè)通用的解決方案。

首先我們?yōu)榭蛻籼峁┮粋€(gè)生圖能力,客戶可以通過(guò)編輯或者Prompt去改變這個(gè)圖片背后的背景。