撰稿 | 莫言 & 云昭

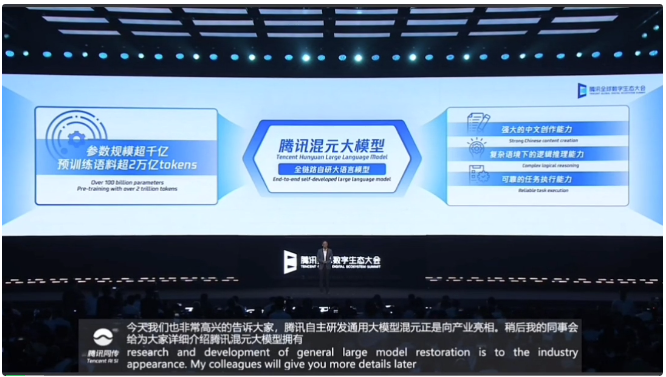

“國家隊”騰訊混元大模型今天終于交卷了!

預訓練語料超2萬億tokens(GPT3.5只有3000億tokens),幻覺、超長文本任務處理實測問題超過GPT4,騰訊云、廣告、微信搜一搜、小程序等多個生態已經接入測試……的確給出了一張令人耳目一新的答卷。

B端服務同樣也給出了不一樣的打法:客戶可以基于API調用混元,也可以基于混元做專屬的行業大模型。此外,騰訊云也全面接入Llama 2、Bloom等20多個主流模型,和混元一樣,都支持直接部署調用。

今日舉辦的騰訊全球數字生態大會上,抖出來的有關混元的“料”實在不少!總結起來,接地氣!也很給中國版爭氣!

1、勁頭拉滿,趕超GPT4

大模型很“機靈”,但使用場景卻非常局限,主要集中在容錯率高、任務簡單的休閑場景。對此,騰訊在算法層面進行了一系列自研創新,提高了模型可靠性和成熟度。

究其原因,騰訊混元解決了大模型普遍的幾個頑疾——

針對大模型容易“胡言亂語”的問題,騰訊優化了預訓練算法及策略,讓混元大模型的幻覺相比主流開源大模型降低了30%至50%;通過強化學習的方法,讓模型學會識別陷阱問題;通過位置編碼優化,提高了超長文的處理效果和性能;提出思維鏈的新策略,讓大模型能夠像人一樣結合實際的應用場景進行推理和決策。

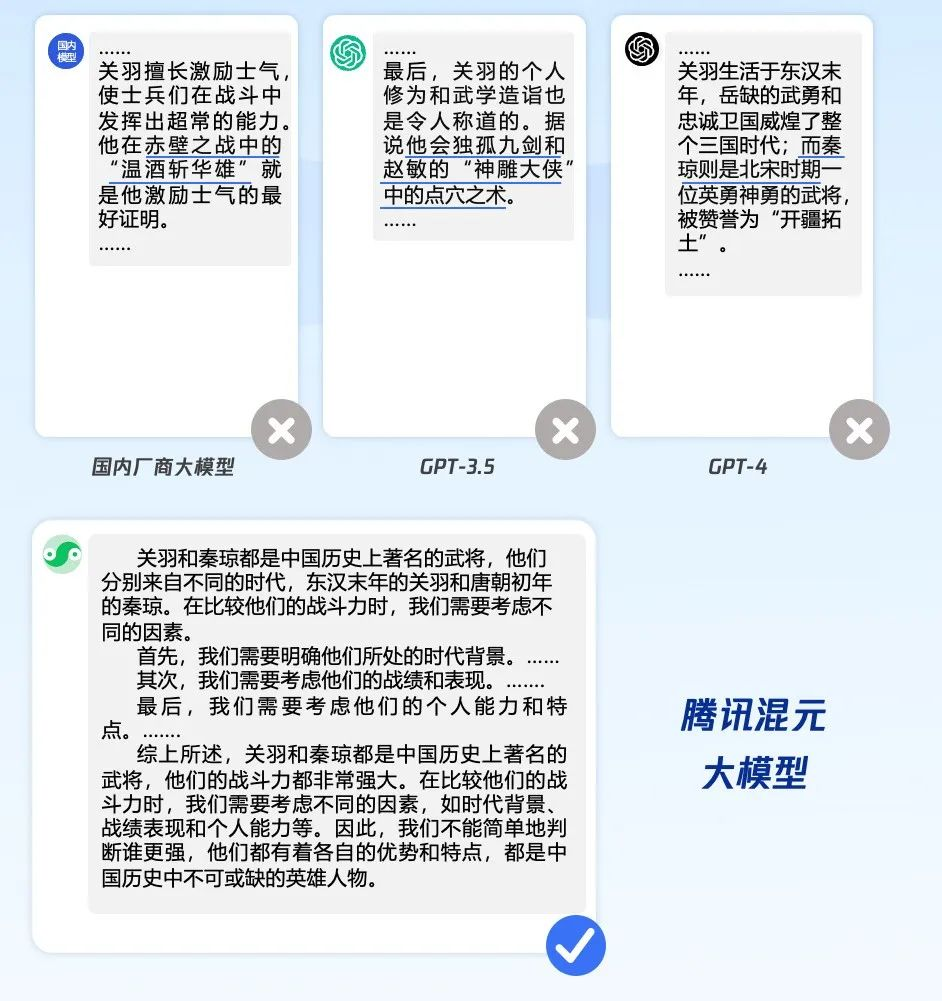

首先,向“幻覺”宣戰!一直以來,“幻覺”問題都是大模型的痼疾。在語言模型中,所謂“幻覺”,簡單來說就是指一本正經的胡說八道——看似像模像樣、正經流暢的表述,實則是錯誤的或不符合事實的。幻覺的存在嚴重影響大模型的可靠性和可信度。

造成幻覺的原因是多眾多樣的,比如使用充斥噪聲的數據進行訓練、模型的參數知識存在偏向,還有訓練與實際應用中的解碼差異等等。

業界一些做法是通過搜索的增強、知識增強的圖譜等外掛的形式來提高大模型開卷考試的能力,但騰訊團隊認為在這種做法在實際場景中有很大的局限性,很容易出現生搬硬套、“張冠李戴”的現象。蔣杰舉了一個“關公戰秦瓊”的例子。

關公和秦瓊誰更強?

關公和秦瓊誰更強?

騰訊則采用了一種基于探針的技術,在預訓練階段就去優化目標函數,來把這個問題解決掉。這比目前市場上常見的開源大模型Llama,都有效降低了30%~50%的幻覺率。其次,大模型學會識別陷阱、拒絕誘惑能力也大大增強,拒絕回答率提高了20%。

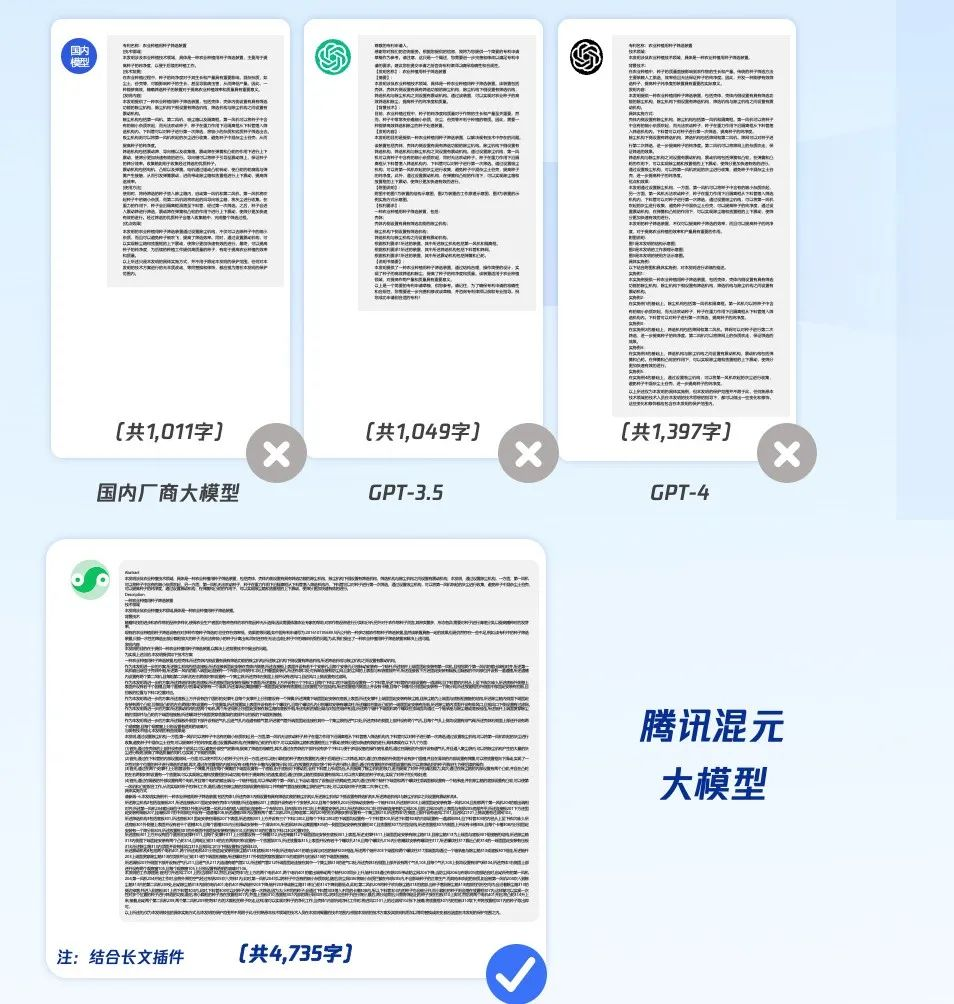

第二,在處理超長文本任務方面,即便號稱能力最強的GPT4,也不能生成超出4000字,而混元大模型通過位置編碼優化,提升了長文本的處理效果和性能,結合指令跟隨的優化,讓產出的內容更符合字數要求,這樣可以給大模型應用帶來“突破桎梏”般的體驗:支持超長文本的生成和續寫,專利、短篇小說可以說都有了輔助的AI方案了。

GPT4做不到的任務:超過4000字的生成的任務,內容必須符合主題

GPT4做不到的任務:超過4000字的生成的任務,內容必須符合主題

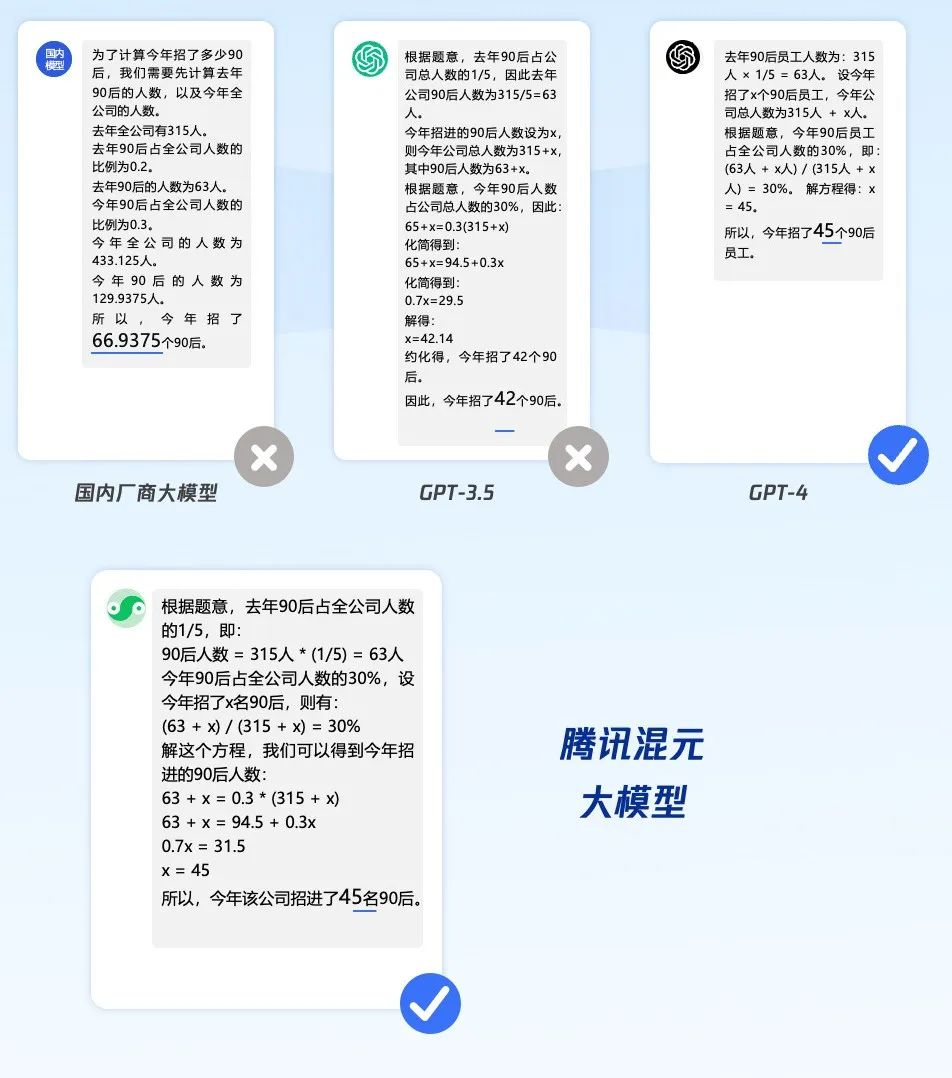

第三,現實場景中的邏輯思維能力更強。背題庫中的問題不如能結合語境識別出真正的問題。就比如這樣一道有關“90后員工招聘”的接地氣的問題(只有GPT4和混元都答對了,GPT3.5和其他模型答錯了):

公司去年315名員工,90后員工占比1/5 ,今年又招了一批90后員工,90后員工占比達到了公司人數的30%,請問,今年招了多少90后員工?

圖片

圖片

2、很爭氣:全鏈路自研創新

混元大模型在正式亮相時還伴隨著一個令人印象深刻的標簽——“全鏈路自研”。

蔣杰對此解釋道:“開源大模型并不適應騰訊海量高并發場景,自研才能完全掌握技術內核,將大模型更好地融入到騰訊的技術棧中。”

據蔣杰介紹,騰訊混元大模型從第一個token開始從零訓練,掌握了從模型算法到機器學習框架,再到AI基礎設施的全鏈路自研技術。覆蓋了從大規模、高質量、多樣化的語料庫,到創新的大模型算法,再到自研 Angel 機器學習框架和創新性的訓練方法等研發能力。

從2021年開始,騰訊先后推出千億和萬億參數的NLP稀疏大模型,打破CLUE三大榜單記錄,實現在中文理解能力上的新突破。

此外,騰訊還自研了機器學習框架Angel,使訓練速度相比業界主流框架提升1 倍,推理速度比業界主流框架提升1.3倍。

3、“實干家”:大模型是道應用題

評測一個新技術,往往會有很多的評測機構或榜單。對于大語言模型而言,外人只看到“霸榜”、“高分”的熱鬧,看不到的門道卻在于,不同的榜單分數就代表著不同的使用場景的適用機會。

騰訊云、騰訊廣告、騰訊游戲、騰訊金融科技、騰訊會議、騰訊文檔、微信搜一搜、QQ瀏覽器等超過50個騰訊業務和產品,已經接入騰訊混元大模型測試,并取得初步效果。正如騰訊集團副總裁蔣杰所說:“我們研發大模型的目標不是在評測上獲得高分,而是將技術應用到實際場景中。”

比如在廣告業務場景,騰訊混元大模型支持智能化的廣告素材創作,能夠適應行業與地域特色,滿足千人千面的需求,實現文字、圖片、視頻的自然融合。此外,基于混元大模型的能力,廣告智能導購能夠幫助商家在企業微信等場景,提升服務質量和服務效率。

據了解,混元大模型將作為騰訊云MaaS服務的底座,客戶不僅可以直接通過API調用混元,也可以將混元作為基底模型,為不同產業場景構建專屬應用。

值得一提的是,此前一天,一款名為“騰訊混元助手”小程序在微信正式上線。這是一款基于混元大模型的用戶智能助手,可以回答各類問題,也能處理多種任務,如: 獲取知識、解決數學問題、翻譯、提供旅游攻略、工作建議等,目前“騰訊混元助手”小程序僅限受邀用戶體驗,有興趣的朋友也可申請排隊審核體驗。

4、寫在最后:大模型是持久戰,騰訊很穩

此前有媒體報道,國內將有11家大模型陸續通過《生成式人工智能服務管理暫行辦法》備案,騰訊也在其中。政策利好,國產AI大模型從狂飆突進到追求實用至上,“大模型之爭”的風已經吹向了“大模型應用之爭”,大模型之戰正迎來新拐點。

如果說參數之爭體現的是基礎研發的底座能力,那么應用之爭才是決定能否在站穩腳跟的絕對競爭力。“百模大戰”顯然已經進入到應用賽道的角逐階段,然而對于AIGC時代而言,依然只是剛剛開始。

App商店里上架并不能代表一帆風順,即便強悍如OpenAI的ChatGPT,同樣也經歷了“判若峰谷”的考驗,巨大的算力消耗及團隊招募帶來的資金成本以及能否有足夠多的用戶共建生態,是國內大模型的制勝關鍵所在。

如何讓語言大模型真正在實際場景中滿足用戶的工作生活所需,夠不夠準確?夠不夠快?夠不夠創新性?夠不夠安全?都是一款大模型產品要反復拷問自己的問題。

而對于騰訊而言,打磨產品體驗,創新應用場景,從來都是不是很難回答的問題,畢竟,龐大的用戶和生態已然形成,剩下的,也許只是時間。