強化學習之父入局AGI創業!聯手傳奇程序員卡馬克,放話不依賴大模型

傳奇程序員卡馬克 (John Carmack),與強化學習之父薩頓 (Richard Sutton)強強聯手了,All in AGI。

2030年向公眾展示通用人工智能的目標是可行的。

并且與主流方法不同,不依賴大模型范式,更追求實時的在線學習。

兩人在薩頓任教的阿爾伯塔大學機器智能研究所(Amii)特別活動上宣布了這一消息。

薩頓會加入卡馬克的AI創業公司Keen Technologies,同時保持在阿爾伯塔的教職。

兩人在活動中都承認,與擁有成百上千員工的大公司相比,Keen Technologies的團隊規模很小。

目前還在剛起步階段,公司整個技術團隊都到了現場——

只有站著的這4個人。

其融資規模2000萬美元,與OpenAI、Anthropic這樣動輒幾十億的也沒法比。

但他們相信,最終AGI的源代碼是一個人就能編寫的量級,可能只有幾萬行。

而且當前AI領域正處在杠桿效應最大的特殊時刻,小團隊也有機會做出大貢獻。

傳奇程序員與強化學習之父

卡馬克的傳奇經歷,從開發世界第一款3D游戲,到轉型造火箭,再到加入Oculus成為后來Meta VR關鍵人物的故事都已被人熟知。

后來他與AI結緣,還和OpenAI有關。

他曾在另一場訪談中透露,Sam Altman曾邀他加入OpenAI,認為他能在系統優化方面發揮重要作用。

但卡馬克當時認為自己對機器學習范式的現代AI沒有任何了解,也就沒有答應。

這卻成了他開始了解AI的一個契機。

他向OpenAI的首席科學家Ilya Sutskever要了一個入門必讀清單,從頭開始自學,先對傳統機器學習算法有了基本的了解。

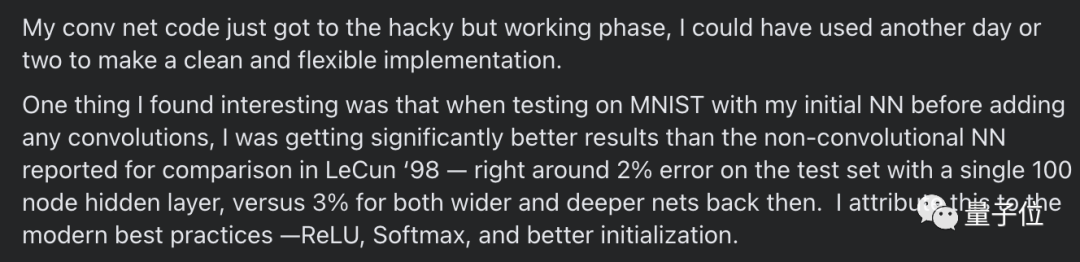

等有了空閑,打算繼續涉足深度學習的時候,他來了個一周編程挑戰:

打印幾篇LeCun的經典論文,在斷網情況下動手實踐,從推反向傳播公式開始。

一周過去后,他帶著用C++手搓的卷積神經網絡結束閉關,沒有借助Python上的現代深度學習框架。

只能說佩服大神了。

此時他的主業還是在Facebook(后改名Meta)旗下Oculus研究VR,帶領團隊推出了Ouclus Go和Quest等產品。

不過這個過程中,他與公司管理層之間也逐漸產生矛盾和分歧,認為公司內部效率低下,也曾公開發表不滿。

2019年,他辭去Oculus CTO職位轉而擔任“顧問CTO”,開始把更多精力轉向AI。

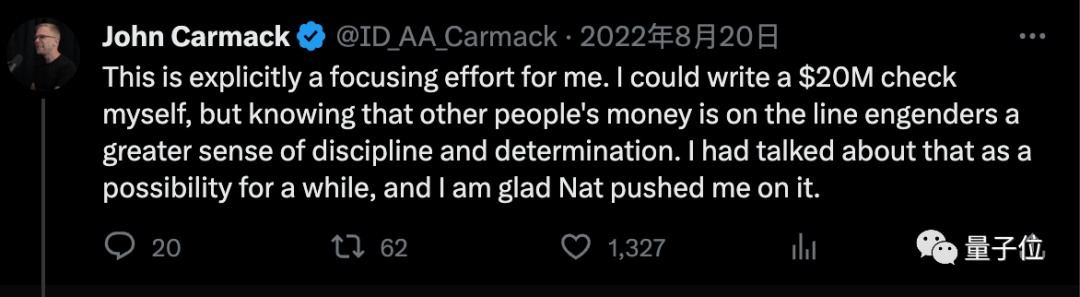

2022年8月,他宣布新AI創業公司Keen Technologies宣布融資2000萬美元,投資者包括紅杉資本,GitHub前CEO Nat Friedman等。

后續他也透露,其實區區2000萬美元,自己就拿得出手。

但是從別人那里拿錢能給他一種危機和緊迫感,有更強烈的決心把事情做好。

2022年底,他正式離開Meta,并將VR視為已經過去的一個人生階段,接下來完全轉向AI。

除了這條明面上的主線之外,卡馬克與AI還有一些莫名的緣分。

當年他的3D游戲激發了對圖形計算的需求,GPU也是從游戲領域開始發展壯大。

到如今正是GPU的算力支持了AI的爆發,他談到這些時仍為自己的貢獻感到自豪。

……

今天的另一位主角薩頓也同樣是位傳奇人物。

他被譽為強化學習之父,為強化時間差異學習和策略梯度等方法做出重要貢獻,也是強化學習標準教科書的合著者。

2017年他以杰出科學家身份加入DeepMind,參與了AlphaGo系列研究,他的學生David Silver則是AlphaGo主要負責人之一。

薩頓寫過一篇著名短文The Bitter Lesson,認為試圖把人類經驗教給AI是行不通的,至今為止所有突破都是依靠算力提升,繼續利用算力的規模效應才是正確道路。

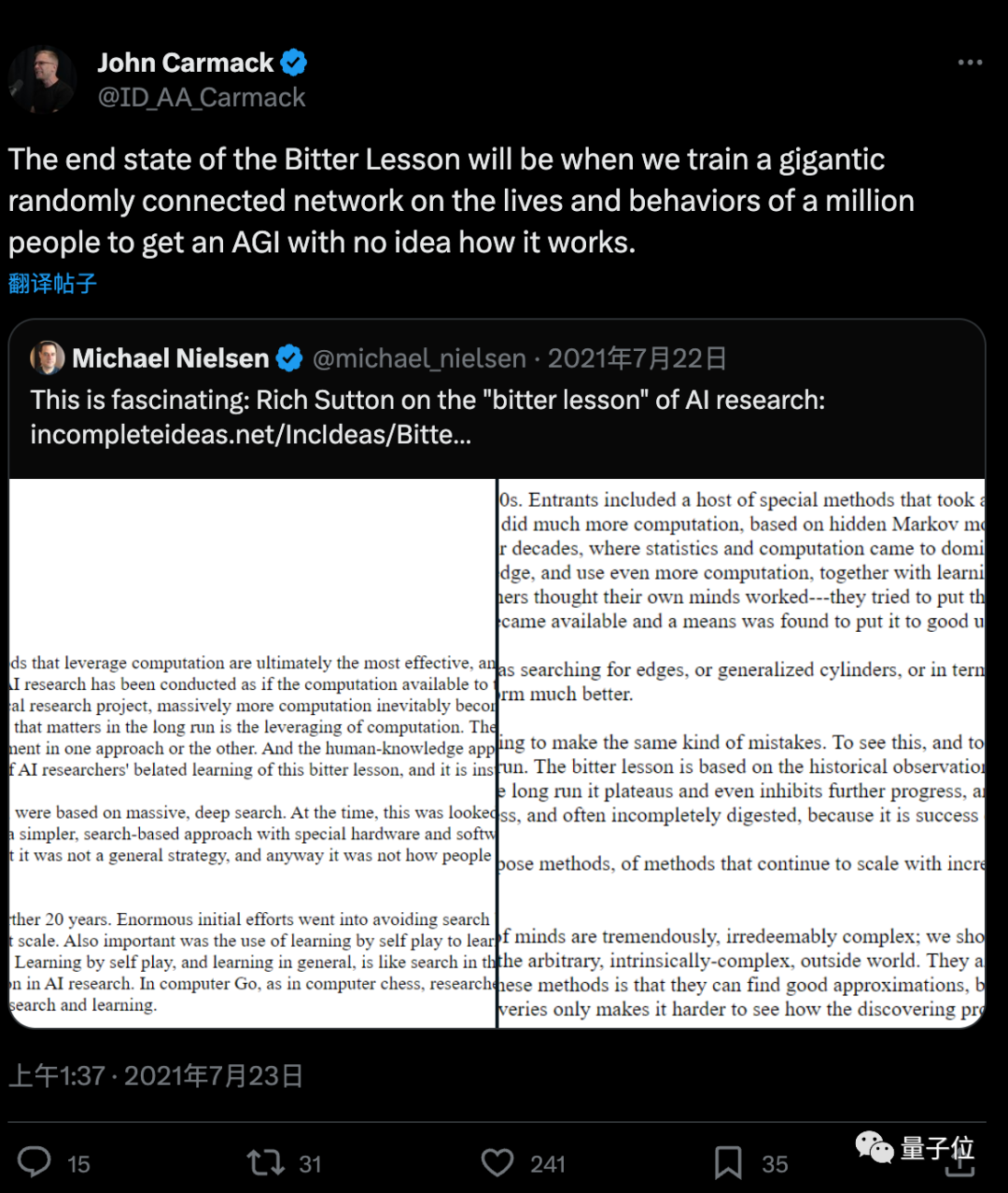

兩人正式交流之前,卡馬克就曾表達過對這篇文章的關注和認同。

但兩人真正直接交流,是薩頓主動聯系的。

幾個月前,卡馬克宣布AGI創業公司融資之后,收到了薩頓的郵件。

薩頓想要問他他在研究的道路上應該走純學術、商業化還是非盈利組織路線的問題。

但在后續郵件交流中,兩人發現在AI研究方向和理念上存在驚人的一致性,漸漸確立了合作關系。

具體來說,兩人達成了4個共識:

- 都認為當前AGI發展被限制在很窄的幾個方向上,過多依賴大數據和大算力而忽視了創新

- 都認為太早商業化會阻礙AGI的發展

- 都認為最終AGI不會太復雜,一個人就能掌握全部原理,甚至一個人就能寫出主要的代碼。

- 都認為2030年出現AGI原型是一個可行的目標。

不只依賴大模型,小團隊也有機會

很大膽的目標,現場觀眾也是這么認為的。

面對“小團隊如何搞定這么宏大的目標”的提問,卡馬克認為實現AGI所需的數據量和算力需求可能沒有想象中那么大。

把人類一整年眼中所見拍成每秒30幀的視頻,可以裝在拇指大小的U盤里。

而1歲兒童只擁有這么多經驗數據,已經展現出明顯的智能。

如果算法對了,就不需要用整個互聯網的數據讓AGI去學習。

對于算力需求,他也是用這種直覺式的思維去考慮:人腦的計算能力也有限,遠遠達不到一個大型算力集群的程度。

比一個服務器節點(node)要大,也比一個機柜(rack)要大,但最大也就再高出一個數量級。

而且隨著時間推移,算法會更加高效,所需的算力還會持續下降。

如果說卡馬克在3D游戲、火箭和VR,這些看似不搭邊的工作領域上有什么共同點,那就是對大型實時反饋系統的優化。

這也是當初Sam Altman邀請他加入OpenAI時看中的地方。

他設想中的AGI架構應該是模塊化和分布式的,而不是一個巨大的集中模型。

學習也應該是持續的在線學習,而不是現在的預訓練之后大部分參數就不再更新。

我的底線是,如果一個系統不能以30hz的頻率運行,也就是訓練時33毫秒左右更新一次,我就不會用它。

他進一步表示,作為能自己寫原始Cuda代碼和能自己管理網絡通信的底層系統程序員,可能會去做一些其他人根本不會考慮的工作。

甚至不僅局限于現有的深度學習框架,會嘗試更高效的網絡架構和計算方法。

總體目標是模擬一個具有內在動機和持續學習能力的虛擬智能體,在虛擬環境中持續學習。

不要機器人,因為制造火箭的經歷讓他認為打交道的物理對象越少越好。

與卡馬克剛涉足AGI不久相比,薩頓在這個問題上已經花費了幾十年,他有更具體的研究計劃。

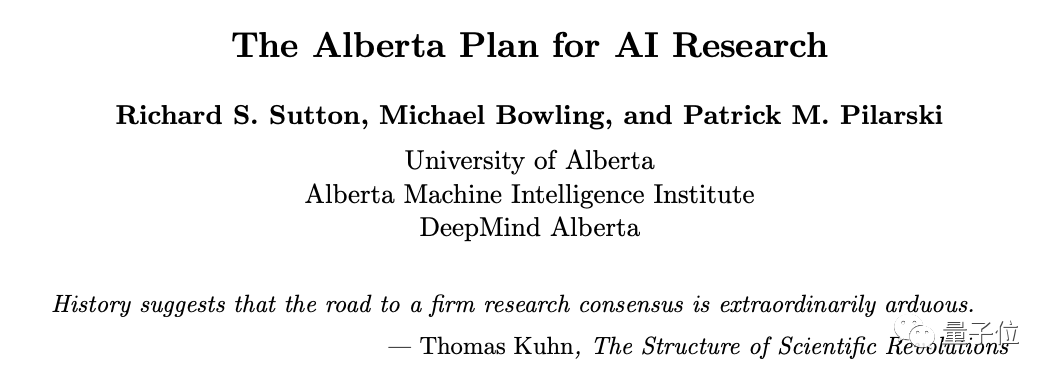

雖然這次活動上沒有說太多,但主體部分已經以“阿爾伯塔計劃”的形式寫在一篇arXiv論文里。

阿爾伯塔計劃提出了一個統一的智能體框架,強調普遍經驗而不是特殊的訓練集,關注時間一致性,優先考慮能隨算力產生規模效應的方法,以及多智能體交互。

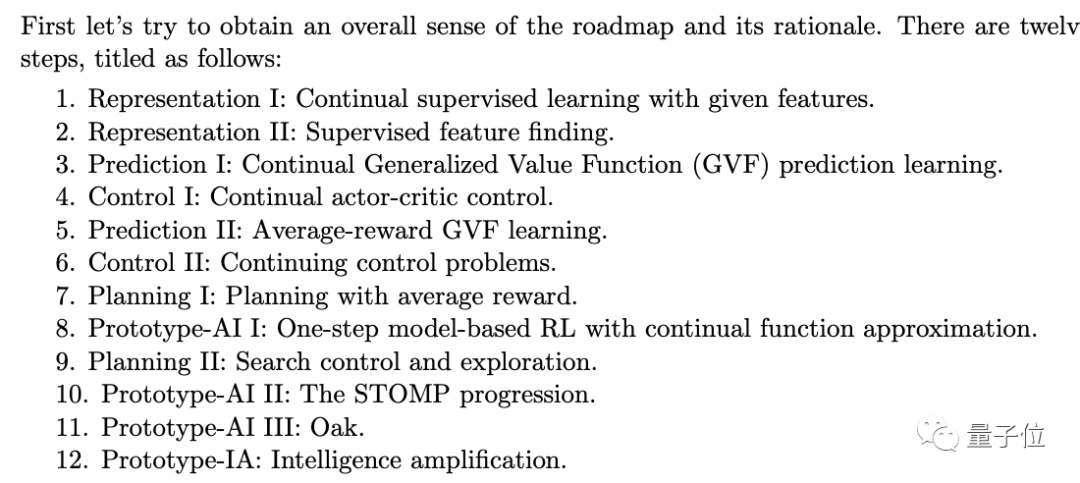

還提出了一個分為12步的路線圖。

前6步專注于設計model-free的持續學習方法,后6步引入環境模型和規劃。

其中最后一步稱為智能增強 (Intelligence Amplification),一個智能體可以根據一些通用原則,利用它所學到的知識來放大和增強另一個智能體的行動、感知和認知。

薩頓認為這種增強是充分發揮人工智能潛力的重要組成部分。

在這個過程中,確定評估AI進步的指標非常重要但也十分困難,團隊正在探索不同的發展。

另外,卡馬克一直是開源的倡導者,但在AGI的問題上他表示會保持一定開放性,但不會全部公開算法細節。

作為一個小團隊,卡馬克認為需要保持開拓精神,關注長遠發展而不是短期利益,

不會過早考慮商業化,沒有像ChatGPT這樣可以公開發布的中間形態。

對于2030年能做到什么地步,卡馬克認為“有可以向公眾展示的AGI”,薩頓的表述是“AI原型可以顯示出生命跡象(signs of life)”。

2030成關鍵節點

2030與AGI,并不是第一次同時出現。

頂尖AI團隊不約而同都把2030年前后作為實現AGI的關鍵節點。

比如OpenAI,在拿出20%總算力成立超級智能對齊部門的公告里寫著,我們相信超級智能在這個十年段到來。

甚至投資界也出現類似的觀點,孫正義剛剛在軟銀世界企業大會上也拿出來這樣一張PPT。

除了OpenAI和Keen Technologies,致力于開發AGI的組織并不多。

OpenAI最大的競爭對手,剛剛拿40億美元融資的Anthropic,其CEO Dario Amodei在最近一次訪談中提到,兩三年內AI能表現得像一個受過良好教育的人類。

Transformer作者Vaswani與Palmer離開谷歌時,創辦了AdeptAI,目標也是打造通用智能。

不過目前兩人今年初突然離開這家公司,聯合創始人中只留下一位David Luan(最右)。

兩位Transformer作者另外創辦了一家Essential AI,這家公司的愿景就沒那么“仰望星空”了,是比較務實的大模型商業化。

國內方面明確喊出AGI目標的同樣也不多,主要有MiniMax和楊植麟新創辦的月之暗面。