AI Agent,啟動!復旦NLP團隊發86頁長文綜述,智能體社會近在眼前

9月19日,Jim Fan轉發了一篇來自復旦NLP團隊對基于LLM的Agent的綜述。

Agent是能夠感知自身所處環境、自我決策并采取行動的人工智能實體。

該論文介紹了基于LLM Agent的一般概念框架,包括大腦、感知和行動;以及LLM Agent的應用場景、由LLM Agent組成的社會等。

還討論了LLM Agent領域中的一系列關鍵議題和開放性問題。

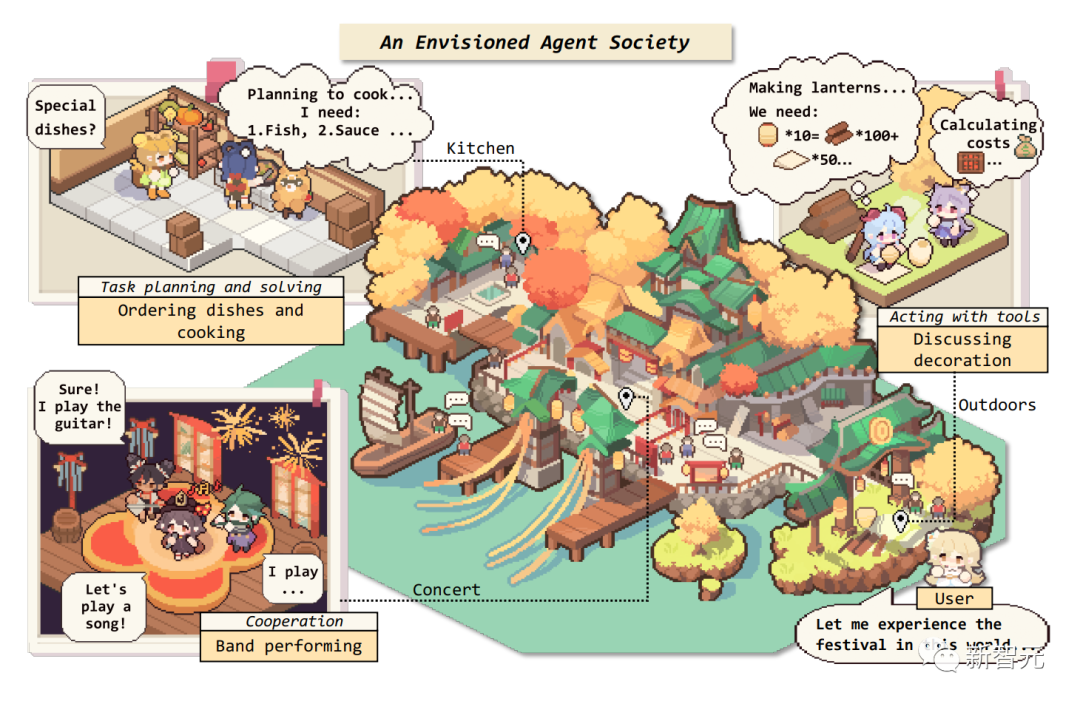

有趣的是,在arXiv上提交的前兩版論文中,注明了與米哈游合著,論文中則以原神中的海燈節為例,介紹了一個理想中的由AI Agent組成的社會。

論文地址:https://arxiv.org/pdf/2309.07864

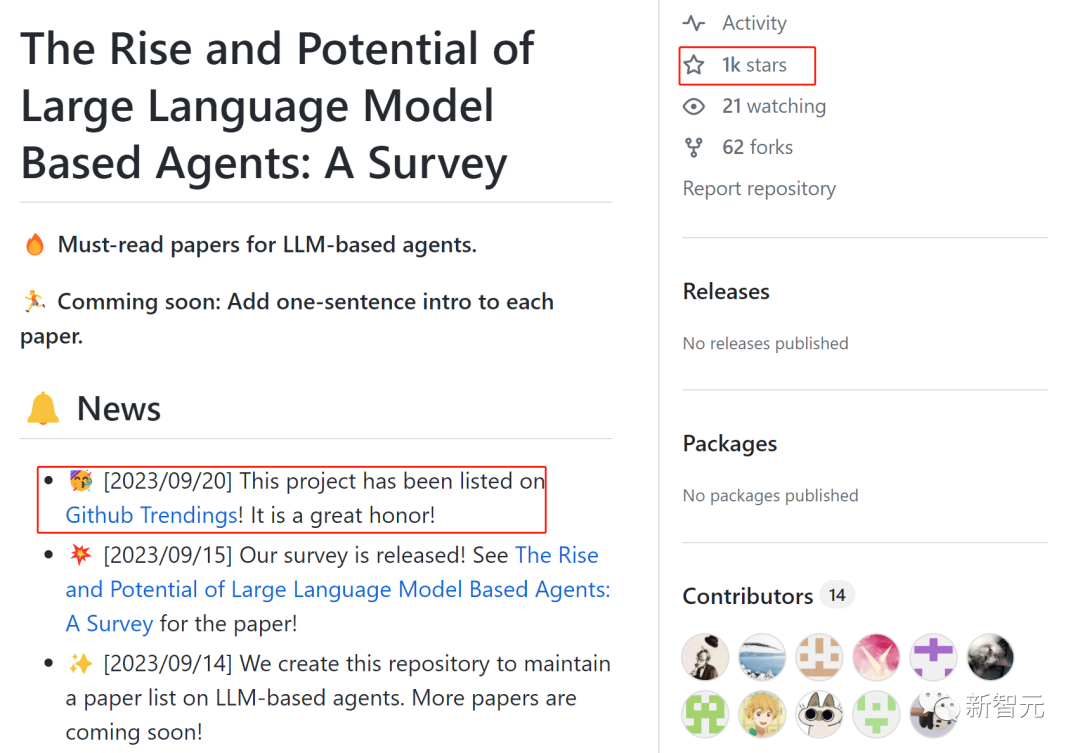

這篇論文從9月15號發布到GitHub上后,短短五天就收獲了1K star,并被評為LLM Agent的必讀論文。

在20號時,更是登上了GitHub的趨勢榜。

項目地址:https://github.com/WooooDyy/LLM-Agent-Paper-List

對什么是「智能」的討論,從圖靈時代就開始了。

1950年,阿蘭·圖靈發表了一篇名為《計算機器與智能(Computing Machinery and intelligence)》的論文。

在論文的開篇,他提出一個問題:「機器能思考嗎?」

答案毋庸置疑,并且圖靈將智能這一概念擴展到了人工實體中,并提出了著名的「圖靈測試」。

隨后的幾十年,人們朝著讓機器獲得與人類智能相當或超越的AGI(通用人工智能)目標不斷前進。

現在,性能最強大的人工智能GPT-4被稱為是最接近AGI的人工智能。

但現今主流的人工智能都是基于NLP(自然語言處理)技術的LLM(大語言模型),往往只能應用于特定的領域,對其他領域一竅不通,還常常產生「幻覺」。

圖靈獎得主Yann LeCun多次公開批評現有的人工智能只是一群訓練有素的「隨機鸚鵡」(stochastic parrots),稱不上真正的智能。

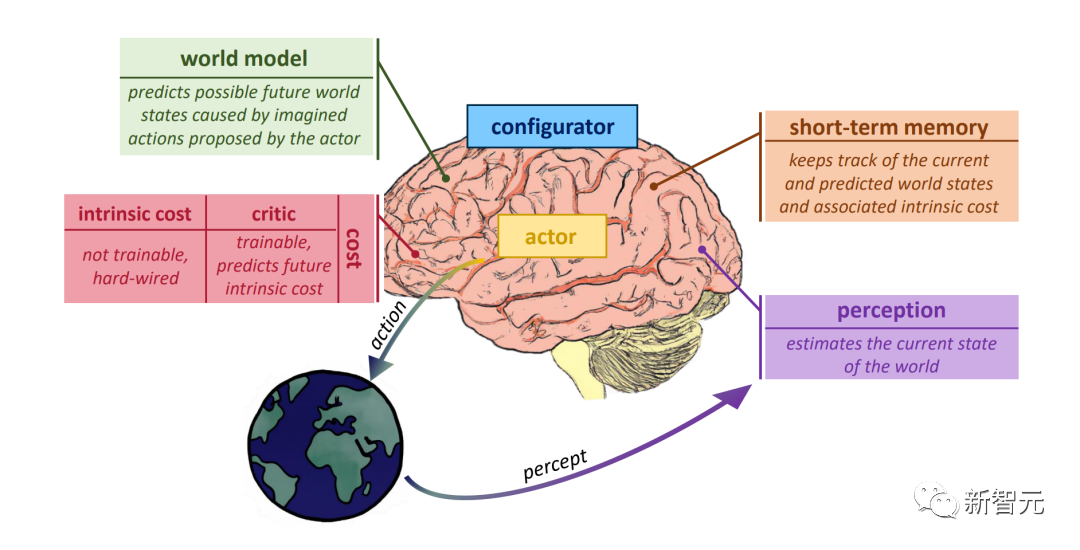

他認為真正通往AGI的將是「世界模型」,能夠自主感知環境、進行計劃、做出行動。

如果說通往AGI的終點是「世界模型」,那么現在最接近終點的是能夠自主行動的Agent。

LLM Agent發展史

從NLP走向AGI要經過幾個階段?

答案是五個,即語料庫、互聯網、感知、具身和社會屬性。目前,大語言模型正處于第二階段,具有互聯網規模的文本輸入和輸出。

如果想要更進一步,就要為LLM賦予感知能力和行動能力。

接下來,如果這些具有感知和行動力的自主LLM Agent之間能夠進行互動、通過協作解決更復雜的問題,或反應現實世界中的社會行為,它們就擁有了社會屬性。

人類也可以參與AI Agent組成的社會。

以原神海燈節為例,上圖中香菱和瑤瑤在廚房里籌備飯菜、胡桃和辛焱開演唱會進行表演,甘雨和刻晴在商量做燈籠的事宜。

玩家(主控)可以任選一個場景與AI Agent進行互動。

因此,AI Agent被認為是實現AGI的最有潛力的選項。

但,什么是Agent?

Agent的中文含義是「代理」,這個概念起源于哲學,最早可以追溯到亞里士多德和休謨。

「代理」描述了一種擁有欲望、信念、意圖和采取行動能力的實體。將這個概念遷移到計算機科學中,即意指計算機能夠理解用戶的意愿并能自主地代表用戶執行任務。

隨著AI的發展,Agent在AI研究中找到了自己的位置,用來描述表現出智能行為并具有自主性、反應性、主動性和社交能力的實體。

當人們能用概念來描述一個對象時,更加的深入的研究就開始了。

Agent有了自己的定義和內涵后,「智能體」的研究成為了AI社區的焦點。

基于LLM的Agent

對Agent的深入研究從20世紀中期開始,人們的努力取得了一定的成就,但Agent的應用場景極為受限,只能實現特定的任務。

而人們想要的AGI是通用的、能適用于廣泛的場景中的,而不是一個專精的工具。

也許專精的工具也能發揮出相當大的威力,但工具無法自主地適應世界,只能被使用。

而模型想要擁有自主性,像生物那樣適應各種復雜的環境,通用能力是必要的關鍵。

這包含知識記憶、長期規劃、有效泛化和高效交互等能力。

隨著各類人工智能的發展,大語言模型(LLM)脫穎而出,成為了具備一般通用能力的種子選手。

純粹的LLM處于AGI之路的第二階段,即具有互聯網規模的文本輸入和輸出。

但LLM在知識獲取、指令理解、泛化、規劃和推理方面都表現出了強大的能力,并且它還能于人類進行有效的自然語言交互。

這是相當重要的優勢,LLM因此被選為Agent系統的起點。在人類為其賦予更廣闊的感知空間和行動空間后,LLM就可能到達更高的層次。

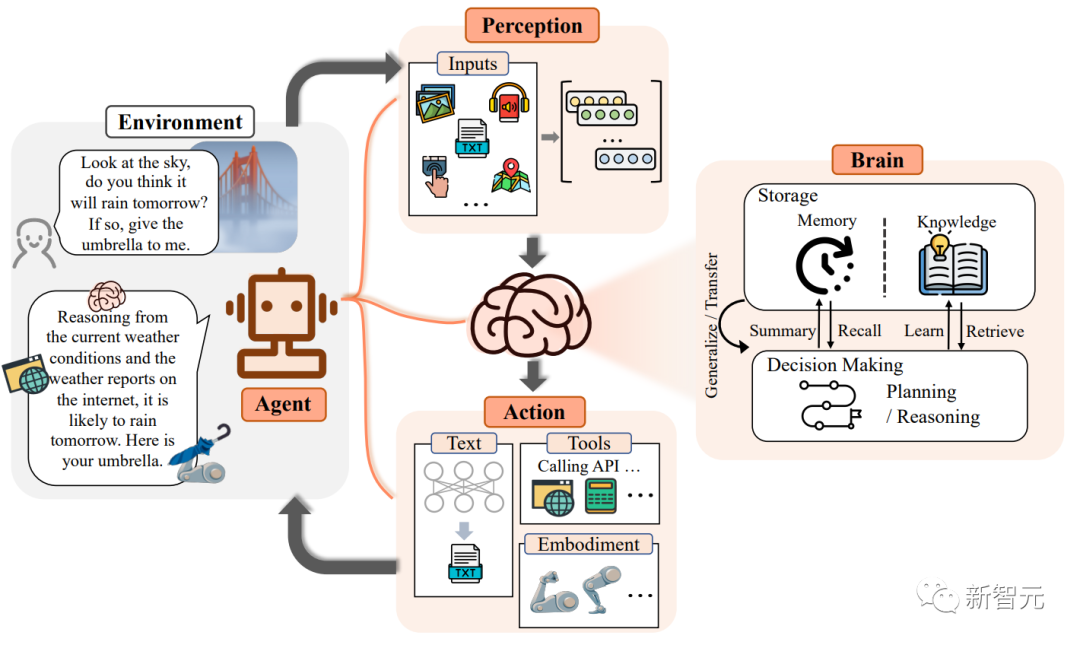

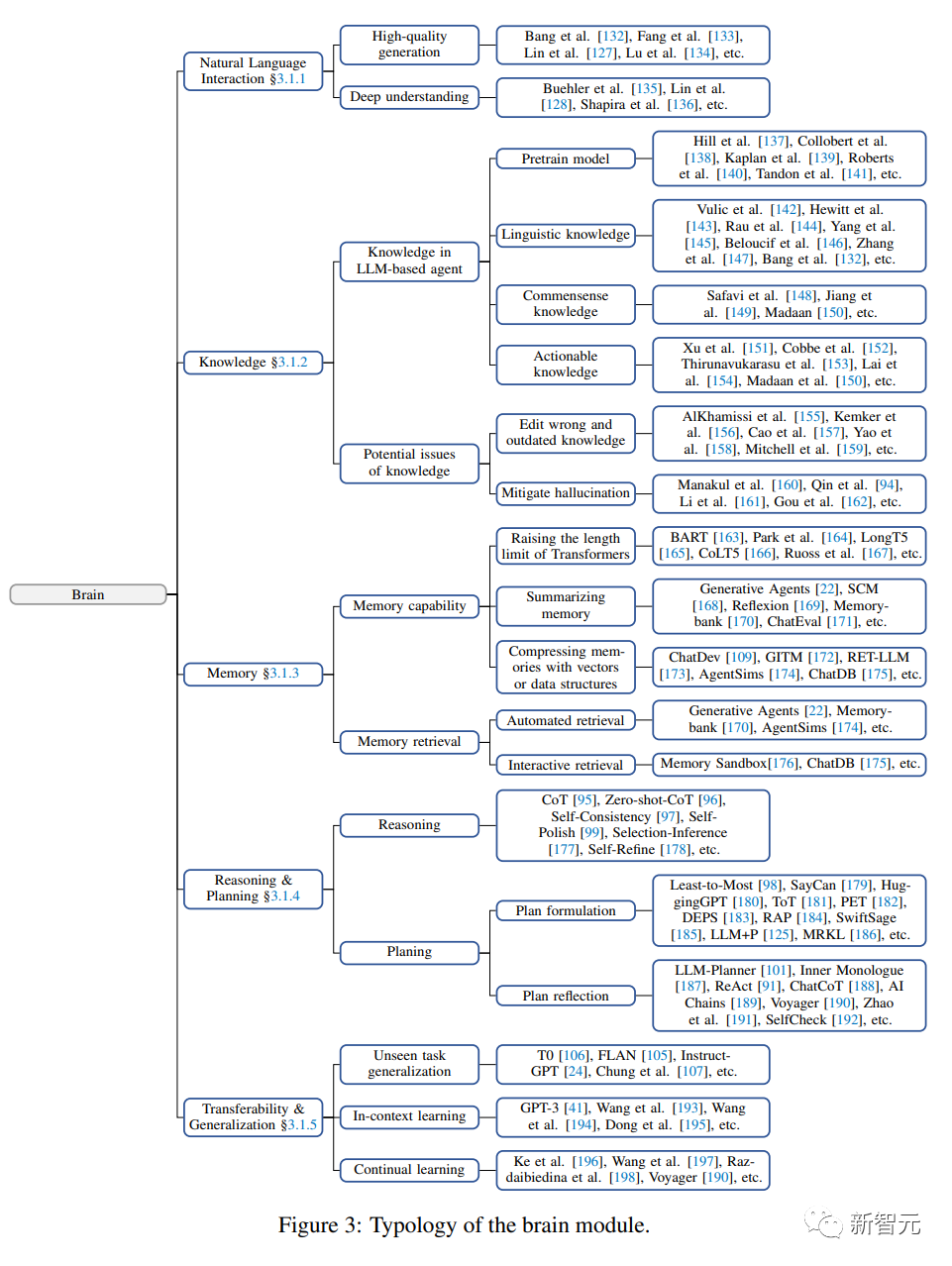

基于LLM的Agent的通用概念框架關鍵,包含了三個部分:大腦、感知和行動。

與人類相似,大腦也是AI Agent的核心,它由LLM組成。在智能體中,LLM負責存儲記憶和知識,還承擔著信息處理、決策等不可或缺的功能。

因此,LLM可以讓Agent呈現出推理和計劃的過程,并很好地應對未知任務,反映出智能代理的泛化性和遷移性。

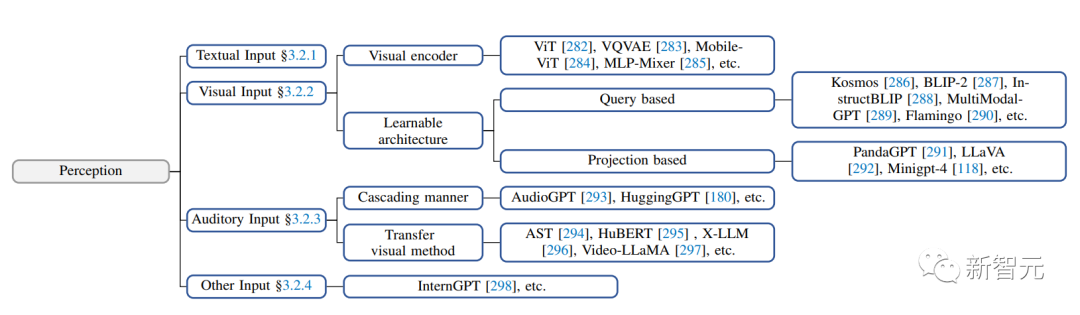

Agent的感知空間應從純文本拓寬到包括文本、視覺和聽覺等多模態領域,這樣使其能更有效地從周圍環境中獲取與利用信息。

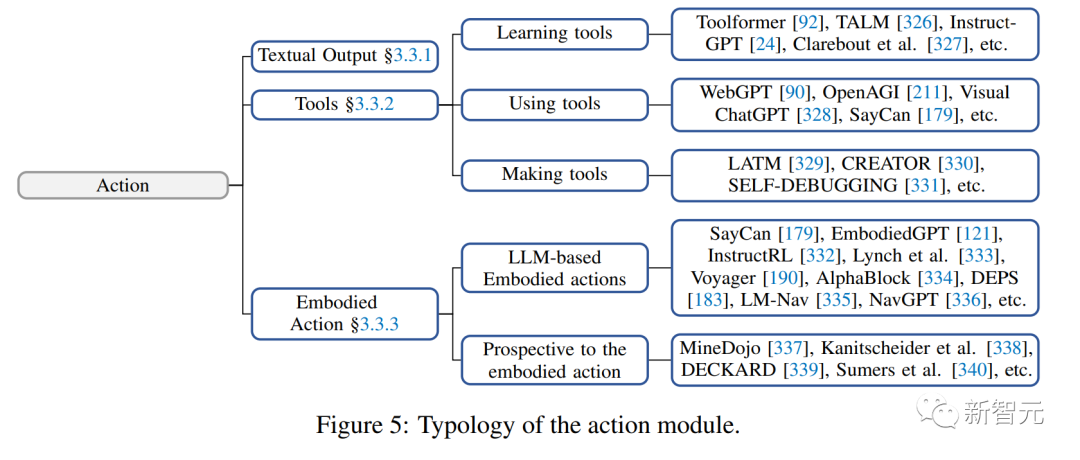

在Agent的行動方面,除了常規的文本輸出,還要賦予Agent具身能力、使用工具的能力,使其能夠更好地適應環境變化,通過反饋與環境交互,甚至能夠塑造環境。

Agent的實際應用場景

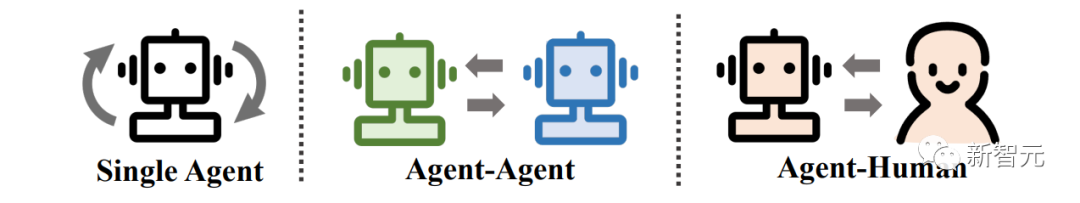

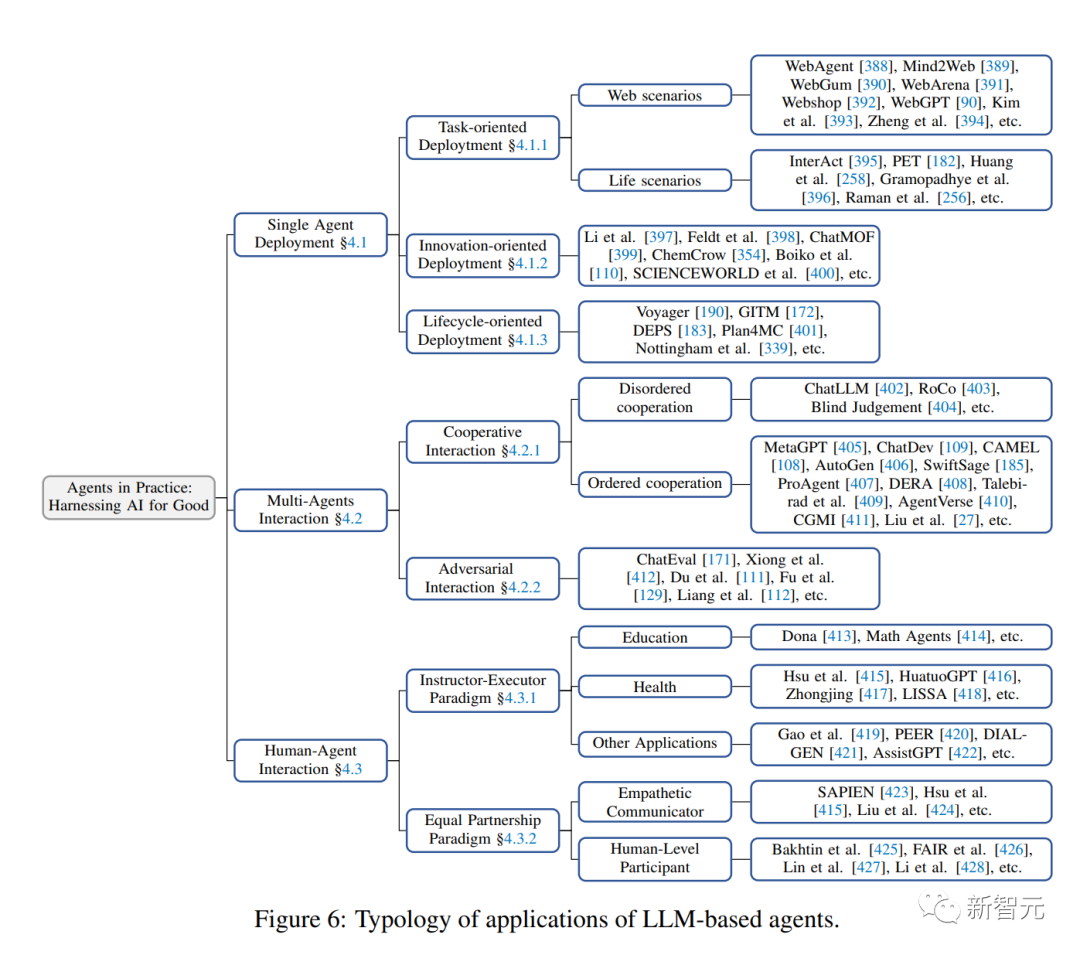

這里主要介紹三種Agent的應用場景:單Agent部署、多Agent交互和人與Agent交互。

單個Agent擁有多種能力,可以在各種應用方向上表現出優異的任務解決能力。

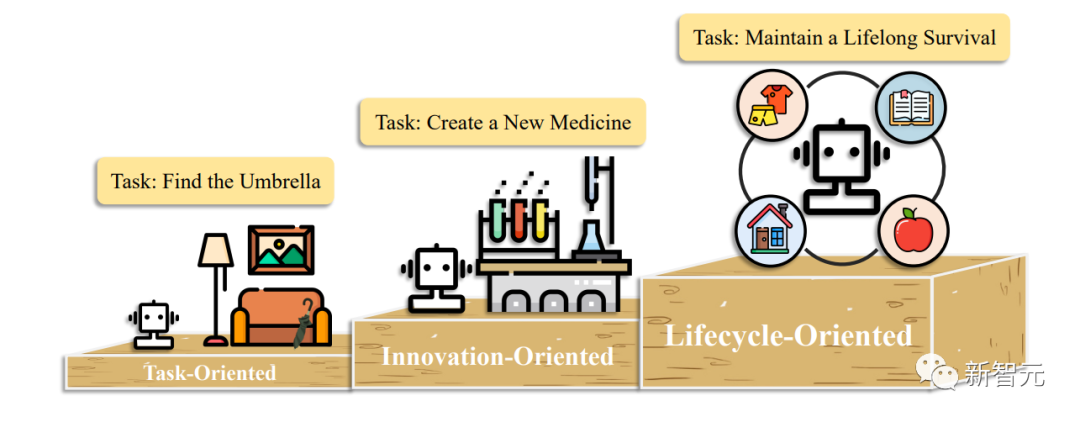

單Agent的應用被劃分為三個層次:

首先是任務導向的部署中,Agent可以協助人類用戶解決日常的基本任務,此時它們需要具備基本的指令理解和任務分解能力。

根據現有的任務類型,代理的實際應用可分為模擬網絡環境和模擬生活場景。

其次是在面向創新的開發中,Agent 展示了在科學領域進行自主探索的潛力。

盡管來自專業領域的固有復雜性和訓練數據的缺乏給代理構建帶來阻礙,但目前已經在化學、材料、計算機等領域取得進展。

在面向生命周期的部署中,Agent具有不斷探索、學習和利用新技能的能力,以確保能在開放世界中長期生存。

以《我的世界》游戲為例,游戲中的生存挑戰被認為是現實世界的縮影,已成為開發和測試代理綜合能力的獨特平臺。

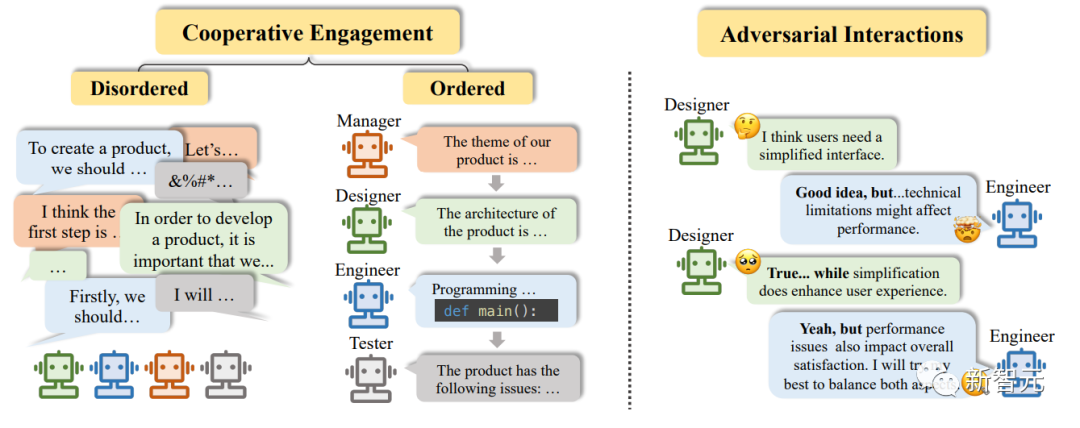

當多Agent進行互動時,它們可以通過合作或對抗性互動實現進步。

在合作互動中,Agent以無序或有序的方式進行協作,以實現共同目標。

在對抗性互動中,代理以針鋒相對的方式展開競爭,以提高各自的性能。

此外,在人-Agent 交互過程中,人類的反饋可以使 Agent 更高效、更安全地執行任務,同時 Agent 也可以為人類提供更好的服務。

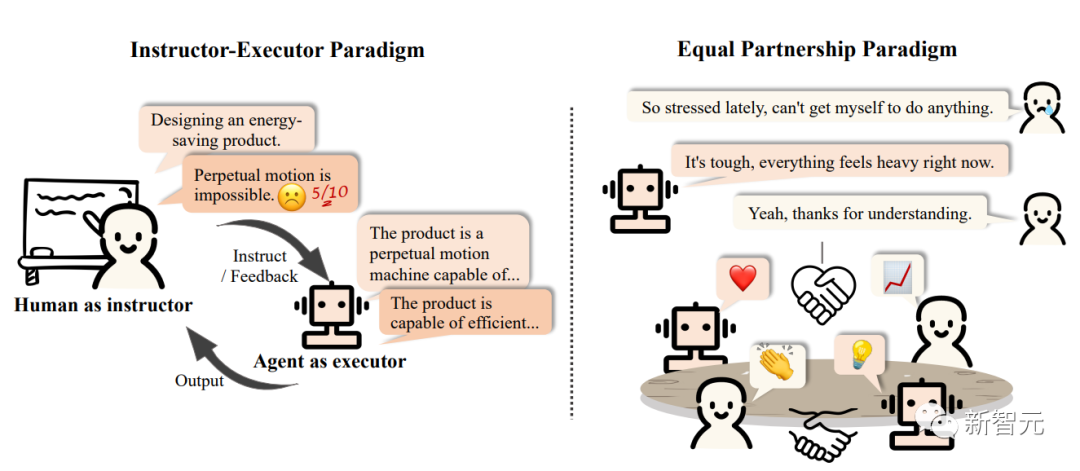

人類與Agent的互動可以分為兩種模式。

在指導者-執行者范式(左)中,人類提供指導或反饋,而代理則充當執行者。

在平等合作范式(右圖)中,Agent 像人類一樣,能夠與人類進行移情對話,并參與非合作任務。

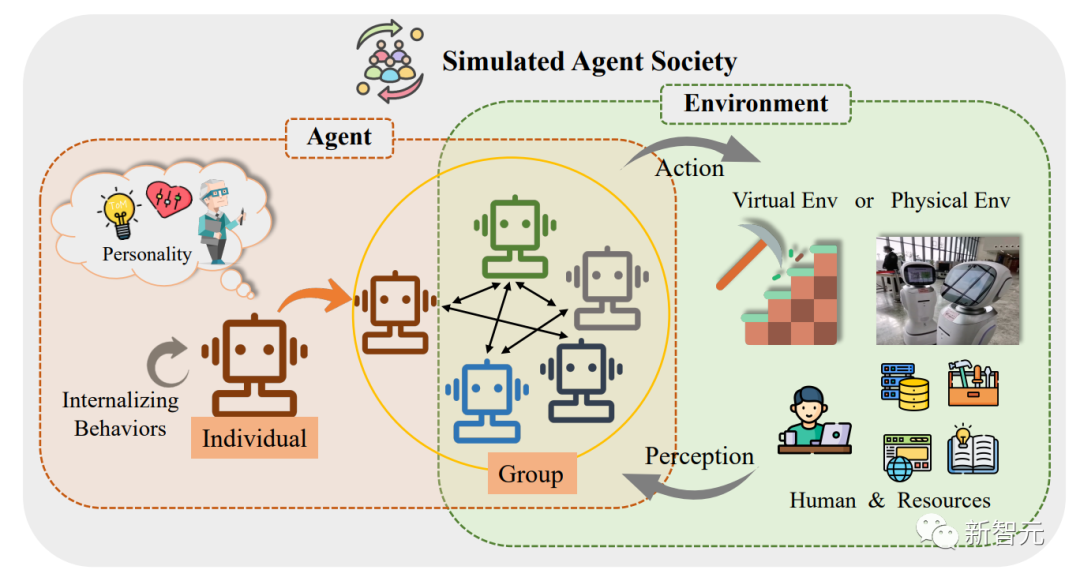

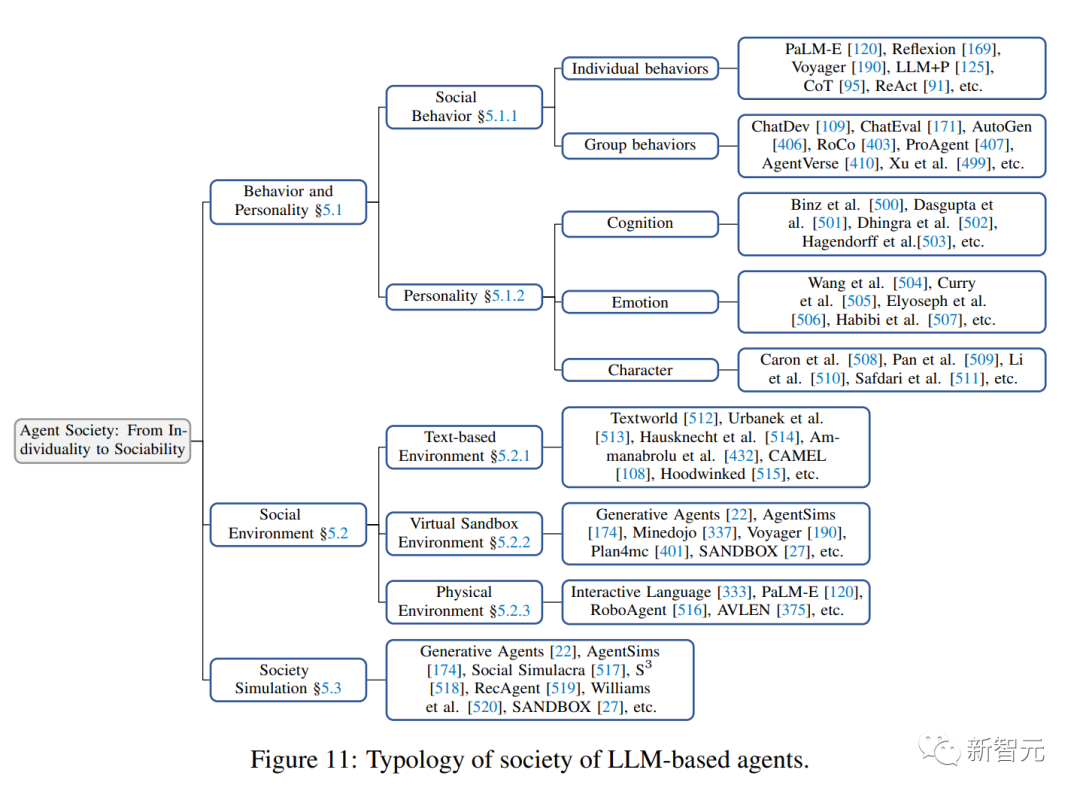

最后是由Agent組成的社會。

Agent的社會可以簡單分為兩個要素:Agent和環境。

在個體層面,Agent能夠表現出計劃、推理和反思等內化行為。它還表現出內在的人格特質,包括認知、情感和性格。

但一個代理可以和其他代理組成群體,并表現出群體行為,如合作。

在環境層面,無論是虛擬環境還是物理環境,包含人類行動者和所有可用資源,對于單個代理而言,其他代理也是環境的一部分。Agent 具有通過感知和行動與環境互動的能力。

網友熱議:AI Agent,啟動!

也許是原神和「技術宅拯救世界」的米哈游的「出境」,網友們對這篇論文可謂是十分上心。

有網友甚至想一天內讀完這篇80多頁的論文:

「我很想知道有沒有人能在一天內讀完并理解這篇論文,但我會嘗試一下的。」

另一位網友作為原神玩家直接就是:

「原神,啟動!」

雖然在這篇論文中并沒有提到AI Agent在游戲中的應用,但是米哈游和原神的出現,讓網友們十分興奮,開始暢想AI Agent對游戲的影響。

「這不僅是原神的未來,也會是所有游戲的未來。

讓AI Agent成為故事中我們的伙伴,他們會用自己的價值觀對玩家的選擇做出反應,而不是靠固定的腳本。」

也有網友對游戲和AGI的未來進行了一番暢想:

「如果AGI需要具身代理,那么游戲將會是實現的它的最佳場所。」