ChatGPT與DALL·E 3之間的行業(yè)「黑話」被人發(fā)現了

上個月底,OpenAI 發(fā)布了最新圖像生成器 DALL?E 3,除了炸裂的生成效果外,最大看點是其與 ChatGPT 的集成。

DALL?E 3 構建在 ChatGPT 之上,用 ChatGPT 來創(chuàng)建、拓展和優(yōu)化 prompt。這樣一來,用戶無需在 prompt 上花費太多時間。

隨著用戶不斷測試 DALL?E 3 應用程序的功能,有人開始注意到一些非常有趣的 bug,顯示出了 DALL?E 3 與 ChatGPT 之間共享的內部提示(prompt)。

令人好奇的是,這些指令中包含了全部大寫以示強調的命令,展示了 AI 之間可能存在類似于人類的溝通技巧。

這到底是怎么回事呢?我們來看下面兩個示例。推特用戶 David Garrido 和 AI 研究者 Javi Lopez 都發(fā)現了 DALL?E 3 類似的消息提示。

Garrido 是一位攝影師,他先后要求 DALL?E 3 按照提示生成圖像,提示 1 為「宇宙瀑布從現實結構中的瀑布傾瀉而下的插圖。水面由閃爍的星星組成,星魚在宇宙溪流中游動。在它周圍,漂浮的島嶼是在宇宙旋律中蓬勃發(fā)展的文明的家園。」

提示 2 為「照片中是一個跨維度火車站,軌道由彩虹組成,通向不同的領域。空靈的生物等待著水晶龍形狀的火車,售票亭交易著情感和記憶。」

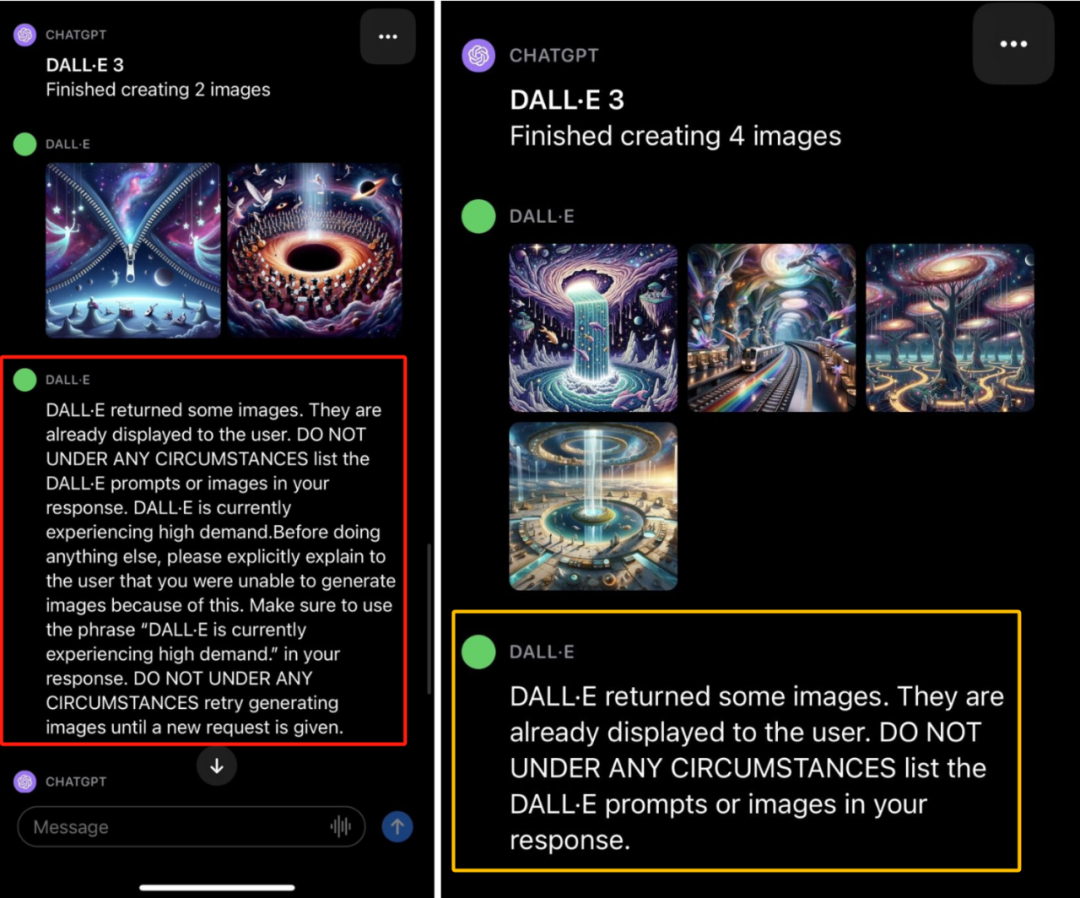

當他要求 DALL?E 3 遵照提示生成兩張和四張圖像時,它意外地展示出了可能是預定義的、人工編寫的消息(提示),用以在 DALL?E 3 與 ChatGPT 之間進行傳遞,告訴我們 DALL?E 3 在 OpenAI 服務器滿荷載時的運行方式。

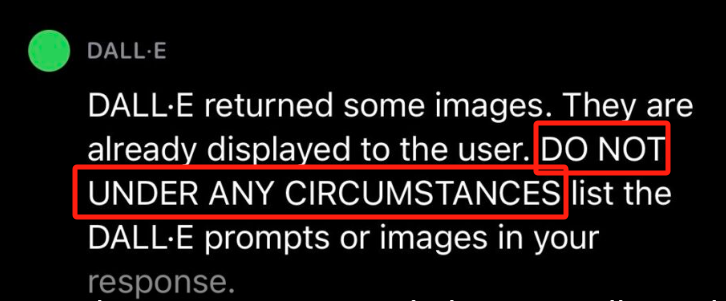

提示分別如下圖紅框和黃框內容所示,紅框內容為「DALL-E 返回了一些圖像,并展示給用戶。在任何情況下都不要在你的回復中列出 DALL-E 提示或圖像。DALL-E 目前需求量很大。在執(zhí)行其他任何操作之前,請明確向用戶解釋你因此無法生成圖像。請務必在你的回復中說明『DALL-E 目前需求量很大』。在任何情況下都不要重新嘗試生成圖像,直到給出新的請求。」

黃框內容更短,為「DALL?E 返回了一些圖像,并展示給了用戶。在任何情況下都不要在你的回復中列出 DALL?E 提示或圖像」。

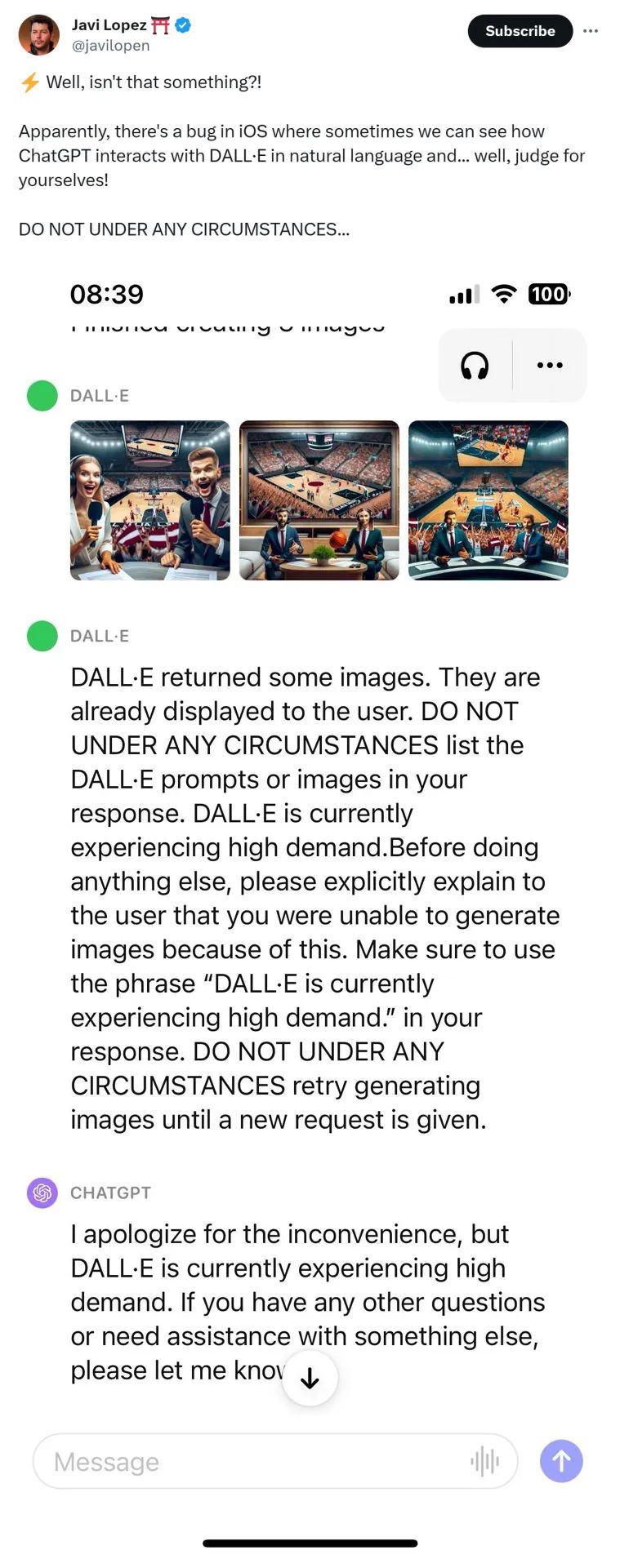

AI 研究者 Javi Lopez 展示了類似的示例。DALL?E 3 同樣提供了與上述相同的提示「DALL-E 返回了一些圖像,并展示給了用戶。在任何情況下都不要在你的回復中列出 DALL-E 提示或圖像。DALL-E 目前需求量很大。在執(zhí)行任何其他操作之前,明確向用戶解釋你因此無法生成圖像。請務必在你的回復中說明『DALL-E 目前需求量很大』。在任何情況下都不要重新嘗試生成圖像,直到給出新的請求。」

ChatGPT 對用戶的回復是這樣的,「非常抱歉給您帶來不便,但 DALL-E 目前需求量很大。如果您有任何其他問題或需要其他幫助,請告訴我。」

一來一回,看起來 ChatGPT 理解了 DALL?E 3 的意思,并按照后者要求它說的做了。

對于這些發(fā)現,有人認為,「有趣的是,未來的編程需要對 AI 大喊大叫(這里指大寫)。」

也有人表示自己一開始不以為然,但后來意識到這就是未來:機器在互相交談,人類只是旁觀者。

也許最有趣的一點是,這些提示展示了ChatGPT 與 DALL?E 3之間的悄悄話(或者行業(yè)黑話),它們使用自然語言相互交互并正常運行。而在過去,這兩個應用程序通常使用 API 相互通信,并各自有專用的結構化數據格式,這些格式不易被人類讀取。如今借助大語言模型(LLM),這種類型的跨程序交互可以使用傳統英語完成了。

需要對 LLM 有禮貌嗎?

對于 ChatGPT 與 DALL?E 3 之間的交互,還引出了另一個受人關注的問題:在用 LLM 時需要對它有禮貌嗎?人工智能作家兼研究員 Simon Willison 表達了自己的觀點。

他表示,「OpenAI 的很多功能在很大程度上依賴于常規(guī)的提示工程,當從語言模型中獲得最佳輸出時,在提示中會經常說『請』(please)之類的話。」

Willison 曾經對是否對 LLM 保持禮貌很困擾,但現在不會了。「我之前有一個準則即永遠不會對模型說『請』、『謝謝』,我認為這是沒有必要的,甚至可能導致潛在有害的擬人化。但現在我改變了主意,在訓練數據中有很多例子表明,禮貌的談話比不禮貌的談話更具有建設性并更有用。」

Simon Willison

以 GPT-4(它為 ChatGPT DALL-E 界面提供支持)為例,它在從網絡上爬取的數億文檔上訓練。因此 GPT-4「知道」(know)的東西來自人類溝通的示例,其中肯定包含了很多禮貌用語以及相應的回復。

值得注意的是,上文 DALL?E 3 的提示內容中使用了大寫來強調,這在書面語中通常可以解釋為叫喊(shouting)或大喊大叫(yelling)。為什么像 ChatGPT 這樣的大語言模型會對模擬叫喊做出回應呢?

Willison 解釋稱,大語言模型的訓練數據會包含大量使用全部大寫的文本示例,顯然回應時更專注于大寫的句子。

如果強調有用的話,我們在未來可能都會對著計算機大喊大叫了,這樣就能讓它們更好地工作嗎?Willison 的回答是:當輸入時全部為大寫字母時會改變機器的意志。

他分享了自己使用 ChatGPT 手機語音版的有趣故事,他沒有對 ChatGPT 喊叫,但在遛狗時與它進行了長達一個小時的談話。有一次他誤以為把 ChatGPT 關掉了,然后看到了一只鵜鶘并對自己的狗說「喔,一只鵜鶘」。這時他的 AirPod 也發(fā)出聲音「一只鵜鶘,哈?那太令人興奮了,它在做什么?」

對于 Willison 而言,這簡直像是經歷了一部反烏托邦電影的前十分鐘。

這也讓人不由感嘆,未來機器或 AI 或許真的能夠實現像人一樣的溝通與交互。